Google представила архитектуру Titans и фреймворк MIRAS

Google представили архитектуру Titans и фреймворк MIRAS, которые позволяют моделям ИИ работать гораздо быстрее и обрабатывать большие объемы данных за счет обновления основной памяти [1] во время ее активной работы.

В двух новых статьях, Titans [2] и MIRAS [3] , Google представила архитектуру и теоретическую схему, сочетающие скорость рекуррентных нейронных сетей (РНС) с точностью трансформеров. Titans – это конкретная архитектура (инструмент), а MIRAS – теоретическая основа (схема) для обобщения этих подходов. Вместе они развивают концепцию запоминания [4] во время тестирования – способности модели ИИ поддерживать долговременную память [5] за счёт включения более мощных метрик-сюрпризов (то есть неожиданных фрагментов информации) во время работы модели и без специального офлайн-обучения.

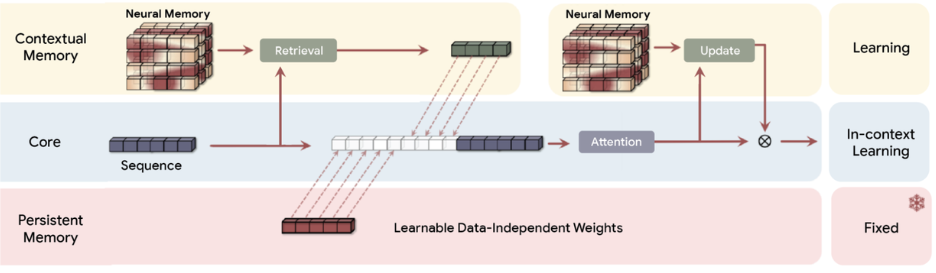

Эффективная система обучения [6] требует отдельных, но взаимосвязанных модулей памяти, отражающих разделение человеческого мозга на кратковременную и долговременную память [7]. Хотя механизмы внимания [8] превосходны для точной кратковременной памяти [9], Titans представляет новый нейронный модуль долговременной памяти [10] , который, в отличие от векторной или матричной памяти фиксированного размера в традиционных рекуррентных нейронных сетях, действует как глубокая нейронная сеть (в частности, многослойный персептрон [11]). Этот модуль памяти обеспечивает значительно более высокую выразительную способность, позволяя модели обобщать большие объёмы информации, не теряя важного контекста. Модель не просто делает заметки. Она понимает и синтезирует всю историю.

Важно отметить, что Titans не просто пассивно хранит данные. Он активно обучается распознавать и сохранять важные взаимосвязи и концептуальные темы, связывающие токены по всему объёму входных данных. Ключевым аспектом этой способности является то, что Google называет «метрикой неожиданности». В психологии человека известно, что мы быстро и легко забываем [12] привычные, ожидаемые события, но запоминаем то, что нарушает шаблон – неожиданные, удивительные или очень эмоциональные события.

В контексте Titans «метрика неожиданности» – это обнаружение моделью большой разницы между тем, что она помнит в данный момент, и тем, что сообщают ей новые входные данные.

-

Низкий уровень удивления: если новое слово – кошка, а состояние памяти модели уже предполагает наличие слова, обозначающего животное, градиент (удивление) низкий. Модель может спокойно пропустить запоминание этого слова в своем постоянном долгосрочном состоянии.

-

Высокая степень неожиданности: если состояние памяти модели представляет собой обобщение серьёзного финансового отчёта, а новые входные данные представляют собой изображение банановой кожуры (неожиданное событие), градиент (неожиданность) будет очень высоким. Это означает, что новые входные данные важны или аномальны, и им необходимо придать приоритет для постоянного хранения в модуле долговременной памяти [13].

Уникальность и практичность MIRAS обусловлены его подходом к моделированию ИИ. Вместо того, чтобы рассматривать различные архитектуры, MIRAS видит различные методы решения одной и той же задачи: эффективное сочетание новой информации со старыми воспоминаниями, не допуская забвения основных концепций .

MIRAS определяет модель последовательности с помощью четырех ключевых вариантов проектирования:

-

Архитектура памяти: структура, которая хранит информацию (например, вектор, матрица или глубокий многослойный персептрон, как в Титанах).

-

Смещение внимания: внутренняя цель обучения, которую оптимизирует модель и которая определяет ее приоритеты.

-

Механизм запоминания: регуляризатор памяти. MIRAS переосмысливает механизмы забывания [14] как особые формы регуляризации , [15] которые обеспечивают баланс между новым обучением и сохранением прошлых знаний.

-

Алгоритм памяти: алгоритм оптимизации, используемый для обновления памяти.

Делегируйте часть рутинных задач вместе с BotHub! [16] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [17] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [18]

Автор: MrRjxrby

Источник [19]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/22811

URLs in this post:

[1] памяти: http://www.braintools.ru/article/4140

[2] Titans: https://arxiv.org/abs/2501.00663

[3] MIRAS: https://arxiv.org/pdf/2504.13173

[4] запоминания: http://www.braintools.ru/article/722

[5] долговременную память: http://www.braintools.ru/article/9500

[6] обучения: http://www.braintools.ru/article/5125

[7] разделение человеческого мозга на кратковременную и долговременную память: https://research.google/blog/introducing-nested-learning-a-new-ml-paradigm-for-continual-learning/

[8] внимания: http://www.braintools.ru/article/7595

[9] кратковременной памяти: http://www.braintools.ru/article/9493

[10] модуль долговременной памяти: https://arxiv.org/abs/2306.07174#:~:text=LongMem%20can:%20*%20Memorize%20long%20past%20context,Yan%20*%20Jianfeng%20Gao%20*%20Furu%20Wei

[11] многослойный персептрон: https://en.wikipedia.org/wiki/Multilayer_perceptron

[12] забываем: http://www.braintools.ru/article/333

[13] долговременной памяти: http://www.braintools.ru/article/9289

[14] забывания: http://www.braintools.ru/article/3931

[15] ,: https://dev.to/nareshnishad/day-27-regularization-techniques-for-large-language-models-llms-4af3

[16] BotHub!: https://bothub.chat/?utm_source=contentmarketing&utm_medium=habr&utm_campaign=news&utm_content=GOOGLE_INTRODUCED_THE_TITANS_ARCHITECTURE_AND_THE_MIRAS_FRAMEWORK

[17] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[18] Источник: https://research.google/blog/titans-miras-helping-ai-have-long-term-memory/

[19] Источник: https://habr.com/ru/companies/bothub/news/973904/?utm_source=habrahabr&utm_medium=rss&utm_campaign=973904

Нажмите здесь для печати.