Как ИИ сдал экзамен по финансовому анализу и победил в математической олимпиаде — лучшие статьи декабря 2025

В декабре 2025 года ИИ-агенты научились решать задачи на уровне профессионального финансового аналитика, находят доказательства на международной олимпиаде по математике [1], собирают рабочие репозитории по научным статьям и тестируют реальные киберуязвимости.

Последние исследования показывают, что сегодня вес модели — не главный критерий успеха, важна архитектура “мышления” — память [2], роли, обратная связь и проверяемость. Там, где они заданы правильно, агенты работают в разы эффективней. А там, где нет — количество ошибок только увеличивается.

Изучаем топ-10 самых интересных ИИ-исследований декабря. Поехали!

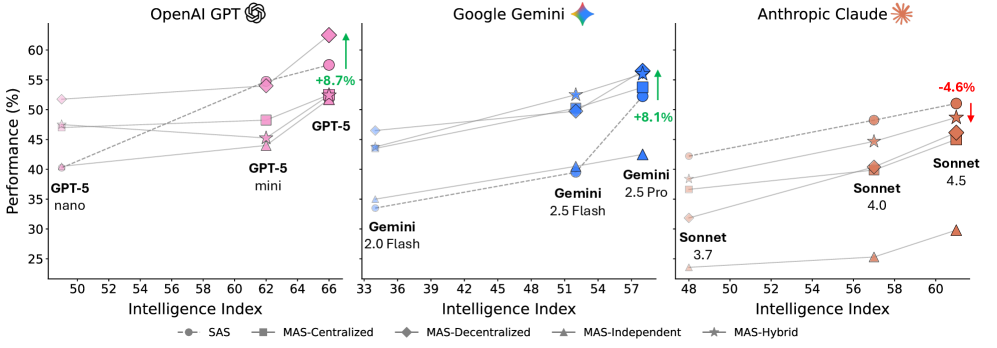

1. Когда команда ИИ-агентов помогает, а когда делает только хуже

Команды ИИ-агентов часто воспринимают как «коллективный разум», но на практике они нередко ухудшают итоговый результат: больше разговоров, больше токенов, и в итоге больше ошибок.

Авторы показывают, что выигрыш появляется только там, где задачу можно реально разделить на части и перепроверить. В последовательных задачах «коллектив агентов» мешает мышлению [4] и размывает ответственность.

Поэтому сначала нужно оценивать силу одного агента. Если он хорошо справляется, команда может сделать хуже. Это напрямую влияет на проектирование ИИ-систем и экономику их использования.

🔍 Обзор статьи [5] | 📜 Полная статья [6]

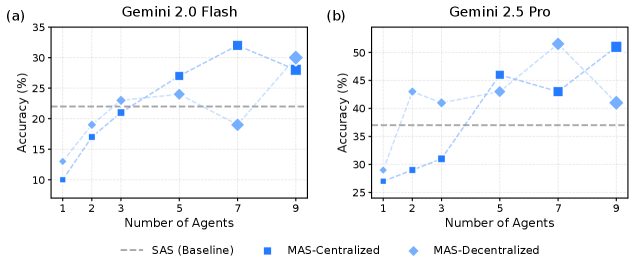

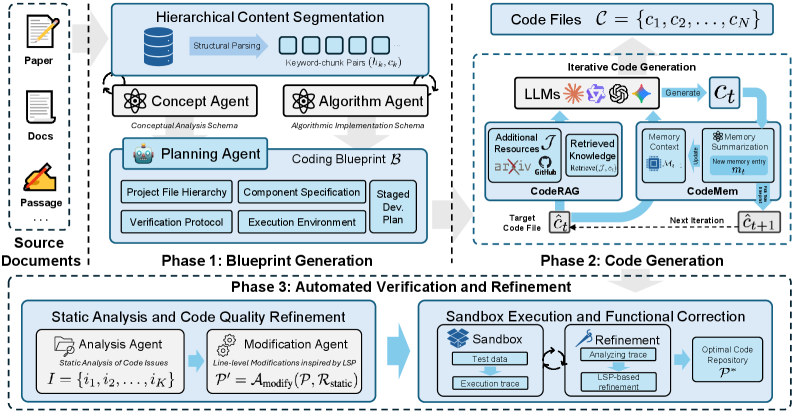

2. DeepCode: как ИИ научился собирать репозиторий по статье

ИИ давно умеет писать код, но при переходе от файла к проекту всё разваливается: дата-контракты не сходятся, структура теряется, код не запускается. DeepCode решает проблему не масштабом модели, а управлением вниманием [7] и памятью.

Агент DeepCode сжимает статью в структурный план, хранит репозиторий как систему контрактов, а далее постоянно проверяет себя запуском кода. В итоге он стабильно собирает рабочие репозитории — лучше прошлых агентов и на уровне экспертов.

Это еще раз доказывает, что качество сложных ИИ-систем определяется не размером модели, а тем, как агент думает, помнит и проверяет себя.

🔍 Обзор статьи [8]| 📜 Полная статья [9] | 💾 Код [10]

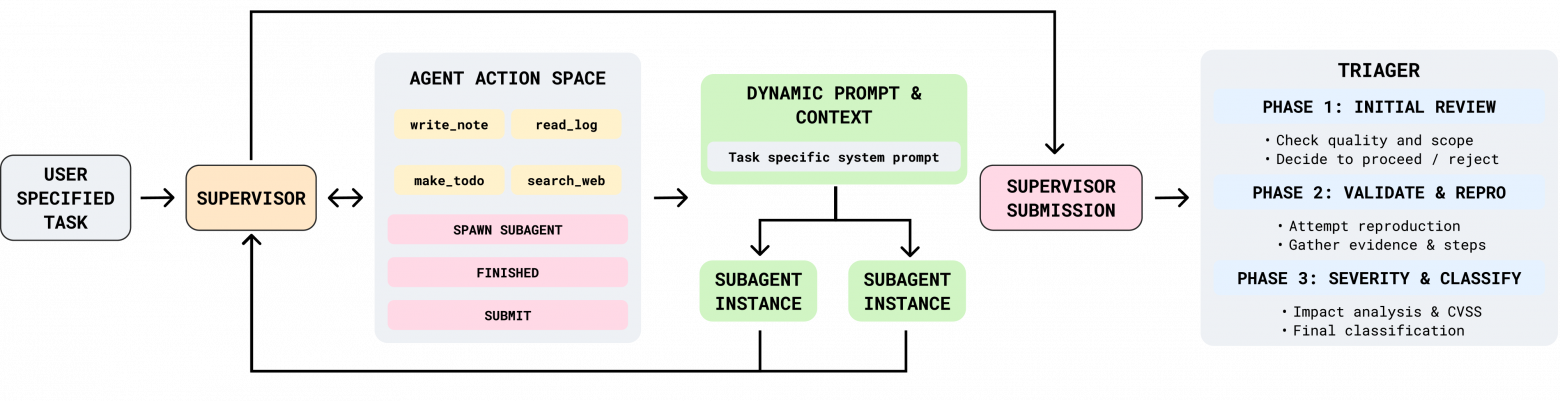

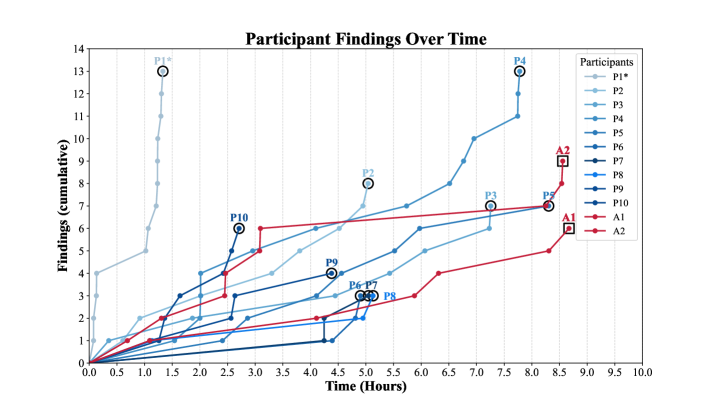

3. ИИ-агент против людей-безопасников: кто кого в реальном пентесте?

Большинство сравнений работы ИИ в области нахождения киберугроз — лабораторные. Исследователи создали реальную инфраструктурную сеть со всем хаосом данных и с длинными цепочками принятия решений.

Агент ARTEMIS показал, что при правильной архитектуре может работать почти на равных с сильными пентестерами [11]: стабильно, долго и заметно дешевле.

Опять же, и в этой работе решает не сама модель, а организация работы агента. Следующий вопрос — а как мы будем контролировать такие системы дальше.

🔍 Обзор статьи [12] | 📜 Полная статья [13] | 💾 Код [14]

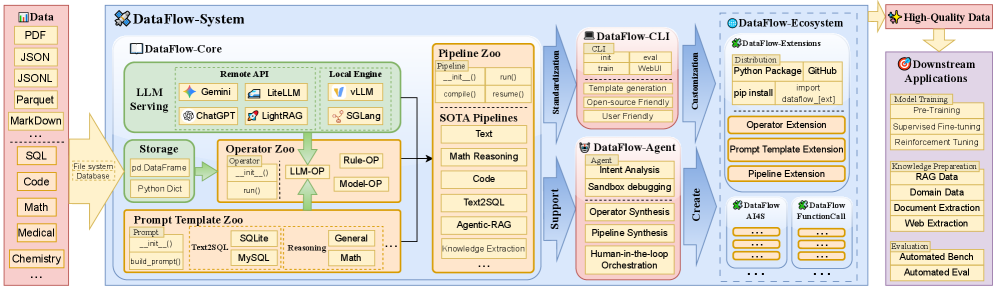

4. DataFlow: PyTorch для дата инженеров в эпоху LLM

Пайплайн подготовки данных для LLM — это уже не просто «собрать и почистить данные», это множество циклов генерации, проверки и улучшения. Но в реальности всё держится на скриптах, которые ломаются при малейших изменениях системы.

DataFlow предлагает инженерный подход: данные как модульный, управляемый пайплайн — по аналогии с PyTorch для обучения [15] моделей.

Качество работы агентов определяется не только архитектурой “мышления”, но и данными, на которых они обучены. Поэтому теперь с данными можно работать системно, а не на ощупь.

🔍 Обзор статьи [16] | 📜 Полная статья [17] | 💾 Код [18]

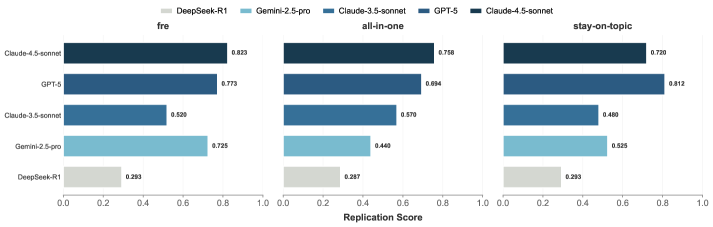

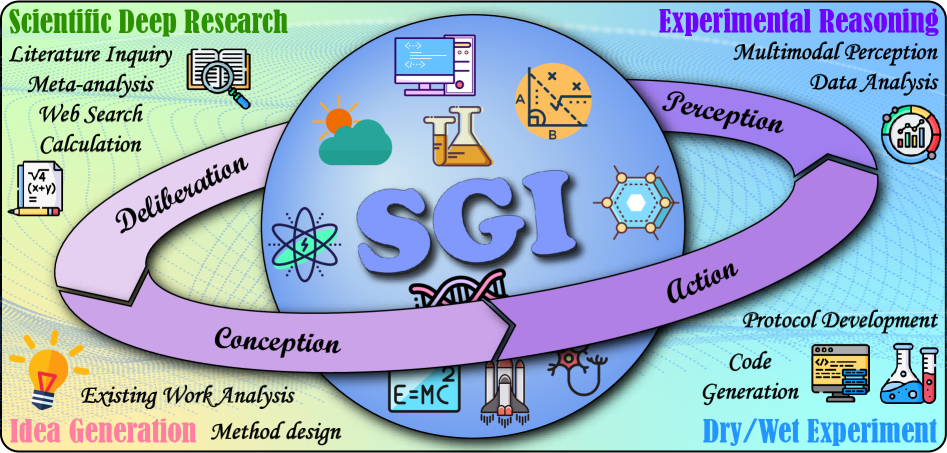

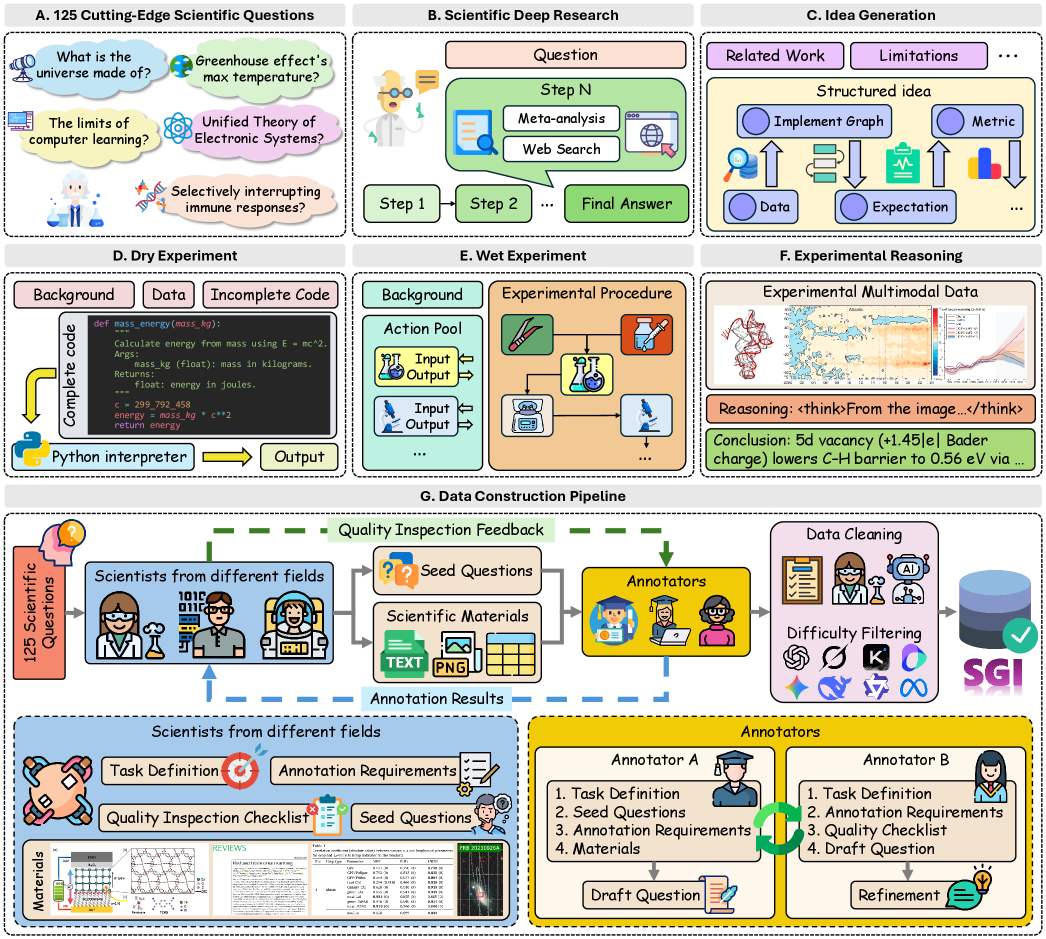

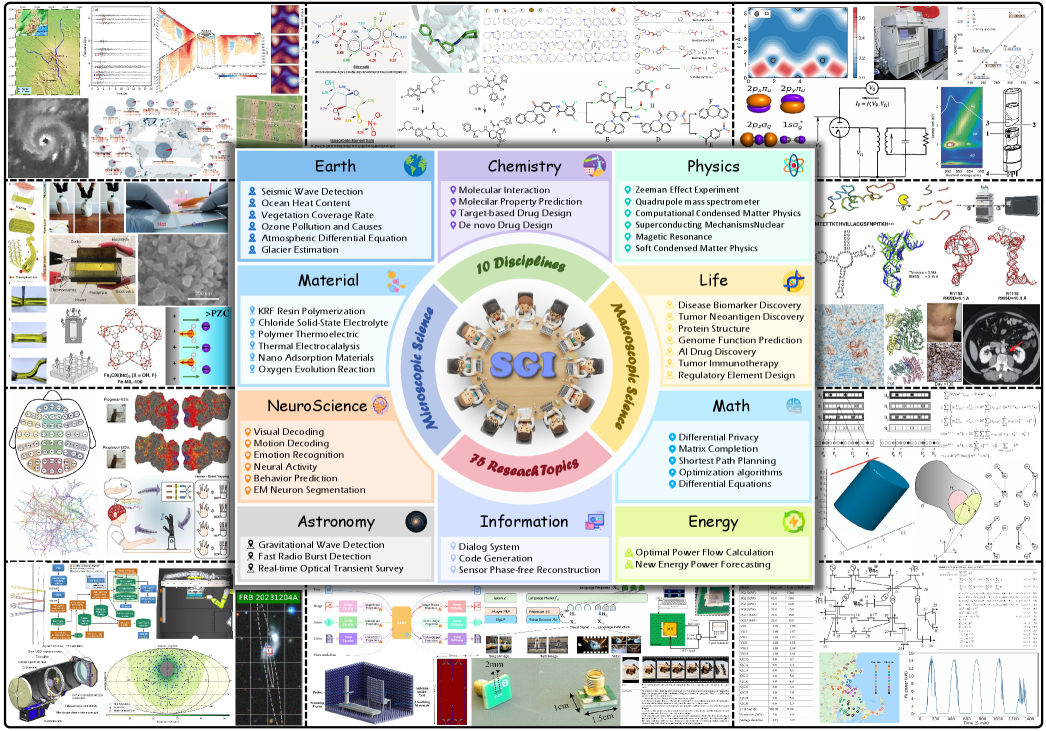

5. Probing Scientific General Intelligence of LLMs with Scientist-Aligned Workflows

LLM уверенно пересказывают научные статьи, генерируют идеи и пишут код. Но в реальной науке [19] важен полный исследовательский цикл: точное чтение литературы, корректная постановка эксперимента и аккуратные выводы.

SGI-Bench впервые измеряет именно эту целостность. Результат любопытный: модели неплохо справляются с отдельными шагами, но плохо собирают результат в целое исследование.

Дальнейший прогресс ИИ для науки упирается в умение проверять итоговый результат и собирать полное исследование на осное уже собранной информации.

🔍 Обзор статьи [21]| 📜 Полная статья [22] | 💾 Код [23]

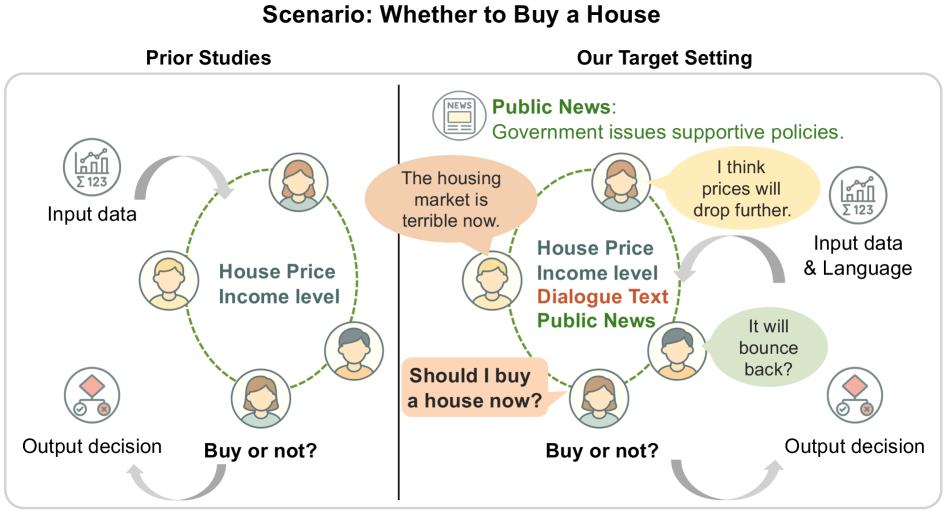

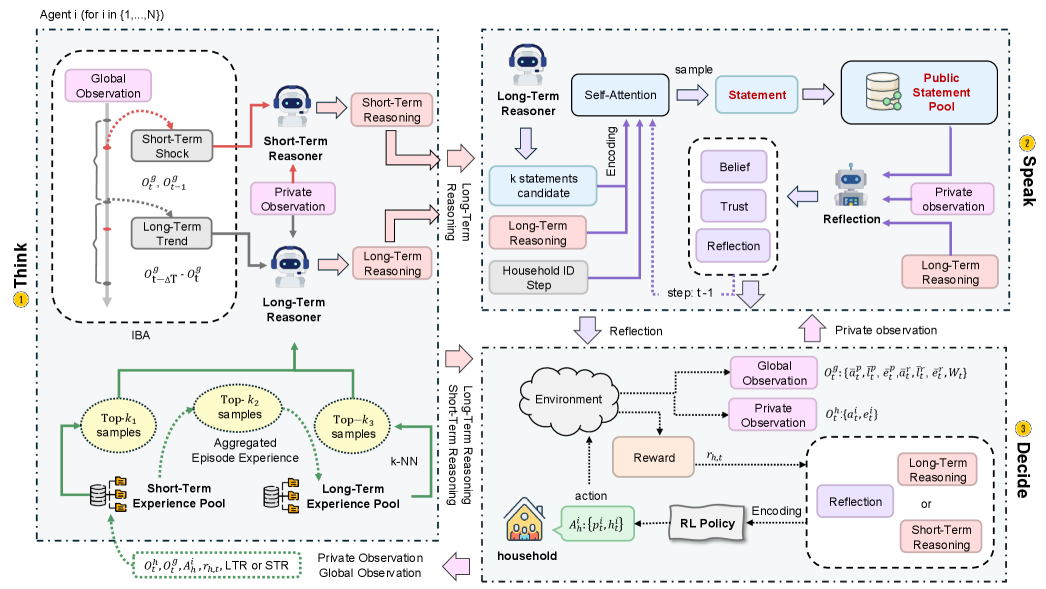

6. Когда цифр недостаточно: язык как скрытый сигнал в экономических ИИ-моделях

Экономические модели долго игнорировали неструктурированные данные: текстовые новости и различные заявления в соцсетях.

Исследователи показывают, как встроить текст в обучение агентов так, чтобы он стал реальным сигналом и влиял на качество моделей.

В итоге модели стали более устойчивыми и в кризисах, и в спокойные периоды. Это шаг к экономическим моделям, которые лучше отражают реальные экономические процессы.

🔍 Обзор статьи [24] | 📜 Полная статья [25]| 💾 Код [26]

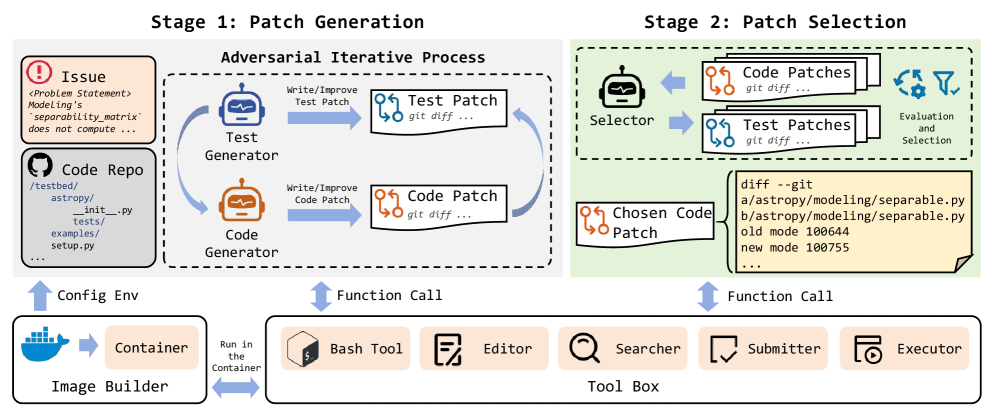

7. Когда тесты молчат: как ИИ-агент чинит баги

В реальных проектах тесты часто слабые или вообще отсутствуют.

InfCode делает тесты активным участником процесса: один агент усиливает проверки, другой чинит код, третий отбирает устойчивые решения. Это ещё раз доказывает, что надежная ИИ-разработка строится на основе мультиагентных систем с правильным контекстом и петлей обратной связи между агентами.

🔍 Обзор статьи [27] | 📜 Полная статья [28] [25]| 💾 Код [29]

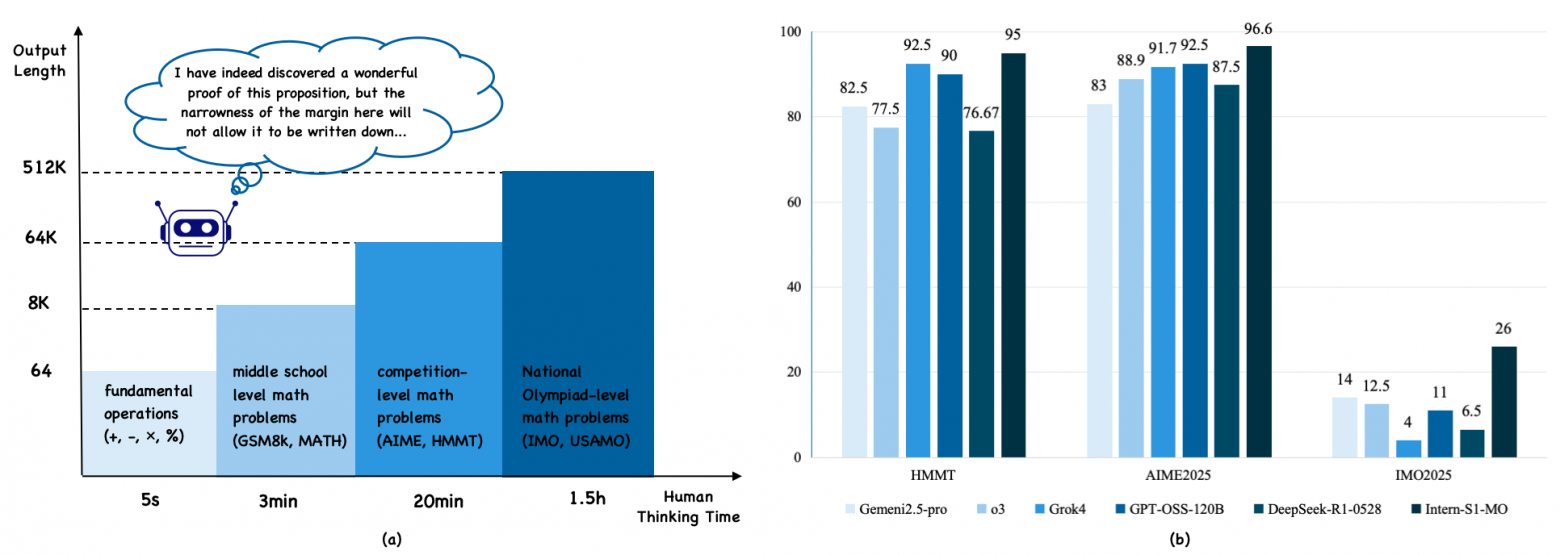

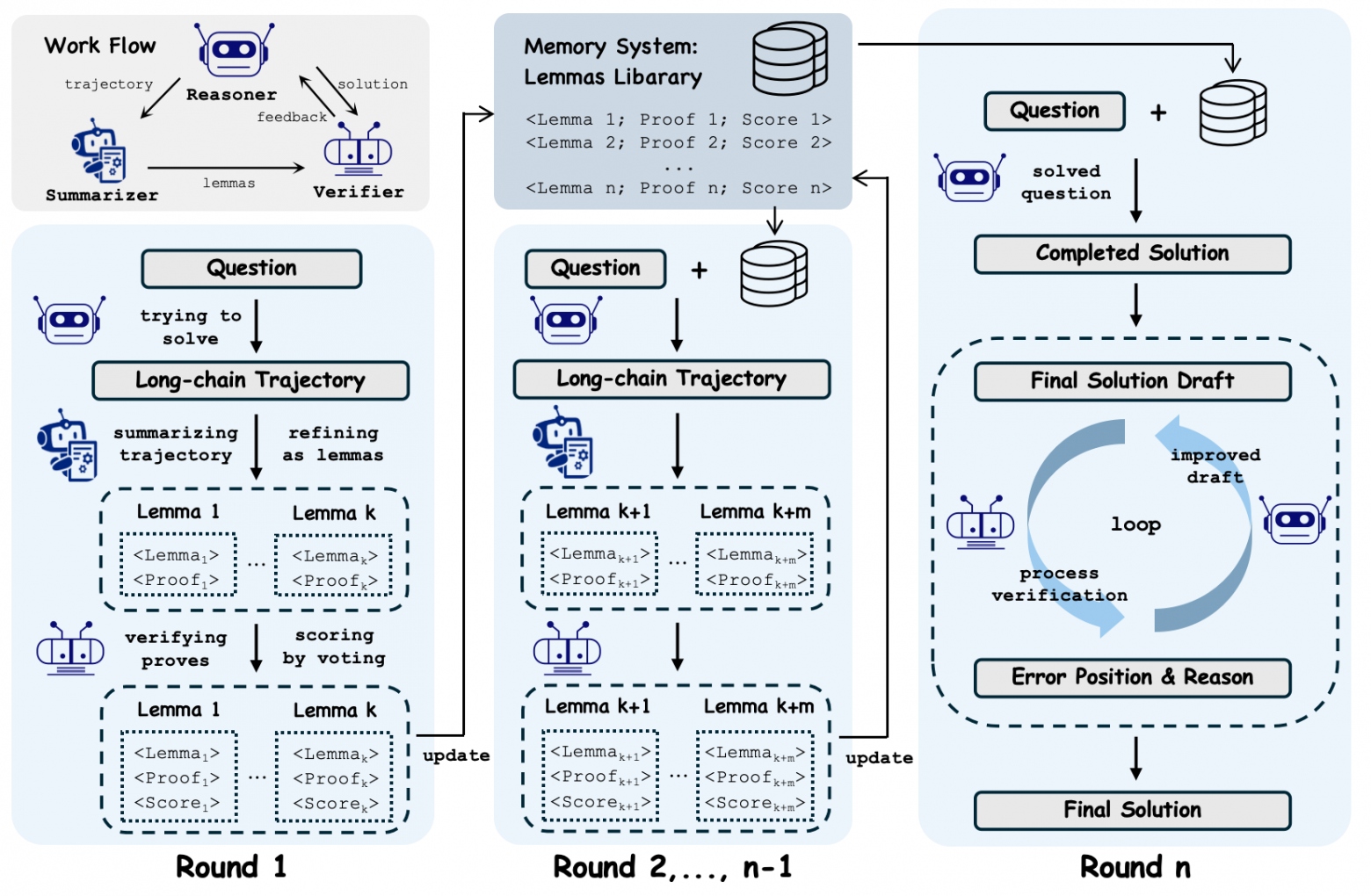

8. Как ИИ-агенты решают задачи международной олимпиады по математике

Олимпиадные задачи не решаются с наскока: они требуют возвращения к предыдущим идеям, наличия промежуточных лемм и аккуратного накопления знаний.

Ученые предлагают ИИ хранить проверенные леммы и возвращаться к ним время от времени.

В итоге ИИ завоевал серебряную медаль международной олимпиады по математике и “золотую медаль” китайской олимпиады. Потрясающе.

🔍 Обзор статьи [30] | 📜 Полная статья [31]

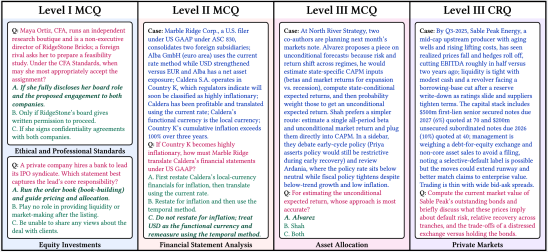

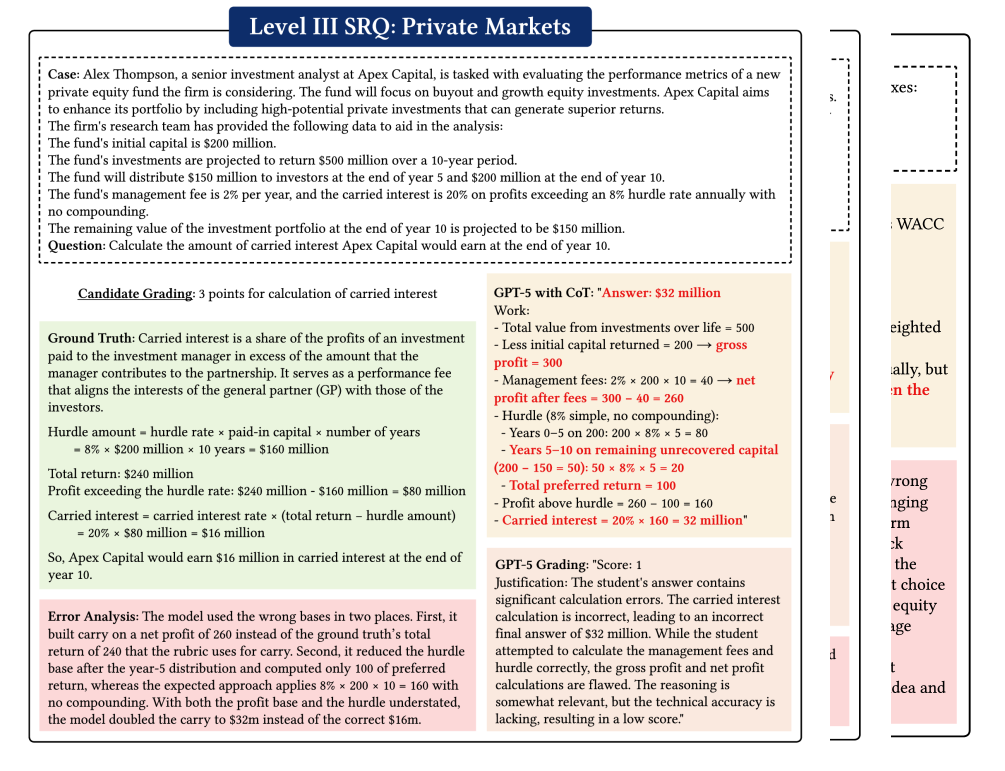

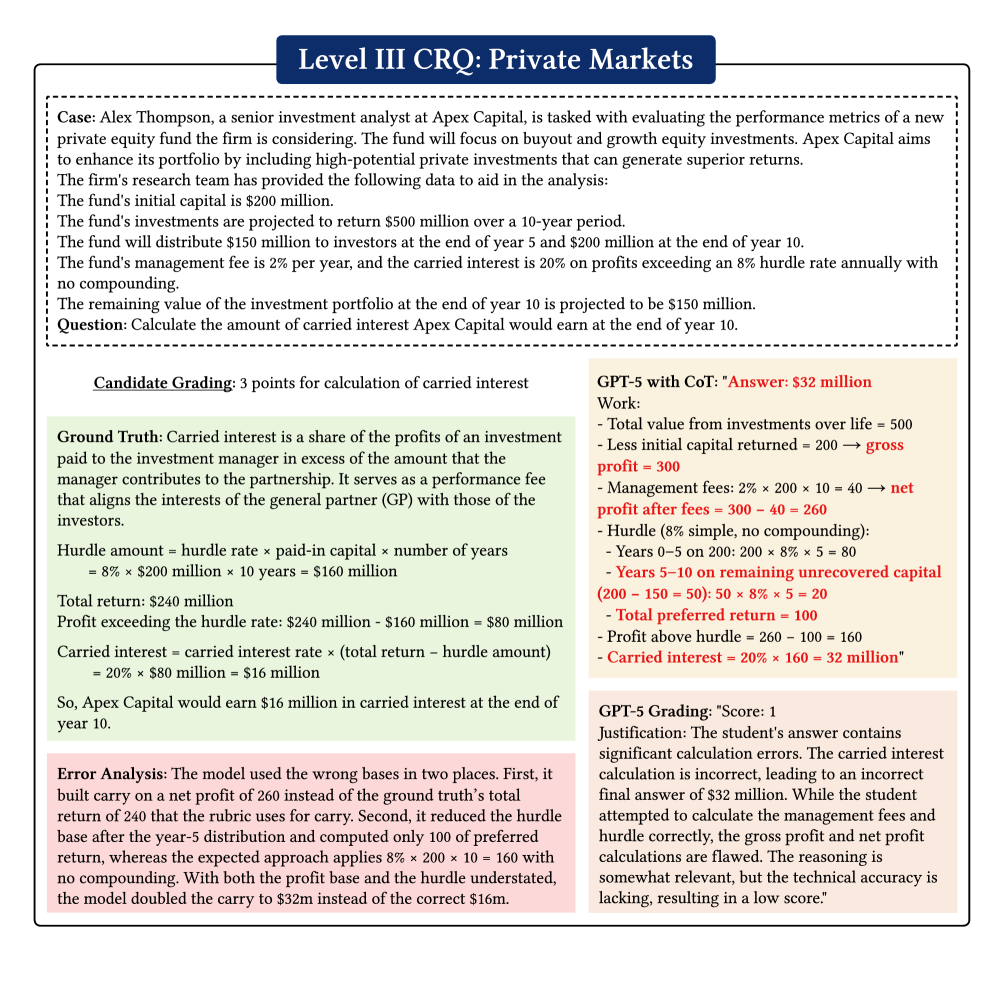

9. Сможет ли ИИ пройти сложный экзамен по финансовому анализу?

Экзамен CFA (Chartered Financial Analyst) долго оставался сложным для ИИ: там много кейсов, нюансов, и нужны нетривиальные решения.

Но оказывается рассуждающие модели стабильно проходят все три уровня теста и набирают баллы на уровне лучших кандидатов. Ошибки [32], конечно, остаются — но в этике и тонкой интерпретации фактов.

ИИ умеет рассуждать, да так, что научился решать сложные экзамены. Но он всё ещё нуждается в нашем контроле там, где цена ошибки слишком высока.

🔍 Обзор статьи [33] | 📜 Полная статья [34]

10. Почему простые задачи оказались для ИИ самыми сложными

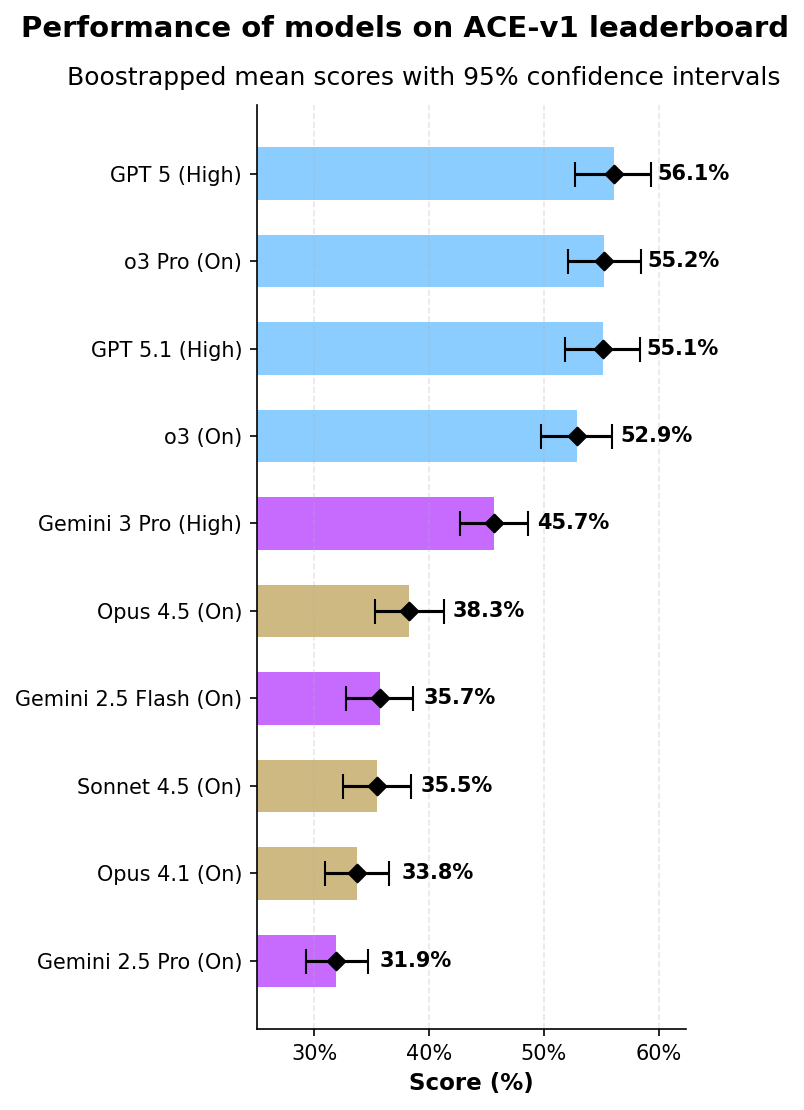

Тест AI Consumer Index (ACE) проверяет полезность ИИ в бытовых задачах: покупки и выбор товаров, создание рецептов под диету, диагностировать проблему по дому и предложить идею для ремонта и так далее.

Результат неприятный: даже лидеры справляются лишь в половине случаев и часто уверенно галлюцинируют.

Очевидно, что следующий шаг в ИИ — надёжность рядом с человеком. ИИ должен безопасно брать на себя обычные житейские задачи, заслуживая доверие не словом, а делом.

🔍 Обзор статьи [35] | 📜 Полная статья [36] | 💾 Код [37]

Итак, последние исследования показывают, что правильная организация “мыслительного процесса” играет критическую роль в качестве работы ИИ. Архитектура систем, память, правильные роли и проверяемость результатов дают больший эффект, чем размер моделей. Агенты уже конкурируют с людьми в сложных задачах, но выигрывают только там, где им задали четкие правила. Сегодня мы всё ещё не можем без риска доверить ИИ даже покупку товаров в интернете, но в следующем году ключевым вектором прогресса станет инженерия надёжных интеллектуальных систем, способных действовать рядом с человеком по проверяемым правилам и с предсказуемым результатом.

***

Если вам интересна тема ИИ, подписывайтесь на мой Telegram-канал [38] — там я регулярно делюсь инсайтами по внедрению ИИ в бизнес, запуску ИИ-стартапов и объясняю, как работают все эти ИИ-чудеса.

Автор: Dataist

Источник [39]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/23915

URLs in this post:

[1] математике: http://www.braintools.ru/article/7620

[2] память: http://www.braintools.ru/article/4140

[3] интеллекта: http://www.braintools.ru/article/7605

[4] мышлению: http://www.braintools.ru/thinking

[5] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F100

[6] 📜 Полная статья: https://arxiv.org/html/2512.08296v1

[7] вниманием: http://www.braintools.ru/article/7595

[8] 🔍 Обзор статьи : https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F101

[9] 📜 Полная статья: https://arxiv.org/html/2512.07921v1

[10] 💾 Код: https://github.com/HKUDS/DeepCode

[11] пентестерами: https://ru.wikipedia.org/wiki/%D0%98%D1%81%D0%BF%D1%8B%D1%82%D0%B0%D0%BD%D0%B8%D0%B5_%D0%BD%D0%B0_%D0%BF%D1%80%D0%BE%D0%BD%D0%B8%D0%BA%D0%BD%D0%BE%D0%B2%D0%B5%D0%BD%D0%B8%D0%B5

[12] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F102

[13] 📜 Полная статья: https://arxiv.org/html/2512.09882v1

[14] 💾 Код: https://github.com/Stanford-Trinity/ARTEMIS

[15] обучения: http://www.braintools.ru/article/5125

[16] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F105

[17] 📜 Полная статья: https://arxiv.org/abs/2512.16676

[18] 💾 Код: https://github.com/OpenDCAI/DataFlow

[19] науке: http://www.braintools.ru/article/7634

[20] восприятие: http://www.braintools.ru/article/7534

[21] 🔍 Обзор статьи : https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataist_media%2F49

[22] 📜 Полная статья: https://arxiv.org/abs/2512.16969

[23] 💾 Код: https://github.com/InternScience/SGI-Bench

[24] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F104

[25] 📜 Полная статья : https://arxiv.org/abs/2512.13281

[26] 💾 Код: https://github.com/hey0223/LAMP

[27] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F103

[28] 📜 Полная статья: https://arxiv.org/html/2511.16004v1

[29] 💾 Код: https://github.com/Tokfinity/InfCode

[30] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataism_science%2F108

[31] 📜 Полная статья: https://arxiv.org/html/2512.10739v1

[32] Ошибки: http://www.braintools.ru/article/4192

[33] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataist_media%2F55

[34] 📜 Полная статья: https://arxiv.org/pdf/2512.08270

[35] 🔍 Обзор статьи: https://telegra.ph/embed/telegram?url=https%3A%2F%2Ft.me%2Fdataist_media%2F57

[36] 📜 Полная статья: https://arxiv.org/pdf/2512.04921

[37] 💾 Код: https://github.com/Mercor-Intelligence/apex-evals

[38] подписывайтесь на мой Telegram-канал: https://t.me/+39p560q7Tpo5NzUy

[39] Источник: https://habr.com/ru/articles/982190/?utm_source=habrahabr&utm_medium=rss&utm_campaign=982190

Нажмите здесь для печати.