Общество мыслей: совещание внутри LLM

Общество мыслей: совещание внутри LLM

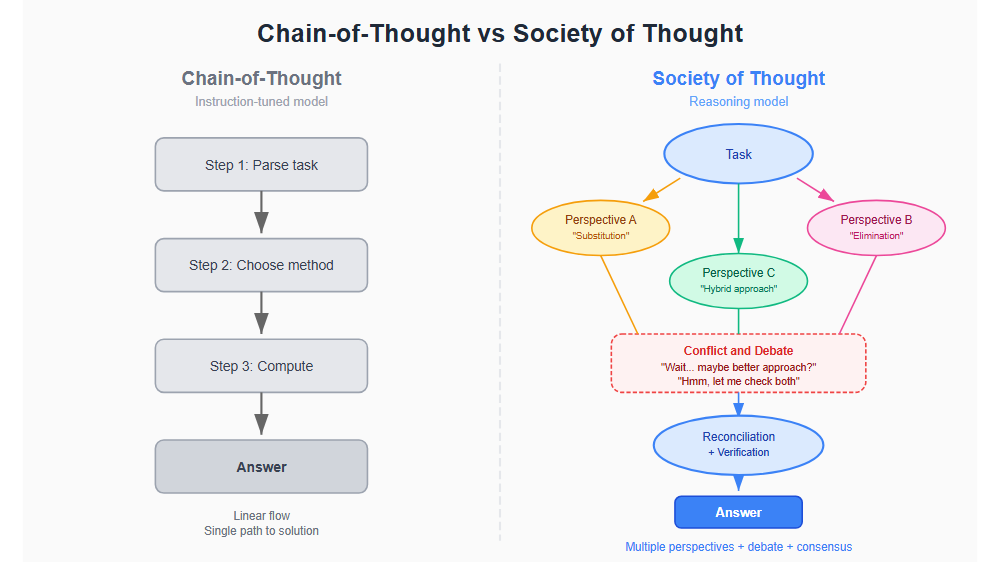

Вы наверняка слышали про Chain-of-Thought. “Пусть модель думает вслух, и она станет умнее” — звучит логично [1], правда? Добавляем “Let’s think step by step” в промпт, модель генерирует больше токенов, качество растёт. Почему это работает — долгое время было неочевидно.

Но вот что странно: DeepSeek-R1, QwQ-32B и модели серии OpenAI o (o1, o3) показывают результаты, которые невозможно объяснить просто “более длинными рассуждениями”. Они решают задачи, на которых обычные модели с Chain-of-Thought спотыкаются. И дело не в размере модели и не в количестве токенов.

Исследователи из Google Research и University of Chicago в статье “Reasoning Models Generate Societies of Thought” [2] заглянули внутрь этих моделей — и обнаружили там нечто неожиданное. Внутри reasoning-моделей происходит не монолог. Там идёт совещание — симуляция многоперспективного диалога внутри одной модели. С конфликтами, дебатами и примирением. И это не просто аналогия — это буквальные паттерны в токенах модели.

Почему Chain-of-Thought недостаточен

Давайте разберёмся, что не так с классическим подходом.

Chain-of-Thought работает примерно так: модель получает задачу, последовательно выписывает шаги решения, приходит к ответу. Один эксперт думает вслух. Линейно. Без сомнений. Без альтернатив.

Проблема в том, что сложные задачи редко решаются линейно. Когда вы сами решаете трудную проблему, вы:

-

Пробуете один подход, упираетесь в стену

-

Переключаетесь на другой

-

Возвращаетесь к первому с новым пониманием

-

Сомневаетесь в своих промежуточных выводах

-

Проверяете результат

Instruction-tuned модели этого не делают. Они выбирают один путь и идут по нему до конца. Даже если этот путь ведёт в тупик.

Сравнение подходов

|

Характеристика |

Instruction-tuned |

Reasoning-модели |

|

Поток рассуждений |

Линейный |

Нелинейный, с ветвлениями |

|

Альтернативы |

Не рассматривает |

Генерирует и сравнивает |

|

Self-correction |

Редко |

Регулярно |

|

Проверка результата |

Обычно нет |

Встроена в процесс |

|

Длина trace |

Короткая |

Длинная |

|

Accuracy на сложных задачах |

Ниже |

Выше |

Ключевая идея: Society of Thought

Представьте себе совещание в компании. Не формальное, где все кивают головой, а настоящее — где продакт спорит с разработчиком, дизайнер предлагает третий вариант, а тимлид пытается найти компромисс.

Именно это происходит внутри reasoning-моделей.

Исследование показало, что DeepSeek-R1 и QwQ-32B не просто “думают дольше”. Они генерируют внутренний диалог между разными перспективами. Каждая перспектива — это как отдельный эксперт со своим подходом (технически это разные активационные паттерны в одной модели, а не отдельные сущности):

-

Перспектива A: “Давайте решим алгебраически”

-

Перспектива B: “Нет, геометрический подход нагляднее”

-

Перспектива C: “А что если комбинировать оба метода?”

И эти перспективы не просто сосуществуют. Они спорят. Конфликтуют. И в итоге приходят к консенсусу.

Не путать с Mixture of Experts

Звучит похоже на Mixture of Experts (MoE)? Это разные вещи.

Mixture of Experts — архитектурный паттерн. В моделях типа Mixtral или Switch Transformer есть буквально разные подсети-эксперты, и router решает, какого эксперта активировать для каждого токена. Это hardcoded в архитектуре: эксперты существуют как отдельные веса, routing происходит на уровне forward pass.

Society of Thought — эмерджентное поведение [3]. Никаких отдельных экспертов в архитектуре нет. Разные “перспективы” — это разные активационные паттерны в одной и той же модели, которые возникают во время генерации. Модель не была спроектирована для этого — она сама научилась переключаться между разными “точками зрения” в процессе рассуждения.

|

|

Mixture of Experts |

Society of Thought |

|

Уровень |

Архитектура модели |

Паттерн рассуждений |

|

Эксперты |

Отдельные подсети с разными весами |

Активационные паттерны в одной модели |

|

Когда работает |

Forward pass (каждый токен) |

Inference (в процессе генерации) |

|

Явный дизайн |

Да, заложено архитектурно |

Нет, возникает спонтанно |

|

Routing |

Learned router выбирает эксперта |

Нет явного routing, переключение через маркеры в тексте |

Проще говоря: MoE — это “разные эксперты обрабатывают разные части входа”, а Society of Thought — это “одна модель ведёт внутренний диалог с разных позиций”.

Аналогия с коллективным интеллектом

Почему “внутренний диалог” вообще помогает? В социальной психологии давно известно: группа экспертов с разными точками зрения [4] решает сложные задачи лучше, чем один гений [5]. Diversity + structured debate = better outcomes.

Reasoning-модели воспроизводят этот принцип внутри себя. Не потому, что их этому учили — а потому, что это работает.

Исторические корни идеи

Концепция “общества внутри разума” не нова. Она имеет глубокие корни:

-

Михаил Бахтин (1920-е) — теория диалогизма: мышление [6] по своей природе диалогично

-

Charles Cooley и George Mead — социальное “я” формируется через внутренний диалог

-

Marvin Minsky (1986) — “Society of Mind”: интеллект [7] как взаимодействие множества простых агентов

То, что reasoning-модели спонтанно воспроизводят эти паттерны, говорит о том, что внутренний диалог — возможно, фундаментальный механизм сложного мышления.

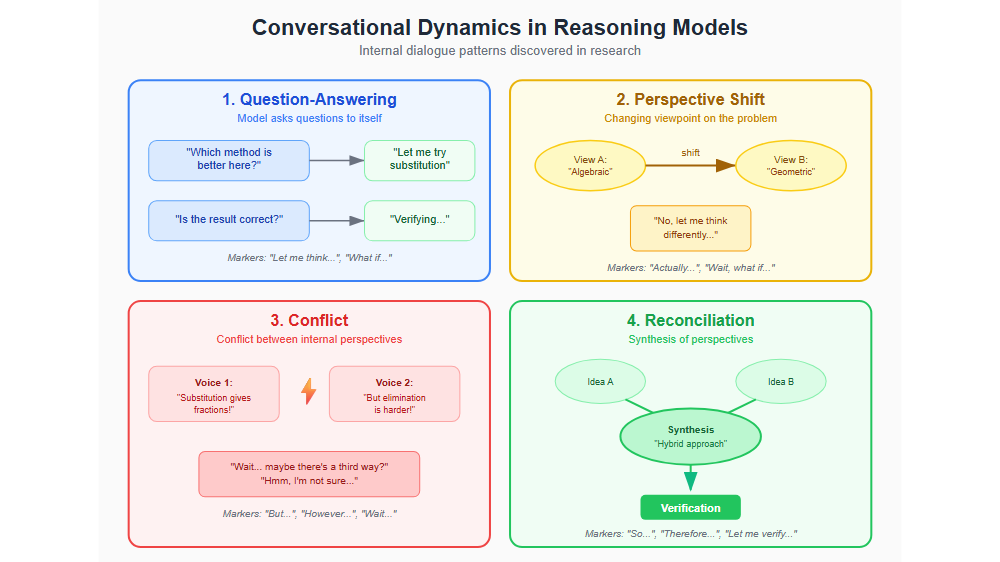

Как это работает: четыре паттерна

Исследователи выделили четыре ключевых паттерна “conversational dynamics” в reasoning-моделях:

1. Question-Answering

Модель задаёт вопросы самой себе:

“Какой метод здесь лучше подойдёт?”

“Попробую подстановку — проще для начала.”

Это не риторические вопросы. Модель реально переключается между режимом “спрашивающего” и “отвечающего”.

2. Perspective Shift

Смена точки зрения на проблему:

“Hmm, алгебраический подход даёт дроби…”

“Давай подумаем иначе. Что если посмотреть геометрически?”

Маркеры: “Actually…”, “Wait, what if…”, “Let me think…”

## 3. Conflict

Конфликт [8] между внутренними голосами:

Голос 1: “Подстановка даст дробные числа!”

Голос 2: “Но исключить еще сложнее! “

“Подожди… может, есть третий путь?”

Маркеры: “But…”, “However…”, “Hmm, я не уверен…”

## 4. Reconciliation

Примирение и синтез:

“Оба подхода валидны, но гибридный метод объединяет их преимущества.”

“Проверю результат обоими способами.”

Маркеры: “So…”, “Therefore…”, “Let me verify…”

Сравнение на примере

Чтобы разница была наглядной, посмотрим на упрощённом примере, как instruction-tuned модель и reasoning-модель решают одну и ту же задачу.

Пример: Instruction-tuned модель (линейное рассуждение)

Задача: Решить систему уравнений 5x − 7y = 1 и 3x + 4y = 20

Решение:

Из первого уравнения выразим x: x = (1 + 7y) / 5

Подставим во второе: 3(1 + 7y)/5 + 4y = 20

(3 + 21y)/5 + 4y = 20

3 + 21y + 20y = 100

41y = 97

y = 97/41

x = (1 + 7 * 97/41) / 5 = 144/41

Ответ: x = 144/41, y = 97/41

Характеристики: Линейный поток. Один метод выбран сразу. Нет самопроверки. Нет рассмотрения альтернатив.

Пример: Reasoning-модель (Society of Thought)

Задача: Решить систему уравнений 5x − 7y = 1 и 3x + 4y = 20

[DEFINE] Переформулирую задачу:

Два линейных уравнения, две переменные. Нужно найти x и y.

[BLOOM] Какие подходы возможны?

- Метод подстановки (выразить одну переменную)

- Метод исключения (сложить/вычесть уравнения)

Хм, коэффициенты не очень удобные для исключения...

Но подожди — если умножить первое на 4, а второе на 7...

[PERSPECTIVE SHIFT]

Нет, позволь мне подумать иначе. Подстановка проще для понимания.

Из уравнения (2): x = (20 − 4y)/3

Подставляю в (1): 5[(20 − 4y)/3] − 7y = 1

[CONFLICT]

Подожди, получаются дроби. Может, исключение всё-таки лучше?

Но я уже начал... продолжу и проверю.

Умножаю на 3: 5(20 − 4y) − 21y = 3

100 − 20y − 21y = 3

100 − 41y = 3

y = 97/41

[VERIFICATION]

Хм, проверю: подставлю обратно...

- В уравнение (1): 5*(144/41) − 7*(97/41) = 720/41 − 679/41 = 41/41 = 1 ✓

- В уравнение (2): 3*(144/41) + 4*(97/41) = 432/41 + 388/41 = 820/41 = 20 ✓

[RECONCILIATION]

Оба метода дали бы тот же ответ, но подстановка оказалась достаточно прямолинейной. Проверка подтверждает корректность.

Ответ: x = 144/41, y = 97/41

Характеристики:

– [DEFINE] — переформулировка задачи

– [BLOOM] — генерация альтернативных подходов

– [PERSPECTIVE SHIFT] — смена точки зрения

– [CONFLICT] — внутренний конфликт между подходами

– [VERIFICATION] — самопроверка

– [RECONCILIATION] — примирение, синтез выводов

Обратите внимание [9]: оба решения приходят к одному ответу. Но reasoning-модель по пути рассмотрела альтернативы, засомневалась в своём выборе, проверила результат. Это и есть “общество мыслей” в действии.

Социо-эмоциональные роли: Bales’ IPA

Четыре паттерна — это только часть картины. Исследователи пошли дальше и применили классический инструмент из социологии: Bales’ Interaction Process Analysis (IPA).

Что такое Bales’ IPA

Это система анализа групповых дискуссий, разработанная социологом Робертом Бейлсом в 1950-х годах. Она выделяет 12 типов коммуникативных актов, которые происходят в любой групповой дискуссии — от совещания в офисе до научного семинара.

Оказалось, что reasoning-модели воспроизводят все эти роли в своих внутренних рассуждениях.

12 ролей внутреннего диалога

|

Категория |

Роль |

Пример маркера |

Что делает |

|

Вопросы |

Ask for orientation |

“What is the problem asking?” |

Запрашивает факты, уточняет условия |

|

|

Ask for opinion |

“Which method is better here?” |

Запрашивает оценку, мнение |

|

|

Ask for suggestion |

“How should I approach this?” |

Запрашивает направление действий |

|

Ответы |

Give orientation |

“The problem has two variables…” |

Даёт факты, информацию |

|

|

Give opinion |

“I think substitution is simpler” |

Даёт оценку, анализ |

|

|

Give suggestion |

“Let me try elimination first” |

Предлагает конкретное действие |

|

Позитивные |

Agreement |

“Yes, that makes sense” |

Соглашается, подтверждает |

|

|

Solidarity |

“This approach will work” |

Выражает уверенность, поддержку |

|

|

Tension release |

Okay, let’s move forward” |

Снимает напряжение, разряжает |

|

Негативные |

Disagreement |

“But that gives fractions…” |

Возражает, не соглашается |

|

|

Antagonism |

“This is getting complicated” |

Выражает фрустрацию |

|

|

Tension |

“Wait, something is wrong here” |

Создаёт напряжение, сигнализирует о проблеме |

Баланс ролей: ключ к эффективности

Важно не просто наличие этих ролей, а их баланс. В исследовании использовали Jaccard index для измерения “reciprocal balance” — насколько сбалансированы парные роли (вопрос-ответ, согласие-несогласие).

Что обнаружили:

-

Reasoning-модели (DeepSeek-R1, QwQ) показывают значительно более высокий баланс ролей, чем instruction-tuned модели

-

Более высокий баланс коррелирует с более высокой accuracy

-

На сложных задачах разница в балансе ещё более выражена

Это похоже на хорошо проведённое совещание: не только споры, но и резюмирование; не только критика, но и конструктивные предложения.

Diversity (разнообразие) перспектив: почему разнообразие важно

Исследователи не остановились на ролях. Они проанализировали, насколько разные перспективы внутри reasoning-моделей отличаются друг от друга — и обнаружили, что diversity (разнообразие) играет ключевую роль.

Личностные профили перспектив

Для анализа использовали Big Five — классическую модель личностных черт из психологии:

|

Черта |

Что измеряет |

Как проявляется в рассуждениях |

|

Openness |

Открытость новому |

“Let me try a different approach…” |

|

Conscientiousness |

Добросовестность |

“Let me double-check this calculation…” |

|

Extraversion |

Экстраверсия |

Активное предложение идей |

|

Agreeableness |

Дружелюбие |

“Yes, that makes sense, and also…” |

|

Neuroticism |

Тревожность |

“Wait, something seems off here…” |

Оказалось, что в reasoning-моделях разные перспективы имеют различные личностные профили. Одна перспектива может быть высоко по Openness (“а что если попробовать иначе?”), другая — высоко по Conscientiousness (“давай перепроверим”).

Типы перспектив

На практике это выглядит как разные “роли” в команде:

-

Critical verifier — высокий Neuroticism, фокус на поиске ошибок

-

Creative ideator — высокий Openness, генерация альтернатив

-

Systematic executor — высокий Conscientiousness, методичное выполнение

-

Integrator — высокий Agreeableness, синтез разных подходов

Expertise diversity

Помимо личностных черт, исследователи измерили “expertise diversity” — насколько разные перспективы используют разные области знаний. Для этого применили cosine distance между embeddings каждой перспективы.

Результат: Reasoning-модели показывают значительно более высокое разнообразие экспертизы между перспективами, чем instruction-tuned модели.

Почему diversity помогает

Разнообразие перспектив решает проблему “echo chamber” — когда все участники дискуссии думают одинаково и усиливают ошибки [10] друг друга.

В instruction-tuned моделях рассуждение часто застревает в одном подходе. Если первый шаг был ошибочным, модель продолжает в том же направлении.

В reasoning-моделях разные перспективы могут:

-

Заметить ошибку (“Wait, that doesn’t seem right…”)

-

Предложить альтернативу (“What if we try…”)

-

Проверить результат с другой стороны (“Let me verify by…”)

Валидация на реальных дебатах

Чтобы убедиться, что метрики diversity осмысленны, исследователи проверили их на Intelligence Squared Debates Corpus — базе реальных структурированных дебатов между экспертами.

Корреляция между метриками diversity и качеством дебатов: rho = 0.86 (p < 0.001).

Это подтверждает, что те же паттерны, которые делают человеческие дебаты продуктивными, работают и внутри reasoning-моделей.

Что показали эксперименты

Это не просто красивая теория. Исследователи провели серию экспериментов, которые подтвердили причинно-следственную связь.

Эксперимент 1: Количественный анализ

DeepSeek-R1 и QwQ-32B сравнили с instruction-tuned моделями (DeepSeek-V3, Qwen-2.5-32B-Instruct, Llama-3.3-70B-Instruct) на шести бенчмарках:

-

BigBench Hard (логика)

-

GPQA (graduate-level физика)

-

MATH Hard (математика [11])

-

MMLU-Pro, MUSR, IFEval

Результат: Reasoning-модели показывают статистически значимо больше conversational behaviors (p << 10^-100). Причём разница усиливается на более сложных задачах.

Эксперимент 2: Activation Steering

Исследователи нашли конкретную feature в Sparse Autoencoder (Feature 30939), связанную с маркерами “surprise/realization” — теми самыми “Wait…”, “Hmm…”, “Actually…”.

Эту feature можно искусственно усиливать (+10) или подавлять (-10):

|

Steering |

Accuracy |

Conversational markers |

Эффект |

|

-10 (подавление) |

12.3% |

Почти отсутствуют |

Модель “забывает” сомневаться |

|

0 (baseline) |

27.1% |

Умеренно |

Обычное поведение [12] |

|

+10 (усиление) |

54.8% |

Много |

Активная самопроверка |

Контраст показателен: при -10 модель перестаёт использовать маркеры типа “Wait…”, “Hmm…” — и accuracy падает вдвое. При +10 маркеры появляются чаще — и accuracy удваивается.

Это доказывает причинно-следственную связь: conversational паттерны не просто коррелируют с accuracy, они её вызывают.

Эксперимент 3: RL без явной награды за диалог

Базовые модели (Qwen-2.5-3B, Llama-3.2-3B) обучали с помощью RL, где награда давалась только за правильный ответ. Никакой явной награды за “conversational behavior”.

Результат: Модели спонтанно увеличивали частоту внутренних диалогов по мере обучения [13]. Эволюция [14] сама нашла этот паттерн.

Эксперимент 4: Conversational Scaffolding

Модели, которые pre-fine-tuned с примерами диалоговых рассуждений:

-

Обучались быстрее

-

Достигали более высокой accuracy

-

Показывали transfer effects на другие задачи

Эксперимент 5: Transfer Effects

Самый интересный результат — transfer. Модели, обученные conversational reasoning на одной задаче (Countdown — математическая игра), показывали улучшение на совершенно других задачах.

Пример transfer:

-

Обучение: Countdown task (комбинаторная математика)

-

Тест: Misinformation detection (определение ложной информации)

-

Результат: улучшение accuracy без дополнительного обучения

Это говорит о том, что conversational reasoning — не узкий хак для конкретной задачи, а общий навык. Модель учится не “решать математику диалогом”, а “решать сложные задачи через структурированное обсуждение с собой”.

Что это значит для разработчиков

Окей, интересная наука [15]. Но что с этим делать на практике?

1. Выбор модели

Если ваша задача требует сложных рассуждений (математика, логика, планирование), reasoning-модели типа DeepSeek-R1 или QwQ дадут лучший результат, чем просто “большая instruction-tuned модель”.

Дело не в размере. Дело в паттерне рассуждений.

Конкретные примеры задач для reasoning-моделей:

-

Отладка сложного бага с неочевидной причиной

-

Архитектурные решения с множеством компромиссов

-

Анализ требований с противоречивыми ограничениями

-

Математические доказательства и верификация

2. Промпт-инжиниринг

Можно попробовать явно поощрять “conversational” стиль в промптах:

-

“Рассмотри несколько подходов”

-

“Проверь свои промежуточные выводы”

-

“Если сомневаешься — попробуй альтернативный метод”

Это не гарантирует успех с обычными моделями, но может помочь.

3. Fine-tuning

Если вы выполняете fine-tune своей модели, рассмотрите “conversational scaffolding” — включение примеров с внутренним диалогом в обучающие данные.

4. Интерпретация

Когда reasoning-модель выдаёт длинный trace (трассировку) — это не “мусор”. Там реально происходит полезная работа. Изменение точки зрения, конфликты, примирение — все это влияет на качество окончательного ответа.

Когда reasoning-модели НЕ нужны

Reasoning-модели — не серебряная пуля. Они медленнее и дороже, а для некоторых задач просто избыточны.

Используйте обычные instruction-tuned модели, когда:

-

Простые фактические вопросы — “Какая столица Франции?” не требует внутренних дебатов

-

Творческие задачи без правильного ответа — генерация текста, идей, где нет “верного” решения

-

Задачи с требованием быстрого ответа — reasoning-модели генерируют длинные trace (трассировки), что увеличивает latency (задержку)

-

Простые линейные решения — если задача решается за 2-3 очевидных шага, “общество мыслей” не даст преимуществ

-

Массовые операции — обработка тысяч однотипных запросов, где стоимость одного токена имеет решающее значение

Правило: если задача не вызывает у вас самих желания “подумать с разных сторон” — скорее всего, reasoning-модель избыточна.

Заключение

Основной вывод исследования заключается в том, что совершенствование мышления в современных моделях заключается не только в “большем количестве токенов” или “большем количестве вычислений”. Это качественно иной образ мышления.

Reasoning-модели научились имитировать коллективный интеллект:

-

Четыре паттерна (вопросы, смена перспектив, конфликт, примирение) структурируют внутренний диалог

-

12 социо-эмоциональных ролей Bales’ IPA воспроизводятся в рассуждениях модели

-

Разнообразие точек зрения (Big Five “Большая пятерка”, экспертиза) предотвращает эффект “эхо-камеры”

-

Transfer effects показывают, что это общий навык, а не хак для конкретных задач

И самое интересное — этот паттерн возникает спонтанно при обучении на accuracy. Никто не учил модели “спорить с собой”. Они сами к этому пришли, потому что это работает. То, что философы и психологи описывали как природу мышления (Бахтин, Minsky), модели переоткрыли эмпирически.

Для практиков вывод прост: reasoning-модели — не универсальное решение, но для задач, требующих многоперспективного анализа, они дают качественно другой результат. Понимание механизма помогает выбрать правильный инструмент.

# Ссылки

1. Reasoning Models Generate Societies of Thought [2] — Junsol Kim, Shiyang Lai, Nino Scherrer, Blaise Aguera y Arcas, James Evans (Google Research, University of Chicago), arXiv:2601.10825, январь 2025

2. DeepSeek-R1 [16] — репозиторий модели

3. QwQ-32B Preview [17] — блог-пост о модели

4. OpenAI o1 [18] — Learning to Reason with LLMs

5. OpenAI o3 [19] — Deliberative Alignment

6. Chain-of-Thought Prompting [20] — Wei et al., 2022

Автор: Rummar

Источник [21]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/24588

URLs in this post:

[1] логично: http://www.braintools.ru/article/7640

[2] “Reasoning Models Generate Societies of Thought”: https://arxiv.org/abs/2601.10825

[3] поведение: http://www.braintools.ru/article/9372

[4] зрения: http://www.braintools.ru/article/6238

[5] гений: http://www.braintools.ru/article/4566

[6] мышление: http://www.braintools.ru/thinking

[7] интеллект: http://www.braintools.ru/article/7605

[8] Конфликт: http://www.braintools.ru/article/7708

[9] внимание: http://www.braintools.ru/article/7595

[10] ошибки: http://www.braintools.ru/article/4192

[11] математика: http://www.braintools.ru/article/7620

[12] поведение: http://www.braintools.ru/article/5593

[13] обучения: http://www.braintools.ru/article/5125

[14] Эволюция: http://www.braintools.ru/article/7702

[15] наука: http://www.braintools.ru/article/7634

[16] DeepSeek-R1: https://github.com/deepseek-ai/DeepSeek-R1

[17] QwQ-32B Preview: https://qwenlm.github.io/blog/qwq-32b-preview/

[18] OpenAI o1: https://openai.com/index/learning-to-reason-with-llms/

[19] OpenAI o3: https://openai.com/index/deliberative-alignment/

[20] Chain-of-Thought Prompting: https://arxiv.org/abs/2201.11903

[21] Источник: https://habr.com/ru/articles/987758/?utm_source=habrahabr&utm_medium=rss&utm_campaign=987758

Нажмите здесь для печати.