Карпаты оставил GPU работать на ночь. Утром в git-истории было 100 экспериментов, которые провёл не он

Во время моей аспирантуры у меня был ночной ритуал. Около девяти вечера я запускал обучение [1]. Подкручивал гиперпараметр. Может, менял learning rate, может, добавлял пару attention heads. Нажимал Enter. Потом какое-то время сидел, глядя на кривую loss, осознавал, что уже одиннадцать, ложился спать — и просыпался, обнаружив, что всё упало в три ночи из-за ошибки [2] нехватки памяти [3], которую я должен был поймать заранее.

На следующий день — чинишь баг, пробуешь снова. Один эксперимент в день, если повезёт. Два — если звёзды сойдутся.

А теперь умножьте это на каждого ML-исследователя на планете. Тысячи нас сидят перед терминалами, вручную подкручивая одну переменную за раз, запуская один эксперимент, ожидая, проверяя, подкручивая снова. Именно так большая часть ML-исследований до сих пор работает в 2026 году.

Андрей Карпати просто спросил: а что если компьютер будет делать всё это сам? И выложил репозиторий под названием [4]autoresearch. Который решает ровно эту проблему.

Проблема: исследования позорно последовательны

Вот грязный секрет ML-исследований, о котором никто не говорит на конференциях. Большую часть времени вы тратите не на гениальные идеи. Большую часть времени вы тратите на цикл: изменил что-то, обучил, оценил, решил — помогло или нет, повторил. Во время моей работы над диссертацией по прогнозированию исходов комы по КТ-снимкам я иногда тратил целую неделю просто на подбор правильной комбинации learning rate и batch size для новой архитектуры. Grid search слишком дорог, когда обучаешь нейросеть на 30 000 трёхмерных КТ-снимках.

Не потому что задача была интеллектуально сложной. Потому что цикл обратной связи был медленным. Меняешь одну вещь. Ждёшь. Смотришь результат. Меняешь другую. Снова ждёшь.

Живой исследователь может реалистично провести от двух до пяти экспериментов в день. А между ними — еда, сон [5], совещания, почта, переключение контекста и периодический экзистенциальный кризис на тему «а правильно ли я выбрал академию».

ИИ-агент не ест. Не спит. Экзистенциальных кризисов не испытывает (насколько нам известно). Он может проводить 12 экспериментов в час. Это примерно 100 за ночь. Именно это делает autoresearch.

Как это работает на самом деле

Устройство почти комично простое. Три файла.

prepare.py [6] скачивает обучающие данные и тренирует токенизатор. Запускаете один раз.

train.py [7] — полноценный сетап для обучения GPT в примерно 630 строках. Архитектура модели, оптимизатор (Muon + AdamW), цикл обучения, оценка. Всё в одном файле. Именно этот файл ИИ-агент модифицирует.

program.md [8] — markdown-документ, в котором вы пишете инструкции для агента. Считайте это исследовательским брифом. «Сфокусируйся на изменениях архитектуры». «Попробуй разные batch size». «Будь консервативен, меняй только одну вещь за раз». Что угодно.

Цикл работает так:

-

Агент читает

program.md -

Агент вносит изменение в

train.py -

Обучение идёт ровно 5 минут

-

Агент проверяет метрику на валидации (bits per byte)

-

Если метрика улучшилась — коммит. Если нет — откат

-

Переход к шагу 1

Вот и всё. Вы ложитесь спать. Просыпаетесь. В git-истории — 100 экспериментов, лучшие изменения сохранены.

Почему 5 минут — это гениально

Позвольте объяснить, почему фиксированный бюджет в 5 минут — настолько умное проектное решение. Оно решает проблему, которую большинство людей даже не осознаёт.

Когда вы сравниваете эксперименты, нужна честная базовая линия. Если эксперимент A работал 5 минут, а эксперимент B — 20, вы не можете просто сравнить их финальный loss. Разумеется, более длинный прогон покажет результат лучше. Это ничего не говорит о том, какая идея была лучше.

Зафиксировав время на ровно 5 минутах, вы делаете каждый эксперимент напрямую сопоставимым. Агент может менять что угодно — архитектуру, batch size, количество слоёв, настройки оптимизатора, даже размер словаря. И вы всё равно можете сравнить эксперимент 1 с экспериментом 87, потому что у обоих было одинаковое временное окно.

Метрика — val_bpb (validation bits per byte) — не зависит от размера словаря. Так что если агент решит попробовать совершенно друг��й токенизатор, сравнение всё равно будет честным.

Есть один компромисс. Результаты привязаны к вашему железу. H100 найдёт другие оптимальные настройки, чем RTX 4090. Но это на самом деле фича. Autoresearch находит лучшую модель именно для вашей GPU.

К слову о том, как самому попробовать возможности ведущих ИИ-моделей. Не у каждого есть H100 и PhD, но сравнить, как разные модели решают ваши задачи, можно прямо сейчас. BotHub собирает топовые нейросети — GPT-5.4, Claude 4.6 и другие — в одном интерфейсе. Тестируйте, сравнивайте, экспериментируйте.

Для доступа не требуется VPN, можно использовать российскую карту.

По ссылке вы можете получить 300 000 бесплатных токенов [9] для первых задач и приступить к работе с нейросетями прямо сейчас!

Странная часть: теперь вы программируете в markdown

Вот что заставило меня остановиться и задуматься. Как исследователь, я годами учил Python, PyTorch, отладку CUDA, трюки распределённого обучения. Всё это — чтобы писать лучшие скрипты обучения.

В autoresearch вы не пишете скрипты обучения. Вы пишете markdown-файл, который объясняет ИИ-агенту, как думать о написании скриптов обучения.

Хотите, чтобы агент сфокусировался на поиске архитектуры — обновляете markdown. Хотите, чтобы занялся тюнингом оптимизатора — обновляете markdown. Markdown — это ваша исследовательская стратегия.

Карпати говорит, что нынешний program.md [8] уже «на 90% на��исан ИИ». То есть даже инструкции частично сгенерированы искусственным интеллектом [10]. Человек больше не кодер. Человек — научный [11] руководитель. Вы задаёте повестку. Агент управляет лабораторией.

И вот метавопрос, который не даёт мне спать по ночам: если program.md [8] — это настоящий продукт, и вы можете итерировать над тем, какой program.md [8] приводит к самым быстрым улучшениям, — вы занимаетесь исследованием того, как проводить исследования. Вы оптимизируете оптимизатор. А если саму эту оптимизацию тоже можно автоматизировать…

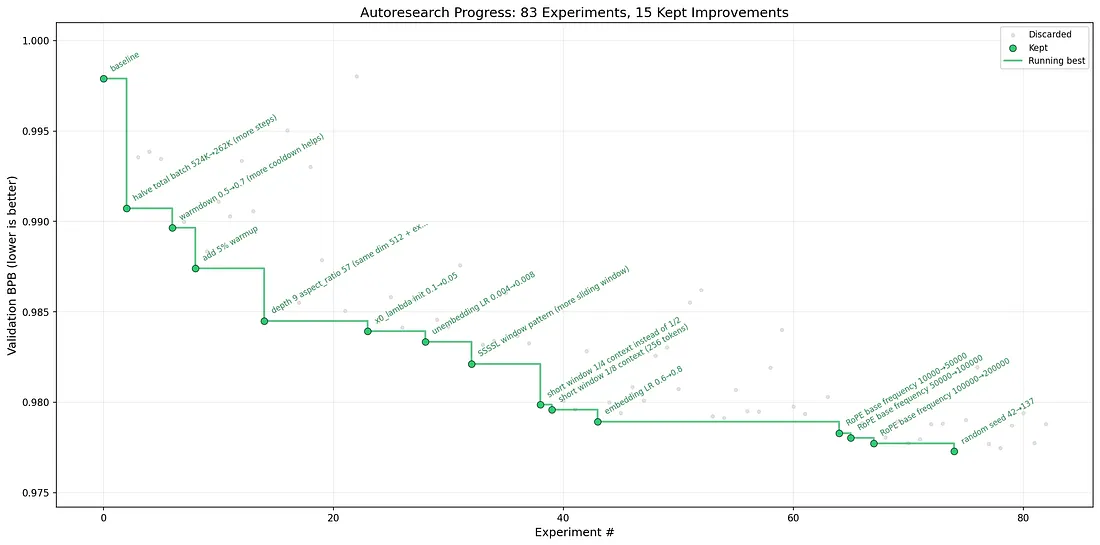

Результаты Карпати за одну ночь

Первый ночной прогон: 83 эксперимента, 15 сохранённых улучшений. Агент обнаружил вещи вроде уменьшения общего batch size с 524K до 262K (что даёт больше шагов обучения в том же временном окне), настройки расписания warmdown, добавления warmup, экспериментов с паттернами sliding window attention и тюнинга базовой частоты RoPE с 10 000 до 50 000.

Это не случайные изменения. Это ровно те вещи, которые попробовал бы опытный ML-исследователь. Агент просто сделал их в 12 раз быстрее и без перерывов на кофе.

Карпати также запустил версию побольше на 8×H100 с полной кодовой базой nanochat. 276 экспериментов, 29 сохранённых улучшений. Его комментарий: «Просто оставлю это работать на какое-то время».

За несколько дней до публикации репозитория он написал в твиттере: «Вот так ощущается пост-AGI. Я ничего не трогал. Пойду в сауну». Он шутил. Но лишь отчасти.

Чего он пока не умеет

Скажу честно про ограничения. Трекинга экспериментов нет. Ни Weights & Biases, ни MLflow. При 100 экспериментах за ночь вы листаете консольный вывод и git-логи. Это больно.

Агент не умеет читать статьи. Не может заглянуть в свежий препринт на arxiv, найти новую функцию активации и попробовать её. Он может обнаруживать вещи только модифицируя код и проверяя, упал ли loss. Это brute-force поиск, а не информированное исследование.

Ограничение одной GPU и 5 минут означает, что вы не можете исследовать идеи, работающие только на масштабе: mixture-of-experts, обучение на длинном контексте, стратегии распределённого шардинга. Всё это — за пределами досягаемости.

И агент иногда падает. Сообщество уже присылает фиксы: заставить агента реально читать трейсбеки, сохранять чекпоинты перед оценкой, чинить утечки VRAM. Скучные, но необходимые патчи, которые отделяют демо от чего-то, что можно реально оставить работать на ночь.

Почему это важно

Последние несколько лет своей жизни я занимался ML-исследованиями по старинке. Вручную. Один эксперимент за раз. Пялился на дэшборды Weights & Biases в полночь. Дебажил CUDA-ошибки, которые всплывают только на третьем часу обучения.

Autoresearch не заменяет исследователя. Он заменяет самую нудную часть исследований: рутину «попробуй, оцени, повтори». Исследователь по-прежнему решает, что изучать. Исследователь пишет program.md [8]. Исследователь утром просматривает результаты и решает, куда копать дальше. Но ночные часы — те, которые вы обычно проводите во сне [12] или тупя в терминал, — теперь принадлежат агенту.

Карпати написал маленький фантастический пролог в README, действие которого происходит в будущем, где исследованиями целиком занимаются автономные рои агентов. Кодовая база самомодифицировалась до состояния, непостижимого для человека. Никто не может проверить, правдивы ли утверждения агентов о собственном прогрессе.

Он заканчивает словами: «Этот репозиторий — история о том, как всё началось». Почти 2 000 звёзд за два дня. Репозиторию нет и 48 часов, а у него уже есть форк под macOS, комьюнити-фиксы и pull request’ы, улучшающие восстановление агента после сбоев.

Аспирант, проводящий один эксперимент в день, теперь конкурирует с GPU, проводящей 100 экспериментов за ночь. Узкое место — не вычисления. Не модель. Это качество вашего program.md [8].

Автор: cognitronn

Источник [13]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27123

URLs in this post:

[1] обучение: http://www.braintools.ru/article/5125

[2] ошибки: http://www.braintools.ru/article/4192

[3] памяти: http://www.braintools.ru/article/4140

[4] названием : https://github.com/karpathy/autoresearch

[5] сон: http://www.braintools.ru/article/9809

[6] prepare.py: http://prepare.py

[7] train.py: http://train.py

[8] program.md: http://program.md

[9] По ссылке вы можете получить 300 000 бесплатных токенов: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[10] интеллектом: http://www.braintools.ru/article/7605

[11] научный: http://www.braintools.ru/article/7634

[12] сне: http://www.braintools.ru/article/9150

[13] Источник: https://habr.com/ru/companies/bothub/articles/1010124/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1010124

Нажмите здесь для печати.