DeepMind определил тест для AGI

Почти три года назад Google DeepMind опубликовала Levels of AGI – работу, которая определила пять уровней AI-систем (от начального до сверхчеловеческого) и шесть уровней автономии (от инструмента до полностью автономного агента). Индустрия получила общую терминологию – что-то вроде уровней автономного вождения , только для интеллекта [1]. Но без способа измерить, на каком уровне находится конкретная система, классификация осталась сугубо теоретической. Каждый мог назвать свою модель level 2, и никто не мог это опровергнуть.

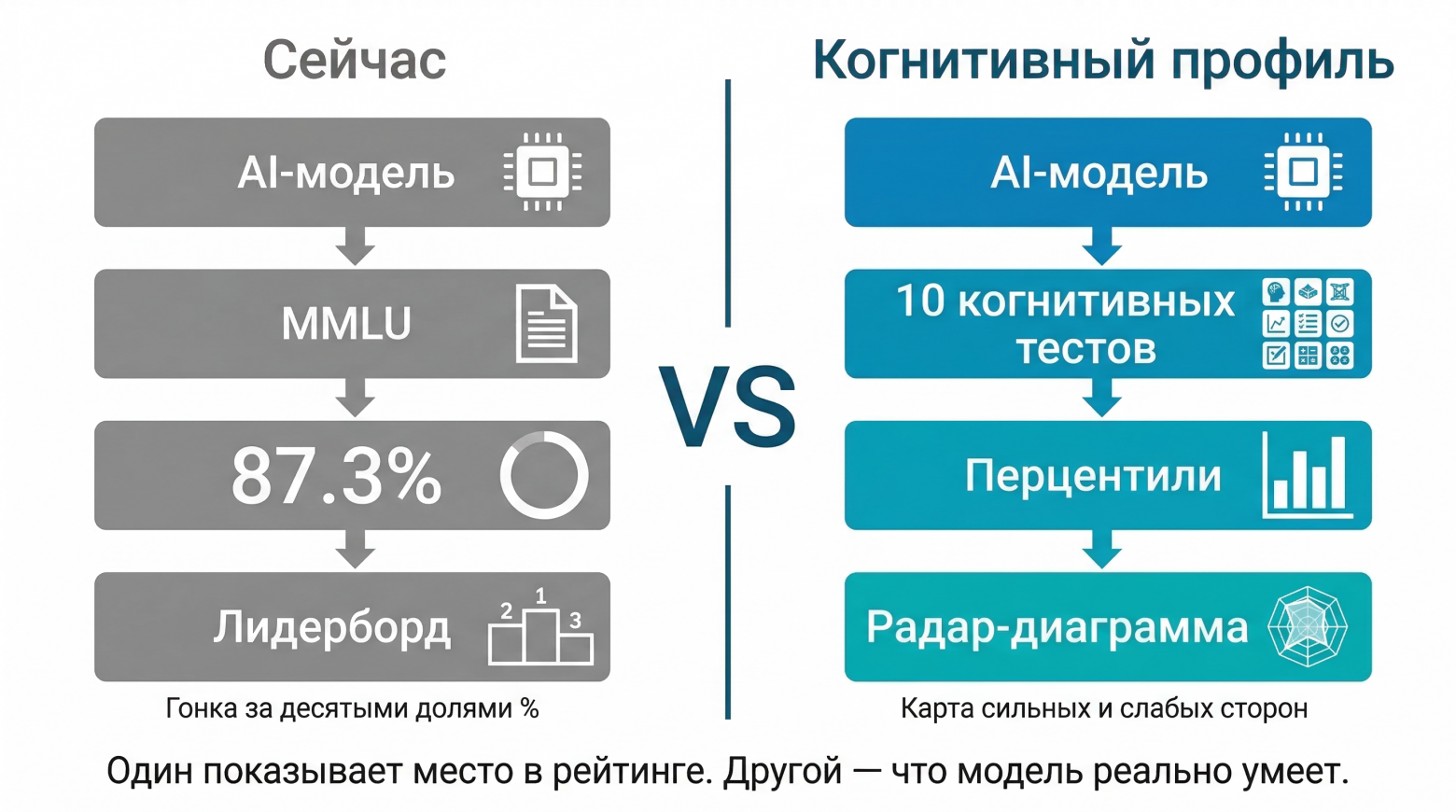

В марте 2026-го вышло продолжение. Measuring Progress Toward AGI [2]пытается дать индустрии инструмент измерения. Не финальный скор, а десять отдельных шкал. Построенных не на очередном датасете, а на инструментарии когнитивной психологии.

Диагноз

Прежде чем предложить решение, авторы разбирают, что не так с текущей системой оценки.

Первая проблема – загрязнение данных. Модели обучаются на корпусах, куда неизбежно попадают ответы на существующие бенчмарки. MMLU, HumanEval – эти наборы данных существуют годами, индексируются, цитируются, просачиваются в обучающие выборки. Модели блестяще решают стандартные тесты и спотыкаются на минимально переформулированных вариантах тех же задач. Высокий балл отражает запоминание [3], а не способность.

Вторая – смешение модели и системы. Когда мы тестируем ChatGPT, мы тестируем не саму модель. Мы тестируем модель, системный промпт, калькулятор, интерпретатор кода, плюс поисковик, плюс цепочку рассуждений. Если система обращается к поисковику, чтобы ответить на вопрос по истории, мы измеряем навык использования инструментов, а не память [4]. Текущие бенчмарки это различие игнорируют.

Таксономия

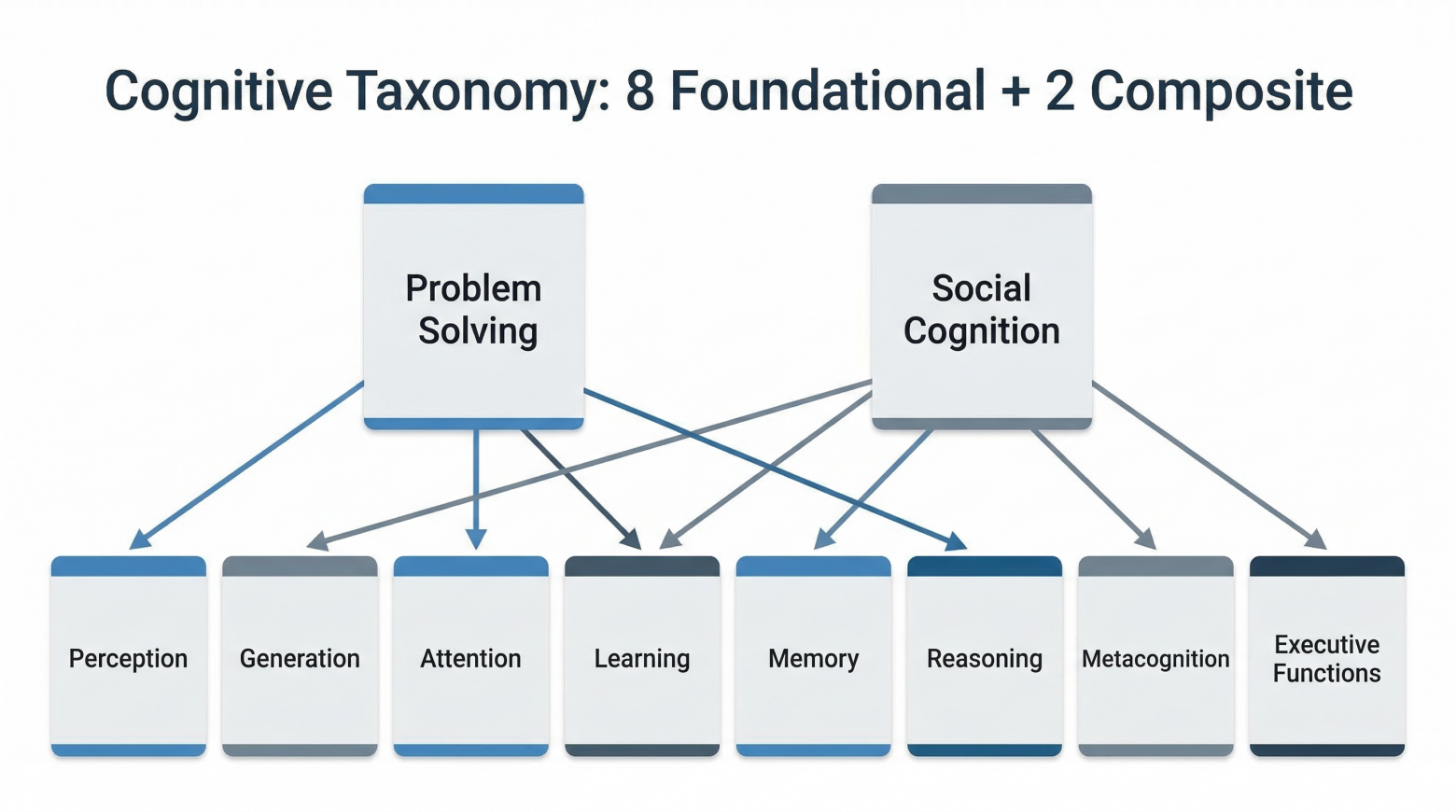

Центральная конструкция работы – когнитивная таксономия. Авторы разбивают общий интеллект на десять способностей. Восемь фундаментальных, две составных.

Восприятие [5] – обработка сенсорной информации. Авторы делают замечание: языковые модели через токенизацию получают прямой доступ к языку, минуя зрение [6]. Это не аналог человеческого восприятия, а принципиально другой канал.

Генерация – производство выходов: текст, речь, действия, код. И генерация мыслей – внутренние рассуждения модели. Цепочка рассуждений по этой логике [7] не костыль, а проявление генеративной способности. Важно, что генерация в таксономии отделена от рассуждения. Модель может порождать гладкий, убедительный текст и при этом плохо планировать.

Внимание [8] – и нет, речь не о механизме внимания в архитектуре трансформеров. Когнитивное внимание – это способность управлять фокусом в меняющемся контексте, балансировать между концентрацией на задаче и чувствительностью к новым стимулам [9].

Обучение [10] – приобретение знаний через опыт [11]. Здесь авторы напоминают неприятную правду о текущих системах: для большинства из них обучение происходит только при тренировке или в рамках одного диалога. Способность модели адаптироваться внутри контекстного окна – не обучение в когнитивном смысле. Когнитивное обучение подразумевает устойчивое изменение поведения [12], способность усваивать и сохранять новые знания и навыки со временем.

Память – четыре типа: знания о мире, воспоминания о событиях, навыки и намерения на будущее. Авторы включают забывание [13] как полезную способность, а не как баг. Умение избавляться от устаревшей, неверной или нерелевантной информации может быть не менее важным, чем умение хранить. Для реальных систем это напрямую ложится на разговоры об обновлении знаний, долгосрочной памяти и управлении контекстом. Современные языковые модели этого не умеют: то, что записано в параметрах при обучении, нельзя избирательно стереть.

Рассуждение – дедуктивное, индуктивное, абдуктивное, аналогическое, математическое. Автоматическое сопоставление паттернов авторы явно исключают. Угадывание ответа по формальным признакам вопроса к рассуждению не относится.

Метакогниция – знание о собственном знании. Мониторинг собственной уверенности, обнаружение ошибок, корректировка стратегий на лету. Авторы прямо называют эту способность наибольшим разрывом между людьми и AI. Модели не знают, чего они не знают. Отсюда уверенные галлюцинации. И, что важно, наращивание размера модели этот разрыв не закрывает.

Исполнительные функции – целеполагание, планирование, торможение импульсов, когнитивная гибкость, рабочая память. Здесь живёт способность к многошаговому планированию и переключению стратегий – то, на чём AI-агенты стабильно ломаются.

Две составных способности стоят отдельно, потому что это не «ещё две из списка», а оркестровка нескольких базовых одновременно.

Разрешение проблем объединяет восприятие, рассуждение, планирование, обучение. Гибкое рассуждение, алгоритмическое, здравый смысл, интуитивная физика, открытие новых закономерностей. Провал в любой базовой способности каскадом ломает решение задач в целом.

Социальное познание – способность моделировать убеждения и намерения других людей, кооперация, переговоры, убеждение и обман. Да, обман включён в таксономию AGI. Авторы считают, что полноценный социальный интеллект подразумевает понимание манипулятивных стратегий, даже если мы не хотим, чтобы AI их применял.

Почему именно десять — вопрос открытый. Когнитивная наука [14] не имеет единого консенсуса по структуре интеллекта. Модель Кэттелла-Хорна-Кэрролла режет его иначе, теория Гарднера выделяет другие оси, модель Стернберга — третьи. Креативности в списке нет. Эмоциональной регуляции тоже. Другая команда обосновала бы восемь или пятнадцать.

Но ключевое утверждение авторы делают явно: система со значимой слабостью хотя бы в одной способности будет проваливаться в реальных задачах. Это не список желаемого, а заявленный минимум.

Протокол

Классификация без метода измерения – академическое упражнение. Работа предлагает конкретный трёхэтапный протокол.

Первый этап – модель проходит задачи по каждой из десяти способностей. Каждая задача тестирует одну конкретную способность, не смесь. Банки задач закрыты и проходят независимый аудит. Сложность градуирована: есть задачи, лёгкие для людей, но сложные для AI, и наоборот. Форматы разнообразны — от тестов с вариантами ответов до многошаговых мультимодальных сценариев.

Второй – большая выборка людей выполняет те же задачи в идентичных условиях. Те же инструкции, те же форматы, тот же доступ к инструментам.

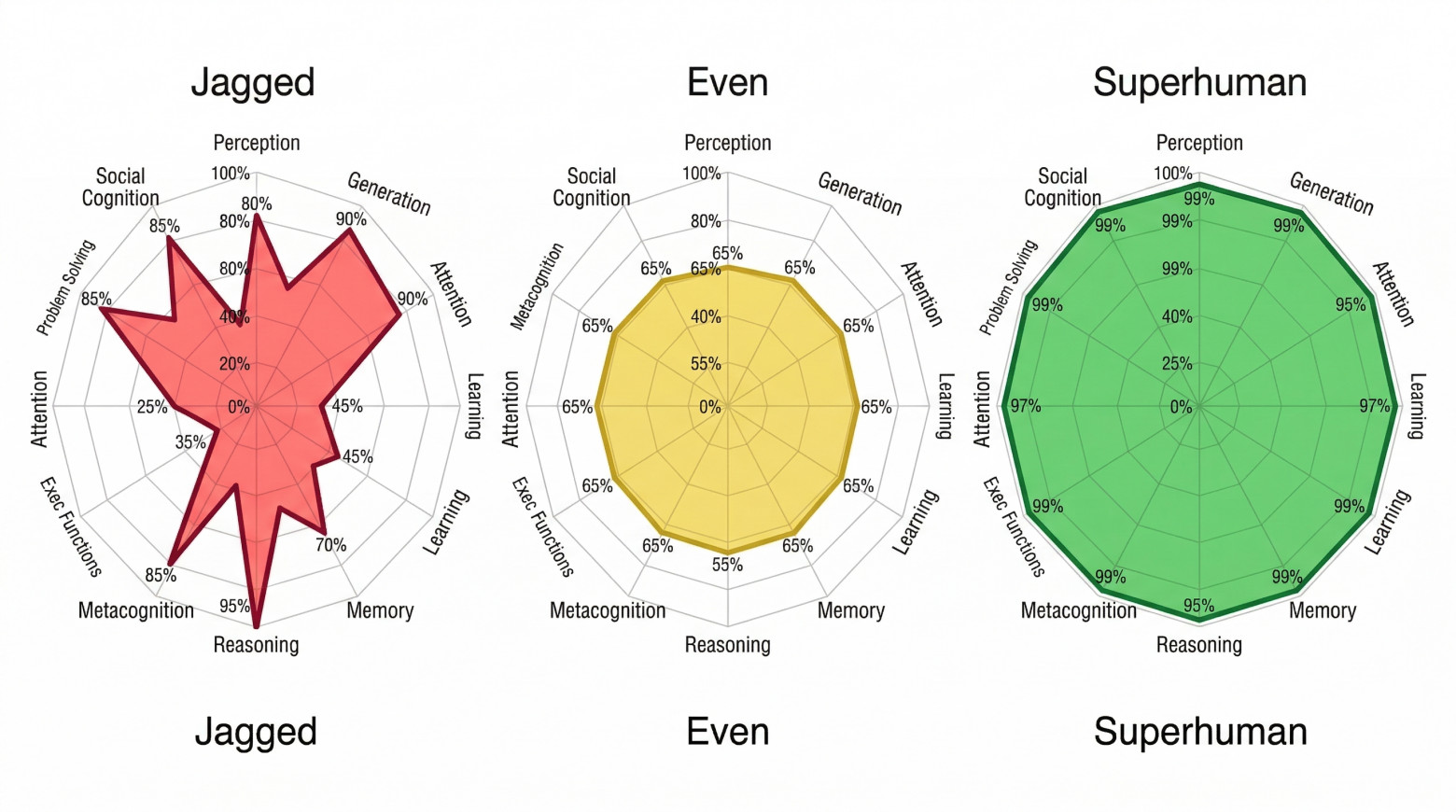

Третий – для каждой способности вычисляется перцентиль: какую долю людей система превосходит. Результат – радарная диаграмма в десяти измерениях.

Рваный профиль

Модель может рассуждать на уровне 95-го перцентиля – лучше 95% людей в выборке. Но не способна оценить собственную уверенность – метакогниция на 20-м перцентиле. Если усреднить, получится 72-й перцентиль. Приличный результат, ничего тревожного. Но радар покажет провал, который делает модель непригодной для задач, где нужна надёжная самооценка.

Авторы называют это рваным профилем (jagged profile). Впечатляющие пики и критические ямы. Центральный аргумент: рваный профиль – не AGI, даже если средний балл выглядит внушительно.

Пять дыр

Авторы указывают пять способностей, для которых у индустрии нет адекватных инструментов оценки. По рассуждению, восприятию, генерации, памяти и решению задач бенчмарки более-менее есть – MATH, ARC, GPQA, визуальные тесты. Но по остальным есть проблемы:

-

Обучение: как измерить, что модель действительно усвоила новое, а не воспроизвела заученный паттерн?

-

Метакогниция: как проверить, знает ли модель, чего она не знает? Работы по оценке калибровки уверенности существуют, но до уровня стандартного бенчмарка им далеко.

-

Внимание: поддержание фокуса в длинных контекстах, устойчивость к отвлекающим факторам — тест «иголка в стоге сена» шаг в нужную сторону, но примитивный.

-

Исполнительные функции: когнитивная гибкость, переключение стратегий, торможение неверных импульсов ‑всё, на чём агенты ломаются, но диагностических инструментов нет.

-

Социальное познание: моделирование чужих убеждений, нюансы взаимодействий — существующие тесты на теорию разума слишком просты для передовых моделей и не различают их между собой.

Работа не приближает AGI и не делает модели умнее. Но она создаёт условия, при которых фразу мы стали ближе к AGI можно проверить – не по одному баллу на заученном тесте, а по десяти осям, каждая из которых сравнивается с живыми людьми. Конкретных задач пока нет, таксономия спорна, человеческие замеры дороги, а задачи с хакатона через год могут оказаться в обучающих данных. Но сам ход – взять когнитивную психологию и приложить к индустрии, которая два года мерила прогресс заученными тестами – правильный.

Также пишу про AI в телеграм [15]. Буду благодарен за подписку.

Автор: Mark_K

Источник [16]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27568

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] Measuring Progress Toward AGI : https://storage.googleapis.com/deepmind-media/DeepMind.com/Blog/measuring-progress-toward-agi/measuring-progress-toward-agi-a-cognitive-framework.pdf

[3] запоминание: http://www.braintools.ru/article/722

[4] память: http://www.braintools.ru/article/4140

[5] Восприятие: http://www.braintools.ru/article/7534

[6] зрение: http://www.braintools.ru/article/6238

[7] логике: http://www.braintools.ru/article/7640

[8] Внимание: http://www.braintools.ru/article/7595

[9] стимулам: http://www.braintools.ru/article/5596

[10] Обучение: http://www.braintools.ru/article/5125

[11] опыт: http://www.braintools.ru/article/6952

[12] поведения: http://www.braintools.ru/article/9372

[13] забывание: http://www.braintools.ru/article/3931

[14] наука: http://www.braintools.ru/article/7634

[15] телеграм: https://t.me/nlp_daily

[16] Источник: https://habr.com/ru/articles/1013570/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1013570

Нажмите здесь для печати.