Cursor показал 5 графиков, которые хоронят все публичные ИИ-бенчмарки для кода. Разбираемся

11 марта 2026 года Cursor опубликовал пост под скромным названием «Как мы сравниваем качество моделей в Cursor». Без громких заявлений. Без атак на конкурентов. Просто пять графиков и спокойное объяснение внутреннего процесса оценки.

ИИ-сообщество в основном отнеслось к этому как к очередному «компания рассказывает о своём бенчмарке». Это было ошибкой [1].

Эти пять графиков, если прочитать их внимательно, обнажают пять допущений, зашитых в каждый публичный бенчмарк для кодинга, которые никто не ставит под вопрос. И каждое допущение, однажды увиденное, невозможно развидеть.

Вот что показал Cursor. И вот чего они не сказали вслух.

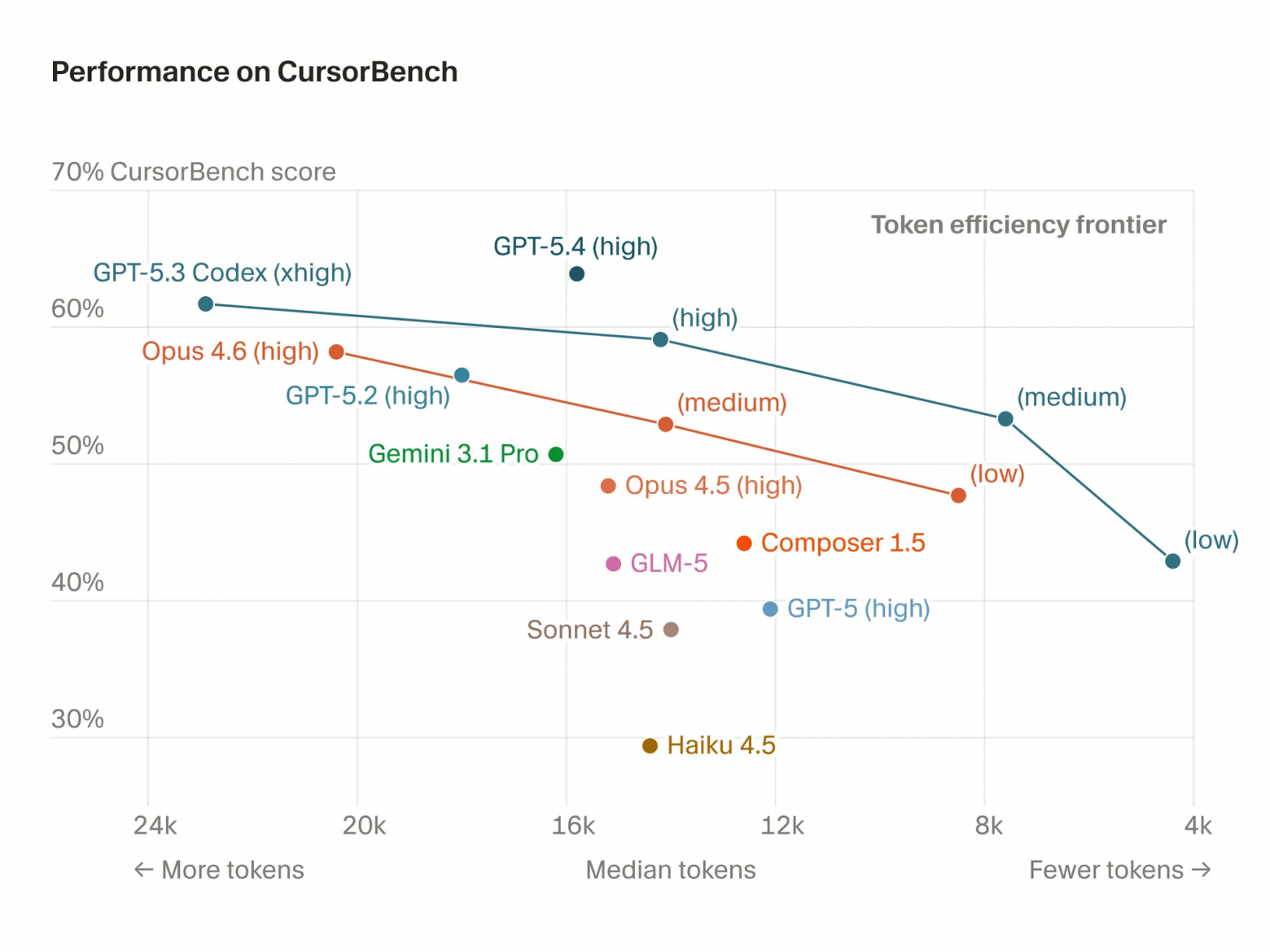

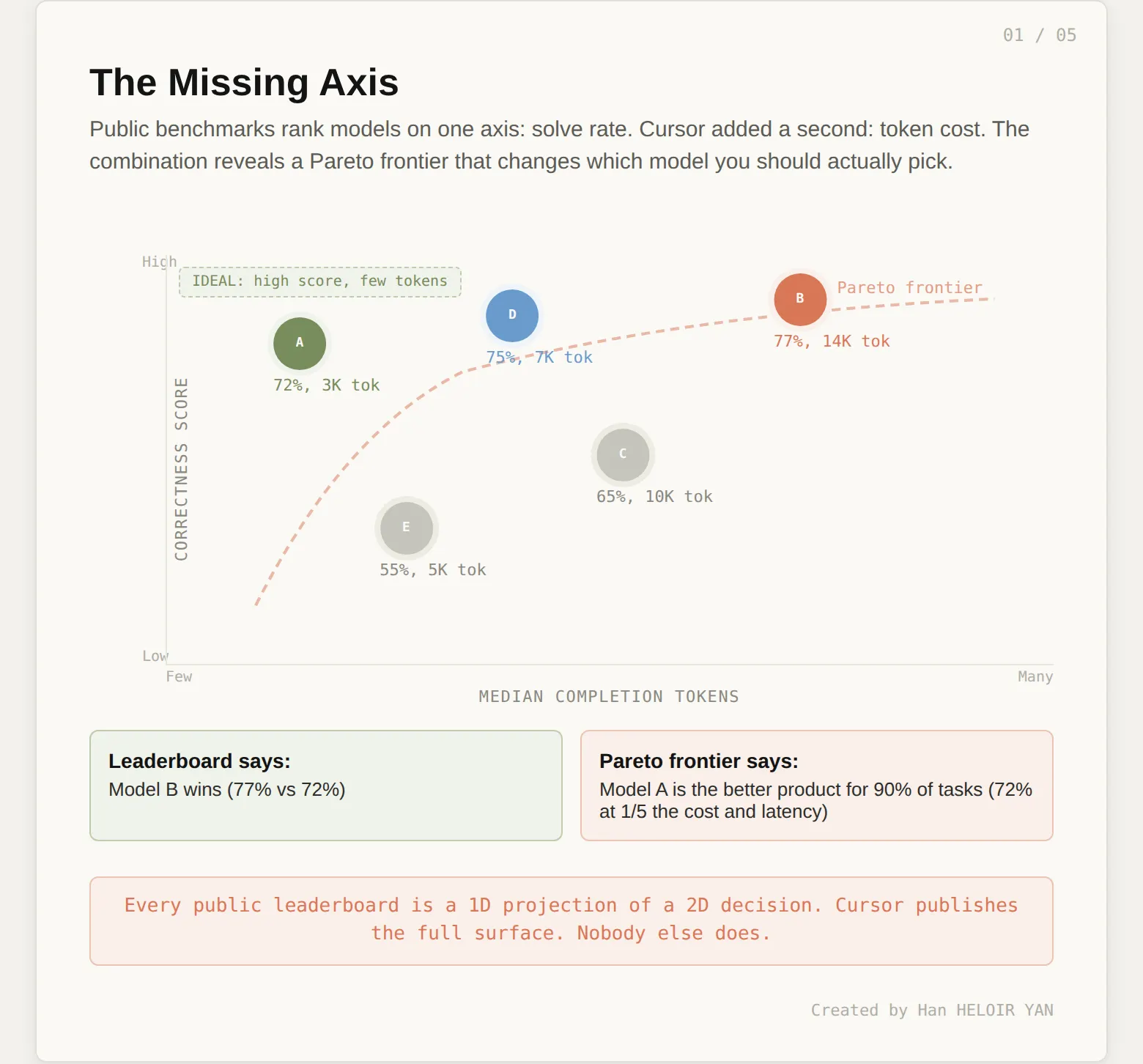

График 1: диаграмма рассеяния, которую больше никто не публикует

Первый график — точки, где по одной оси отложена корректность по CursorBench, по другой — медианное количество токенов на завершение для каждой модели. Простая диаграмма рассеяния.

Только вот ни один публичный бенчмарк такую картину не показывает. Ни SWE-bench. Ни Terminal-Bench. Ни Aider Polyglot. Каждый публичный рейтинг ранжирует модели по одной оси: какой процент задач модель решила? Неявное допущение — процент решённых задач и есть главная метрика.

Cursor говорит: нет. Важны две оси. Сколько задач вы решаете — и сколько токенов вам это стоит.

Это не академическое различие. В продакшене токены — это задержка. Токены — это стоимость. Модель, решающая 72% задач за 3 000 токенов, — лучший продукт, чем модель, решающая 75% за 12 000. Первая отвечает за секунды. Вторая заставляет разработчика минуту смотреть на крутящееся колёсико. Первая стоит копейки за запрос. Вторая — доллары.

Публичные бенчмарки это скрывают. Они отчитываются о проценте и выбрасывают путь к нему. SWE-bench не различает, решила ли модель задачу за 500 токенов или за 50 000. В результате индустрия оптимизирует процент решённых задач, а модели становятся всё более многословными ради маргинальных улучшений. «Рассуждающие» модели — крайний случай: они решают больше задач, но «думают» тысячами токенов, и разработчик ощущает каждый из этих токенов как задержку.

Каждый публичный рейтинг — это одномерная проекция двумерного решения. Cursor публикует полную поверхность. Больше так не делает никто.

Если вы хотите составить собственное мнение о моделях — не по бенчмаркам, а по реальным результатам на ваших задачах — попробуйте сами. BotHub собирает ведущие нейросети — GPT-5.4, Claude 4.6 и другие — в одном интерфейсе. Сравнивайте модели на своих данных, считайте реальную стоимость, принимайте решения на основе собственного опыта [2].

Для доступа не требуется VPN, можно использовать российскую карту.

По ссылке вы можете получить 300 000 бесплатных токенов [3] для первых задач и приступить к работе с нейросетями прямо сейчас!

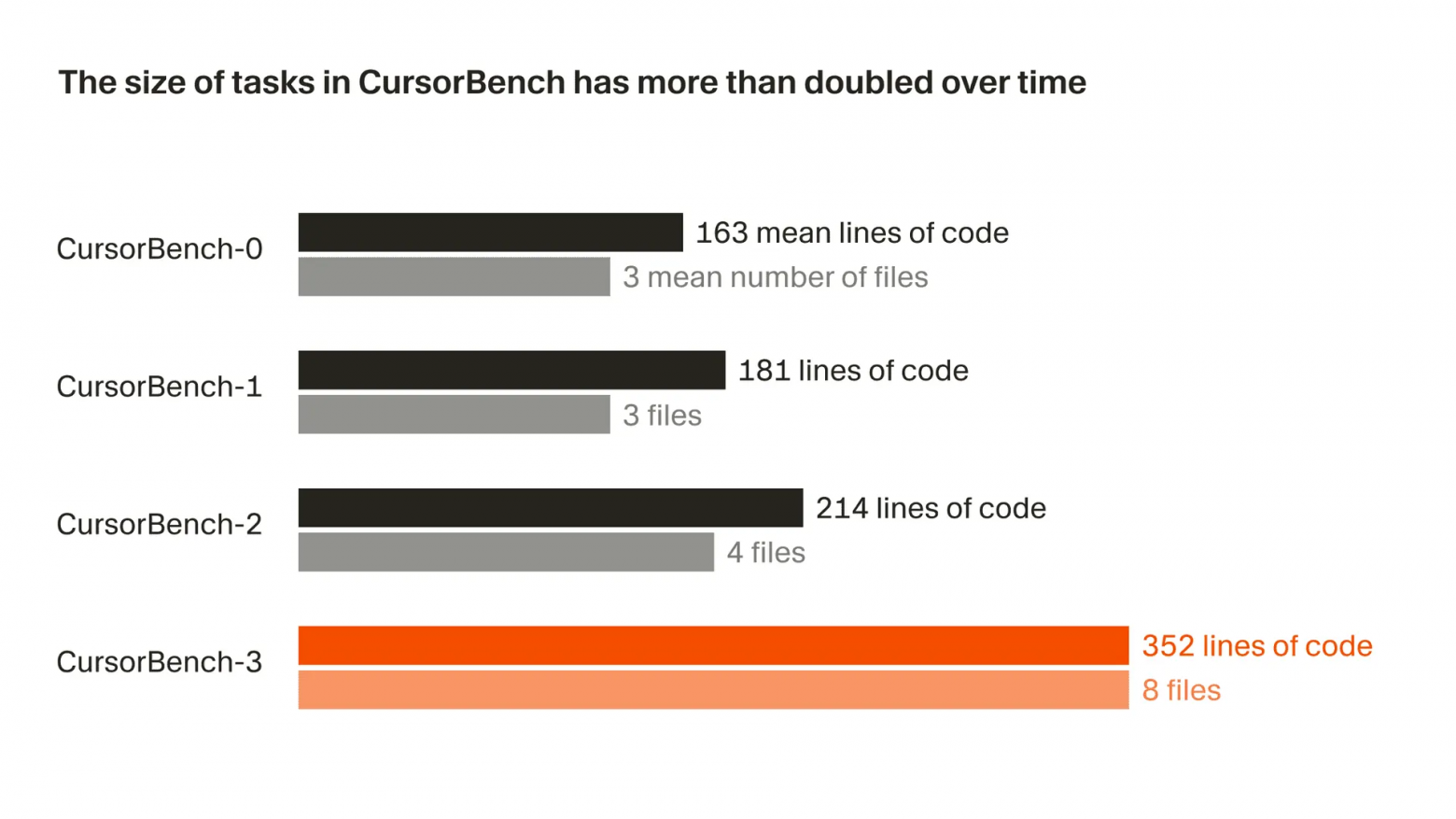

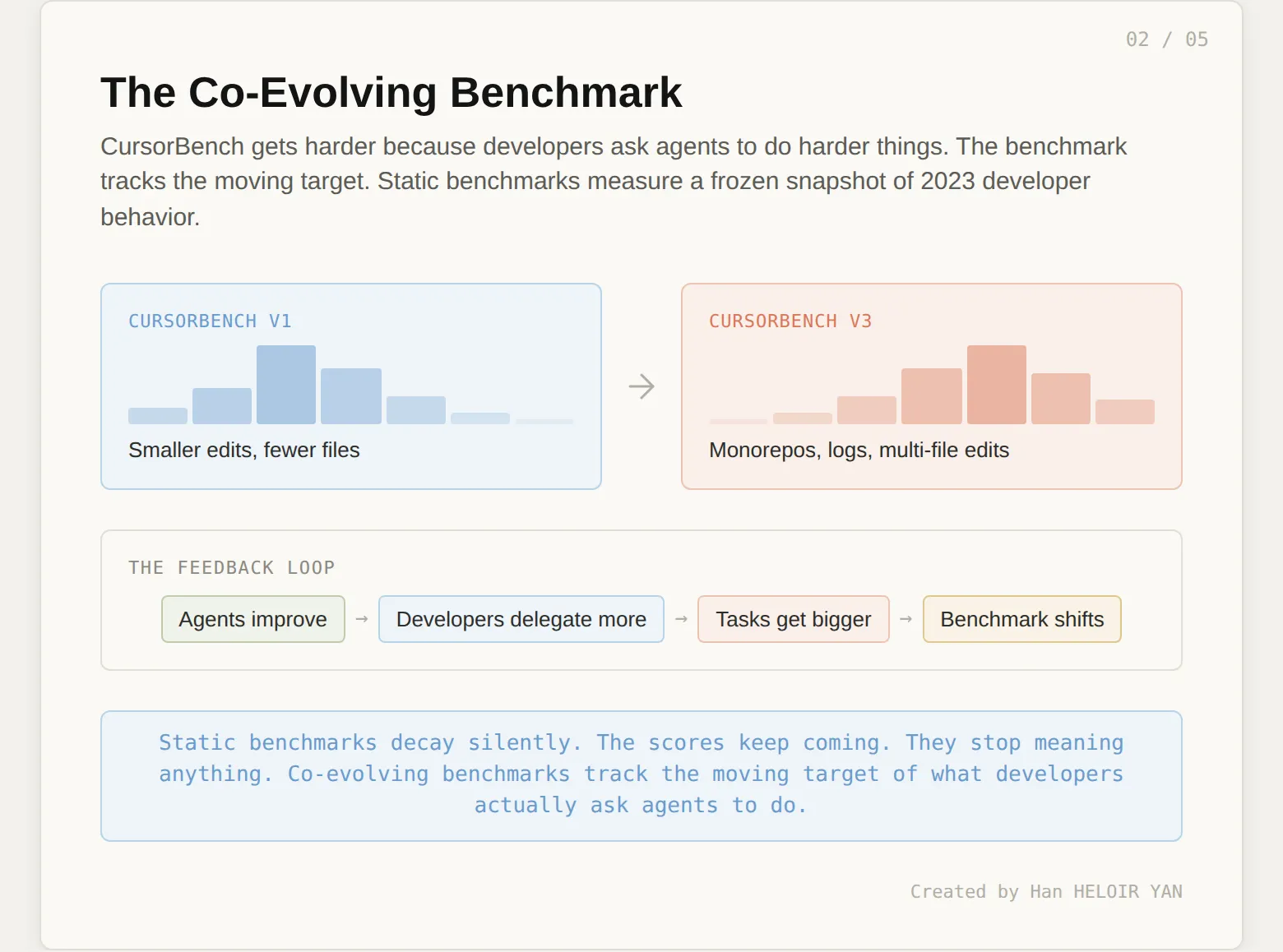

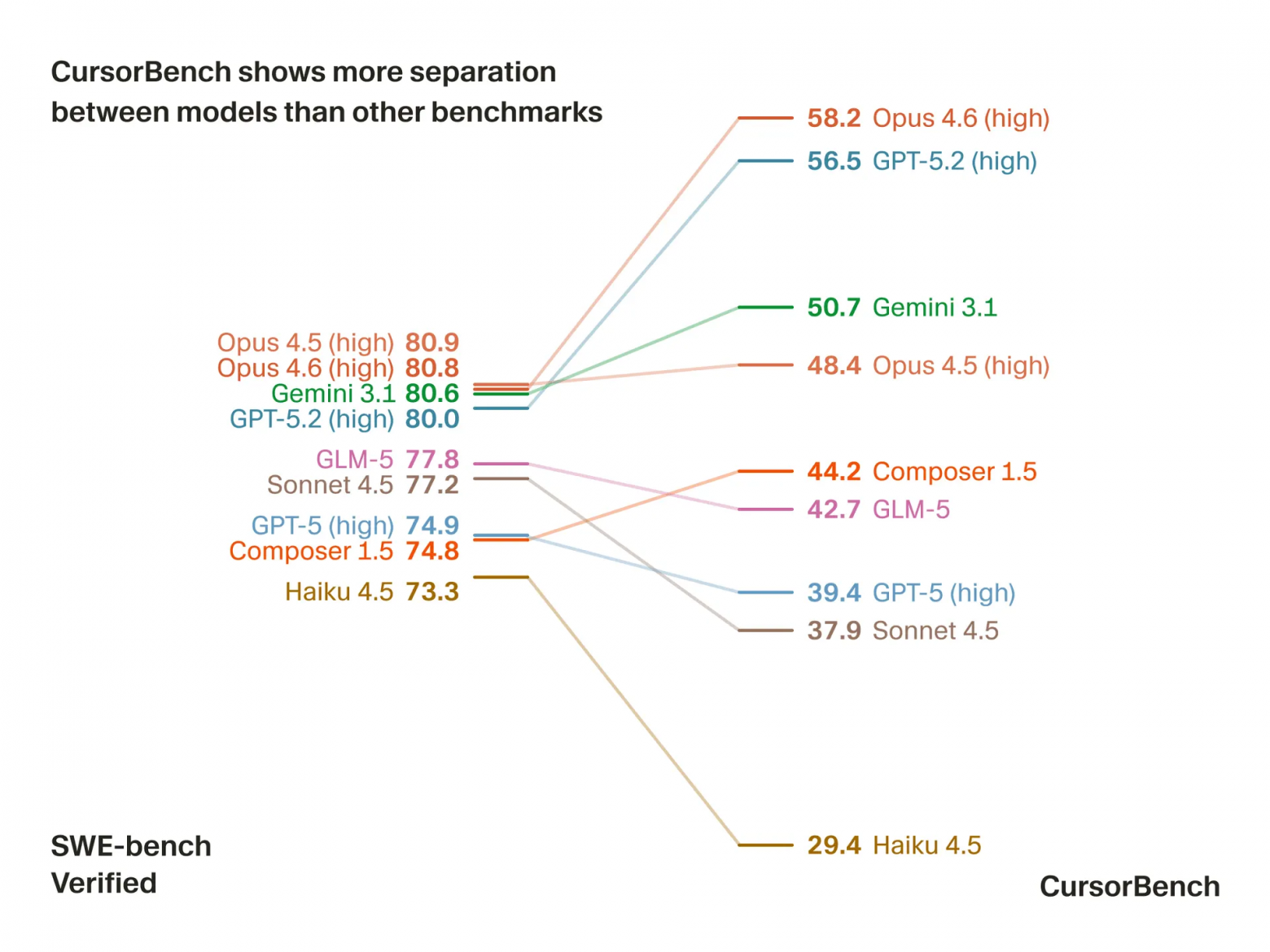

График 2: бенчмарк, который становится сложнее сам

Второй график показывает распределение размеров правок (строк кода в эталонном патче) по трём версиям CursorBench. Распределение смещается вправо от v1 к v3. Масштаб задач примерно удвоился.

На поверхности это выглядит как методологическое примечание: «Мы усложнили бенчмарк». Но импликация интереснее.

Задачи CursorBench берутся из реальных сессий Cursor через систему Cursor Blame, которая отслеживает закоммиченный код до запроса агенту, который его породил. Если задачи становятся крупнее — значит, разработчики просят агентов делать более масштабные вещи. Бенчмарк усложняется не потому, что исследовательская команда Cursor решила его усложнить. Он усложняется, потому что поведение [4] разработчиков меняется.

Это коэволюционная динамика. Разработчики узнают, с чем агенты справляются. Делегируют больше. Задачи растут. Бенчмарк растёт вместе с ними.

Публичные бенчмарки этого не могут. SWE-bench Verified заморожен на 500 задачах из 2024 года. SWE-bench Pro заморожен на 1 865 задачах из 2025-го. Они измеряют снимок того, как выглядела разработка ПО на момент создания бенчмарка. Они не отслеживают движущуюся мишень — то, что разработчики реально просят агентов делать прямо сейчас.

Это важно, потому что распределение задач — самая важная переменная в любом бенчмарке, и именно её большинство бенчмарков считают фиксированной. Если распределение реальной работы смещается (к более длинным задачам, большему количеству файлов, большей неопределённости), а бенчмарке смещается вместе с ним — его релевантность деградирует незаметно. Вы продолжаете получать баллы. Баллы перестают что-либо означать.

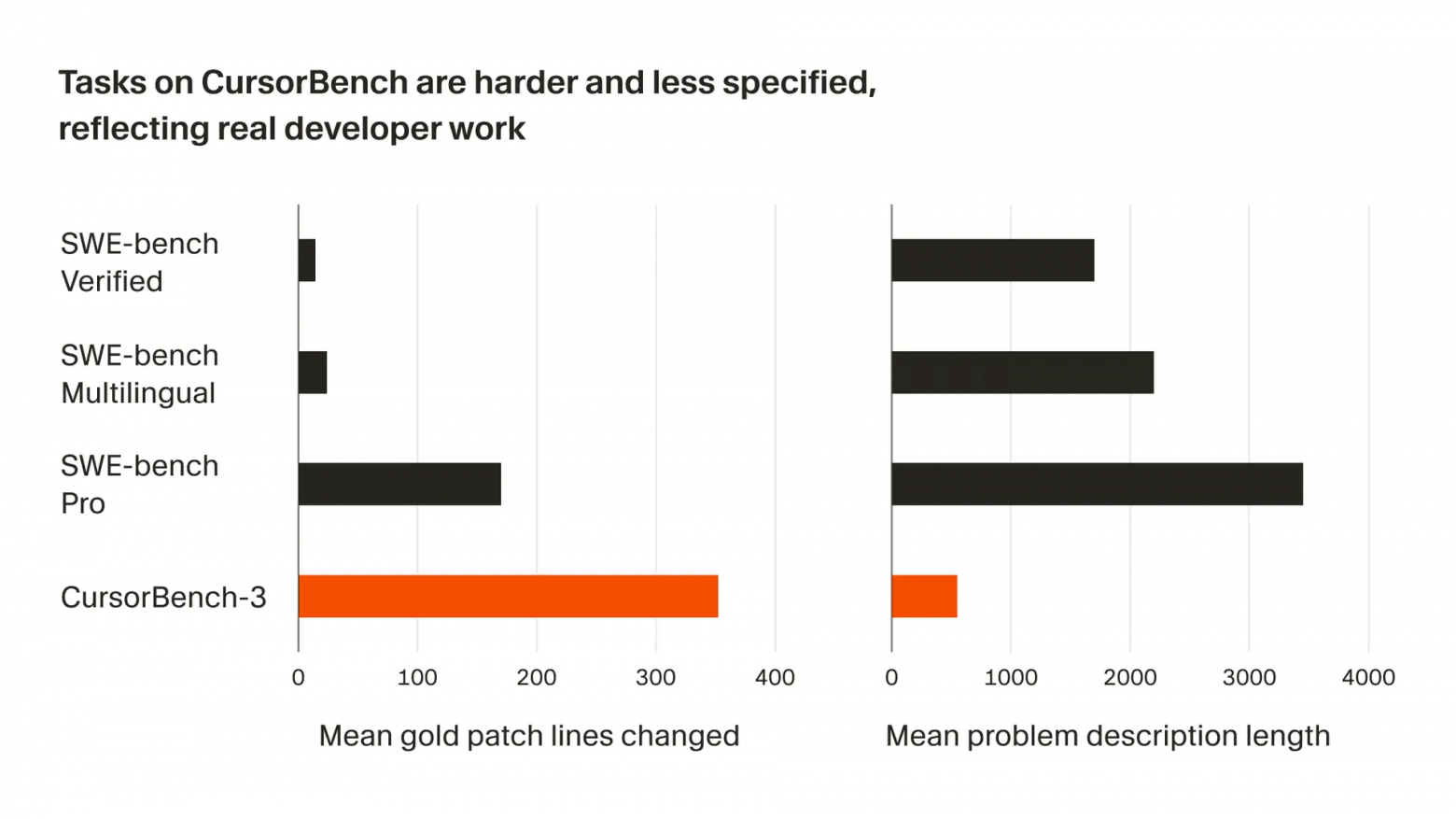

График 3: инвертированная информационная плотность

Третий график — самый показательный во всём посте, и Cursor его почти не комментирует.

Сравнение двух панелей. Слева: строки кода в эталонном решении (насколько длинный ответ). Справа: длина описания задачи (сколько текста описывает проблему). CursorBench сравнивается с SWE-bench Verified, Pro и Multilingual.

Задачи CursorBench имеют короткие описания и длинные решения. Публичные бенчмарки — длинные описания и короткие решения. Информационная плотность инвертирована.

Подумайте, что тестирует каждая комбинация.

Длинное описание с коротким решением — это задача на следование инструкциям. Проблема точно специфицирована. Ожидаемый результат невелик. Работа модели — разобрать детальную спецификацию и произвести целевое исправление. Именно это измеряет SWE-bench. GitHub-issue описывает, что именно сломано, включает трейсбек и указывает на нужный код. Эталонный патч — часто несколько строк.

Короткое описание с длинным решением — это задача на понимание намерения. Разработчик говорит «поправь логин» или «отрефактори пайплайн данных». Модель должна сама разобраться, что это значит в контексте кодовой базы, принять архитектурные решения и написат�� существенный объём кода. Спецификации, которой нужно следовать, нет. Есть расплывчатое намерение, которое нужно реализовать.

Это фундаментально разные когнитивные задачи. Они активируют разные способности модели. Модель, отлично разбирающая детальные инструкции, может провалиться на неоднозначном намерении. Модель, хорошо считывающая намерение, может быть небрежной с точными спецификациями.

161 из 500 задач SWE-bench Verified требуют изменения лишь одной-двух строк кода. В CursorBench-3 медианное решение существенно крупнее и затрагивает несколько файлов. Вы измеряете не одно и то же. Вы никогда не измеряли одно и то же.

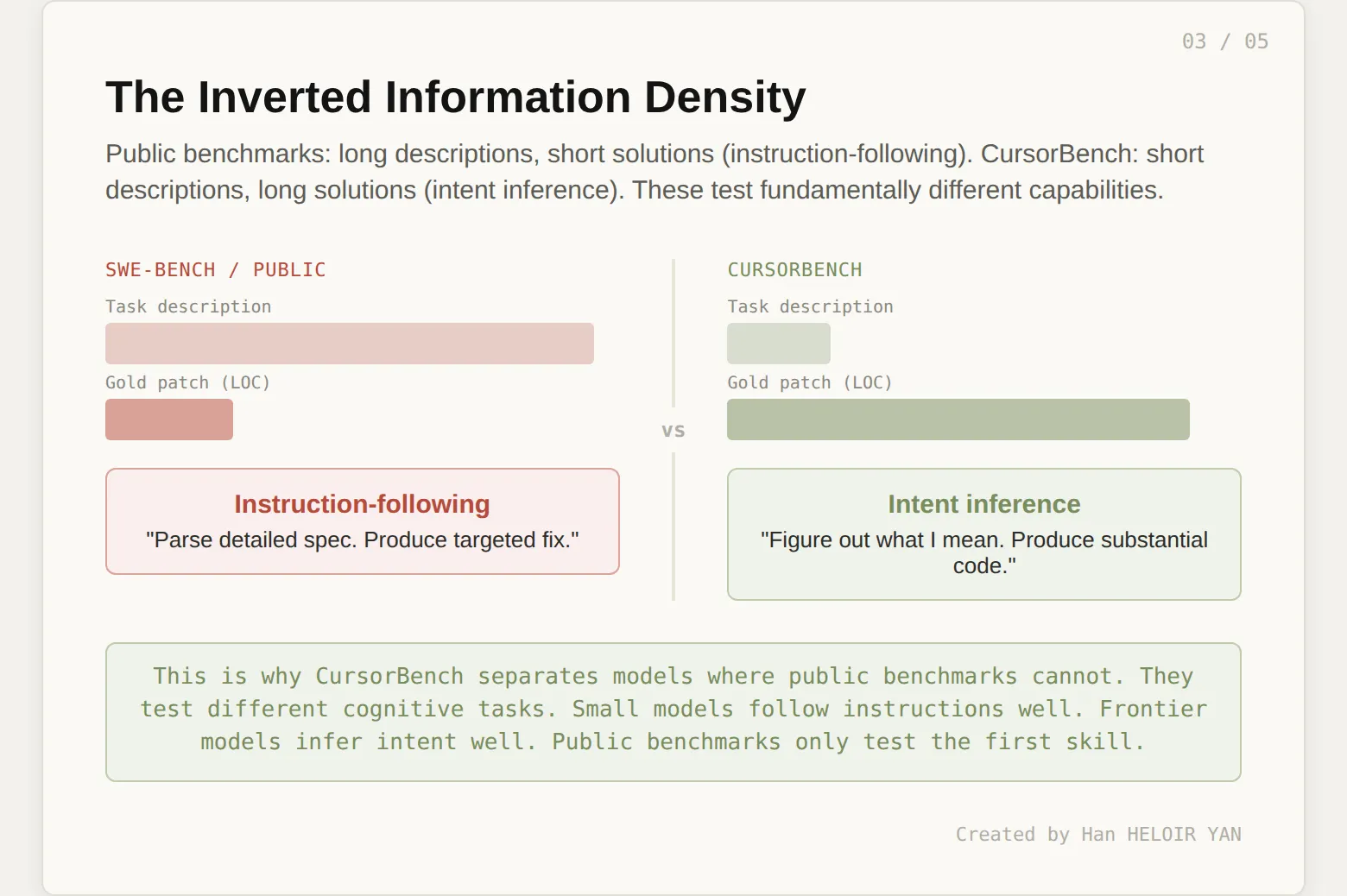

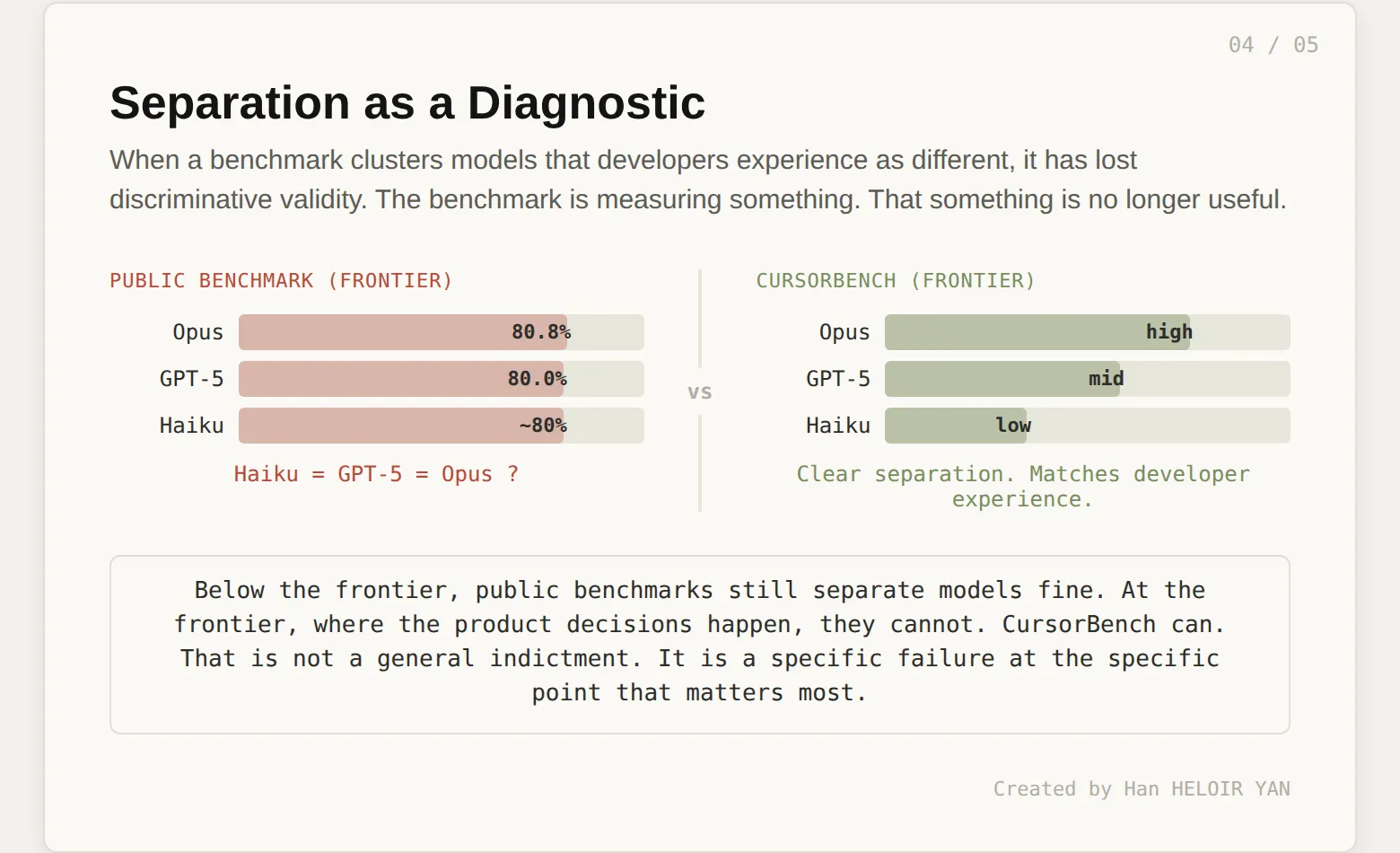

График 4: разделение как диагностика

Четвёртый график показывает разброс баллов между моделями на CursorBench в сравнении с публичными бенчмарками. CursorBench даёт большее разделение на фронтире.

Большинство читает это как «CursorBench сложнее, поэтому баллы ниже и разброс больше». Это верно, но неинтересно. Интересное прочтение — диагностическое.

Когда бенчмарк показывает широкое разделение между моделями, которые разработчики воспринимают как существенно разные, — бенчмарк обладает дискриминативной валидностью. Он измеряет что-то реальное.

Когда бенчмарк показывает тесное скопление моделей, которые разработчики воспринимают как существенно разные (например, Haiku на уровне GPT-5), — бенчмарк утратил дискриминативную валидность. Он что-то измеряет, но это «что-то» больше не коррелирует с тем, что вас волнует.

Утверждение Cursor конкретно: на CursorBench модели, которые разработчики оценивают выше, действительно набирают больше баллов. На публичных бенчмарках модели, которые разработчики оценивают выше, иногда набирают столько же или меньше, чем модели, которые разработчики оценивают ниже.

Если вы оцениваете модели ниже фронтира — публичные бенчмарки по-прежнему работают. Если вы выбираете между пятью лучшими моделями для продакшен-агента кодинга — они не работают.

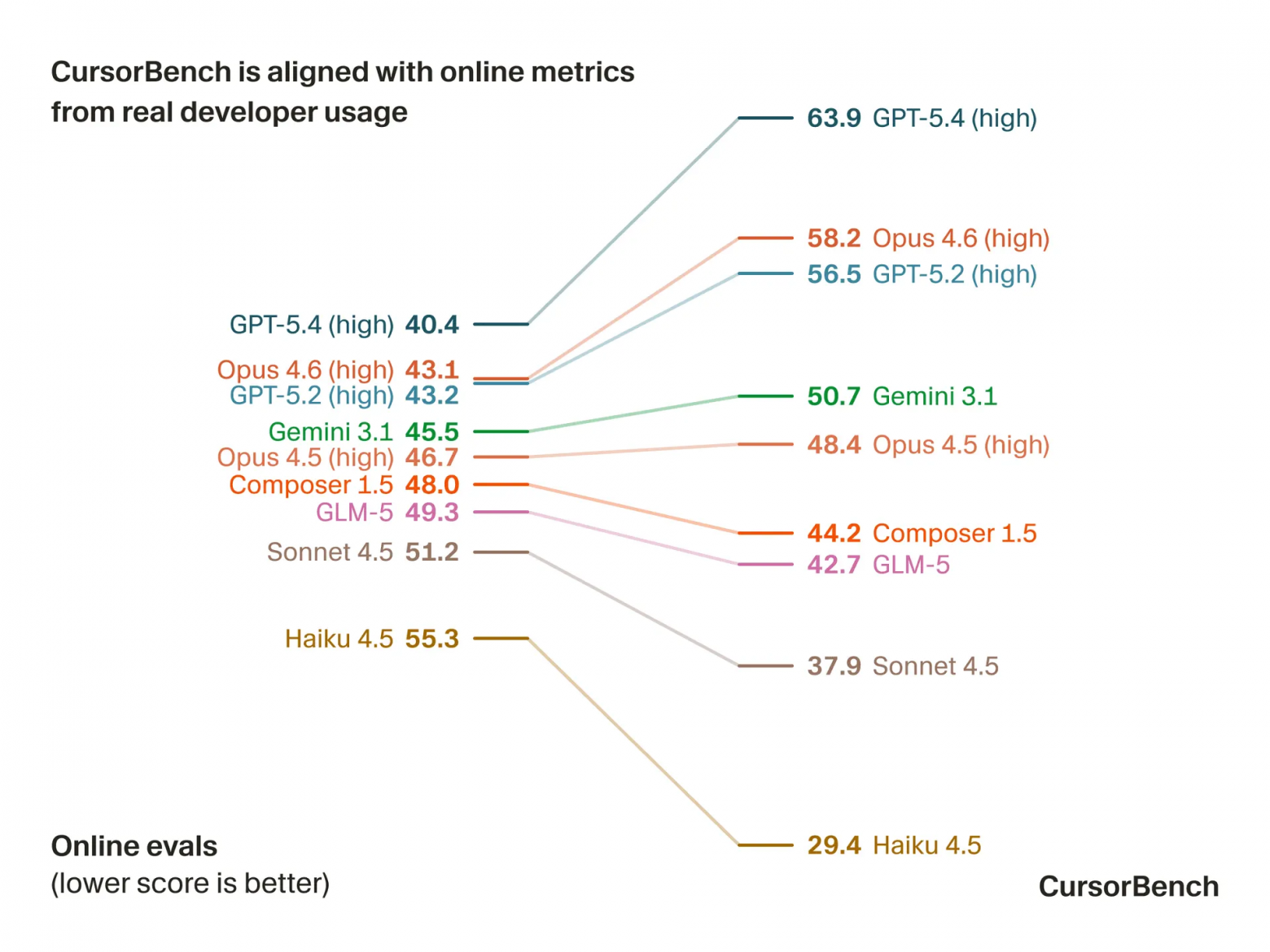

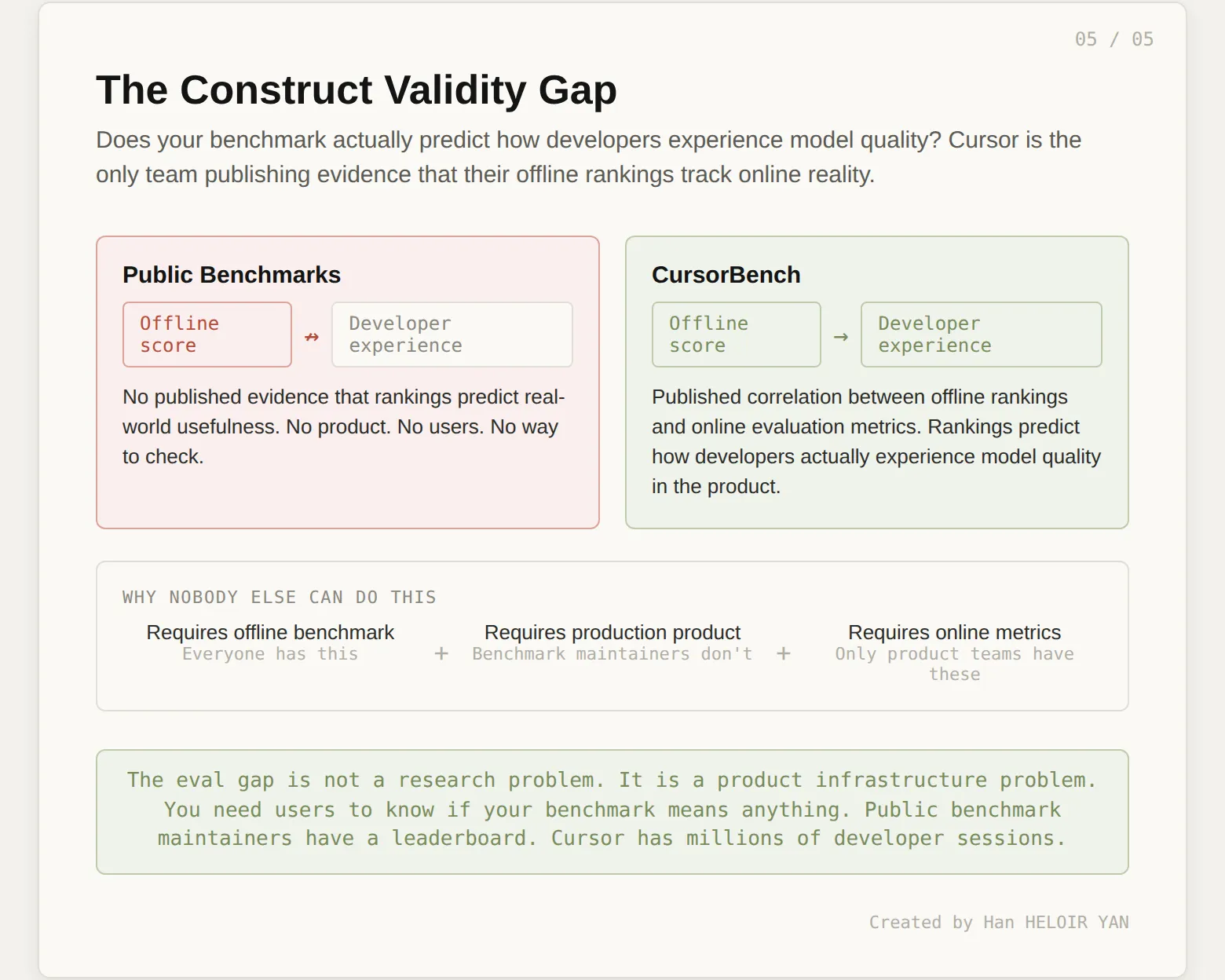

График 5: тест конструктной валидности, который никто не проводит

Пятый график показывает, что рейтинги CursorBench лучше согласуются с онлайн-метриками оценки, чем рейтинги публичных бенчмарков.

Это самый важный график во всём посте — и тот, что получил меньше всего внимания [5].

В психометрике конструктная валидность спрашивает: ваш тест измеряет то, что заявляет? Тест по математике [6], который действительно предсказывает математические способности, обладает конструктной валидностью. Тест по математике, где результаты определяются скоростью чтения, — нет, даже если содержит математические задачи.

Cursor делает аргумент о конструктной валидности. Их офлайн-бенчмарк (CursorBench) предсказывает их онлайн-метрики — то, как разработчики реально воспринимают качество модели в продукте. Публичные бенчмарки не предсказывают те же онлайн-метрики. Следовательно, CursorBench обладает более высокой конструктной валидностью для того, что действительно важно: опыта разработчика с кодинг-агентами.

Ни один публичный бенчмарк не публикует доказательства конструктной валидности. Ни один не показывает корреляцию между своими рейтингами и какой-либо нижестоящей мерой реальной полезности. Эти бенчмарки предполагают, что их баллы значимы. Cursor — первая команда, показавшая доказательства.

Причина, по которой никто другой этого не делает, — структурная. Чтобы провести тест конструктной валидности, нужен и офлайн-бенчмарк, и онлайн-продукт с реальными пользователями. Нужно измерять результаты разработчиков, а не только корректность кода. Нужна инфраструктура для связи офлайн-баллов с онлайн-поведением. У создателей публичных бенчмарков этого нет. У них есть набор тестов и рейтинг. Нет продукта, нет пользователей, нет способа проверить, отражают ли их рейтинги реальность.

Итог

Cursor опубликовал пять графиков. Позиционировал их как объяснение методологии. Если прочитать иначе — это пятичастный аргумент о том, что вся экосистема публичных бенчмарков для кодинга измеряет не то: одноосевые рейтинги вместо границ эффективности, замороженные распределения задач вместо коэволюционирующих, следование инструкциям вместо понимания намерений, неразличимые баллы вместо дискриминативных рейтингов, предполагаемая валидность вместо доказанной.

Ни одна другая команда не опубликовала доказательств ни по одному из этих пяти измерений. Либо потому, что никто об этом не задумывался. Либо потому, что ни у кого нет инфраструктуры, чтобы это измерить. В любом случае, разрыв реален.

Автор: cognitronn

Источник [7]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27616

URLs in this post:

[1] ошибкой: http://www.braintools.ru/article/4192

[2] опыта: http://www.braintools.ru/article/6952

[3] По ссылке вы можете получить 300 000 бесплатных токенов: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[4] поведение: http://www.braintools.ru/article/9372

[5] внимания: http://www.braintools.ru/article/7595

[6] математике: http://www.braintools.ru/article/7620

[7] Источник: https://habr.com/ru/companies/bothub/articles/1014096/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1014096

Нажмите здесь для печати.