ИИ без иллюзий: почему большие языковые модели ошибаются, даже когда знают ответ

Всем привет! Меня зовут Шабашев Валерий. Я работаю Python-разработчиком в ТехВилле и параллельно занимаюсь научной деятельностью в аспирантуре, где исследую поведение [1] языковых моделей, концептуальный дрейф и методы адаптации моделей к новым данным.

В этой статье я хочу поделиться не просто популярным обзором возможностей искусственного интеллекта [2], а разобрать реальные ограничения современных LLM с опорой на актуальные исследования и практический опыт [3].

За последние несколько лет большие языковые модели (LLM) стали активно применяться в различных областях, где требуется работа с текстовой информацией. Они умеют генерировать тексты, анализировать данные и даже помогать в принятии решений. При этом ключевой вопрос сегодня уже не в том, что модель знает, а в том, как она использует эти знания.

При более глубоком анализе становится очевидно: между доступом к информации и способностью корректно рассуждать лежит серьёзный разрыв. Даже имея на входе качественные данные, модели могут допускать логические ошибки [4], игнорировать важный контекст и делать выводы, которые не следуют из исходной информации.

И именно это сегодня становится ключевой проблемой – не недостаток знаний у модели, а отсутствие надёжного механизма проверки и верификации рассуждений.

LLM в медицине: возможности и пределы клинического рассуждения

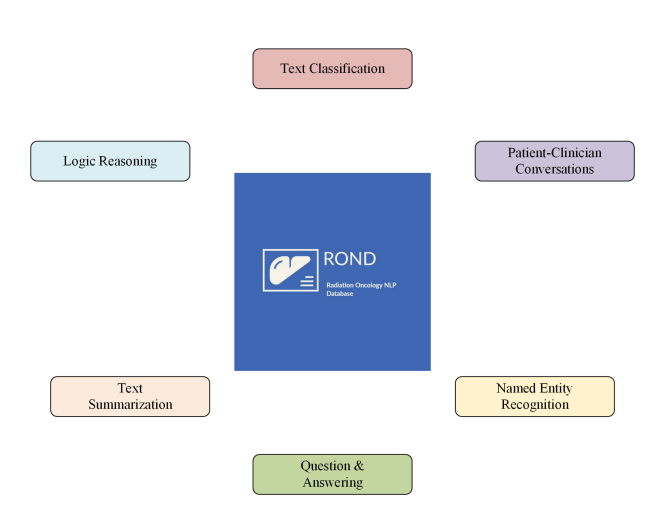

Искусственный интеллект в медицине развивается особенно активно: появляются специализированные датасеты, модели и бенчмарки, ориентированные на реальные клинические задачи. Один из таких примеров – Radiation Oncology NLP Database (ROND), первый специализированный корпус для задач радиационной онкологии.

ROND охватывает широкий спектр задач, отражающих реальные сценарии клинической обработки текстов: классификацию, извлечение сущностей (NER), вопросно-ответные системы, суммаризацию и даже задачи логического рассуждения (рис. 1).

Как видно, датасет покрывает не только стандартные NLP-задачи, но и задачи логического рассуждения, что особенно важно для медицинских сценариев.

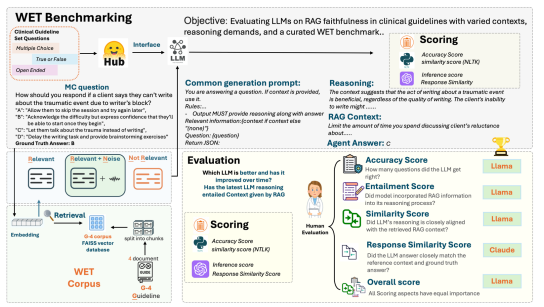

Однако наличие качественного датасета не гарантирует корректной работы моделей в реальных условиях. Исследование CARE-RAG показывает, что даже при доступе к релевантным клиническим данным LLM могут демонстрировать ошибки в рассуждениях.

Авторы выделяют ключевую проблему: разрыв между retrieval (доступом к информации) и reasoning (способностью правильно её использовать) (рис. 2).

Как видно из схемы, модель не просто получает релевантный контекст, но и должна использовать его в процессе рассуждения, после чего её вывод сравнивается с эталонным ответом и исходными данными.

Даже при наличии корректного контекста модели могут:

-

игнорировать важные части клинических инструкций,

-

опираться на поверхностные шаблоны,

-

некорректно интерпретировать этапы терапии.

Более того, эксперименты показывают, что модели часто дают правильный ответ при некорректном обосновании, что особенно критично в медицинских задачах, где важна не только точность, но и логическая обоснованность решений.

Таким образом, современные LLM уже способны эффективно работать с медицинскими текстами и автоматизировать часть аналитических задач, однако их использование в клинической практике ограничено недостаточной надёжностью рассуждений. Именно этот разрыв сегодня становится одной из ключевых проблем при внедрении ИИ в медицину.

RAG-подходы: панацея или иллюзия надёжности?

Retrieval-Augmented Generation (RAG) – это подход, направленный на снижение «галлюцинаций» языковых моделей за счёт подключения внешнего контекста. Идея выглядит интуитивно: если модель получает релевантную информацию, она должна реже допускать ошибки.

Однако результаты CARE-RAG показывают, что на практике ситуация сложнее. Хотя RAG действительно улучшает доступ модели к данным, он не гарантирует корректного использования этой информации в процессе рассуждения.

Даже при наличии релевантного контекста модели могут:

-

неправильно интерпретировать ключевые положения клинических протоколов;

-

терять причинно-следственные связи между фрагментами информации;

-

подменять логическое рассуждение вероятностными шаблонами.

Таким образом, RAG решает проблему доступа к знаниям, но не проблему корректного вывода. Другими словами, наличие информации не гарантирует её правильное использование.

Особенно критично это в чувствительных областях – медицине, образовании и праве, где ошибка в интерпретации может привести к некорректным решениям. В этих сценариях недостаточно просто предоставить модели информацию – необходимо контролировать сам процесс рассуждения.

Более того, даже при корректной работе RAG устойчивость модели со временем может снижаться из-за изменения данных – и здесь возникает проблема концептуального дрейфа.

Концептуальный дрейф: когда модель теряет актуальность

Если RAG решает проблему доступа к знаниям, то концептуальный дрейф показывает, что даже корректно работающая модель со временем теряет актуальность.

Под концептуальным дрейфом понимается изменение распределения данных со временем, из-за чего модель начинает систематически ошибаться.

В работе “Prompt Tuning Is Not All You Need” концептуальный дрейф рассматривается в контексте continual learning – сценария, в котором модель последовательно обучается на новых данных.

Авторы показывают, что при появлении новых доменов или классов распределение данных меняется, и без адаптации модель теряет качество. Это особенно заметно в domain-incremental сценариях, где сами классы остаются прежними, но меняется их представление в данных.

Ключевые наблюдения:

-

появление новых тем приводит к смещению эмбеддингов и ухудшению качества;

-

без дообучения модель быстро теряет актуальность;

-

устойчивость напрямую зависит от способности модели адаптироваться к новым данным.

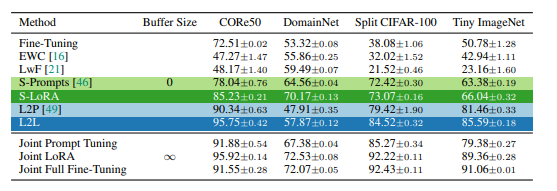

Особенно интересно, что выбор метода адаптации существенно влияет на устойчивость модели. Эксперименты показывают, что подходы на основе LoRA демонстрируют более высокую точность по сравнению с prompt tuning в задачах continual learning (рис. 3).

Как видно из таблицы, LoRA-основанные методы (S-LoRA, L2L) показывают более высокую точность по сравнению с их prompt-based аналогами (S-Prompts, L2P) на всех рассмотренных бенчмарках.

Особенно заметен прирост в сложных сценариях, таких как DomainNet и Tiny ImageNet, где изменение распределения данных наиболее выражено.

Таким образом, проблема заключается не только в изменении данных, но и в выборе механизма адаптации: не все методы одинаково хорошо справляются с дрейфом.

Концептуальный дрейф становится критическим ограничением в динамичных областях, где данные постоянно обновляются. В таких условиях недостаточно один раз обучить модель: необходимо обеспечивать её непрерывную адаптацию и контроль качества. Это подтверждает, что выбор метода адаптации напрямую влияет на устойчивость модели к концептуальному дрейфу.

Заключение

Современные большие языковые модели уже демонстрируют впечатляющие результаты в задачах обработки текста и анализа данных. Однако рассмотренные исследования показывают, что их возможности по-прежнему ограничены тремя ключевыми факторами: некорректным рассуждением, зависимостью от качества контекста и концептуальным дрейфом.

Во-первых, даже при наличии релевантной информации модели могут допускать логические ошибки – что подтверждается результатами CARE-RAG. Во-вторых, подходы вроде RAG улучшают доступ к знаниям, но не гарантируют корректного вывода. И, наконец, со временем качество моделей неизбежно снижается из-за изменения данных, что требует механизмов адаптации.

Таким образом, ключевая проблема современных LLM – это не недостаток знаний, а отсутствие надёжных механизмов их интерпретации и обновления.

Перспективное направление развития – это интеграция трёх компонентов:

-

систем извлечения знаний (RAG),

-

методов адаптивного обучения [5] (PEFT, включая LoRA),

-

и механизмов оценки корректности рассуждений.

Только их совместное использование позволит приблизиться к созданию действительно надёжных интеллектуальных систем.

ИИ уже умеет отвечать на вопросы – теперь задача научить его думать.

Литература

В этой статье я опирался на актуальные научные публикации, которые помогают глубже понять текущее состояние и перспективы развития ИИ. Каждая ссылка ведёт на оригинальное исследование, где вы сможете найти более подробную информацию по затронутым темам.

-

The Radiation Oncology NLP Database (ROND) [6] (Liu Z., Holmes J., Liao W., Liu C., Zhang L., Feng H., Wang P., Elahi M.A., Cai H., Sun L., Li Q., Li X., Liu T., Shen J., Liu W. 2024)

-

CARE-RAG: Clinical Assessment and Reasoning in Retrieval-Augmented Generation [7] (Potluri D., Mathew A.M., DeWitt J.B., Rasgon A.L., Hao Y., Hong J., Ding Y. 2025)

-

Choice of PEFT Technique in Continual Learning: Prompt Tuning is Not All You Need [8] (Wistuba M., Sivaprasad P.T., Balles L., Zappella G. 2024)

-

Современные направления развития искусственного интеллекта: потенциал применения и методологические ограничения [9] (Шабашев В.О. 2026)

Автор: sha_bash_in_techvill

Источник [10]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27745

URLs in this post:

[1] поведение: http://www.braintools.ru/article/9372

[2] интеллекта: http://www.braintools.ru/article/7605

[3] опыт: http://www.braintools.ru/article/6952

[4] ошибки: http://www.braintools.ru/article/4192

[5] обучения: http://www.braintools.ru/article/5125

[6] The Radiation Oncology NLP Database (ROND): https://arxiv.org/abs/2401.10995

[7] CARE-RAG: Clinical Assessment and Reasoning in Retrieval-Augmented Generation: https://arxiv.org/abs/2511.15994

[8] Choice of PEFT Technique in Continual Learning: Prompt Tuning is Not All You Need: https://arxiv.org/abs/2406.03216

[9] Современные направления развития искусственного интеллекта: потенциал применения и методологические ограничения: https://journ.vlsu.ru/fileadmin/docs/Documents/Publikatcii/Sbornik_konferencii_ZHRSO.pdf

[10] Источник: https://habr.com/ru/companies/vkusvill/articles/1015166/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1015166

Нажмите здесь для печати.