Одинаковая модель — разный опыт: где ломается сравнение нейросетей

Я Гоша Соловьёв, ведущий инженер-программист в Контуре.

Иногда в одном обсуждении встречаются люди с разным уровнем погружения в нейросети. Они начинают сравнивать опыт [1], и тут всплывает проблема: фраза вроде «Я использую GPT для своих задач, и он лучше справляется, чем Qwen» буквально ни о чём не говорит, пока мы не уточним контекст. Более того — она легко вводит собеседника в заблуждение.

В этой статье я объясню, почему два человека, использующие OpenAI GPT, могут получать кардинально разный результат, и как обсуждать ИИ-агентов так, чтобы разговор был предметным и конструктивным.

Почему фраза «я использую GPT» ничего не значит

Потому что на результат влияют как минимум четыре слоя:

-

Какая именно модель (семейство / версия / конкретный вариант).

-

Режим размышления (обычный ответ или reasoning режим (режим рассуждений), а также количество токенов, потраченных на рассуждения).

-

Инструменты, которые модели доступны (веб-поиск, анализ файлов, интерпретатор кода, «агентные» функции).

-

Клиент/продукт, через который вы общаетесь с моделью (chatgpt.com [2], API, Cursor, плагин в IDE, корпоративный портал и т.д.) — он добавляет ограничения и «обвязку».

В терминах архитектуры это выглядит так:

Вы → (клиент/продукт + его системные инструкции + лимиты) → (модель + режим) → (инструменты, если доступны) → ответ

Поэтому корректное сравнение начинается с нормализации описания: что именно и в каких условиях вы запускали.

Версия модели

При сравнении важно указать версию модели: скачки качества между поколениями могут быть очень заметными. Если вам «не понравились нейросети», полезно уточнить, какую именно модель вы пробовали: опыт с условной GPT-3.5 и современной моделью — это разные миры.

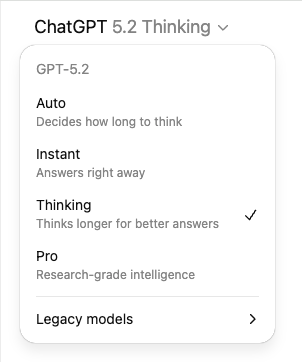

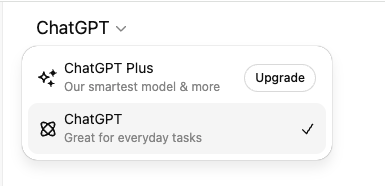

Но и это ещё полбеды: у одной и той же последней версии «GPT-5.2» могут быть разные варианты/режимы. Если говорить про ChatGPT в интерфейсе chatgpt.com [2], обычно видны три режима: gpt-5.2-instant, gpt-5.2-thinking, gpt-5.2-pro. И если у вас нет платной подписки, вы, как правило, не можете осознанно выбирать между ними.

При этом между gpt-5.2-instant и gpt-5.2-thinking — заметная разница в качестве. У бесплатного пользователя ограничения не только по количеству запросов, но и по «тяжести» режима: чаще будет работать instant, а thinking — включаться реже и/или с меньшим лимитом на размышления. Плюс у бесплатного тарифа обычно меньше контекстное окно — это тоже влияет на качество.

Платно:

Бесплатно:

Отсюда и колоссальная разница в опыте: сравнивать результаты пользователя на бесплатном тарифе и человека, который регулярно использует thinking-режим, — некорректно. Давайте объясню, что там за магия такая в этом thinking скрыта.

Модели с рассуждением: первый большой фактор качества

Thinking / reasoning модели — это модели, которые «думают перед ответом»: тратят больше времени и токенов на внутреннее рассуждение, лучше держат многошаговые задачи, реже ломаются на логике [3] и планировании.

В документации OpenAI reasoning-модели описываются как обученные «думать перед тем, как отвечать» (внутренний chain-of-thought), с упором на многошаговое решение задач. Это в среднем заметно улучшает качество ответов: примерно как разница между человеком, который подумал, и человеком, который ляпнул первое, что пришло в голову.

Примером таких моделей у других вендоров будут: claude sonnet/opus, gemini pro, deepseek с включённым режимом deepthink.

Важно: reasoning стоит денег, потому что тратит много токенов. Чем лучше модель «думает», тем больше токенов сжигается. Токены — это вычисления и энергия, поэтому вендоры не дают большие лимиты reasoning «просто так»: иначе экономика не сойдётся. Отсюда типичный эффект в бесплатных режимах: даже если у вендора можно использовать reasoning модель, то она будет работать с более жёсткими лимитами — и качество будет ниже, чем у платного тарифа.

Поиск в интернете: второй большой фактор качества

По умолчанию LLM-модели обучены на неактуальных данных и могут галлюцинировать — выдавать правдоподобную чушь.

Доступ к веб-поиску решает обе проблемы:

-

позволяет подтянуть актуальные данные;

-

снижает вероятность выдумок, потому что модель опирается на реальные источники.

На chatgpt.com [2] веб-поиск часто включается автоматически (когда модель считает, что без него риск ошибки [4] высок), а в некоторых других продуктах его нужно включать вручную — или его может не быть вовсе. И вот, если его нет, то, опять же, качество ответов будет кардинально хуже.

ChatGPT через сторонние сервисы

Я не случайно выше пишу именно chatgpt.com [2] — это конкретный продукт вендора с его подпиской, режимами и инструментами. Из-за санкций и платежей многие используют сервисы-«прокладки», и это добавляет нюансов.

Если вы общаетесь не через chatgpt.com [2], а через сторонний интерфейс/плагин/«подписку на GPT внутри продукта X», почти наверняка под капотом это вызовы через API. И тогда «GPT» перестаёт быть единым опытом — условия задаёт не модель, а то, как её настроили.

В API можно выставлять лимиты на контекст, на длину ответа, и на глубину размышления. И тут есть экономический фактор: размышления и длинные ответы стоят денег, потому что тратят больше токенов и вычислений. Если вы платите не OpenAI, а посреднику, у него есть стимул [5] удешевить запрос — сделать ответы короче, «думать» меньше и реже включать инструменты.

Отдельных денег стоит и веб-поиск: в API он обычно идёт как отдельный инструмент и имеет отдельную стоимость, поэтому многие клиенты либо не включают его вовсе, либо сильно ограничивают частоту. Отсюда типичный эффект: «ChatGPT умнее и точнее на chatgpt.com [2], чем в сервисе X» — потому что в ChatGPT чаще доступны и глубокое размышление, и веб-поиск, и нормальные лимиты.

Продукт — важная надстройка над LLM

Даже если модель одна и та же, и вы используете одинаковые режимы и инструменты, поведение [6] всё равно может заметно отличаться — из-за продукта, из которого вы к ней обращаетесь.

У любого продукта есть своя «обвязка»: системные инструкции (как модели себя вести именно в этом интерфейсе), правила форматирования, ограничения, а также свой набор и способ использования инструментов.

Например, chatgpt.com [2] оптимизирован под диалог: там модель ведёт беседу, уточняет контекст, держит тон и структуру «чатом». А codex-cli — это инструмент для работы из терминала от OpenAI: он больше заточен под взаимодействие с кодовой базой, поиск по файлам, правки и выполнение команд. Поэтому если попытаться «просто поболтать» в codex-cli с GPT, то ощущения будут другими: модель будет вести себя менее «чатово» и более «инструментально», потому что продукт подталкивает её к такому стилю работы.

В разработке продукт часто важен не меньше, чем «умность» модели. В связке правильный инструмент + сильная модель (например, Claude Code с Opus или codex-cli с gpt-5.3-codex) может давать результат лучше, чем Cursor или GitHub Copilot даже при тех же самых LLM моделях — просто потому что по-другому устроены контекст, системные инструкции, стратегии поведения [7] и доступные действия.

Локальные и корпоративные развёртывания моделей: квантование и дистилляция

Отдельная категория — модели, которые вы запускаете сами (или разворачиваются внутри компании). Здесь важно помнить ещё об одном источнике различий: модель могут сжать ради запуска на более слабом и дешёвом железе. Два самых частых приёма — квантование и дистилляция.

Квантование — это когда модель «перекодируют» в более компактный формат: её внутренние числа (веса) хранят грубее, с меньшей точностью (как в изображениях из RAW сжимают в JPEG). Это снижает требования к памяти [8] и ускоряет работу, но часть «тонких деталей» теряется — поэтому качество обычно падает на сложных рассуждениях, длинном контексте и задачах, где важна точная формулировка.

Кроме квантования часто используют дистилляцию: берут большую «модель-учителя» и обучают меньшую «модель-ученика» повторять [9] её поведение. Так получается реально меньшая по размеру модель, которая проще запускается на слабом железе, но это уже другая модель и качество тоже может отличаться.

Поэтому, например, Qwen3-Coder и какой-нибудь Qwen3-Coder-30B-A3B-Instruct-FP8 считаются разными моделями. FP8 — это квантованная версия, поэтому качество и поведение могут отличаться от «полной» версии, которую обычно указывают в бенчмарках.

Вывод

Фраза «я использую GPT» сама по себе не даёт информации для сравнения. На результат влияют как минимум четыре вещи: какая модель, какой режим рассуждений и его лимиты, какие инструменты доступны (особенно веб-поиск) и в каком продукте это используется (ChatGPT, API-клиент, IDE-агент, корпоративный портал). Поэтому для предметного разговора всегда уточняйте: точный вариант модели/режим, клиент, наличие веб-поиска и ограничения по контексту/длине ответа/глубине размышления.

P.S.

Сам OpenAI вообще своим неймингом жизнь проще не делает. Вот, например, вы обсуждаете как пользовались codex. Но каким именно?

-

Codex CLI — консольный агент для кодинга (файлы, команды, патчи).

-

Codex app — приложение для Mac OS с нормальным интерфейсом.

-

Codex web / cloud — «Codex в ChatGPT»: веб-приложение вокруг облачного фонового агента.

-

GPT-5-Codex / gpt-5.3-codex — модель, тюн GPT под задачи кодинга.

Автор: solovgeo

Источник [10]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27815

URLs in this post:

[1] опыт: http://www.braintools.ru/article/6952

[2] chatgpt.com: http://chatgpt.com

[3] логике: http://www.braintools.ru/article/7640

[4] ошибки: http://www.braintools.ru/article/4192

[5] стимул: http://www.braintools.ru/article/5596

[6] поведение: http://www.braintools.ru/article/9372

[7] поведения: http://www.braintools.ru/article/5593

[8] памяти: http://www.braintools.ru/article/4140

[9] повторять: http://www.braintools.ru/article/4012

[10] Источник: https://habr.com/ru/companies/skbkontur/articles/1006758/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1006758

Нажмите здесь для печати.