WACV 2026 в Тусоне: конференция, пустыня и немного экзистенции

Я — Максим Куркин из лаборатории FusionBrain AIRI. Когда мне сказали «поедешь на WACV», первая мысль была — отлично, конференция. Вторая мысль — Тусон, Аризона. Пустыня Сонора. Кактусы‑сагуаро высотой с двухэтажный дом. +25°C в начале марта, когда в Москве ещё лежит снег. Круто!

В итоге я провёл в командировке девять дней — с 5 по 13 марта. Два дня дороги в каждую сторону, пять дней конференции, немного пустыни вокруг. Поездка получилась насыщенной: и по науке [1], и по ощущениям, и очень хочется поделиться увиденным!

WACV — что это вообще за конференция?

IEEE/CVF Winter Conference on Applications of Computer Vision — это «младший брат» CVPR. Принято считать её более прикладной: меньше теории ради теории, больше систем, датасетов, промышленных применений. Акцепт около 25–30% — по меркам топовых CV конференций вполне лояльно.

При этом конференция камерная — 200–300 человек, не тысячи, как на NeurIPS или ICCV. И это огромный плюс: реально можно подойти к автору работы, которая тебя интересует, и поговорить с ним без очереди. Уровень и организации, и принятых работ при этом высокий. Поэтому «маленькая конференция» в отношении WACV звучит даже как будто немного оскорбительно, я бы предпочёл вариант «конференция правильного размера».

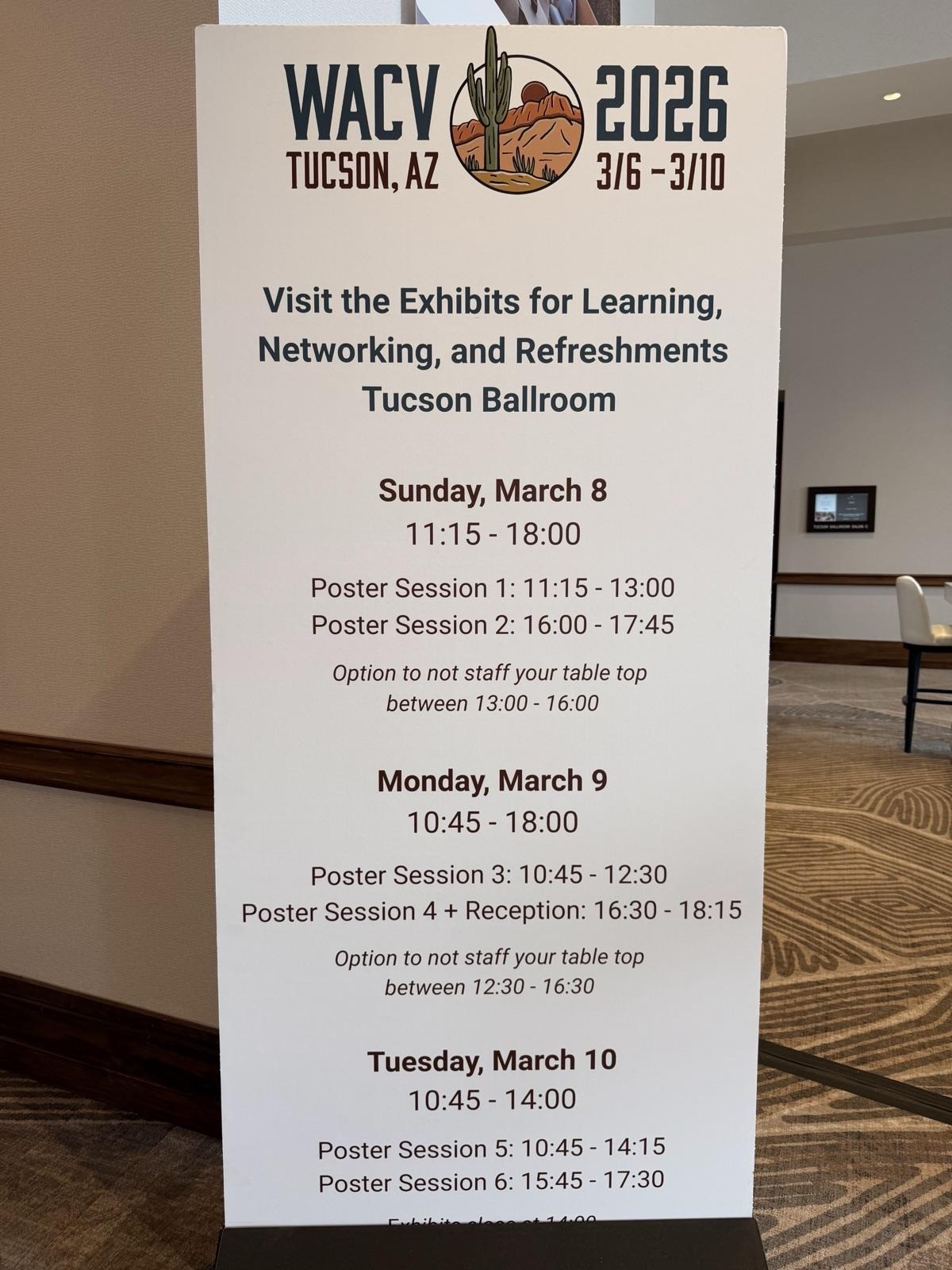

Тусон организаторы выбирают уже не первый год подряд. Место проведения — JW Marriott Starr Pass Resort, гостиница прямо посреди пустыни. Все сессии, постеры и кофе‑брейки в одном здании. Красиво. Но есть нюанс: отель стоит на отшибе, ближайшая остановка общественного транспорта в пяти километрах. Каждый день — такси или Uber, как и у большинства участников. Зато вышел из зала заседаний — а перед тобой сагуаро в метре от дорожки.

Конференцию, как это обычно бывает, открывали воркшопы и туториалы. В основном треке были как постеры, так и оралы — три дня, шесть сессий.

Что было интересного на конференции

Если говорить о трендах, которые в целом были представлены на WAVC 2026, то я бы выделил несколько ключевых вещей. Но в общем можно сказать, что индустрия Computer Vision окончательно перешла к генеративно‑центричному подходу. Основной фокус сместился с количества данных на эффективность выборки через диффузионный синтез и на динамическую плотность вычислений через адаптивное управление токенами в трансформерах.

Мультимодальность как новый стандарт

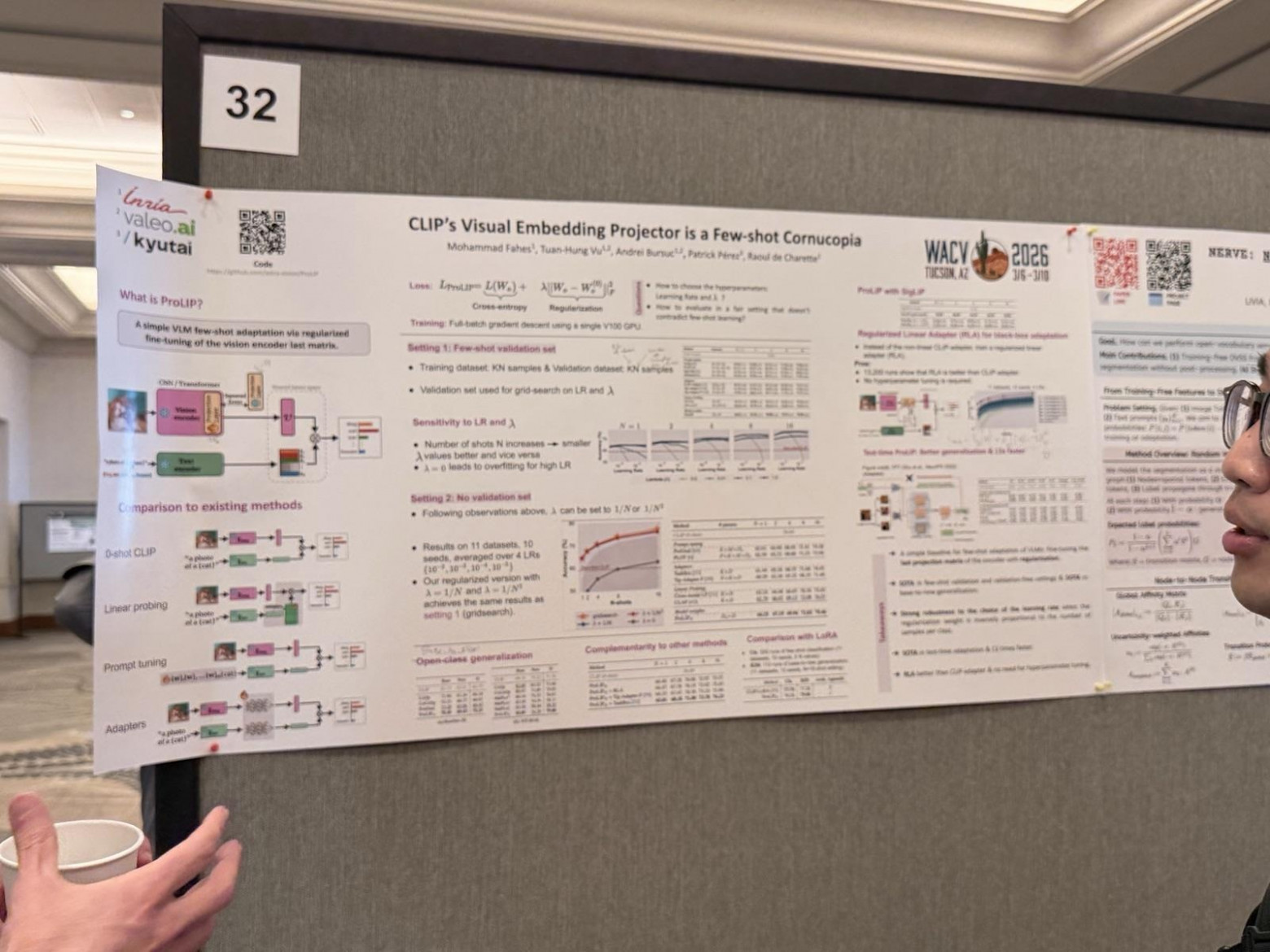

Если три года назад «мультимодальная модель» звучало как что‑то экзотическое, сейчас это просто норма. Огромная доля работ на WACV так или иначе задействует совместное обучение [2] на тексте и изображениях. Вопрос уже не «зачем», а «как именно» — какие архитектурные решения, как выровнять пространства, как бороться с модальным доминированием.

Синтетические данные и аугментация данных

Диффузионные модели окончательно вошли в состав инструментов компьютерного зрения [3] как генераторы обучающих данных. Несколько работ показывали результаты, где synthetic‑only pipeline обгоняет реальные данные на специфических доменах (медицина, спутниковые снимки, промышленный контроль качества). Это меняет логику [4] построения датасетов фундаментально.

На WACV 2026 одной из центральных тем стал “Cold Start” — обучение моделей в условиях полного отсутствия реальных размеченных данных. Вот несколько примеров:

-

Суть: Авторы доказывают, что чисто синтетический пайплайн (Blender → Event‑симулятор) позволяет обучать SNN‑модели для отслеживания саккад глаза, которые показывают стабильную точность на реальных данных.

-

TalkingPose: Efficient Face and Gesture Animation with Feedback-guided Diffusion Model [6]

Суть: Работа о генерации согласованных движений и мимики. Использование диффузионных моделей с обратной связью позволяет создавать обучающие выборки для анимации, которые по качеству и разнообразию превосходят доступные видео‑датасеты.

-

PHYSPLAT: Photorealistic Hybrid Simulation of Real and Synthetic Elements [7]

Суть: Фреймворк на базе 3D Gaussian Splatting для смешивания реальных сцен с синтетическими объектами. Это решает проблему «нереалистичности» синтетики в задачах автономного вождения.

Эффективность — не только quantization

Тема сжатия и ускорения моделей никуда не ушла, но стала интереснее. Помимо классической квантизации активно обсуждались: structured pruning с сохранением семантики, knowledge distillation с мультиагентными учителями, адаптивное вычисление (early exit, token merging в ViT). Впечатление [8], что поле дозрело до более нюансированных подходов.

Тренды WACV 2026 показывают уход от простой квантизации к методам, которые динамически меняют сложность вычислений в зависимости от входного изображения. Вот несколько примечательных работ:

-

EVTP-IVS: Effective Visual Token Pruning For Unifying Instruction Visual Segmentation [9]

Суть: Предложен метод прунинга визуальных токенов на основе k‑center с учетом пространственной информации. Достигнуто ускорение в 5 раз для видео‑задач при сохранении точности с использованием всего 20% токенов.

-

Token Fusion: Bridging the Gap between Token Pruning and Token Merging [10] (Published late 2025/2026 context)

Суть: Гибридный подход (STEP: SuperToken and Early‑Pruning), который объединяет динамическое слияние патчей и прунинг. Это позволяет обходить ошибки [11] стандартного прунинга, когда важные детали фона могли быть случайно удалены.

-

Accelerating Vision Transformers with Adaptive Patch Sizes (APT) [12] (Late 2025, обсуждалось в контексте WACV)

Суть: Вместо фиксированной сетки патчей модель использует крупные патчи для однородных областей и мелкие для сложных деталей. Увеличение пропускной способности на 40–50% для тяжелых моделей (ViT‑L/H).

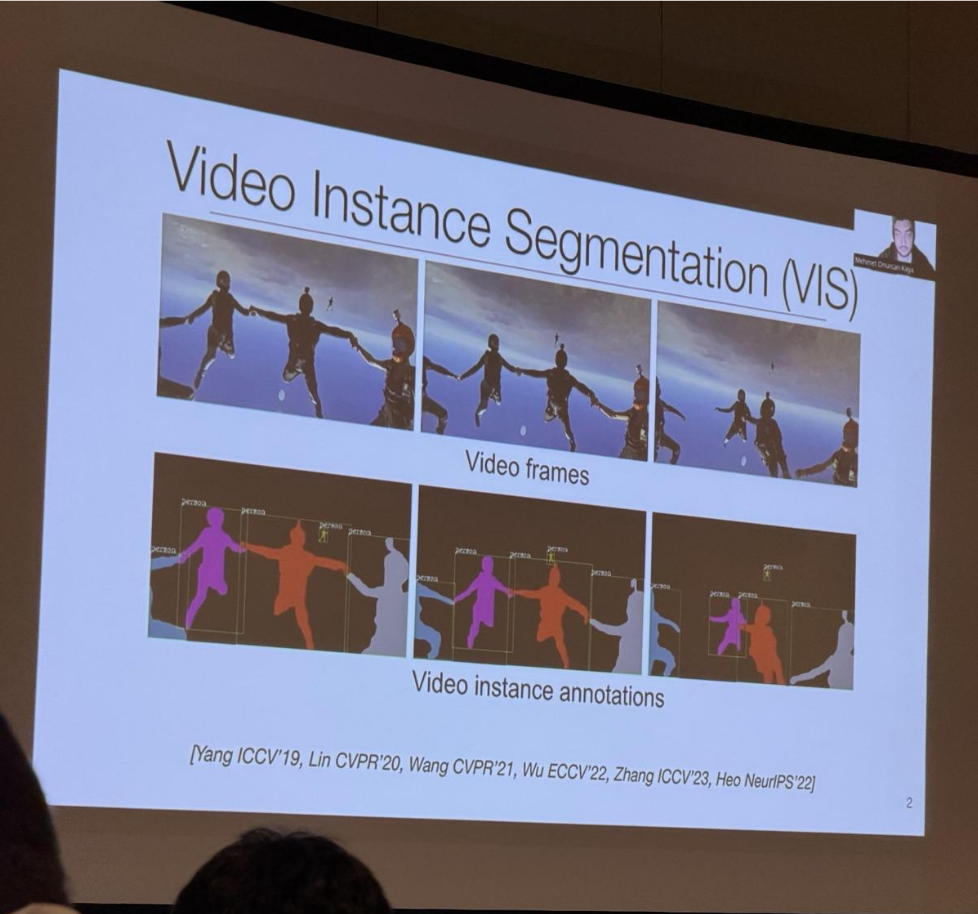

Video understanding как незакрытая проблема

Много работ про видео — и это честный сигнал, что проблема всё ещё открыта. Трансформеры с временным вниманием [13], state space модели для видеоконтекста, long‑form video QA. Данных много, бенчмарки растут, но «понимания» в полном смысле пока нет.

Постеры традиционно составляют основную массу докладов. Авторы некоторых из них пытались выделиться форматом или размером.

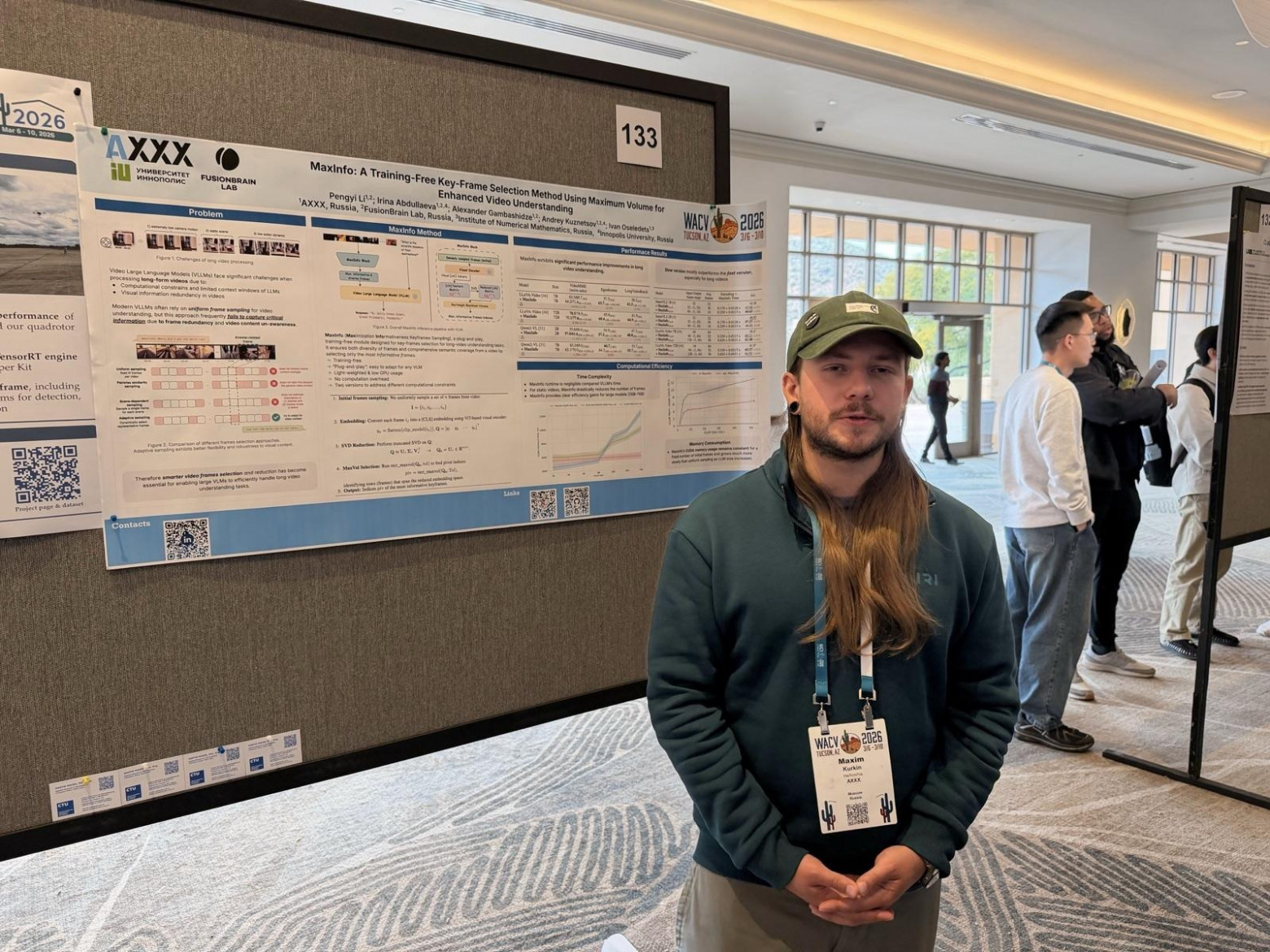

Наши работы: MaxInfo и Feature Inversion

На WACV мы привезли две работы из FusionBrain Lab. Обе — постеры, и обе я представлял лично, поскольку сами авторы не смогли приехать.

MaxInfo: умный выбор ключевых кадров для видео

“MaxInfo: A Training-Free Key-Frame Selection Method Using Maximum Volume for Enhanced Video Understanding” [15] Pengyi Li, Irina Abdullaeva, Alexander Gambashidze, Andrey Kuznetsov, Ivan Oseledets

Идея элегантная в своей простоте. Video Large Language Models при работе с длинными видео упираются в ограничения контекстного окна. Обычно кадры выбирают равномерно — каждый N‑й кадр. Но это игнорирует содержание: на статичных сценах кадры дублируются, а ключевые моменты могут быть пропущены.

MaxInfo решает это так:

-

Равномерно семплируем N начальных кадров;

-

Получаем CLS‑эмбеддинги через ViT‑энкодер;

-

Делаем SVD‑редукцию матрицы эмбеддингов;

-

Запускаем rect_maxvol — алгоритм из линейной алгебры, который находит подматрицу максимального объёма, то есть набор максимально разнообразных и информативных кадров.

Результат — plug‑and‑play модуль, без дообучения, с постоянным CUDA‑потреблением независимо от длины видео. На LongVideoBench даёт прирост +3–5% к базовым LLaVA‑Video и Qwen2-VL без каких‑либо изменений в архитектуре модели.

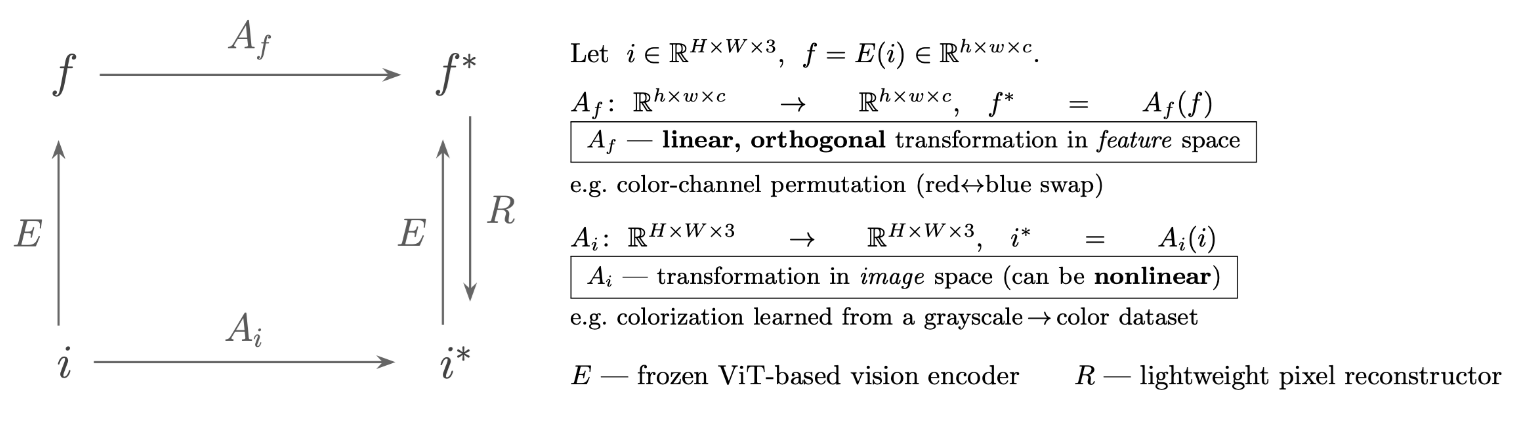

Feature Inversion as a Lens on Vision Encoders

“Feature Inversion as a Lens on Vision Encoders” [16] Eduard Allakhverdov, Dmitrii Tarasov, Elizaveta Goncharova, Andrey Kuznetsov

Вторая работа задаёт красивый вопрос: что именно «видит» vision encoder? Если мы можем реконструировать изображение из замороженных признаков ViT, значит, эти признаки содержат достаточно информации. А если мы можем делать контролируемые правки в пространстве признаков и наблюдать предсказуемые изменения в реконструкции — значит, пространство признаков структурировано осмысленно.

Ключевая идея выражается коммутативной диаграммой:

в пространстве признаков (линейное, ортогональное) соответствует преобразованию

в пространстве признаков (линейное, ортогональное) соответствует преобразованию  в пространстве изображений, то

в пространстве изображений, то  . Красивый геометрический взгляд на то, насколько кодирование визуальных признаков сохраняет геометрическую структуру.

. Красивый геометрический взгляд на то, насколько кодирование визуальных признаков сохраняет геометрическую структуру.На практике это выглядит так: авторы тренируют лёгкий реконструктор для каждого замороженного энкодера и показывают, что:

-

Все ViT‑энкодеры позволяют реконструировать изображения, но качество сильно зависит от разрешения и целевой функции предобучения;

-

Простые линейные преобразования в feature space дают предсказуемые цветовые трансформации в pixel space (например, перестановка red↔blue);

-

Энкодеры с image‑centric objectives (SigLIP2 ≫ SigLIP) сохраняют больше визуальной информации.

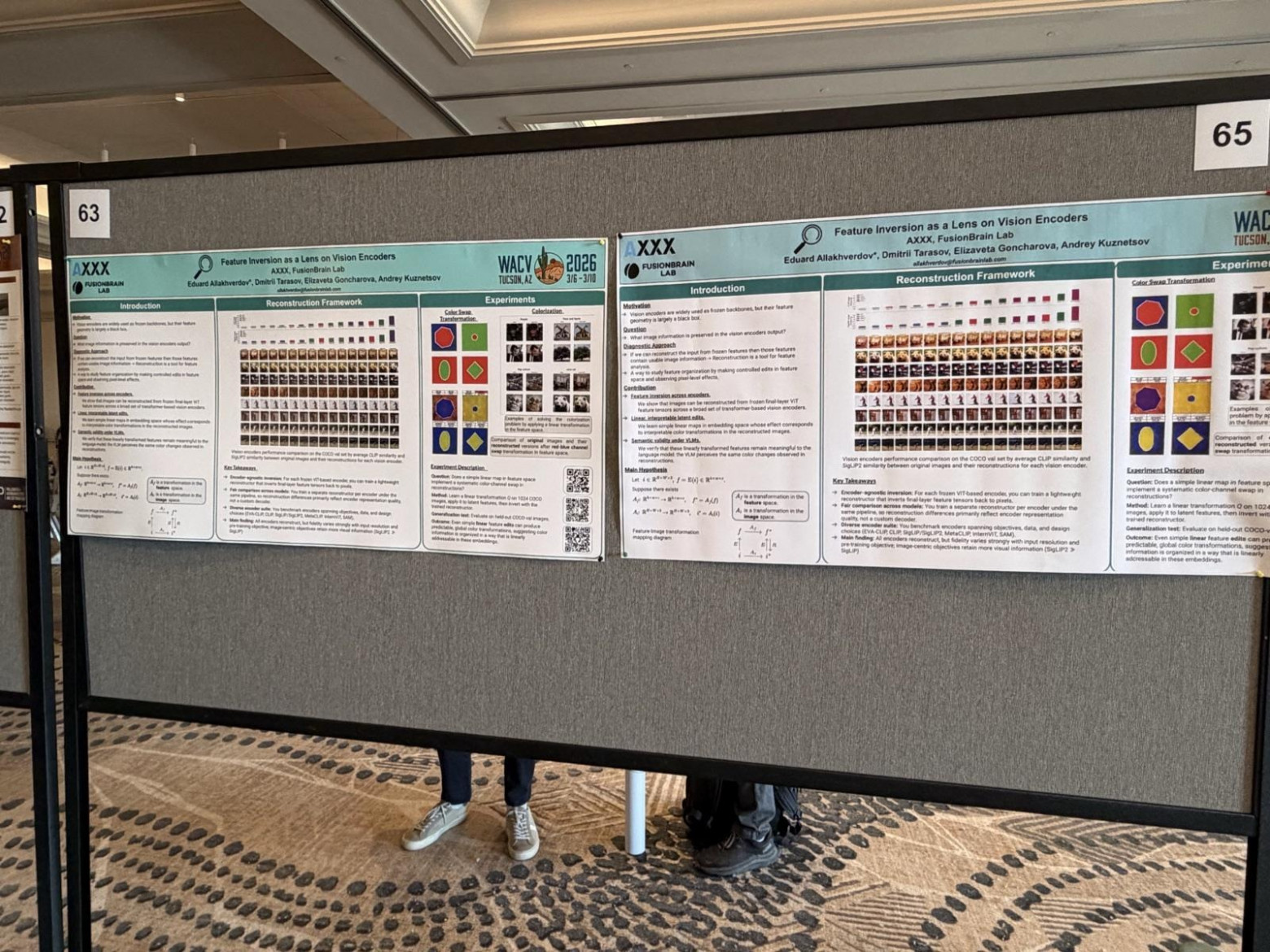

Этот постер вызвал много интереса [17] — к нему постоянно подходили, обсуждали коммутативность преобразований и практические выводы для выбора энкодеров.

Ребята научились буквально «выворачивать» латентное пространство наизнанку, восстанавливая из него изображения. Самый любопытный хак: они показали, что простые геометрические манипуляции с векторами (например, повороты) позволяют предсказуемо менять разные атрибуты вроде цвета. Это хороший пример того, как за сложными весами скрывается строгая и красивая математическая структура.

А ещё я пошёл на хитрость: стенд рядом с моими пустовал. Поэтому я распечатал и повесил два экземпляра постера по Feature Inversion рядом — получилось эффектно, оцените сами:

Люди и атмосфера

Отсутствие толп на конференции создавало особенную атмосферу, которую особенно сильно ощущаешь на фоне более многолюдных эвентов. На докладах было банально меньше стульев и больше кислорода [18].

Камерность WACV — это ещё и про разговоры. На большой конференции ты утопаешь в толпе; здесь ты реально знакомишься с людьми.

Я тоже завёл себе несколько новых знакомых.

Пьер из EPFL

Одна из самых запомнившихся встреч — Пьер (Pierre Ancey), PhD‑студент первого года из EPFL. Его работа на конференции — FastPose‑ViT [19]: ViT‑архитектура для оценки позы космических аппаратов в реальном времени по одному изображению. Модель напрямую регрессирует 6DoF позу без итеративных алгоритмов и достигает ~75 мс на кадр (до 33 FPS) на NVIDIA Jetson Orin Nano — впечатляющие показатели для edge‑устройства.

Но разговор быстро ушёл за пределы его научной работы. Оказалось, что Пьер параллельно с PhD активно использует Claude Code. Он превратил его буквально в фабрику по производству веб‑сайтов для состоятельных швейцарских клиентов. Полный цикл: от маркет‑ресёрча и анализа конкурентов, через создание макетов, до полноценного работающего сайта и его сопровождения — весь pipeline автоматизирован через Claude. Мы долго обсуждали возможности и ограничения Claude Code и оказалось, что наш опыт [20] использования во многом совпадает, хотя контексты совершенно разные.

Хильда Кюне

Также удалось пообщаться с Hilde Kuehne [21] из Tübingen AI Center / University of Tübingen. Её работа MM‑TS: Multi‑Modal Temperature and Margin Schedules [22] была принята как Oral на WACV 2026 — это серьёзное признание. Идея: динамически подстраивать температуру в contrastive loss во время обучения мультимодальных моделей, модулируя силы притяжения и отталкивания. Для несбалансированных датасетов температура назначается в зависимости от плотности кластеров — более плотные получают более высокую температуру для сохранения семантической структуры. Подход унифицирует InfoNCE loss и max‑margin objectives, показывая state‑of‑the‑art на Flickr30K, MSCOCO, EPIC‑KITCHENS-100 и YouCook2.

Ещё из прикольного: на WACV 2026 поставили фотобудку, которая печатала фото с рамкой в честь 80-летия The Computer Vision Foundation.

Я конечно же, тоже сфотографировался:

Тусон: пустыня, кактусы и +25°C в марте

Отдельная часть истории — сам город и окрестности. Тусон — это не курортный Лас‑Вегас и не деловой Феникс. Это академический город с университетом, испанским колониальным прошлым и пустыней прямо за порогом.

Пустыня Сонора

Сагуаро — кактусы, которые стоят как символ американского Запада на всех открытках — растут только здесь, в пустыне Сонора. Растут они не спеша и долго живут: 75-летний кактус — это полутораметровый ствол без единого бокового отростка. Те, у кого есть «руки», стоят по 150–200 лет.

Где‑то тут, вероятно, нашёл свой последний приют Эдвард Эбби — рейнджер, анархист и писатель, который работал в национальных парках Юго‑Запада и написал «Банду гаечного ключа». Никто не знает, где он лежит — известно только, что он умер в аризонской пустыне.

Рядом с Тусоном есть Saguaro National Park, разделённый на две секции, западную и восточную. Ехать минут 20 от центра. Если попадаешь туда на рассвете или закате, имеешь возможность запечатлеть одну из тех сцен, благодаря которым понимаешь, что планета большая и странная.

Фауна здесь тоже экзотичная. Причём, чтобы убедиться в этом, зачастую даже не нужно уходить глубоко в пустыню.

Атмосфера и темп

Тусон в целом — тихий, горизонтальный город. Горы вокруг со всех сторон (Santa Catalina, Rincon, Tucson Mountains). Воздух сухой. Ночью прохладно. Темп жизни несравнимо медленнее московского — это было немного дезориентирующе.

Ниже — немного фото, чтобы передать атмосферу города.

Еда

Мексиканская кухня здесь не «мексиканская», а сонорская — своя региональная история. Carne asada, chimichangas (это изобретение Тусона, если верить местным), green chile. Если окажетесь там — рекомендую хотя бы раз покушать за пределами отельного ресторана.

Впрочем, на конференции кормили тоже неплохо — Street Taco Station от JW Marriott с carne asada, chicken adobo и вегетарианскими тако стала хитом.

Еда на кофе‑брейках и постерных секциях тоже обладала местным колоритом:

Вместо заключения

WACV — хорошая конференция для того, чтобы почувствовать пульс прикладного CV без перегруза NeurIPS‑масштаба. Плотность качественных работ высокая, люди доступны для разговора, локация в этот раз была просто красивым бонусом. Камерный формат на 200–300 человек — то, чего часто не хватает на больших конференциях.

А Тусон — это место, куда стоит вернуться просто так. Без постера.

Автор: Fr0do

Источник [24]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/28351

URLs in this post:

[1] науке: http://www.braintools.ru/article/7634

[2] обучение: http://www.braintools.ru/article/5125

[3] зрения: http://www.braintools.ru/article/6238

[4] логику: http://www.braintools.ru/article/7640

[5] SynSacc: A Blender-to-V2E Pipeline for Synthetic Neuromorphic Eye-Movement Data and Sim-to-Real Spiking Model Training: https://openaccess.thecvf.com/content/WACV2026W/EVGEN-2026/html/Iddrisu_SynSacc_A_Blender-to-V2E_Pipeline_for_Synthetic_Neuromorphic_Eye-Movement_Data_and_WACVW_2026_paper.html

[6] TalkingPose: Efficient Face and Gesture Animation with Feedback-guided Diffusion Model: https://av.dfki.de/av_dataset_categories/internal/

[7] PHYSPLAT: Photorealistic Hybrid Simulation of Real and Synthetic Elements: https://www.rsipvision.com/WACV2026-Monday/

[8] Впечатление: http://www.braintools.ru/article/2012

[9] EVTP-IVS: Effective Visual Token Pruning For Unifying Instruction Visual Segmentation: https://openaccess.thecvf.com/content/WACV2026/html/Zhu_EVTP-IVS_Effective_Visual_Token_Pruning_For_Unifying_Instruction_Visual_Segmentation_WACV_2026_paper.html

[10] Token Fusion: Bridging the Gap between Token Pruning and Token Merging: https://www.researchgate.net/publication/379721697_Token_Fusion_Bridging_the_Gap_between_Token_Pruning_and_Token_Merging

[11] ошибки: http://www.braintools.ru/article/4192

[12] Accelerating Vision Transformers with Adaptive Patch Sizes (APT): https://arxiv.org/abs/2510.18091

[13] вниманием: http://www.braintools.ru/article/7595

[14] Mehmet Onurcan Kaya: https://scholar.google.com/citations?user=fJDt1ycAAAAJ&hl=tr

[15] “MaxInfo: A Training-Free Key-Frame Selection Method Using Maximum Volume for Enhanced Video Understanding”: https://openaccess.thecvf.com/content/WACV2026/papers/Li_MaxInfo_A_Training-Free_Key-Frame_Selection_Method_Using_Maximum_Volume_for_WACV_2026_paper.pdf

[16] “Feature Inversion as a Lens on Vision Encoders”: https://openaccess.thecvf.com/content/WACV2026/html/Allakhverdov_Feature_Inversion_as_a_Lens_on_Vision_Encoders_WACV_2026_paper.html

[17] интереса: http://www.braintools.ru/article/4220

[18] кислорода: http://www.braintools.ru/article/5138

[19] FastPose‑ViT: https://arxiv.org/abs/2512.09792

[20] опыт: http://www.braintools.ru/article/6952

[21] Hilde Kuehne: https://hildekuehne.github.io/

[22] MM‑TS: Multi‑Modal Temperature and Margin Schedules: https://arxiv.org/abs/2603.08202

[23] соединяются: https://occupiedtucsoncitizen.org/?p=6549

[24] Источник: https://habr.com/ru/companies/airi/articles/1018010/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1018010

Нажмите здесь для печати.