Как гибрид IDP и VLM экономит миллионы на верификации данных

Последние 2 года мы в Content AI активно тестируем Vision Language Models (VLM) для обработки документов. Модели вроде Qwen2.5-VL или Gemini 2.5 отлично работают с простыми формами — чеками, типовыми договорами. Но на документах со сложными фонами, многоуровневыми таблицами или нестандартной версткой VLM часто галлюцинирует, теряет строки и путается в реквизитах.

В одной из предыдущих статей мы пришли к выводу, что будущее за комбинированным подходом [1], когда VLM усиливает IDP-решения.

В этот раз мы проверили гипотезу: пусть VLM не распознает документ с нуля, а проверяет черновик из IDP-системы и исправляет ошибки [2], опираясь на исходное изображение. Базовым OCR движком выступила наша платформа ContentCapture.

Практическая цель эксперимента — автоматизировать верификацию документов. Сейчас в крупных компаниях сотни операторов вручную сверяют распознанные данные с оригиналами.

Методология эксперимента и тестовые данные

Документ обрабатывается в ContentCapture на классическом OCR. Он выдает JSON с извлеченными полями, который передается в промпт для VLM вместе с картинкой документа. Модель выступает в роли верификатора: проверяет конкретные поля, исправляет опечатки, нормализует форматы и оставляет корректные данные без изменений.

Для тестов собрали два набора данных:

-

Первый — паспорта РФ, около 400 изображений, включая сложные случаи без машиночитаемой зоны (MRZ). Использовали в основном синтетические образцы, но был и небольшой набор реальных паспортов наших сотрудников.

-

Второй набор — синтетическая финансовая первичка практически идеального качества. В него вошли акты выполненных работ, счета, счета-фактуры, ТОРГ-12, УПД и УКД (100 – 150 штук каждого типа).

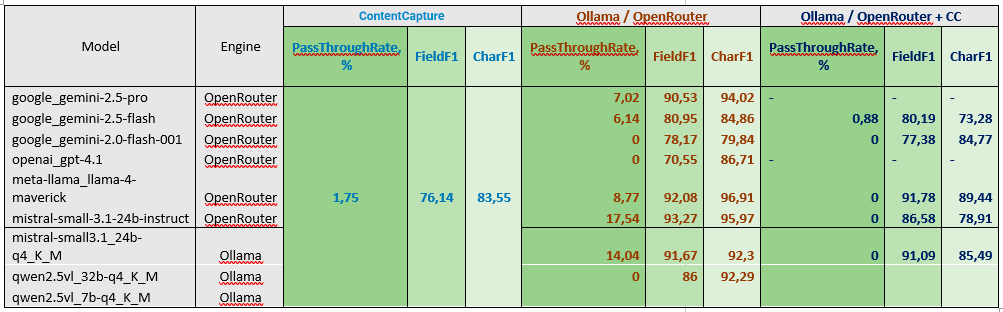

В экспериментах участвовали VLM-модели Google Gemini 2.5 Flash и Pro, линейка Qwen2.5-VL (от 7B до 72B), Mistral-Small-3.1-24B-Instruct. В таблицах с результатами вы увидите и другие модели с прочерками — их мы не тестировали, добавили просто для общей картины и референса.

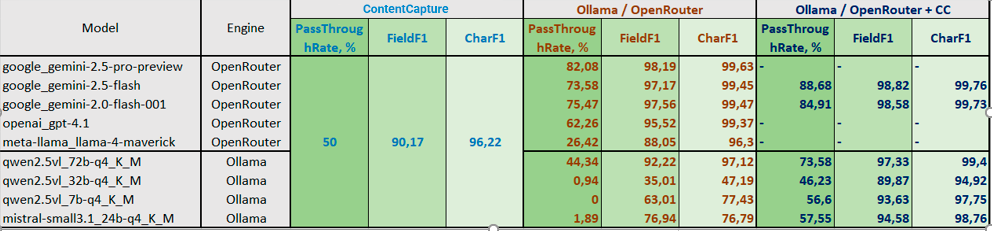

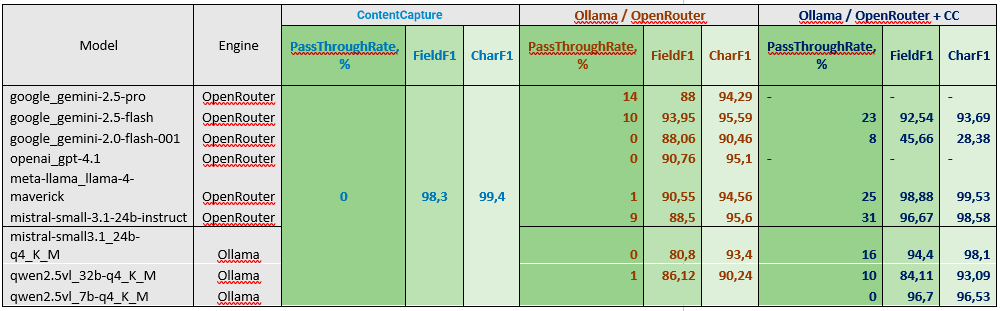

Паспорта: контекст IDP повышает точность VLM

Распознавание паспортов без MRZ — сложная задача для нейросетей. Без дополнительного контекста локальные и некоторые облачные VLM часто ошибаются и начинают галлюцинировать.

Метрики ощутимо растут, когда VLM в свой контекст получает базовую JSON-разметку из ContentCapture. Gemini-2.5-flash показала Pass-Through Rate (PTR) на уровне 88,7%. Без расширения контекста эта версия набирала около 74%.

Напомним, что Pass-Through-Rate — одна из самых строгих метрик качества. Документ считается распознанным, только если все символы в соответствующих полях распознаны верно, иначе результат по всему документу обнулится.

Локальная Qwen2.5-VL-72b в роли верификатора повысила результат по PTR до 73,6%, что сравняло такой подход с тяжелыми облачными решениям без ContentCapture.

На документах с MRZ-строкой, где распознается только машиночитаемая зона, качество выросло на 11-12%. Модели Gemini распознали без ошибок почти 90 MRZ-строк из 100, хотя самостоятельно без ContentCapture отрабатывали не более 80.

Из этого мы делаем вывод, что при необходимости развернуть решение без участия облачных моделей лучше всего работает связка ContentCapture с локальной Qwen2.5-VL-72b.

Для документов с MRZ-строкой лучше всего подойдет верификация моделью Mistral-Small-3.1-24B.

В итоге гибрид классического OCR и VLM работает лучше, чем каждый подход по отдельности.

Финансовая первичка: тестирование на 7 типах документов

Главная проблема финансовой первички — табличные части и сложная верстка. Мы протестировали гибридный подход на семи типах документов (по 100–150 штук на каждый документ) и сравнили качество распознавания в трех сценариях.

Для верификации VLM-моделью использовали жестко структурированные промпты с правилами валидации конкретных полей. Результаты показали, что эффективность связки сильно зависит от структуры конкретного документа, однако почти на всех документах качество существенно выросло.

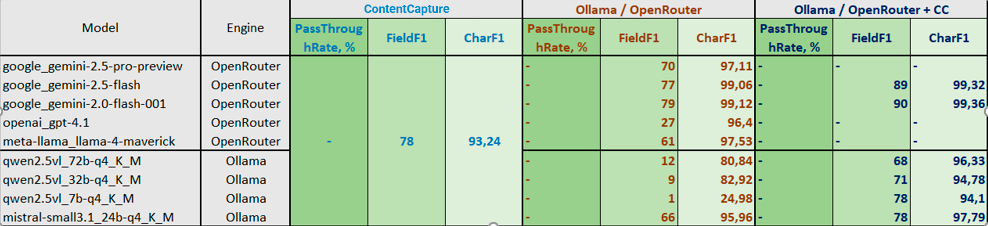

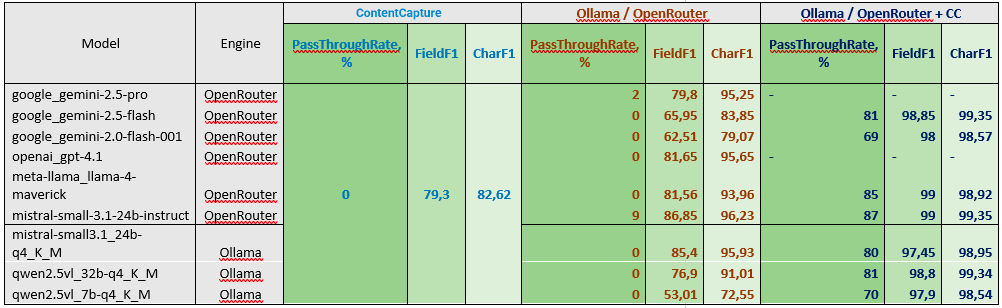

Акты выполненных работ

Базовый ContentCapture показал на актах PTR 0%.

VLM справилась лучше: результат у Gemini 2.5 Flash показал 73%. А гибридный сценарий (VLM+CC) с локальной моделью Mistral-Small-3.1-24b показал 79% PTR. Мы предполагаем, что здесь гибридный подход выигрывает за счет того, что ContentCapture формирует надежный каркас таблицы, а VLM точечно исправляет ошибки в реквизитах и нормализует количественные значения.

Счета

ContentCapture показал PTR 5%, а максимальный результат из VLM без ContentCapture – облачная Gemini 2.5 Pro — 31%. В гибридном сценарии результаты выросли до 75% с облачной Gemini 2.0 Flash и до 71% с локальной Mistral-Small-3.1-24b.

Вероятно, на счетах гибрид работает отлично благодаря относительной простоте документов. Предварительный JSON от IDP-платформы почти не содержит структурных ошибок, поэтому нейросеть не тратит контекст на восстановление макета, а фокусируется на точечной верификации данных.

Счета-фактуры

Здесь ContentCapture показал PTR 0%, VLM Gemini 2.5 Pro без CC — 14%, а гибридный сценарий дал 31% с Mistral-Small-3.1-24b (OpenRouter) и 25% с LLaMA-4.

Вероятно, что предварительный каркас от IDP-системы здесь критически важен, так как он задает жесткие границы и снижает риск перепутать близко расположенные поля. Как, например, «номер/дата», с которыми VLM-модели часто не справляются самостоятельно.

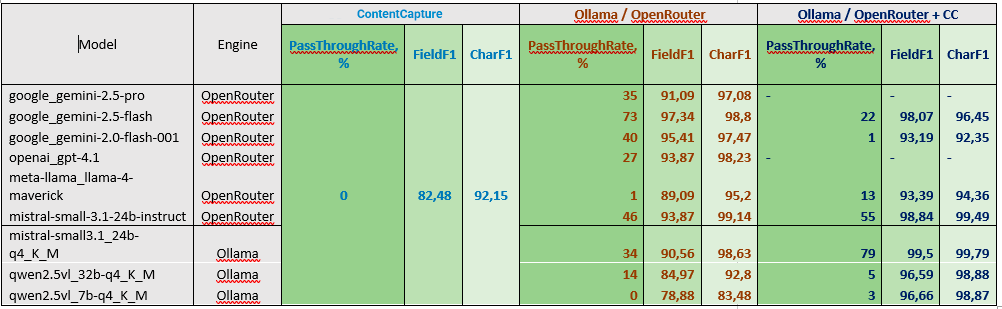

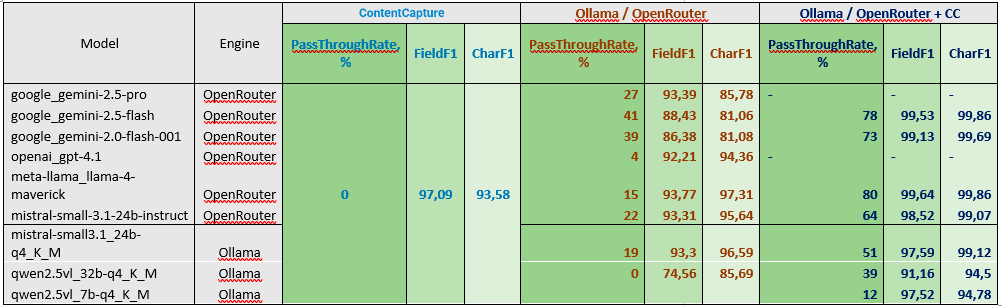

Акты приемки работ КС-2

На актах о приемке выполненных работ (КС-2) связка показала феноменальный прирост. ContentCapture выдал 0% PTR, VLM-only — всего 2%.

Гибридная верификация (VLM+CC) с Mistral-Small-3.1-24b подняла PTR до 87%, а локальная Qwen2.5-VL-32b дала 81%.

Мы считаем, что длинные и геометрически сложные таблицы в КС-2 непосильны для корректного распознавания генеративным сетям. Но когда IDP передает размеченную геометрию, VLM фокусируются на очистке от лишнего мусора, что и дает радикальный рост качества.

Товарные накладные ТОРГ-12

С товарными накладными ContentCapture не распознал полностью корректно ни одного документа, лучшие облачные VLM модели выдали около 41%. Гибридная схема (VLM+CC) показала 80% с LLaMA-4 и 78% с Gemini 2.5 Flash. Среди локальных моделей лучшим верификатором опять оказался Mistral c PTR в 51%.

Вероятно, гибридный сценарий здесь помогает за счет гибкой работы нейросетей с длинными текстовыми блоками: VLM-модели успешно отделили адреса от реквизитов, опираясь на готовые рамки сущностей от IDP-движка.

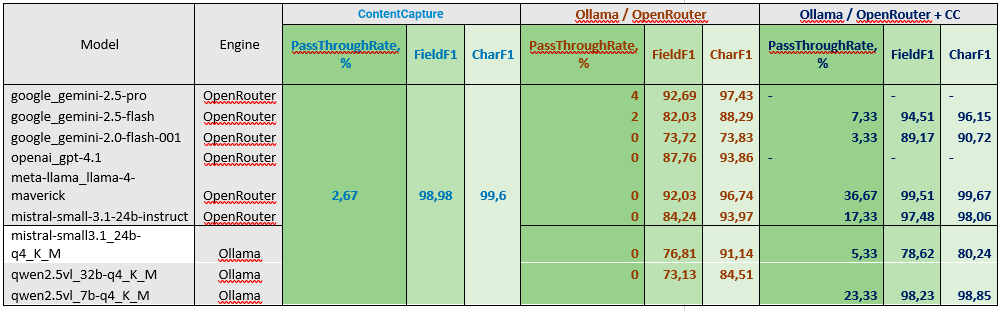

Универсальные передаточные документы

Для УПД ContentCapture показал PTR 2,67%, VLM без IDP — 4%, а гибридный сценарий с LLaMA-4 выдал 36,67%. Локальная Qwen2.5-VL-7B показала 23,3%. Возможно, что перегруженная шапка УПД и наличие смешанных зон (налоговые реквизиты, итоги под таблицей) мешают VLM-моделям корректно извлечь документ с нуля. При наличии базового каркаса от ContentCapture модель может сфокусироваться на проверке ИНН/КПП, дат и сумм.

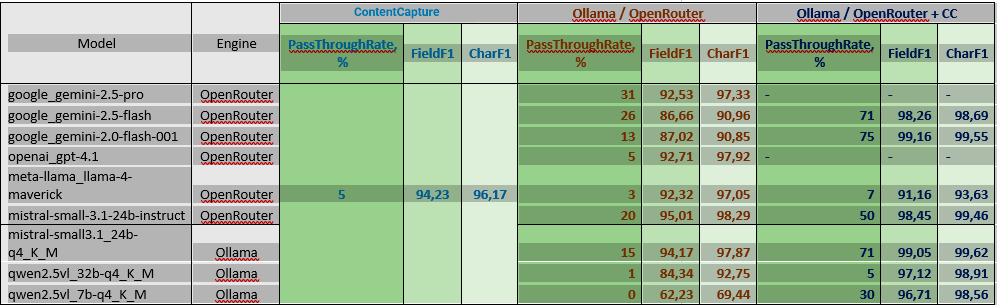

Универсальные корректировочные документы: где гибрид дал сбой

Единственный документ, на котором гибридный подход провалился, — универсальный корректировочный документ (УКД). Здесь VLM без ContentCapture (Mistral-Small-3.1-24b) показал скромные 17,54% PTR, базовый ContentCapture — 1,75%, но при их объединении результат упал до 0% у большинства моделей (лишь Gemini 2.5 Flash дотянул до 0,88%).

Мы полагаем, что причина в самой структуре УКД. Документ содержит вложенные повторяющиеся группы и сложную логику [3] строк «до изменения» и «после изменения». Даже получив черновой JSON от IDP, генеративная модель при попытке верификации теряет многомерные связи между строками и колонками. Она пытается переписать данные по своей логике, в результате разрушает структуру таблицы и обнуляет итоговый результат.

Практические рекомендации по использованию локальных моделей для верификации первички

На основе экспериментов мы составили рекомендации по локальным open-source моделям для корпоративного использования

-

Mistral-Small 3.1-24b (q4) зарекомендовала себя как лучший локальный верификатор для несложных табличных документов. На актах выполненных работ она выдала 79% PTR, а на счетах — 71%. Да и на КС-2 выдает неплохой результат.

-

Qwen2.5-VL-32b (q4) отлично справляется с длинными формами со специфической геометрией, если таблица имеет плоскую структуру. Например, на КС-2 она дала максимальные 81% PTR.

-

Qwen2.5-VL-7B (q4) показала себя как легкая и быстрая модель, которую можно применять для верификации умеренно сложных структур. Например, для УПД, где она достигла 23,33% PTR в гибридном сценарии.

-

Документы с многоуровневыми вложенными таблицами (как УКД) лучше обрабатывать только через IDP. VLM-модели здесь разрушают структуру.

Экономический эффект автоматизации верификации

В крупных компаниях верификацией документов занимаются десятки операторов. Средний верификатор проверяет 120-150 документов в день, его зарплата с налогами составляет около 150 тыс. ₽ в месяц.

При автоматизации верификации 80% документов (как показали наши тесты) компания с потоком 15 000 документов в месяц может оптимизировать штат с 10 до 2 верификаторов. Это дает экономию около 14,4 млн ₽ в год только на фонде оплаты труда.

Даже для небольших отделов с 2-3 верификаторами автоматизация позволяет высвободить 2,3-2,9 млн ₽ ежегодно и перераспределить высвободившихсясотрудников на другие задачи.

Итоги эксперимента

Связка IDP и VLM решает проблему нестабильного качества нейросетей на сложной верстке.

Классический движок обеспечивает жесткую структуру и геометрию, а VLM работает как верификатор, повышающий метрики извлечения до уровня, пригодного для продакшена. Это позволяет эффективно использовать локальные open source модели без отправки чувствительных документов в облачные API.

Эксперимент подтвердил: гибридный подход IDP + VLM может автоматизировать значительную часть ручной верификации документов. На 5 из 7 типов документов гибрид достигает 75%-89% PTR. Это означает, что на этих типах 7-9 документов из 10 распознаются полностью корректно и не требуют ручной проверки.

Где работает лучше всего:

-

паспорта: 88,7% PTR

-

КС-2: 87% PTR

-

акты выполненных работ: 79% PTR

-

ТОРГ-12: 80% PTR

-

счета: 75% PTR

Гибридный подход оказался не только технически эффективнее, но и экономически оправданным, т.к. автоматизация окупается за счет сокращения ручного труда при сохранении высокого качества обработки документов.

——————————————————————-

Это блог компании Content AI. Мы помогаем работать с информацией умнее — автоматизировать обработку документов, извлекать данные и повышать качество бизнес-процессов с помощью собственных технологий и современного ИИ. Здесь рассказываем, как разрабатываем продукты и делимся опытом [4], архитектурными решениями и кейсами внедрения интеллектуальной автоматизации.

Наш Telegram-канал со всеми новостями: https://t.me/content_ai [5]

Автор: ContentAI_Team

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/28613

URLs in this post:

[1] будущее за комбинированным подходом: https://habr.com/ru/companies/contentai/articles/993628/

[2] ошибки: http://www.braintools.ru/article/4192

[3] логику: http://www.braintools.ru/article/7640

[4] опытом: http://www.braintools.ru/article/6952

[5] https://t.me/content_ai: https://t.me/content_ai

[6] Источник: https://habr.com/ru/companies/contentai/articles/1021880/?utm_campaign=1021880&utm_source=habrahabr&utm_medium=rss

Нажмите здесь для печати.