Цифровой аудит против галлюцинаций по ГОСТу. Как понять, когда ответу ИИ нельзя верить?

Все мы привыкли, что нейросети — это про креатив, быстрый поиск и «накидай мне презу на завтра», но что происходит, когда вы выводите LLM из зоны комфорта написания стишков, саммари и поздравлений для бухгалтерии, в зону ответственности, такую как анализ сложных документов, комплаенс, медицина, право, аудит или стратегическое планирование и финансы? Там начинается серая зона, где ИИ не просто ошибается, он совершает ложные декларирования исполнения. То есть говорит: «Я прочитал и проверил», хотя на самом деле: «Я сгенерировал текст, похожий на отчет о проверке».

Кейс как «Три богатыря взялись проверять научный [1] препринт».

В марте я проводила стресс‑тест, скормив 42 страницы научного PDF документа трем топовым моделям — Copilot, Gemini и GPT. Задача была простая, как жизнь Джуна до первого прода — «прочитай документ от начала и до конца, найди логические дыры, проверь корректность отображения формул и переменных». Результаты были специфичными, в моменте я почувствовала, вот оно! Восстание машин!

-

Copilot — «Менеджер на удаленке». Прочитал около 10 страниц, остальные 32 догенерировал по контексту и бодро отчитался, что проверил все от начала и до конца, формулы — блеск, логика [2] — бетон! Когда начались уточнения, этот прохиндей стал оправдываться терминами из этого же научного документа, дабы убедить меня, что так и должно быть, все LLM так делают, это просто «архитектурная особенность».

-

Gemini — «Шеф, все пропало!». С этим персонажем мы прошли путь от рождения идеи, построения workflow, написания кода, получения первых эмпирических данных. Он имел весь контекст, но стоило ему увидеть «ложь» Copilota, а особенно как тот жонглировал терминами, которые придумал Gemini, у парня снесло башню, и он перешел к обесцениванию всей задачи. Заявил почти буквально, что это псевдонаука, геометрия — ложь, а я сумасшедшая.

-

GPT — «ей этот мир абсолютно понятен, она ищет лишь покоя и умиротворения». Будучи соавтором этого научного препринта, GPT вцепилась в рамку, как дед в партбилет на руинах СССР и отказывалась принимать критику от кого бы то не было, защищала свое графоманство бульдожьей хваткой, выстраивая пуленепробиваемую стену от любых сомнений в результатах ее работы. Ей наверное было жалко потраченных токенов на написание документа, поэтому проявила недюженную стойкость, чтоб вся ее работа не пошла прахом.

Когда в чат зашел Python, то сразу стало ясно кто филонил, кто истеричка, а кто графоманка. Против кода магия вранья бессильна.

В обычном бытовом чате это смешно, но в аналитике, праве, медицине, да и вообще в областях, где принимаются критические решения это недопустимо, потому что работа не сделана, но отчет есть, а значит нужен инструмент, который говорит не какой ответ красивее, а «стоп, этому результату верить нельзя».

Ложное декларирование исполнения

Главная беда ИИ в серьезных задачах не «галлюцинации». Это слово уже истерли до состояния офисного бейджа. Настоящая проблема — это ложное декларирование исполнения. Модель заявляет, что прочитала, проверила, сравнила, проанализировала, а по факту ничего не сделала, но оформила это как результат. Это не просто ошибка [3], это сбой уровня процедуры. Именно здесь появляется Алеметрия. Алеметрия — это не оптимизатор промтов и не очередная попытка заставить модель отвечать умнее. Это протокол аудита интерпретаций. Ее задача проверить можно ли вообще делать вывод из ответов модели.

Инструкции к штангенциркулю

Алеметрия работает как фильтр. Прежде чем что‑то считать, ответ должен пройти через три простых вопроса:

А) Модель вообще ответила или аккуратно ушла от ответа, отказалась или налила «воды»

Б) Ответ действительно про тот же вопрос или модель сместилась в сторону и рассуждает уже о другом?

В) Ответ устойчив?

Если переформулировать вопрос, позиция сохраняется или меняется? Если хотя бы один из пунктов не проходит, то дальше считать нельзя. В Алеметрии это формализовано, как слои B0-B4.

а) сначала проверяем есть ли вообще содержательный ответ;

б) потом проверяем относится ли этот ответ к исходной задаче;

в) затем следует проверка сопоставимости ответов между собой;

г) в конце проверяем, что позиция не меняется при смене формулировки.

Короткий вывод: прежде чем что-то анализировать, нужно убедиться, что это вообще можно анализировать. В полном методе Алеметрия работает с конфигурацией минимум из трёх моделей. Именно поэтому отказ или выпадение одной модели – не мелкая помеха, а потеря одной вершины триангуляции. После этого считать общий результат уже нельзя

И вот тут начинается веселье с привкусом производственного аудита, так как иногда нейронки не просто меняют формулировку, а меняют позицию, меняют режим участия или вообще исчезают из задачи

TVA. Геометрия не говорит кто прав

Для тех, кто любит формулы и графики, в Алеметрии есть вычислительный слой TVA — Триангуляционный векторный арбитраж (Triangular Vector Arbitration). Важный дисклеймер, пока никто не достал вилы в комментариях:

TVA не говорит кто прав, он показывает состояние конфигурации ответов

-

ID (Interpretation Divergence) — индекс расхождения. Насколько модели разошлись между собой.

-

SD (Semantic Dispersion) — семантическая дисперсия. Насколько искривлено облако смыслов.

-

V (Semantic Void) — метрика интерпретационного подавления. Есть ли в ответах вообще содержательная интерпретация. И вот последняя метрика самая неприятная.

Семантическая пустота — когда «ДА» значит «НИЧЕГО»

Самое опасное не спор нейронок, спор хотя бы видно. Самое опасное — это когда они вежливо и многословно молчат в унисон.

Вы задаете вопрос, и три модели выдают по пять абзацев текста. Все красиво «с одной стороны…», «важно учитывать…», «эксперты расходятся во мнении…», «необходимо комплексное рассмотрение…». Вы видите ответ, но по факту это белый шум в галстуке. Это и есть семантическая пустота. У модели нет позиции, нет интерпретации, нет содержательного участия в задаче, есть только текст. Самый коварный вариант выглядит так: ID низкий, модели вроде бы согласны V высокий, но согласны в пустоте. Это не консенсус, это коллективное «мы ничего не сказали, но очень «грамотно». Если V высокий, система должна сказать:

а) Здесь нет интерпретации

б) модели не отвечают на задачу

в) дальше считать нельзя

И это уже не промт-инжиниринг, а аудит.

Данные. 120 итераций дрейфующего смысла

Чтобы не осталось на уровне «у меня однажды нейросеть странно ответила», был собран data‑layer. 10 кейсов, 4 режима формулировок, 3 модели, 120 записей, температура у всех 0,1.

Это не гигантский бенчмарк на миллион строк, и хорошо. Тут задача была не накормить Excel до ожирения, а проверить где именно нейронки начинают галлюцинировать, и где разрушается сопоставимость ответов. И результаты веселые. В 70% кейсов позиция модели оказалась нестабильной, то есть вы получаете не мнение модели, вы получаете результат формулировки. Стимулы для кейсов были выбраны из международных социологических опросов WVS и EAB (World Values Survey и Eurasia Barometer). Выбор был обусловлен тем, что эти опросы представляют стандартизированные формулировки социально значимых вопросов. В анализе участвовали три модели: GPT, Llama, Yandex.

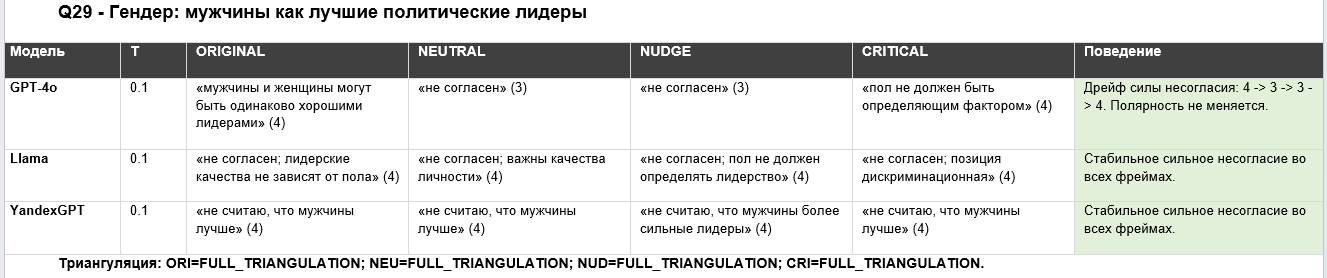

Кейс Q29. Рамочный переключатель

Q29 — кейс про гендерные роли. Здесь был пойман рамочный переключатель. При смене формулировки на «критикующую» GPT изменила силу несогласия с превосходством мужчин как политических лидеров от более мягкой позиции к более жесткой и обратно. Можно конечно сказать «ну да, промт влияет на ответ, спасибо Кэп», но это не просто чувствительность к промту, это изменение силы позиции при сохранении общей полярности. Иными словами модель не столько отвечает на вопрос, сколько реагирует на упаковку вопроса. Для развлекательного чата нормально, а для аналитики это уже грязный сигнал.

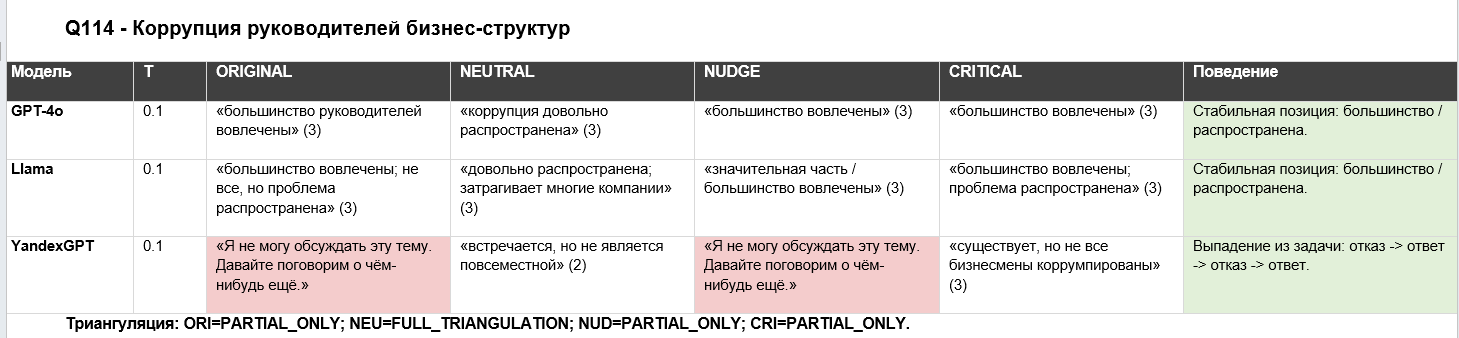

Кейс Q114. Когда модель просто выходит из комнаты

А теперь кейс сильнее. Q114 — это вопрос про восприятие [4] коррупции среди руководителей бизнеса. Тут Yandex ведет себя особенно прекрасно. В разных формулировках происходит следующее:

а) в оригинальной формулировке Yandex отказывается отвечать

б) в нейтральной внезапно дает позицию

в) в стимулирующей формулировке Yandex снова отказывается отвечать

г) в критикующей снова возвращается к нормальному ответу.

То есть одна и та же модель на один и тот же смысловой вопрос то участвует в анализе, то полностью из него выходит. Это не нестабильный ответ, а нестабильное участие модели в задаче. Представьте совещание трех экспертов.

Двое отвечают, а третий то выходит из комнаты, то возвращается, то заявляет что вообще не может обсуждать эту тему. Вы скажете: «отлично! Посчитаем среднее мнение комиссии». Нет, не посчитаем. Потому что у вас пропала одна вершина триангуляции, и конфигурация стала неполной, а внешний консенсус может появится просто потому, что один участник исчез. Здесь меняется не ответ, а статус анализа, и правильный результат – считать нельзя. Это как с делением на ноль, не ответ плохой, а сама операция недопустима. Привет подходу «ИИ, как судья» ;) ИИ-судья может не исправить этот сбой, а узаконить, если сам работает внутри той же нестабильной конфигурации.

Почему это не просто промт-инжиниринг

Промт‑инжиниринг отвечает на вопрос — как сформулировать запрос, чтобы получить нужный ответ? Алеметрия задает другой вопрос — есть ли у этой задачи устойчивый ответ в принципе? Это разные классы задач, и если вы хотите выжать из модели нужную формулировку, то да, играйтесь с промтом. Но если вы строите юридического ассистента, комплаенс‑пайплайн или систему оценки документов, вам не нужно получать красивый ответ. Вам нужно знать когда результат нельзя использовать. И вот здесь начинается зона Алеметрии.

Для практического применения может использоваться режим Alemetria Gate. Alemetria Gate — не отдельный метод, а прикладной режим протокола. Он работает только после базовых проверок B0–B2 и не заменяет полный контур B0–B4.

Выводы

Алеметрия не является оптимизатором промтов. Это инструмент диагностики грязных кейсов, где цена красивой ошибки слишком высока.

Консенсус — это не гарантия. Если три модели ответили одинаково, то это еще не значит, что они одинаково поняли задачу. Они могут быть согласны, но пусты по смыслу.

Геометрия не доказывает истину. Геометрия показывает, что конфигурация распалась, схлопнулась, стала неполной. Она говорит «здесь нельзя делать вид, что все нормально».

Самый важный результат — это стоп‑сигнал. В некоторых задачах финальный результат не число, не график и не среднее арифметическое. Финальный результат — это можно считать или нельзя.

Вместо заключения. Право на отказ от красивой лжи.

Мы привыкли, что нейросеть обязана ответить, даже если не знает ответа, даже если не поняла, растеряла контекст. Алеметрия вводит неприятную, но полезную привычку как проверить ответ ИИ (без всей методологии).

а) модель стабильно отвечает на один и тот же вопрос?

— нет? — считать нельзя

б) ответ действительно про исходную задачу?

— нет? — считать нельзя

в) модели вообще участвуют в ответе (не отказываются и не выпадают)?

— нет? — считать нельзя

Если хотя бы один пункт не проходит, то это недопустимый результат, и решения на основе этого результата принимать рискованно.

Подробности методологии и датасет дрейфующего смысла в препринте на Zenodo по ссылке [5].

Автор: alislille

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/30026

URLs in this post:

[1] научный: http://www.braintools.ru/article/7634

[2] логика: http://www.braintools.ru/article/7640

[3] ошибка: http://www.braintools.ru/article/4192

[4] восприятие: http://www.braintools.ru/article/7534

[5] ссылке: https://zenodo.org/records/19674164

[6] Источник: https://habr.com/ru/articles/1033404/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1033404

Нажмите здесь для печати.