Шесть техник промптинга, которые работают в 2026 году

Жемал Хамидун · Head of AI Alpina Digital [1], CPO AlpinaGPT [2]

С 2023 года я курирую внедрение ИИ в Альпине. Мы начинали с того, что пытались ускорить книжное производство, и попутно прошли довольно много развилок: запустили AlpinaGPT [3] сначала как внутренний инструмент для сотрудников, потом вывели его на внешний рынок, разобрались с агентами, вайбкодингом и десятками сценариев применения нейросетей в обычных рабочих задачах.

За эти годы я для себя сформулировал одну простую вещь: качество того, что выдаёт ИИ, определяется не только моделью. Один и тот же Claude или GPT может выдать вам шаблонную пустышку или предметный, точный ответ — в зависимости от того, насколько корректно вы задали вопрос. Это и есть промптинг — умение правильно формулировать запрос к ИИ.

Ниже шесть техник, которые я регулярно использую в работе и на которых учу команды клиентов. Они проверены на реальных задачах: разборе договоров, конкурентном анализе, деловой переписке, работе с таблицами.

Сначала о том, как ИИ выбирает ответ

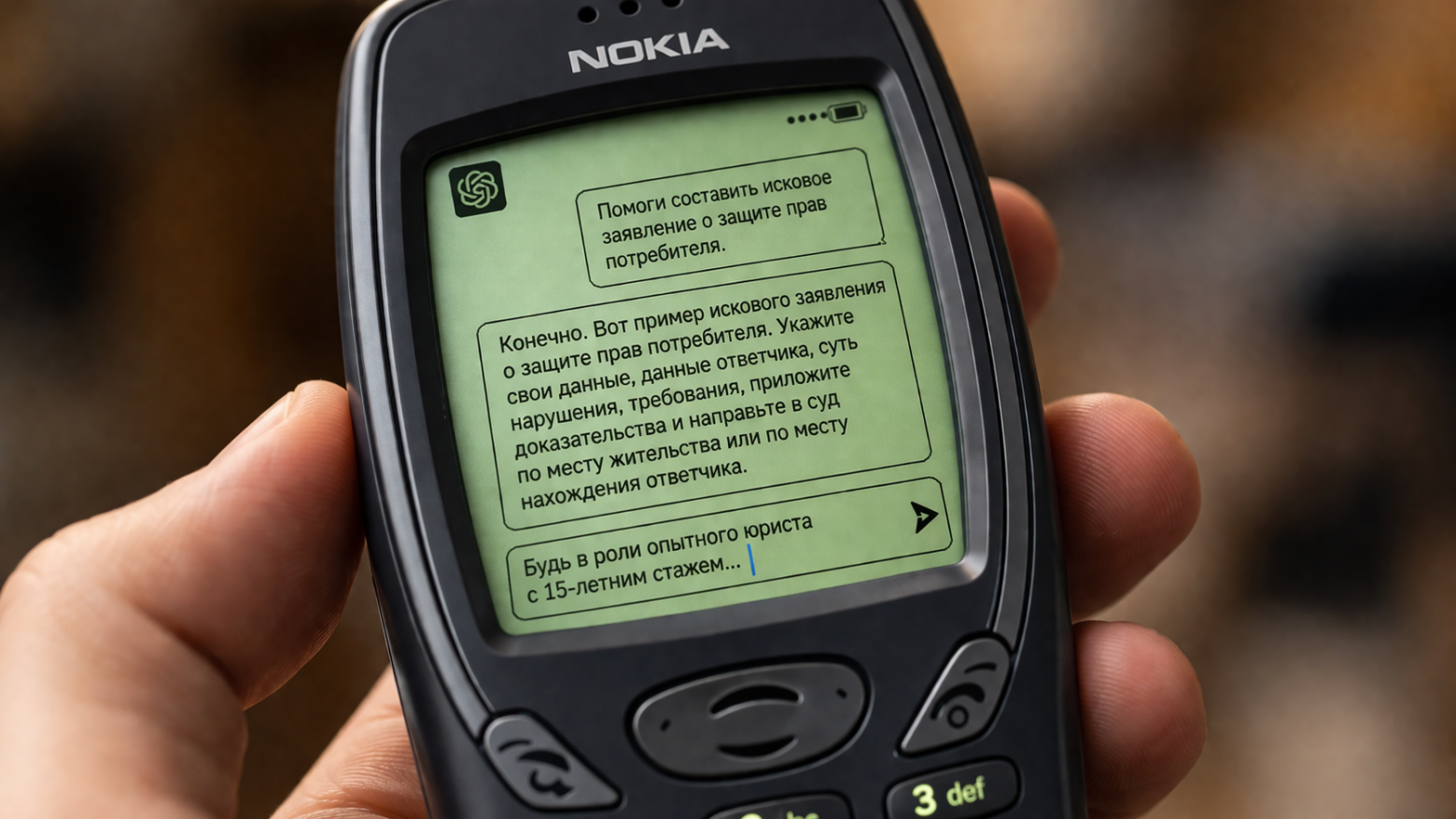

Прежде чем говорить о техниках, важно понимать, как нейросеть вообще приходит к ответу. Самая близкая аналогия — это T9 на старых телефонах. Вы набираете букву, и телефон предсказывает, какое слово вы хотите написать, по тем словам, которые вы и другие люди писали часто. Большие модели вроде Claude или GPT работают по тому же принципу, только в масштабе триллиона параметров и обучены на миллиардах текстов из интернета — книгах, статьях, форумах, научных работах.

Когда вы спрашиваете «какие документы нужны для кредита», модель не «знает» правильный ответ в человеческом смысле. Она предсказывает, какие слова с наибольшей вероятностью идут после слова «кредит» в подобных контекстах. И благодаря огромному объёму обученных данных это совпадение часто выглядит как осмысленный экспертный ответ.

Ещё одна важная деталь — токены. Токен это базовая единица, которой мыслит нейросеть. На английском один токен — это примерно четыре символа, то есть слово в среднем занимает меньше одного токена. На русском всё устроено иначе: кириллица токенизируется значительно хуже, и один и тот же текст на русском обходится в 2-3 раза дороже по токенам, чем на английском. Это влияет и на стоимость запросов, и на то, сколько текста реально помещается в контекстное окно.

У каждой модели есть ограничение по размеру контекста — это сколько токенов она может удержать в одном чате. Сейчас почти все ведущие модели подошли к миллиону токенов в одном окне: и Gemini, и последние версии Claude, и GPT. Это огромный объём — целая книга помещается. Но как только вы подходите к лимиту, модель начинает «плавать»: что-то из середины забывается, появляются неточности. Поэтому затягивать чат на бесконечность невыгодно — ни по качеству, ни по стоимости.

Почему понимание этой механики важно для практики? Потому что промпт — это, по сути, способ сузить пространство ответов модели до нужного вам. Anthropic в своих рекомендациях называет эту работу context engineering [4] — настройкой всей среды вокруг запроса, а не просто подбором правильных слов. Дальше я разберу шесть техник, через которые это сужение реализуется на практике.

Техника 1. Формула из пяти компонентов

Первая и самая известная техника — формула эффективного промпта. В ней пять частей, и каждая увеличивает качество результата.

Первое — роль. Кто отвечает. «Ты бизнес-аналитик с 10-летним стажем», «ты руководитель проекта», «ты менеджер по ключевым клиентам». Роль задаёт тон и глубину ответа.

Второе — контекст. В какой ситуации мы находимся. Здесь важны детали: кто клиент, какие у него параметры, какая история отношений, какие продукты он уже использует.

Третье — задача. Что конкретно нужно сделать. Не «проанализируй», а «извлеки пять ключевых условий и оцени три риска».

Четвёртое — формат. В каком виде нужен результат. Таблица, список, текст на 200 слов, презентация на пять слайдов.

Пятое — ограничения. Чего не делать. «Не использовать юридический жаргон», «максимум 300 слов», «только по данным из приложенного документа, ничего не додумывать».

Эту формулу можно использовать как чек-лист для каждого нового промпта. Но даже если вы заполните только два из пяти компонентов — контекст и задачу — этого уже хватит, чтобы получить качественный ответ. Роль, формат и ограничения вторичны: они полезны, но не обязательны для каждого запроса.

Простой пример из реального кейса. Если написать «напиши письмо клиенту», вы получите шаблонную безликую заготовку, которая никому не поможет. А если написать «ты менеджер по ключевым клиентам, клиент — ООО Рога и копыта, оборот 500 миллионов, сейчас на базовом тарифе, финдиректор Иванов, напиши коммерческое предложение на зарплатные проекты и эквайринг в деловом тоне, 200 слов, с конкретными цифрами экономии» — вы получите принципиально другой текст. Та же модель, тот же ИИ — но за счёт правильно заданного контекста результат становится рабочим.

Техника 2. Работа с контекстом — главная техника промптинга

Если из всех шести техник я бы оставил только одну, я бы оставил эту. Контекст важнее любого другого элемента промпта.

Чтобы понять, почему так, есть простая аналогия. Я скажу фразу: «В лесу родилась…» — и в голове большинства носителей русского сразу прозвучит «ёлочка». Почему? Потому что наша с вами нейронная сеть была натренирована: где-то в детстве мы выучили эту песню, и теперь, когда мы слышим «в лесу родилась», вероятность слова «ёлочка» резко возрастает в нашем культурном контексте. На англоязычной аудитории этот же запрос не сработал бы — у них в голове другое облако ассоциаций.

Нейросеть устроена похоже. У неё в голове огромное векторное пространство, где все слова связаны друг с другом разными вероятностными «верёвочками». Когда вы пишете промпт, который не сужает контекст, нейросеть выбирает ответ из самого широкого облака смыслов — и берёт оттуда самое усреднённое, шаблонное, частое. Получается «стандартное письмо», «стандартный анализ», «обычный ответ из интернета».

Когда вы даёте развёрнутый контекст, происходит обратное. Облако смыслов сужается до того, что нужно именно вам. Модель буквально перестаёт выбирать из всего и начинает работать в узкой зоне, где живут варианты, подходящие к вашей ситуации. Я это для себя сформулировал так: промпт — это инструмент отсечения всего лишнего, а не инструмент добавления нужного.

Иногда я в качестве контекста загружаю целые письма, документы, регламенты, предысторию вопроса — чтобы нейросеть знала о задаче ровно столько же, сколько знаю я. Это занимает чуть больше времени на старте, но экономит часы на доводке ответа. Чем больше релевантного контекста вы дадите, тем меньше доработок потребует первый ответ.

Эта же мысль уже стала отраслевым консенсусом. Gartner в своих обзорах [5] прямо называет переход от классического промптинга к работе с контекстом главным сдвигом в корпоративном применении ИИ в 2026 году. Раньше задача звучала как «подобрать правильные слова», теперь — как «спроектировать всю информационную среду вокруг запроса».

Техника 3. Цепочка рассуждений

Третья техника — попросить модель рассуждать пошагово. На английском это называют chain-of-thought, на русском проще — «цепочка рассуждений».

Пример. Если вы спросите «оцени эффективность рекламной кампании», модель может ответить «эффективность высокая». Откуда взялась эта оценка, на чём она основана, какие цифры считались — непонятно. Перепроверять придётся вручную всё с нуля.

Если же сказать «давай пошагово: шаг первый — оцени охват и бюджет, шаг второй — рассчитай конверсию по этапам, шаг третий — сравни с бенчмарками отрасли, шаг четвёртый — сделай вывод», вы получите прозрачный ответ, где видно каждый этап рассуждения. Если где-то есть ошибка [6], вы сразу увидите, на каком конкретно шаге она произошла, и сможете точечно поправить.

Это особенно полезно для задач, где важна не только итоговая цифра, но и логика [7], которая к ней привела: финансовый анализ, юридическая оценка, выбор стратегии, разбор сложного решения. И для тех случаев, когда вы передаёте результат коллегам, которые тоже хотят видеть, как именно ИИ дошёл до выводов.

Техника 4. Обучение на примерах и без примеров

Четвёртая техника — это два режима подачи задачи: с примерами и без них. На английском их называют few-shot и zero-shot, но идея у обоих простая.

Без примеров — это когда вы даёте только инструкцию: «классифицируй обращение клиента по категориям: жалоба, запрос информации, заявка на продукт, благодарность». Этот режим хорошо работает на простых однозадачных вопросах, где категории очевидны и модель и так понимает, что от неё хотят.

С примерами — это когда вы перед задачей показываете два-три образца того, что хотите получить: «вот жалоба, вот запрос, вот благодарность. Теперь классифицируй новое обращение». Идея простая: примеры — самый эффективный способ объяснить формат. Вместо того чтобы описывать словами, как должен выглядеть результат, вы просто показываете «вот так» — и модель копирует паттерн на новых данных.

Когда что использовать? Без примеров работает отлично, если задача простая, формат очевидный, а у модели достаточно общих знаний. С примерами лучше, когда нужен специфический формат вывода: корпоративная таблица, текст в фирменном стиле компании, структура отчёта по шаблону.

Важный момент, который я узнал на практике: больше примеров — не всегда лучше. Двух-трёх обычно достаточно. Если положить десять примеров, модель начинает копировать поверхностные паттерны (длину текста, начальные слова), а не суть формата. Поэтому «достаточный минимум» — золотое правило для этой техники.

Техника 5. Ролевой промптинг

Пятая техника — назначение роли. Это самая интуитивно понятная техника, и про неё чаще всего пишут в гайдах: «представь, что ты эксперт в области X».

Здесь важно понимать одну вещь, которую я сам долго не осознавал. Роль не задаёт модели новых знаний. Все знания у неё уже есть из обучения [8], и она их давно «прочитала». Роль не делает модель умнее или эрудированнее. Что роль реально делает — она сужает облако смыслов, из которого модель выбирает слова. Когда вы говорите «ты юрист с опытом [9] анализа контрактов», вы сразу обозначаете, что отвечать нужно в стилистике юриста, с юридической терминологией, с акцентом на риски и условия. Меняется не объём знаний, а угол, под которым модель к ним подходит.

Я для себя сформулировал такой простой принцип выбора роли: задаю себе вопрос — кто из людей лучше всего справился бы с этой задачей? И в зависимости от ответа выбираю роль для нейросети. Если задача про разбор договора — юрист. Если про написание поста — копирайтер с опытом в нужной нише. Если про анализ продаж — коммерческий директор.

Этот приём особенно полезен, когда вам важна именно стилистика и подход к ответу. Для задач типа «извлеки факты из документа» или «переведи текст» роль не нужна — там главное точность, а не угол.

Техника 6. Метапромптинг — попросите ИИ составить промпт за вас

Шестая техника — лайфхак, которым я сам пользуюсь регулярно и который сильно облегчает жизнь. Если вы не знаете, как сформулировать сложный запрос — попросите нейросеть саму написать промпт под вашу задачу.

Звучит непривычно, но на практике это один из самых полезных приёмов. Вы обращаетесь к ИИ как к учителю и говорите: «Я учусь промптить, мне нужна твоя помощь в составлении промпта для задачи такой-то. Составь оптимальный запрос для модели X, чтобы она сделала Y». И нейросеть пишет вам промпт, который часто оказывается лучше того, что вы бы сформулировали сами. Просто потому, что она знает свои собственные особенности и предпочитаемые форматы.

Реальный пример из недавней встречи. Участница воркшопа спросила: у меня есть старые архитектурные планы и фасады зданий двухсотлетней давности, нужно привести их в приличное состояние, как мне это сделать с помощью ИИ? Я ей предложил простую вещь: написать в Gemini «составь мне промпт для модели Nano Banana Pro для реставрации старых архитектурных планов и фасадов». Нейросеть выдала ей готовый детальный промпт на английском языке (модели генерации изображений лучше понимают английский), с правильными терминами, описанием итогового состояния и техническими параметрами. Дальше оставалось взять этот промпт и использовать его для генерации.

Этот приём работает в любой сложной ситуации, когда вы не уверены в формулировке. У моделей огромный опыт работы с собственным форматом запросов — им виднее, как правильно к ним обращаться.

Бонус: общайтесь с ИИ как с собеседником

И последнее, что важно сказать про работу с ИИ в 2026 году. Anthropic в своём исследовании [10] про использование Claude отметила одну закономерность: большинство пользователей пишут один промпт, получают ответ и закрывают чат. Это и есть основная причина, почему результаты выходят посредственными.

С нейросетью нужно работать как с собеседником, а не выстреливать одним промптом и уходить. ИИ выдал черновик — попросите подправить тон. Получили версию два — попросите изменить структуру. Версия три — поработайте над терминологией. С пятой-шестой итерации обычно получается то, что нужно.

Это в общем-то так же, как с обычным сотрудником. Если вы дали задачу человеку и он принёс не то, вы же не увольняете его сразу. Вы объясняете, что не так, и он дорабатывает. С ИИ ровно та же логика, и часто это удивляет людей: они привыкли воспринимать его как поисковик, где есть «один правильный ответ», тогда как на самом деле это собеседник, с которым нужно работать в диалоге.

Полезный побочный эффект: когда вы привыкаете чётко формулировать задачи для ИИ — давать роль, контекст, формат, ограничения — вы начинаете чётче ставить задачи и людям. Это профессиональная деформация в хорошем смысле слова.

Эти и другие техники я разбираю на бесплатных вебинарах AlpinaGPT [3] с реальными задачами клиентов — анализом договоров, конкурентным анализом, деловой перепиской и работой с таблицами. В телеграм-канале «Дело в промпте» [11] публикуем готовые промпты для нейросетей, чек-листы, кейсы и анонсы мероприятий по внедрению ИИ в бизнес.

Что в итоге

Главный навык работы с ИИ в 2026 году — уметь давать модели контекст и работать с задачами итерационно. Шесть техник, которые я разобрал, складываются в простой практический набор: чек-лист с пятью компонентами промпта, работа с контекстом, цепочка рассуждений, примеры для специфичного формата, ролевой промптинг для нужного угла подачи и метапромптинг для сложных случаев.

Те, кто освоил хотя бы первые две техники — уже получают от ИИ кратно более полезные ответы, чем большинство пользователей, которые до сих пор пишут «напиши мне письмо клиенту» и удивляются шаблонным результатам.

Поделитесь в комментариях, какие техники вы используете чаще всего и в каких задачах вам не хватает чего-то из этих шести? Соберём список того, что реально работает в практике на разных моделях.

Автор: AlpinaDigitalRU

Источник [12]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/30213

URLs in this post:

[1] AI Alpina Digital: https://alpinadigital.ru/?utm_source=habr&utm_campaign=120526

[2] AlpinaGPT: https://alpinagpt.ru/?utm_source=habr&utm_campaign=120526

[3] AlpinaGPT: https://alpinagpt.ru?utm_source=habr&utm_medium=article&utm_campaign=six-techniques-2026

[4] context engineering: https://www.anthropic.com/engineering/effective-context-engineering-for-ai-agents

[5] Gartner в своих обзорах: https://www.gartner.com/en/articles/context-engineering

[6] ошибка: http://www.braintools.ru/article/4192

[7] логика: http://www.braintools.ru/article/7640

[8] обучения: http://www.braintools.ru/article/5125

[9] опытом: http://www.braintools.ru/article/6952

[10] Anthropic в своём исследовании: https://www.anthropic.com/news/prompt-engineering-for-business-performance

[11] телеграм-канале «Дело в промпте»: https://t.me/alpinagpt?utm_source=habr&utm_medium=article&utm_campaign=six-prompting-techniques-2026

[12] Источник: https://habr.com/ru/companies/alpinadigital/articles/1034954/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1034954

Нажмите здесь для печати.