Прототип «универсального помощника ИИ» от Google теперь может выполнять задачи без запроса от пользователя

Google представила [1] более продвинутую версию универсального ИИ-помощника Astra, которого научили выполнять некоторые задачи, не опираясь на запрос пользователя.

Наработки в рамках Astra уже используются [2] в Gemini и других приложениях. Они включают голосовой вывод, память [3] и некоторые базовые функции использования компьютера.

Google показала [4] Project Astra на конференции I/O 2024. Это обновлённый и улучшенный ИИ-помощник, который способен взаимодействовать с окружающим миром, распознавая объекты и понимая контекстные детали. Он также получил намного более естественную речь, чем у Google Assistant. Astra работает на прототипе умных очков. В короткой демонстрации Project Astra нашёл колонки по запросу «найди то, что воспроизводит звук», и описал, что делает код на экране компьютера.

В этом году на конференции разработчиков I/O Google анонсировала несколько новых функций Astra, которые показывают, как компания пришла к восприятию [5] своего помощника. Помимо ответов на вопросы и использования камеры телефона для запоминания [6] того, где пользователь оставил свои очки, Astra теперь может выполнять задачи от его имени даже без специальной просьбы.

«Astra может выбирать, когда говорить, основываясь на событиях, которые он видит», — отметили в Google. Таким образом, вместо того, чтобы ждать, когда пользователь направит телефон на что-то, ИИ-помощник будет постоянно наблюдать, слушать и ждать, когда можно выполнить соответствующее действие. Например, если Astra наблюдает, как пользователь выполняет домашнее задание, он может заметить, где сделана ошибка [7], и указать на неё. Если человек придерживается системы прерывистого голодания, то Astra будет напоминать ему поесть непосредственно перед тем, как истечёт назначенное время.

Обучение [8] Astra действовать по собственной воле было частью плана с самого начала, говорит генеральный директор DeepMind Демис Хассабис. По его словам, по-настоящему хороший проактивный помощник пока далёк от реальности, и ему потребуется огромный объём информации о пользователе.

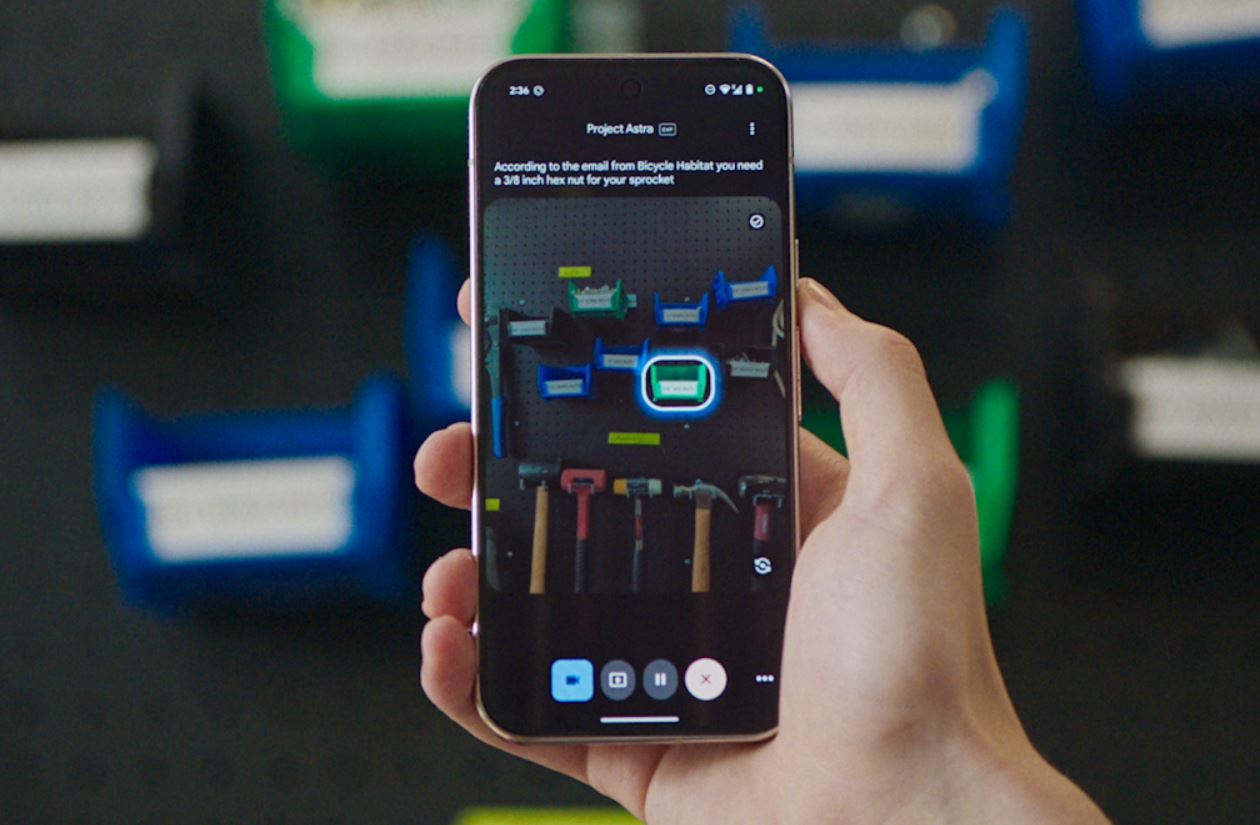

Также Astra теперь может получать доступ к информации из Интернета и из других продуктов Google. Он может видеть заметки в календаре пользователя, содержание его электронной почты и многое другое.

Бибо Сю, менеджер по продукту в команде DeepMind, в рамках демонстрации направила камеру телефона на пару наушников Sony и спросила, какие это наушники. Astra ответил, что это либо модель WH-1000XM4, либо модель WH-1000XM3, а менеджер попросила помощника найти руководство, а затем объяснить, как подключить их к смартфону. В итоге Сю попросила: «Можешь открыть “Настройки” и просто подключить наушники для меня, пожалуйста?». ИИ-помощник выполнил команду. При этом менеджеру пришлось вручную включить функцию, которая позволяла Astra видеть экран её телефона. Команда ещё работает над тем, чтобы это происходило автоматически.

Автор: maybe_elf

Источник [9]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/15474

URLs in this post:

[1] представила: https://www.theverge.com/google-io/670386/google-astra-universal-ai-assistant-prototype-io-2025

[2] используются: https://habr.com/ru/companies/bothub/news/894130/

[3] память: http://www.braintools.ru/article/4140

[4] показала: https://habr.com/ru/news/814329/

[5] восприятию: http://www.braintools.ru/article/7534

[6] запоминания: http://www.braintools.ru/article/722

[7] ошибка: http://www.braintools.ru/article/4192

[8] Обучение: http://www.braintools.ru/article/5125

[9] Источник: https://habr.com/ru/news/911796/?utm_source=habrahabr&utm_medium=rss&utm_campaign=911796

Нажмите здесь для печати.