Данная статья содержит в тезисной форме сравнение эффективности современных LLM и человеческого мозга.

Преамбула: Человеческий мозг эффективнее LLM в 10–30 миллионов раз по энергопотреблению на один когнитивный акт.

Причина — фундаментальные различия в архитектуре, принципах обучения и физической реализации.

Часть 1. Цифры для понимания масштаба

|

Параметр |

Человеческий мозг |

Современная LLM (например, GPT-4) |

|

Энергопотребление |

~20 Вт (всего) |

~1–3 МВт (тренировка) / ~1–10 кВт (инференс) |

|

Операций в секунду (эквивалент) |

~10¹⁶ синаптических операций |

~10¹⁵–10¹⁶ FLOPs |

|

Энергия на одну операцию |

~1–2 × 10⁻¹⁸ Дж (аттоджоули) |

~10⁻¹²–10⁻¹⁰ Дж (пикоджоули) |

|

Энергоэффективность |

100 триллионов операций на ватт |

~0,001–1 операция на ватт ( мозг в 10¹⁴ раз эффективнее) |

То есть мозг делает в 100 миллионов раз больше «полезной работы» на единицу энергии, чем лучшие современные чипы, запускающие LLM.

Часть 2. Главные причины энергоэффективности мозга

Причина 1. Аналоговые вычисления против цифровых

Мозг: нейроны и синапсы работают аналогово. Вместо представления чисел битами (0 и 1) нейроны интегрируют непрерывные градиенты нейромедиаторов, ионных токов и мембранных потенциалов. Это позволяет одному синапсу выполнять сложные нелинейные вычисления, для которых в цифровом мире нужны тысячи транзисторов.

LLM: работают на цифровых чипах (GPU/TPU), где каждый бит информации требует отдельного транзистора, а умножение матриц — миллиарды операций с плавающей запятой. Цифровая абстракция (отделить данные от вычислений, хранить точность 16/32 бита) невероятно расточительна.

Аналогия: мозг считает «на пальцах» с бесконечной градацией, а LLM — перебирает гигантские таблицы умножения с 32-значными числами, даже когда нужно просто понять, что 2+2=4.

Причина 2. Рекуррентность и временная динамика (вместо глубины)

Мозг: нейронные сети рекуррентны и динамичны. Один и тот же нейрон участвует в вычислениях многократно, информация циркулирует по петлям обратной связи. Время — это ресурс вычислений.

LLM: трансформеры статичны и последовательны. Каждый токен проходит через все слои (например, 96 слоев в GPT-4) за один проход. Чтобы учесть контекст в 1000 токенов, модель должна выполнить 96×1000× (огромное число) операций.

Энергетический эффект: мозг «растягивает» вычисления во времени, используя одни и те же нейроны многократно. LLM расплачивается гигантским количеством параллельных операций, каждая из которых требует энергии.

Пример: чтобы запомнить слово из 5 букв, LLM нужно пропустить его через миллиарды параметров. Мозг просто изменяет вес одного синапса.

Причина 3. Разреженность (sparsity) — почти никто не работает одновременно

Мозг: в любой момент времени активно только 1–10% нейронов. Остальные молчат. Это называется разреженное кодирование.

LLM: в трансформерах в каждый момент задействованы все параметры модели (например, 1.8 триллиона параметров у GPT-4). Даже при инференсе активируется почти вся сеть.

Энергетический эффект: мозг включает «ту самую нужную» маленькую подцепь для задачи. LLM греет всю планету, чтобы ответить на вопрос «как тебя зовут?».

Причина 4. Обучение один раз — использование многократно (без обратного прохода при инференсе)

Мозг: обучение (синаптическая пластичность) происходит локально и постепенно. Для использования уже выученного не нужно делать обратное распространение ошибки (backpropagation).

LLM: обучение требует многократного прохода всей базы данных с обратным распространением ошибки через все слои — это в 3–5 раз больше операций, чем прямой проход. Но даже при инференсе (использовании) трансформер выполняет гигантское число умножений матриц, которые биологический нейрон заменяет одной локальной операцией.

Энергетический эффект: мозг не делает «обратного хода» во время мышления. LLM на GPU считает ту же сложность, что и при обучении, только без изменения весов.

Причина 5. Использование физики для вычислений (биохимия и ионные каналы)

Мозг: каждый синапс — это молекулярная машина, работающая на энергии АТФ (∼0.3 эВ на акт). Переключение ионного канала требует ∼10⁻²⁰ Дж — это тепловой шум. Мозг работает на пределе термодинамического минимума.

LLM: транзистор в GPU переключается с энергией ∼10⁻¹⁵ Дж (при 5 нм техпроцессе) — это в 100 000 раз больше физического минимума. А умножение матриц на 32-битных числах требует миллионов таких переключений.

Ирония: природа «вычислила» за 3.5 миллиарда лет эволюции, что энергетически выгоднее использовать химические градиенты и ионные токи, чем электроны в кремнии.

Причина 6. Огромная база знаний, встроенная в архитектуру (не в веса)

Мозг: не просто нейронная сеть, а сложная архитектура с врожденными структурами: зрительная кора, слуховая кора, гиппокамп, мозжечок и т.д. Эволюция уже «заплатила» энергией за эти структуры, и они достаются бесплатно каждому новому человеку.

LLM: всю структуру (каждый слой, каждую связь) нужно выучить с нуля из данных. Это требует гигантских энергозатрат на обучение (сотни ГВт·ч для GPT-3), которые потом амортизируются при использовании, но все равно остаются огромными.

Часть 3. Конкретный пример: почему GPT-4 тратит 100 кВт·ч, а мозг — 0.0005 кВт·ч на тот же ответ

Возьмем задачу: «В чем разница между метаном и этаном?»

|

Что делает мозг |

Энергия |

Что делает GPT-4 |

Энергия |

|

Активирует ~10 млн нейронов в коре (из 86 млрд) |

~0.1 Дж |

Загружает 1.8 трлн параметров в память |

~1 кВт·ч (3.6 МДж) |

|

Проводит ~100 спайков через каждые 100 мс |

~0.01 Дж |

Выполняет 10¹⁶ операций умножения матриц |

~10 кВт·ч (36 МДж) |

|

Изменяет ~10 синапсов (если что-то запомнил) |

~10⁻¹⁶ Дж |

Ничего не меняет (инференс) |

0 |

|

ИТОГО |

~0.1 Дж (0,00003 Вт*ч) |

~10 кВт·ч (36 000 000 Дж) |

|

Разница в 360 миллионов раз.

Часть 4. Почему LLM такие неэффективные — можно ли исправить?

LLM неэффективны по дизайну. Трансформер был изобретен для машинного перевода, где нужно обрабатывать последовательности фиксированной длины с максимальной параллельностью. Параллельность — это хорошо для GPU (считают быстро), но ужасно для энергоэффективности.

Что делают, чтобы приблизиться к мозгу:

|

Технология |

Идея |

Текущий статус |

|

Разреженные трансформеры |

Активировать только 5–10% весов на токен |

Работает, но сложно обучать |

|

Нейроморфные чипы (Intel Loihi, IBM TrueNorth, SpiNNaker) |

Аналоговые вычисления, спайковая нейронная сеть |

В 10 000 раз эффективнее GPU, но пока не умеют обучать как LLM |

|

Квантование до 4–8 бит |

Вместо 16–32 бит точности |

Уже используют (4 бита — точность падает, но не критично) |

|

Модели с «включением экспертов» (MoE) |

Включать только 10% параметров на токен |

Используют в Mixtral, Gemini — в 5–10 раз эффективнее |

|

Жидкие нейронные сети (Liquid SNN) |

Рекуррентные, с временной динамикой |

Только исследования |

Но: даже лучшие нейроморфные чипы все еще в 1000 раз менее энергоэффективны, чем мозг, потому что они не используют биохимические градиенты (ионные каналы, молекулярные моторы).

Итог: почему мозг лучше (и можно ли догнать)

|

Причина |

Эффект (разница в энергопотреблении) |

|

Аналоговые вычисления |

× 10⁴ – 10⁶ |

|

Разреженность (1% нейронов активно) |

× 10² |

|

Рекуррентность (вычисления во времени) |

× 10² |

|

Локальное обучение без backprop |

× 10¹ – 10² |

|

Использование биохимии (ионные каналы) |

× 10⁴ – 10⁵ |

|

ИТОГО |

× 10¹⁰ – 10¹⁴ |

Можно ли догнать?

Если мы создадим аналоговые спайковые нейроморфные чипы, работающие на пределе теплового шума, и научим их обучаться локально (как STDP — spike-timing-dependent plasticity) — то да, в теории, через 20–30 лет можно приблизиться к эффективности мозга. Но для этого придется отказаться от цифровой абстракции, точности 32 бита и обратного распространения ошибки — то есть от всего, на чем построены современные LLM.

Пока же LLM — это гигантский паровой молот, который забивает маленькие гвозди, потребляя энергию небольшого города.

Когда нейроморфные чипы (которые в 10 000–100 000 раз эффективнее GPU) станут реальностью?

Короткий ответ: они УЖЕ существуют, и их уже можно купить или арендовать в облаке. Но это не потребительские устройства — это специализированное оборудование для исследователей, оборонных структур и промышленности.

Часть 1. Что уже существует и работает прямо сейчас

1.1 SpiNNaker2 — самый мощный коммерческий нейроморфный суперкомпьютер

Статус: уже развернут и работает. Первая установка — в Sandia National Laboratories (США, ядерная безопасность).

Характеристики:

-

5 млрд нейронов в полуконфигурации (максимальная коммерческая версия — 10 млрд)

-

5.25 млн ядер ARM M4F на чипах (152 ядра на чип, 48 чипов на карту, 90 карт в стойке, 8 стоек)

-

Работает без операционной системы и дисков — данные хранятся только в SRAM и DRAM для максимальной скорости

-

Энергоэффективность: динамическое изменение напряжения от 0.45В до 0.6В, частоты — в зависимости от нагрузки

Где используется:

-

Sandia National Laboratories (национальная безопасность США)

-

Дрезденский технический университет (Германия) — закупили систему за €250,000

-

Доступен через облако (можно арендовать)

Цена: публично не раскрыта, но тендер на воздушную систему SpiNNaker2 составил €250,000. Полная конфигурация на 10 млрд нейронов будет значительно дороже.

Ключевая особенность: это гибридная система — поддерживает и спайковые нейронные сети (SNN), и глубокие нейронные сети (DNN), и символьный AI. Можно запустить GPT-слой прямо на нейроморфном чипе.

1.2 BrainChip Akida 2.0 — коммерческий чип для edge AI

Статус: уже в производстве. Проект AKD2500 запущен в феврале 2026 года, прототип ожидается в Q3 2026.

Характеристики:

-

Техпроцесс TSMC 12 нм

-

Бюджет разработки: $2.5 млн

-

Работает на принципе событийно-управляемых вычислений (как мозг: спайки только когда нужно)

BrainChip Akida 2.0 — второе поколение нейроморфной процессорной платформы, разработанной компанией BrainChip. Имитирует работу человеческого мозга для эффективной обработки данных на граничных устройствах, обеспечивая высокую производительность при низком энергопотреблении.

Для чего: обработка сенсорных данных на краю (edge AI) — умные датчики, носимые устройства, промышленный IoT.

Цена: отдельно чип не продается — BrainChip продает IP-лицензии производителям чипов. Стоимость лицензии не раскрыта.

1.3 SynSense Xylo — ультра-низкопотребляющие чипы

Статус: коммерчески доступны. В 2023 году выпустили Xylo IMU HDK — набор для разработки на нейроморфном чипе.

Характеристики:

· Потребление: микроватты (для сравнения: GPU — ватты)

· Серия Xylo — это базовый вычислительный модуль для инвазивных и неинвазивных нейрокомпьютерных интерфейсов, который выступает в роли низкоразмерного естественного процессора сигналов общего назначения. Использует уникальный алгоритм шипованной рекуррентной нейронной сети и полностью параллельную событийно-ориентированную архитектуру для высокоточной обработки нейронных сигналов в режиме реального времени при энергопотреблении на уровне микроватт. .

Он поддерживает онлайн-обучение и обработку данных с датчиков в режиме реального времени, обеспечивая постоянное интеллектуальное восприятие на периферии устройства. Встроенный аналоговый интерфейс и процессор на основе нейронной сети совместимы с различными датчиками, такими как аудиодатчики, инерциальные измерительные блоки и датчики давления, что позволяет объединять мультимодальные сигналы для расширения интерактивных возможностей и повышения общей производительности системы.

Серия Rigi — это инвазивный чип для биокомпьютерного интерфейса, предназначенный для высокотехнологичных медицинских применений. Он отличается сверхнизким энергопотреблением и высокой пропускной способностью. Его основная задача — обеспечить высокопроизводительную аппаратную основу для точного сбора и обработки нейронных сигналов.

Серия Rigi предназначена для клинического применения в таких областях, как мониторинг лекарственно-устойчивой эпилепсии, реабилитация при параличе и интеллектуальное управление протезами. Она ускорит переход от лабораторных разработок к реальным медицинским решениям на основе технологии BCI.

Серия Aeveon Eye — это миниатюрный малопотребляющий чип для распознавания изображений, разработанный для устройств дополненной и виртуальной реальности. Он использует технологию пикселей с обратной засветкой и кодирование со сжатием в реальном времени, обеспечивая сверхнизкую задержку менее 1 мс и динамически регулируя энергопотребление в зависимости от частоты кадров (от 4 мВт при 30 кадрах в секунду до 50 мВт при 1000 кадрах в секунду). Благодаря компактному форм-фактору 3,4×3,4 мм и конструкции с глобальным затвором он представляет собой легкое и высокоэффективное визуальное решение для смарт-очков и гарнитур.

Серия DVS имитирует событийно-ориентированный механизм биологической сетчатки глаза и предлагает полный спектр решений — от базовых до промышленных. Она подает сигнал только при обнаружении изменений в окружающем освещении, что позволяет перейти от «непрерывной регистрации» к «восприятию на основе событий».

Цена: не раскрыта (обычно такие dev-киты стоят $500–5000 для исследователей).

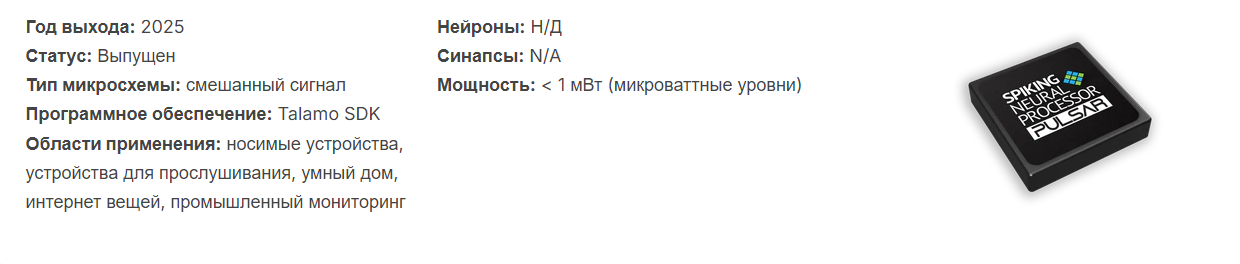

1.4 Innatera Pulsar — микроконтроллер со спайковой нейросетью

Статус: анонсирован в мае 2025 года, уже доступен.

Характеристики:

Pulsar — это нейроморфный микроконтроллер, созданный по образу и подобию человеческого мозга и предназначенный для сверхэнергоэффективной обработки данных в режиме реального времени в периферийных устройствах. Он сочетает в себе механизм спайковой нейронной сети (Spiking Neural Network, SNN) с микроконтроллером RISC-V и ускорением сверточных нейронных сетей, что позволяет создавать интеллектуальные сенсорные приложения без привязки к облаку.

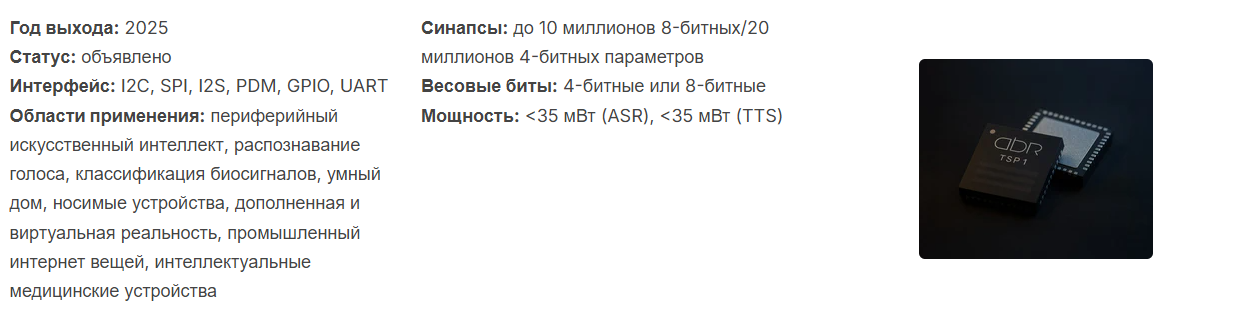

1.5.· TSP1 — Applied Brain Research – процессор временных рядов 1 (Time Series Processor 1, TSP1) от Applied Brain Research — чип-процессор временных рядов, созданный на основе принципов работы мозга и предназначенный для периферийных ИИ-приложений со сверхнизким энергопотреблением. Он использует обработку на основе сетей состояний для распознавания речи в реальном времени

Цена: не раскрыта.

Часть 2. Что появится в ближайшие 1–2 года

2.1 Коммерческий дебют аналоговых нейроморфных чипов

По прогнозам Analog Devices , к концу 2026 года аналоговые нейроморфные вычисления начнут выходить из пилотных проектов в раннее коммерческое использование.

Где увидят первыми:

-

Робототехника (гуманоидные роботы с локальным интеллектом)

-

Носимые устройства (умные часы, слуховые аппараты)

-

Автономные системы (дроны, беспилотники)

Что это даст: латентность в наносекунды (вместо миллисекунд у GPU) и энергопотребление на порядки ниже.

2.2 VectorWave — нейроморфная обработка радиочастотных сигналов

Статус: CEO — Бен Тейлор (Ben Taylor), ранее работавший в Cisco. В марте 2026 года, собрали $2.5 млн seed-раунда.

Технология: обрабатывает сырые RF-сигналы до их оцифровки — напрямую на аналоговом нейроморфном чипе.

В основе VectorWave лежит аналоговый ИИ-процессор, специально разработанный для радиочастотного логического вывода на уровне сигналов. Благодаря логическому выводу в физической области он позволяет принимать решения за наносекунды непосредственно на радиочастотном уровне, сокращая объем передаваемых данных, уменьшая задержку и энергопотребление еще до того, как сигналы попадут в цифровые системы.

Латентность: наносекунды (для сравнения: цифровая обработка — миллисекунды).

Применение: устойчивая связь в перегруженном радиочастотном спектре (стадионы, крупные мероприятия, умные фабрики).

Когда будет доступно: не раскрыто, но seed-раунд закрыт — значит, разработка активно идет.

Часть 3. Когда это станет доступно обычным людям?

Здесь нужно быть честным: нейроморфные чипы не заменят ваш ноутбук или телефон в ближайшие 5–10 лет.

Три пути коммерциализации:

|

Путь |

Пример |

Сроки |

|

Облачные сервисы |

Аренда SpiNNaker2 через облако (уже доступно) |

Уже сейчас |

|

Промышленные контроллеры |

BrainChip Akida в роботах и датчиках |

2026–2028 |

|

Потребительские устройства |

Нейроморфные сопроцессоры в смартфонах/умных часах |

2030+ |

Почему так долго?

-

Нужно переписать ПО — текущие нейросети (PyTorch, TensorFlow) не работают на спайковых чипах “из коробки”

-

Нужно обучить инженеров новой парадигме

-

Нужно масштабировать производство

Часть 4. Сколько это стоит? (реальные цифры)

4.1 Цены на системы (B2B)

|

Система |

Цена |

Что входит |

|

SpiNNaker2 (воздушное охлаждение) |

€250,000 |

1 борт, интеграция, бенчмарки |

|

SpiNNaker2 (полная конфигурация, 10 млрд нейронов) |

несколько млн € |

1440 плат, 10 млн ядер |

4.2 Цены на разработку чипов

|

Проект |

Бюджет |

Стадия |

|

BrainChip AKD2500 |

$2.5 млн |

Прототип Q3 2026 |

|

VectorWave |

$2.5 млн (seed-раунд) |

Ранняя стадия |

4.3 Рыночные оценки

-

Рынок нейроморфных чипов в 2025 году: $0.77 млрд

-

Прогноз на 2026: $0.87 млрд (рост 12.5%)

-

Прогноз на 2030: $1.38–1.92 млрд (в зависимости от сегмента)

Ключевой драйвер роста: робототехника и автоматизация. В 2023 году в Европе установлено 92,393 промышленных робота — и многие из них перейдут на нейроморфные чипы в ближайшие 5 лет.

Часть 5. Резюме: когда и сколько

|

Вопрос |

Ответ |

|

Они уже существуют? |

✅ Да. SpiNNaker2, BrainChip Akida, SynSense Xylo — уже работают. |

|

Где их используют сейчас? |

Национальные лаборатории США (ядерная безопасность), исследовательские центры в Германии, оборонные проекты. |

|

Можно ли купить? |

✅ Да, но B2B. Нужно заключать контракт с производителем. |

|

Сколько стоит самая дешевая система? |

€250,000 — воздушная версия SpiNNaker2 (тендер в Дрездене). |

|

Когда появятся в телефонах? |

~2030+ — сначала в промышленности, потом в потребительских устройствах. |

|

Можно ли арендовать в облаке? |

✅ Да, SpiNNaker2 уже доступен через облако. |

Часть 6. Оценка эксперта

Коротко: нейроморфные чипы — это не “технология будущего”. Это реальность прямо сейчас, но в очень специфических нишах: национальная безопасность, робототехника, умные датчики.

Для обычного человека: ты не купишь нейроморфный чип в магазине в 2026 году. Но ты уже можешь арендовать нейроморфный суперкомпьютер в облаке за несколько сотен евро в час (как AWS для GPU, только для SNN).

Главный барьер: не железо, а софт. Спайковые нейронные сети требуют совершенно новых алгоритмов обучения — обратное распространение ошибки (backprop) работает плохо. Нужны локальные правила обучения, как STDP в мозге. Это активно исследуется, но промышленного стандарта еще нет.

Когда будет переломный момент: когда кто-то (Google? OpenAI? Китайский стартап?) покажет, что LLM на нейроморфном чипе работает так же хорошо, как на GPU, но потребляет в 10 000 раз меньше энергии. Тогда инвесторы хлынут рекой. По текущим темпам — 2028–2030 годы.

Автор: nikolz