VLA, или Vision-Language-Action models, сегодня становятся одной из основных парадигм в робототехнике. Идея выглядит естественно: если большие визуально-языковые модели уже умеют связывать изображение, текст и высокоуровневое понимание сцены, то следующий шаг состоит в том, чтобы добавить к этому действия робота. Так появляется единый контур, в котором модель видит сцену, понимает инструкцию на естественном языке и выдаёт осмысленное управление.

Но в робототехнике недостаточно просто взять VLM, добавить выход на действия и масштабировать обучение, как это делается в чисто языковых задачах. Роботу приходится работать с дальним горизонтом планирования, с новыми объектами, с активным физическим контактом, с разными скоростями движения и с разными воплощениями: от одноруких манипуляторов до двуруких платформ и антропоморфов. В такой постановке поведение нельзя надёжно прописать в коде, а одной только имитации демонстраций быстро становится недостаточно.

В Green-VLA мы исходили именно из этого. Для нас это история не про «ещё один большой датасет», а про сочетание трёх вещей: quality alignment данных, unified action space и RL-фазы поверх behavior cloning (BC), то есть обучения на прямом копировании поведения из демонстраций. В результате мы получили поэтапно обученную VLA-модель для антропоморфного робота Green, которая при этом сохраняет способность к zero-shot переносу на другие воплощения.

Почему одних демонстраций и behavior cloning недостаточно

На первый взгляд кажется, что задача уже почти решена: соберём больше демонстраций, обучим политику по behavior cloning, то есть заставим модель повторять действия из примеров, и робот начнёт работать. На практике такой подход быстро упирается в потолок.

Во-первых, сами робототехнические данные неоднородны. У разных датасетов разные камеры, разные пространства действий, разные частоты дискретизации, разная динамика и качество записи. Если просто смешать это в один обучающий корпус, то модель начнёт усваивать не общий шаблон манипуляции, а артефакты конкретных датасетов.

Во-вторых, качество демонстраций сильно отличается от источника к источнику. В траекториях встречаются шум, смазанные кадры, дёрганые движения, непоследовательное выполнение задач и бедное визуальное разнообразие. Масштаб сам по себе эту проблему не решает: если не выровнять качество, то мы просто масштабируем шум.

В-третьих, behavior cloning по своей природе плохо работает там, где нужны длинные цепочки действий, восстановление после ошибок и устойчивое поведение вне обучающего распределения. Он хорошо копирует локальные решения из демонстраций, но хуже согласует поведение с долгосрочной целью. Именно поэтому VLA-системы, обученные только таким способом, часто выглядят сильными в коротких эпизодах и заметно проседают в реальной работе.

Для реального робота это особенно критично. Нас интересует не только success rate, но и общая пропускная способность системы: сколько задач робот успевает выполнить и насколько стабильно делает это в длинных сценариях. Поэтому в Green-VLA мы делали не просто модель, а полный стек данных, действий и обучения, в котором каждое слабое место закрывается отдельно.

Что делает Green-VLA отличной от других VLA-работ

Green-VLA — это поэтапно обученная VLA-модель для реального антропоморфного робота Green. При этом архитектура не привязана только к одному воплощению: та же политика переносится на мобильные манипуляторы, двурукие платформы и стандартные робототехнические бенчмарки.

Ключевая особенность здесь не в одной конкретной «хитрой» архитектурной детали, а в комбинации решений.

С одной стороны, мы используем большой мультимодальный и робототехнический корпус. На стадии L1 модель получает 24 миллиона мультимодальных примеров из интернета, не связанных напрямую с робототехникой, чтобы выучить физические и семантические представления о мире. На стадии R0 она видит 184 миллиона робототехнических примеров, что в сумме даёт более 3000 часов демонстраций с разных воплощений.

С другой стороны, этот масштаб не используется вслепую. Данные проходят фильтрацию и временное согласование, действия приводятся к единому семантическому пространству, а обучение разбивается на пять стадий: от базовой VLM и мультимодального предобучения до специализации под конкретного робота и RL-дообучения.

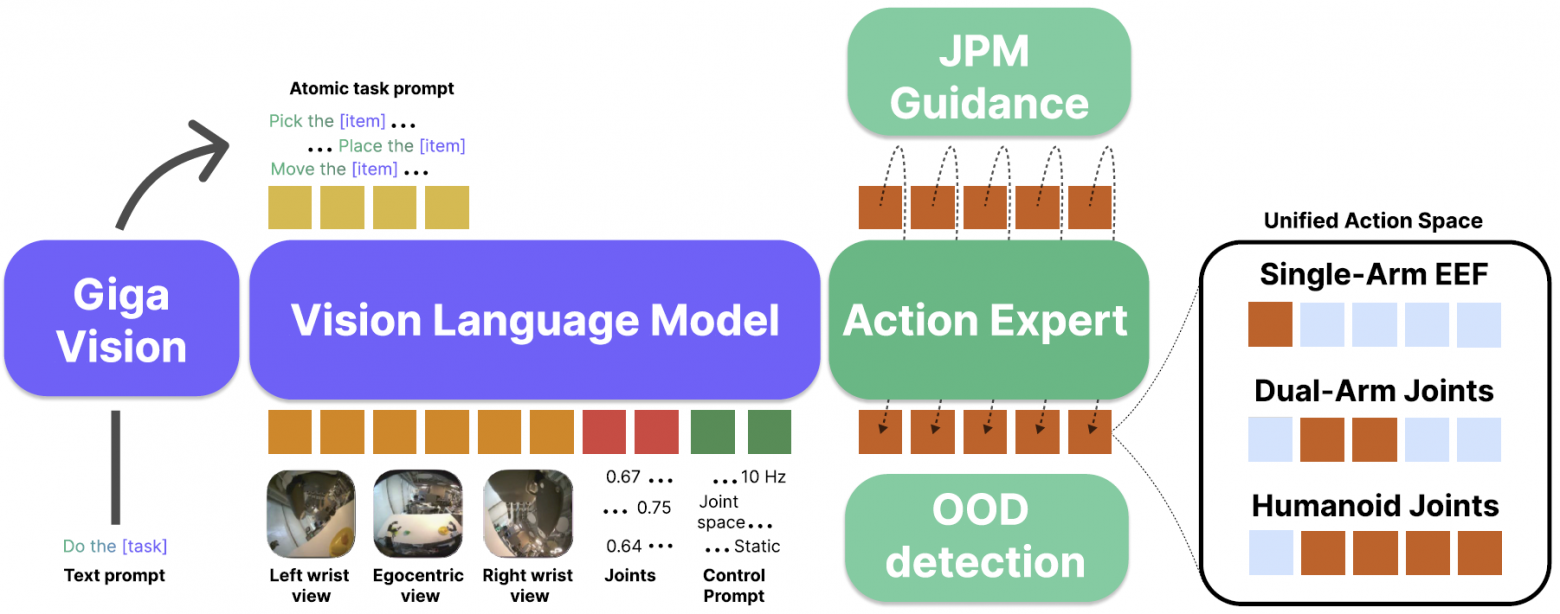

Наконец, Green-VLA оптимизирована именно под реальное управление. В основе лежит Qwen-VL 4B как визуально-языковая база, поверх которой работает отдельный flow-matching action expert. Такая схема разделяет семантическое восприятие и высокочастотное управление. Дополнительно архитектура ускорена для работы в реальном времени: используются эффективные механизмы внимания, легковесные финальные слои и сокращённое количество шагов денойзинга.

Именно это сочетание позволяет одной и той же системе работать с 48 степенями свободы (DoF) антропоморфа Green, но не терять способность к обобщению на другие платформы.

Как мы привели разнородные робототехнические данные к единому виду

Одна из главных инженерных проблем в VLA состоит в том, что робототехнические датасеты плохо «стыкуются» друг с другом. Даже если все они про манипуляцию, они записаны с разной кинематикой, разными типами управления и разной скоростью выполнения.

В Green-VLA мы решаем это на нескольких уровнях.

Сначала работает пайплайн DataQA. Он оценивает траектории по нескольким признакам: насколько движение шумное и дёрганое, насколько резкие изображения, насколько разнообразна сцена и как ведёт себя пространство состояний. Плюс к этому применяются практические фильтры: отсутствие камер, пропущенные кадры, подозрительно короткие или длинные эпизоды, задачи без осмысленного движения, а для отдельных сценариев ещё и проверка корректного шаблона действий захвата. На выходе мы получаем не просто большой, а очищенный корпус демонстраций.

Следующий шаг — временное согласование. Разные операторы и разные роботы двигаются с разной скоростью: где-то траектории плотные и медленные, где-то редкие и быстрые. Если смешать их как есть, то модель перестает понимать, какой физический прогресс должен соответствовать одному шагу действия. Поэтому мы оцениваем скорость движения по оптическому потоку с камер на запястьях и ресемплируем траектории так, чтобы похожие визуальные изменения соответствовали похожим приращениям действий.

Отдельно решается проблема пространства действий. Простое дополнение всех действий до одного общего вектора обычно ломает перенос, потому что одни и те же координаты начинают означать разные вещи для разных роботов. Вместо этого Green-VLA использует unified action space с фиксированной семантической разметкой. Для каждого воплощения мы явно знаем, какие слоты активны, и подаём в модель структурированный промпт с типом управления и параметрами робота. В итоге политика учится не «угадывать, в каком она датасете», а оперировать общей семантикой действий.

Для целевого антропоморфа это дополняется ретаргетингом. Демонстрации с других роботов переводятся в пространство конфигураций робота Green так, чтобы он имитировал намерение исходного действия, а не его буквальную параметризацию. Это позволяет использовать опыт, собранный не только на антропоморфах, но и на более простых системах, и всё равно обогащать итоговую политику для Green.

Наконец, мы усиливаем собственный датасет антропоморфа структурированными аугментациями. Исходные 48 часов данных Green Humanoid расширили до 167 часов обучения с помощью зеркалирования эпизодов по симметрии робота и обратимых траекторий с разворотом по времени там, где задача это физически допускает.

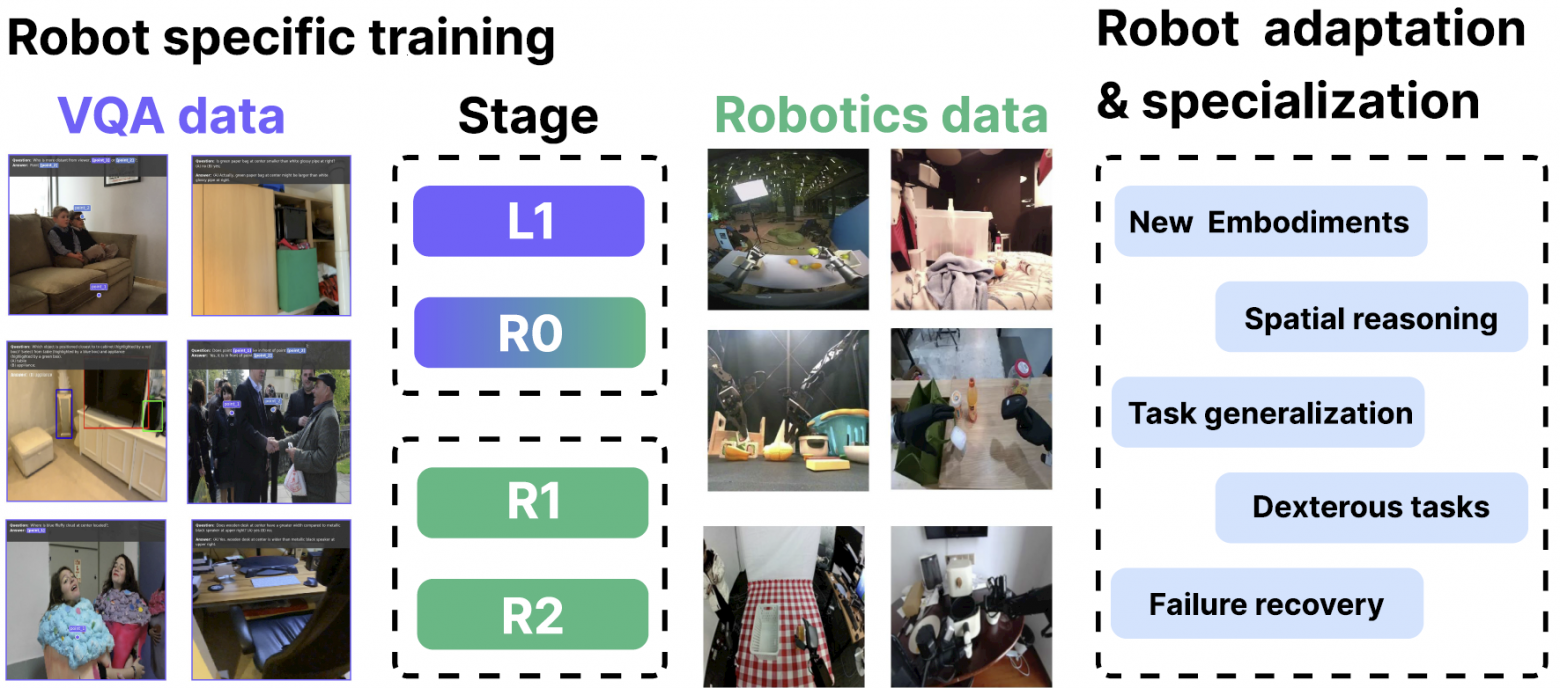

Почему обучение разбито на пять стадий: L0 → L1 → R0 → R1 → R2

Поэтапный пайплайн в Green-VLA нужен не для красоты. Каждая стадия закрывает отдельное узкое место, и без этой последовательности трудно одновременно получить обобщение, надёжность и приемлемую задержку инференса.

L0 — это базовая VLM. Она уже умеет связывать изображение и текст, но ещё не готова к реальному управлению роботом.

L1 — мультимодальное предобучение на веб-данных. Здесь модель получает физические и семантические представления о мире: многоракурсное понимание сцены, аффордансы объектов, пространственное рассуждение, более общую структуру задач. Это тот слой знаний, который нельзя достать только из робототехнических демонстраций.

R0 — общее робототехническое предобучение. На этом этапе модель связывает цели, объекты и кинематику с распределением допустимых действий и начинает учиться общим паттернам манипуляции на разных воплощений. Именно здесь unified action space и quality alignment начинают давать максимальный эффект.

R1 — адаптация под конкретное воплощение. После общего предобучения мы дообучаем модель на высококачественном корпусе, привязанном к целевому роботу или бенчмарку. Это позволяет сразу поднять качество управления без необходимости заново строить весь pipeline.

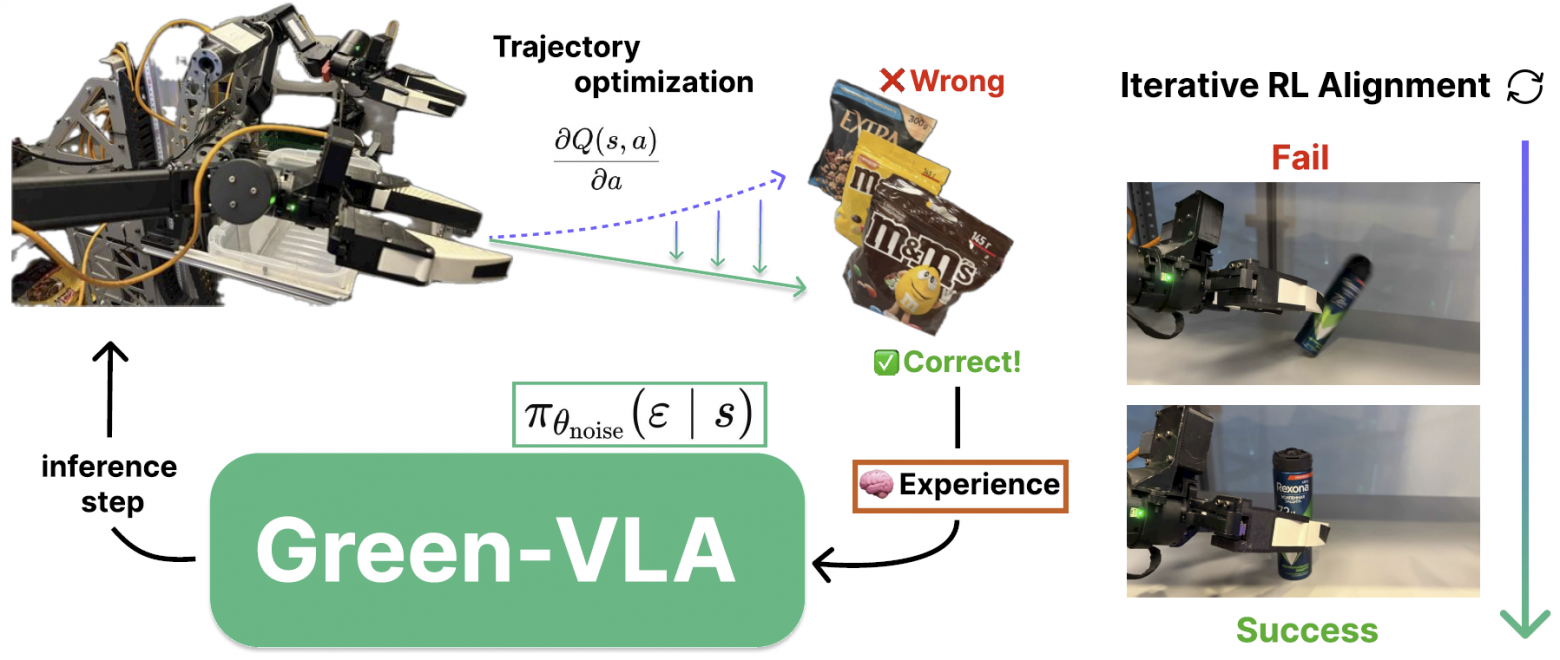

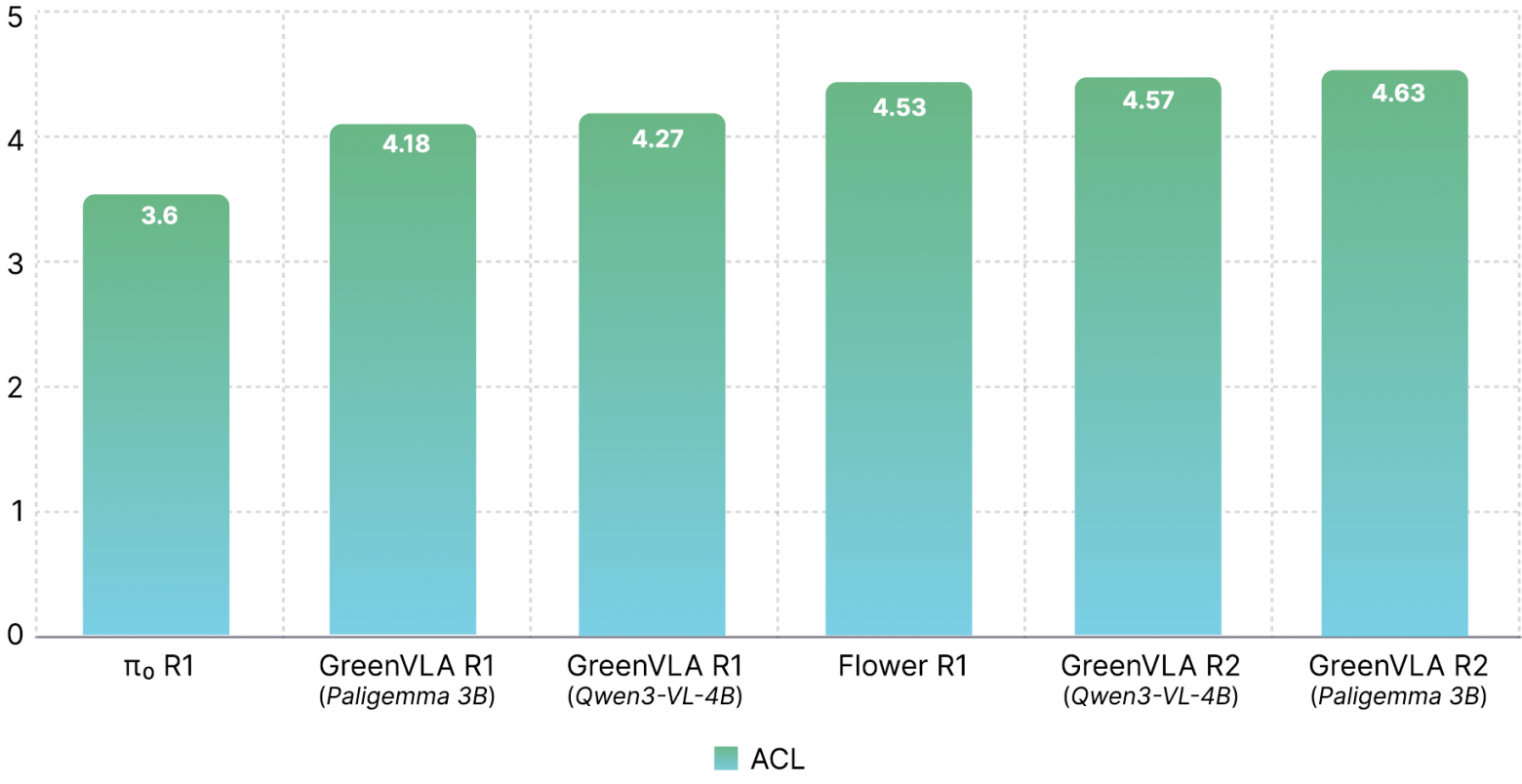

R2 — RL fine-tuning. Эта фаза нужна, чтобы выйти за пределы behavior cloning в задачах с дальним горизонтом, активным контактом и восстановлением после ошибок. В Green-VLA она устроена так, чтобы не ломать базовую модель прямыми RL-градиентами по всей архитектуре. Вместо этого используется оптимизация траекторий с отдельным критиком и оптимизация исходного распределения шума для flow-matching генерации.

Такой пайплайн даёт понятное разделение ответственности. Веб-данные отвечают за общие представления, R0 — за базовые навыки манипуляции, R1 — за специализацию под конкретное воплощение, а R2 — за устойчивость на длинном горизонте и восстановление.

Что помогает модели в реальном мире: unified actions, JPM, EEP и OOD

Даже хорошей базовой политике мало просто «уметь брать предметы». В реальном мире ей приходится сталкиваться с новыми объектами, похожими упаковками, неожиданными сбоями захвата и необходимостью вовремя остановиться после успешного выполнения.

Первый важный компонент здесь — уже описанный unified action space. Он нужен не только для обучения, но и для инференса: модель получает явный промпт, который задаёт тип управления и воплощение, а затем генерирует только те модальности действий, которые действительно нужны этому роботу.

Второй компонент — EEP (episode end prediction), то есть предсказание завершения эпизода. На каждом шаге Green-VLA оценивает, завершена ли текущая подзадача. Это критично в сценариях, когда лишнее движение после успеха может испортить уже достигнутое состояние. В исходной статье это отдельно подчёркивается для задач на Google Robot, но в целом такое поведение важно для любого реального развёртывания.

Третий компонент — OOD-детекция, то есть обнаружение состояний вне обучающего распределения (out-of-distribution). Если модель долго не видит признаков завершения и при этом её краткосрочная динамика становится нестабильной, то система может зафиксировать выход в нежелательное состояние и передать управление на перепланирование. Это делает поведение менее хрупким, особенно при неожиданном контакте, сбое захвата или встрече с незнакомым объектом.

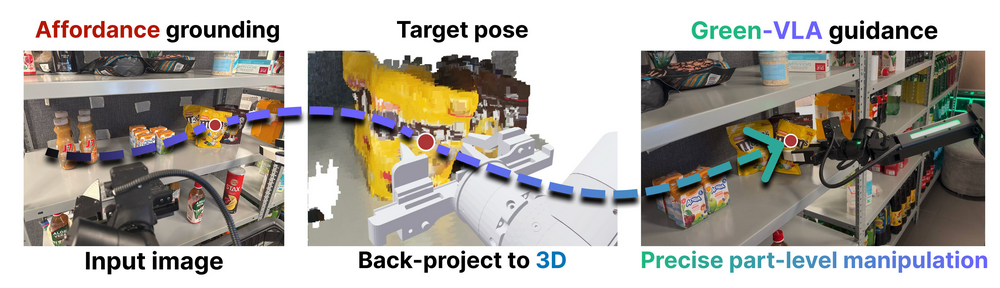

Отдельную роль играет JPM, joint prediction module. Он нужен для тех случаев, когда сквозная политика видит инструкцию, но в самой сцене объект слишком новый, слишком редкий или слишком похожий на соседние. В сценарии e-commerce это особенно заметно: модель должна отличать почти одинаковые товары, у которых единственные надёжные признаки могут быть в мелком тексте, деталях этикетки или небольших цветовых различиях.

JPM решает это так: по изображению и языковой инструкции он сначала находит релевантную двумерную точку на объекте, затем переносит её в трёхмерное пространство робота и использует как целевую точку для ориентирования во время flow-matching генерации действий. Важное преимущество в том, что этот модуль не требует дополнительного обучения всей политики и может использоваться как лёгкий способ направить поведение на более точный выход к объекту.

Поверх низкоуровневой политики в системе также может работать высокоуровневый планировщик задач. В исходной статье эту роль выполняет VLM-модуль, который разбивает пользовательский запрос на атомарные подзадачи вроде «возьми предмет левой рукой», «положи в корзину», «передай пользователю», и затем использует обратную связь от Green-VLA для перехода к следующему шагу или перепланирования. Важно, что сама Green-VLA при этом остаётся низкоуровневой политикой исполнения, а не универсальным планировщиком всего цикла.

Что получилось на бенчмарках и реальном роботе

Green-VLA — это модель, состоящая из около 5 миллиардов параметров, где Qwen-VL 4B отвечает за визуально-языковую основу, а остальные параметры приходятся на action expert и легковесные выходные слои. При этом важный тезис исходной статьи в том, что система остаётся менее требовательной к данным и вычислениям, чем ряд очень крупных VLA-подходов.

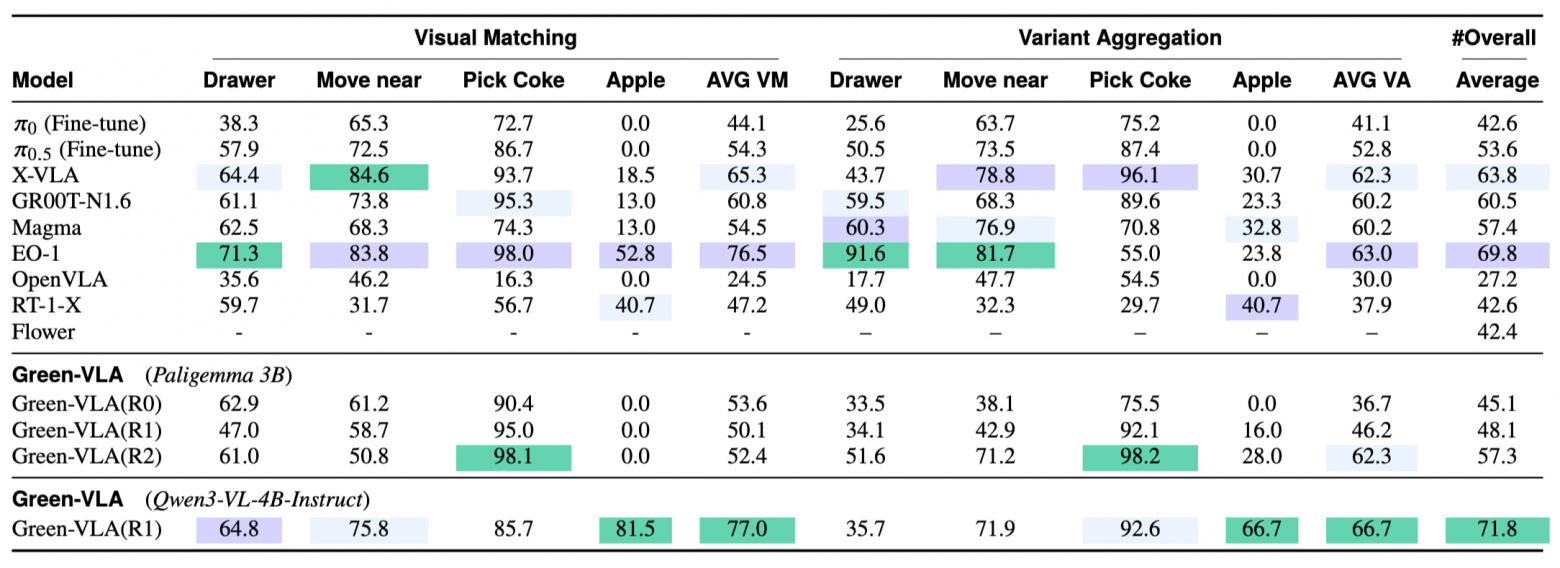

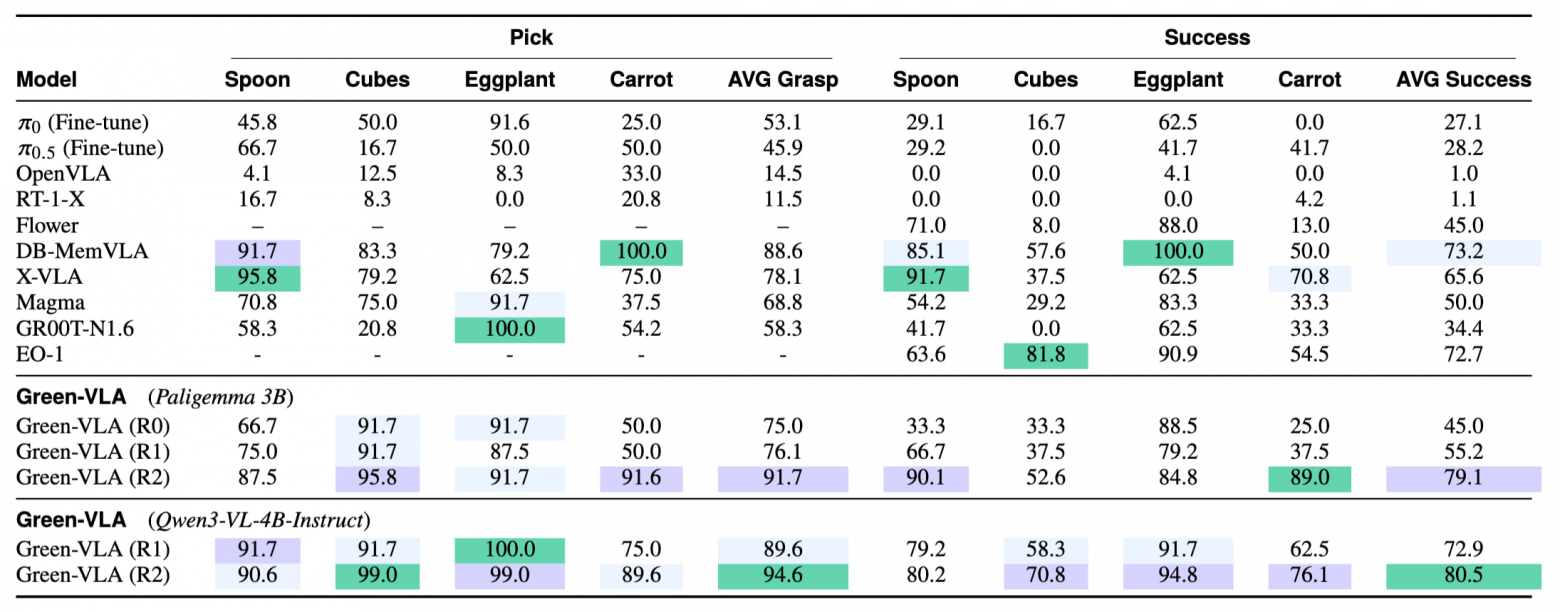

На этапе R0 мы смотрим, насколько хорошо модель переносится между воплощениями без дополнительной адаптации. На двуруком роботе AgileX Magic Cobot Green-VLA в задачах pick-and-place и уборки стола по инструкции сравнивается с π0, GR00T N1, AgiBot GO-1 и WALL-OSS. Из исходной статьи следует, что Green-VLA показывает более высокую точность следования инструкциям и success rate, чем π0, причём достигает этого при примерно 3000 часов унифицированных демонстраций против более чем 10000 часов у π0.

На открытых бенчмарках Simpler для WidowX и Google Robot R0-модель Green-VLA превосходит другие методы на сопоставимой стадии чистого предобучения, и доходит до уровня некоторых уже дообученных бейзлайнов. Отдельно исходная статья показывает поэтапную картину на WidowX: неотфильтрованная смесь данных, затем SFT на отфильтрованном подмножестве, затем RL. Качество растёт последовательно на каждом этапе, что хорошо иллюстрирует ценность и DataQA, и RL-фазы.

R1 показывает, что после общего предобучения модель можно эффективно адаптировать под конкретное воплощение. В CALVIN Green-VLA дообучается, начиная только с базового чекпойнта R0, без отдельного предобучения на данных CALVIN. Это позволяет изолировать эффект адаптации. По результатам исходной статьи Green-VLA R1 достигает сопоставимой производительности с π0, дообученной на CALVIN, и немного опережает её по общей вероятности успеха и многошаговым цепочкам.

R2 — это уже история про дальний горизонт и восстановление. На CALVIN именно эта стадия даёт наибольший прирост: улучшается стабильность, способность восстанавливаться после ошибок и средняя длина успешной цепочки действий. На Simpler BRIDGE WidowX исходная статья фиксирует абсолютный прирост success rate на 24% относительно R1. В сценарии e-commerce RL-дообучение тоже даёт практический эффект: оно делает захват физически надёжнее, улучшает геометрию подхода и снижает количество падений и выскальзываний объектов.

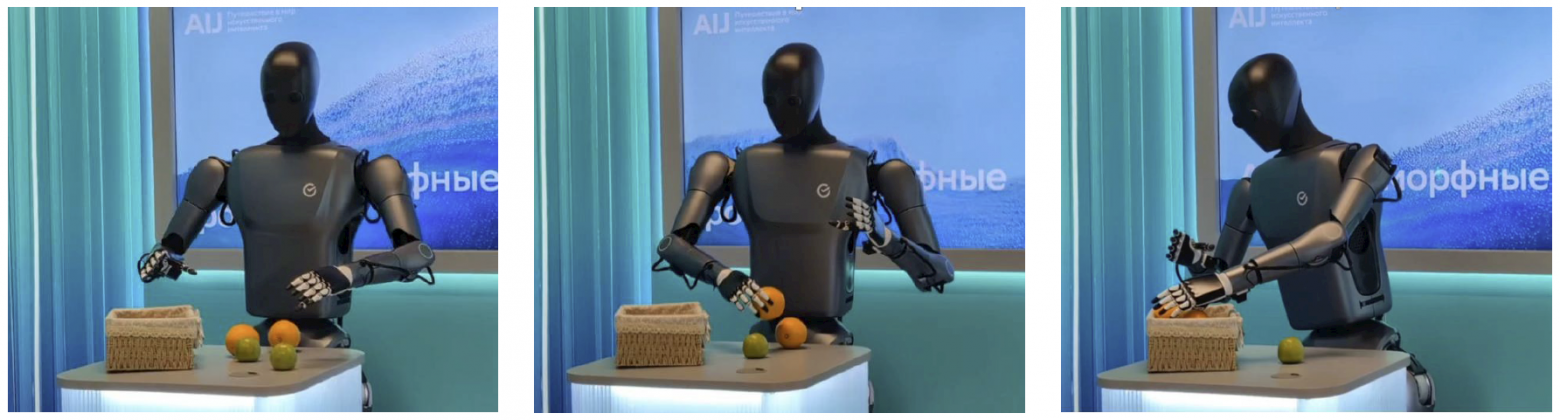

Отдельно важен результат на реальном антропоморфе Green. Здесь модель управляет головой, туловищем, двумя руками и ловкими кистями, всего 48 DoF. В статье описаны сценарии, когда робот берёт предметы левой или правой рукой, перекладывает объект из руки в руку, достаёт из корзины, передаёт пользователю, сортирует фрукты и выполняет длинные последовательности « взять → положить → снова взять → отдать». Оценка проводится как в ID, так и в OOD-конфигурациях сцены.

С инженерной точки зрения это, возможно, самый важный результат всей работы. Одна и та же политика не только показывает хорошие результаты на стандартизированных бенчмарках, но и управляет реальным антропоморфом в задачах, где нужно координировать обе руки, туловище, выбор правильного объекта и точное следование языковой инструкции.

Заключение

Если смотреть на Green-VLA как на рецепт, то главный вывод довольно практичный. Для VLA в реальном роботе недостаточно просто увеличивать масштаб. Нужны дисциплина в данных, явная унификация действий и отдельная фаза обучения, которая выводит модель за пределы behavior cloning.

В нашем случае quality alignment через DataQA и временное согласование сделали разнородный датасет пригодным для совместного обучения. Unified action space позволил одной политике не распадаться на набор несвязанных режимов для разных роботов, а RL-фаза добавила то, чего обычно не хватает чистому cloning: устойчивость на дальнем горизонте, восстановлени и более надёжное поведение при сложном контакте.

Именно поэтому Green-VLA интересна не только как модель для антропоморфа Green, но и как практический способ собрать единую VLA-политику для нескольких воплощений без потери качества на реальном целевом роботе.

Из будущих направлений исходная статья прямо выделяет три: выполнение инструкций на нескольких языках, усиление связи между быстрым рассуждением и управлением в реальном времени, а также интеграцию памяти и воспроизведение траекторий. Если эти части удастся органично встроить в тот же стек, то путь к действительно универсальному роботизированному интеллекту станет заметно короче.

Автор: Sber