Вы не ошиблись, прочитав заголовок. Практически все распространенные виды архитектур были представлены в новинках вендоров в марте. И все они так или иначе связаны с задачами машинного обучения и искусственного интеллекта.

Меня зовут Сергей Ковалёв, я менеджер выделенных серверов в Selectel. В новом дайджесте я собрал новинки, представленные в марте: процессоры, GPU, диски и другое. Подробности под катом!

Процессоры

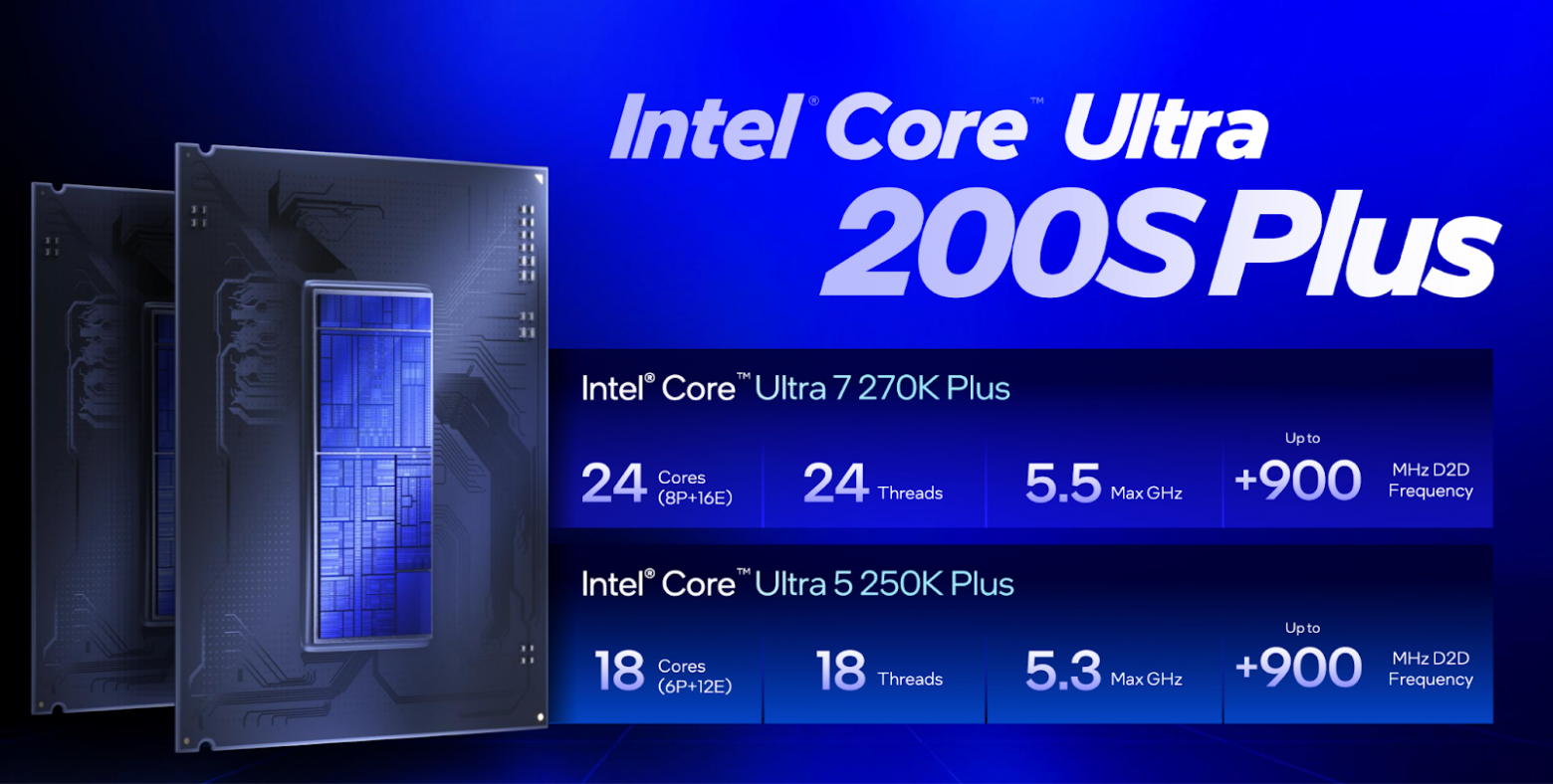

Intel Core Ultra 200S Plus — минорное обновление линейки

Intel обновили десктопную линейку Core Ultra 200S и мобильную 200HX Plus — но без прорыва. Новинки получили больше E-ядер, повышенные частоты и поддержку более быстрой DDR5, оставаясь по сути точечным рефрешем архитектуры Arrow Lake.

|

Модель |

Ядра |

Потоки |

Базовая частота P-ядер |

Базовая частота E-ядер |

|

Intel Core Ultra 7 270K Plus |

8P + 16E |

24 |

3,7 ГГц |

3,2 ГГц |

|

Intel Core Ultra 5 250K Plus |

6P + 12E |

18 |

4,2 ГГц |

3,3 ГГц |

Выпущено два обновленных процессора. Для текущих владельцев систем апгрейд выглядит спорным. Подробный разбор характеристик, сравнение с прошлым поколением и AMD — в полной статье.

AMD Ryzen 9 9950X3D2 Dual Edition

AMD представила Ryzen 9 9950X3D2 Dual Edition — первый десктопный процессор с двумя кристаллами 3D V-Cache.

Технические характеристики

-

Архитектура: Zen 5.

-

Ядра / потоки: 16 / 32.

-

Суммарный кеш: 208 МБ.

-

Базовая частота: 4,3 ГГц.

-

Boost-частота: 5,6 ГГц.

-

TDP: 200 Вт.

Процессор демонстрирует уверенный прирост производительности в профессиональном софте, что подтверждает его актуальность для рабочих станций. В задачах трехмерного рендеринга (V-Ray и Blender) новинка быстрее предшественника на 7%, а в сценариях создания контента и компиляции кода преимущество составляет от 5% до 8%. Наиболее значительный скачок эффективности — на 13% — зафиксирован в комплексных бенчмарках SPEC Workstation, подчеркивающих общую оптимизацию архитектуры для сложных вычислительных нагрузок.

AMD явно пытается отобрать часть рынка у Intel Xeon-W и своих же Threadripper.

Двойной V-Cache на настольном сокете AM5 — это своеобразная лаборатория, результаты которой определят, стоит ли развивать технологию дальше и переносить на серверные EPYC. Мы тоже присматриваемся к таким процессорам для использования в наших дата-центрах.

Снижаем цены на выделенные серверы в реальном времени

Успейте арендовать со скидкой до 35%, пока лот не ушел другому.

Arm AGI — свой процессор для дата-центров

Arm представила процессор AGI – серверный чип, оптимизированный для агентных AI-вычислений.

Архитектура сознательно урезана от всего, что не приносит пользы. Чип построен на базе Arm, при этом разработчики сознательно исключили поддержку SMT (один поток на ядро) для обеспечения максимально предсказуемого масштабирования нагрузки. Чтобы минимизировать задержки, память и подсистема ввода-вывода (I/O) интегрированы непосредственно в кристалл с вычислительными ядрами, а для эффективного управления ресурсами каждый сокет определяется операционной системой как два независимых NUMA-домена.

Линейка серверных процессоров AGI SP113012 включает три модели, работающие на базовой частоте 3,2 ГГц с теплопакетом 300 Вт. Платформа получила продвинутую подсистему памяти с поддержкой 12 каналов DDR5 (до 8 800 МТ/с, по два модуля на канал) и внушительный объем кеша: 128 МБ системного L3 и по 2 МБ L2 на каждое ядро. Для расширения возможностей ввода-вывода и работы с периферией предусмотрено 96 линий PCIe Gen6 и поддержка протокола CXL 3.0 Type 3, при этом архитектура допускает создание эффективных двухсокетных конфигураций.

Линейка разделена на три модификации, каждая из которых адаптирована под конкретный тип нагрузки.

-

136C (Max Core Count). Флагман со 136 ядрами Neoverse V3, ориентированный на максимально параллельные вычисления. При пропускной способности памяти 6 ГБ/с на ядро эта модель обеспечивает пиковую многопоточную производительность.

-

128C (TCO Optimized). Сбалансированное решение на 128 ядер с эффективностью 6,3 ГБ/с на ядро. Процессор позиционируется как оптимальный вариант по соотношению стоимости владения (TCO) и итоговой мощности.

-

64C (Max Mem/Core). Специализированный чип с 64 ядрами, где пропускная способность памяти на каждое ядро достигает 13 ГБ/с. Это вдвое выше показателей старших моделей, что делает его идеальным для задач, критичных к ПСП, таких как инференс больших языковых моделей (LLM).

Arm всегда говорили: «Мы не делаем чипы, мы их лицензируем» — но теперь нарушает собственное правило. Потому что гиперскейлеры вроде AWS, Google, Microsoft или Alibaba уже сами производят Arm-чипы, а Arm получает лишь плату за лицензию. И кажется, наиболее сильным ударом это станет по Ampere Computing, которая как раз производит процессоры для свободной продажи на рынке.

Цены еще не названы, но теперь роялти будут поступать Arm не только с дизайна, но и продажи готовых чипов. Первыми клиентами должны стать OpenAI, SAP, Cerebras, Cloudflare, F5, SK Telecom, Rebellions. А также OEM/ODM производители: ASRock Rack, Lenovo, QCT, Supermicro

Интересно, как к выходу Arm на рынок отнеслись другие вендоры? Пишите свое мнение в комментариях.

Alibaba XuanTie C950 — самый производительный RISC-V

Alibaba анонсировали XuanTie C950 — серверный RISC-V процессор, который компания называет «самым высокопроизводительным RISC-V в мире». Главная фишка — в аппаратной поддержке инференса LLM на уровне набора инструкций. По сути,

это первый RISC-V чип с таким подходом.

Технические характеристики

-

Архитектура: 64 бит RISC-V.

-

Декодер: восемь инструкций за такт.

-

Конвейер: 16-стадийный.

-

Производительность: 22 SPECint2006/ГГц (более чем втрое выше, чем у предшественника C920).

-

Векторные регистры: 256 бит.

-

Поддерживаемые типы: FP16/BF16/FP32/FP64/INT8/INT16/INT32/INT64.

-

Кеш L1I: 64 КБ (опционально parity check).

-

Кеш L1D: 64 КБ (опционально ECC).

-

Кеш L2: 1 МБ на ядро (опционально ECC), кластер = 8 ядер.

Особое внимание уделено AI-вычислениям: встроенные движки Alibaba Vector и Matrix Acceleration поддерживают широкий спектр типов данных (от INT8 до FP64) с 256-битными регистрами. Такая архитектура оптимизирована для высоконагруженных серверных задач, включая работу с базами данных (MySQL, Redis), веб-серверами (Nginx) и инференс популярных моделей Qwen и DeepSeek.

Что это значит для рынка? RISC-V набирает обороты. Alibaba не просто лицензирует ядра, а разрабатывает свои с нуля. C950 — флагман, который, если верить заявлениям, втрое быстрее предшественника C920. Также заявлена изначальная поддержка инференса LLM (Qwen, DeepSeek) на аппаратном уровне. Это можно назвать вызовом для Intel и AMD в облаке. Хотя пока Alibaba не продает эти чипы отдельно, а производит для собственных ЦОД. Ждем, когда присоединятся другие китайские гиперскейлеры.

CIX ClawCore — три ARM-процессора под OpenClaw

Китайская компания CIX Technology (Cixin Technology) объявила о новом семействе ClawCore на архитектуре Armv9.2. Новые процессоры разрабатывали с прицелом на OpenClaw.

-

ClawCore-P. Высокопроизводительный вариант с 12 ядрами до 3,2 ГГц и графикой Immortalis-G720. При AI-мощности в 45 TOPS и поддержке 64 ГБ LPDDR5 это решение ориентировано на мультимедийные и вычислительные задачи.

-

ClawCore-A. «Рабочая лошадка» для круглосуточного инференса. Включает восемь ядер (3,0 ГГц) и базовые 80 TOPS, которые можно разогнать до внушительных 200 TOPS с помощью внешней AI-карты. Безопасность и стабильность данных здесь обеспечиваются аппаратным шифрованием и поддержкой ECC.

-

ClawCore-E. Энергоэффективное решение для IoT и периферийных устройств. Характеристики чипа минимальны, так как основной упор сделан на низкое энергопотребление и работу с голосовым управлением.

Все три чипа ориентированы на платформу Arm SystemReady и совместимы с Windows, Android, Ubuntu, Tongxin/UnionTech и Kylin.

Китай активно развивает альтернативы западным чипам. Производители заявляют снижение стоимости токенов на 50%. Для достижения таких показателей используется гибридная архитектура: устройство гибридное, 80–90% запросов выполняется локально, остальное — в Alibaba Cloud.

GPU

LPU NVIDIA Groq 3

NVIDIA объявила, что платформа Vera Rubin запущена в производство и готова к развертыванию. Изначально решение строилось вокруг шести чипов, но в марте к ним добавился седьмой — LPU Groq 3.

Платформа представляет собой комплексную инфраструктуру, объединяющую Arm-процессоры Vera, ускорители Rubin и высокоскоростной интерконнект NVLink 6. Сетевая часть базируется на адаптерах ConnectX-9 SuperNIC, DPU BlueField-4 и коммутаторах серий Spectrum/Quantum-6. Особое место в составе системы занимают LPU Groq 3 — специализированные чипы для инференса языковых моделей. Благодаря отказу от традиционной памяти в пользу сверхбыстрой встроенной SRAM решение от Groq обеспечивает экстремально высокую скорость генерации текста при минимальных задержках.

Специфический ускоритель LPU Groq 3 разработан исключительно для инференса (запуска) языковых моделей, что позволяет достичь экстремальной скорости генерации и минимальных задержек. В отличие от традиционных ускорителей, полагающихся на внешнюю память, Groq 3 использует сверхбыструю встроенную память SRAM. Это исключает узкие места при передаче данных и делает чип одним из самых производительных решений для работы с LLM в реальном времени.

Стойка Groq 3 LPX содержит 256 LPU-чипов с агрегированной пропускной способностью памяти 640 Тбайт/с. В паре с Vera Rubin NVL72 LPU удается повысить эффективность декодирования: каждый слой модели вычисляется совместно для каждого токена.

Заявленный прирост пропускной способности инференса на мегаватт — до 35 раз. На выходе получается гетерогенная система, где каждый делает свое дело с огромной общей эффективностью.

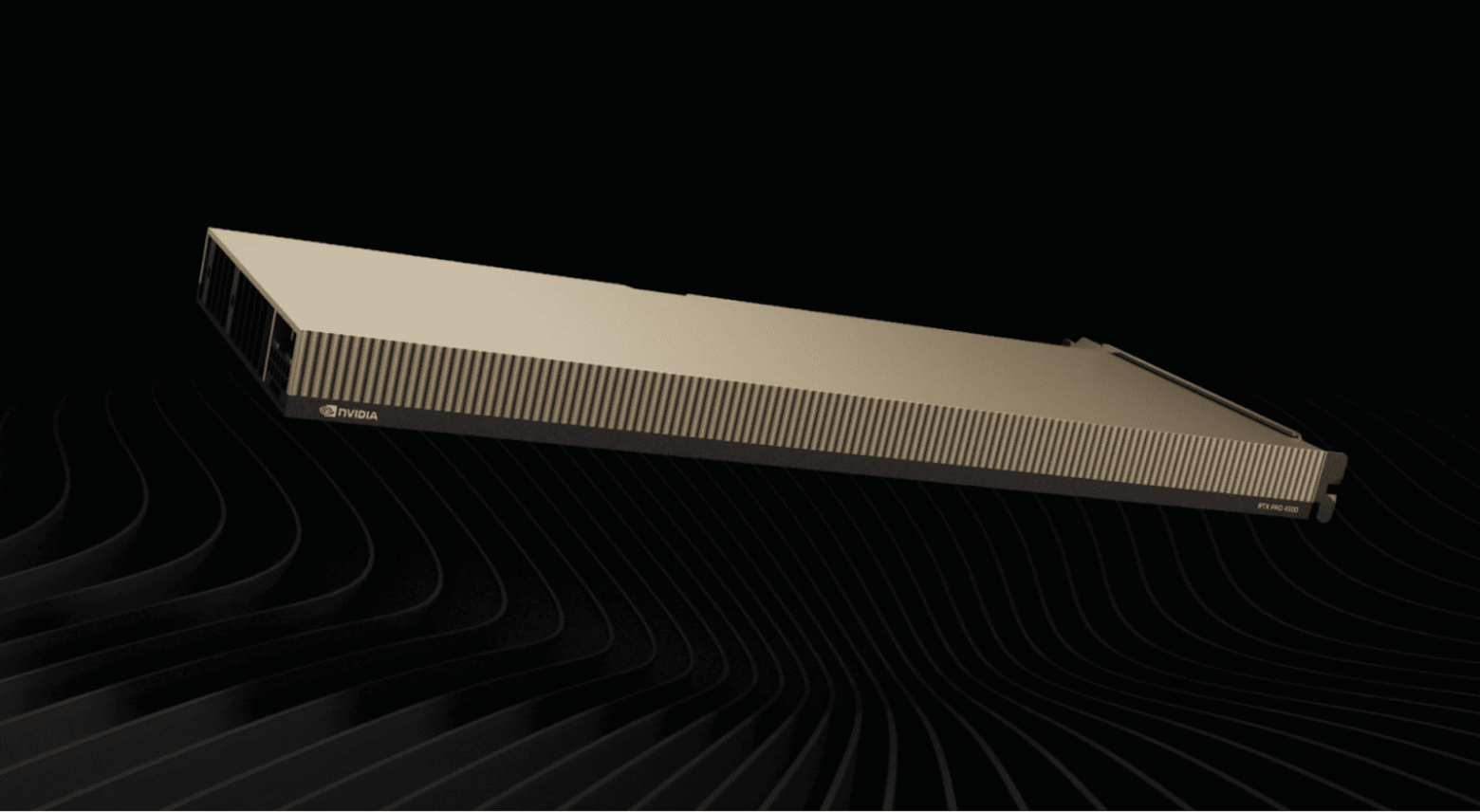

NVIDIA RTX Pro 4500 Blackwell Server Edition — середнячок на 32 ГБ

В марте компания NVIDIA представила серверную GPU с 32 ГБ GDDR7 с пропускной способность до 800 ГБ/с, рассчитанную на инференс небольших моделей. Карта получила однослотовый форм-фактор и пассивное охлаждение. А в производительности заметный упор был сделан на вычисления низкой точности (FP4/FP8). Подробнее о характеристиках мы уже рассказывали в своем блоге.

Huawei Atlas 350 — китайская новинка

Huawei не отстает от NVIDIA с Atlas 350. Новинка построена на чипе Ascend 950PR и ориентирована на стадию инференса prefill.

Заявлены до 128 ГБ HBM-памяти, пропускная способность 1,6 ТБ/с и производительность до 1,56 PFLOPS (FP4), подробные спецификации пока раскрыты лишь частично.

Подробнее о характеристиках, позиционировании и сравнении с NVIDIA — также в полной статье.

Диски

Kioxia GP Series – SSD на XL-Flash с прямым доступом от GPU

Kioxia анонсировала семейство SSD Super High IOPS серии GP для ресурсоемких AI-нагрузок. Концепция здесь нестандартная: GPU в составе системы получает прямой доступ к накопителю, минуя CPU. Это позволяет использовать флеш-память как расширение HBM — того самого, которого часто не хватает в больших ИИ-моделях.

В основе новинки — чипы XL-Flash (SCM — Storage Class Memory) с низкой задержкой. Это уже не стандартный TLC NAND, а нечто среднее между NAND и DRAM по характеристикам доступа. Интерфейс тоже современный — PCIe 6.0.

Ожидаемый IOPS на первом этапе — около 25 миллионов, а в дальнейшем планируется рост до 100 миллионов. При этом диск есть в нескольких форм-факторах, включая SFF.

Разработка ведется в рамках инициативы NVIDIA Storage-Next. Для сравнения: параллельно Kioxia продвигает серию CM9 на PCIe 5.0 с емкостью до 25,6 ТБ на TLC NAND и выносливостью 3 DWPD — они пойдут в серию в III квартале 2026 года для задач инференса на более традиционных уровнях нагрузки.

Micron 9650 — первый серийный SSD с PCIe 6.0 и 28 ГБ/c

Micron запустила массовое производство накопителя 9650 — первого в мире коммерческого SSD с поддержкой PCIe 6.0. Переход с 5.0 на 6.0 – это удвоение теоретической пропускной способности шины.

Накопитель Micron 9650 демонстрирует рекордные показатели производительности благодаря интерфейсу PCIe 6.0: скорость последовательного чтения достигает 28 000 МБ/с, а записи — 14 000 МБ/с. Устройство особенно эффективно в сценариях с произвольным доступом, обеспечивая до 5,5 млн IOPS при чтении и 900 тысяч IOPS при записи. Такие характеристики делают его ключевым компонентом для AI-инфраструктуры, где требуется мгновенная передача данных для обучения и инференса больших моделей.

Для сравнения: аналогичные показатели топовых PCIe 5.0 накопителей примерно вдвое ниже. Потребление при этом — всего 25 Вт, ровно столько же, сколько потреблял предшественник с PCIe 5.0. То есть производительность на ватт выросла вдвое: 1 120 МБ/с/Вт против 560 МБ/с/Вт.

Для AI-инфраструктуры это особенно актуально: одним из реальных узких мест при перемещении данных между хранилищем и вычислительными узлами является именно пропускная способность, а не только латентность. Micron 9650 с PCIe 6.0 убирает это ограничение хотя бы со стороны накопителя. PCIe 6.0 на серверном рынке пока только разгоняется, но старт массового производства — серьезный сигнал для всей отрасли.

Toshiba M12 — стеклянные пластины, SMR и 34 ТБ

Toshiba начала пробные отгрузки Nearline-накопителей серии M12 емкостью от 30 до 34 ТБ. Эти диски целятся прямо в гиперскейлеров и крупных облачных провайдеров.

Самое интересное здесь — не емкость сама по себе, а то, как ее достигли. Toshiba отказалась от алюминиевых пластин в пользу стеклянных: это позволило сделать их тоньше и упаковать 11 штук в стандартный LFF-корпус.

Спецификации Toshiba MG12 демонстрируют новый стандарт плотности данных — 3,09 Тбайт на пластину в герметичном гелиевом корпусе. Благодаря технологии FC-MAMR и переходу на управляемую хостом черепичную запись (host-managed SMR) накопитель избавляется от характерных для SMR задержек. При стандартной скорости 7 200 об/мин устройство выдает до 282 МБ/сек, что на 8% быстрее серии MG11, а энергоэффективность в расчете на терабайт улучшилась сразу на 18%. Накопитель рассчитан на критические нагрузки (MTBF 2,5 млн часов) и доступен в версиях SATA и SAS.

На рынке это довольно значимый шаг: SMR-накопители давно существуют, но host-managed вариант с такой емкостью на стеклянных пластинах — это уже серьезная заявка на доминирование.

Охлаждение

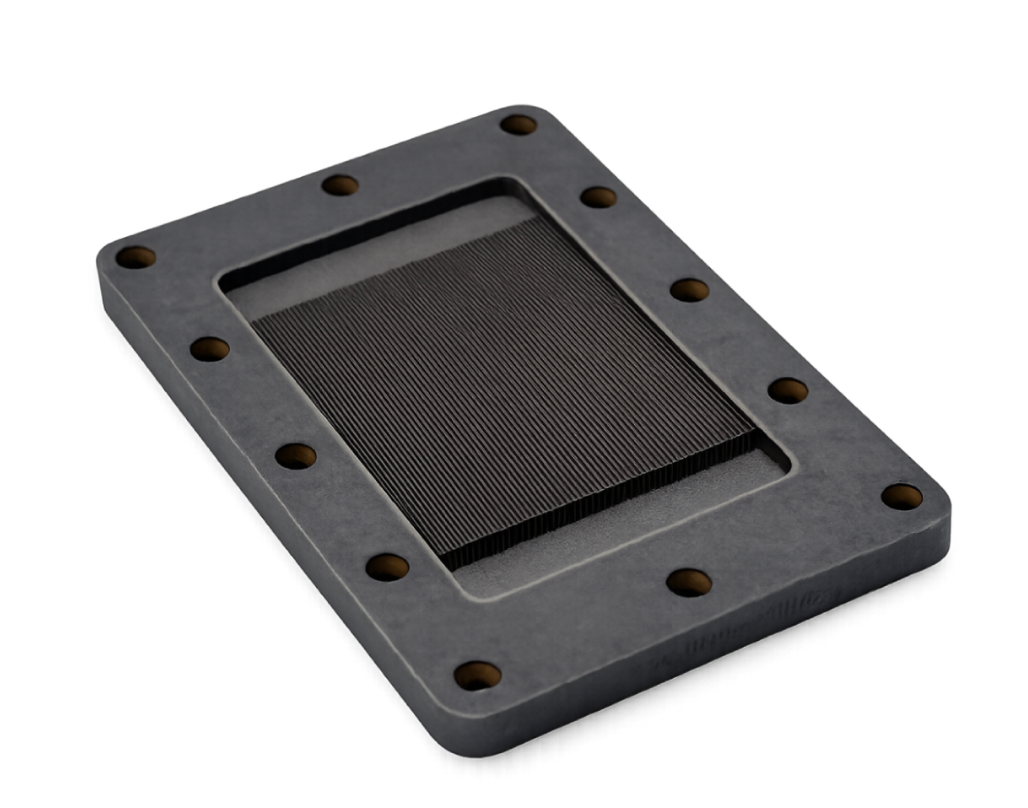

Coherent Thermadite 800 — водоблок из карбида кремния с алмазом

Компания Coherent, известная больше в оптическом и полупроводниковом сегменте, анонсировала охлаждающие пластины Thermadite 800 Liquid Cold Plates для жидкостного охлаждения AI-ускорителей. Звучит как не самый очевидный продукт от неочевидной компании, но технически здесь есть, на что посмотреть.

Материал Thermadite — это реакционно-связанный карбид кремния (RB-SiC) с добавкой алмаза в матрицу SiC. Алмаз — рекордсмен по теплопроводности среди существующих материалов, так что его включение в SiC-матрицу дает итоговый показатель 800 Вт/м·К. Медь — около 400 Вт/м·К, то есть есть разница действительно вдвое. При этом плотность Thermadite 800 примерно на 60% ниже, чем у меди — иными словами, водоблок будет значительно легче при тех же размерах.

Внутри — микроканальная архитектура, адаптированная под конкретные чипы. Это значит, что каналы оптимизированы не универсально, а под тепловую карту конкретного GPU или ускорителя, что снижает расход охлаждающей жидкости и эффективнее отводит тепло именно из горячих зон. Заявленный результат – снижение температуры чипа более чем на 15°C по сравнению с медными аналогами.

Для рынка AI-ускорителей, где TDP флагманских GPU уже давно впечатляет и продолжает расти, каждый градус на кристалле — это либо запас для буста, либо сохранность оборудования. Thermadite 800 — нишевый, но интересный ответ на этот вызов. Будем следить за технологией.

ZutaCore OmniTherm — двухфазный водоблок для NVIDIA RTX Pro 6000 Blackwell

ZutaCore представила водоблок OmniTherm для NVIDIA RTX Pro 6000 Blackwell Server Edition. Фишка: безводное двухфазное охлаждение — диэлектрическая жидкость кипит прямо на чипе, пар конденсируется в отдельном контуре и цикл повторяется. Воды нет, протечек тоже.

Технические характеристики

-

Совместимость: NVIDIA RTX Pro 6000 Blackwell Server Edition.

-

Технология: двухфазное безводное жидкостное охлаждение.

-

Теплоноситель: диэлектрическая жидкость (кипит при контакте с чипом).

-

Конструкция: герметичная, пар конденсируется в отдельном контуре.

-

Цель: повышение плотности монтажа AI-карт в серверах.

Двухфазное охлаждение без воды — звучит как кофеварка, но работает как тепловой насос. Диэлектрическая жидкость не проводит ток, а значит, даже при гипотетической протечке ничего не замкнет. Главная ценность — плотность: если каждая карта охлаждается эффективнее, можно разместить их в стойку больше.

Для RTX Pro 6000 Blackwell это особенно актуально, ведь чипы с высоким TDP, потребляют много рерсурсов воздушного охлаждения. ZutaCore не первый на этом рынке, но заточка под конкретный GPU — новый ход: OEM-производителям не нужно придумывать крепления самим. При этом GPU выбран корректно, у него отличное соотношение цены и производительности, большой объем памяти (96 ГБ). Мы в Selectel успешно используем такие GPU, но с традиционным воздушным охлаждением.

Что думаете по поводу новинок? Делитесь мыслями в комментариях.

Автор: skovalev