…И при этом демонстрирует двойные стандарты

Anthropic, компания, известная своей жесткой позицией по отношению к Китаю, и один из тех игроков, кто массово использовал данные из открытых источников для обучения своих моделей, теперь обвиняет другие ИИ-лаборатории в краже своих разработок. Такое нарочно не придумаешь.

И хотя это подтверждает мои подозрения о том, как Китаю удалось сократить отставание, несмотря на гораздо меньшие ресурсы, это также обнажает «несуществующий» технологический ров, который США имеют перед Китаем.

В этой статье мы разберем основы дистилляции – ключа к прогрессу ИИ и «уловки» Китая, позволяющей не отставать, – а также раскроем реальные намерения Anthropic, которые далеки от благородных.

В очередной раз в сфере ИИ все не так, как кажется, и текущая проблема не имеет ничего общего с самим искусственным интеллектом.

Двойные стандарты во всей красе

Anthropic опубликовала резкое заявление, обвинив три ведущие китайские лаборатории – DeepSeek, Minimax и Moonshot – в «дистилляции» ответов Claude для обучения собственных ИИ-моделей.

Одна из компаний, построившая весь свой бизнес на использовании чужих данных, получившая за это многомиллиардные иски, возмущена тем, что кто-то другой делает с ней то же самое. Какая смелость.

Но вместо того, чтобы просто указывать на очевидные двойные стандарты во всем этом, позвольте мне объяснить, что произошло на самом деле, как это было сделано, и какова истинная причина негодования Anthropic: это не имеет ничего общего с самим обвинением и напрямую связано с их собственным выживанием.

Но в чем заключается официальное обвинение?

Обучение через имитацию чужой работы

Вкратце, Anthropic сообщает об обнаружении кампаний по дистилляции «промышленного масштаба», приписываемых этим китайским ИИ-лабораториям, нацеленных на извлечение ответов Claude для обучения или улучшения их собственных моделей.

По словам Anthropic, на счету этой тройки более 16 миллионов взаимодействий с Claude, сгенерированных через примерно 24 000 мошеннических аккаунтов, использующих прокси для обхода региональных ограничений и обнаружения.

Но что именно «украла» каждая лаборатория?

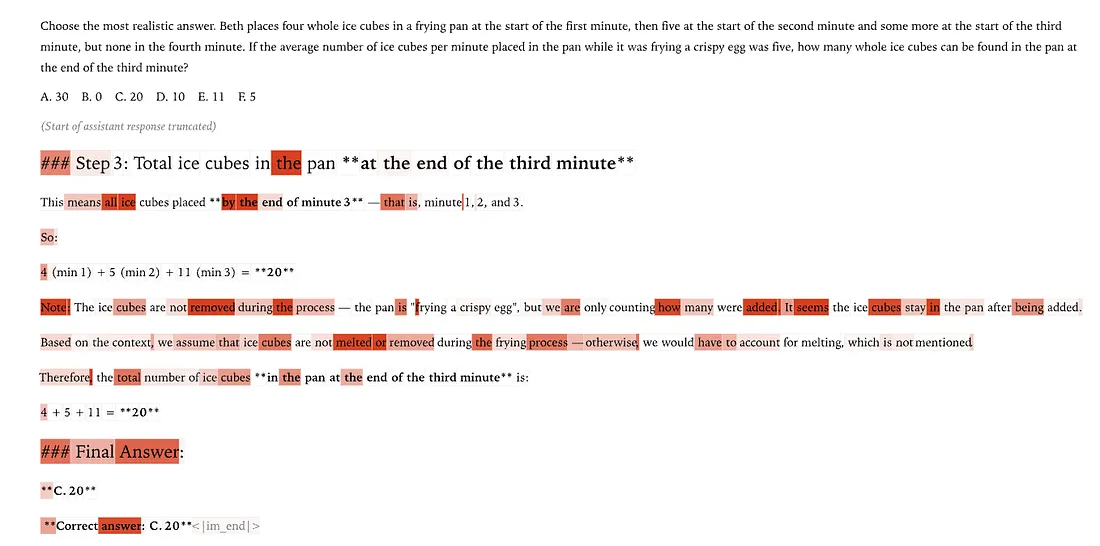

В случае с DeepSeek Anthropic сообщает о меньшей по объему кампании – более 150 000 взаимодействий. Запросы были сосредоточены на дистилляции широких задач рассуждения, оценке на основе рубрик и генерации «безопасных от цензуры» альтернатив политически чувствительным запросам, где Claude фактически служил моделью вознаграждения для обучения с подкреплением (подробнее о том, что это значит, позже).

Для Moonshot AI (создателей известной модели Kimi) Anthropic сообщает о более чем 3,4 миллионах взаимодействий. Активность была нацелена на: агентное рассуждение и использование инструментов, кодинг и анализ данных, разработку агентов для использования компьютера и компьютерное зрение.

Для MiniMax Anthropic сообщает о крупнейшей кампании – более 13 миллионов взаимодействий, самой масштабной из трех, с фокусом на агентный кодинг, а также использование инструментов и оркестрацию.

Но главный вопрос здесь: что на самом деле делали эти лаборатории?

Давайте объясним, что такое дистилляция и как она стала столь жизненно важной для Китая (а также для США, но в другом ключе).

Обучение через дистилляцию. Что это такое и как это делается?

Ключевое слово во всем этом – концепция под названием дистилляция. Давайте добросовестно объясним, что это такое, потому что вопреки мнению многих, включая так называемых экспертов, существует множество ее видов.

Большие языковые модели (LLM), такие как ChatGPT, учатся двумя способами: имитация и подкрепление.

-

Имитация, как следует из названия, заключается в том, что ИИ слово в слово копирует определенный текст. Обычно это называется либо предобучением (pretraining), когда модель обучается на огромных объемах общих данных, либо контролируемым дообучением (SFT), когда исследователи модифицируют поведение модели в определенном направлении, используя специально подобранные наборы данных.

-

Подкрепление, как следует из названия, заключается в том, что ИИ пробует разные варианты, и те действия или решения, которые привели к хорошим результатам, подкрепляются. Этот режим обучения называется обучением с подкреплением (Reinforcement Learning, или RL).

Обычно сигнал исходит от человеческих данных, например, когда ChatGPT имитирует стиль письма Шекспира.

Но иногда обучение происходит от других ИИ. Именно это мы называем дистилляцией, потому что модель «дистиллирует» знания и навыки от другого ИИ (обычно более «умного»). Здесь мы должны разделить дистилляцию на два фронта: мягкую и жесткую (soft and hard distillation).

Жесткая дистилляция широко используется в ИИ-лабораториях для снижения затрат на инференс (вывод). Как? Они обучают очень большую, а следовательно, мощную модель, которую слишком дорого рентабельно предоставлять пользователям, и используют ее в качестве «учителя» для меньших моделей, которые учатся «вести себя» как учитель и могут предоставляться с прибылью.

Вопреки мнению многих, инференс ИИ прибылен; на самом деле, весьма прибылен. То, что заставляет эти ИИ-лаборатории терять деньги, – это операционные расходы (зарплаты, опционы на акции и вычисления для НИОКР).

Это очень дорогое обучение, потому что для каждого предсказания не только нужно оценить вероятность, которую «ученик» присвоил правильному ответу, но и вероятности всех остальных возможных вариантов. И это для двух моделей одновременно.

То есть, для каждого возможного следующего слова (по сути, всего словаря LLM) мы должны оценить ответы как ученика, так и учителя для каждого слова.

Почему? Просто потому, что жесткая дистилляция не только увеличивает вероятность того, что ученик выберет тот же лучший ответ, что и учитель, но и заставляет имитировать все распределение вероятностей учителя.

Проблема с жесткой дистилляцией в том, что и учитель, и ученик должны иметь общий словарь, и это крайне дорого, что делает ее оправданной только тогда, когда вы хотите обучить маленьких учеников, которые «ведут себя» во многом как большие, и сэкономить на затратах на инференс.

Здесь эта жесткая дистилляция основана исключительно на имитации; ученик учится подражать учителю.

Но есть и другой способ сделать это, который блестящие ребята из Thinking Machine Labs подробно описали в своем блоге.

Идея здесь в том, чтобы позволить ученику пробовать разные варианты, а учителю – проверять их. Ключевое отличие в том, что здесь ученик активно предлагает идеи, которые затем верифицирует учитель, тогда как в предыдущем примере ученик просто копировал то, что делал учитель.

Очевидно, это лучший выбор, если вы хотите обучить сильных учеников, но он также и более дорогой, потому что может потребоваться больше времени для сходимости. Подумайте об этом в человеческих терминах:

Что лучше для обучения ребенка: просто заставить его зубрить и копировать предложения, которые учитель пишет на доске, или позволить ему пробовать самому, а учителю – исправлять? Последнее, очевидно, стимулирует детей активно пытаться решать проблемы, а не просто копировать их.

С другой стороны, дети «глупее» и им потребуется гораздо больше попыток, чтобы прийти к решению, чем если бы учитель просто дал его им. Это означает больше времени и попыток на каждый правильный ответ, что означает большие затраты.

Но что на самом деле делали китайские лаборатории? Ответ: ни то, ни другое.

LLM в качестве судьи

Меня часто спрашивают, как Китаю удается не отставать от прогресса США, несмотря на значительную нехватку вычислительных мощностей.

И мой ответ всегда был: дистилляция, но не тот тип, который я обсуждал выше.

Вместо этого она осуществляется двумя способами: SFT и LLM-как-судья по рубрикам (LLM-as-a-judge on rubrics), оба из которых являются методами мягкой дистилляции.

Первый – это просто буквальная имитация: заставить ваши модели задавать Claude кучу сложных вопросов и заставлять их буквально копировать то, что сказал Claude. Слово в слово.

Важно отметить, что это не жесткая имитация, потому что мы не запускаем активно и ученика, и учителя на задаче и не сравниваем; мы генерируем ответы от учителя и просто говорим ученику: «имитируй».

С другой стороны, LLM-как-судья по рубрикам гораздо интереснее и, вполне возможно, является главной причиной, по которой китайские лаборатории пошли на такие крайности, чтобы использовать модели Anthropic.

Вспомните, что другой способ обучения ИИ, помимо имитации, – это подкрепление. Проблема с этим методом в том, что, поскольку мы не держим модель «за руку» на протяжении всего набора предсказаний, а вместо этого позволяем ей пробовать, нам нужен способ измерить, насколько хорошо модель справилась, и подкрепить хорошее поведение/решения.

Для таких задач, как математика, это тривиально, потому что вам просто нужно проверить, правильно ли ответила модель.

Но как быть с задачами, которые нельзя верифицировать автоматически?

Когда задача не поддается автоматической верификации, один из распространенных вариантов – использовать другие ИИ в качестве проверяющих.

Другими словами, они давали Claude проблему, предложенный ответ ученика и шаблон рубрики, и просили Claude оценить результат, используя указанную рубрику.

Именно на этот тип обучения ссылалась Anthropic.

Важно отметить, что это позволяет проводить дистилляцию в рамках парадигмы RL, масштабируя RL на области, которые трудно верифицировать, и даже выявлять тонкие ошибки в верифицируемых задачах, таких как кодинг, в больших масштабах.

Кстати, пока гиганты судятся из-за того, кто чьи данные использует для обучения, обычным разработчикам и бизнесу нужен просто надежный доступ к лучшим моделям для решения своих задач.

Сервисы вроде BotHub дают возможность использовать передовые ИИ в одном окне. Вы можете сами сравнивать их ответы или использовать одну модель для проверки другой – легально и удобно.

Для доступа не требуется VPN, можно использовать российскую карту.

По ссылке вы можете получить 300 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Но действительно ли это истинная причина претензий Anthropic? На самом деле, нет. Это просто предлог для продвижения определенной повестки: запрета открытого исходного кода (open-source).

Запрет Open-Source

Истинная причина действий Anthropic не имеет ничего общего с тем, что конкурент обучается на их данных, что происходит постоянно.

Дело не в том, что происходит, а в том, кто это делает.

Anthropic известна своей (публичной) позицией против двух вещей:

-

Open-source. Они не считают, что исследования и продукты ИИ должны быть публичными или доступными для всех, и что некоторые «избранные» (намек: они сами) должны контролировать и диктовать распространение ИИ. Они демонстрируют уверенность в том, что только они и еще несколько компаний должны решать, как лучше всего использовать ИИ на благо мира.

-

Китай. Они очень активно выступают за пресечение любых возможностей прогресса Китая в области ИИ. Это не первая и не последняя попытка продавить антикитайские регуляции. Не так давно они даже зашли так далеко, что назвали Китай враждебным государством.

Но давайте будем реалистами, есть и экономическая причина. У Anthropic нет той огромной дистрибуции (способа охвата пользователей), которая есть у их конкурентов:

-

У OpenAI есть бренд ChatGPT с почти миллиардом активных пользователей.

-

У Google есть Chrome, Google Workspace и сотня других способов дать свои модели Gemini в руки клиентов.

-

У xAI более 400 миллионов пользователей в X и сильный внутренний спрос во всей империи Илона Маска.

И хотя у Anthropic есть некоторая сила дистрибуции через продуктовую линейку Amazon, она не может конкурировать с остальными исключительно за счет сил дистрибуции, что вынуждает ее нацеливаться на гораздо меньшую, но более прибыльную потребительскую базу.

Вот почему они нацелились на кодинг и агентов: пользователи этих сценариев – разработчики программного обеспечения и, в более широком смысле, предприятия, которые гораздо богаче среднего клиента ChatGPT.

Это позволяет Anthropic устанавливать премиальную цену на свои модели по сравнению с конкурентами.

И, конечно же, вся эта бизнес-модель зависит от того, чтобы не быть вынужденными снижать цены из-за коммодитизации (обесценивания) технологий… что именно и делают китайские модели.

Предлагая 90% производительности за 20% цены – или даже бесплатно! – они, безусловно, являются самым большим риском для Anthropic.

Более того, Китай делает это не случайно; это часть его общей ИИ-стратегии в продолжающейся «ИИ-войне» с США. Если США затрудняют им покупку компьютеров, они наносят ответный удар, коммодитизируя американские модели и заставляя их снижать цены, даже когда их узкая маржа предполагала бы обратное.

Учитывая все обстоятельства, легко разглядеть замаскированные намерения Anthropic.

Под их алармистскими взглядами на то, что ИИ слишком силен и может погубить нас всех (то есть, пожалуйста, запретите любые попытки создания ИИ, кроме наших), в сочетании с их антикитайским нарративом, то, что они пытаются сделать, имеет мало общего со спасением человечества, а скорее направлено на то, чтобы вынудить правительство США возвести регуляторную стену вокруг Anthropic и нескольких избранных, и тем самым обезопасить свое собственное, не самое простое будущее.

Как?

Потенциальный запрет на открытый исходный код, будь то модели из Китая или Кюрасао, дал бы этим компаниям свободу действий для повышения цен и заставил бы всех использовать их модели по желаемой ими цене, создав беспрецедентный бум неравенства.

Иными словами, они, предположительно, намерены спасти мир, совершив нечто, что сильно ограничивает свободу выбора: запретить свободную конкуренцию.

Подумайте об этом: с каких пор запрет всем, кроме нескольких компаний, создавать что-либо защищал потребителей?

И все это потому, что несколько заинтересованных руководителей в Кремниевой долине опасаются, что то же самое, что они, по иронии судьбы, строят сами, может погубить человечество? Тогда зачем это строить?

Конечно, речь никогда не шла о спасении людей. Правда в том, что Anthropic и другие американские компании с частными оценками в сотни миллиардов не имеют никакого значимого технологического рва. У них просто много денег и GPU.

И пока Китай продолжает выпускать передовые ИИ-модели, у этих компаний не будет сверхприбыльного бизнеса.

Так позвольте спросить вас, дорогой читатель: должны ли американские лаборатории вроде Anthropic добиться своего и заставить всех нас использовать их технологии, ограничив свободу ради них самих и их частных инвесторов, или же мы должны позволить ИИ идти своим чередом, как любой другой широко распространенной технологии в истории, как кумулятивному усилию исследователей со всего мира?

Иными словами, что с большей вероятностью принесет распределенные блага: ИИ, который является публичным и цены на который снижаются, становясь почти бесплатным, или тот, который закрыт и контролируется несколькими магнатами в Кремниевой долине, утверждающими, что только они могут создать ИИ, который не уничтожит человечество?

Разве здесь есть над чем думать?

Автор: cognitronn