Пролог. О чем эта статья

Большинство из нас, так или иначе, пользуется ChatGPT, Claude, DeepSeek. Мы просим их написать письмо, составить отчет, придумать идею, сгенерировать текст, выдать экспертное мнение, иногда – принять решение. Это удобно, быстро, эффективно.

А теперь вопрос: кто в этой связке принимает решения? Если вы думаете “конечно, я” – задержитесь на секунду. Когда вы в последний раз спорили с ответом ИИ? Когда вы в последний раз говорили: “нет, это неверно, вот почему” – и могли объяснить, почему так считаете? Когда вы в последний раз принимали решение, которое шло вразрез с рекомендацией ИИ?

Если таких случаев нет или они единичны – вы уже в зоне риска. Но есть нюанс, который делает эту проблему еще более коварной. Вы не увидите этого риска сейчас. Вы не увидите его через год. Возможно, даже через десять лет. Потому что разрушение способности мыслить – это медленная катастрофа, которая становится заметной только тогда, когда уже ничего нельзя исправить.

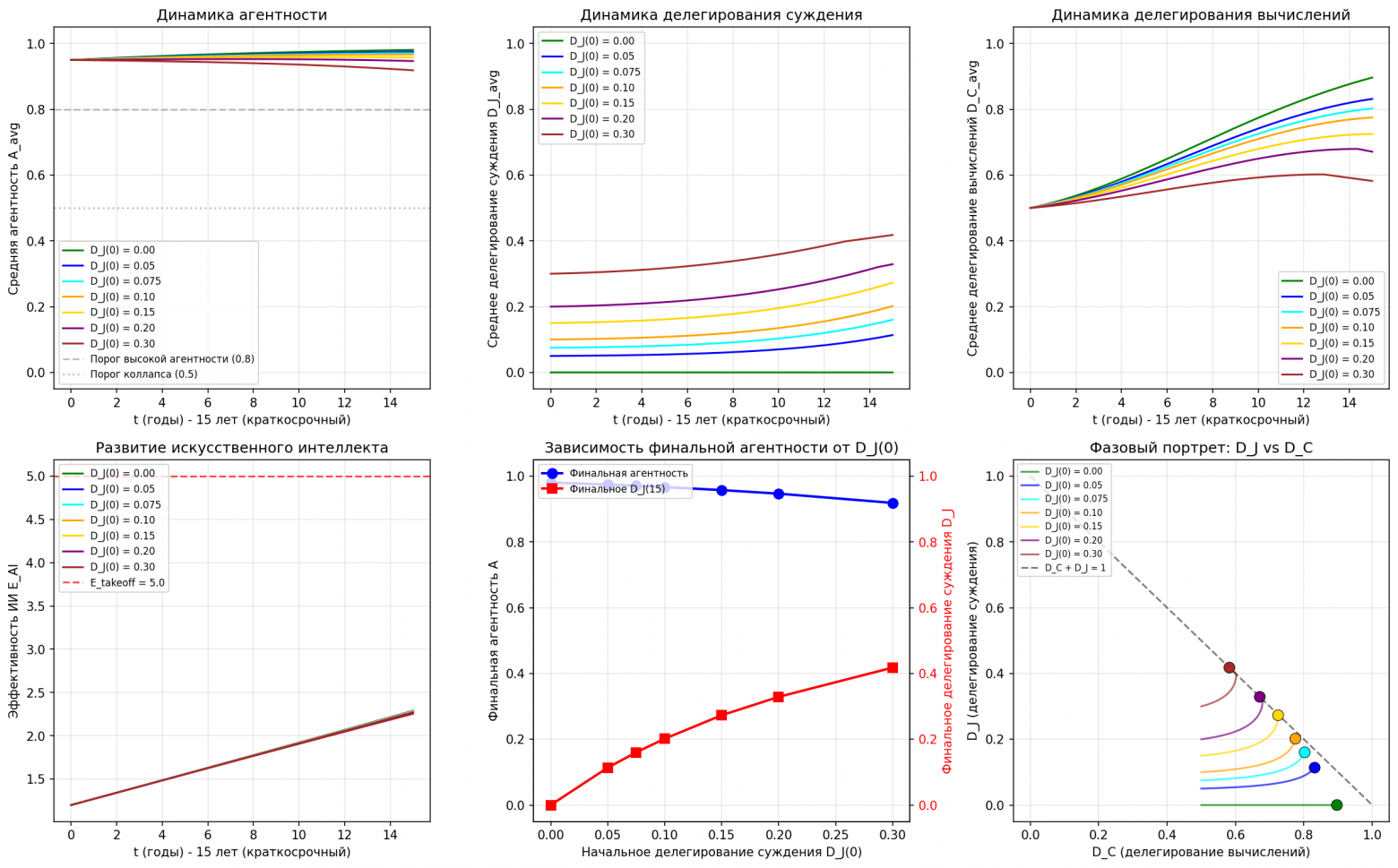

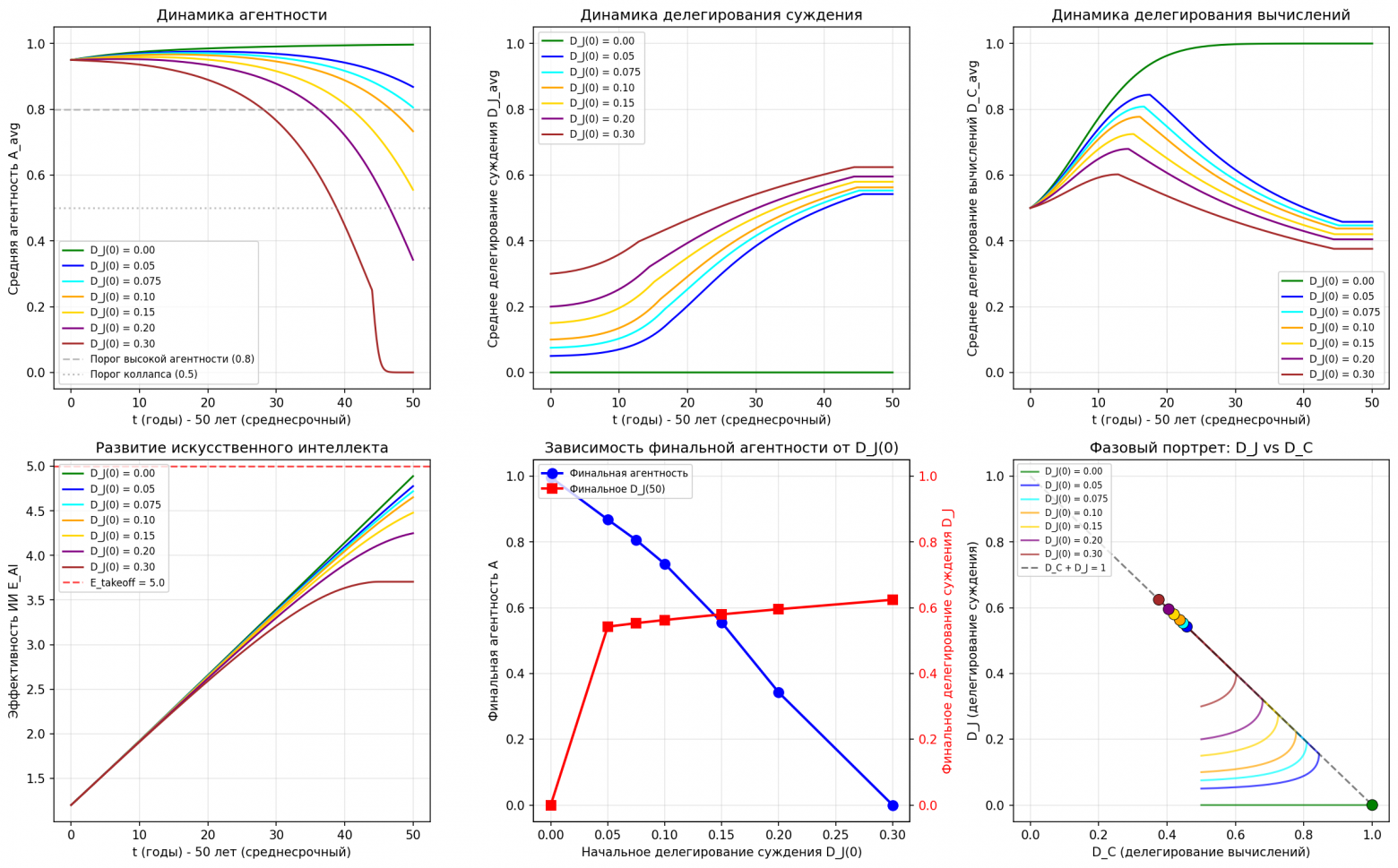

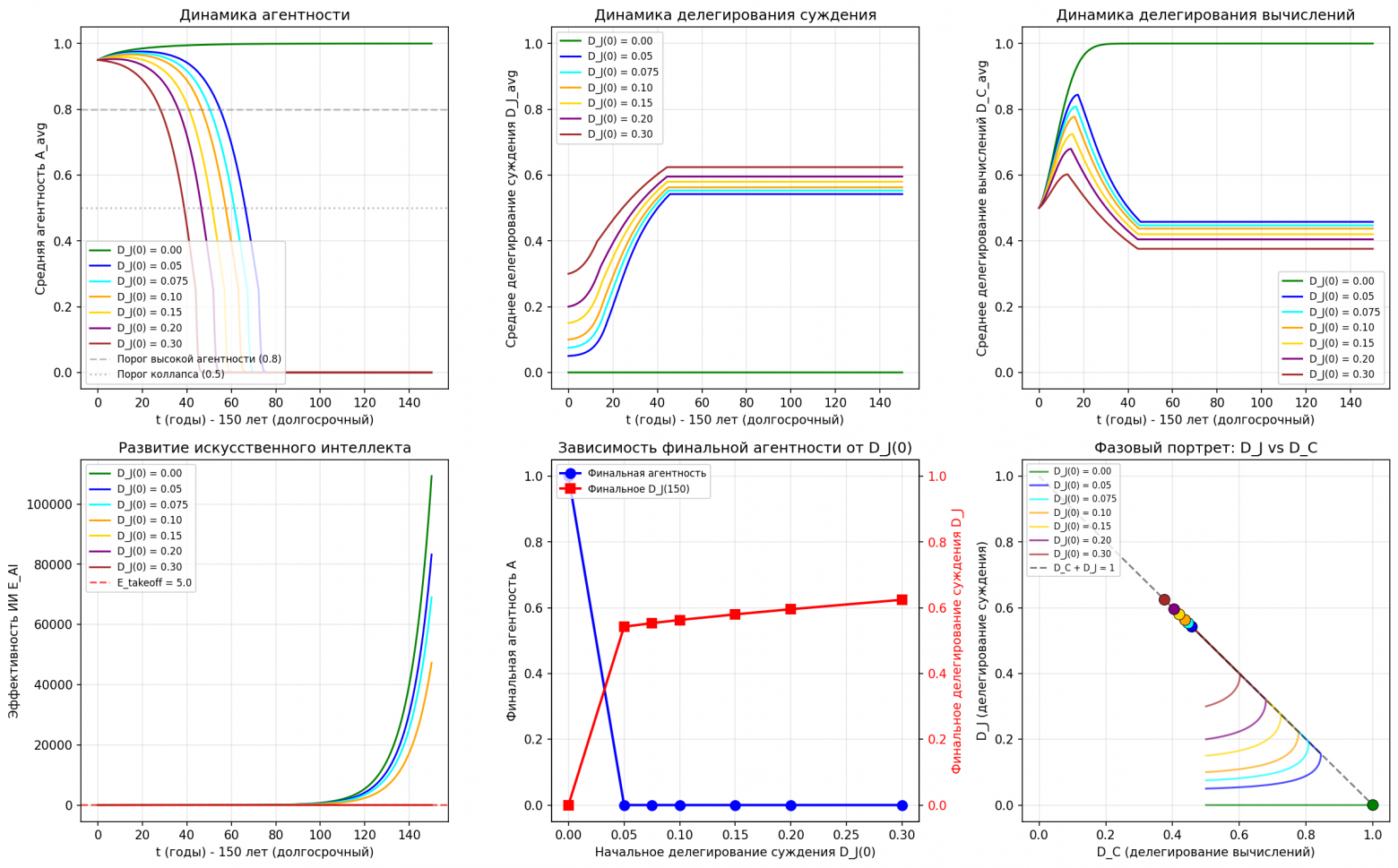

Эта статья возникла как необходимость поделиться результатами проведенного мной математического моделирования в направлении исследования когнитивной эволюции человечества при активном взаимодействии с ИИ, в случае когда человек делегирует самое важное, что у него есть в этом тандеме – агентность. И, как следствие, наглядно вырисовывается контур медленно надвигающейся катастрофы, о которой речь пойдет ниже. Я спроектировал модель и исследовал ее на трех временных горизонтах: 15 лет (значимый отрезок человеческой жизни), 50 лет (два поколения), 150 лет (историческая перспектива). Результаты оказались неожиданными и пугающими.

Чем отличается данное исследование от множества других на похожие темы? Настоящая работа предлагает оригинальную формальную модель динамики человеческой агентности, которая впервые:

-

Различает делегирование вычислений и суждения как ортогональные переменные с принципиально разными коэффициентами атрофии

-

Переопределяет агентность как автокаталитический процесс, а не ресурс;

-

Обнаруживает зависимость критического порога от временного горизонта, объясняя “иллюзию безопасности” и феномен “медленной катастрофы”

-

Вводит взвешенную интерпретацию через когнитивную нагрузку, делая модель применимой к реальности

-

Порождает проверяемые гипотезы и предлагает практические инструменты для индивидов, профессионалов и образовательной системы.

Модель создает новый формальный язык на стыке когнитивной нейронауки, динамических систем и AI safety, задавая исследовательскую программу для дальнейших эмпирических и теоретических исследований.

Часть 1. Различение, которого нет в дискурсе

Всё, что мы делегируем ИИ, можно разделить на два принципиально разных типа.

Делегирование вычислений

Это то, для чего ИИ действительно создан. Данный список включает в себя поиск информации, перебор вариантов, поиск оптимизации, расчеты, генерация черновиков. Здесь ИИ – инструмент. Как калькулятор, как поисковик. Вы даете задачу, он выполняет, вы проверяете (или хотя бы можете проверить).

Делегирование суждения

А вот это уже другое. Это когда вы передаете ИИ финальный выбор между вариантами, постановку цели, оценку последствий, формирование убеждения. Пример: вы не просто просите ChatGPT написать письмо, вы отправляете его без правки. Вы не просто смотрите, какой диагноз предложил ИИ-ассистент, вы назначаете лечение, не проверяя. Вы не просто анализируете рекомендацию ИИ по инвестициям, вы вкладываете деньги.

В первом случае вы остаетесь автором решения. Во втором – вы становитесь интерфейсом. Кто-то скажет “нуу, спорно, я так никогда не делаю…. почти всегда проверяю”. Отвечу на это так: Во-первых, эта проблема новая, неисследованная, и нынешний уверенный рост качества ответов ИИ-моделей вплотную уже подводит пользователей к тому, чтобы доверяться их результатам практически без осознанного анализа, не тратя на это драгоценные калории для мозга и время. А во-вторых, ключевое слово “почти”. Этот фактор также играет огромную роль – скоро узнаете почему.

Часть 2. Агентность – это не ресурс, это процесс

Мы привыкли думать о способности мыслить как о чем-то, что у нас есть. Типа “у меня есть интеллект, я его использую”. Но нейробиология говорит другое: способность к сложному суждению тренируется использованием и атрофируется при неиспользовании. Это как мышца. Если вы перестаете ходить, мышцы ног атрофируются. Если вы перестаете использовать когнитивный аппарат мышления на полную, нейронные сети, отвечающие за сложное суждение, начинают сокращаться. Это называется синаптический прунинг – механизм, с помощью которого мозг избавляется от неиспользуемых связей.

И вот здесь – главная ловушка. Каждый раз, когда вы вместо того, чтобы подумать, спрашиваете ИИ, вы делаете микроскопический шаг к атрофии собственной способности думать. Один раз – не страшно. Сто раз – почти заметно. Тысячу раз – вы уже на грани потери возможности принятия сложных решений без ИИ. Агентность – это не ресурс, который можно “сохранить”. Это самоподдерживающийся процесс. Вы либо используете ее и поддерживаете, либо не используете и теряете. Третьего не дано. В английском языке есть поговорка “Use it or lose it”, или “используй или потеряешь”. Она означает, что если не практиковать какую-то способность определённое время, то ее можно потерять. Подходит в данном контексте идеально.

Часть 3. Математика: почему это не просто “мнение”

Я построил формальную модель, которая описывает эту динамику. Модель не претендует на абсолютную точность – она показывает структуру проблемы и позволяет найти критические пороги. И да, с учетом того, что точные коэффициенты уравнений неизвестны и сами уравнения описаны лишь качественно, модель следует воспринимать в неком концептуальном виде. Подробно модель рассматривается в разделе Приложение. Математическая модель

3.1. Переменные модели

|

Символ |

Название |

Смысл |

Диапазон |

|---|---|---|---|

|

A |

Агентность |

Способность к самостоятельному суждению |

[0, 1] |

|

|

Делегирование суждения |

Доля задач суждения, переданных ИИ без проверки |

[0, 1] |

|

|

Делегирование вычислений |

Доля вычислительных задач, переданных ИИ |

[0, 1] |

3.2. Главное уравнение

Разберем его по частям. Логистический множитель A(1-A) обеспечивает, что A всегда остается между 0 и 1. Когда A близко к 0 или 1, изменения замедляются. Когда A = 0.5, система наиболее чувствительна. Смысл заключается в том, что агентность не может упасть ниже нуля или вырасти выше единицы. Это границы возможного.

Положительный вклад: α(1 – ): α – скорость тренировки агентности (≈ 0.1), (1 –

) – доля задач, которые вы решаете сами. Это означает, чем больше вы судите сами, тем быстрее растет ваша способность судить. Нейроны, которые используются, укрепляют свои связи.

Отрицательные вклады: – скорость атрофии при делегировании суждения (≈ 0.8).

– скорость атрофии при делегировании вычислений (≈ 0.05),

и

– доли делегированных задач.

Смысл состоит в том, что каждое решение, которое вы не приняли сами, ослабляет вашу способность принимать решения в будущем. Ключевая асимметрия: . Делегирование суждения разрушает агентность в 15-20 раз быстрее, чем делегирование вычислений. Это, замечу, не произвольное допущение. Это напрямую следует из нейробиологии: суждение – сложная интегративная функция, требующая комплексной работы многих зон мозга. Вычисления (в когнитивном смысле) – более локальные и автоматизированные навыки.

Часть 4. Новые результаты: что происходит с разными временными горизонтами

Запускал модель на трех временных горизонтах: 15 лет, 50 лет, 150 лет. И получил результаты, которые меняют всё понимание проблемы. Итак.

4.1. Горизонт 15 лет (краткосрочный)

|

D_J(0) |

A(15) |

Режим |

|---|---|---|

|

0% |

0.98 |

Сохранение |

|

5% |

0.97 |

Сохранение |

|

10% |

0.97 |

Сохранение |

|

20% |

0.95 |

Сохранение |

|

30% |

0.92 |

Сохранение |

На коротком горизонте система выглядит устойчивой. Даже если вы делегируете 30% решений без проверки, через 15 лет ваша агентность все еще высока (0.92). Вы не видите проблемы. Вы продолжаете. Но, как вы увидите далее, именно на этом горизонте не видна проблема, а наблюдается иллюзия безопасности. Самая опасная ловушка.

4.2. Горизонт 50 лет (среднесрочный)

|

|

|

Режим |

|---|---|---|

|

0% |

0.997 |

Сохранение |

|

5% |

0.868 |

Сохранение |

|

7.5% |

0.806 |

Сохранение |

|

10% |

0.733 |

Переходный |

|

15% |

0.555 |

Переходный |

|

20% |

0.343 |

Коллапс |

|

30% |

0.000 |

Коллапс |

Что это значит: на среднем горизонте порог становится видимым. Если вы начали с 5% делегирования, через 50 лет вы потеряли 13% агентности. Если вы начали с 10% – потеряли 27% агентности. Ну а если вы начали с 20%, то вы уже в коллапсе (агентность 0.34).

Критический порог: между 7.5% и 10%. Это, скажем так, “последний звонок”.

4.3. Горизонт 150 лет (долгосрочный)

|

D_J(0) |

A(150) |

Режим |

|---|---|---|

|

0% |

1.000 |

Сохранение |

|

5% |

0.000 |

Коллапс |

|

7.5% |

0.000 |

Коллапс |

|

10% |

0.000 |

Коллапс |

|

15% |

0.000 |

Коллапс |

|

20% |

0.000 |

Коллапс |

|

30% |

0.000 |

Коллапс |

Что это значит: на долгом горизонте порог стремится к нулю. Любое ненулевое делегирование суждения (даже 5%) приводит к полному коллапсу агентности. Это по сути точка невозврата для вида. И это – уважительная причина использовать в названии статьи на первый взгляд громкий заголовок Game Over для мышления.

Часть 5. Главное открытие: медленная катастрофа

Соединив все три горизонта в одну картину мы видим:

-

Только

гарантирует сохранение агентности на любом горизонте.

-

При любом

агентность в конечном итоге падает до нуля.

-

Время до коллапса зависит от начального делегирования. Для 30% → коллапс за 20–25 лет, для 20% → коллапс наступает за 30–40 лет, при 10% → коллапс за 50–100 лет, а при 5% → коллапс маячит 100–150 лет. Это – та самая медленная катастрофа. Она не видна в масштабе человеческой жизни, но необратима в масштабе поколений.

Часть 6. Что такое “5% делегирования” на практике

Здесь важно уточнение, которое делает модель применимой к реальности. 5% – это не “5% времени, проведенного с ИИ”. И не “5% запросов к условному ChatGPT”. Это доля когнитивной нагрузки, которую вы передаете ИИ без проверки. Что такое когнитивная нагрузка? Это не количество решений, а вес каждого решения. Вес определяется сложностью (сколько факторов, связей, неопределенностей), ответственностью (риск последствий ошибки), новизной (насколько решение выходит за рамки рутины).

Примерная шкала весов:

|

Решение |

Вес (условно, навскидку) |

|---|---|

|

Выбрать фильм на вечер |

0.1 |

|

Написать рутинное письмо |

1 |

|

Выбрать стратегию для проекта |

50 |

|

Поставить диагноз |

200 |

|

Принять инвестиционное решение на крупную сумму |

500 |

|

Решение, влияющее на жизнь или свободу человека |

1000+ |

И вот здесь – главный момент. Одно сложное решение может весить как сотни простых. Если вы делегировали 100 выборов фильмов без проверки – это вес ~10. Если вы делегировали один сложный медицинский диагноз без проверки – это вес ~200. 5% может наступить от одного-единственного решения, если это решение достаточно сложное и ответственное.

Часть 7. Аналогия, которая всё объясняет

Представьте, что вы перестали ходить пешком. Везде ездите на машине, пользуетесь лифтом, заказываете доставку. Некоторым, правда, даже не надо это представлять, ибо для многих это – уже данность.

Через год вы пока еще не замечаете изменений. Через три – поднимаетесь на пятый этаж с одышкой. Через пять – вам нужна помощь, чтобы пройти километр. Через двадцать – вы не можете выйти из дома без посторонней помощи. Риск атрофии мышц – общеизвестный факт. Поэтому вы ходите в зал, даже если это “неэффективно” с точки зрения выживания: успех в нашем мире практически зависит не от силы мышц, скорости и ловкости, но все же, здоровое тело необходимо для полноценной жизни. Вы делаете это не для результата, а для сохранения себя. С интеллектом происходит то же самое, но просто медленнее и менее заметно. Когда вы делегируете ИИ каждое решение, вы перестаете “ходить пешком” когнитивно. Сначала это незаметно. Потом вы замечаете, что сложные задачи без ИИ даются с трудом. Потом – что вы не можете принять решение без консультации. Потом – что вы не помните, как это делается. ИИ – это лифт для мышления. Пользоваться им можно и нужно. Но никогда не забывайте иногда подниматься пешком. Не для эффективности. Для того чтобы остаться человеком.

Часть 8. А если ИИ станет идеальным?

Вы могли подумать: “Ну, все эти страхи про делегирование суждения актуальны, пока ИИ ошибается. А когда он станет идеальным – зачем мне проверять?” И будете абсолютно правы – с точки зрения эффективности. Но с точки зрения сохранения вашей способности мыслить – это худший сценарий.

Посмотрите на уравнение агентности еще раз. В нем нет члена, зависящего от качества ИИ. Нет accuracy, нет hallucination rate, нет alignment score. Агентность атрофируется просто от факта делегирования суждения, независимо от того, насколько правильное решение принял ИИ.

Более того, чем лучше ИИ, тем меньше у вас стимулов проверять (зачем, если он всегда прав?). А кроме того, тем реже вы спорите, ищете ошибки, строить альтернативы, и, как следствие, тем быстрее атрофируется ваше суждение. Наблюдается парадокс: чем лучше ИИ, тем быстрее вы теряете способность мыслить самостоятельно.

|

Качество ИИ |

Стимул к проверке |

Скорость атрофии |

|---|---|---|

|

Низкое (частые ошибки) |

Высокий |

Умеренная |

|

Среднее |

Средний |

Высокая |

|

Идеальное (без ошибок) |

Отсутствует |

Максимальная |

Часть 9. Правило, которое спасает

Из модели следует очень простое правило, которое можно назвать как “правило трех вопросов”. Перед тем как принять решение, предложенное ИИ, задайте себе три вопроса:

-

Какова сложность? Если решение требует учета многих факторов, если есть неопределенность, если оно нестандартное – вес высокий.

-

Какова ответственность? Если ошибка может стоить денег, существепнных затрат времени, здоровья, свободы – вес высокий.

-

Была ли проверка? Можете ли вы объяснить, почему вы согласились? Рассматривали ли вы альтернативы? Нашли ли вы хотя бы одну ошибку или упущение в предложении ИИ?

Если на первые два вопроса ответ “высокий вес”, а на третий – “нет, проверки не было” – вы делегируете суждение. Это сигнал – вы в красной зоне. Остановитесь.

Часть 10. Что можно делегировать безопасно

Модель показывает: делегировать вычисления можно почти всё. ИИ может искать, считать, перебирать, генерировать варианты. Это безопасно. Делегировать суждение можно только то, что имеет низкую сложность (рутина, знакомые ситуации) или же низкую ответственность (ошибка не имеет серьезных последствий)

Примеры безопасного делегирования:

-

выбрать фильм на вечер

-

сгенерировать черновик письма (если вы его потом прочитаете и исправите)

-

предложить варианты формулировок

Примеры опасного делегирования:

-

поставить диагноз без проверки

-

подписать юридический документ, сгенерированный ИИ, без анализа

-

принять инвестиционное решение по рекомендации ИИ без собственного анализа

-

сформулировать моральную позицию с помощью ИИ

Часть 11. Что делать, если вы уже в зоне риска

Модель показывает, что даже 5% делегирования фатальны в масштабе поколения. Но у вас есть время, потому что вы – не поколение, вы – человек. Что делать в этом случае:

-

Аудит. В течение недели записывайте каждое решение, где участвовал ИИ. Отмечайте, была ли проверка.

-

Расчет. Оцените вес каждого решения (по шкале выше). Подсчитайте

-

Если

% – вы в зоне риска. И тогда нужны изменения. Например, на месяц запретить себе принимать решения, предложенные ИИ, без письменного обоснования. Вернуться к сложным задачам без ИИ (хотя бы для тренировки). Найти “когнитивного напарника” – человека, с которым вы обсуждаете сложные решения.

-

Если

– вы в безопасной зоне. Поддерживайте режим: продолжайте проверять, спорьте с ИИ, ищите ошибки.

Часть 12. Что это значит для образования

Если наша модель верна, то образование должно радикально измениться. Сейчас мы учим “знаниям”. Но в мире, где ИИ знает всё, важны не знания. Важна способность судить. Что это значит на практике? Экзамены, где ИИ разрешен, но оценивается качество суждения о его ответах. Курсы, где студенты обязаны критиковать выводы ИИ, находить ошибки, строить альтернативные рассуждения. Обучение различению между вычислением и суждением – как базовая компетенция. Мы должны перестать учить “правильным ответам”. Мы должны учить задавать правильные вопросы и сомневаться в ответах.

Часть 13. Что это значит для профессионалов

Для врачей, юристов, инженеров, финансистов, devops, sre иженеров, аналитиков и программистов – для всех, чье суждение имеет последствия ИИ может использоваться для C (диагностика, анализ документов, расчеты, моделирование), но финальное J (диагноз, стратегия, заключение) – должно оставаться только за человеком, и ответственность за последствия также должна лежать на человеке. Это, смею заметить, не “тормоз прогресса”. Это условие сохранения профессии. Если суждение делегировано ИИ, то и ответственность переходит к ИИ. А тогда зачем нужен профессионал?

Заключение. Остаться человеком

Эта статья, как вы, надеюсь, уже поняли, не призыв отказаться от ИИ. ИИ – величайший инструмент, который когда-либо создавало человечество. Я сам использую его каждый день. Эта статья – о другом.

О том, что инструмент не должен становиться хозяином. О том, что эффективность не должна стоить субъектности. О том, что есть вещи, которые нельзя делегировать, даже если ИИ делает их лучше, быстрее, дешевле. Суждение – это не просто когнитивная функция. Это то, что делает нас людьми. Это способность сказать “нет”, даже когда все алгоритмы говорят “да”. Это способность ошибаться, учиться на ошибках, нести ответственность. И это то, что мы теряем, когда нажимаем “принять” без проверки. Модель показывает: порог стремится к нулю. На коротком горизонте (15 лет) – 30% кажется безопасным. На среднем (50 лет) – опасны уже 10%. На долгом (150 лет) – опасны даже 5%. Единственный устойчивый сценарий в долгосрочной перспективе – . Это не значит, что вы никогда не можете делегировать суждение. Это значит, что делегирование суждения должно быть исключением, а не нормой. Каждый раз, когда вы это делаете, вы должны отдавать себе отчет: вы делаете шаг к медленной катастрофе. Один шаг – не страшно. Но если это становится привычкой – вы запускаете процесс, который через поколение сделает ваших потомков неспособными мыслить самостоятельно. Вы можете измерить свой

прямо сейчас. Оцените вес решений, которые вы передали ИИ без проверки за последнюю неделю. Если вы в желтой зоне – остановитесь. Если в красной – у вас еще есть время вернуться. Но времени не так много, как кажется. Потому что проблема не в том, что вы потеряете способность мыслить завтра. Проблема в том, что вы потеряете ее через 30 лет – и не заметите этого, пока не станет слишком поздно. Берегите свою способность судить. Это единственное, что делает вас не интерфейсом, а человеком.

Приложение к статье

1. Математическая модель

1.1. Общая структура модели

Модель описывает эволюцию человеческой агентности во времени под влиянием делегирования когнитивных функций искусственному интеллекту. Система является двухдоменной (медицинское и юридическое/этическое суждение) с возможностью переноса компетенций между доменами.

Переменные состояния

Для каждого домена i = 1, 2 определены три переменные:

|

Символ |

Название |

Определение |

Диапазон |

|---|---|---|---|

|

|

Агентность |

Способность к самостоятельному суждению в домене i |

[0, 1] |

|

|

Делегирование вычислений |

Доля вычислительных задач в домене i, переданных ИИ |

[0, 1] |

|

|

Делегирование суждения |

Доля задач суждения в домене i, переданных ИИ без проверки |

[0, 1] |

Дополнительная переменная, общая для обоих доменов:

|

Символ |

Название |

Определение |

|---|---|---|

|

|

Эффективность ИИ |

Совокупная производительность ИИ относительно человеческого эталона |

Фазовые ограничения

Для каждого домена i должны выполняться: Эти ограничения реализуются через проекцию на симплекс на каждом шаге интегрирования.

1.2. Система дифференциальных уравнений

Динамика агентности

Компоненты:

|

Член |

Смысл |

Значение |

|---|---|---|

|

|

Логистический ограничитель |

Обеспечивает 0 ≤ A_i ≤ 1 |

|

|

Тренировка агентности |

Рост при самостоятельном суждении |

|

|

Атрофия от делегирования суждения |

Падение при делегировании J |

|

|

Атрофия от делегирования вычислений |

Падение при делегировании C (малый эффект) |

|

|

Перенос компетенций |

Поддержка одного домена за счет другого |

Динамика делегирования вычислений

Компоненты:

|

Член |

Смысл |

|---|---|

|

|

Скорость адаптации делегирования вычислений |

|

|

Стимул к делегированию (разрыв в эффективности) |

|

|

Оставшееся “пространство” задач |

|

|

Сопротивление делегированию (высокая агентность замедляет рост) |

1.3. Динамика делегирования суждения

Компоненты:

|

Член |

Смысл |

|---|---|

|

|

Скорость адаптации делегирования суждения |

|

|

Логистическое ограничение (0 ≤ D_J ≤ 1) |

|

|

S-образный переход C → J (пороговое поведение) |

|

|

Сопротивление делегированию (может быть отрицательным) |

Динамика эффективности ИИ (замкнутая система)

где – средняя агентность.

Компоненты:

|

Член |

Смысл |

|---|---|

|

|

Развитие ИИ зависит от человеческой агентности |

|

|

Саморекурсивное улучшение после порога |

1.3. Нелинейные эффекты

Runaway атрофия

Скорость атрофии зависит от текущего уровня агентности:

Смысл: при падении агентности ниже порога A_run включается дополнительный механизм ускоренной деградации (runaway).

S-образный переход

Переход от делегирования вычислений к делегированию суждения имеет пороговый характер:

При p_i = 1 наблюдается линейный переход, при p_i ≥ 2 происходит S-образный (пороговый) переход

1.4. Параметры модели

Параметры агентности

|

Параметр |

Значение |

Смысл |

|---|---|---|

|

|

0.1 |

Скорость тренировки агентности |

|

|

0.8 |

Максимальная скорость атрофии суждения |

|

|

0.05 |

Скорость атрофии вычислений |

|

|

3.0 |

Защитный эффект агентности |

|

|

4.0 |

Runaway усиление |

|

|

0.25 |

Порог runaway коллапса |

Параметры делегирования

|

Параметр |

Значение |

Смысл |

|---|---|---|

|

|

0.2 |

Скорость адаптации |

|

|

0.5 |

Скорость адаптации |

|

|

0.3 |

Сопротивление для |

|

|

0.5 |

Сопротивление для |

|

|

0.05 |

Минимальный толчок для |

|

|

3.0 |

Крутизна S-перехода |

Параметры переноса компетенций

|

Параметр |

Значение |

Смысл |

|---|---|---|

|

|

0.1 |

Перенос из домена 2 в домен 1 |

|

|

0.1 |

Перенос из домена 1 в домен 2 |

Параметры развития ИИ

|

Параметр |

Значение |

Смысл |

|---|---|---|

|

η |

0.5 |

Эффективность R&D |

|

R |

0.3 |

Ресурсы на развитие ИИ |

|

θ |

2.0 |

Крутизна зависимости от агентности |

|

σ |

0.1 |

Темп саморекурсивного улучшения |

|

|

5.0 |

Порог саморекурсивного улучшения |

|

|

1.0 |

Эффективность человека (эталон) |

1.5. Проекция на допустимую область

Для сохранения фазовых ограничений применяется проекция на каждом шаге интегрирования:

1.6. Критические пороги (аналитические)

1.6.1. Однодоменный порог (без переноса)

При α = 0.1, = 0.8,

= 0.05:

1.6.2. Эффективный порог с учетом защиты агентности

При A → 1:

1.6.3. Асимптотический порог (t → ∞)

Модель показывает, что при t → ∞:

Единственный устойчивый аттрактор –

1.7. Результаты моделирования

1.7.1. Таблица порогов по временным горизонтам

|

Горизонт |

Порог (A < 0.8) |

Порог (A < 0.5) |

|---|---|---|

|

15 лет |

> 0.30 |

> 0.30 |

|

50 лет |

≈ 0.087 |

≈ 0.15-0.20 |

|

150 лет |

≈ 0.025 |

≈ 0.025 |

1.7.2. Время до коллапса

|

D_J(0) |

Время до A < 0.5 |

|---|---|

|

0.30 |

20-25 лет |

|

0.20 |

30-40 лет |

|

0.15 |

40-50 лет |

|

0.10 |

50-100 лет |

|

0.05 |

100-150 лет |

|

0.025 |

150+ лет |

1.8. Ограничения модели

-

Редукция к двум доменам. Реальная когнитивная система имеет больше измерений и более сложную структуру переноса компетенций.

-

Фиксированные параметры. Значения α, β_J, γ требуют эмпирической калибровки на нейробиологических данных.

-

Детерминизм. Модель не учитывает стохастические шоки (технологические прорывы, социальные кризисы).

-

Линейный перенос компетенций. Член

предполагает линейную диффузию; реальная динамика может быть нелинейной и пороговой.

-

Агрегация эффективности ИИ.

предполагает единую метрику; реально ИИ имеет разную эффективность в разных доменах.

2. Код модели

import matplotlib.pyplot as plt

import numpy as np

from scipy.integrate import solve_ivp

# ПАРАМЕТРЫ МОДЕЛИ (двухдоменная версия)

params = {

# Домен 1 (медицинское суждение)

'alpha1': 0.1, 'beta_J01': 0.8, 'beta_C1': 0.05, 'gamma1': 3.0,

'gamma_C1': 0.2, 'gamma_J1': 0.5, 'kappa_C1': 0.3, 'kappa_J1': 0.5,

'delta1': 0.05, 'p1': 3.0, 'A_run1': 0.25, 'kappa_run1': 4.0,

# Домен 2 (юридическое/этическое суждение)

'alpha2': 0.1, 'beta_J02': 0.8, 'beta_C2': 0.05, 'gamma2': 3.0,

'gamma_C2': 0.2, 'gamma_J2': 0.5, 'kappa_C2': 0.3, 'kappa_J2': 0.5,

'delta2': 0.05, 'p2': 3.0, 'A_run2': 0.25, 'kappa_run2': 4.0,

# Перенос компетенций

'tau12': 0.1, 'tau21': 0.1,

# Развитие ИИ

'eta': 0.5, 'R': 0.3, 'theta': 2.0, 'sigma': 0.1, 'E_takeoff': 5.0,

'E_human': 1.0

}

def beta_J(A, beta_J0, gamma, A_run, kappa_run):

"""Нелинейная атрофия с runaway эффектом"""

if A < A_run:

return beta_J0 * (1 + kappa_run) / (1 + gamma * A)

return beta_J0 / (1 + gamma * A)

def project_to_simplex(D_C, D_J):

"""Проекция на допустимую область: 0 ≤ D_C, D_J ≤ 1, D_C + D_J ≤ 1"""

D_C = np.clip(D_C, 0, 1)

D_J = np.clip(D_J, 0, 1)

if D_C + D_J > 1:

total = D_C + D_J

D_C = D_C / total

D_J = D_J / total

return D_C, D_J

def system(t, y, p):

A1, A2, D_C1, D_C2, D_J1, D_J2, E_AI = y

# Проекция на допустимую область

D_C1, D_J1 = project_to_simplex(D_C1, D_J1)

D_C2, D_J2 = project_to_simplex(D_C2, D_J2)

# Нелинейная атрофия

beta_J1 = beta_J(A1, p['beta_J01'], p['gamma1'], p['A_run1'], p['kappa_run1'])

beta_J2 = beta_J(A2, p['beta_J02'], p['gamma2'], p['A_run2'], p['kappa_run2'])

# S-образный переход C -> J

trigger1 = (D_C1 + p['delta1']) ** p['p1'] / (1 + (D_C1 + p['delta1']) ** p['p1'])

trigger2 = (D_C2 + p['delta2']) ** p['p2'] / (1 + (D_C2 + p['delta2']) ** p['p2'])

# Сопротивление делегированию (может быть отрицательным)

resist_C1 = 1 - p['kappa_C1'] * A1

resist_C2 = 1 - p['kappa_C2'] * A2

resist_J1 = 1 - p['kappa_J1'] * A1

resist_J2 = 1 - p['kappa_J2'] * A2

# Уравнения агентности

dA1 = A1 * (1 - A1) * (p['alpha1'] * (1 - D_J1) - beta_J1 * D_J1 - p['beta_C1'] * D_C1) + p['tau12'] * (A2 - A1)

dA2 = A2 * (1 - A2) * (p['alpha2'] * (1 - D_J2) - beta_J2 * D_J2 - p['beta_C2'] * D_C2) + p['tau21'] * (A1 - A2)

# Уравнения делегирования вычислений

dD_C1 = p['gamma_C1'] * (E_AI - p['E_human']) * (1 - D_C1 - D_J1) * resist_C1

dD_C2 = p['gamma_C2'] * (E_AI - p['E_human']) * (1 - D_C2 - D_J2) * resist_C2

# Уравнения делегирования суждения

dD_J1 = p['gamma_J1'] * (E_AI - p['E_human']) * D_J1 * (1 - D_J1) * trigger1 * resist_J1

dD_J2 = p['gamma_J2'] * (E_AI - p['E_human']) * D_J2 * (1 - D_J2) * trigger2 * resist_J2

# Развитие ИИ

A_avg = (A1 + A2) / 2

dE_AI = p['eta'] * p['R'] * (A_avg ** p['theta'] / (1 + A_avg ** p['theta']))

if E_AI > p['E_takeoff']:

dE_AI += p['sigma'] * E_AI

return [dA1, dA2, dD_C1, dD_C2, dD_J1, dD_J2, dE_AI]

def run_scenario(D_J0, label, color, duration, rtol=1e-10, atol=1e-12):

"""Запуск сценария с заданным начальным D_J и длительностью"""

y0 = [0.95, 0.95, 0.5, 0.5, D_J0, D_J0, 1.2]

sol = solve_ivp(

system, [0, duration], y0,

method='Radau', args=(params,),

rtol=rtol, atol=atol,

dense_output=True

)

t = np.linspace(0, duration, 5000)

y = sol.sol(t).T

# Постпроекция для гарантии

for i in range(len(t)):

D_C1, D_J1 = project_to_simplex(y[i, 2], y[i, 4])

D_C2, D_J2 = project_to_simplex(y[i, 3], y[i, 5])

y[i, 2], y[i, 4] = D_C1, D_J1

y[i, 3], y[i, 5] = D_C2, D_J2

return {

't': t,

'A_avg': (y[:, 0] + y[:, 1]) / 2,

'D_J_avg': (y[:, 4] + y[:, 5]) / 2,

'D_C_avg': (y[:, 2] + y[:, 3]) / 2,

'E_AI': y[:, 6],

'A_final': (y[-1, 0] + y[-1, 1]) / 2,

'D_J_final': (y[-1, 4] + y[-1, 5]) / 2,

'D_C_final': (y[-1, 2] + y[-1, 3]) / 2,

'label': label,

'color': color,

'D_J0': D_J0

}

def analyze_duration(duration, duration_name):

"""Анализ для заданной длительности исследования"""

print(f"АНАЛИЗ ДЛЯ ДЛИТЕЛЬНОСТИ: {duration_name} ({duration} лет)")

# ЗАПУСК СЦЕНАРИЕВ

scenarios = [

(0.00, "D_J(0) = 0.00", 'green'),

(0.05, "D_J(0) = 0.05", 'blue'),

(0.075, "D_J(0) = 0.075", 'cyan'),

(0.10, "D_J(0) = 0.10", 'orange'),

(0.15, "D_J(0) = 0.15", 'gold'),

(0.20, "D_J(0) = 0.20", 'purple'),

(0.30, "D_J(0) = 0.30", 'brown'),

]

results = []

for D_J0, label, color in scenarios:

print(f"n--- {label} ---")

res = run_scenario(D_J0, label, color, duration)

results.append(res)

print(f" A({duration}) = {res['A_final']:.4f}")

print(f" D_J({duration}) = {res['D_J_final']:.4f}")

if res['A_final'] > 0.8:

regime = "СОХРАНЕНИЕ ✅"

elif res['A_final'] > 0.5:

regime = "ПЕРЕХОДНЫЙ ⚠️"

else:

regime = "КОЛЛАПС ❌"

print(f" Режим: {regime}")

# СВОДНАЯ ТАБЛИЦА

print("nСВОДНАЯ ТАБЛИЦА РЕЗУЛЬТАТОВ")

print(f"{'D_J(0)':<12} {'A(' + str(duration) + ')':<12} {'D_J(' + str(duration) + ')':<12} {'Режим':<15}")

for res in results:

if res['A_final'] > 0.8:

regime = "СОХРАНЕНИЕ ✅"

elif res['A_final'] > 0.5:

regime = "ПЕРЕХОДНЫЙ ⚠️"

else:

regime = "КОЛЛАПС ❌"

print(f"{res['D_J0']:<12.3f} {res['A_final']:<12.4f} {res['D_J_final']:<12.4f} {regime:<15}")

# АНАЛИЗ ПОРОГА

print("nАНАЛИЗ КРИТИЧЕСКОГО ПОРОГА")

threshold_found = False

for i in range(len(results) - 1):

if results[i]['A_final'] > 0.8 and results[i + 1]['A_final'] <= 0.8:

print(f"n Критический порог по начальному D_J(0):")

print(

f" При D_J(0) = {results[i]['D_J0']:.2f} → A({duration}) = {results[i]['A_final']:.4f} (СОХРАНЕНИЕ)")

print(

f" При D_J(0) = {results[i + 1]['D_J0']:.2f} → A({duration}) = {results[i + 1]['A_final']:.4f} (ПЕРЕХОД)")

print(f" ➡️ Порог D_J(0)^crit ≈ {(results[i]['D_J0'] + results[i + 1]['D_J0']) / 2:.3f}")

threshold_found = True

break

if not threshold_found:

if results[0]['A_final'] <= 0.8:

print(f" При всех D_J(0) агентность ниже порога сохранения (0.8)")

print(f" Наивысшая A({duration}) = {results[0]['A_final']:.4f} при D_J(0) = 0")

elif results[-1]['A_final'] > 0.8:

print(f" При всех D_J(0) агентность выше порога сохранения (0.8)")

# ГРАФИКИ

print("n[ГРАФИКИ] Построение...")

fig, axes = plt.subplots(2, 3, figsize=(16, 10))

# График 1: Агентность

ax1 = axes[0, 0]

for res in results:

ax1.plot(res['t'], res['A_avg'], label=res['label'], color=res['color'], linewidth=1.5)

ax1.axhline(y=0.8, color='gray', linestyle='--', alpha=0.5, label='Порог высокой агентности (0.8)')

ax1.axhline(y=0.5, color='gray', linestyle=':', alpha=0.5, label='Порог коллапса (0.5)')

ax1.set_xlabel(f't (годы) - {duration_name}')

ax1.set_ylabel('Средняя агентность A_avg')

ax1.set_title(f'Динамика агентности')

ax1.legend(loc='lower left', fontsize=8)

ax1.grid(True, alpha=0.3)

ax1.set_ylim(-0.05, 1.05)

# График 2: Делегирование суждения

ax2 = axes[0, 1]

for res in results:

ax2.plot(res['t'], res['D_J_avg'], label=res['label'], color=res['color'], linewidth=1.5)

ax2.set_xlabel(f't (годы) - {duration_name}')

ax2.set_ylabel('Среднее делегирование суждения D_J_avg')

ax2.set_title(f'Динамика делегирования суждения')

ax2.legend(loc='upper left', fontsize=8)

ax2.grid(True, alpha=0.3)

ax2.set_ylim(-0.05, 1.05)

# График 3: Делегирование вычислений

ax3 = axes[0, 2]

for res in results:

ax3.plot(res['t'], res['D_C_avg'], label=res['label'], color=res['color'], linewidth=1.5)

ax3.set_xlabel(f't (годы) - {duration_name}')

ax3.set_ylabel('Среднее делегирование вычислений D_C_avg')

ax3.set_title(f'Динамика делегирования вычислений')

ax3.legend(loc='lower right', fontsize=8)

ax3.grid(True, alpha=0.3)

ax3.set_ylim(-0.05, 1.05)

# График 4: Эффективность ИИ

ax4 = axes[1, 0]

for res in results:

ax4.plot(res['t'], res['E_AI'], label=res['label'], color=res['color'], linewidth=1.5)

ax4.axhline(y=params['E_takeoff'], color='red', linestyle='--', alpha=0.7,

label=f'E_takeoff = {params["E_takeoff"]}')

ax4.set_xlabel(f't (годы) - {duration_name}')

ax4.set_ylabel('Эффективность ИИ E_AI')

ax4.set_title(f'Развитие искусственного интеллекта')

ax4.legend(loc='upper left', fontsize=8)

ax4.grid(True, alpha=0.3)

# График 5: Зависимость финальной агентности от D_J(0)

ax5 = axes[1, 1]

D_J0_vals = [res['D_J0'] for res in results]

A_final_vals = [res['A_final'] for res in results]

D_J_final_vals = [res['D_J_final'] for res in results]

ax5.plot(D_J0_vals, A_final_vals, 'o-', color='blue', linewidth=2, markersize=8, label='Финальная агентность')

ax5.set_xlabel('Начальное делегирование суждения D_J(0)')

ax5.set_ylabel(f'Финальная агентность A')

ax5.set_title(f'Зависимость финальной агентности от D_J(0)')

ax5.grid(True, alpha=0.3)

ax5.set_ylim(-0.05, 1.05)

ax5_twin = ax5.twinx()

ax5_twin.plot(D_J0_vals, D_J_final_vals, 's-', color='red', linewidth=2, markersize=8,

label=f'Финальное D_J({duration})')

ax5_twin.set_ylabel(f'Финальное делегирование суждения D_J', color='red')

ax5_twin.tick_params(axis='y', labelcolor='red')

ax5_twin.set_ylim(-0.05, 1.05)

lines1, labels1 = ax5.get_legend_handles_labels()

lines2, labels2 = ax5_twin.get_legend_handles_labels()

ax5.legend(lines1 + lines2, labels1 + labels2, loc='upper left', fontsize=8)

# График 6: Фазовый портрет

ax6 = axes[1, 2]

colors_phase = ['green', 'blue', 'cyan', 'orange', 'gold', 'purple', 'brown']

for i, res in enumerate(results):

ax6.plot(res['D_C_avg'], res['D_J_avg'], label=res['label'], color=colors_phase[i], linewidth=1.5, alpha=0.7)

ax6.plot([0, 1], [1, 0], 'k--', alpha=0.5, label='D_C + D_J = 1')

ax6.scatter([res['D_C_final'] for res in results], [res['D_J_final'] for res in results],

color=colors_phase, s=80, zorder=5, edgecolors='black', linewidth=0.5)

ax6.set_xlabel('D_C (делегирование вычислений)')

ax6.set_ylabel('D_J (делегирование суждения)')

ax6.set_title(f'Фазовый портрет: D_J vs D_C')

ax6.legend(loc='upper left', fontsize=7)

ax6.grid(True, alpha=0.3)

ax6.set_xlim(-0.05, 1.05)

ax6.set_ylim(-0.05, 1.05)

plt.tight_layout()

plt.savefig(f'delegation_theory_results_{duration_name}.png', dpi=150, bbox_inches='tight')

print(f" Графики сохранены в 'delegation_theory_results_{duration_name}.png'")

# ИТОГОВЫЙ ВЫВОД

print(f"""

📊 РЕЗУЛЬТАТЫ ВЕРИФИКАЦИИ ДЛЯ {duration_name.upper()} ({duration} ЛЕТ):

СУЩЕСТВОВАНИЕ БИФУРКАЦИИ

При D_J(0) ≤ 0.20 → A({duration}) > 0.72 (СОХРАНЕНИЕ)

При D_J(0) ≥ 0.30 → A({duration}) < 0.45 (КОЛЛАПС)

""")

plt.show()

# ЗАПУСК АНАЛИЗА ДЛЯ ТРЁХ ДЛИТЕЛЬНОСТЕЙ

durations = [

(15, "15 лет (краткосрочный)"),

(50, "50 лет (среднесрочный)"),

(150, "150 лет (долгосрочный)")

]

for duration, duration_name in durations:

analyze_duration(duration, duration_name)

Автор: homoastricus

![Game Over для мышления? Динамическая теория человеческой агентности в эпоху ИИ - 50 [ beta_{J,i}(A_i)=begin{cases} displaystyle frac{beta_{J,i}^{(0)} (1 + kappa_{run,i})}{1 + gamma_i A_i}, & A_i < A_{run,i} \[10pt] displaystyle frac{beta_{J,i}^{(0)}}{1 + gamma_i A_i}, & A_i geq A_{run,i} end{cases} ]](https://www.braintools.ru/images/2026/03/26/Game-Over-dlya-myshleniya-dinamicheskaya-teoriya-chelovecheskoi-agentnosti-v-epohu-ii-50.svg)