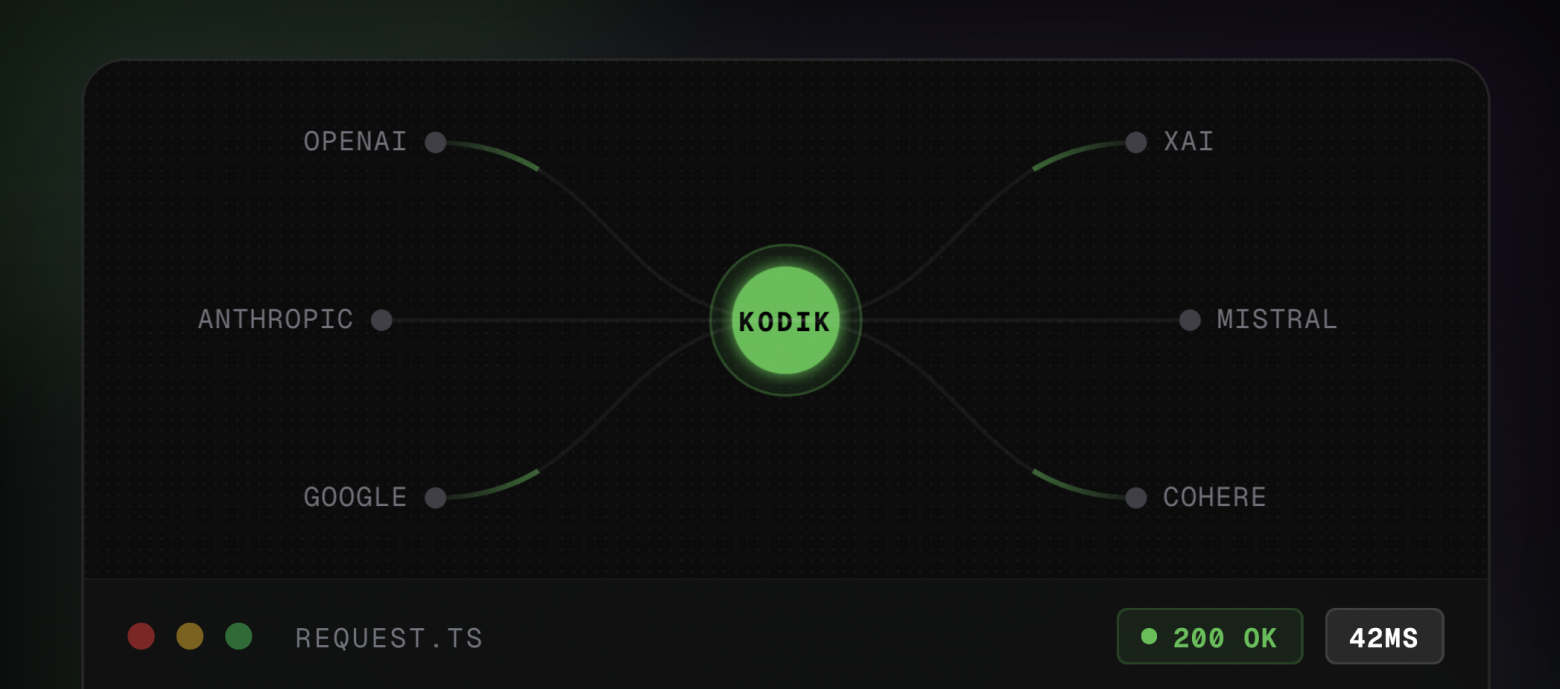

Шлюзы позволяют обращаться ко многим LLM через единый API с единой оплатой. При их использовании в России можно столкнуться с региональными ограничениями, поэтому мы в Kodik создали шлюз KodikRouter: он не удаляет российские аккаунты, принимает оплату в рублях и обладает русскоязычной поддержкой.

Через него доступны флагманские модели — как закрытые (Claude, GPT, Gemini), так и открытые (DeepSeek, Kimi, Qwen). Всего на запуске проекта в каталоге около 400 моделей.

Проект совместим со стандартом OpenAI API, который широко используется в индустрии. Поэтому для перехода на KodikRouter с любого совместимого решения достаточно изменить значение поля baseURL и указать новый ключ API.

Оплата без каких-либо подписок: тарифицируется только использование по токенам. KodikRouter добавляет наценку 10% к стоимости токенов от провайдера модели. Для крупных компаний возможны индивидуальные условия.

Помимо маршрутизации, сервис может автоматически находить и маскировать персональные данные до отправки их в модель, а затем восстанавливать оригинальные значения в ответах. Это соответствует требованиям 152-ФЗ по обработке персональных данных. Маскировка не требует отдельной оплаты.

Помимо основного использования по API, доступен также режим Playground, позволяющий отправлять сообщения моделям на сайте KodikRouter. В нём есть как стандартные для такого режима возможности (вроде регулировки параметра температуры), так и менее стандартное поле «Extractions»: оно показывает, какие персональные данные из промпта были извлечены и скрыты.

Сервис позволяет в случае недоступности определённой модели автоматически переключаться на «запасную». В запросе можно передать сразу несколько названий, и по умолчанию будет использована первая модель, но при ошибке произойдёт переход далее по списку.

Также KodikRouter поддерживает возможности мультимодальных моделей вроде использования изображений. Например, можно разместить отдельно файл с изображением, а в промпте для соответствующей модели передать ссылку на него и вопрос «Что здесь изображено?»

По умолчанию ответы на промпт возвращаются как цельный JSON, но можно переключиться в stream-режим и получать поток событий data: в формате Server-Sent Events с Content-Type: text/event-stream.

Ранее мы выпустили Kodik — редактор кода с ИИ. В нём тоже доступно множество LLM, но не по API, а в самом редакторе для агентских задач. Теперь добавили KodikRouter, и будем рады фидбеку по любому из проектов.

Автор: Kodik_AI