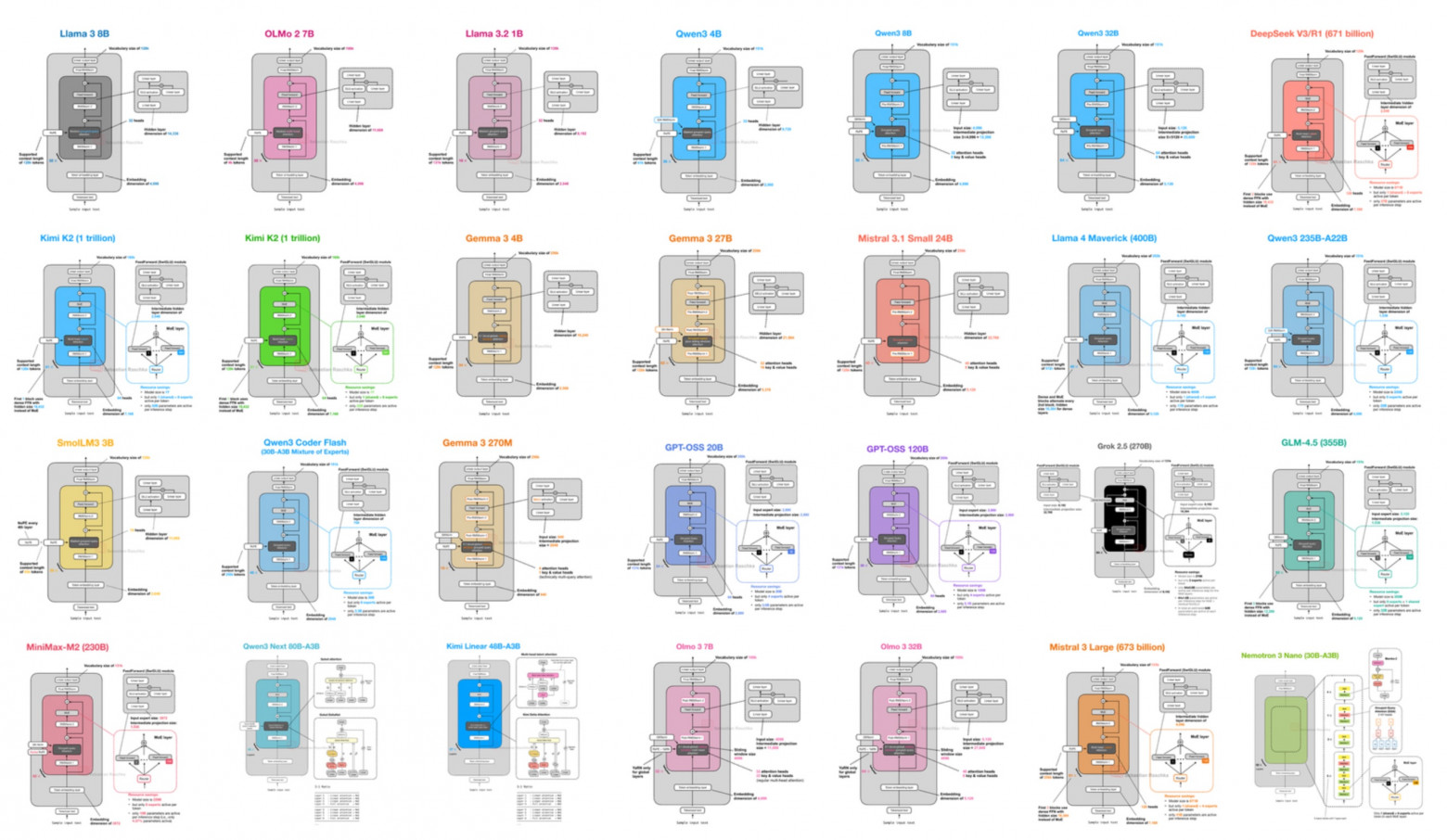

Себастьян Рашка, автор бестселлера Build a Large Language Model (From Scratch) и рассылки Ahead of AI на 168 000 подписчиков, запустил открытый визуальный каталог архитектур больших языковых моделей — LLM Architecture Gallery. На одной странице собраны диаграммы и карточки более чем 40 моделей: от Llama 3 и DeepSeek V3 до свежих Qwen3.5, GLM-5 и Nemotron 3 Super.

Для каждой модели указаны масштаб (общее число параметров и количество активных), тип декодера (dense, sparse MoE или гибрид), механизм внимания (GQA, MLA, sliding-window и другие) и ключевая архитектурная особенность. Карточки ведут на config.json модели на HuggingFace, техрепорт и — для части моделей — реализацию “с нуля” из репозитория Рашки на GitHub.

Если смотреть на каталог как на карту трендов, бросаются в глаза несколько вещей. Архитектура DeepSeek V3 с многоголовым латентным вниманием (MLA) и смесью экспертов (MoE) фактически стала отраслевым шаблоном — ее в той или иной форме воспроизвели Mistral 3 Large, Kimi K2 и GLM-5. Классические dense-модели вытесняются разреженными MoE на крупных масштабах, а на переднем крае уже появляются гибриды с линейным вниманием: Gated DeltaNet в Qwen3.5, слои Mamba-2 в Nemotron 3 от NVIDIA, Lightning Attention в триллионном Ling 2.5 от Ant Group.

Рашка не связан ни с одной из крупных лабораторий — с 2022 года он работал в Lightning AI, а сейчас ведет независимую исследовательскую лабораторию RAIR Lab. Галерея обновляется — последнее обновление датировано 14 марта. Баг-репорты и предложения по моделям принимаются через трекер на GitHub.

P.S. Поддержать меня можно подпиской на канал “сбежавшая нейросеть“, где я рассказываю про ИИ с творческой стороны.

Автор: runaway_llm