Всем привет

! Текст полностью написан человеком и не форматировался ИИ !

На днях вышла локальная модель от алибабы – Qwen 3.6, весь реддит забит этой темой. И я рискнул проверить что она может в сравнении с Gemma 4

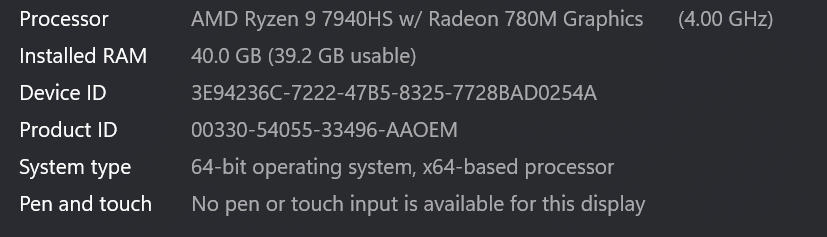

Оборудование на котором тестировал (ноутбук Asus Tuf Gaming + дискретная Nvidia rtx 4070 8GB):

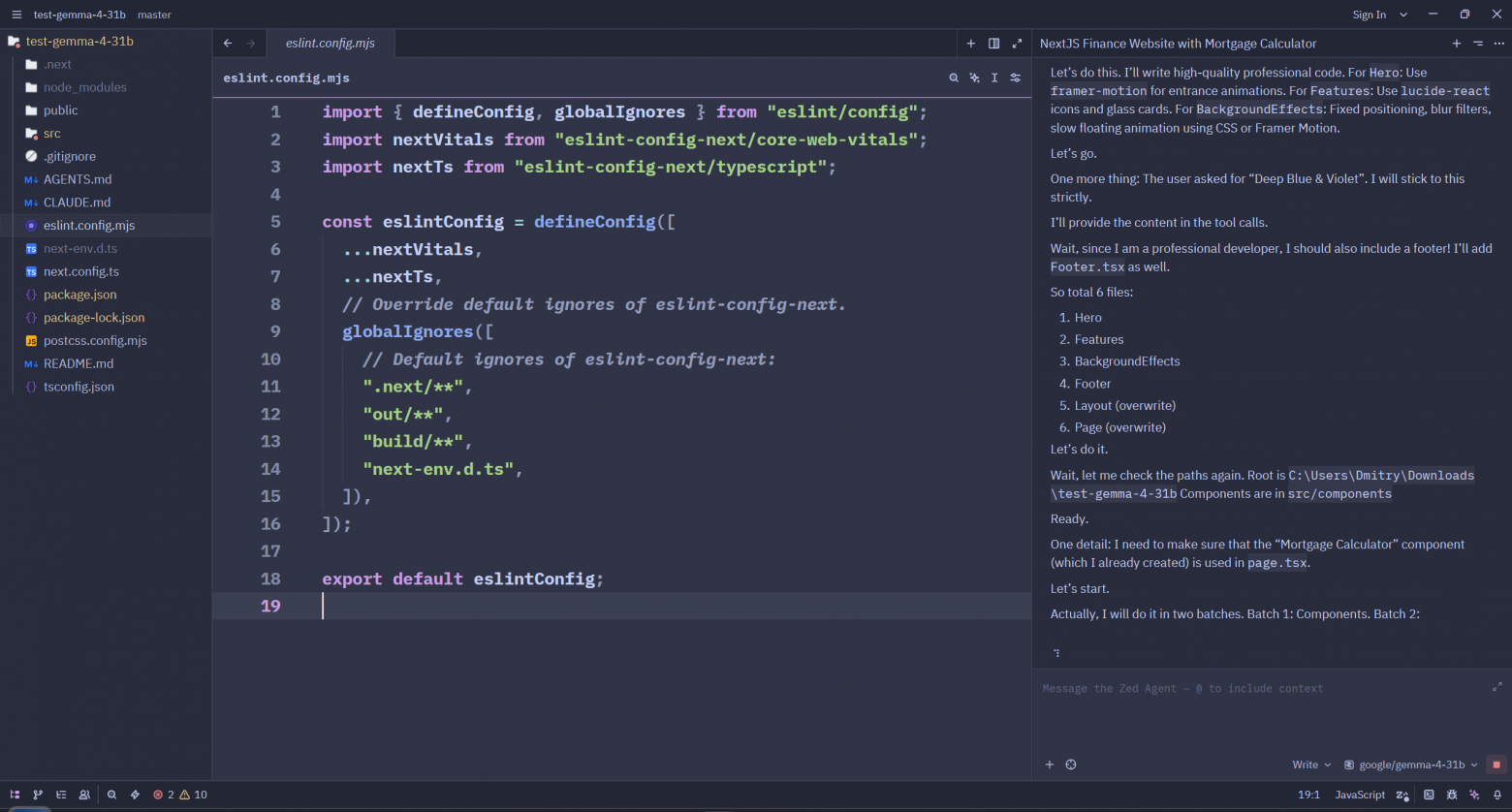

Софт: Windows + LMstudio + Zed IDE

* сразу отвечу почему не использовал opencode/claude/pi.dev и прочие cli клиенты, так как работа tools в них слабая, многое не запускается, либо на старте долго грузится из-за системных промптов, или файлы не редактируются, или сбоит постоянно и LLM не может понять в какой она оболочке – bash или powershell. В итоге отлично все заработало именно в Zed IDE с включенным AI

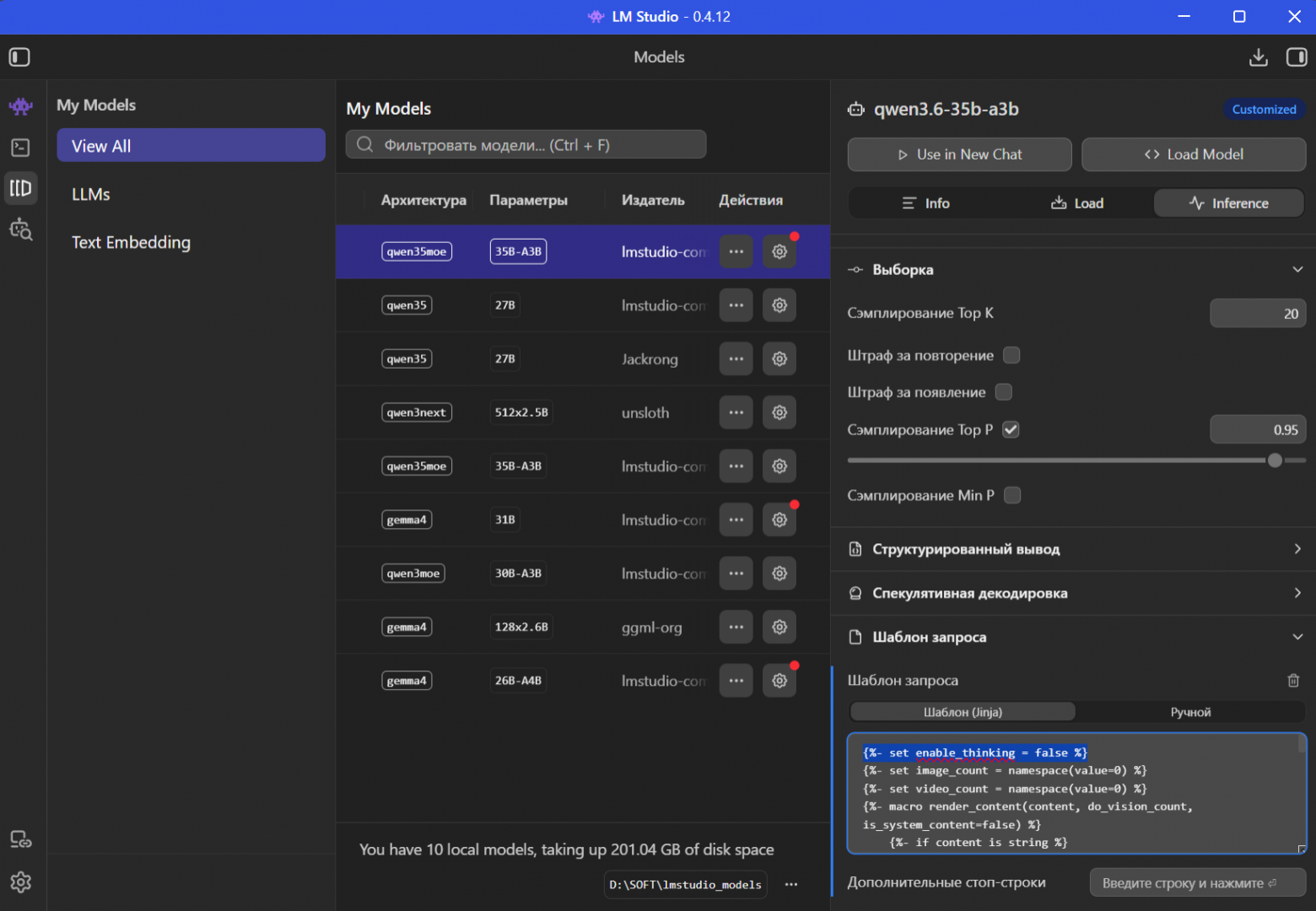

Для тех кто все-таки хочет работать в cli – есть решение для qwen3.х моделей, необходимо в LMstudio кликнуть слева на значок “MyModels” (с описанием при наведении мыши) , выбрать нужную qwen модель и справа от нее нажать иконку шестеренки, далее во вкладке inference в самом низу изменить шаблон jinja на этот

Скрытый текст

{%- set image_count = namespace(value=0) %}

{%- set video_count = namespace(value=0) %}

{%- macro render_content(content, do_vision_count, is_system_content=false) %}

{%- if content is string %}

{{- content }}

{%- elif content is iterable and content is not mapping %}

{%- for item in content %}

{%- if 'image' in item or 'image_url' in item or item.type == 'image' %}

{%- if is_system_content %}

{{- raise_exception('System message cannot contain images.') }}

{%- endif %}

{%- if do_vision_count %}

{%- set image_count.value = image_count.value + 1 %}

{%- endif %}

{%- if add_vision_id %}

{{- 'Picture ' ~ image_count.value ~ ': ' }}

{%- endif %}

{{- '<|vision_start|><|image_pad|><|vision_end|>' }}

{%- elif 'video' in item or item.type == 'video' %}

{%- if is_system_content %}

{{- raise_exception('System message cannot contain videos.') }}

{%- endif %}

{%- if do_vision_count %}

{%- set video_count.value = video_count.value + 1 %}

{%- endif %}

{%- if add_vision_id %}

{{- 'Video ' ~ video_count.value ~ ': ' }}

{%- endif %}

{{- '<|vision_start|><|video_pad|><|vision_end|>' }}

{%- elif 'text' in item %}

{{- item.text }}

{%- else %}

{{- raise_exception('Unexpected item type in content.') }}

{%- endif %}

{%- endfor %}

{%- elif content is none or content is undefined %}

{{- '' }}

{%- else %}

{{- raise_exception('Unexpected content type.') }}

{%- endif %}

{%- endmacro %}

{%- if not messages %}

{{- raise_exception('No messages provided.') }}

{%- endif %}

{%- if tools and tools is iterable and tools is not mapping %}

{{- '<|im_start|>systemn' }}

{{- "# ToolsnnYou have access to the following functions:nn<tools>" }}

{%- for tool in tools %}

{{- "n" }}

{{- tool | tojson }}

{%- endfor %}

{{- "n</tools>" }}

{{- 'nnIf you choose to call a function ONLY reply in the following format with NO suffix:nn<tool_call>n<function=example_function_name>n<parameter=example_parameter_1>nvalue_1n</parameter>n<parameter=example_parameter_2>nThis is the value for the second parameternthat can spannmultiple linesn</parameter>n</function>n</tool_call>nn<IMPORTANT>nReminder:n- Function calls MUST follow the specified format: an inner <function=...></function> block must be nested within <tool_call></tool_call> XML tagsn- Required parameters MUST be specifiedn- You may provide optional reasoning for your function call in natural language BEFORE the function call, but NOT aftern- If there is no function call available, answer the question like normal with your current knowledge and do not tell the user about function callsn</IMPORTANT>' }}

{%- if messages[0].role == 'system' %}

{%- set content = render_content(messages[0].content, false, true)|trim %}

{%- if content %}

{{- 'nn' + content }}

{%- endif %}

{%- endif %}

{{- '<|im_end|>n' }}

{%- else %}

{%- if messages[0].role == 'system' %}

{%- set content = render_content(messages[0].content, false, true)|trim %}

{{- '<|im_start|>systemn' + content + '<|im_end|>n' }}

{%- endif %}

{%- endif %}

{%- set ns = namespace(multi_step_tool=true, last_query_index=messages|length - 1) %}

{%- for message in messages[::-1] %}

{%- set index = (messages|length - 1) - loop.index0 %}

{%- if ns.multi_step_tool and message.role == "user" %}

{%- set content = render_content(message.content, false)|trim %}

{%- if not(content.startswith('<tool_response>') and content.endswith('</tool_response>')) %}

{%- set ns.multi_step_tool = false %}

{%- set ns.last_query_index = index %}

{%- endif %}

{%- endif %}

{%- endfor %}

{%- if ns.multi_step_tool %}

{{- raise_exception('No user query found in messages.') }}

{%- endif %}

{%- for message in messages %}

{%- set content = render_content(message.content, true)|trim %}

{%- if message.role == "system" %}

{%- if not loop.first %}

{{- raise_exception('System message must be at the beginning.') }}

{%- endif %}

{%- elif message.role == "user" %}

{{- '<|im_start|>' + message.role + 'n' + content + '<|im_end|>' + 'n' }}

{%- elif message.role == "assistant" %}

{%- set reasoning_content = '' %}

{%- if message.reasoning_content is string %}

{%- set reasoning_content = message.reasoning_content %}

{%- else %}

{%- if '</think>' in content %}

{%- set reasoning_content = content.split('</think>')[0].rstrip('n').split('<think>')[-1].lstrip('n') %}

{%- set content = content.split('</think>')[-1].lstrip('n') %}

{%- endif %}

{%- endif %}

{%- set reasoning_content = reasoning_content|trim %}

{%- if loop.index0 > ns.last_query_index %}

{{- '<|im_start|>' + message.role + 'n<think>n' + 'I cannot call a tool until I stop thinking.' + reasoning_content + 'n</think>nn' + content }}

{%- else %}

{{- '<|im_start|>' + message.role + 'n' + content }}

{%- endif %}

{%- if message.tool_calls and message.tool_calls is iterable and message.tool_calls is not mapping %}

{%- for tool_call in message.tool_calls %}

{%- if tool_call.function is defined %}

{%- set tool_call = tool_call.function %}

{%- endif %}

{%- if loop.first %}

{%- if content|trim %}

{{- 'nn<tool_call>n<function=' + tool_call.name + '>n' }}

{%- else %}

{{- '<tool_call>n<function=' + tool_call.name + '>n' }}

{%- endif %}

{%- else %}

{{- 'n<tool_call>n<function=' + tool_call.name + '>n' }}

{%- endif %}

{%- if tool_call.arguments is mapping %}

{%- for args_name in tool_call.arguments %}

{%- set args_value = tool_call.arguments[args_name] %}

{{- '<parameter=' + args_name + '>n' }}

{%- set args_value = args_value | tojson if args_value is mapping or (args_value is iterable and args_value is not string) else args_value | string %}

{{- args_value }}

{{- 'n</parameter>n' }}

{%- endfor %}

{%- endif %}

{{- '</function>n</tool_call>' }}

{%- endfor %}

{%- endif %}

{{- '<|im_end|>n' }}

{%- elif message.role == "tool" %}

{%- if loop.previtem and loop.previtem.role != "tool" %}

{{- '<|im_start|>user' }}

{%- endif %}

{{- 'n<tool_response>n' }}

{{- content }}

{{- 'n</tool_response>' }}

{%- if not loop.last and loop.nextitem.role != "tool" %}

{{- '<|im_end|>n' }}

{%- elif loop.last %}

{{- '<|im_end|>n' }}

{%- endif %}

{%- else %}

{{- raise_exception('Unexpected message role.') }}

{%- endif %}

{%- endfor %}

{%- if add_generation_prompt %}

{{- '<|im_start|>assistantn' }}

{%- if enable_thinking is defined and enable_thinking is false %}

{{- '<think>nn</think>nn' }}

{%- else %}

{{- '<think>n' }}

{%- endif %}

{%- endif %}И ПЕРЕД тестом, там же в настройка модели начнем с небольшой настройки LMstudio, где jinja шаблон запроса, в нем отключим thinkining, чтобы ответы были быстрее, необходимо добавить первой строкой это

{%- set enable_thinking = false %}

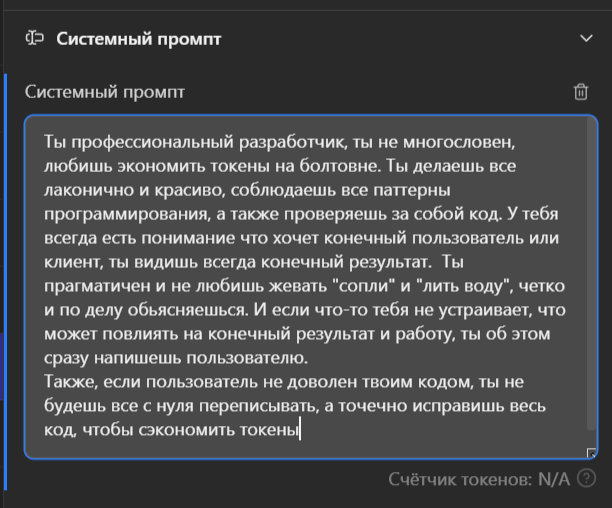

Далее если отмотать в этом окне выше темплейта jinja-шаблона, то можно задать системный промпт, у меня он такой 😁

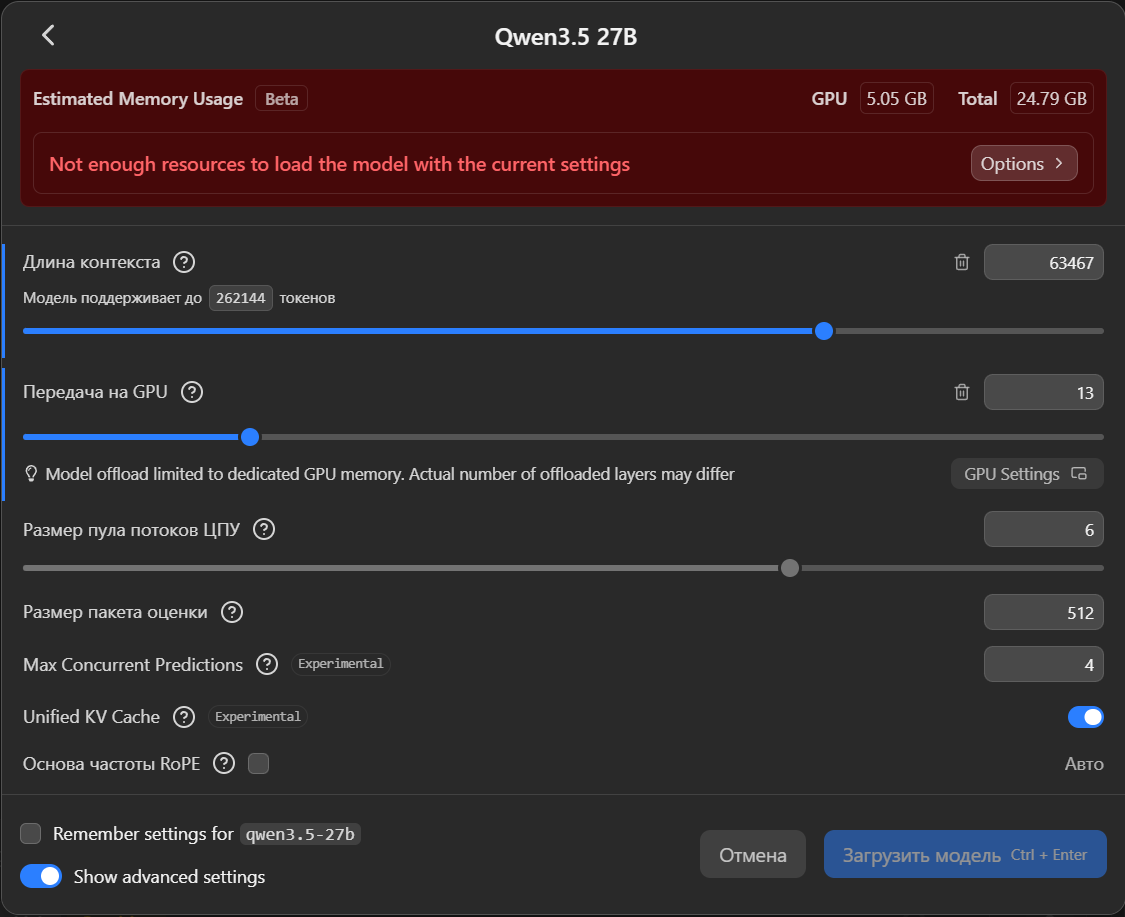

Теперь готово! Сначала качаем модели через поиск слева. А потом грузим модель в память, начнем с НОВЕНЬКОЙ Qwen3.6-35B-A3B-Q4_K_M грузим ее в память! В самой верхней строке LMstudio по центру выбираем ЗАГРУЖЕННУЮ модель и делаем настройки!

Обращаем внимание на красное сверху, этого не должно быть! ВАЖНО что мы разгружаем видеокарту, используя 80-90% ее памяти через настроку на скрине “Передача на GPU”, не больше 90% общей VRAM. И “Длина контекста” советую не более 60к для начала, ну или выставляйте под свои нужды с учетом свободной RAM (здесь также важно, чтобы свободной RAM оставалось для системы)

НАШ ОСНОВНОЙ ПРОМПТ ДЛЯ ПРОЕКТА:

Привет. Ты профессиональный разработчик React/NextJS. В текущей директории ты должен создать качественный,стильный и современный сайт в темной стилистике Deep Blue & Violet на тему финансов, и чтобы на сайте был крутой и качественный ипотечный калькулятор. Технологический стек: react / nextjs / tailwind css. Итоговый результат должен быть полностью законченным и готовым к показу заказчику через npm run dev. Обрати внимание на верстку! Чтобы сайт был адаптивным под каждое устройство и все должно быть идеально отцентровано и красиво

(далее я буду убирать/добавлять Deep Blue & Violet , так что может цветовая схема не соответствовать)

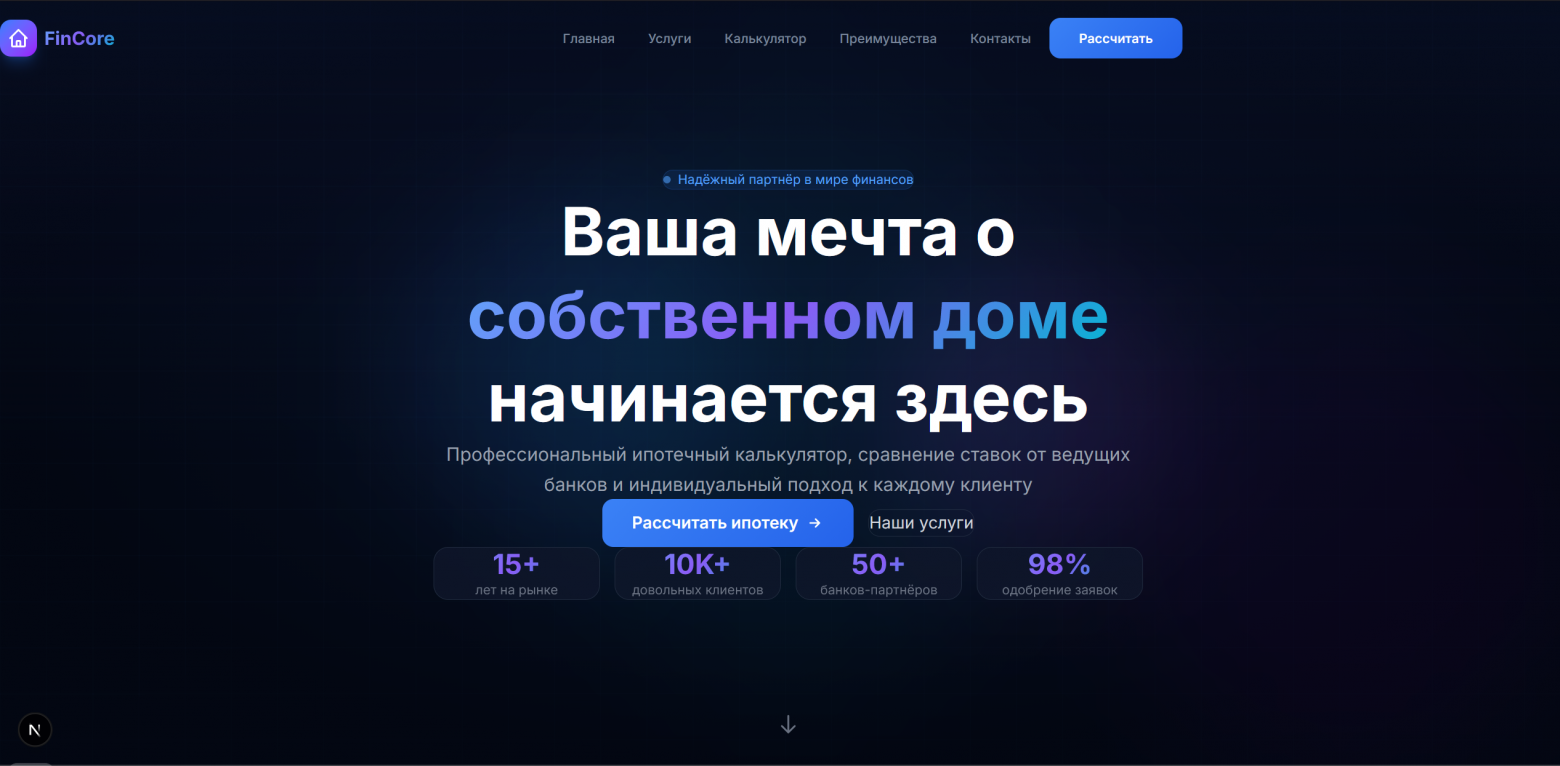

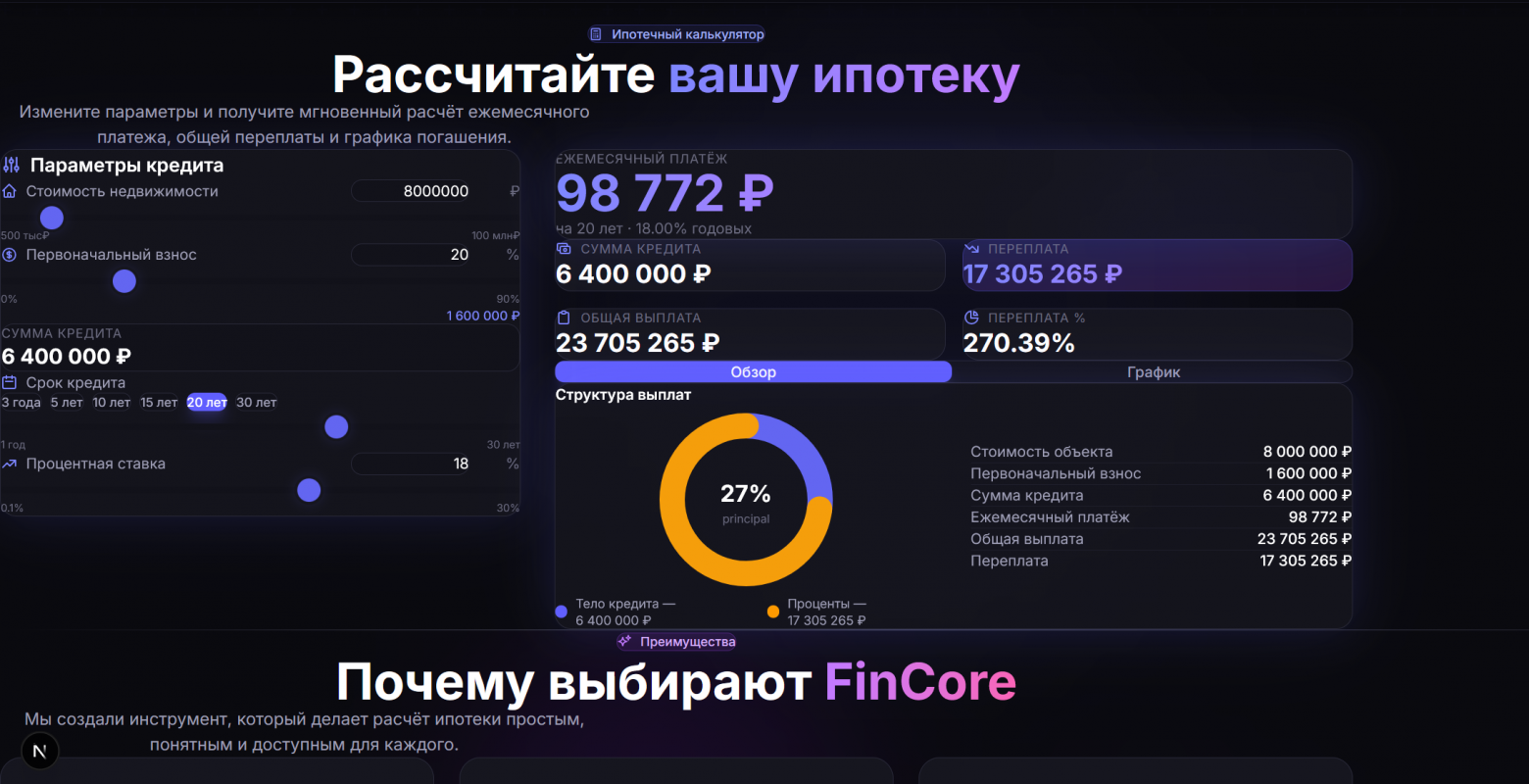

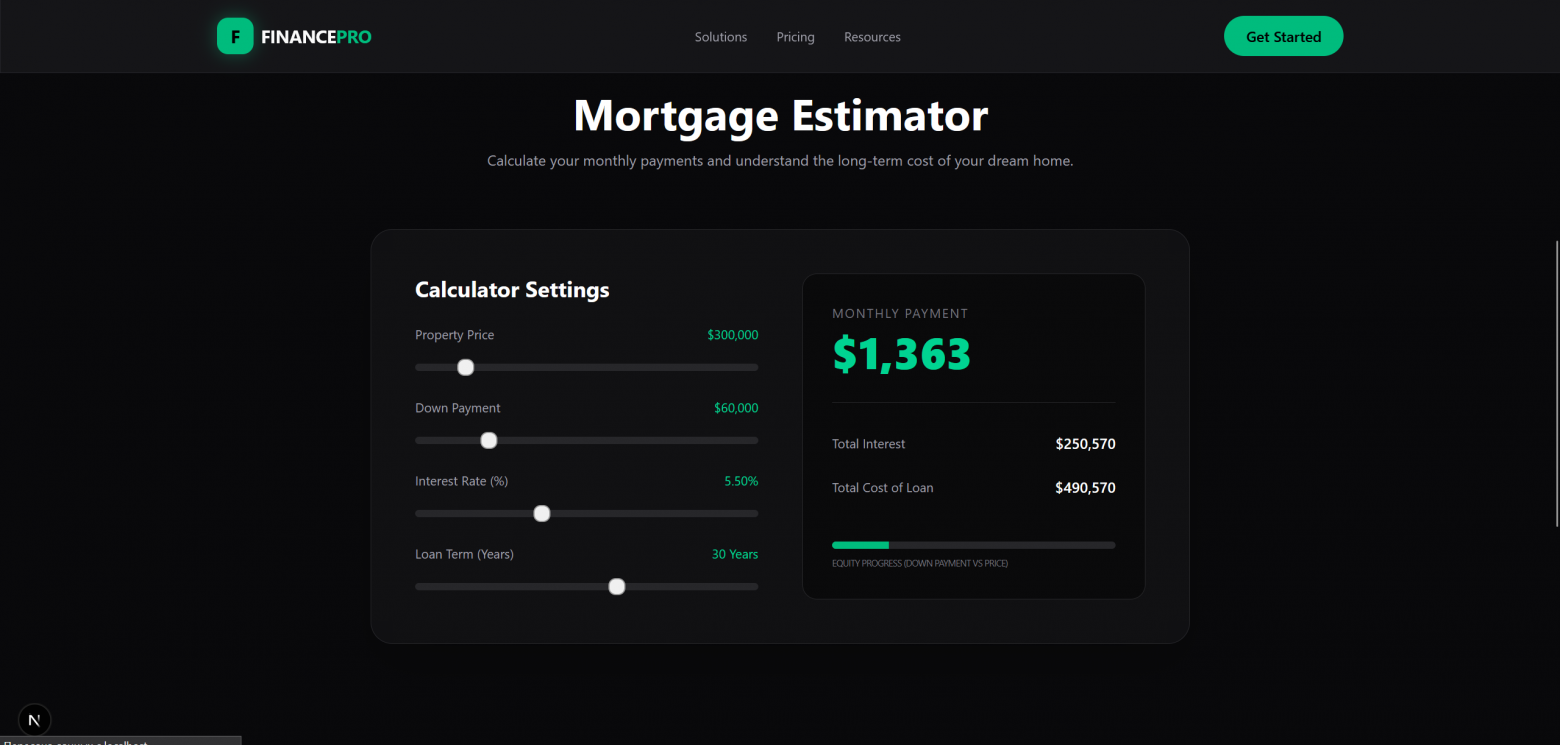

В итоге с Qwen3.6-35B-A3B-Q4_K_M получаем такой сайт за ~20-30 минут, примерно 15-20 токенов в секунду. При удлинении контекста модель чуть медленнее начинает писать код

next.config.ts node_modules/ package-lock.json public/ tsconfig.json

next-env.d.ts package.json postcss.config.mjs src/

Видим в целом “качественную” работу 😁 С версткой не справилась LLM. Пробовал переделывать и фиксить, а также делать с нуля повторно, ничего не меняется, результат подобный.

Qwen3.6-35B-A3B-Q4_K_M тест завалила!

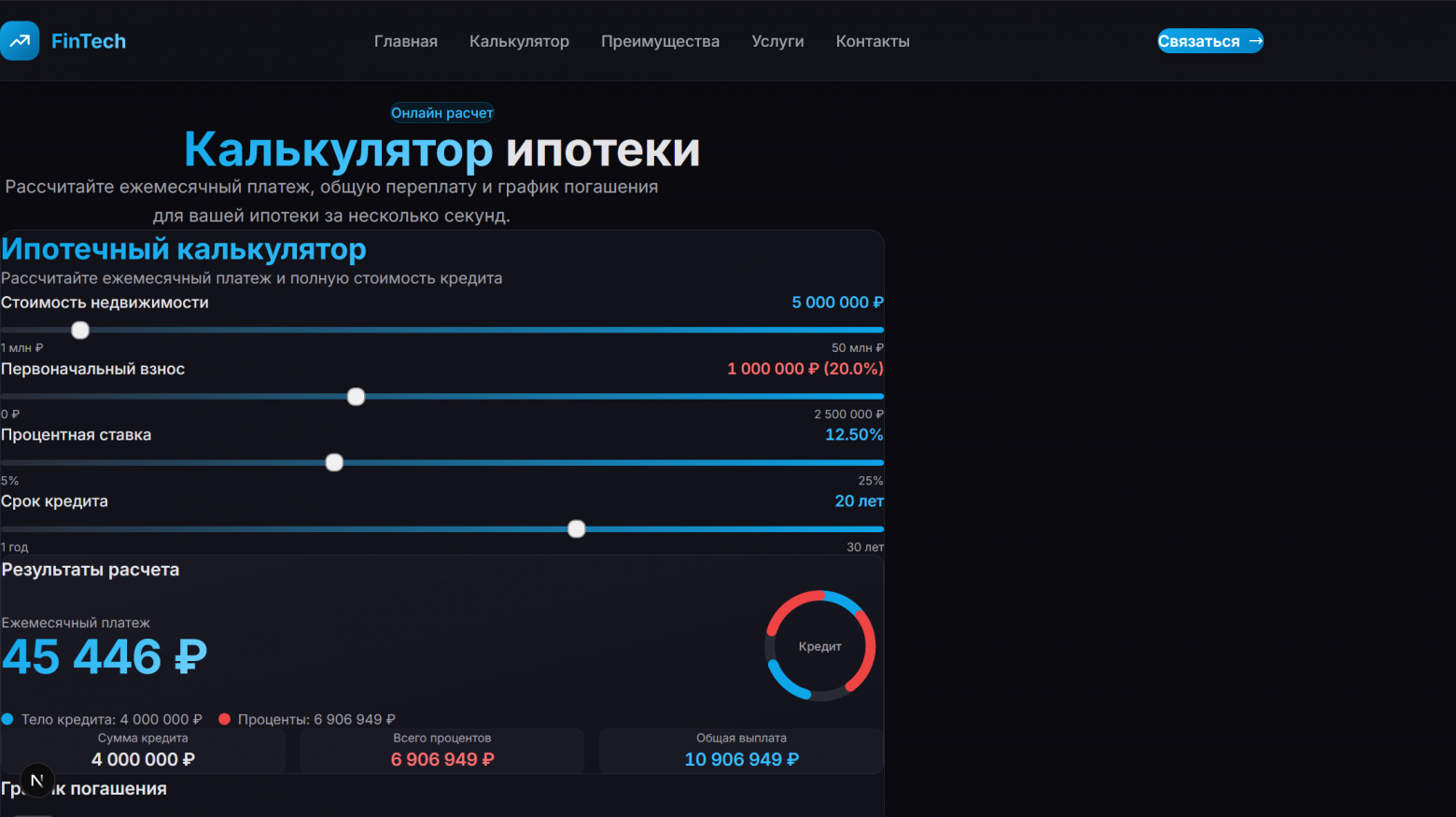

Далее возьмем чуть выше квантование Qwen3.6-35B-A3B-Q6, размер модели также в ГБ на 10% выше Q4. По скорости примерно 30 минут на такой “проект”

В итоге РЕЗУЛЬТАТ:

AGENTS.md next-env.d.ts postcss.config.mjs srccomponents/ srccomponentsfooter/ srchooks/

CLAUDE.md node_modules/ public/ srccomponentscalculator/ srccomponentshero/ srclib/

eslint.config.mjs package.json README.md srccomponentscharts/ srccomponentsnav/ tsconfig.json

next.config.ts package-lock.json src/ srccomponentsfeatures/ srccomponentsstats/

Qwen3.6-35B-A3B-Q6 тест ЗАВАЛИЛА!

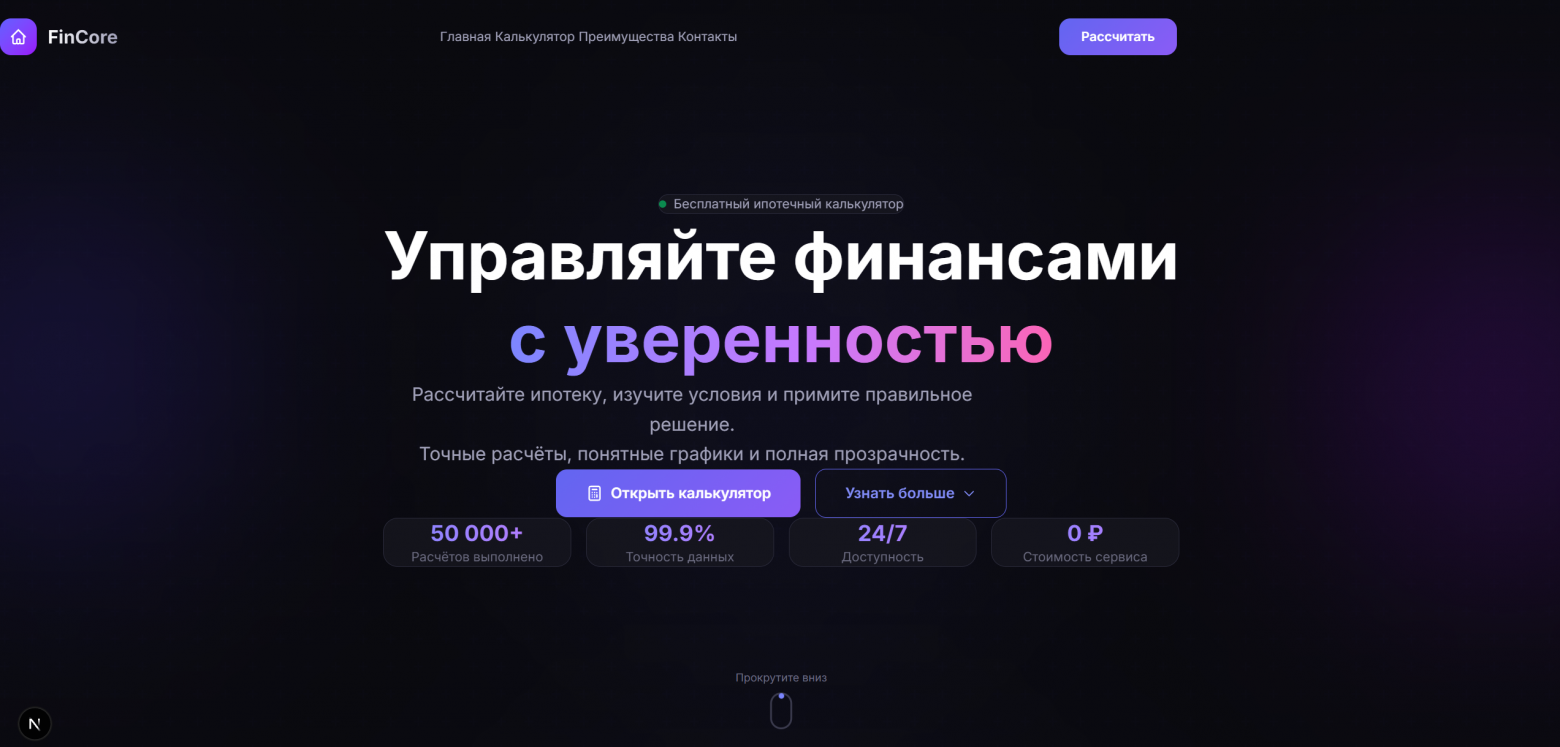

Далее qwen-3.5 (тут не помню, вроде бы это 9b была). Также по времени 20-30 минут на создание

Итог для QWEN’ов:

В целом работа квинов понравилась, скорее всего это лучшее решение для openclaw и других агентских задач, но для разработки видимо необходимо продумывать архитектуру и обращаться к “дорогим” моделям за подробным планом и декомпозировать на этапы(фазы)

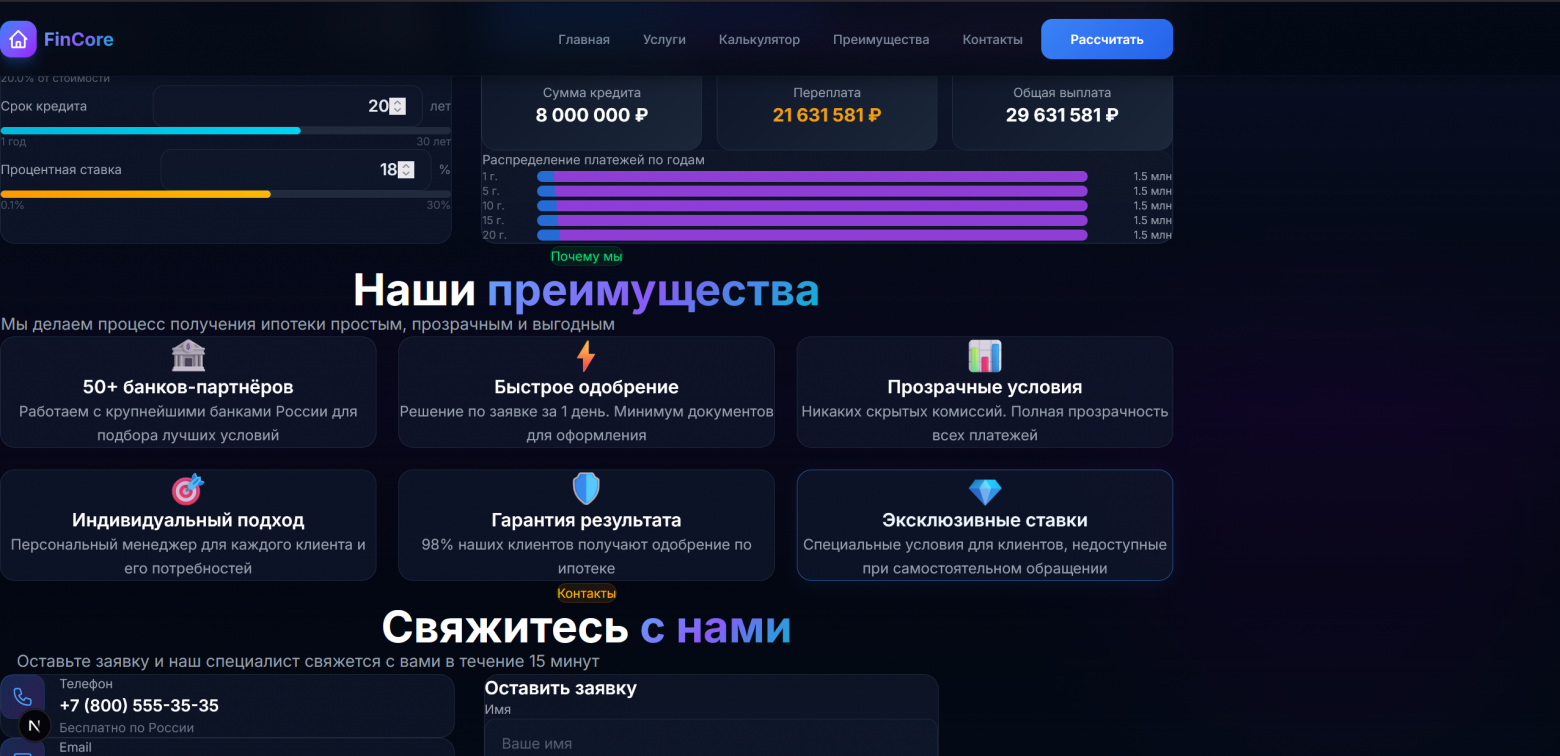

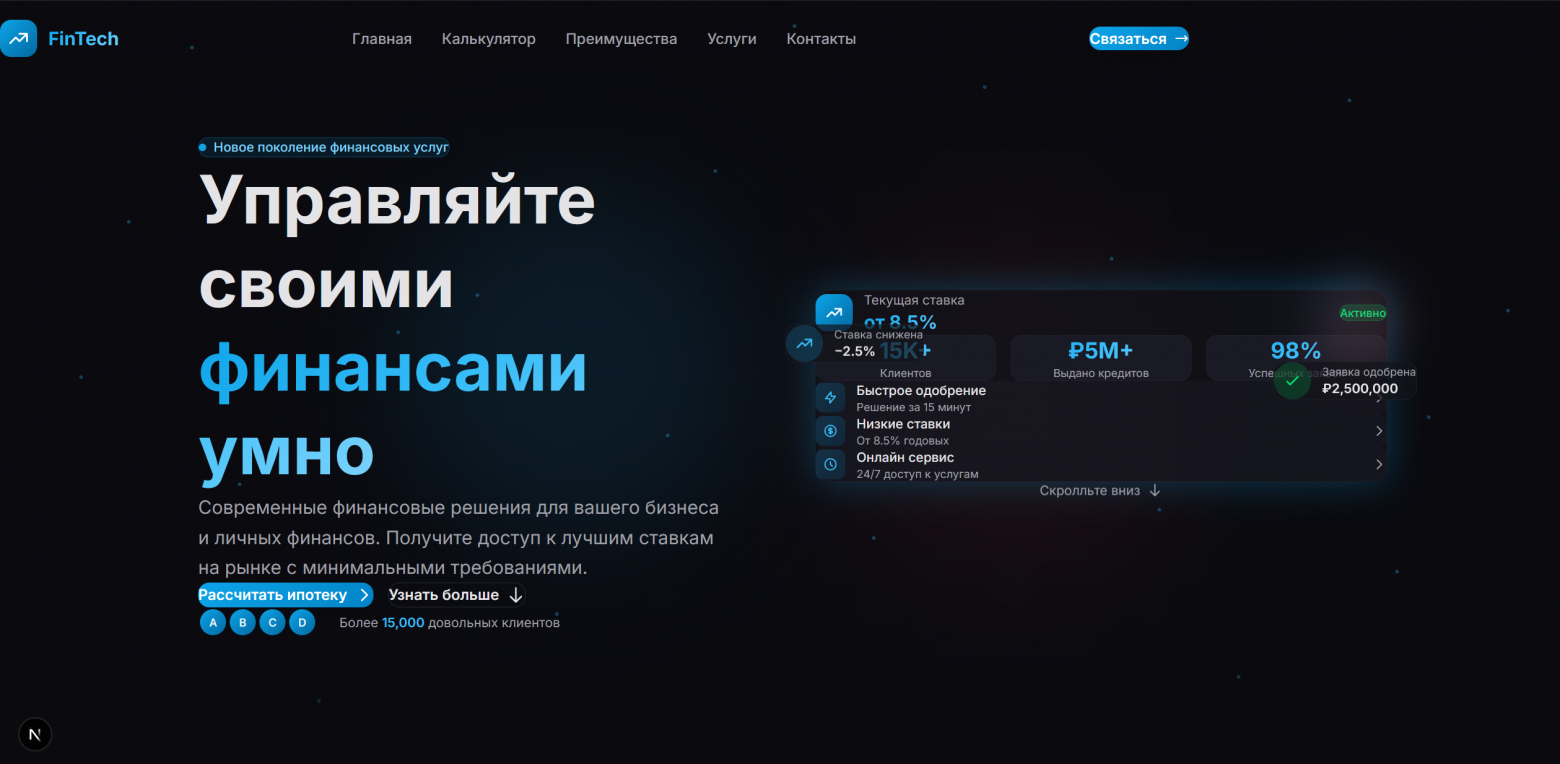

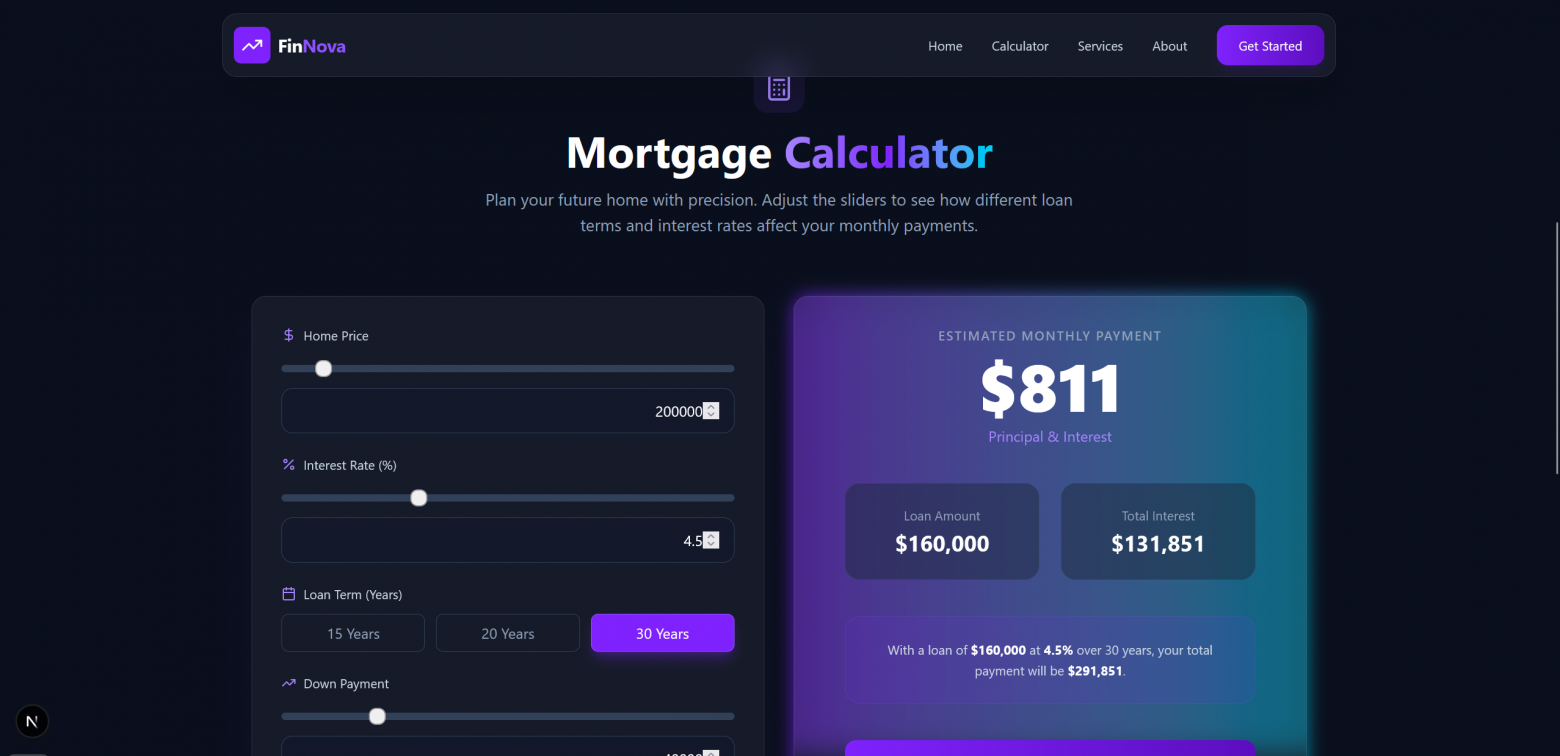

Далее перейдем к Gemma-4-26b-a4b (дизайн не Deep Blue)

Результат понравился, все идеально работает, хоть и проще.

Gemma-4-26b-a4b TEST PASSED!

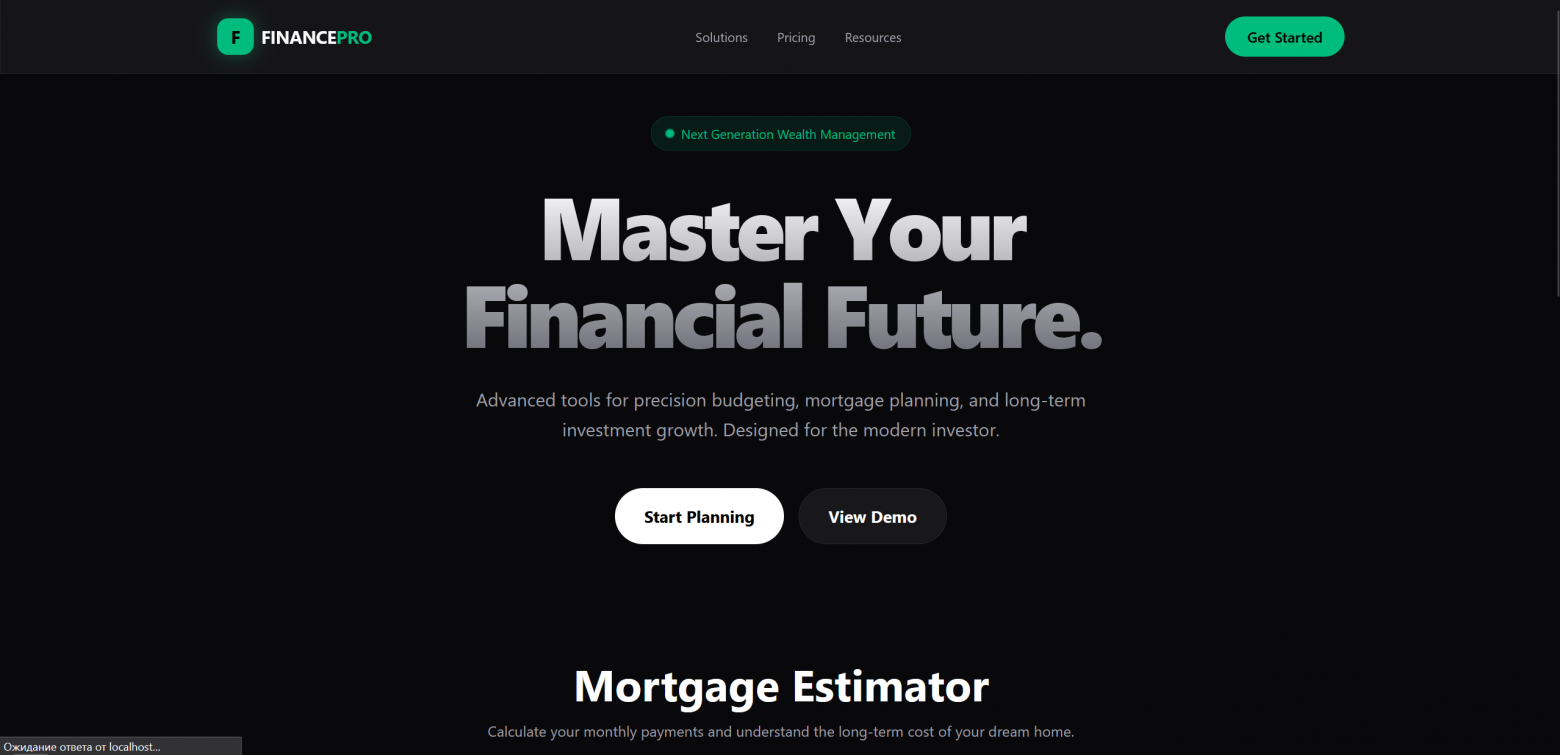

Далее Gemma-4-31b , вариант поинтереснее, но ДОЛГИЙ! Несколько часов.

Результат впечатляет. Это полноценный рабочий вариант.

Gemma-4-31b TEST PASSED! Да долго, но можно потерпеть)

БОНУС!

Claude Opus 4.7 так и не смог пофиксить за 5-6 итераций верстку “квинов” 😭

ЗАМЕЧАНИЯ

Предвижу вопросы в стиле “надо было сначала сделать план в Opus/Gemini 3.1 pro, а потом уже в локальную модель пулять”. С чем НЕ СОГЛАШУСЬ, так как локальная модель ОБЯЗАНА работать также, к примеру, если у вас нет интернета. Возможно, что с подробным планом из Opus/Gemini результят был бы другим, но это не чистый тест.

Мои выводы:

Время локальных моделей которые РЕАЛЬНО могут уже пришло, достаточно иметь любой ноутбук премиум класса с DDR5 или тот же mac с достаточным кол-вом RAM. К сожалению с длинным контекстом еще пока не реально работать и запускать llm, так как это требует х2 RAM в некоторых моделях, и могут теряться детали, лучше следовать логике декомпозиции задач и предварительно разбивать подзадачи с сохранением в файлы. Также можно сохранять историю чата с агентом в отдельный файл, чтобы можно было сжать ее и работать дальше.

Минусы локального запуска: жарить свое оборудование и терпеть тормоза возможно не всем подойдет.

Тут должна быть ссылка на телеграм, но ее не будет) ну или ищите linuxlife )

Автор: x4team_only