Запускайте большие языковые модели оффлайн на своём компьютере — без API-ключей, без облачных зависимостей, полная приватность

Меня зовут Михаил Капустин, я сооснователь и CTO в Advanced Scientific Research Projects (ASRP). За последнее десятилетие я работал across всего технологического стека — от frontend и backend до DevOps и AI/ML инфраструктуры. Недавно я задался целью: построить полностью локальный AI-стек, который не зависит от корпоративных API.

Эта статья — часть моего продолжающегося исследования локальной LLM-инфраструктуры. После экспериментов с Ollama, Claude Code и различными open-source инструментами, я обратил внимание на LM Studio — десктопное приложение, которое обещает сочетать простоту использования с мощным локальным инференсом.

Почему LM Studio важно: В моём путешествии к цифровой независимости я понял, что удобство часто приходит за счёт контроля. Облачные LLM просты в использовании, но вы всегда зависите от чужой инфраструктуры, ценообразования и политик. Локальные LLM дают вам контроль, но традиционно требуют глубоких технических знаний для настройки и поддержки.

LM Studio пытается преодолеть этот разрыв. Но справляется ли она? Давайте разберёмся.

Что такое LM Studio?

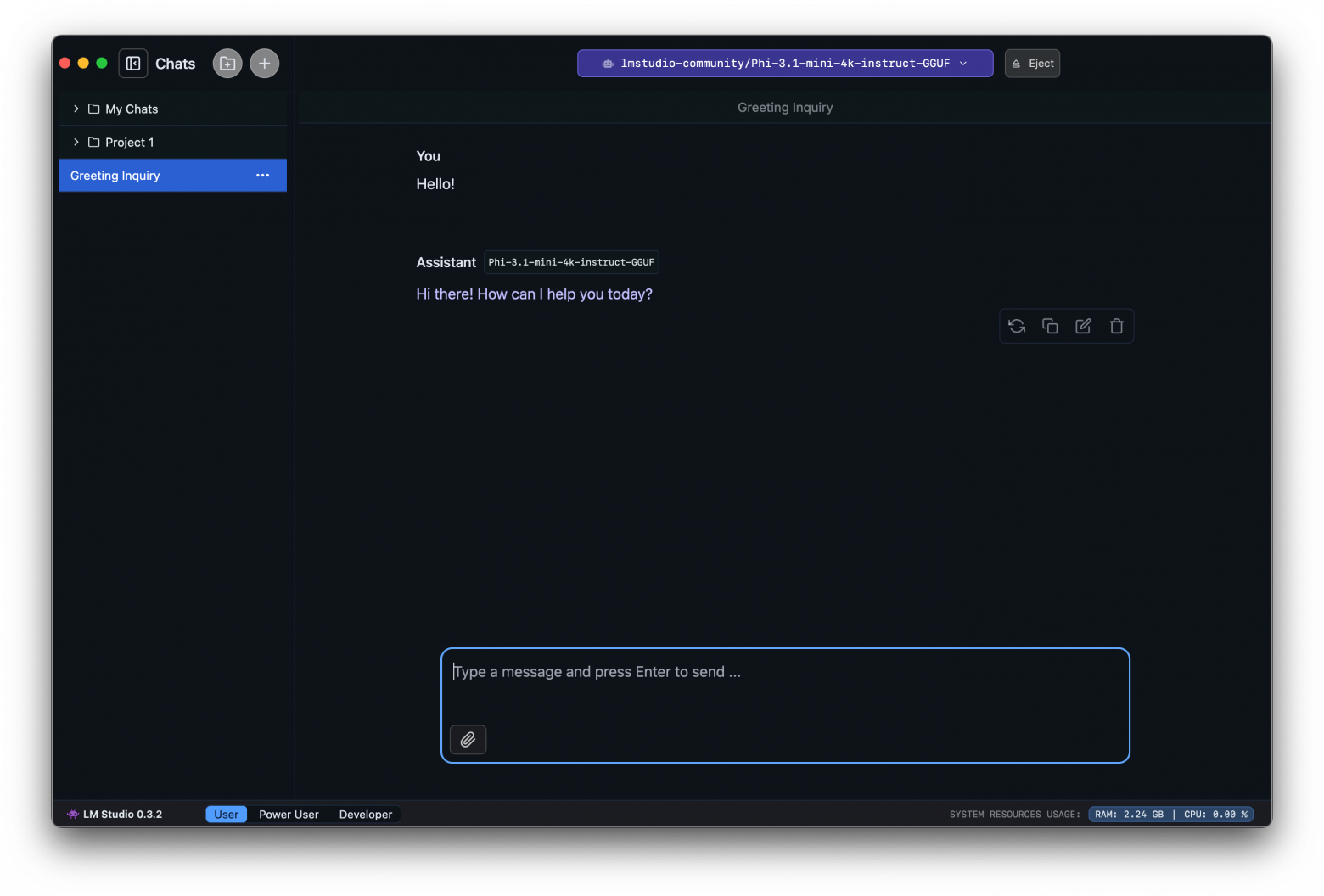

LM Studio — это десктопное приложение для запуска больших языковых моделей (LLM) локально и приватно. Оно предоставляет удобный GUI (плюс CLI и API-доступ) для загрузки, запуска и взаимодействия с open-source LLM на вашем собственном оборудовании.

Основные возможности

Набор возможностей LM Studio комплексный:

-

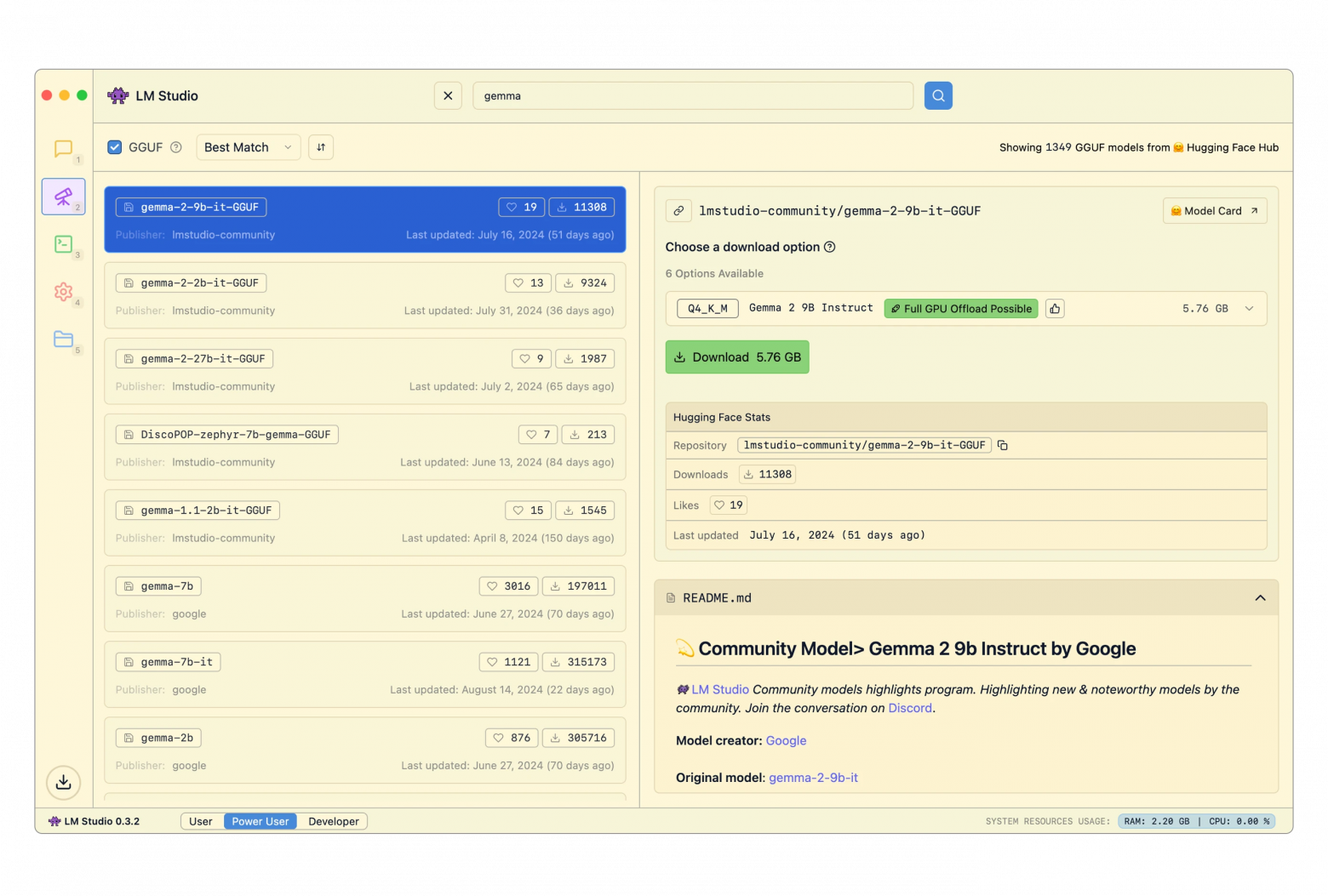

Интегрированное управление моделями — Поиск и загрузка моделей напрямую из Hugging Face

-

Интерфейсы чата и completion — С поддержкой структурированного вывода

-

Генерация embeddings — Для RAG и семантического поиска

-

Поддержка tool calls — Интеграция MCP (Model Context Protocol) агентов

-

RAG возможности — Чат с вашими документами

-

Модели с поддержкой зрения — Через Apple MLX engine на M1/M2/M3 Mac

-

Developer SDK — Пакеты TypeScript и Python

-

OpenAI-совместимые REST endpoints — Простая интеграция в существующие скрипты и приложения

Что делает её особенной

На практике LM Studio комбинирует три слоя, которые часто разделены в других инструментах:

┌─────────────────────────────────────────────────────────┐

│ LM Studio Stack │

├─────────────────────────────────────────────────────────┤

│ ┌─────────────────────────────────────────────────┐ │

│ │ Layer 3: User Interface │ │

│ │ • Desktop GUI (Windows, macOS, Linux) │ │

│ │ • CLI (lms command) │ │

│ │ • Themes, split-view chat, export │ │

│ └─────────────────────────────────────────────────┘ │

│ │ │

│ ┌─────────────────────────────────────────────────┐ │

│ │ Layer 2: API & SDK │ │

│ │ • OpenAI-compatible REST endpoints │ │

│ │ • TypeScript SDK (@lmstudio/sdk) │ │

│ │ • Python SDK (lmstudio pip package) │ │

│ └─────────────────────────────────────────────────┘ │

│ │ │

│ ┌─────────────────────────────────────────────────┐ │

│ │ Layer 1: Inference Engine │ │

│ │ • llama.cpp (GGUF/GGML formats) │ │

│ │ • Apple MLX engine (M1/M2/M3 optimization) │ │

│ │ • GPU offloading (NVIDIA RTX) │ │

│ │ • Continuous batching for parallel requests │ │

│ └─────────────────────────────────────────────────┘ │

└─────────────────────────────────────────────────────────┘Вы получаете полированный UI для экспериментов, CLI для автоматизации и API для интеграции — всё это поддерживается оптимизированными движками инференса.

Техническая архитектура

Под капотом LM Studio использует проверенные open-source библиотеки инференса. Понимание архитектуры помогает принимать обоснованные решения о том, когда и как её использовать.

Движки инференса

Windows и Linux: LM Studio использует движок llama.cpp с форматами моделей GGUF/GGML. Это тот же движок, который питает многие другие инструменты локальных LLM, что означает:

-

Зрелая, хорошо оптимизированная кодовая база

-

Широкая совместимость с моделями

-

Активное сообщество и частые обновления

-

Поддержка квантования (4-bit GGUF, AWQ и т.д.)

Apple Silicon (M1/M2/M3): LM Studio также поддерживает Apple MLX engine, который комбинирует:

-

mlx-lmдля текстовых моделей -

mlx-vlmдля моделей с поддержкой зрения

MLX engine специально оптимизирован для Apple Silicon, обеспечивая быструю обработку vision-входов, с чем llama.cpp не справляется на Mac.

Headless-демон (llmster)

Ключевое архитектурное решение в LM Studio v0.4+ — это headless-демон под названием llmster. Это разделяет GUI и инференс:

┌─────────────────┐ ┌──────────────────┐

│ Desktop App │ ──────► │ llmster daemon │

│ (GUI client) │ HTTP │ (inference │

│ │ API │ engine) │

└─────────────────┘ └──────────────────┘

│

▼

┌──────────────────┐

│ Models in │

│ memory / GPU │

└──────────────────┘Почему это важно: Архитектура с демоном позволяет LM Studio работать “в фоне” на сервере или в CI/CD pipeline, предоставляя REST API даже без GUI. Это критично для продакшн-развёртываний, где нужен headless-режим.

Это означает, что вы можете:

-

Использовать GUI для экспериментов и выбора моделей

-

Запускать демон на сервере для продакшн-инференса

-

Переключаться между ними без изменений кода

GPU Offloading

LM Studio поддерживает GPU offloading с NVIDIA RTX GPU для ускорения больших моделей. Интерфейс предоставляет слайдер “GPU offloading” для балансировки использования CPU/GPU.

Влияние в реальности: Блог NVIDIA показал, что GPU offloading от LM Studio может превратить непригодно медленный (2.1 токенов/сек) запуск Gemini 2-27B в интерактивную скорость (~12-15 токенов/сек) путём оффлоадинга слоёв на GPU.

На практике это означает:

-

20B модели могут работать на 24GB GPU через оффлоадинг

-

Квантованные модели (4-bit GGUF) достигают качества, близкого к FP16, при значительно меньших затратах памяти

-

Вы можете запускать столько моделей, “сколько поддерживает ваше оборудование”

Системные требования

Согласно официальной документации:

| Компонент | Требования |

|-----------|------------|

| **ОС** | macOS (Apple Silicon), Windows (x64/ARM с AVX2), Linux (x64/ARM64) |

| **CPU** | Поддержка AVX2 (x64) или Apple Silicon |

| **RAM** | Рекомендуется 16GB+ |

| **GPU** | Опционально, рекомендуется 4GB+ VRAM для NVIDIA RTX |

| **Хранилище** | Зависит от размеров моделей (обычно 4-40GB на модель) |Важно: LM Studio работает полностью оффлайн по умолчанию — никакие данные не отправляются на внешние серверы. Это критично для приложений с требованиями приватности и корпоративных развёртываний.

Как настроить?

Позвольте провести вас через то, как я использую LM Studio в своём рабочем процессе в ASRP.

Установка

Шаг 1: Загрузите LM Studio

Посетите lmstudio.ai и загрузите соответствующую версию для вашей ОС.

Шаг 2: Установите CLI

CLI (lms) предоставляет терминальный доступ к функциональности LM Studio:

# На macOS/Linux

curl -fsSL https://lmstudio.ai/cli/install.sh | bash

# Или через npm

npm install -g @lmstudio/sdk

# Или через pip (Python SDK)

pip install lmstudioШаг 3: Загрузите модель

LM Studio имеет интегрированный браузер моделей. Вы можете искать и загружать модели напрямую из Hugging Face:

# Использование CLI

lms get qwen3-coderИли через GUI: Search → Select → Download

Основные команды CLI

Вот команды, которые я использую чаще всего:

# Начать сессию чата

lms chat

# Получить информацию о модели

lms get <model-name>

# Список загруженных моделей

lms list

# Запустить headless-сервер

lms serve

# Проверить системные ресурсы

lms statusИнтеграция API

Одно из преимуществ LM Studio — его OpenAI-совместимое API. Вот как я интегрирую его в Python-проекты:

from openai import OpenAI

# Настройка клиента для использования локального endpoint LM Studio

client = OpenAI(

base_url="http://localhost:1234/v1",

api_key="lm-studio" # API-ключ не валидируется локально

)

# Chat completion

response = client.chat.completions.create(

model="qwen3-coder",

messages=[

{"role": "system", "content": "Вы полезный ассистент для кодинга."},

{"role": "user", "content": "Напишите Python-функцию для вычисления fibonacci"}

],

stream=True

)

for chunk in response:

if chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="")Пример TypeScript SDK:

import { LMStudio } from "@lmstudio/sdk";

const lms = new LMStudio("ws://localhost:1234");

const model = await lms.llm.load("qwen3-coder");

const result = await model.complete({

prompt: "Объясните квантовые вычисления простыми словами",

maxTokens: 500

});

console.log(result.content);Headless Server Mode

Для продакшн-развёртываний я запускаю LM Studio в headless-режиме:

# Запустить демон

lms serve --port 1234

# Или запустить как фоновый сервис

nohup lms serve > lmstudio.log 2>&1 &Это предоставляет REST API без GUI, идеально для:

-

Docker-контейнеров

-

CI/CD pipeline

-

Серверных развёртываний

-

Агентской инфраструктуры

Сравнение с конкурентами

Основные функции

| Функция | LM Studio | Ollama | Open WebUI | LMDeploy |

|---------|-----------|--------|------------|----------|

| **Основной интерфейс** | Desktop GUI + CLI | CLI-focused | Web UI | Library/API |

| **Движок инференса** | llama.cpp + MLX | Custom + llama.cpp | Backend-agnostic | Custom (CUDA-optimized) |

| **Форматы моделей** | GGUF, GGML, MLX | GGUF, GPTQ, AWQ | Any (via backend) | AWQ, KV-quant |Технические возможности

| Возможность | LM Studio | Ollama | Open WebUI | LMDeploy |

|-------------|-----------|--------|------------|----------|

| **Оффлайн использование** | ✅ Полностью оффлайн | ✅ Полностью оффлайн | ✅ Self-hosted | ✅ Локальное развёртывание |

| **GPU Offloading** | ✅ NVIDIA RTX | ✅ Опционально | ✅ Via backend | ✅ Multi-GPU |

| **Поддержка зрения** | ✅ MLX на Apple Silicon | ⚠️ Ограничено | ✅ Via plugins | ⚠️ Ограничено |

| **Совместимость API** | OpenAI-совместимое | Custom API | OpenAI + Ollama | Custom |Developer Experience

| Функция | LM Studio | Ollama | Open WebUI | LMDeploy |

|---------|-----------|--------|------------|----------|

| **Поддержка SDK** | TypeScript, Python | CLI + REST | REST API | Python |

| **MCP/Tool Calls** | ✅ Встроено | ⚠️ Via integrations | ✅ Extensive | ❌ |

| **Поддержка RAG** | ✅ Встроено | ⚠️ Via integrations | ✅ Встроено | ❌ |Бизнес и лицензирование

| Функция | LM Studio | Ollama | Open WebUI | LMDeploy |

|---------|-----------|--------|------------|----------|

| **Лицензия** | Proprietary (бесплатно) | MIT (CLI) | Open Source | Apache 2.0 |

| **Корпоративные функции** | ✅ Team/Enterprise планы | ✅ Pro/Max уровни | ✅ Enterprise поддержка | ❌ |Бенчмарки производительности

Производительность — это то, где LM Studio сияет, благодаря оптимизированному бэкенду.

Пропускная способность с Continuous Batching

Движок llama.cpp v2.0 от LM Studio поддерживает continuous batching для параллельных запросов. Это критично для продакшн-сценариев, где нескольким агентам или пользователям нужен одновременный доступ.

Инсайт из бенчмарков: LMDeploy заявляет о 1.8× ускорении по сравнению с альтернативами благодаря persistent batch scheduling. Реализация LM Studio предоставляет аналогичные преимущества для сценариев с несколькими запросами.

Производительность в реальном мире

По отчётам пользователей и бенчмаркам NVIDIA:

| Размер модели | Оборудование | Токенов/сек | Примечания |

|--------------|--------------|-------------|------------|

| 7B (4-bit) | M2 Pro | ~40-50 | Плавная интерактивная скорость |

| 13B (4-bit) | RTX 4090 | ~30-40 | GPU полностью загружен |

| 20B (4-bit) | RTX 4090 (24GB) | ~15-20 | С GPU offloading |

| 27B (4-bit) | RTX 4090 | ~8-12 | Gemini 2-27B (блог NVIDIA) |

| 70B (4-bit) | Dual RTX 4090 | ~5-8 | Требуется разделение модели |Ключевой инсайт из моего тестирования: Квантование — ваш друг. 4-bit GGUF модели достигают качества, близкого к FP16, при доле затрат памяти. Для большинства приложений разница в качестве незначительна.

Влияние GPU Offloading

Блог NVIDIA продемонстрировал драматическое влияние GPU offloading:

-

Без GPU offloading: Gemini 2-27B при 2.1 токенов/сек (непригодно медленно)

-

С GPU offloading: Интерактивная скорость (~12-15 токенов/сек)

Именно поэтому я всегда рекомендую включать GPU offloading, если у вас есть совместимый NVIDIA GPU.

Бизнес-модель и лицензирование

Понимание бизнес-модели LM Studio важно для корпоративных развёртываний.

Текущее лицензирование

Для индивидуальных пользователей: LM Studio бесплатно для загрузки и использования. Официально: “LM Studio бесплатно для домашнего и рабочего использования” без ограничений на локальные модели.

Для предприятий: Компания предлагает Team/Enterprise планы с:

-

RBAC (Role-Based Access Control)

-

Audit logs

-

Развёртыванием на уровне организации

-

Приоритетной поддержкой

Open Source статус

Здесь есть нюансы:

-

Desktop приложение: Proprietary (closed-source)

-

CLI (

lms): MIT-licensed на GitHub -

SDK: MIT-licensed (TypeScript и Python)

-

Конфигурации моделей: Open source репозитории

Почему это важно: Для исследовательских проектов ASRP это означает, что мы можем свободно использовать LM Studio для разработки и внутренних развёртываний. Однако, если нам нужно модифицировать основной движок инференса или GUI, придётся работать с open-source компонентами или рассмотреть альтернативы.

Модель монетизации

Команда LM Studio поддерживается венчурными инвесторами (Element Labs Inc.). Их монетизация, по-видимому, полагается на:

-

Корпоративные контракты (Team/Enterprise планы)

-

Потенциальные платные облачные дополнения в будущем

-

Бесплатное распространение базового приложения для наращивания пользовательской базы

Это классическая модель, близкая к “open core” — бесплатно для индивидуальных пользователей, платно для корпоративных функций.

Вывод

LM Studio занимает уникальную позицию в ландшафте локальных LLM:

-

Для индивидуальных пользователей: Это бесплатный, полированный способ экспериментировать с локальными моделями

-

Для разработчиков: Предоставляет OpenAI-совместимые API и SDK для интеграции

-

Для предприятий: Предлагает headless-развёртывание и (вскоре) RBAC/audit функции

Мой вердикт: LM Studio заслуживает места в моём локальном AI-стеке наряду с Ollama и другими инструментами. У каждого есть сильные стороны:

-

LM Studio для GUI-ориентированного исследования и оптимизации Apple Silicon

-

Ollama для CLI-автоматизации и сообщества с библиотекой моделей

-

Open WebUI для веб-ориентированных коллаборативных развёртываний

Что дальше: В следующей статье этой серии я исследую OpenHands и OpenCode — open-source среды, оптимизированные для запуска меньших моделей (7B-13B) с уменьшенными контекстными окнами для более быстрой итерации.

Цель остаётся той же: построить полный цикл локального AI-стека, где я могу разрабатывать агентов на локальных моделях и развёртывать их таким же образом. Без корпоративных зависимостей. Без счетов за API. Только код и вычисления под моим контролем.

Источники

Меня зовут Михаил Капустин. Я сооснователь и CTO в ASRP, где мы строим трансатлантическую исследовательскую инфраструктуру для AI, блокчейна и исследований сознания. Если вы работаете над локальной AI-инфраструктурой или хотите обсудить архитектуру агентов, найдите меня на GitHub (https://github.com/Kapustin2000) или LinkedIn (https://www.linkedin.com/in/mykhailo-kapustin-55885612a/).

Эта статья — часть серии публикаций ASRP. Для более технических глубоких погружений посетите ASRP.science (https://asrp.science).

Автор: kapustinomm