Путь к автономному машинному интеллекту Версия 0.9.2, 2022-06-27

Ян Лекун (Yann LeCun)

Курантовский институт математических наук, Нью-Йоркский университет (Courant Institute of Mathematical Sciences, New York University)

yann@cs.nyu.edu

Meta – Fundamental AI Research

yann@fb.com

27 июня 2022 г.

Аннотация

Как машины могут учиться так же эффективно, как люди и животные? Как машины могут научиться рассуждать и планировать? Как машины могут изучать представления восприятий и планов действий на нескольких уровнях абстракции, что позволит им рассуждать, предсказывать и планировать на различных временных горизонтах? В этой позиционной статье предлагается архитектура и парадигмы обучения для построения автономных интеллектуальных агентов. Она объединяет такие концепции, как конфигурируемая предсказательная модель мира, поведение, движимое внутренней мотивацией, и иерархические архитектуры совместного вложения, обучаемые с помощью самоконтролируемого обучения.

Ключевые слова: Искусственный интеллект, Машинный здравый смысл, Когнитивная архитектура, Глубокое обучение, Самоконтролируемое обучение, Энергетическая модель, Модели мира, Архитектура совместного вложения, Внутренняя мотивация.

1. Пролог

Этот документ не является технической или научной статьей в традиционном смысле, а представляет собой позиционную работу, выражающую мое видение пути к интеллектуальным машинам, которые учатся больше похожим на животных и людей образом, способны рассуждать и планировать, и чье поведение определяется внутренними целями, а не жестко запрограммированными инструкциями, внешним контролем или внешними вознаграждениями. Многие идеи, описанные в этой статье (почти все из них), были сформулированы многими авторами в различных контекстах и в различной форме. Настоящая работа не претендует на приоритет в какой-либо из них, но представляет собой предложение о том, как собрать их в единое целое. В частности, в работе выявляются предстоящие трудности. Также перечисляется ряд направлений, которые, вероятно, будут успешными или неуспешными.

Текст написан с минимальным использованием жаргона и с использованием минимальных предварительных математических знаний, чтобы быть понятным читателям с самым разным образованием, включая нейробиологию, когнитивистику и философию, а также машинное обучение, робототехнику и другие инженерные дисциплины. Я надеюсь, что этот материал поможет лучше понять контекст некоторых исследований в области ИИ, чья значимость иногда неочевидна.

2. Введение

Животные и люди демонстрируют способности к обучению и пониманию мира, которые далеко превосходят возможности современных систем ИИ и машинного обучения (МО).

Как возможно, что подросток учится водить машину примерно за 20 часов практики, а дети учат язык при том, что по сути получают очень мало речевого воздействия? Как получается, что большинство людей знают, как действовать во многих ситуациях, с которыми они никогда раньше не сталкивались? Напротив, чтобы быть надежными, современные системы МО должны быть обучены на очень большом количестве попыток, чтобы даже самые редкие комбинации ситуаций часто встречались во время обучения. Тем не менее, наши лучшие системы МО все еще очень далеки от соответствия надежности человека в реальных задачах, таких как вождение, даже после того, как они были снабжены огромным количеством контрольных данных от экспертов-людей, после прохождения миллионов испытаний обучения с подкреплением в виртуальных средах и после того, как инженеры жестко прописали в них сотни вариантов поведения.

Ответ может заключаться в способности людей и многих животных изучать модели мира — внутренние модели того, как работает мир.

Сегодня исследования ИИ должны решить три основные проблемы:

Как машины могут научиться представлять мир, научиться предсказывать и научиться действовать в значительной степени посредством наблюдения?

Взаимодействия в реальном мире дороги и опасны; интеллектуальные агенты должны узнать как можно больше о мире без взаимодействия (путем наблюдения), чтобы свести к минимуму количество дорогих и опасных попыток, необходимых для изучения конкретной задачи.

-

Как машина может рассуждать и планировать способами, совместимыми с обучением на основе градиентов?

Наши лучшие подходы к обучению полагаются на оценку и использование градиента функции потерь, что может быть выполнено только с помощью дифференцируемых архитектур и с трудом согласуется с логическими символьными рассуждениями.

-

Как машины могут научиться представлять восприятия и планы действий иерархическим образом, на нескольких уровнях абстракции и в нескольких временных масштабах?

Люди и многие животные способны conceive (замышлять/создавать) многоуровневые абстракции, с помощью которых долгосрочные предсказания и долгосрочное планирование могут осуществляться путем разложения сложных действий на последовательности действий более низкого уровня.

В настоящей работе предлагается архитектура для интеллектуальных агентов с возможными решениями всех трех проблем.

Основные вклады этой статьи заключаются в следующем:

-

Общая когнитивная архитектура, в которой все модули дифференцируемы и многие из них обучаемы (Раздел 3, Рисунок 2).

-

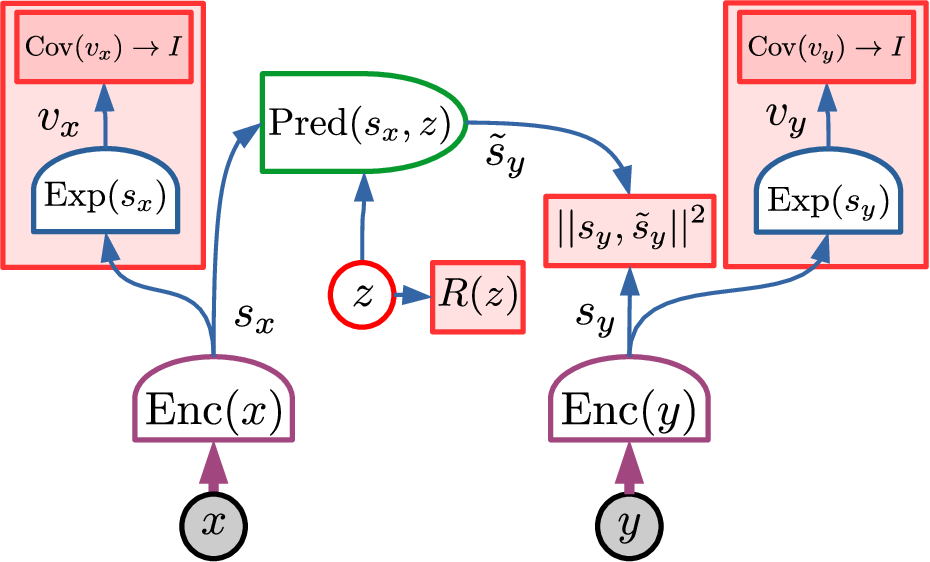

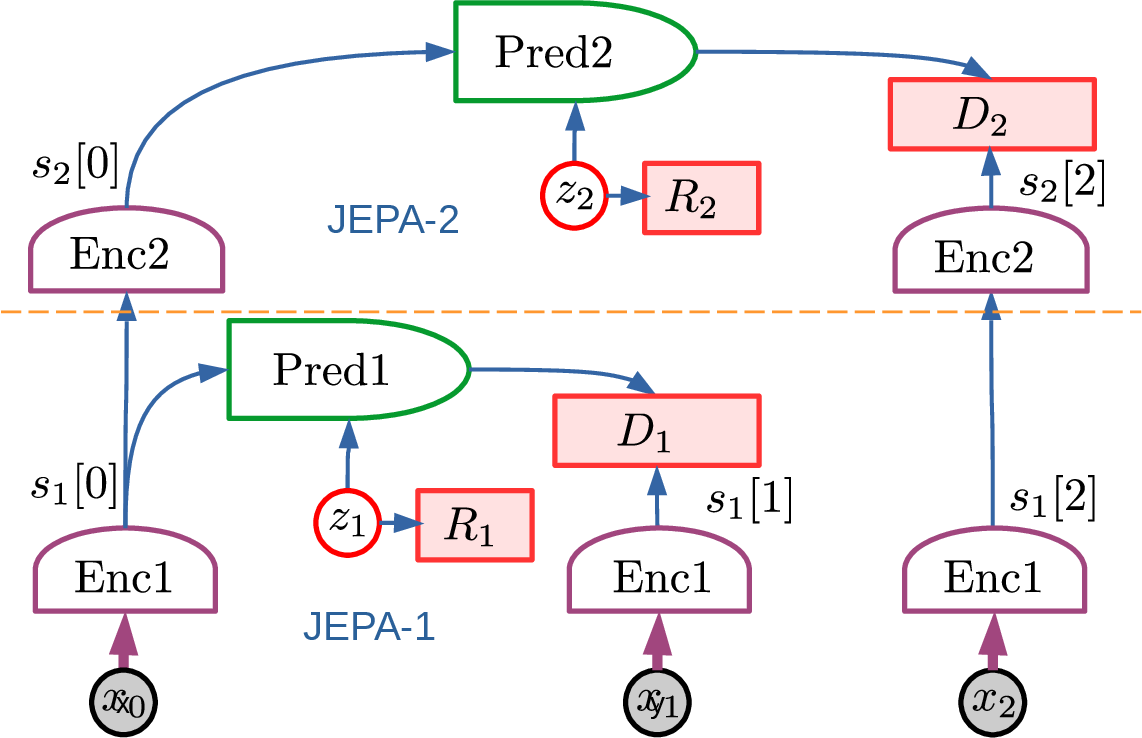

JEPA и Иерархическая JEPA: негенеративная архитектура для предсказательных моделей мира, которая изучает иерархию представлений (Разделы 4.4 и 4.6, Рисунки 12 и 15).

-

Неконтрастная парадигма самоконтролируемого обучения, которая создает представления, являющиеся одновременно информативными и предсказуемыми (Раздел 4.5, Рисунок 13).

-

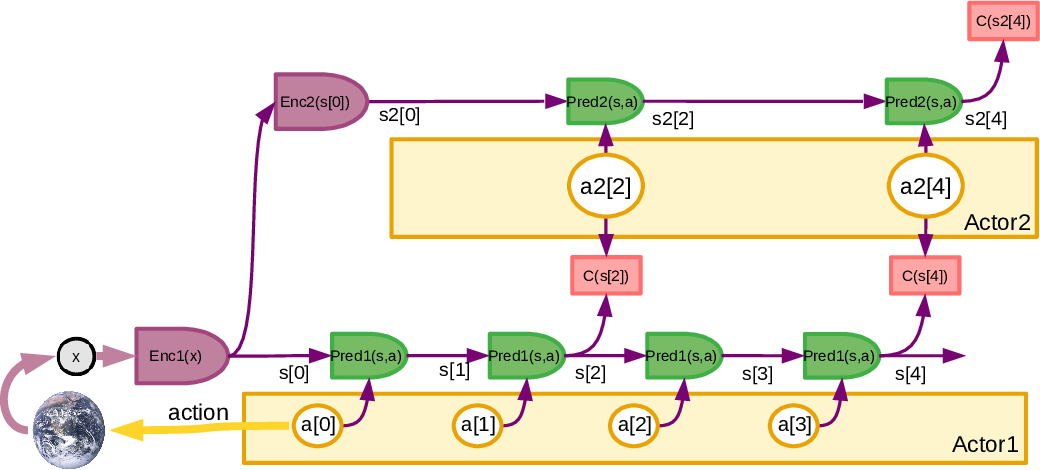

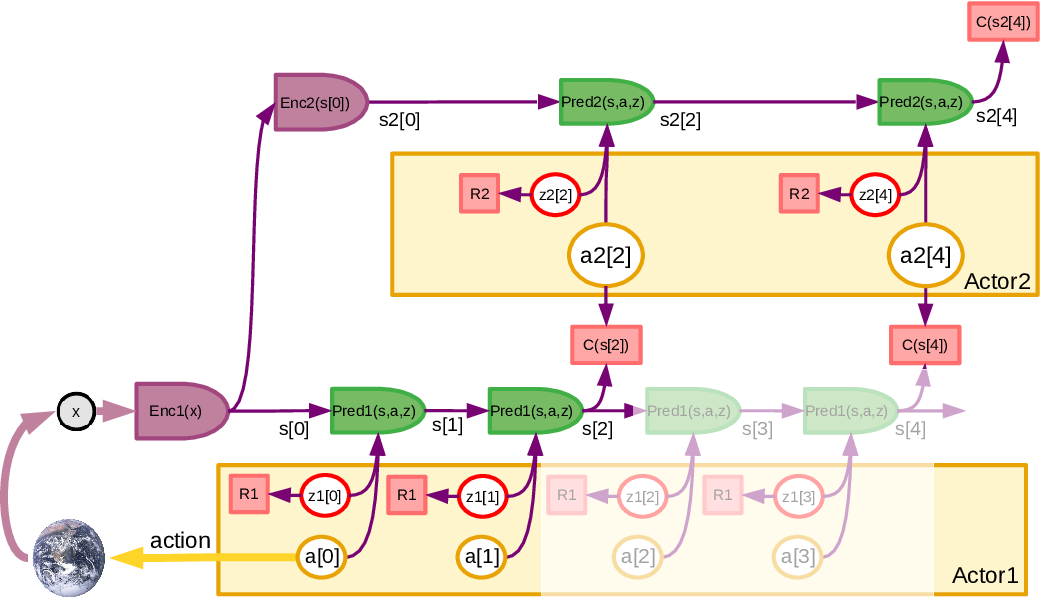

Способ использования H-JEPA в качестве основы для предсказательных моделей мира для иерархического планирования в условиях неопределенности (Раздел 4.7, Рисунки 16 и 17).

Нетерпеливые читатели могут сразу перейти к упомянутым разделам и рисункам.

2.1 Изучение моделей мира

Люди и животные, по-видимому, способны изучать огромное количество базовых знаний о том, как работает мир, посредством наблюдения и через непостижимо малое количество взаимодействий, не зависящим от задач, неконтролируемым образом. Можно предположить, что эти накопленные знания могут составлять основу того, что часто называют здравым смыслом. Здравый смысл можно рассматривать как набор моделей мира, которые могут сказать агенту, что вероятно, что правдоподобно, а что невозможно. Используя такие модели мира, животные могут изучать новые навыки с очень небольшим количеством попыток. Они могут предсказывать последствия своих действий, они могут рассуждать, планировать, исследовать и воображать новые решения проблем. Что важно, они также могут избегать совершения опасных ошибок при столкновении с неизвестной ситуацией.

Идея о том, что люди, животные и интеллектуальные системы используют модели мира, восходит к давним временам в психологии (Craik, 1943). Использование прямых моделей, которые предсказывают следующее состояние мира как функцию текущего состояния и рассматриваемого действия, было стандартной процедурой в оптимальном управлении с 1950-х годов (Bryson and Ho, 1969) и носит название управления с предсказанием модели (model-predictive control). Использование дифференцируемых моделей мира в обучении с подкреплением долгое время игнорировалось, но вновь набирает популярность (см., например, (Levine, 2021)).

Система автопилота для автомобилей может потребовать тысячи испытаний обучения с подкреплением, чтобы узнать, что слишком быстрая езда на повороте приведет к плохому результату, и научиться замедляться, чтобы избежать заноса. Напротив, люди могут использовать свое интимное знание интуитивной физики, чтобы предсказать такие результаты, и в значительной степени избегать фатальных действий при изучении нового навыка.

Знания здравого смысла позволяют животным не только предсказывать будущие результаты, но и восполнять недостающую информацию, будь то во времени или в пространстве. Это позволяет им создавать интерпретации восприятий, которые согласуются со здравым смыслом. Столкнувшись с неоднозначным восприятием, здравый смысл позволяет животным отбросить интерпретации, которые не соответствуют их внутренней модели мира, и обратить особое внимание, так как это может указывать на опасную ситуацию и возможность для уточнения модели мира.

Я утверждаю, что разработка парадигм обучения и архитектур, которые позволили бы машинам изучать модели мира неконтролируемым (или самоконтролируемым) образом и использовать эти модели для предсказания, рассуждений и планирования, является одной из главных проблем ИИ и МО сегодня. Одним из основных технических препятствий является то, как разработать обучаемые модели мира, которые могут справляться со сложной неопределенностью в предсказаниях.

2.2 Люди и животные изучают иерархии моделей

Люди и животные изучают базовые знания о том, как работает мир, в первые дни, недели и месяцы жизни. Хотя огромное количество таких знаний приобретается довольно быстро, они кажутся настолько фундаментальными, что мы считаем их само собой разумеющимися. В первые несколько месяцев жизни мы узнаем, что мир трехмерен. Мы узнаем, что каждый источник света, звука и осязания в мире находится на определенном расстоянии от нас. Тот факт, что каждая точка визуального восприятия имеет расстояние, является лучшим объяснением того, как наше восприятие мира меняется при переходе от левого глаза к правому или когда двигается наша голова. Параллактическое движение делает глубину очевидной, что, в свою очередь, делает очевидным понятие объекта, а также тот факт, что объекты могут перекрывать более удаленные. Как только существование объектов установлено, они могут быть автоматически отнесены к широким категориям в зависимости от их внешнего вида или поведения. Поверх понятия объекта возникает знание о том, что объекты не появляются, не исчезают, не меняют форму и не телепортируются самопроизвольно: они движутся плавно и могут находиться только в одном месте в любой момент времени. После усвоения таких концепций становится легко узнать, что некоторые объекты статичны, некоторые имеют предсказуемые траектории (неодушевленные объекты), некоторые ведут себя несколько непредсказуемо (коллективные явления, такие как вода, песок, листья деревьев на ветру и т. д.), а некоторые, кажется, подчиняются другим правилам (одушевленные объекты). На этой основе могут возникнуть понятия интуитивной физики, такие как устойчивость, гравитация, инерция и другие. Влияние одушевленных объектов на мир (включая влияние собственных действий субъекта) может быть использовано для вывода причинно-следственных связей, на основе которых могут быть приобретены лингвистические и социальные знания.

На Рисунке 1, предоставленном Эммануэлем Дюпу (Emmanuel Dupoux), показано, в каком возрасте младенцы, по-видимому, усваивают базовые концепции, такие как постоянство объекта, базовые категории, интуитивная физика и т. д. Концепции более высоких уровней абстракции, по-видимому, развиваются на основе концепций более низких уровней.

Обладая этими знаниями о мире, в сочетании с простыми врожденными поведенческими схемами и внутренними мотивациями/целями, животные могут быстро изучать новые задачи, предсказывать последствия своих действий и планировать наперед, предвидя успешные сценарии действий и избегая опасных ситуаций.

Но может ли человеческий или животный мозг содержать все модели мира, необходимые для выживания? Одна из гипотез в этой статье заключается в том, что у животных и людей есть только один механизм модели мира, где-то в их префронтальной коре. Этот механизм модели мира динамически конфигурируется для текущей задачи. С помощью единственного конфигурируемого механизма модели мира, а не отдельной модели для каждой ситуации, знания о том, как работает мир, могут быть общими для разных задач. Это может позволить рассуждать по аналогии, применяя модель, настроенную для одной ситуации, к другой ситуации.

Чтобы сделать вещи конкретными, я сразу перейду к описанию предложенной модели.

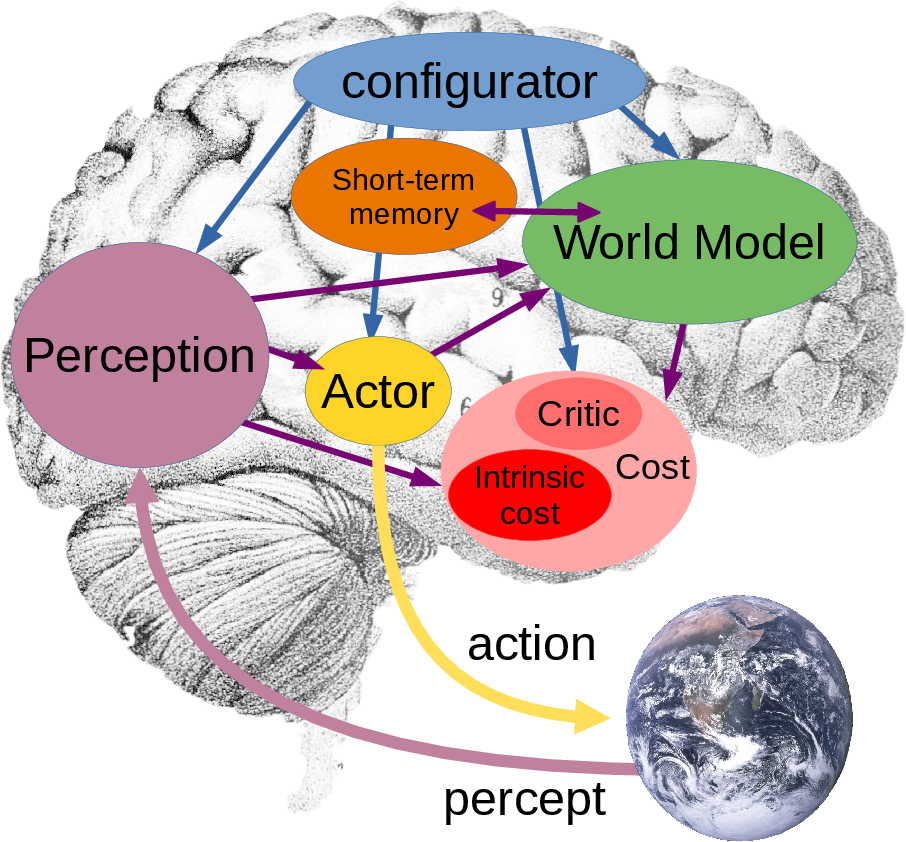

Figure 2: Системная архитектура автономного интеллекта. Предполагается, что все модули в этой модели являются “дифференцируемыми”, в том смысле, что модуль, передающий данные в другой (через соединяющую их стрелку), может получать оценки градиентов скалярного выхода стоимости по отношению к собственному выходу.

Модуль конфигуратора получает входные данные (не показаны для наглядности) от всех остальных модулей и настраивает их для выполнения текущей задачи.

Модуль восприятия оценивает текущее состояние мира.

Модуль модели мира предсказывает возможные будущие состояния мира как функцию последовательностей воображаемых действий, предложенных актором.

Модуль стоимости вычисляет единственный скалярный выход, называемый “энергией”, который измеряет уровень дискомфорта агента. Он состоит из двух подмодулей: внутренней стоимости, которая является неизменной (необучаемой) и вычисляет мгновенную энергию текущего состояния (боль, удовольствие, голод и т. д.), и критика (critic), обучаемого модуля, который предсказывает будущие значения внутренней стоимости.

Модуль краткосрочной памяти отслеживает текущие и предсказанные состояния мира, а также соответствующие внутренние стоимости.

Модуль актора (actor) вычисляет предложения для последовательностей действий. Модель мира и критик вычисляют возможные результаты. Актор может найти оптимальную последовательность действий, которая минимизирует оценочную будущую стоимость, и выводит первое действие в оптимальной последовательности.

Подробности см. в Разделе 3.

3. Архитектура модели автономного интеллекта

Предлагаемая архитектура для автономных интеллектуальных агентов изображена на Рисунке 2.

Она состоит из ряда модулей, функции которых описаны ниже. Некоторые модули конфигурируются на лету, т. е. их точная функция определяется модулем конфигуратора. Роль конфигуратора — исполнительный контроль: учитывая задачу, которую нужно выполнить, он предварительно настраивает восприятие, модель мира, стоимость и актора для текущей задачи. Конфигуратор модулирует параметры модулей, в которые он направляет данные.

Модуль конфигуратора получает входные данные от всех остальных модулей и настраивает их для текущей задачи, модулируя их параметры и контуры внимания. В частности, конфигуратор может подготовить систему восприятия, модель мира и модули стоимости для достижения определенной цели.

Модуль восприятия получает сигналы от сенсоров и оценивает текущее состояние мира. Для данной задачи актуальна и полезна лишь небольшая часть воспринимаемого состояния мира. Модуль восприятия может представлять состояние мира иерархически, на нескольких уровнях абстракции. Конфигуратор настраивает систему восприятия на извлечение актуальной информации из восприятия для текущей задачи.

Модуль модели мира является самой сложной частью архитектуры. Его роль двояка: (1) оценивать недостающую информацию о состоянии мира, не предоставленную восприятием, (2) предсказывать правдоподобные будущие состояния мира. Модель мира может предсказывать естественную эволюцию мира или будущие состояния мира, возникающие в результате последовательности действий, предложенной модулем актора. Модель мира может предсказывать несколько правдоподобных состояний мира, параметризованных латентными переменными, которые представляют неопределенность в отношении состояния мира. Модель мира — это своего рода “симулятор” релевантных аспектов мира. Какие аспекты состояния мира релевантны, зависит от текущей задачи. Конфигуратор настраивает модель мира для обработки текущей ситуации. Предсказания выполняются в абстрактном пространстве представлений, содержащем информацию, актуальную для текущей задачи. В идеале модель мира оперирует представлениями состояния мира на нескольких уровнях абстракции, что позволяет ей предсказывать в разных временных масштабах.

Ключевой вопрос заключается в том, что модель мира должна уметь представлять несколько возможных предсказаний состояния мира. Естественный мир не полностью предсказуем. Это особенно верно, если он содержит других интеллектуальных агентов, которые могут быть антагонистичны. Но это часто верно, даже когда мир содержит только неодушевленные объекты, поведение которых хаотично, или состояние которых не полностью наблюдаемо.

Существует два основных вопроса, на которые нужно ответить при построении предлагаемых архитектур: (1) Как позволить модели мира делать несколько правдоподобных предсказаний и представлять неопределенность в предсказаниях, и (2) как обучать модель мира.

Модуль стоимости измеряет уровень “дискомфорта” агента в виде скалярной величины, называемой энергией. Энергия — это сумма двух энергетических членов, вычисляемых двумя подмодулями: модулем внутренней стоимости (Intrinsic Cost) и обучаемым модулем критика (Trainable Critic). Общая цель агента — совершать действия, чтобы оставаться в состояниях, минимизирующих среднюю энергию.

Модуль внутренней стоимости является врожденным (неизменным, необучаемым) и вычисляет один скаляр — внутреннюю энергию, которая измеряет мгновенный “дискомфорт” агента — представьте боль (высокая внутренняя энергия), удовольствие (низкая или отрицательная внутренняя энергия), голод и т. д. Входом для модуля является текущее состояние мира, произведенное модулем восприятия, или потенциальные будущие состояния, предсказанные моделью мира. Конечная цель агента — минимизировать внутреннюю стоимость в долгосрочной перспективе. Именно здесь находятся базовые поведенческие драйвы и внутренние мотивации. Дизайн модуля внутренней стоимости определяет природу поведения агента. Базовые драйвы могут быть врожденными в этом модуле. Это может включать ощущение “хорошего” (низкая энергия) при стоянии, чтобы мотивировать шагающего робота ходить, при влиянии на состояние мира, чтобы мотивировать субъектность, при взаимодействии с людьми, чтобы мотивировать социальное поведение, при восприятии радости у находящихся рядом людей, чтобы мотивировать эмпатию, при наличии полного запаса энергии (голод/сытость), при столкновении с новой ситуацией, чтобы мотивировать любопытство и исследование, при выполнении определенной программы и т. д. И наоборот, энергия будет высокой при столкновении с болезненной ситуацией или легко распознаваемой опасной ситуацией (близость к экстремальному жару, огню и т. д.), или при использовании опасных инструментов. Модуль внутренней стоимости может модулироваться конфигуратором для управления разным поведением в разное время.

Обучаемый модуль критика предсказывает оценку будущих внутренних энергий. Как и внутренняя стоимость, его входом является либо текущее состояние мира, либо возможные состояния, предсказанные моделью мира. Для обучения критик извлекает прошлые состояния и последующие внутренние стоимости, сохраненные в модуле ассоциативной памяти, и тренируется предсказывать последние на основе первых. Функция модуля критика может быть динамически сконфигурирована конфигуратором для направления системы к определенной подцели как части более крупной задачи.

Поскольку оба подмодуля модуля стоимости дифференцируемы, градиент энергии может быть распространен обратно через другие модули, в частности через модель мира, актора и восприятие, для планирования, рассуждений и обучения.

Модуль краткосрочной памяти хранит актуальную информацию о прошлых, текущих и будущих состояниях мира, а также соответствующее значение внутренней стоимости. Модель мира обращается к краткосрочной памяти и обновляет ее, временно предсказывая будущие (или прошлые) состояния мира, а также пространственно восполняя недостающую информацию или исправляя несогласованную информацию о текущем состоянии мира. Модель мира может отправлять запросы в краткосрочную память и получать извлеченные значения или сохранять новые значения состояний. Модуль критика может быть обучен путем извлечения прошлых состояний и связанных с ними внутренних стоимостей из памяти. Архитектура может быть похожа на архитектуру сетей с ключ-значение памятью (Key-Value Memory Networks) (Miller et al., 2016). Этот модуль можно рассматривать как выполняющий некоторые из тех же функций, что и гиппокамп у позвоночных.

Модуль актора вычисляет предложения для последовательностей действий и выводит действия на эффекторы. Актор предлагает последовательность действий для модели мира. Модель мира предсказывает последовательности будущих состояний мира из последовательности действий и передает их модулю стоимости. Учитывая цель, определенную модулем стоимости (как настроено конфигуратором), модуль стоимости вычисляет оценочную будущую энергию, связанную с предложенной последовательностью действий. Поскольку у актора есть доступ к градиенту оценочной стоимости по отношению к предложенной последовательности действий, он может вычислить оптимальную последовательность действий, которая минимизирует оценочную стоимость, используя методы на основе градиента. Если пространство действий дискретно, для поиска оптимальной последовательности действий может использоваться динамическое программирование. После завершения оптимизации актор выводит первое действие (или короткую последовательность действий) на эффекторы. Этот процесс аналогичен управлению с предсказанием модели (model-predictive control) в оптимальном управлении (Bryson and Ho, 1969).

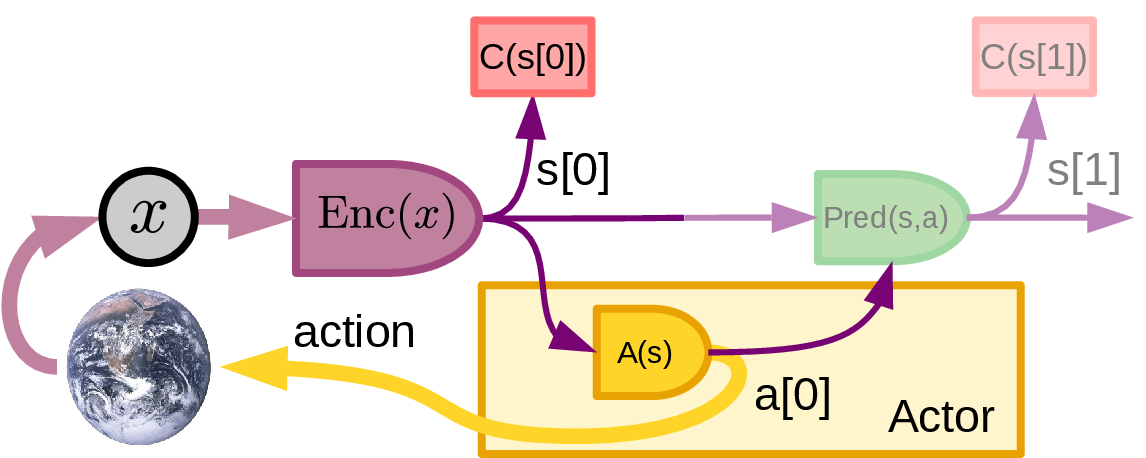

Figure 3: Эпизод восприятия-действия в Режиме-1. Модуль восприятия оценивает состояние мира. Актор напрямую вычисляет действие или короткую последовательность действий через модуль политики

.

Этот реактивный процесс не использует модель мира или модуль стоимости. Модуль стоимости вычисляет энергию начального состоянияи сохраняет пары

в краткосрочной памяти. По желанию он также может предсказать следующее состояние, используя модель мира

, и соответствующую энергию

, чтобы модель мира могла быть скорректирована после того, как станет доступно следующее наблюдение, полученное в результате предпринятого действия.

Актор может состоять из двух компонентов: (1) модуля политики, который напрямую производит действие из оценки состояния мира, полученной восприятием и извлеченной из краткосрочной памяти, и (2) оптимизатора действий, как описано выше, для управления с предсказанием модели. Первый режим похож на “Систему 1” Даниэля Канемана, а второй режим похож на “Систему 2” (Kahneman, 2011).

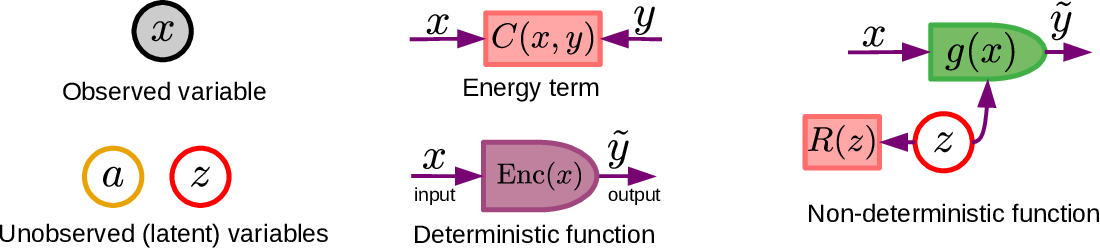

Далее мы будем использовать специальные символы для обозначения различных компонентов на архитектурных диаграммах. Краткое объяснение приведено в Приложении 8.3.3.

3.1 Типичные циклы восприятия-действия

Существует два возможных режима, которые модель может использовать для эпизода восприятия-действия. Первый не включает сложных рассуждений и производит действие напрямую из выхода восприятия и возможного доступа к краткосрочной памяти. Мы будем называть его “Режим-1” по аналогии с “Системой 1” Канемана. Второй режим включает рассуждения и планирование через модель мира и модуль стоимости. Он аналогичен управлению с предсказанием модели (MPC) — классической парадигме планирования и рассуждений в оптимальном управлении и робототехнике. Мы будем называть его “Режим-2” по аналогии с “Системой 2” Канемана. Мы используем термин “рассуждения” здесь в широком смысле, подразумевая удовлетворение ограничений (или минимизацию энергии). Многие типы рассуждений можно рассматривать как формы минимизации энергии.

3.1.1 Режим-1: Реактивное поведение

Эпизод восприятия-действия для Режима-1 изображен на Рисунке 3.

Модуль восприятия через модуль кодировщика извлекает представление состояния мира, содержащее актуальную информацию для текущей задачи. Модуль политики, компонент актора, производит действие как функцию состояния

. Результирующее действие отправляется на эффекторы.

Функция модуля политики модулируется конфигуратором, который настраивает его для текущей задачи.

Модуль политики реализует чисто реактивную политику, которая не включает намеренного планирования или предсказания через модель мира. Тем не менее, его структура может быть довольно сложной. Например, в дополнение к состоянию, модуль политики может обращаться к краткосрочной памяти для получения более полной информации о предыдущих состояниях мира. Он может использовать краткосрочную память для ассоциативного извлечения действия, данного текущему состоянию.

Хотя модуль стоимости дифференцируем, его выходкосвенно зависит от предыдущих действий через внешний мир. Поскольку мир не дифференцируем, нельзя распространять градиенты от стоимости через цепочку стоимость

восприятие

мир

действие. В этом режиме градиенты стоимости

по отношению к действиям могут быть оценены только путем опроса мира с помощью множества возмущенных действий, но это медленно и потенциально опасно. Этот процесс соответствовал бы классическим методам градиента политики в обучении с подкреплением.

Во время Режима-1 система может по желанию корректировать модель мира. Она запускает модель мира на один шаг, предсказывая следующее состояние, затем она ждет следующего восприятия, полученного в результате предпринятого действия, и использует наблюдаемое состояние мира в качестве цели для предиктора.

Используя модель мира, агент может воображать сценарии действий и предсказывать их эффект и результат, уменьшая потребность в выполнении дорогого и опасного поиска хороших действий и политик путем испытания множества действий во внешнем мире и измерения результата.

3.1.2 Режим-2: рассуждения и планирование с использованием модели мира

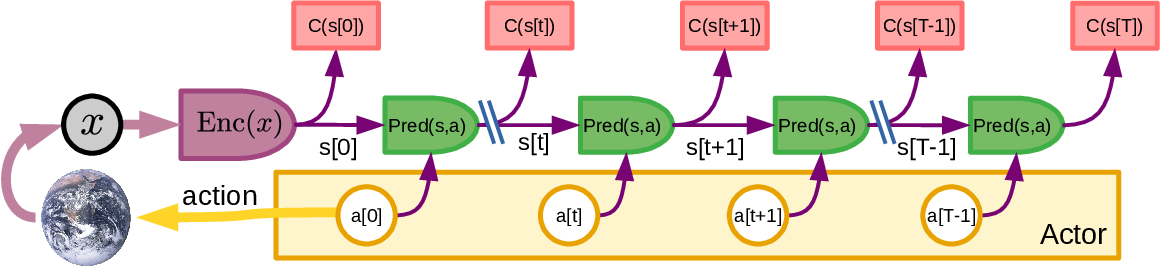

Типичный эпизод восприятия-действия для Режима-2 изображен на Рисунке 4.

-

восприятие: система восприятия извлекает представление текущего состояния мира

. Модуль стоимости вычисляет и сохраняет непосредственную стоимость, связанную с этим состоянием.

-

предложение действия: актор предлагает начальную последовательность действий для подачи в модель мира для оценки

-

симуляция: модель мира предсказывает одну или несколько вероятных последовательностей представлений состояния мира, возникающих в результате предложенной последовательности действий

-

оценка: модуль стоимости оценивает общую стоимость из предсказанной последовательности состояний, обычно как сумму по временным шагам

-

планирование: актор предлагает новую последовательность действий с более низкой стоимостью. Это можно сделать с помощью процедуры на основе градиента, в которой градиенты стоимости распространяются обратно через вычислительный граф к переменным действия. Результирующая последовательность действий с минимальной стоимостью обозначается

. Полная оптимизация может потребовать итерации шагов 2-5.

-

действие: после сходимости к последовательности действий с низкой стоимостью актор отправляет первое действие (или первые несколько действий) в последовательности с низкой стоимостью на эффекторы. Весь процесс повторяется для следующего эпизода восприятия-действия.

-

память: после каждого действия состояния и соответствующие стоимости от внутренней стоимости и критика сохраняются в краткосрочной памяти. Эти пары могут быть использованы позже для обучения или адаптации критика.

Figure 4: Эпизод восприятия-действия в Режиме-2. Модуль восприятия оценивает состояние мира s[0]. Актор предлагает последовательность действий a[0], a[1],…,a[t],a[t+1],…,a[T]. Модель мира рекурсивно предсказывает оценку последовательности состояний мира, используя s[t+1] = Pred(s[t],a[t]). Стоимость C(s[t]) вычисляет энергию для каждого предсказанного состояния в последовательности, общей энергией является их сумма. С помощью процедуры оптимизации или поиска актор выводит последовательность действий, которая минимизирует общую энергию. Затем он отправляет первое действие в последовательности (или первые несколько действий) на эффекторы. Это, по сути, классическое управление с предсказанием модели с планированием на скользящем горизонте. Поскольку стоимость и модель дифференцируемы, можно использовать методы на основе градиента для поиска оптимальных последовательностей действий, как в классическом оптимальном управлении. Поскольку полная энергия аддитивна во времени, также можно использовать динамическое программирование, особенно когда пространство действий мало и дискретизировано. Пары состояний (вычисленные кодировщиком или предсказанные предиктором) и соответствующие энергии от внутренней стоимости и обучаемого критика сохраняются в краткосрочной памяти для последующего обучения критика.

Эта процедура по сути представляет собой то, что в литературе по оптимальному управлению известно как управление с предсказанием модели (MPC) с скользящим горизонтом. Отличие от классического оптимального управления заключается в том, что модель мира и функция стоимости изучаются.

В принципе, для шага 5 может использоваться любая форма стратегии оптимизации. Хотя методы оптимизации на основе градиента могут быть эффективными, когда модель мира и стоимость ведут себя корректно, ситуации, в которых отображение действие-стоимость имеет разрывы, могут потребовать использования других стратегий оптимизации, особенно если пространства состояний и/или действий могут быть дискретизированы. Эти стратегии включают динамическое программирование, комбинаторную оптимизацию, имитацию отжига и другие методы без градиентов, эвристические методы поиска (например, поиск по дереву с отсечением) и т. д.

Для упрощения процесс был описан в детерминированном случае, т. е. когда нет необходимости учитывать возможность множественных предсказаний для s[t+1], возникающих из заданного начального состояния s[t] и действия a[t]. В реальных ситуациях мир, вероятно, будет несколько непредсказуемым. Несколько состояний могут возникнуть из одного начального состояния и действия из-за того, что мир внутренне стохастичен (алеаторная неопределенность), или что представление состояния s[t] содержит неполную информацию о истинном состоянии мира (эпистемическая неопределенность), или что точность предсказания модели мира несовершенна из-за ограниченных обучающих данных, репрезентативной способности или вычислительных ограничений.

Figure 5: Обучение реактивного модуля политики на основе результата рассуждений в Режиме-2. Использование Режима-2 обременительно, поскольку оно мобилизует все ресурсы агента для текущей задачи. Это включает многократный запуск модели мира на множестве временных шагов. На этой диаграмме показано, как обучить модуль политикиаппроксимировать действие, которое является результатом оптимизации в Режиме-2. Система сначала работает в Режиме-2 и производит оптимальную последовательность действий

. Затем параметры модуля политики настраиваются на минимизацию расхождения

,

между оптимальным действием и выходом модуля политики. Это приводит к созданию модуля политики, который выполняет амортизированный вывод и производит приближение для хорошей последовательности действий. Затем модуль политики может использоваться для реактивного производства действий в Режиме-1 или для инициализации последовательности действий перед выводом в Режиме-2 и, таким образом, ускорения оптимизации.

3.1.3 От Режима-2 к Режиму-1: Изучение новых навыков

Использование Режима-2 обременительно. Агент обладает только одним “движителем” модели мира. Он конфигурируется конфигуратором для текущей задачи, но может использоваться только для одной задачи за раз. Следовательно, подобно людям, агент может фокусироваться только на одной сложной задаче одновременно.

Режим-1 значительно менее обременителен, так как требует только одного прохода через модуль политики. Агент может иметь несколько модулей политики, работающих одновременно, каждый из которых специализирован для определенного набора задач.

Процесс, описанный на Рисунке 5, показывает, как модуль политикиможет быть обучен производить аппроксимации оптимальных действий, являющихся результатом рассуждений в Режиме-2. Система работает в Режиме-2, производя оптимальную последовательность действий

. Затем параметры модуля политики

обновляются для минимизации меры расхождения между его выходом и оптимальным действием в этот момент времени

. После надлежащего обучения модуль политики может использоваться для непосредственного производства действия в Режиме-1

. Он также может использоваться для рекурсивного вычисления начального предложения последовательности действий перед оптимизацией в Режиме-2:

Модуль политики можно рассматривать как выполняющий форму амортизированного вывода.

Этот процесс позволяет агенту использовать всю мощь своей модели мира и возможностей рассуждения для приобретения новых навыков, которые затем “компилируются” в реактивный модуль политики, который больше не требует тщательного планирования.

3.1.4 Рассуждения как минимизация энергии

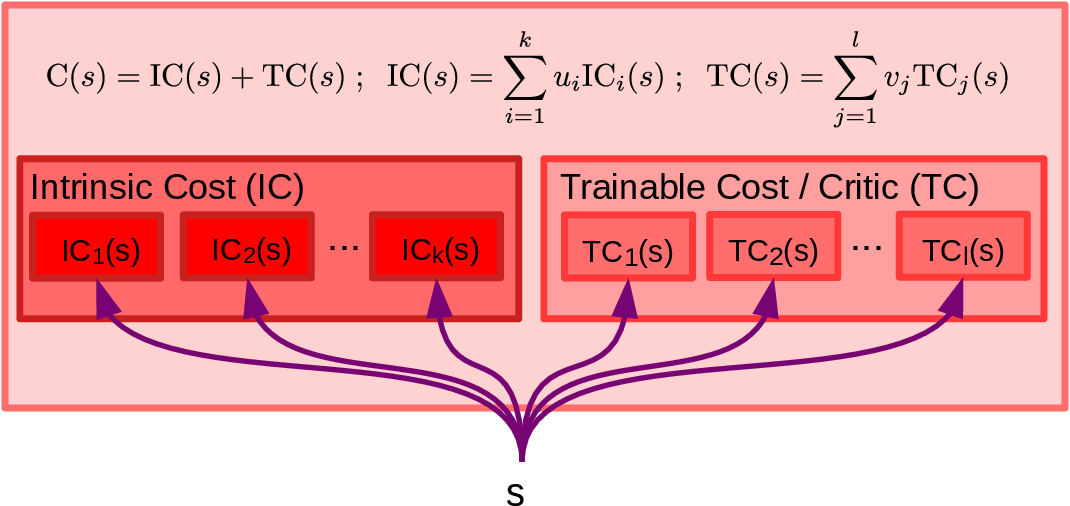

Рисунок 6: Архитектура модуля затрат. Модуль затрат состоит из внутреннего модуля затрат, который является неизменным(слева), и критика или обучаемого модуля затрат

(справа), который поддается обучению. Как IC, так и TC состоят из нескольких подмодулей, выходные энергии которых линейно комбинируются. Каждый подмодуль придает агенту определенное поведенческое стремление. Веса в линейной комбинации,

и

, определяются модулем конфигуратора и позволяют агенту сосредоточиться на разных подцелях в разное время.

Процесс выработки подходящей последовательности действий в Режиме-2 можно рассматривать как форму рассуждений. Эта форма рассуждений основана на симуляции с использованием модели мира и оптимизации энергии по отношению к последовательностям действий. В более общем смысле “действия” можно рассматривать как латентные переменные, представляющие абстрактные преобразования из одного состояния в следующее. Этот тип планирования через симуляцию и оптимизацию может составлять тот вид рассуждений, который наиболее часто встречается в естественном интеллекте.

Многие классические формы рассуждений в ИИ на самом деле могут быть сформулированы как задачи оптимизации (или задачи удовлетворения ограничений). Это определенно верно для вероятностного вывода, выполняемого с факторными графами и вероятностными графическими моделями. Предлагаемая архитектура фактически является факторным графом, в котором модули стоимости являются логарифмическими множителями. Но тип рассуждений, который позволяет предлагаемая архитектура, выходит за рамки традиционных логических и вероятностных рассуждений. Она позволяет рассуждать через симуляцию и по аналогии.

3.2 Модуль стоимости как драйвер поведения

Общая архитектура модуля стоимости показана на Рисунке 6. Он состоит из модуля внутренней стоимости, который является неизменным, и критика или обучаемой стоимости

, которая является обучаемой. И IC, и TC состоят из нескольких подмодулей, выходные энергии которых линейно комбинируются

Каждый подмодуль придает агенту определенную поведенческую мотивацию. Веса в линейной комбинации,и

, модулируются модулем конфигуратора и позволяют агенту фокусироваться на различных подцелях в разное время.

Модуль внутренней стоимости (IC) — это то, где определяется базовая поведенческая природа агента. Здесь косвенно задаются базовые виды поведения.

Для робота эти члены включали бы очевидные проприоцептивные измерения, соответствующие “боли”, “голоду” и “инстинктивным страхам”, измеряющие такие вещи, как перегрузки от внешних сил, опасные электрические, химические или тепловые среды, чрезмерное потребление энергии, низкий уровень запасов энергии в источнике питания и т. д.

Они также могут включать базовые драйвы, помогающие агенту изучать базовые навыки или выполнять свои миссии. Например, шагающий робот может включать внутреннюю стоимость, побуждающую его вставать и ходить. Это также может включать социальные драйвы, такие как поиск компании людей, вознаграждение от взаимодействия с людьми и похвалы от них, и ощущение их боли неприятным (сродни эмпатии у социальных животных). Другие внутренние поведенческие драйвы, такие как любопытство или совершение действий, имеющих наблюдаемый эффект, могут быть включены для максимизации разнообразия ситуаций, на которых обучается модель мира (Gottlieb et al., 2013).

IC можно рассматривать как играющий роль, аналогичную роли миндалевидного тела в мозге млекопитающих и подобных структур у других позвоночных.

Чтобы предотвратить своего рода поведенческий коллапс или неконтролируемый дрейф в сторону плохого поведения, IC должен быть неизменным и не подлежать обучению (а также внешним модификациям).

Роль критика (TC) двояка: (1) предвидеть долгосрочные результаты с минимальным использованием ресурсоемкой модели мира, и (2) позволить конфигуратору заставить агента сосредоточиться на достижении подцелей с изученной стоимостью.

В целом поведенческая природа ИИ-агента может быть задана четырьмя способами:

-

путем явного программирования определенного поведения, активируемого при выполнении определенных условий

-

путем определения целевой функции таким образом, чтобы желаемое поведение выполнялось агентом в результате нахождения последовательностей действий, минимизирующих цель.

-

путем обучения агента вести себя определенным образом под прямым контролем. Агент наблюдает за действиями учителя-эксперта и обучает модуль политики Режима-1 воспроизводить его.

-

путем обучения агента через имитационное обучение. Агент наблюдает за учителями-экспертами и выводит целевую функцию, которую, судя по всему, оптимизирует их поведение при действии. Это создает подмодуль критика для поведения в Режиме-2. Этот процесс иногда называют обратным обучением с подкреплением.

Второй метод значительно проще в инженерном плане, чем первый, поскольку он требует лишь разработки цели, а не полного поведения. Второй метод также более надежен: предопределенное поведение может быть аннулировано неожиданными условиями или изменяющейся средой. С целью агент может адаптировать свое поведение для удовлетворения цели, несмотря на неожиданные условия и изменения в среде. Второй метод использует способности агента к обучению и выводу, чтобы минимизировать количество априорных знаний, жестко заложенных проектировщиком, которые могут быть хрупкими.

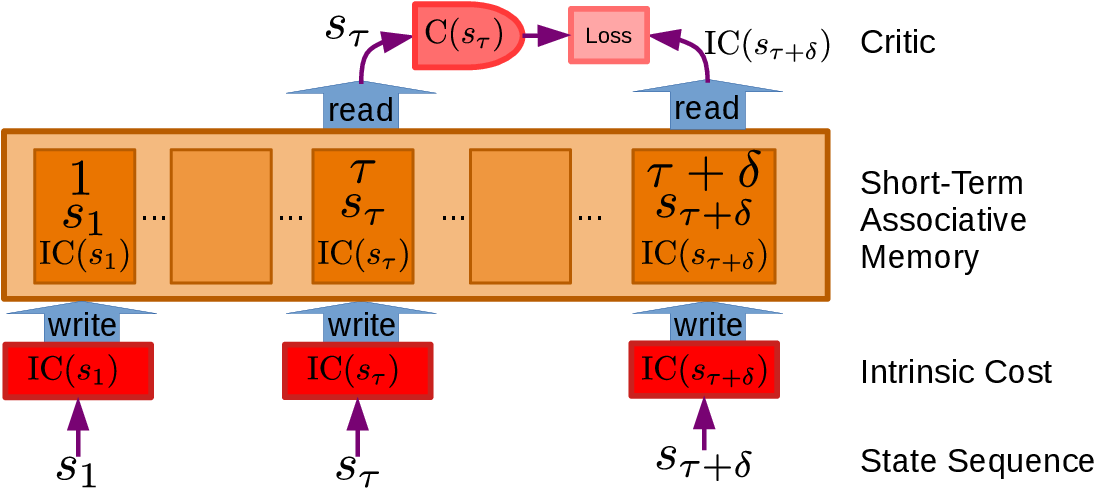

3.3 Обучение критика

Рисунок 7: Обучение критика. Во время эпизодов планирования модуль внутренней стоимости сохраняет тройки (время, состояние, внутренняя энергия):в ассоциативной кратковременной памяти. Во время эпизодов обучения критика критика извлекает вектор прошлого состояния

вместе с внутренней энергией в более поздний момент времени

. В простейшем сценарии критик корректирует свои параметры, чтобы минимизировать меру расхождения между целевым значением

и прогнозируемой энергией

. В более сложных схемах он может использовать комбинации будущих внутренних энергий в качестве целевых значений. Обратите внимание, что последовательность состояний может содержать информацию о действиях, запланированных или предпринятых агентом.

Существенный вопрос — как обучать критика.

Главная роль критика — предсказывать будущие значения внутренней энергии. Для этого он использует модуль краткосрочной памяти. Этот модуль представляет собой ассоциативную память, в которую модуль внутренней стоимости сохраняет триплеты (время, состояние, внутренняя энергия):. Сохраненные состояния и соответствующие внутренние энергии могут соответствовать воспринятому состоянию или состоянию, воображенному моделью мира во время эпизода Режима-2. Память может извлекать состояние

по времени

и может извлекать энергию

по времени

или состоянию

. При подходящей архитектуре памяти извлечение может включать интерполяцию ключей и извлекаемых значений. Процесс показан на Рисунке 7.

Критик может быть обучен предсказывать будущие значения внутренней энергии путем извлечения вектора прошлого состояниявместе с внутренней энергией в более позднее время

. Затем параметры критика могут быть оптимизированы для минимизации потерь предсказания, например

. Это простой сценарий. Можно разработать более сложные схемы для предсказания ожиданий дисконтированных будущих энергий или их распределений. Обратите внимание, что векторы состояния могут содержать информацию о действиях, предпринятых или воображенных актором.

На общем уровне это похоже на методы обучения критика, используемые в таких подходах обучения с подкреплением, как A2C.

Краткосрочная память может быть реализована как модуль памяти в сети ключ-значение памяти: вектор запроса сравнивается с рядом ключевых векторов, создавая вектор оценок. Оценки нормализуются и используются как коэффициенты для вывода линейной комбинации сохраненных значений. Это можно рассматривать как “мягкую” ассоциативную память, способную к интерполяции. Одним из преимуществ этого является то, что при правильной схеме выделения новых слотов ключ/значение она способна к однократному обучению, но при этом может интерполировать между ключами и является сквозной дифференцируемой.

4. Проектирование и обучение Модели Мира

Можно утверждать, что проектирование архитектур и парадигм обучения для модели мира представляет собой главное препятствие на пути реального прогресса в ИИ в ближайшие десятилетия. Одним из основных вкладов данного предложения является именно иерархическая архитектура и процедура обучения моделей мира, которые могут представлять множество исходов в своих предсказаниях.

Обучение модели мира — это типичный пример Самоконтролируемого обучения, основная идея которого заключается в завершении шаблона (pattern completion). Предсказание будущих входных данных (или временно ненаблюдаемых входных данных) является частным случаем завершения шаблона. В данной работе основная цель модели мира рассматривается как предсказание будущих представлений состояния мира.

Необходимо решить три основные проблемы. Во-первых, совершенно очевидно, что качество модели мира будет сильно зависеть от разнообразия последовательностей состояний или троек (состояние, действие, результирующее состояние), которые она способна наблюдать во время обучения. Во-вторых, поскольку мир не является полностью предсказуемым, может существовать несколько правдоподобных представлений состояния мира, которые следуют за данным представлением состояния мира и действием агента. Модель мира должна уметь осмысленно представлять эту, возможно, бесконечную совокупность правдоподобных предсказаний. В-третьих, модель мира должна уметь делать предсказания в разных временных масштабах и на разных уровнях абстракции.

Первая проблема затрагивает один из главных вопросов, касающихся обучения для процессов последовательного принятия решений: разнообразие “обучающего множества” зависит от предпринятых действий. Эта проблема обсуждается ниже в разделе 4.10.

Вторая проблема еще более серьезна: мир не является полностью предсказуемым. Следовательно, модель мира должна уметь представлять множество правдоподобных исходов из данного состояния и (необязательно) действия. Это может составлять одну из самых сложных проблем, на которую данное предложение предлагает решение. Эта проблема обсуждается ниже в разделе 4.8.

Третья проблема связана с проблемой долгосрочного предсказания и планирования. Люди планируют сложные цели на абстрактном уровне и используют высокоуровневые описания состояний мира и действий для совершения предсказаний. Высокоуровневые цели затем разбиваются на последовательности более элементарных последовательностей подцелей, используя краткосрочные предсказания от модели мира для выработки низкоуровневых действий. Этот процесс декомпозиции повторяется вплоть до миллисекундного управления мышцами, с учетом локальных условий. Вопрос о том, как модели мира могли бы представлять планы действий в различных временных масштабах и на различных уровнях абстракции, обсуждается в разделе 4.6.

4.1 Самоконтролируемое обучение

Самоконтролируемое обучение (Self-Supervised Learning, SSL) — это парадигма, в которой система обучения обучается фиксировать взаимные зависимости между своими входными данными. Конкретно это часто сводится к обучению системы сообщать нам, являются ли различные части ее входных данных согласованными друг с другом.

Например, в сценарии предсказания видео системе дают два видеоклипа, и она должна сообщить нам, в какой степени второй видеоклип является правдоподобным продолжением первого. В сценарии завершения шаблона системе дают часть входных данных (изображение, текст, аудиосигнал) вместе с предложением для остальной части входных данных, и она сообщает нам, является ли предложение правдоподобным завершением первой части. В дальнейшем мы будем обозначать наблюдаемую часть входных данных как, а возможно, ненаблюдаемую часть — как

.

Важно, что мы не требуем, чтобы модель могла предсказыватьиз

. Причина в том, что может существовать бесконечное количество

, совместимых с данным

. В настройке предсказания видео существует бесконечное количество видеоклипов, которые являются правдоподобными продолжениями данного клипа. Может быть сложно или неразрешимо явно представить множество правдоподобных предсказаний. Но кажется менее затруднительным просто попросить систему сказать нам, совместим ли предложенный

с данным

.

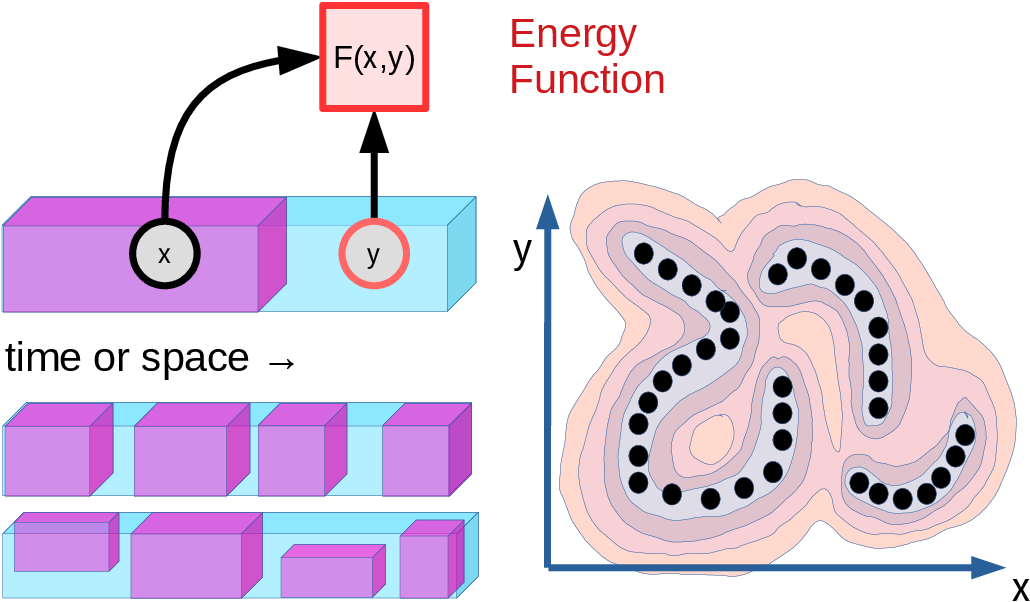

Общая формулировка может быть выполнена с помощью фреймворка Энергетических Моделей (Energy-Based Models, EBM). Система представляет собой скалярную функцию, которая выдает низкие значения энергии, когда

и

совместимы, и более высокие значения, когда они несовместимы. Эта концепция изображена на Рисунке 8. Точки данных — это черные точки. Энергетическая функция выдает низкие значения энергии вокруг точек данных и более высокие энергии вдали от областей с высокой плотностью данных, как символизируют контурные линии энергетического ландшафта. Неявная формулировка функции EBM позволяет системе представлять многомодальные зависимости, в которых несколько значений

совместимы с данным

. Множество

, совместимых с данным

, может быть одной точкой, несколькими дискретными точками, многообразием или набором точек и многообразий.

Чтобы обеспечить планирование в Режиме-2, предсказательная модель мира должна быть обучена фиксировать зависимости между прошлыми и будущими восприятиями. Она должна уметь предсказывать представления будущего из представлений прошлого и настоящего. Общий принцип обучения заключается в следующем: даны два входаи

, изучить две функции, которые вычисляют представления

и

, такие, что (1)

и

максимально информативны о

и

и (2)

может быть легко предсказан из

. Этот принцип обеспечивает компромисс между предсказуемостью эволюции мира в пространстве представления и сбором как можно большего количества информации о состоянии мира в представлении.

Какие концепции могла бы изучить такая система SSL, обучаясь на видео? Наша гипотеза состоит в том, что может быть приобретена иерархия абстрактных концепций о том, как работает мир.

Изучение представления небольшого участка изображения таким образом, чтобы он был предсказуем из соседних участков, окружающих его в пространстве и времени, побудило бы систему извлекать локальные края и контуры на изображениях, а также обнаруживать движущиеся контуры на видео. Изучение представлений изображений, при котором представление сцены с одной точки зрения предсказуемо из представления той же сцены с немного другой точки зрения, побудило бы систему неявно представлять карту глубины. Карта глубины — это самый простой способ объяснить, как вид сцены меняется при небольшом перемещении камеры. Как только понятие глубины будет изучено, системе станет просто идентифицировать края перекрытия, а также коллективное движение участков, принадлежащих твердому объекту. Неявное представление 3D-объектов может возникнуть спонтанно. Как только понятие объекта возникает в представлении, концепции, такие как постоянство объекта, могут стать легкими для изучения: объекты, исчезающие за другими из-за параллактического движения, неизбежно появятся снова. Различие между неодушевленными и одушевленными объектами последует: неодушевленные объекты — это те, чьи траектории легко предсказуемы. Интуитивные физические концепции, такие как устойчивость, гравитация, импульс, могут последовать при обучении системы выполнять более долгосрочные предсказания на уровне представления объектов. Можно представить, что через предсказания на все более абстрактных уровнях представления и все более длительных временных масштабах все более сложные концепции о том, как работает мир, могут быть приобретены иерархическим образом.

Идея о том, что абстрактные концепции могут быть изучены через предсказание, не нова и формулировалась по-разному многими авторами в когнитивной науке, нейронауке и ИИ на протяжении нескольких десятилетий. Вопрос в том, как именно это сделать.

Рисунок 8: Самоконтролируемое обучение (SSL) и Энергетические Модели (EBM). SSL — это парадигма обучения, в которой система обучения обучается “заполнять пробелы” или, точнее, фиксировать зависимости между наблюдаемыми частями входных данных и возможно ненаблюдаемыми частями. Часть входного сигнала наблюдается и обозначается(розовым), а часть входного сигнала либо наблюдается, либо не наблюдается и обозначается

(синим). В сценарии временного предсказания

представляет прошлые и настоящие наблюдения, а

представляет будущие наблюдения. В сценарии общего завершения шаблона различные части входных данных могут наблюдаться или не наблюдаться в разное время. Система обучения обучается фиксировать зависимости между

и

через скалярную энергетическую функцию

, которая принимает низкие значения, когда

и

согласованы или совместимы, и более высокие значения, если

и

несогласованны или несовместимы. В сценарии предсказания видео система выдала бы низкое значение энергии, если видеоклип

является правдоподобным продолжением видеоклипа

. Эта формулировка на основе энергетической модели (EBM) позволяет системе представлять многомодальные зависимости, в которых несколько значений

(возможно, бесконечное множество) могут быть совместимы с данным

. На правой панели представлен энергетический ландшафт, в котором темные диски представляют точки данных, а замкнутые линии представляют контуры (линии уровня) энергетической функции.

Рисунок 9: Энергетическая модель с латентными переменными (LVEBM).

Чтобы оценить степень совместимости междуи

, EBM может нуждаться в помощи латентной переменной

. Латентная переменная может рассматриваться как параметризация множества возможных отношений между

и множеством совместимых

. Латентные переменные представляют информацию о

, которая не может быть извлечена из

. Например, если

— это вид объекта, а

— другой вид того же объекта,

может параметризовать перемещение камеры между двумя видами. Вывод (inference) заключается в поиске латентной переменной, которая минимизирует энергию

Результирующая энергия

зависит только от

и

. В примере с двойным видом вывод находит движение камеры, которое лучше всего объясняет, как

могло быть преобразовано в

.

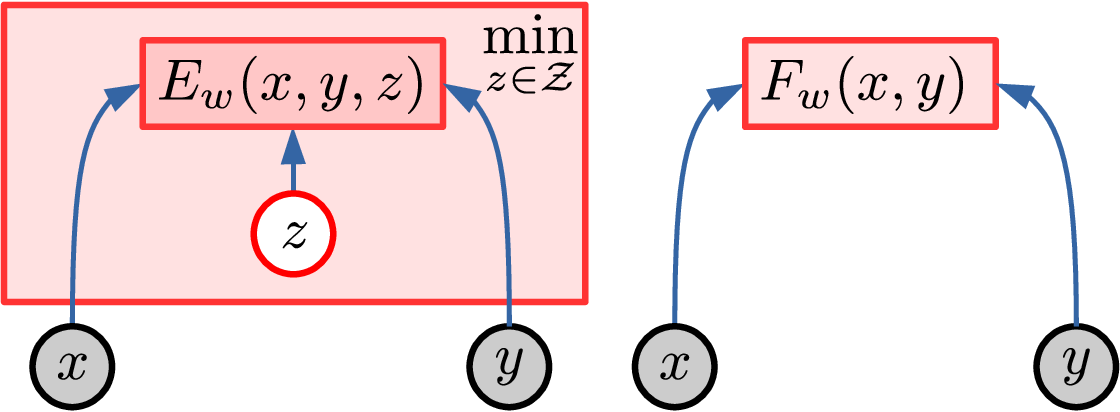

4.2 Обработка неопределенности с помощью латентных переменных

Как указывалось выше, одна из главных проблем заключается в том, чтобы дать модели возможность представлять множество предсказаний. Это может потребовать использования латентной переменной. Латентная переменная — это входная переменная, значение которой не наблюдается, а выводится. Латентная переменная может рассматриваться как параметризация множества возможных отношений междуи множеством совместимых

. Латентные переменные используются для представления информации о

, которая не может быть извлечена из

.

Представьте сценарий, в котором— это фотография сцены, а

— фотография той же сцены с немного другой точки зрения. Чтобы определить, действительно ли

и

являются видами одной и той же сцены, может потребоваться вывести перемещение камеры между двумя видами. Аналогично, если

— это фотография автомобиля, подъезжающего к развилке дороги, а

— фотография того же автомобиля несколько секунд спустя на одной из ветвей развилки, совместимость между

и

зависит от бинарной латентной переменной, которую можно вывести: повернула ли машина налево или направо.

В сценарии временного предсказания латентная переменная представляет то, что нельзя предсказать о(будущем) исключительно из

и прошлых наблюдений (прошлого). Она должна содержать всю информацию, которая была бы полезна для предсказания, но не наблюдаема или не известна. Я могу не знать, повернет ли водитель передо мной налево или направо, ускорится или затормозит, но я могу представить эти варианты латентной переменной.

Энергетическая модель с латентными переменными (LVEBM) — это параметризованная энергетическая функция, зависящая от,

и

:

При предъявлении пары

процедура вывода EBM находит значение латентной переменной

, которая минимизирует энергию

Этот вывод латентной переменной через минимизацию позволяет нам исключитьиз энергетической функции:

Техническиследовало бы называть свободной энергией при нулевой температуре, но мы продолжим называть ее энергией.

4.3 Обучение Энергетических Моделей

Прежде чем обсуждать обучение EBM, важно отметить, что определение EBM не делает никаких ссылок на вероятностное моделирование. Хотя многие EBM могут быть легко преобразованы в вероятностные модели, например, через распределение Гиббса, это вовсе не является необходимостью. Следовательно, энергетическая функция рассматривается как фундаментальный объект и не предполагается неявно представляющим ненормализованный логарифм распределения вероятностей.

Обучение EBM заключается в построении архитектуры (например, глубокой нейронной сети) для вычисления энергетической функции, параметризованной вектором параметров

. Процесс обучения должен искать такой вектор

, который придаст энергетической функции правильную форму. Для данного

из обучающего множества хорошо обученная

будет выдавать более низкие энергии для значений

, которые связаны с

в обучающем множестве, и более высокие энергии для других значений

.

При наличии обучающего образца, обучение EBM сводится к разработке подходящего функционала потерь

, который может быть выражен напрямую как функция от вектора параметров

, и такой, что минимизация этих потерь сделает энергию обучающего образца

ниже, чем энергии

для любого

, отличного от

.

Сделать энергию обучающего образца низкой легко: достаточно, чтобы потери были возрастающей функцией энергии, а энергия имела нижнюю границу.

Трудный вопрос заключается в том, как гарантировать, что энергии, отличных от

, будут выше, чем энергия

. Без специального положения, гарантирующего, что

всякий раз, когда

, энергетический ландшафт может подвергнуться коллапсу: при данном

энергетический ландшафт может стать “плоским”, по существу давая одну и ту же энергию всем значениям

.

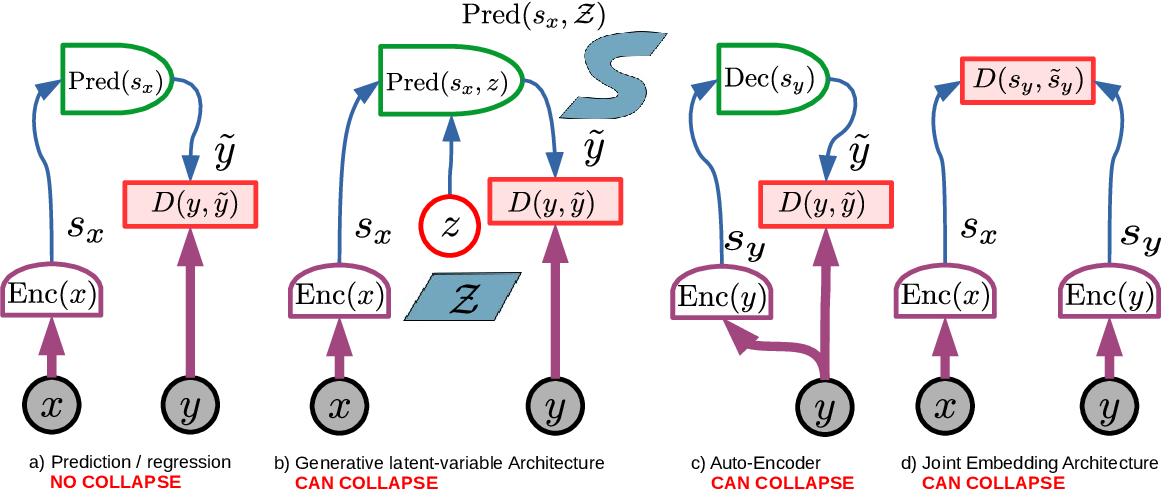

Какие архитектуры EBM подвержены коллапсу? Подвержен ли EBM коллапсу, зависит от его архитектуры. Рисунок 10 показывает ряд стандартных архитектур и указывает, могут ли они подвергнуться коллапсу.

Обычная предсказательная или детерминистическая генеративная архитектура (Рисунок 10(a)) не может коллапсировать. Для любоговыдается единственный

. Энергия равна нулю всякий раз, когда

. Любой

, отличный от

, будет иметь более высокую энергию, пока

строго больше нуля, когда

отличается от

.

Генеративная архитектура с латентными переменными (недетерминистическая генеративная) (Рисунок 10(b)) может коллапсировать, когда латентная переменная имеет слишком большую информационную емкость. Когда латентная переменнаяизменяется по множеству

, предсказание

изменяется по множеству

, которое должно соответствовать множеству

, совместимых с

. Если

слишком “велико”, то область низкоэнергетических

может быть больше области с высокой плотностью данных. Если

имеет ту же размерность, что и

, система вполне может давать нулевую энергию всему пространству

.

Автоэнкодер (AE) (Рисунок 10(c)) может коллапсировать, когда представлениеимеет слишком большую информационную емкость. Например, если размерность

равна или выше, чем у

, AE может изучить тождественную функцию, выдавая ошибку реконструкции, равную нулю по всему пространству

.

Рисунок 10: Несколько стандартных архитектур и их способность к коллапсу.

(a) Детерминистическая генеративная архитектура: не может коллапсировать, потому что может выдать только один выход. Для данноготолько одно значение

может иметь нулевую энергию:

. Другие значения

будут иметь более высокую энергию, если

больше нуля при

.

(b) Недетерминистическая генеративная архитектура: может коллапсировать, когда латентная переменная имеет чрезмерную информационную емкость. Если для данногои для всех

существует

, которое дает нулевую энергию предсказания (например, если

имеет ту же или более высокую размерность, что и

), все пространство

будет иметь низкую энергию. Информационная емкость

должна быть такой, чтобы изменение

по своему множеству порождало все правдоподобные

для данного

.

(c) Автоэнкодер: может коллапсировать, если система изучает тождественную функцию или если она может корректно реконструировать область пространства, которая намного больше области с высокой плотностью данных, тем самым давая низкую энергию слишком большой области.

(d) Простая архитектура совместного вложения: может коллапсировать, если энкодеры игнорируют входные данные и производят представления, которые остаются постоянными и равными, или если энкодеры инвариантны по слишком широким областям пространства.

Наконец, Архитектура Совместного Вложения (Joint Embedding Architecture, JEA) (Рисунок 10(d)) может коллапсировать, когда информация, переносимаяи/или

, недостаточна. Если энкодеры игнорируют входные данные и выдают постоянные и равные коды

, все пространство будет иметь нулевую энергию.

Это лишь несколько примеров архитектур.

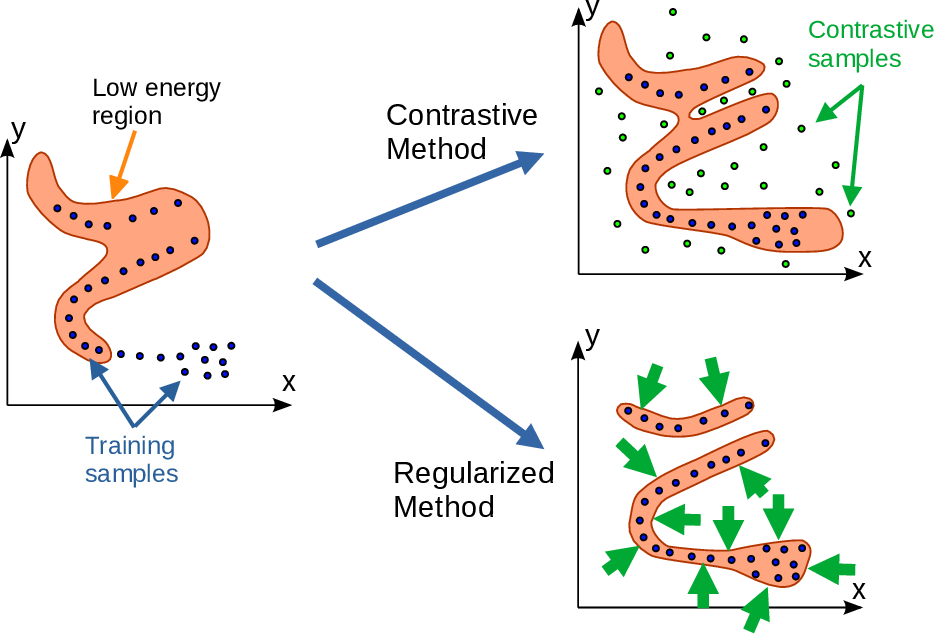

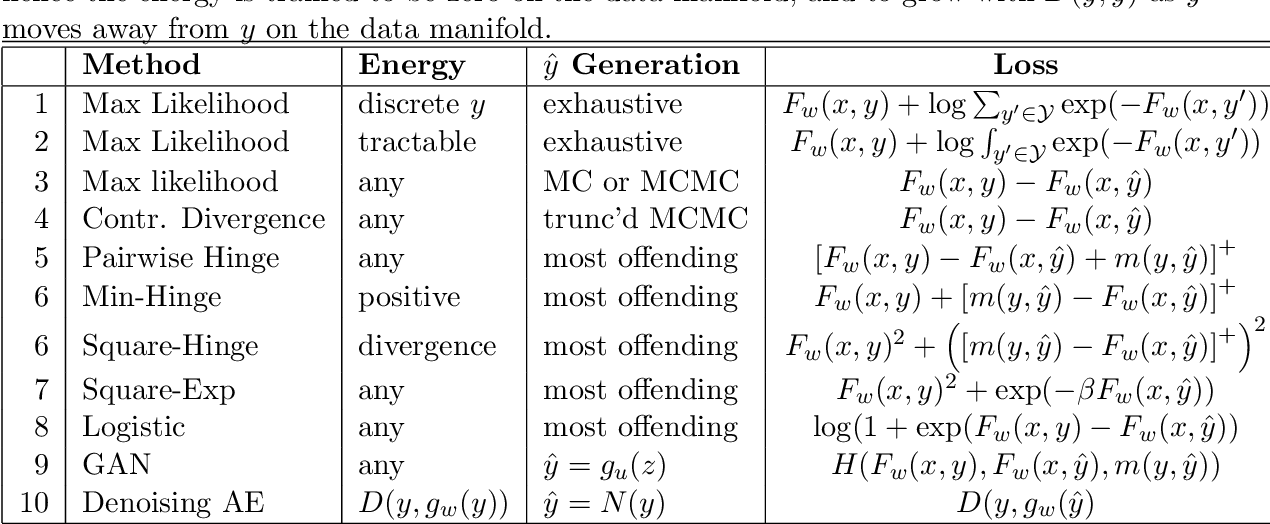

Как нам разработать функцию потерь для предотвращения коллапса? Существует два подхода: контрастивные методы и регуляризованные методы. Далее я буду утверждать, что контрастивные методы имеют недостатки и что регуляризованные (неконтрастивные) методы с гораздо большей вероятностью будут предпочтительнее в долгосрочной перспективе.

Контрастивные методы заключаются в использовании функционала потерь, минимизация которого имеет эффект “продавливания” энергий обучающих образцоввниз и “подтягивания” энергий подходящим образом галлюцинируемых “контрастивных” образцов

вверх. Контрастивный образец

должен быть выбран таким образом, чтобы гарантировать, что EBM присваивает более высокие энергии точкам вне областей с высокой плотностью данных. Это переводится в разработку потерь, которые являются возрастающей функцией

и убывающей функцией

, по крайней мере, когда

не достаточно выше, чем

. Существует много таких контрастивных функций потерь,

Рисунок 11: Контрастивные и регуляризованные методы обучения EBM. Концептуальная диаграмма энергетического ландшафта показана слева. Обучающие образцы — синие точки. Область низкой энергии показана оранжевым (линия уровня энергетической функции).

Контрастивные методы (вверху справа) продавливают энергию обучающих образцов (синие точки) вниз и подтягивают энергии подходящим образом размещенных контрастивных образцов (зеленые точки) вверх.

Регуляризованные методы (внизу справа) продавливают энергию обучающих образцов вниз и используют член регуляризации, который минимизирует объем областей с низкой энергией. Эта регуляризация имеет эффект “усадки-обертывания” (shrink-wrapping) областей с высокой плотностью данных внутри областей с низкой энергией, насколько позволяет гибкость энергетической функции.

Одна из проблем контрастивных методов заключается в том, что энергия будет подтягиваться только там, где были размещены контрастивные образцы. Необходимо разработать методы, которые предпочтительно размещают контрастивные образцы в областях с низкой энергией, что и делают методы Монте-Карло и MCMC. Однако недостатком контрастивных методов является то, что количество контрастивных образцов, необходимых для придания энергетической поверхности хорошей формы, может расти экспоненциально с увеличением размерности пространства.

некоторые из которых принимают одну триаду, другие требуют пакет положительных и контрастивных значений

.

Простой пример контрастивных функций потерь выглядит следующим образом:

где— это возрастающая функция от

и убывающая функция от

всякий раз, когда последняя меньше первой плюс положительная функция маржи

. Простой пример такой потери — это потеря шарнира, зависящая от расстояния:

где— это тождественная функция, когда

положительно, и ноль в противном случае. Это заставляет энергию расти по крайней мере квадратично с расстоянием до многообразия данных. Другие контрастивные функционалы потерь принимают во внимание несколько контрастивных образцов:

Которая должна быть возрастающей функцией первого аргумента и убывающей функцией всех остальных аргументов. Примером такой потери является популярная InfoNCE:

Контрастивные методы очень популярны, особенно для архитектур сиамских сетей, обучаемых на парах, где— это искаженная или поврежденная версия

, а

— другой случайный (или подходящим образом выбранный) обучающий образец. Сюда входят такие методы, как оригинальная сиамская сеть, а также более поздние методы, включая DrLIM, PIRL, MoCO, SimCLR, CPT и другие. Контрастивные методы также включают такие классические методы, как вероятностные модели, обученные с максимальным правдоподобием, которые не нормализуются автоматически. Контрастивные образцы

часто производятся с использованием методов Монте-Карло, методов Марковских цепей Монте-Карло или их приближенных версий, таких как Контрастивная Дивергенция. Генеративные Состязательные Сети также могут рассматриваться как контрастивные методы, в которых

производится обучаемой сетью генератора. Денойзинг Автоэнкодеры и их частный случай, Маскированные Автоэнкодеры, также являются примерами контрастивных методов обучения, в которых

генерируется путем искажения чистого

. Более подробное обсуждение различных контрастивных методов приведено в приложении 8.3.3.

Но с контрастивными методами есть две основные проблемы. Во-первых, нужно разработать схему генерации или выбора подходящих. Во-вторых, когда

находится в пространстве высокой размерности и если EBM гибок, может потребоваться очень большое количество контрастивных образцов, чтобы гарантировать, что энергия будет выше во всех измерениях, не занятых локальным распределением данных. Из-за проклятия размерности, в худшем случае количество контрастивных образцов может расти экспоненциально с размерностью представления. Это основная причина, по которой я буду выступать против контрастивных методов.

Регуляризованные методы обучения EBM гораздо более перспективны в долгосрочной перспективе, чем контрастивные методы, поскольку они могут избежать проклятия размерности, от которого страдают контрастивные методы. Они заключаются в построении функционала потерь, который имеет эффект “продавливания” энергий обучающих образцов вниз и одновременной минимизации объема пространства, которому модель сопоставляет низкую энергию. Объем области с низкой энергией измеряется членом регуляризации в энергии и/или в потерях. Минимизируя этот член регуляризации, одновременно понижая энергии точек данных, области с низкой энергией будут “усаживаться-обертываться” вокруг областей с высокой плотностью данных. Главное преимущество неконтрастивных регуляризованных методов заключается в том, что они с меньшей вероятностью, чем контрастивные методы, станут жертвами проклятия размерности. Главный вопрос заключается именно в том, как спроектировать такие регуляризаторы, минимизирующие объем. Ответ сильно зависит от архитектуры модели, что обсуждается в следующих разделах. Однако неконтрастивные методы существуют уже давно. Примеры включают разреженное моделирование, разреженные автоэнкодеры и автоэнкодеры с шумными латентными переменными, такие как VAE.

Важно отметить, что контрастивные и регуляризованные методы не являются несовместимыми друг с другом и могут использоваться одновременно на одной и той же модели.

Как бы регуляризованные методы применялись к архитектурам на Рисунке 10(b-d)?

В генеративной архитектуре с латентными переменными ограничение информационной емкостиограничит объем пространства

, который может иметь низкую энергию. Если

дискретно с возможными

значениями, самое большее

точек в пространстве

будут иметь нулевую энергию. Если

— это многообразие размерности

, то область пространства

с нулевой энергией будет иметь не более

измерений.

Аналогично, в архитектуре автоэнкодера ограничение информационной емкостиограничит объем пространства

, который может быть реконструирован с низкой энергией.

Наконец, в Архитектуре Совместного Вложения максимизация информации, которуюсодержит о

, а

содержит о

, минимизирует объем пространства

, который может иметь низкую энергию.

Далее мы сосредоточимся на архитектуре для SSL — Архитектуре Совместного Предиктивного Вложения (JEPA), которую можно рассматривать как комбинацию Архитектуры Совместного Вложения и Генеративной Архитектуры с Латентными Переменными. JEPA является негенеративной в том смысле, что она на самом деле не предсказывает, а предсказывает представление

,

из представления

,

.

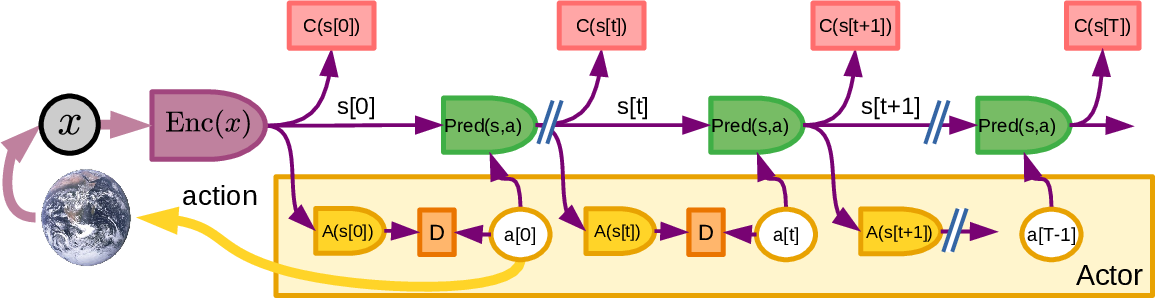

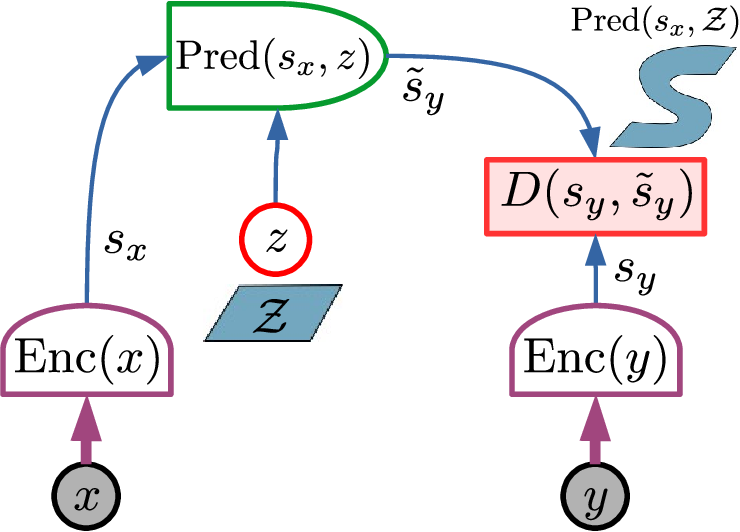

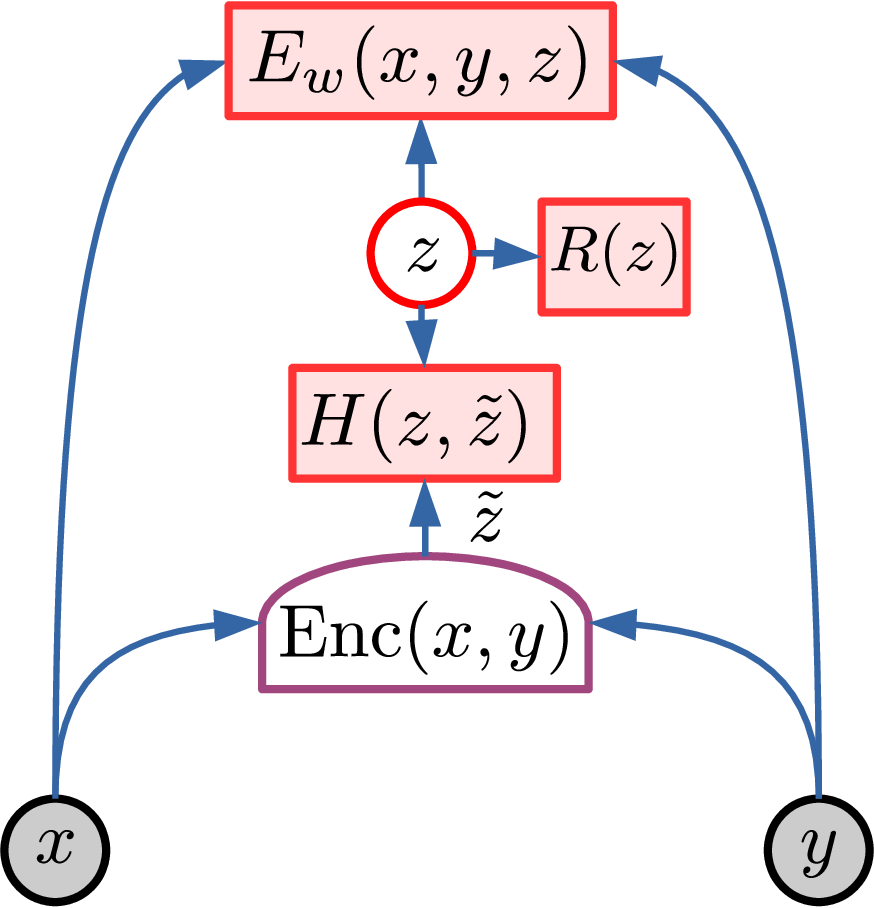

4.4 Архитектура Совместного Предиктивного Вложения (JEPA)

Центральным элементом этой статьи является Архитектура Совместного Предиктивного Вложения (JEPA). JEPA не является генеративной в том смысле, что она не может быть легко использована для предсказанияиз

. Она просто фиксирует зависимости между

и

без явной генерации предсказаний

.

Обобщенная JEPA показана на Рисунке 12. Две переменныеи

подаются на два энкодера, производящих два представления

и

. Эти два энкодера могут быть разными. Не требуется, чтобы они обладали одинаковой архитектурой, а также не требуется, чтобы они разделяли свои параметры. Это позволяет

и

быть разными по природе (например, видео и аудио). Модуль предсказателя предсказывает представление

из представления

. Предсказатель может зависеть от латентной переменной

. Энергия — это просто ошибка предсказания в пространстве представлений:

Общая энергия получается путем минимизации по:

Главное преимущество JEPA заключается в том, что она выполняет предсказания в пространстве представлений, избегая необходимости предсказывать каждую деталь. Это обеспечивается тем, что энкодер

может выбрать производить абстрактное представление, из которого устранены нерелевантные детали.

Но есть два способа, которыми JEPA может представлять множественность значений, совместимых с

. Первый — это свойства инвариантности энкодера

, второй — латентная переменная

, как объяснено ниже.

Мультимодальность через инвариантность энкодера: Функция энкодераможет обладать свойствами инвариантности. Если все

из набора отображаются в одно и то же значение

, все эти

будут иметь одинаковые энергии. С JEPA мы теряем способность генерировать выходные данные, но получаем мощный способ представлять многомодальные зависимости между входами и выходами.

Рисунок 12: Архитектура Совместного Предиктивного Вложения (JEPA) состоит из двух ветвей кодирования. Первая ветвь вычисляет, представление

, а вторая ветвь —

, представление

. Энкодерам не обязательно быть идентичными. Модуль предсказателя предсказывает

из

с возможной помощью латентной переменной

. Энергия — это ошибка предсказания. Простые вариации JEPA могут не использовать предсказатель, заставляя два представления быть равными, или могут использовать фиксированный предсказатель без латентной переменной, или могут использовать простые латентные переменные, такие как дискретные переменные.

Главное преимущество JEPA заключается в том, что она выполняет предсказания в пространстве представлений, избегая необходимости предсказывать каждую детальи позволяя устранять нерелевантные детали энкодерами. Точнее, главное преимущество этой архитектуры для представления многомодальных зависимостей двоякое: (1) функция энкодера

может обладать свойствами инвариантности, которые заставят ее выдавать одно и то же

для набора различных

. Это делает энергию постоянной на этом наборе и позволяет модели фиксировать сложные многомодальные зависимости; (2) Латентная переменная

, при изменении по множеству

, может произвести набор правдоподобных предсказаний

.

Если— это видеоклип автомобиля, приближающегося к развилке дороги,

и

могут представлять положение, ориентацию, скорость и другие характеристики автомобиля до и после развилки соответственно, игнорируя нерелевантные детали, такие как деревья вдоль дороги или текстура тротуара.

может представлять, выберет ли автомобиль левую ветвь или правую ветвь дороги.

Мультимодальность через предсказатель с латентной переменной: Предсказатель может использовать латентную переменнуюдля захвата информации, необходимой для предсказания

, которая отсутствует в

. Когда

изменяется по множеству

, предсказатель производит набор правдоподобных предсказаний

. Например, если

— это видеоклип автомобиля, приближающегося к развилке дороги,

и

могут представлять прошлые и будущие положения, ориентации, скорости и другие характеристики автомобиля, игнорируя нерелевантные детали, такие как деревья вдоль дороги или текстура тротуара. Латентная переменная

может быть бинарной переменной, указывающей, свернет ли автомобиль на левую ветвь (

) или на правую ветвь (

) дороги. Если автомобиль сворачивает налево, значение

даст более низкую энергию

, чем

.

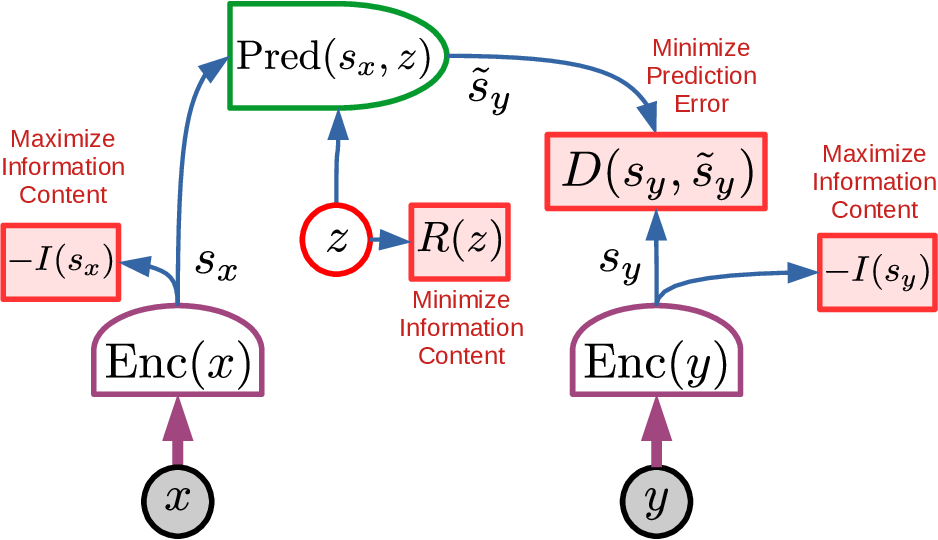

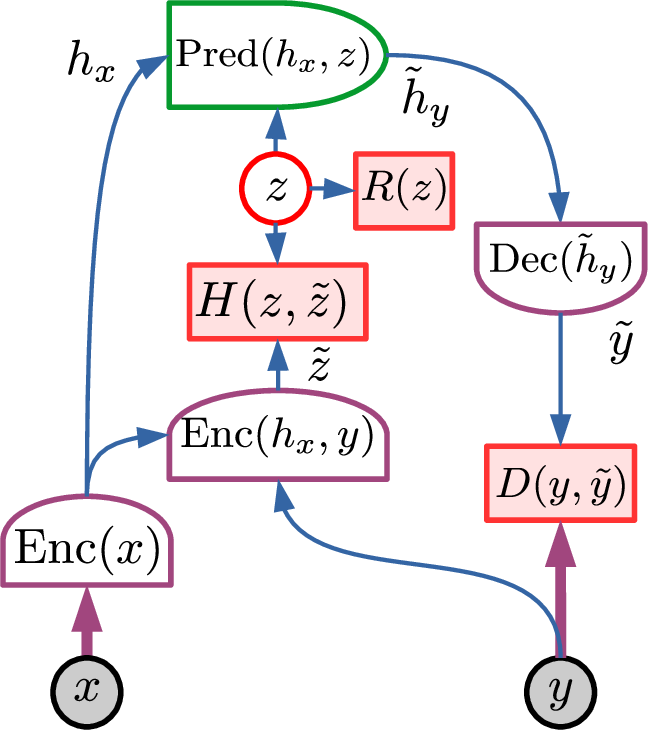

4.5 Обучение JEPA

Как и любая EBM, JEPA может быть обучена контрастивными методами. Но, как указывалось выше, контрастивные методы имеют тенденцию становиться очень неэффективными в высокой размерности. Релевантная размерность здесь — это размерность, которая может быть значительно меньше, чем

, но все еще слишком высока для эффективного обучения.

Рисунок 13: Неконтрастивное обучение JEPA.

Главная привлекательность JEPA заключается в том, что они могут быть обучены неконтрастивными методами. Основной принцип такого обучения заключается в том, что (1)должен быть максимально информативен о

; (2)

должен быть максимально информативен о

; (3)

должен быть легко предсказуем из

; и (4)

должен иметь минимальное информационное содержание. Критерии 1, 2 и 4 коллективно предотвращают коллапс энергетической функции.

Примерами таких неконтрастивных критериев для обучения JEPA являются VICReg и Barlow Twins. Как и любая EBM, JEPA могут также обучаться контрастивными методами. Но это сталкивается с проклятием размерности и ограничивает практическую размерность.

Что делает JEPA особенно интересными, так это то, что мы можем разработать неконтрастивные методы для их обучения. Как объяснено в разделе 4.3, неконтрастивные методы используют регуляризаторы, которые измеряют объем пространства, который может принимать низкие значения энергии. В случае JEPA это можно сделать с помощью четырех критериев, как показано на Рисунке 13:

-

максимизировать информационное содержание

о

-

максимизировать информационное содержание

о

-

сделать

легко предсказуемым из

-

минимизировать информационное содержание латентной переменной

, используемой в предсказании.

Критерии 1 и 2 предотвращают уплощение энергетической поверхности из-за информационного коллапса. Они гарантируют, чтои

несут как можно больше информации о своих входах. Без этих критериев система могла бы решить сделать

и

постоянными или слабо информативными, что сделало бы энергию постоянной на больших участках входного пространства.

Критерий 3 обеспечивается членом энергиии гарантирует, что

предсказуем из

в пространстве представлений.

Критерий 4 предотвращает попадание системы в другой тип информационного коллапса, заставляя модель предсказыватьс минимальной помощью латентной переменной.

Этот тип коллапса можно понять с помощью следующего мысленного эксперимента. Представьте, чтоимеет ту же размерность, что и

. Предположим, что предсказатель — это параметризованная функция (например, нейронная сеть), которая может решить игнорировать

и просто копировать

на свой выход

. Для любого

можно установить

, что сделает энергию

нулевой. Это соответствует полностью плоскому и коллапсировавшему энергетическому ландшафту. Как нам предотвратить этот коллапс?

Как предотвратить этот коллапс?

Ограничивая или минимизируя информационное содержание латентной переменной.

Как это можно сделать?

Сделавдискретной, низкоразмерной, разреженной или шумной, среди других методов.

Несколько конкретных примеров могут помочь создать интуитивное понимание явления. Предположим, чтои что

дискретна с

возможными целочисленными значениями [0, K-1]. Для данного

может быть только

возможных значений

:

Следовательно, это могут быть единственные значенияс нулевой энергией, и их всего

. Рассмотрим точку

, которая начинается с

и движется к

. Ее энергия начнется с нуля, будет расти квадратично по мере удаления

от

, пока

. Когда

станет ближе к

, чем к

, энергия будет уменьшаться, достигая нуля, когда

достигнет

. В пространстве представлений энергия будет минимумом

квадратичных энергетических ям.

Аналогично, представьте, что— это вектор, размерность

которого ниже, чем у

. Тогда, предполагая, что

является гладкой функцией от

, множество возможных предсказаний будет не более чем

-мерным многообразием в пространстве

.

Более того, представьте, что энергетическая функция дополнена членом регуляризации навида

, т.е. норма

вектора

. Это приведет к тому, что

будет разреженным. Как и в классическом разреженном кодировании, это приведет к тому, что область низкой энергии будет аппроксимироваться объединением низкоразмерных многообразий (объединением низкоразмерных линейных подпространств, если

линейно по

), размерность которых будет минимизирована регуляризатором

.

Сделатьстохастической выборкой из распределения, чья энтропия максимизирована, также будет иметь правильный эффект регуляризации. Это основа Вариационных Автоэнкодеров и подобных моделей.

Более полное обсуждение регуляризаторов, которые могут минимизировать информационное содержание латентных переменных, выходит за рамки этой статьи. Пока мы можем упомянуть четыре класса методов: дискретизация/квантование (например, как в VQ-VAE (Walker et al., 2021)), минимизация размерности/ранга (например, как в Implicit Rank-Minimizing AE (Jing et al., 2020)), разреживание (как в линейном разреженном моделировании (Olshausen and Field, 1996), LISTA (Gregor and LeCun, 2010b), и нелинейном разреженном моделировании (Evtimova and LeCun, 2022))), и фаззификация (как в шумных AE (Doi et al., 2007), VAE (Kingma and Welling, 2013), и вариантах, используемых в задачах управления (Henaff et al., 2019)).

Способность JEPA предсказывать в пространстве представлений делает ее значительно более предпочтительной, чем генеративные модели, которые напрямую производят предсказание. В сценарии предсказания видео практически невозможно предсказать каждое значение пикселя каждого будущего кадра. Детали текстуры ковра, листья дерева, колышущиеся на ветру, или рябь на пруду не могут быть точно предсказаны, по крайней мере, не на длительные периоды времени и не без потребления огромных ресурсов. Значительным преимуществом JEPA является то, что она может выбрать игнорировать детали входных данных, которые нелегко предсказать. Тем не менее, Критерии 1 и 2 гарантируют, что информационное содержание игнорируемых деталей сведено к минимуму.

Рисунок 14: Обучение JEPA с помощью VICReg.

VICReg — это неконтрастивный метод обучения вложений. Информационное содержание представленийи

максимизируется путем их отображения в вложения более высокой размерности

и

через экспандер (например, обучаемую нейронную сеть с несколькими слоями). Функция потерь приближает ковариационную матрицу вложений к единичной матрице (например, вычисленную по пакету). VICReg можно рассматривать как метод, контрастивный по измерениям, в отличие от методов, контрастивных по образцам.

Как мы можем реализовать Критерии 1 и 2?

Как мы можем реализовать Критерии 1 и 2? Другими словами, имея параметризованную детерминистическую функцию кодирования, как нам максимизировать информационное содержание

?

Еслиобратима,

содержит всю информацию о

, но это может быть субоптимально для Критерия 3, так как

будет содержать много нерелевантных или трудно предсказуемых деталей о

. Точнее,

максимально информативен о

, если функция

минимально сюръективна, т.е. если объем множеств

, которые отображаются в одно и то же

, минимален. То же самое рассуждение применимо к энкодеру

. Чтобы превратить этот критерий в дифференцируемую функцию потерь, нам нужно сделать некоторые предположения.

4.5.1 VICReg

Метод VICReg (Bardes et al., 2021) делает несколько предположений о распределенияхи

. Графическое представление показано на Рисунке 14. Чтобы максимизировать информационное содержание

, VICReg использует следующие два подкритерия: (1) компоненты

не должны быть постоянными, (2) компоненты

должны быть как можно более независимы друг от друга. Это аппроксимируется сначала нелинейным отображением

и

в вложения более высокой размерности

и

через обучаемый модуль экспандера (например, нейронную сеть с несколькими слоями) и использованием функции потерь с двумя дифференцируемыми членами потерь, вычисляемыми по пакету образцов:

-

Дисперсия: потеря шарнира, которая поддерживает стандартное отклонение каждого компонента

и

выше порогового значения по пакету.

-

Ковариация: ковариационная потеря, в которой ковариация между парами различных компонентов

подталкивается к нулю. Это имеет эффект декорреляции компонентов

, что, в свою очередь, сделает компоненты

в некоторой степени независимыми.

Те же критерии применяются отдельно ки

.

Третий критерий VICReg — это ошибка предсказания представления. В простейших реализациях VICReg предсказатель является константным (равен тождественной функции), делая представления инвариантными к преобразованию, которое превращает

в