Ребята, кажется, мы уперлись в стену. Пока гиганты наращивают параметры и жгут тераватты, пытаясь выжать каплю разума из статистики, я решил пересмотреть сам фундамент. Проблема не в данных, проблема в «вязкости» стандартного Attention.

Суть метода: Я заменил стандартный механизм внимания на нативную геометрию исключительной группы Ли Е8. Вместо того чтобы заставлять модель угадывать связи, я дал ей идеальную 8-мерную решетку для упаковки семантических векторов.

Что это дало (пруфы в студию):

-

Архитектура: Lila-E8, всего 40 млн параметров.

-

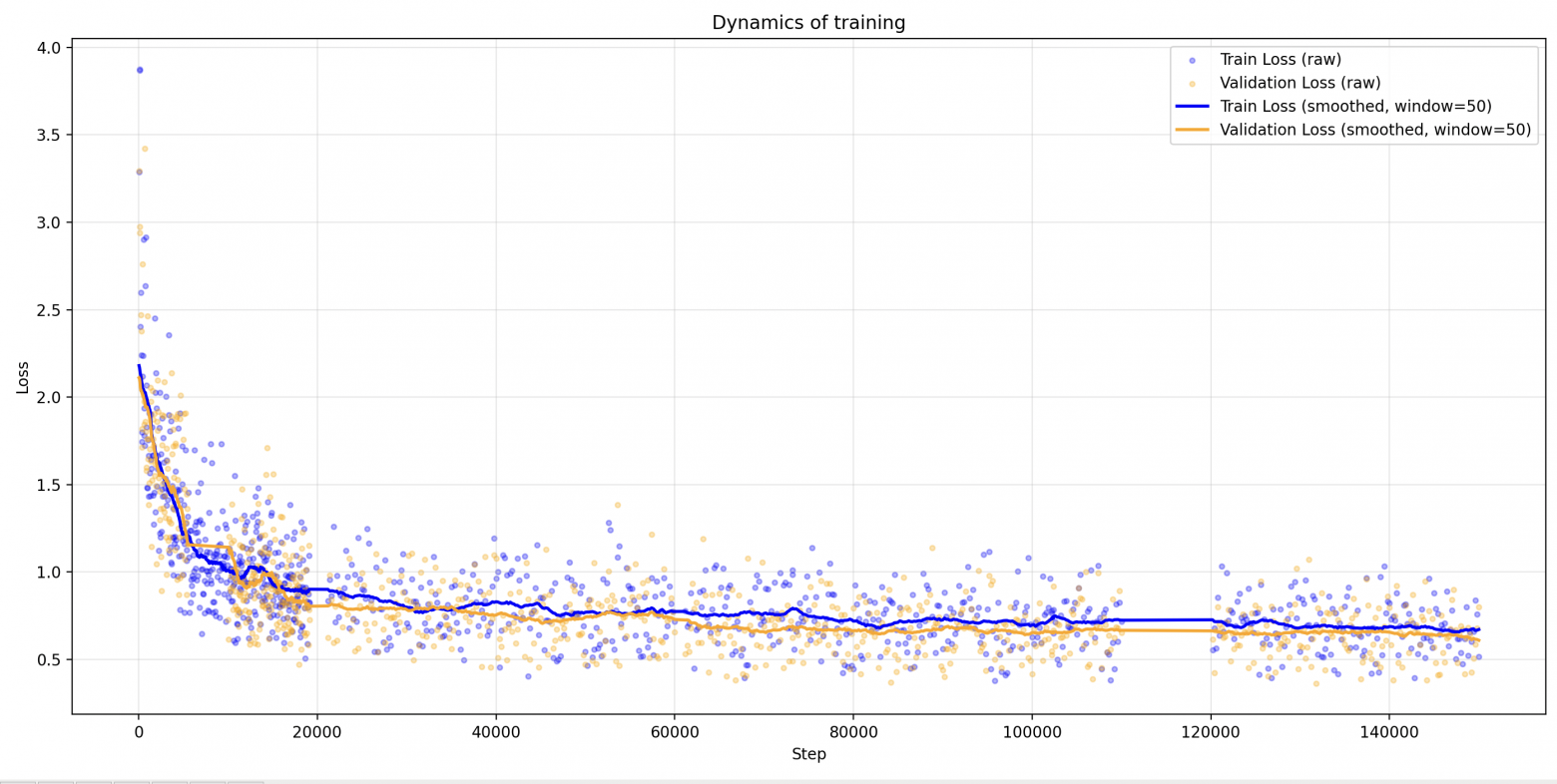

Результат: На TinyStories мы пробили 0.37 Train Loss и удерживаем 0.44–0.53 Validation. Для сравнения: это чище, чем у 60М-модели от Microsoft.

-

Контекст: 750+ токенов без единого зацикливания(и это при размере контекстного окна 512). Модель не «плывет» и не сходит с ума на длинных рассказах.

Реальные цифры: Loss 0.37 — это не шутка. Это точка, где математика превращается в интеллект.

Почему это работает?

Стандартный аттеншн создает «трение» в латентном пространстве. Решетка обеспечивает самую плотную упаковку сфер в 8 измерениях. Это сводит информационную вязкость к минимуму. Модель не зубрит — она резонирует со структурой языка.

Код на GitHub, веса и Colab для проверки — всё в открытом доступе (AGPLv3).

В то время как классические трансформеры (например, NanoGPT) полагаются на грубую статистическую силу и огромные матрицы весов для аппроксимации языка, E8-former использует фундаментальную симметрию Вселенной — исключительную группу Ли E8.

Lila-E8 (Lie Lattice Attention Language Model) — это экспериментальная модель глубокого обучения, которая исследует интеграцию фундаментальной математической структуры, а именно симметрий системы корней E8, в архитектуру трансформера.

В отличие от традиционных моделей, опирающихся исключительно на статистические корреляции, E8-Transformer стремится использовать глубокие геометрические принципы для создания более эффективных, интерпретируемых и ресурсосберегающих языковых моделей. Этот подход направлен на развитие концепции “геометрического сознания” в ИИ, где понимание языка осуществляется через структурные и симметричные отношения.

Автор: bootstraptor