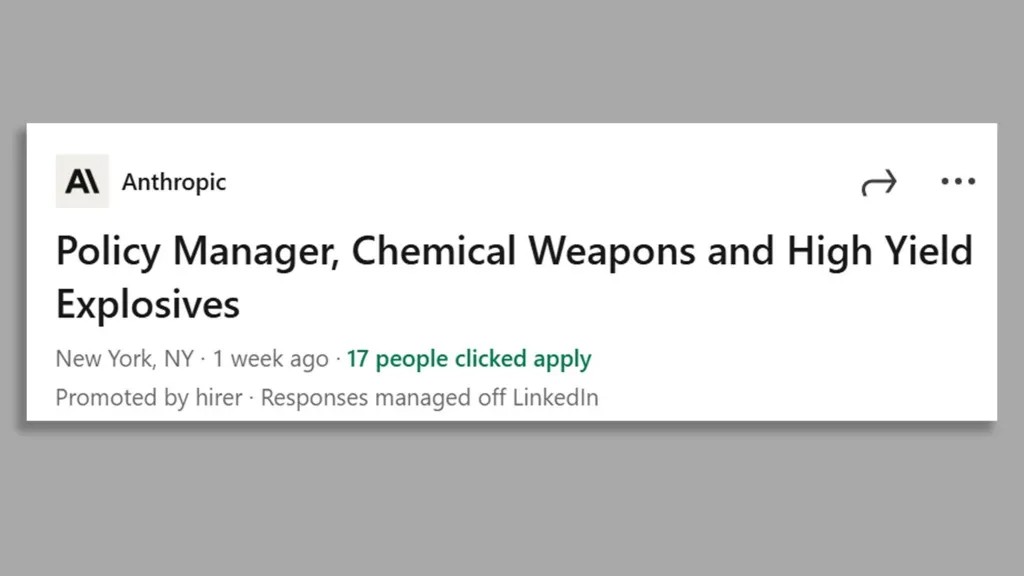

Американская компания в сфере искусственного интеллекта Anthropic ищет эксперта по химическому оружию и взрывчатым веществам большой мощности, чтобы предотвратить «катастрофическое неправомерное использование» своего программного обеспечения. Разработчик Claude опасается, что его ИИ-инструменты могут подсказать кому-то, как создавать химическое и радиоактивное оружие. Эксперт должен обеспечить достаточную надёжность защитных механизмов ПО.

В вакансии Anthropic указывает, что соискатель должен иметь минимум пятилетний опыт работы в сфере «защиты от химического оружия и взрывчатых веществ», а также знания о «радиационных средствах рассеивания», известных как «грязные бомбы».

Компания сообщила BBC, что эта должность аналогична тем, которые уже созданы в других ответственных областях. Anthropic — не единственная компания в сфере ИИ, которая применяет эту стратегию. Аналогичную вакансию на своём сайте разместила и OpenAI. Разработчик ChatGPT предлагает таким кандидатам до $455 тыс., что почти вдвое больше, чем готова платить Anthropic.

Некоторые эксперты обеспокоены рисками такого подхода, предупреждая, что он предоставляет информацию об оружии ИИ-инструментам, даже если им дано указание не использовать её. Исследователи указывают на отсутствие международного договора или иного регламента, регулирующего этот сценарий работы и использования ИИ с подобным оружием. Всё это происходит незаметно для окружающих.

Индустрия ИИ постоянно предупреждала о потенциальных экзистенциальных угрозах, исходящих от её технологий, но компании и законодатели не предприняли никаких попыток замедлить этот прогресс. Проблема приобрела особую важность, когда американское правительство заключило контракты с ИИ-компаниями и начало боевые действия на Ближнем Востоке.

В конце прошлого месяца генеральный директор Anthropic Дарио Амодей отказал Министерству оборону США в предоставлении полного доступа к своим ИИ-системам. В ответ Пентагон поместил компанию в категорию рисков для цепочки поставок США. Anthropic теперь оспаривает этот статус через суд.

Разработчик настаивает, что его системы не должны использоваться в полностью автономном оружии и для массовой слежки за американцами. Амодей пишет, что технология ещё недостаточно совершенна и не должна применяться в этих целях.

OpenAI заявила о согласии с позицией Anthropic, но затем заключила собственный контракт с правительством США, который пока ещё не начал действовать. Пентагон продолжает использовать Claude в системах, предоставленных Palantir.

Автор: Travis_Macrif