Автор: Искандер Тиморшин, владелец продукта Innostage TDIR Интеллектуальная автоматизация расследования инцидентов ИБ.

Почему правил корреляции больше недостаточно?

Долгое время ядром любого центра мониторинга и реагирования на киберугрозы (далее по тексту – SOC) оставался корреляционный движок, то есть набор правил для автоматизированного поиска паттернов атак, например, «5 неудачных входов» + «успешный вход» + «активность в БД» = «подозрение на компрометацию» типа 5 failed logins = brute force (5 неудачных попыток входа в систему = метод перебора паролей).

Сегодня этот подход напоминает попытку поймать искусного шпиона с помощью крика: «Стой! Кто идет?!». Современные атаки стали тихими, целевыми и изощренно-адаптивными. Злоумышленники используют легитимные инструменты (Living-off-the-Land — живой взлом), имитируют нормальную активность пользователей и растягивают шаги задуманной цепочки кибератак на месяцы.

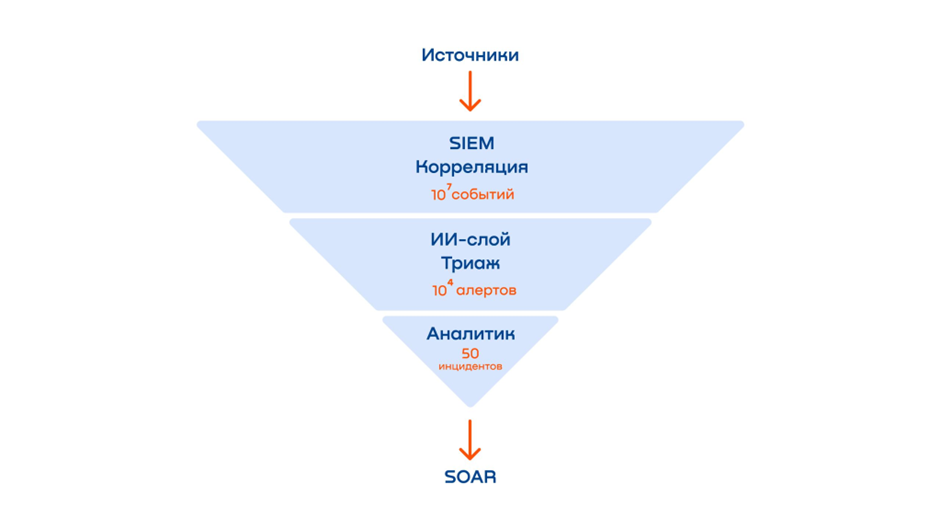

Статистика выглядит удручающе: среднестатистический SOC обрабатывает до 10⁷ событий в сутки, из которых после фильтрации остается от 10³ до 10⁴ алертов. Но 70–90% из них — ложные срабатывания, требующие ручной проверки. Это порождает так называемое Alert fatigue — профессиональное выгорание аналитиков, которые превращаются в операторов по нажатию кнопки Close false positive (Закрыть ложноположительный результат).

На этом фоне большие языковые модели и алгоритмы машинного обучения перешли из категории «экспериментальных технологий» в разряд операционных инструментов кибербезопасности. При этом важно отметить ключевой принцип: искусственный интеллект (ИИ) не заменяет аналитика, а усиливает его возможности через снижение когнитивной нагрузки и ускорение обработки рутинных задач.

Эволюция детектирования: три современных подхода

Рассмотрим три основные категории систем автоматизации работы SOC, в которых применяется ИИ.

Категория А: Поведенческий анализ и машинное обучение

Здесь нет статических правил. Вместо этого система строит «цифровую ДНК» каждой сущности. Алгоритмы непрерывно обучаются, создавая поведенческие профили для пользователей, хостов и приложений. В реальном времени они ищут статистически значимые отклонения от этой базы, анализируя сотни параметров.

Пример: не «сотрудник вошел в 3:00», а «бухгалтер Мария, обычно работающая с 9 до 18 только с офисными документами, в 3:00 ночи скачала 50 ГБ исходного кода на внешний облачный аккаунт, к которому никогда ранее не обращалась».

Ключевые решения:

Категория Б: Подход, ориентированный на данные — детектирование как поиск

В этой парадигме детектирование превращается в мощный поисковый запрос к огромному массиву нормализованных данных.

Все логи консолидируются в едином хранилище данных. Детекты создаются через запросы на специализированных языках программирования (KQL, SPL, YARA-L), которые могут автоматически выполняться по расписанию.

Ключевые решения:

-

Российские платформы больших данных (например, Yandex Data Platform / решения «Сбера») — построены на открытых технологиях (Hadoop/Spark, Kafka, ClickHouse) с языком правил, аналогичном YARA-L, для описания сложных поведенческих паттернов.

-

ClickHouse (аналитическая СУБД) + Python (язык программирования) — детектирование через Python-скрипты, исполняемые непосредственно на данных в ClickHouse или совместимом DWH (Data Warehouse — централизованный репозиторий для структурированной аналитической отчетности).

Категория В: Платформы для расследований

Эти системы не занимаются первичным детектированием. Их сила — в агрегации и анализе уже выявленных инцидентов.

Платформа принимает уведомления из любых источников, обогащает их контекстом, строит временные линии и предоставляет инструменты для координации реагирования.

Пример использования. Уведомление от американской компании CrowdStrike о подозрительном процессе автоматически обогащается в платформе типа IBM Resilient (ведущая платформа класса SOAR компании IBM):

-

Проверка индикаторов компрометации (далее по тексту — IOC) в потоках данных об угрозах.

-

Поиск связанных событий в платформе кибербезопасности от Alphabet (Google) Chronicle за последние 30 дней.

-

Автоматический сбор артефактов с затронутого сервера.

-

Запуск playbook (сценария действий для обнаружения, анализа, локализации и устранения конкретных инцидентов, далее по тексту — playbook/s) изоляции с эскалацией на аналитика для подтверждения.

Архитектурная интеграция: ИИ как слой автоматизированного триажа

Платформы для расследований блестяще справляются с задачей консолидации и обогащения инцидентов, предоставляя аналитику единое окно для работы. Однако они не решают главную проблему современного SOC — перегрузку первичными алертами. Даже самые продвинутые SIEM (система сбора, нормализации и корреляции событий безопасности для обнаружения инцидентов и расследований, далее по тексту SIEM) и EDR (класс решений для обнаружения угроз на конечных устройствах и реагирования на них, далее по тексту EDR) продолжают генерировать поток событий, в котором тонут действительно критичные угрозы. Именно здесь на сцену выходит ИИ-помощник — следующий логический шаг эволюции, призванный не просто помогать в расследовании, а автоматизировать его первый и самый трудоемкий этап.

Основная задача первичной обработки событий в любом SOC — ручная обработка и анализ выявленных уязвимостей (далее по тексту – триаж).

Триаж — это процесс первичной оценки, сортировки и приоритизации выявленных уязвимостей, инцидентов или алертов безопасности. Он необходим для быстрого определения критичности угроз и первоочередного реагирования на наиболее опасные из них, когда ресурсов недостаточно для обработки всего потока данных. Именно эту функцию, традиционно требовавшую значительных ручных усилий аналитиков первой линии (L1), сегодня принимает на себя ИИ-ассистент. Он выступает в роли интеллектуального фильтра, автоматически обрабатывая сырой поток уведомлений: фильтрует заведомо ложные срабатывания, обогащает подозрительные события контекстом и присваивает каждому инциденту приоритет на основе поведенческого анализа и истории угроз. Таким образом, ИИ-ассистент реализует автоматизированный триаж, превращая хаос данных в структурированные задачи для экспертов и кардинально снижая нагрузку на аналитиков.

Интеллектуальный триаж на основе ансамблей моделей

Современный ИИ-ассистент в SOC — это не одна модель, а архитектурный слой, интегрированный между корреляционным движком SIEM и аналитиком SOC, позволяющий снизить количество инцидентов, поступающих аналитику для ручного разбора:

Процесс интеллектуального триажа выглядит следующим образом:

-

Входные данные: размеченные исторические инциденты + контекст (тип события, источник, временные паттерны, поведенческие аномалии)

-

Ансамбль моделей:

o Градиентный бустинг для структурированных признаков

o NLP-модели (модель обработки естественного языка) для анализа командных строк, логов приложений

o Временные ряды (LSTM) для выявления паттернов во времени

3. Выход: оценка критичности (баллы 0-100) + рекомендации по приоритизации инцидентов.

Обнаружение аномалий без сигнатур

UEBA (User and Entity Behavior Analytics) — это технология кибербезопасности, использующая машинное обучение для анализа поведения пользователей и ИТ-сущностей (серверов, устройств, приложений). Она строит «базовые» профили нормальной активности и автоматически выявляет аномалии, указывающие на инсайдерские угрозы или взломы, что эффективнее статических правил.

UEBA-подход в действии:

-

Кластеризация (DBSCAN — алгоритм кластеризации данных, основанный на плотности соединений между точками (используется для поиска аномалий)): автоматическое выделение групп похожего поведения для выявления “белых ворон”.

-

Isolation Forest (алгоритм обучения без учителя для обнаружения аномалий, работающий по принципу изоляции аномалий, а не по наиболее распространенным методам профилирования нормальных точек): обнаружение редких, но значимых отклонений.

-

Поведенческие профили: динамическое обновление baseline с учетом сезонности, ролевых изменений.

Пример из практики. Система заметила, что разработчик Петр, обычно выкладывает обновление программного кода в систему контроля версий 5—10 раз раз в день, внезапно начал делать единичные коммиты с огромными бинарными файлами в 4 утра. Это не нарушает ни одного правила корреляции, но ML-модель (ML — машинное обучение, далее по тексту ML) отмечает аномалию, как потенциальную эксфильтрацию через Git (система управления версиями для отслеживания изменений в исходном коде и совместной работы).

Кросс-доменная корреляция через графовые нейросети

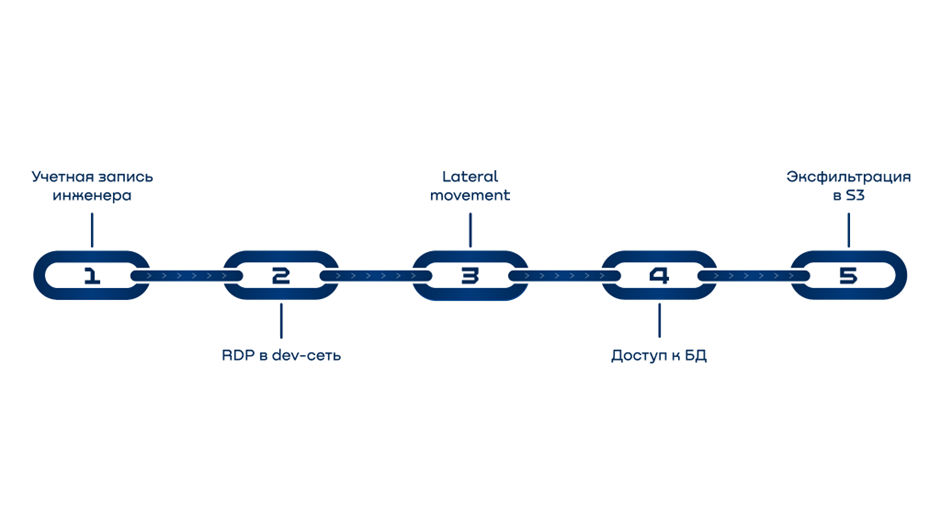

Современные атаки — это цепочки событий (kill chains), растянутые во времени и пространстве. Графовые нейросети (GNN) строят связи между разрозненными событиями.

Пример:

Dev-сеть — сегмент сети, выделенный для разработки, тестирования и отладки программного обеспечения.

Lateral movement — техника, когда злоумышленник, проникнув в сеть, передвигается по ней в поисках ценных данных или привилегий.

GNN обучаются находить подобные паттерны, даже если отдельные события выглядят легитимно, а временные промежутки измеряются неделями.

Интеграция с SOAR: автоматизированное реагирование

При достижении порога значимости модель инициирует playbook (документированная последовательность действий для обработки конкретного типа инцидентов или задач, далее по тексту playbook/s) через SOAR (платформа для оркестрации задач, автоматизации рутинных процессов и скоординированного реагирования на инциденты, далее по тексту SOAR), но с обязательным human-in-the-loop (методом машинного обучения, при котором человек активно участвует в процессе обучения, настройки и контроля систем искусственного интеллекта) для критичных операций.

Пример playbook:

-

Сбор артефактов на затронутом хосте;

-

Изоляция хоста в сети;

-

Уведомление владельца хоста.

Метрики эффективности, которые говорят сами за себя

Внедрение ИИ-слоя трансформирует ключевые показатели SOC:

Экономический эффект: снижение операционных затрат на 30-50% за счет сокращения ручного труда, уменьшение ущерба от инцидентов благодаря более раннему обнаружению, повышение качества расследований.

Ограничения и “темная сторона” ИИ в SOC

Описанные выше метрики и возможности могут создать впечатление, что «серебряная пуля» для кибербезопасности наконец найдена. Однако, как и любой мощный инструмент, искусственный интеллект требует трезвого взгляда на свои ограничения и уязвимости. Внедрение ИИ в критически важные контуры безопасности — это не только снижение рисков от атак, но и появление новых, специфичных для самой технологии рисков. Если рассматривать ИИ как панацею и слепо ему доверять, можно не только не усилить защиту, но и создать новые бреши. Поэтому, прежде чем интегрировать ИИ в ядро SOC, необходимо четко понимать его «темную сторону» и архитектурные ловушки, которые могут свести на нет все преимущества автоматизации.

Почему ИИ не заменит аналитика

-

Слепота к бизнес-контексту: модель не понимает, что ненормальная активность директора в 3 ночи может быть подготовкой к квартальному отчету.

-

Уязвимость к атакам на ML:

o Adversarial examples — минимальные искажения входных данных, меняющие предсказание.

o Data poisoning — преднамеренное загрязнение обучающей выборки.

o Model stealing — кража модели через API (программный интерфейс приложения) для разработки обходных методов.

3. Проблема интерпретируемости: Черный ящик, принимающий решения по тысячам признаков — это операционный риск. XAI (Explainable AI) (подход к созданию моделей, чьи решения понятны и интерпретируемы для человека) через SHAP/LIME (методы объяснения предсказаний моделей машинного обучения) стало обязательным.

Архитектурные риски

-

Ложное чувство безопасности: “ИИ все видит” — опасная иллюзия, приводящая к ослаблению других контролей.

-

Переобучение на исторических данных: Модель, обученная на атаках 2020-2023, может пропустить принципиально новые техники.

-

Зависимость от качества данных: Garbage in — garbage out (принцип, согласно которому некачественные входные данные приводят к некачественным и бесполезным результатам на выходе): плохая нормализация логов убивает любую, даже самую продвинутую модель.

Практические рекомендации по внедрению

1. Начните с Data Foundation (базовый уровень организации, хранения и управления данными для их дальнейшего использования в аналитике)

-

Нормализуйте логи по общей схеме (OCSF, CIM — открытые стандарты для унификации форматов событий безопасности от разных вендоров).

-

Обеспечьте качественную разметку исторических инцидентов.

-

Реализуйте pipeline непрерывного сбора обратной связи от аналитиков.

2. Выбирайте гибридный подход

-

ML-детектирование (Категория А) для неизвестных угроз и аномалий.

-

Data-centric (подход к безопасности, фокусирующийся на защите самих данных, а не инфраструктуры) поиск (Категория Б) для проактивной охоты и известных паттернов.

-

Платформа расследований (Категория В) как единая точка агрегации.

3. Внедряйте постепенно

-

Первые три месяца — автоматический триаж ложных срабатываний, базовое обогащение;

-

С четвертого по шестой месяц — обнаружение аномалий UEBA, интеграция с SOAR для действий по минимизации рисков;

-

Во втором полугодии — кросс-доменная корреляция, автоматизированное реагирование для средних рисков.

4. Контролируйте и измеряйте

-

Тестовый контур: параллельный запуск детектов ИИ и традиционных правил.

-

Регулярные ретроспективы: анализ пропущенных инцидентов и ложных срабатываний.

-

Метрики бизнес-эффекта: не только технические KPI (ключевые показатели эффективности), но и влияние на безопасность бизнеса.

Будущее: от автоматизации к автономным SOC

Следующий эволюционный шаг — автономные системы безопасности, где ИИ не только обнаруживает угрозы, но и:

-

Прогнозирует уязвимости на основе анализа кода, конфигураций и Threat Intelligence (знания о текущих киберугрозах, тактиках злоумышленников и индикаторах компрометации).

-

Симулирует атаки для проверки эффективности защитных мер.

-

Адаптирует security posture (уровень защищенности) в реальном времени в ответ на изменение угроз.

Но даже в этом будущем человек останется стратегическим центром — задающим цели, принимающим рискованные решения и несущим ответственность. ИИ — это не замена, а сила-умножитель, который превращает аналитика из оператора алертов в охотника за угрозами и архитектора безопасности.

Заключение

ИИ в SOC — это не магия, а инженерная дисциплина. Успех приносят не сами алгоритмы, а их грамотная интеграция в рабочие процессы, качество данных и четкое понимание границ автоматизации.

Современный эффективный SOC — это симбиоз трех подходов: поведенческого анализа для неизвестных угроз, поиска для проактивной защиты и платформ расследований для скоординированного ответа. ИИ-слой автоматизирует триаж и рутину, освобождая человеческую экспертизу для задач, где она незаменима: стратегического анализа, охоты за угрозами и принятия решений в условиях неопределенности.

Ценность ИИ измеряется не процентом замененных аналитиков, а процентом их времени, перераспределенного с рутинных операций на задачи, создающие реальную безопасность бизнеса.

Автор: Innostage