Иногда в разговоре с ЛЛМ можно забыть, что с тобой беседует набор алгоритмов, весов и распределений — настолько он может показаться убедительным.

Но если Большая языковая модель не умеет чувствовать и думать как мы, то как ей удается подменять собой человека? При чем она так хорошо с этим справляется, что сейчас трендом стала сердечно-закадычная дружба с БЯМами. Кстати, по какой-то причине сей тренд захлестнул особенно сильно эстонскую молодежь.

Так в чем секрет иллюзии?

Execute: Жечь глаголом сердца людей

Если открыть платонов “Пир” на эпизоде с застольем у Агафона, то можно наткнуться на интересное рассуждение врача Эриксимаха о том, что жизнь нуждается в равновесии противоположностей: тяжелого-легкого, смешного-грустного, спокойного-активного и так далее.

Человеческая речь тоже живая. И ей тоже нужен баланс, причем не абы какой, а температурный. Лексика, которую мы используем имеет свою тепловую сигнатуру и помогает нам лучше интерпретировать содержание, контекст, эмоции и остальной вербальный контент, становящийся начинкой увлекательной беседы. А еще она устраняет речевую монотонность.

Например, ответ на вопрос “как дела?” можно условно представить в трех температурных окрасках:

-

“Нормально” — холодно, как галька Выборгского залива в ноябре.

-

“Да ничего вроде…” — ближе к нагревающейся батарее, когда отопительный сезон только начинается.

-

“Феноменально!” — это почти солнечная вспышка экстра-класса, глушащая вихрем радиации геостационарные спутники.

Люди интуитивно понимали эту особенность вербалики всегда. И когда дело дошло до ЛЛМ, в алгоритмическую архитектуру был введен параметр t e m p e r a t u r e. Его главная задача регулировать стохастический выбор следующего токена: иными словами, повышать или понижать случайность следующего слова в цепочке ответа.

Чем ниже температура, тем на более предсказуемых токенах будет сделан выбор. Вот, например cold temp-описание морского пейзажа:

“Море синее и пахнет солью. Над ним летают чайки”.

Вот как бы это выглядело графически:

А вот более высокая температура увеличивает вероятность того, что модель выберет менее вероятные и логичные токены. Это происходит потому, что более высокое значение температуры вносит вариативность в процесс отбора слов и это приводит к высокой непредсказуемости написанного:

“Как если бы небо разлилось по земле бездонной бирюзовой лужей, и над ним кружили вестницы бурь и штормов, горластые чайки, глотающие крики вперемешку с солеными брызгами — вот что такое море!”

Правда здесь есть забавная корреляция с жизнью: когда у нас высокая температура, мы иногда впадаем в делирий или по-простому бред. ЛЛМ, перегретая температурным режимом, тоже может начать галлюцинировать, неся ахинею, потому что разброс в случайных словах становится большим.

Таким образом, бросая нас то в поэтический жар, то в фактуальный бесстрастный холод, ЛЛМ учится имитировать динамику живой речи через игру температурных оттенков.

Конфигурация параметра

Как правило температурный компонент в БЯМе зиждется на трех основных китах:

-

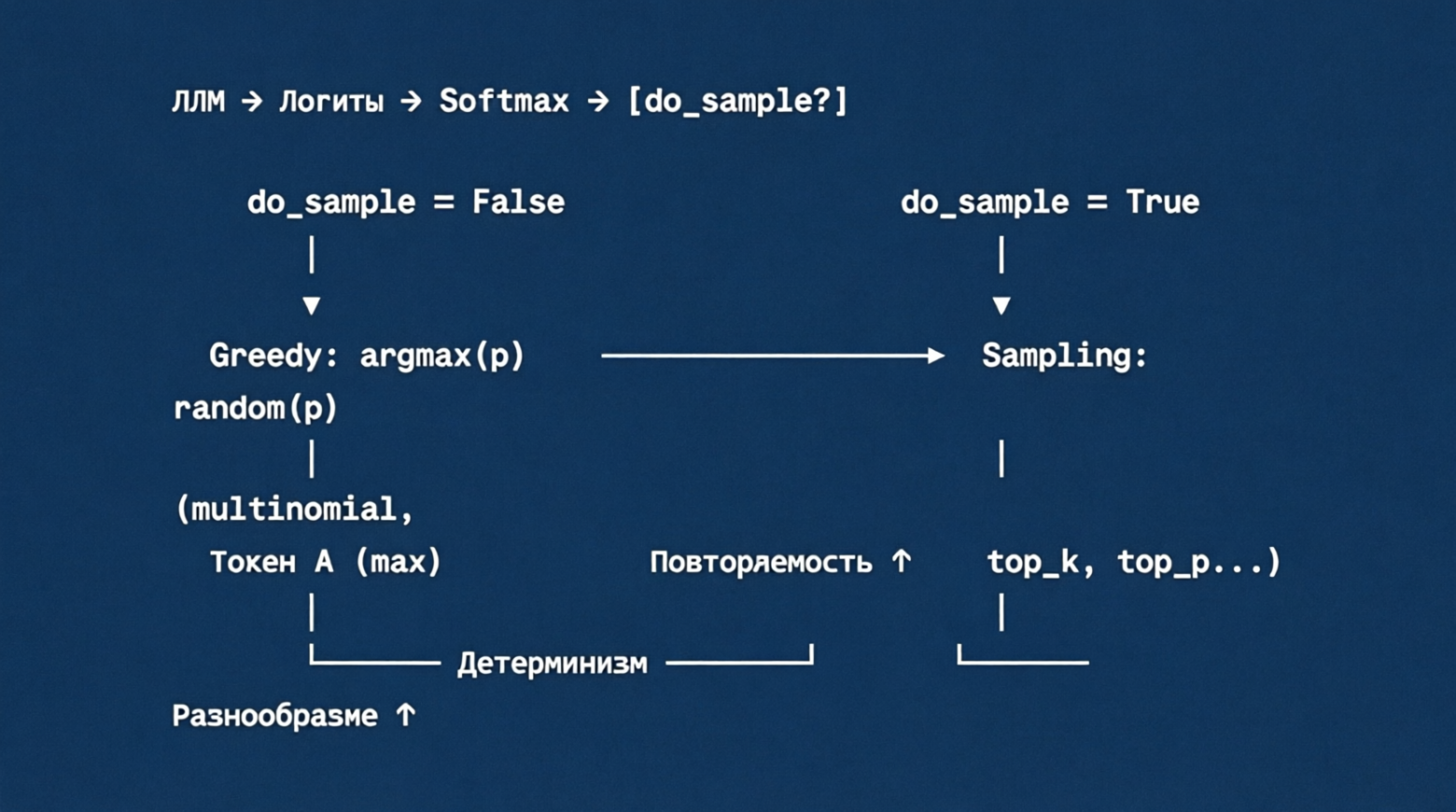

Do_sample

Этот параметр решает, задействует ли модель семплирование во время создания текста или нет. Сэмплирование — это то, что позволяет разнообразить конечный текстовый результат. Когда он активен в состоянии do_sample=True, то включается режим стохастического декодирования.

То есть ИИ ослабляет вожжи детерминированности и выбирает следующие лексемы более случайным образом, из вероятностного распределения. Это как в вольной манере пересказывать у доски отрывок из “Дубровского”: суть вроде на месте, а вот слова могут быть самые разные — не всегда грамотно-литературные, но, вроде, типа, как бы понятные.

-

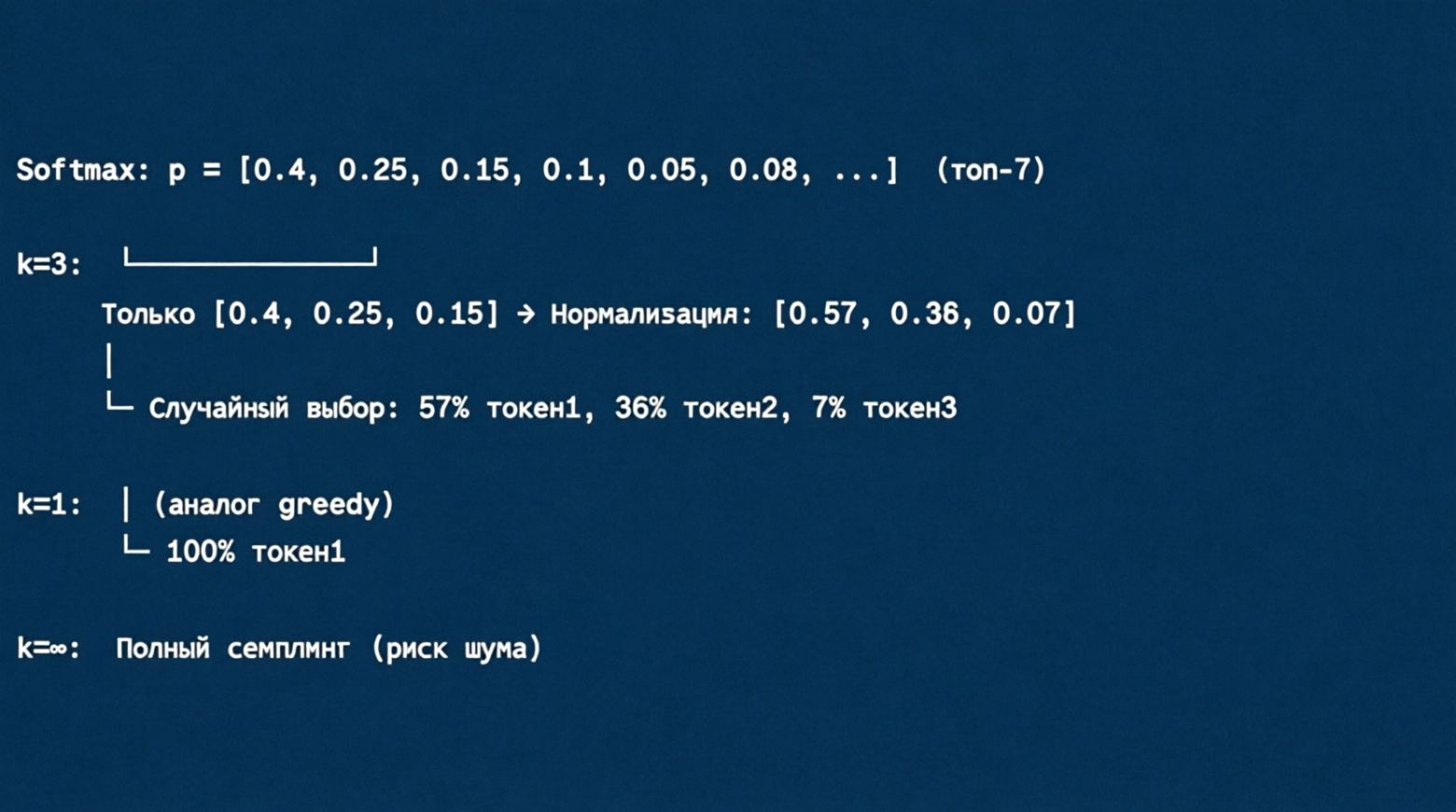

Top_k

А этот параметр играет роль смыслового сита. Вкратце, если do_sample может уйти слишком сильно в разнос и насобирать, как репейника, кучу случайных, но не релевантных слов, то top_k сэмплирование сужает круг допустимых вариантов до N-количества самых подходящих токенов из тех что уже есть на руках. Благодаря этому текст не превращается в бессвязную белиберду.

-

Top_p

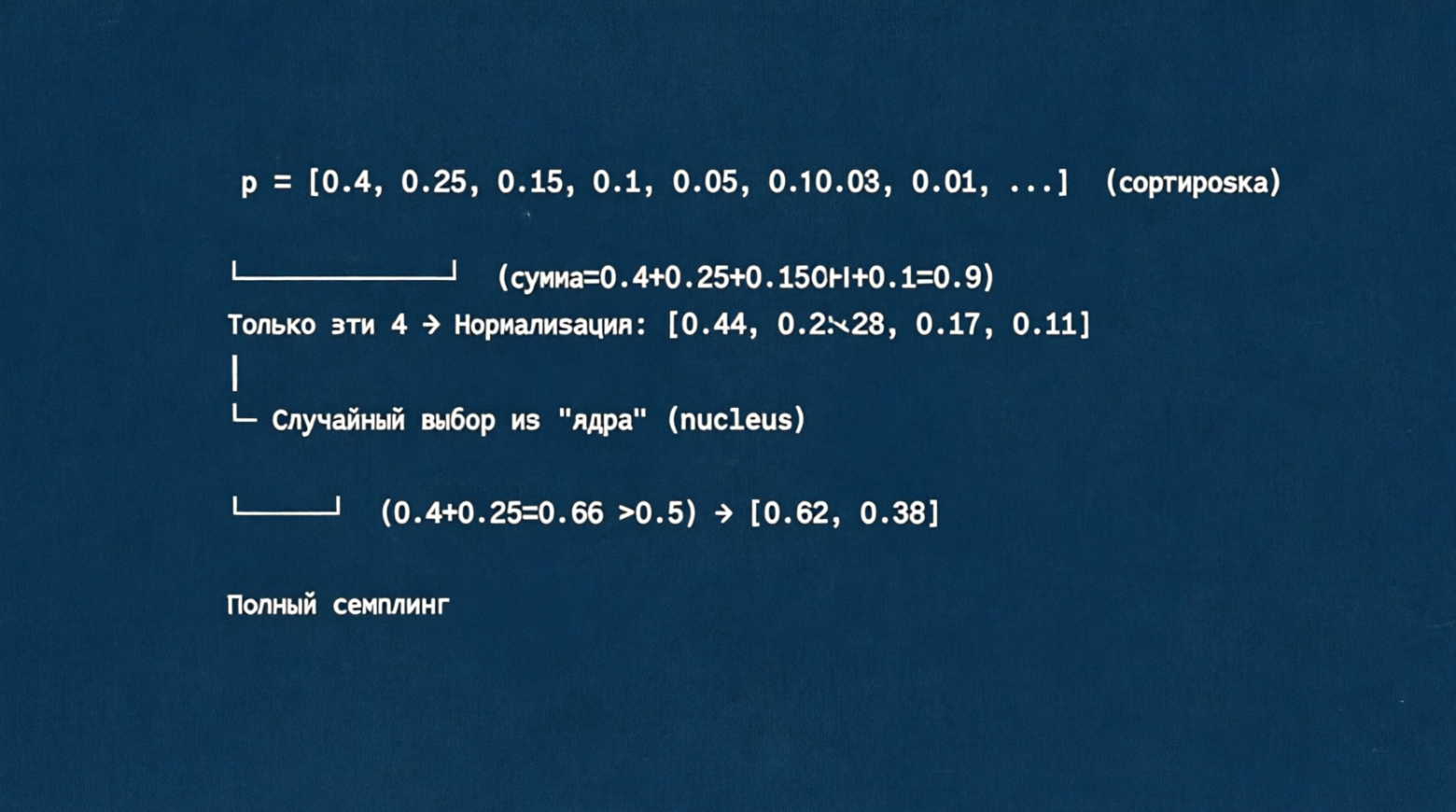

Это еще один метод сэмплирования, также называемый “ядерной выборкой”. Данный параметр ограничивает выбор следующего токена набором самых вероятных слов, суммарная вероятность которых дает не меньше, чем значение p, которое должно превышать определенный порог, например в 95%.

Так что если случайная выборка позволяет БЯМу достичь более динамичной речи, то top_p придает тексту когезивность, последовательность и связность. Иначе мы бы временами получали абсолютно клинические результаты по типу “Крокодил из Урюпинска укусил фарфоровые качели и они закричали: Адажио! Адажио!”.

Точно розовое пламя…

Конечно температура — далеко не единственный параметр ответственный за успешную мимикрию ЛЛМ под человека. Не меньшую роль в успехе играют механизм самовнимания (self-attention), дообучение с учителем или supervised fine-tuning, обучение с подкреплением на основе обратной связи от человека (RLHF), а также методы инструктивного обучения и многое-многое другое.

Но понимание того как работает случайность в языке, наверное, очеловечило говорящий ИИ больше всего. Если бы не параметр температуры, мы до сих пор разговаривали с БЯМ как с телефонным справочником: сухим, бесстрастным и холодным как подъездная ступенька.

Конечно благодаря температуре человеком ИИ не станет. Но возможно этот параметр — это первый шаг к пониманию искусственным разумом того, что такое эмоция и спонтанность. Поживем, увидим.

Интересный факт: История Искусственного интеллекта во многом началась не без помощи Евгения Онегина, который процитирован в названии статьи. В 1912 году выдающийся русский ученый Андрей Марков провел уникальный эксперимент. Он разобрал на составляющие 20 000 букв, взятых из поэмы, чтобы доказать, что математически возможно предсказать появление гласных или согласных букв в тексте. Так на свет появились цепи Маркова. Подробнее читать здесь.

Автор: DimaIam