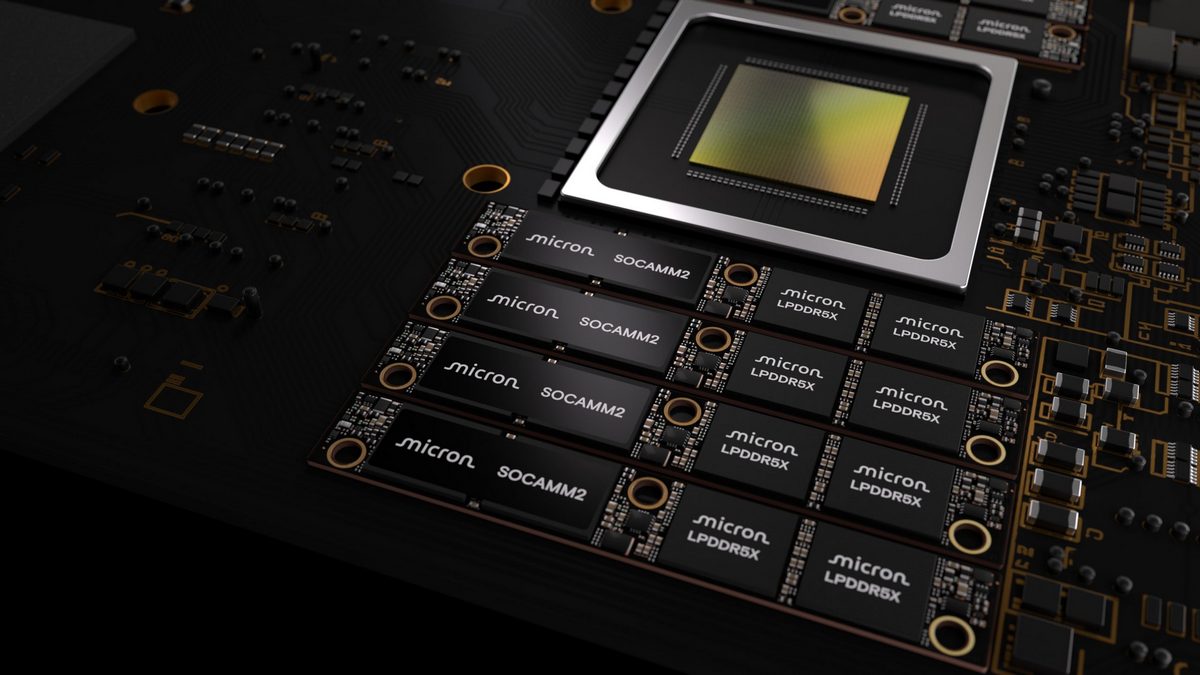

Micron презентовала модуль оперативной памяти формата SOCAMM2 объёмом 256 ГБ, что стало существенным скачком по сравнению с предыдущим порогом в 192 ГБ. Производитель указывает, что SOCAMM2 будет интегрирован в современное оборудование инфраструктуры искусственного интеллекта и поможет решить проблему нехватки памяти.

Разработанный совместно с Nvidia стандарт SOCAMM2 отличается лучшей производительностью и энергоэффективностью благодаря использованию KV-кэша, что обеспечивает уменьшение задержки при обработке рабочих нагрузок.

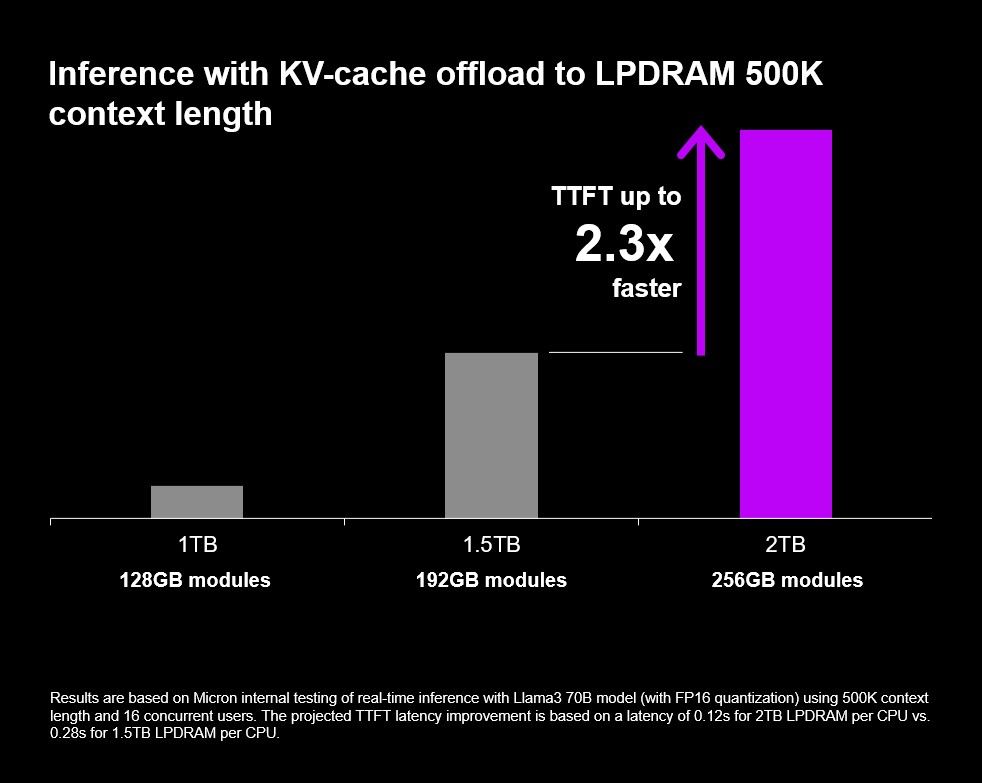

В последней версии SOCAMM2 Micron увеличила ёмкость одного монолитного кристалла LPDRAM до 32 ГБ. В модели объёмом 256 ГБ обеспечивается до 2 ТБ LPDRAM на каждый 8-канальный процессор, что позволяет ИИ-серверам быстрее обрабатывать длинные контекстные окна.

Micron указывает, что с SOCAMM2 время отклика увеличилось в 2,3 раза для вывода данных с длинным контекстом. Это значительно помогает в решении задач, требующих работы с агентными нагрузками, где ключевую роль играют автономные приложения, выполняющиеся на ЦП.

SOCAMM2 разработали для обеспечения более высокой плотности в компактном форм-факторе по сравнению с RDIMM и LRDIMM. Подобные модули будут применять на платформе Vera Rubin.

Образцы SOCAMM2 объёмом 256 ГБ уже отгрузили клиентам. Продукт Micron представят на конференции Nvidia GTC 2026, которая пройдёт 16-19 марта этого года.

Автор: Travis_Macrif