Когда модели ИИ анализируют изображения, небольшие ошибки восприятия накапливаются на нескольких этапах и приводят к неверным ответам. Фреймворк HopChain генерирует многоэтапные вопросы к изображениям, которые напрямую решают эту проблему и улучшают результаты в 20 из 24 контрольных показателей.

Языковые модели обработки изображений (VLM) хорошо показывают себя во многих тестах на сопоставление изображений и текста, но они регулярно дают сбой в задачах, требующих нескольких последовательных шагов рассуждения об изображении. Исследователи из команды Alibaba и Университета Цинхуа изучили причины этого явления и создали HopChain — фреймворк, предназначенный для решения этой проблемы.

Когда модели на основе визуальных моделей дают длинные ответы с промежуточными шагами, так называемые ответы, построенные по принципу цепочки рассуждений, возникают всевозможные ошибки. Модели неправильно подсчитывают объекты, путают пространственные отношения, искажают детали или делают логически неверные выводы. Эти ошибки распространяются по всей цепочке рассуждений. Одна неправильно идентифицированная деталь на раннем этапе приводит к аргументу, который звучит убедительно, но в конечном итоге оказывается неверным.

Существующие обучающие данные для алгоритма обучения с подкреплением и проверяемыми вознаграждениями (RLVR), в котором модели обучаются на основе автоматически проверяемых ответов, практически не включают задачи, требующие пристального визуального внимания на протяжении нескольких этапов.

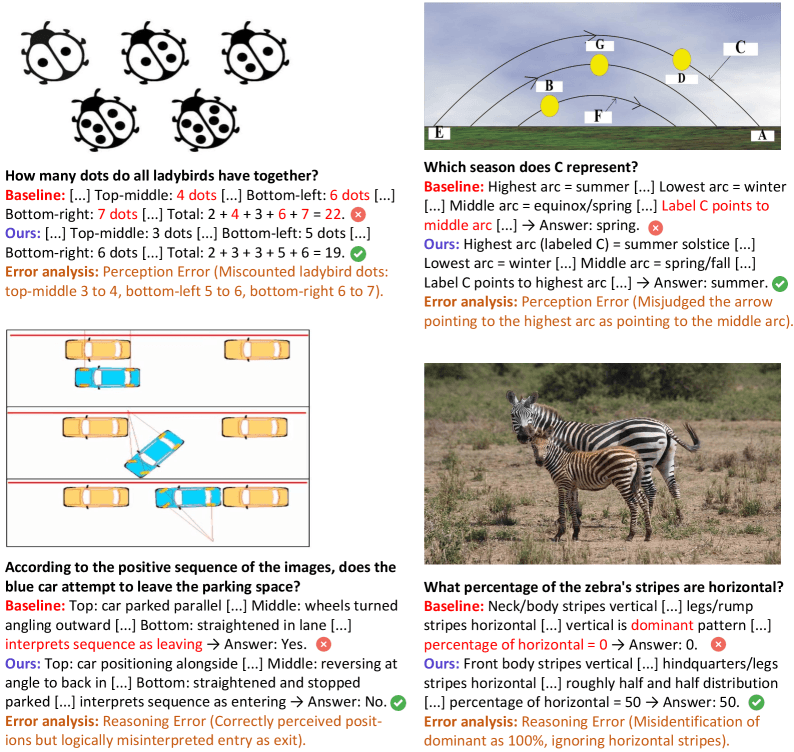

Неправильный подсчет точек

В одном из примеров модель должна посчитать точки на нескольких божьих коровках. Она ошибается в подсчете трех из пяти жуков, полагая по одной точке на каждого, что в сумме дает явно неверное число. В другом случае модель правильно определяет положение автомобиля на последовательности изображений, но интерпретирует движение как выезд с парковочного места вместо въезда. Третий пример показывает, как модель указывает стрелкой на астрономической диаграмме не на ту дугу и попадает не в то время года.

Приведенные примеры включают фотографии, диаграммы и научные иллюстрации, но объединяет их общая закономерность: один неверный промежуточный шаг отравляет все последующие.

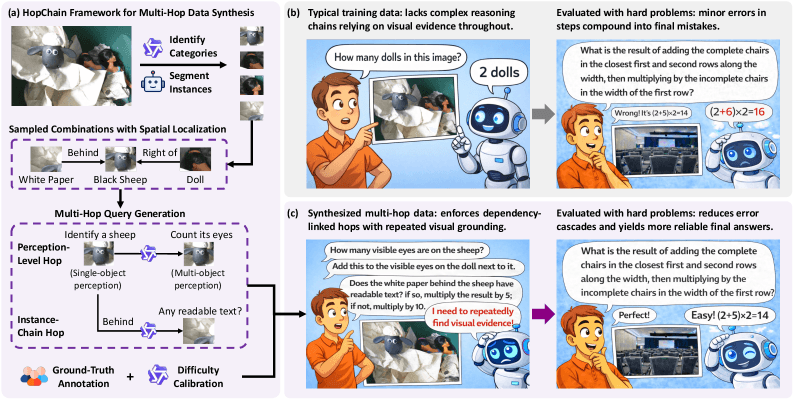

Многоэтапные вопросы, касающиеся изображений, заставляют модели продолжать поиск

HopChain автоматически генерирует вопросы по изображениям, где каждый шаг основывается на предыдущих результатах и заставляет модель повторно анализировать изображение. Исследователи встроили два типа связей: во-первых, задачи чередуются между распознаванием одного объекта, например, чтением текста или определением цветов, и сравнением нескольких объектов, например, соотношением размеров или пространственным расположением. Во-вторых, каждый вопрос следует цепочке зависимостей между объектами, где модель может найти следующий релевантный объект только через те, которые она уже идентифицировала.

Каждый вопрос заканчивается уникальным числом, которое служит автоматической проверкой ответа. Один из примеров из работы дает представление о том, насколько сложными могут быть такие задания: модель сначала считает глаза на игрушечной овечке, затем проверяет, есть ли какой-либо текст на фоновом листе бумаги. После этого она считает глаза на ближайшей кукле, читает слово на листе бумаги перед второй куклой, считает буквы, выполняет ряд арифметических действий и умножает результат на общее количество игрушечных фигурок в сцене. Правильный ответ: 72.

Четыре этапа с контролем качества

Процесс генерации данных состоит из четырех этапов. Сначала языковая модель Alibaba Qwen3-VL -235B-A22B-Thinking определяет категории объектов на изображении. Затем модель сегментации Meta SAM3 находит отдельные экземпляры этих категорий.

На третьем этапе языковая модель формирует многоуровневые вопросы на основе изображений, состоящие из комбинаций от трех до шести объектов. На четвертом этапе четыре эксперта-аннотатора независимо решают каждый вопрос.

Отбираются только те вопросы, на которые все четыре аннотатора сходятся во мнении. Вопросы, с которыми более слабая модель легко справляется, также отбрасываются. В результате этого процесса для каждой модели получается примерно от 60 000 до 80 000 обучающих примеров.

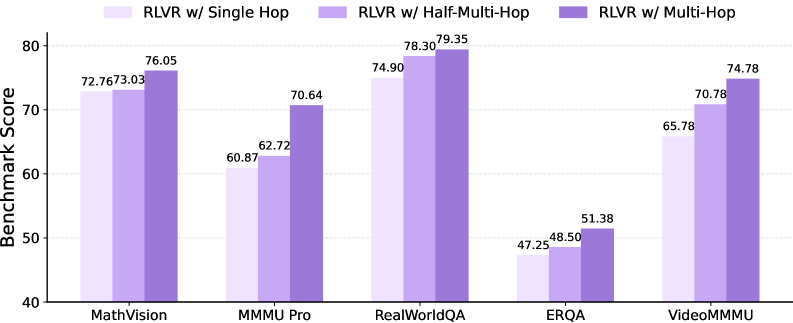

HopChain демонстрирует улучшенные результаты в 20 из 24 бенчмарков

Исследователи обучили две модели, используя этот подход: Qwen3.5-35B-A3B и Qwen3.5-397B-A17B . Они протестировали RLVR, используя только существующие обучающие данные, в сравнении с RLVR, использующим существующие данные плюс вопросы HopChain, измеряя производительность по 24 эталонным тестам в четырех категориях: STEM и головоломки, общее понимание изображений, распознавание текста и понимание документов, а также понимание видео.

Для обеих моделей данные HopChain показали улучшение по 20 из 24 показателей. У меньшей модели показатель EMMA вырос с 53 до 58, а у CharXiv — с 69 до 73,1. У большей модели показатель BabyVision увеличился с 28,61 до 32,22, а показатель ZeroBench удвоился — с 4 до 8. Поскольку сгенерированные вопросы не адаптированы к какому-либо конкретному показателю, исследователи считают это свидетельством подлинной обобщаемости.

Несмотря на то, что обучающие данные полностью основаны на изображениях, обе модели также улучшили свои результаты в пяти из шести видеотестов, что говорит о том, что навыки, которым учит HopChain, применимы не только к статичным изображениям.

Полные цепочки вопросов имеют решающее значение

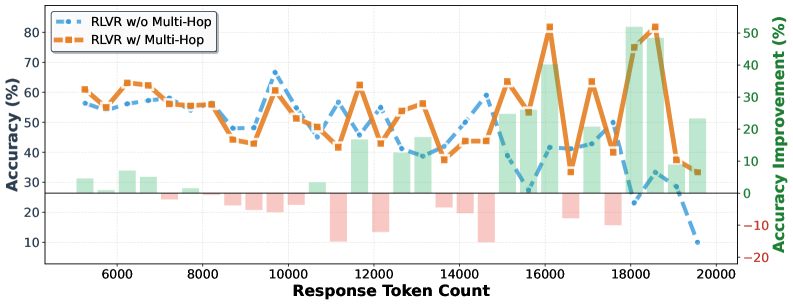

Исследование методом абляции показывает, что полное составление цепочки вопросов является ключевым моментом. Когда вопросы сводятся только к последнему шагу, средний балл по пяти репрезентативным контрольным показателям падает с 70,4 до 64,3. Сохранение только второй половины цепочки позволяет получить результат 66,7.

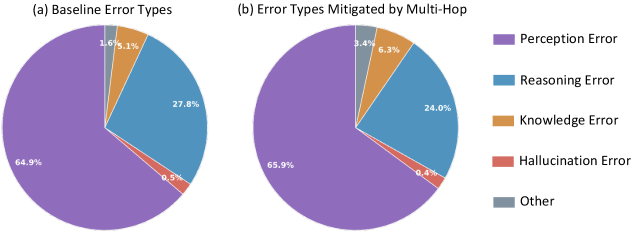

Улучшения также зависят от длины цепочки рассуждений. Для особенно длинных ответов повышение точности для более крупной модели превышает 50 пунктов. Анализ ошибок подтверждает, что HopChain помогает во всех областях: ошибки восприятия, логики, знаний и галлюцинаций демонстрируют сопоставимые улучшения. Распределение исправленных ошибок точно соответствует исходному профилю ошибок.

Одно ограничение: для распознавания объектов на изображении конвейеру требуется SAM3, поэтому изображения без сегментируемых объектов не учитываются при генерации данных.

Тот факт, что визуальное восприятие остается ключевой слабостью современных моделей, недавно подтвердился и в бенчмарке WorldVQA от Moonshot AI. Даже модель с наивысшим баллом правильно идентифицировала менее половины показанных объектов, и каждая модель систематически переоценивала собственную точность.

Кроме того, анализ, проведенный Стэнфордским университетом, показал, что перспективные модели достигают 70-80 процентов своих результатов в эталонных тестах обработки изображений, даже не видя изображения, и уверенно описывают визуальные детали, которых не существует.

Делегируйте часть рутинных задач вместе с BotHub! Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке вы можете получить 300 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Автор: MrRjxrby