Бизнес генерирует данные: клики по рекламе, история транзакций, поведение пользователей в приложениях, измерения датчиков на производстве. Предиктивная аналитика — это процесс использования этих данных для построения прогнозов. В его основе — идея, что в событиях прошлого есть закономерности, которые с некоторой вероятностью повторятся в будущем. Это можно использовать, чтобы предсказать отток клиентов, оптимизировать маркетинговые бюджеты, спрогнозировать спрос или даже подобрать оптимальное лечение.

Мы поговорили с тремя специалистами по машинному обучению и data science (ML/DS) и попросили их рассказать о своём пути и проектах. А в конце собрали советы для тех, кто хочет начать свой путь в data science: какие навыки качать, где брать опыт и к чему готовиться на собеседованиях.

Что под капотом у предиктивной аналитики

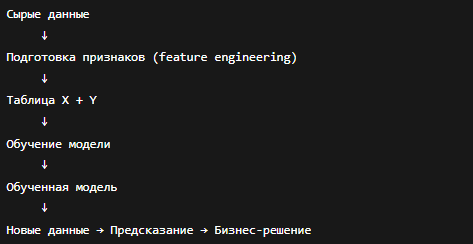

Внутри любого проекта по предиктивной аналитике, будь то анализ рекламных кампаний или поломок на заводе, есть три основных компонента:

1. Данные, которые предварительно структурируют, например, в таблицы, где каждая строка — объект наблюдения (клиент, транзакция, сессия), а каждый столбец — его признак. Для клиента онлайн-магазина это может быть средний чек, частота покупок, любимая категория товаров. Для оборудования на заводе — температура, вибрация, время наработки. В медицине признаками для анализа рентгеновского снимка служат числовые представления его пикселей.

2. Модель — математический движок, который ищет закономерности в данных. Технически это функция вида f(X) → Y, где X — набор признаков, а Y — целевая переменная, то есть то, что нужно предсказать.

Сама функция f может быть разной: от относительно простой логистической регрессии до сложных ансамблей деревьев решений (CatBoost, XGBoost) или нейросетей. Задача модели — обучиться на исторических данных и как можно точнее предсказывать Y для новых объектов.

3. Алгоритм обучения — настройщик модели. Алгоритм итеративно подбирает внутренние параметры модели (веса), чтобы её прогнозы на исторических данных как можно меньше отличались от реальных значений. Говоря техническим языком, он минимизирует функцию потерь — метрику, которая измеряет ошибку модели. Простая схема работы алгоритма:

Данные → Модель → Прогноз → Сравнение с фактом → Ошибка → Корректировка → Модель

Цикл повторяется, пока ошибка прогноза не станет минимальной.

Простой пример работы модели-предсказателя

Представим абстрактную задачу: нужно предсказать, уйдёт ли клиент из сервиса в следующем месяце. Работу разобьём на несколько шагов.

Шаг 1. Подготовка данных

Собираем историю поведения клиентов: как часто они заходили в приложение, сколько потратили, обращались ли в поддержку, как давно зарегистрировались. Каждый клиент становится строкой в таблице, а каждая характеристика — столбцом (признаком).

Но сырые данные редко готовы к использованию. Их нужно очистить и преобразовать:

-

Удалить дубликаты и ошибки. Например, если один клиент записан дважды с разными ID, или дата регистрации указана как «32 января».

-

Заполнить пропуски. Если у части клиентов не указан город, можно заполнить его средним значением, самым частым вариантом или пометить как «неизвестно».

-

Создать новые признаки. Вместо даты последнего входа можно посчитать «сколько дней прошло с последнего визита» — это более полезный признак для модели.

-

Нормализовать данные. Привести все числа к одному масштабу. Например, возраст клиента от 18 до 80 и сумма покупок от 100 до 100 000 ₽ имеют разный порядок величин. Модель может запутаться, если не привести их к общему виду.

Часто новички думают, что самое сложное — построение моделей. На практике обучение модели занимает несколько строчек кода, а подготовка данных — это 80% всего времени и усилий. Процесс превращения сырых данных в признаки называют генерацией признаков (feature engineering). Чем лучше подготовили данные, тем выше качество работы модели.

Шаг 2. Обучение модели

Берём данные за прошлый год, где известно, кто из клиентов ушёл (Y = 1), а кто остался (Y = 0), и загружаем таблицу с признаками (X) и результатами (Y) в программу (например, на Python с нужной библиотекой) и запускаем процесс обучения. Это выглядит примерно так:

model.fit(X_train, y_train)Алгоритм работает методом проб и ошибок. Он начинает со случайных предположений, затем сравнивает свои прогнозы с реальными результатами и постепенно корректирует внутренние параметры модели (веса), чтобы ошибка становилась меньше. После множества примеров модель замечает закономерности и может обнаружить: «Если клиент не заходил в приложение больше 10 дней и не совершал покупок последние 2 месяца, вероятность ухода высокая».

Шаг 3. Применение модели

Теперь мы берём данные о клиентах — тех, кто пользуется сервисом прямо сейчас. У нас есть их признаки (X): как часто заходят, сколько тратят и так далее. Но мы не знаем, уйдут они в следующем месяце или нет — это же будущее, которое мы хотим предсказать. Подаём эти признаки в обученную модель. Она анализирует их и выдаёт прогноз: «Клиент №12345 с вероятностью 87% уйдёт в следующем месяце».

Маркетинг может использовать этот прогноз, чтобы предложить клиенту персональную скидку и вернуть к покупкам до того, как он потеряет интерес к сервису.

Какие навыки нужны для предиктивной аналитики, и обязателен ли диплом мехмата

Прогнозированием занимаются разные специалисты:

-

дата-сайентист — исследует данные, выбирает алгоритмы, проводит эксперименты, фокусируется на качестве предсказаний;

-

ML-инженер — превращает прототипы в готовые решения, оптимизирует модели по скорости и ресурсам;

-

дата-аналитик — готовит данные, проводит разведочный анализ, помогает с feature engineering, находит полезные для бизнеса закономерности в данных, на их основе тестирует гипотезы;

-

data engineer — строит инфраструктуру: пайплайны для сбора данных, хранилища, ETL-процессы;

-

MLOps-инженер — разворачивает модели, мониторит их работу, настраивает автоматическое дообучение по новым данным.

В небольших командах один человек совмещает 2–3 роли. В стартапах DS часто сам готовит данные и запускает модель в прод. В крупных компаниях роли разделены.

Какой путь выбрать, зависит от интереса: исследования — в data science, надёжные системы — в ML engineering, инфраструктура — в data engineering. Но независимо от роли есть базовый набор навыков, с которого начинают все.

|

Хард-скиллы |

Софт-скиллы |

|

Основы математики: Линейная алгебра — язык данных. Без неё не понять нейросети или метод главных компонент, когда из множества признаков выделяют самые важные. Важно изучить матрицы (свойства и операции над ними), векторы, собственные значения. Теория вероятностей и статистика — распределения, доверительные интервалы, расчёт статистических характеристик (среднее, медиана, дисперсия). Для A/B-тестов важны статистические критерии (t-критерий Стьюдента, критерий хи-квадрат, критерий Манна-Уитни) и понимание их применимости и ограничений. Математический анализ — производные и интегралы. Численные методы. Основа большинства алгоритмов обучения — градиентный спуск (итеративный поиск минимума функции потерь). Понимание сходимости, learning rate, momentum помогает управлять обучением модели. Где учить: любые курсы по ML либо отдельные программы с базовой математикой. |

Бизнес-логика: зачем модель, какую проблему решает, как измерим успех, что если ошибётся. |

|

Python — базовый синтаксис, функции и библиотеки: Для более сложных проектов добавятся PyTorch или scikit-learn. Как учить: Kaggle, pet-проекты, автоматизация рутины. Синтаксис запоминается через использование. |

Коммуникация: находить общий язык с другими специалистами, задавать уточняющие вопросы, презентовать результаты работы. |

|

SQL — язык для работы с реляционными базами данных. В реальной жизни данные редко лежат в готовых CSV — их нужно доставать из баз, джойнить таблицы, агрегировать, фильтровать. Нужно уметь: |

Критическое мышление: сомневаться, искать ошибки в данных, понимать ограничения моделей. |

|

Git. Базовый навык для командной работы: коммиты, pull request’ы, ревью кода. |

|

Выпускникам технических вузов легче входить в профессию — у них уже есть математическая база и привычка мыслить алгоритмически и системно. Но даже им придётся многое доучивать: практический Python, работу с реальными данными, которые часто грязные и неструктурированные, бизнес-контекст.

Люди без технического образования тоже успешно входят в сферу — через курсы, самообучение, pet-проекты. Путь дольше, но пройти его реально. Главное — готовность разбираться в основах математики и программирования на Python.

Далее на опыте экспертов разберём предиктивные проекты разной сложности.

История первая: от биологии к нейромедиаторам

Татьяна Булгакова

Эксперт по ML и DL, ментор, научный консультант, в прошлом преподаватель на курсах ML И DL, лектор курса по A/B-тестированию в Нетологии

Пятнадцать лет назад я изучала физиологию слуха у китообразных в НИИ. Мы собирали данные с помощью электродов, фиксируя, как мозг дельфина реагирует на звуки. Большая часть работы — сбор данных и их анализ: таблицы в Excel, графики, поиск зависимостей. Классическая работа аналитика, только без современных инструментов.

В какой-то момент ручная обработка стала съедать всё время. Я поняла: нужно автоматизировать рутину. Это привело меня в ИТ, но не сразу в data science, а в системное администрирование. Я научилась работать с командной строкой, разобралась, как устроена ИТ-инфраструктура изнутри. Позже это очень помогло: когда строишь ML-пайплайны, понимание того, как данные движутся от источника до модели, критически важно.

Первый ML/DS-проект в маркетинге

Переход в data science случился около 2010 года, когда я работала в ИТ-компании. Отдельного отдела аналитики тогда не было, задачи решались по принципу «айтишник = универсал».

К нам пришли маркетологи: «Помогите проанализировать клиентов». Нужно было оценить спрос, lifetime value, эффективность промокодов. Я приступила к задаче, используя Python и scikit-learn, которые только начинали набирать популярность в бизнесе. Это был мой первый опыт применения математических моделей для задач бизнеса. Научилась переводить маркетинговые запросы на язык данных и моделей. Тогда ещё не было речи о deep learning, но я увидела, как даже простые алгоритмы приносят реальную пользу.

После этого я ушла в декретный отпуск, а вернулась с чётким намерением: искать проекты на стыке биологии, медицины и данных.

Фриланс и медицинский ML

Сейчас я фрилансер и могу выбирать проекты, которые мне интересны. Один из самых значимых — на стыке медицины и машинного обучения. Я помогала врачам в лечении пациентов с дислексией с помощью прибора для нейростимуляции.

Прибор крепится на голову, и его нужно точно настроить: выбрать расположение электродов и силу воздействия. Раньше врач делал это вручную, методом подбора — долго и неудобно для пациента. Тогда команда проекта решила создать рекомендательную систему, которая анализирует данные пациента и предлагает врачу оптимальные настройки прибора.

Наша модель обучается на исторических данных. Например, пациент А с показателями S, ему поставили настройки X, и это привело к улучшению Y. Пациент B — c аналогичным списком параметров и своими показателями. В этих данных модель учится искать закономерности: при каких симптомах и показателях какие параметры стимуляции дают максимальный эффект.

Для нового пациента обученная модель перебирает все возможные варианты настроек и предсказывает вероятность успеха: набор настроек А подходит на 80%, а B — на 30%. По сути, это оптимизация и персонализация через предсказание успешности исхода.

В итоге врач получает ранжированный список рекомендаций и на его основе принимает решение, какие выставить настройки. Ниже — схема нашей модели, которая показывает полный цикл работы: обучение на примерах, подготовка вариантов настроек и выбор лучших.

|

Этап |

Что происходит |

|

Подготовка исторических данных |

Для модели готовят набор данных по каждому пациенту: Получается связка: пациент + настройки → эффект лечения. |

|

Обучение модели |

Данные кодируются в вектор признаков и подаются в модель: Модель отвечает на вопрос: «как хорошо сработают эти настройки для этого пациента?» |

|

Модель работает с данными нового пациента |

Получает анамнез и показатели, генерирует допустимые варианты настроек и оценивает каждую комбинацию: пациент + настройки → score / P(успеха). |

|

Ранжирование вариантов настроек по ожидаемому эффекту |

Врач получает список рекомендаций: от перспективных к наименее полезным. |

Результатами проекта пока не могу поделиться — в медицине нужны долгие клинические испытания и согласования. Но качественный результат видим уже сейчас: врачи перестали воспринимать подбор терапии как слепой перебор. Модель отсекает заведомо неэффективные варианты и подсвечивает перспективные. Время на предварительную настройку сократилось, количество итераций подбора — тоже.

Этот проект показал всю сложность работы с медицинскими данными. Во-первых, нужна глубокая экспертиза. Мне пришлось много общаться с врачами, чтобы понять нюансы. Полагаться только на решение модели здесь нельзя: ставки слишком высоки.

Во-вторых, данные не стандартизированы, а их сбор и использование строго регулируются законами о защите персональных данных (152-ФЗ, GDPR). Подготовить и собрать данные до того, как напишешь первую строчку кода для модели, — огромная инженерная и юридическая работа.

История вторая: от геологии до Causal Inference в X5

Александр Кореньков

ML-инженер в X5, студент Нетологии

Я геолог по образованию, и вся моя семья из этой сферы, так что мой путь был как будто предопределён. Забегая вперёд, скажу, что в итоге я предал геологию и перешёл в e-commerce, но не пожалел.

Старт в ИТ: от геологии к дата-инжинирингу

С программированием я познакомился на стажировке в ИТ-отделе крупной нефтегазовой компании, где впервые столкнулся с машинным обучением. Мне нужно было создать двухэтапный пайплайн для анализа геологических данных. Я настроил две модели: одна работала на базе логистической регрессии, другая — на базе линейной. Первая классифицировала участки по скважинным данным, а другая на основе этой разметки прогнозировала ключевые параметры участков.

Для этого проекта мне хватило базового Python и понимания принципов работы двух классических моделей ML. Ключевую роль сыграла среда: я постоянно общался с более опытными коллегами, задавал вопросы и впитывал знания.

На следующем месте работы, уже в другой компании той же отрасли, я столкнулся с классической проблемой — хаосом в данных. Фокус сместился с ML на data engineering: я строил единую витрину данных, проектировал ETL-процессы и учился быть «переводчиком» между экспертами-геологами и разработкой. Так я прошёл путь от решения конкретных ML-задач до создания инфраструктуры для них.

Резкий поворот в ML для e-commerce

В X5 я пришёл ML-специалистом в команду продуктовых аналитиков. Это был серьёзный вызов: новая сфера, сильная команда и ожидания полноценных ML-решений в короткие сроки. Мой же опыт ограничивался прикладными моделями для геологии, многие из которых не выходили за рамки «опытного образца».

Например, клиент получил скидку 300 ₽ на заказ от 3 000 ₽ и воспользовался ей. Но если он и так собирался сделать заказ на 3 000 ₽, то мы просто потеряли 300 ₽. А если планировал заказать на 2 500 ₽, но добрал корзину до 3 000 ₽, то мы заработали 200 ₽. Чтобы понять, какой дополнительный доход принесла промоакция или отдельный канал, я строил модель оценки на ретро-данных. Провести A/B-тест не представлялось возможным. Маркетинг живёт намного быстрее, чем продукт, и должен быть более гибким.

Здесь я понял, что классический ML бессилен, и погрузился в Causal Inference — область на стыке эконометрики и ML, которая ищет причинно-следственные связи. У нас есть две группы: те, кто применил промокод, и те, кто не применил, но видел этот же промокод. Но их нельзя сравнивать в лоб. Те, кто применил, — это изначально более лояльные и активные клиенты. Их поведение всегда будет лучше, и мы не поймём, где эффект от промо, а где — клиентская активность. Чтобы решить эту проблему, я использовал два метода:

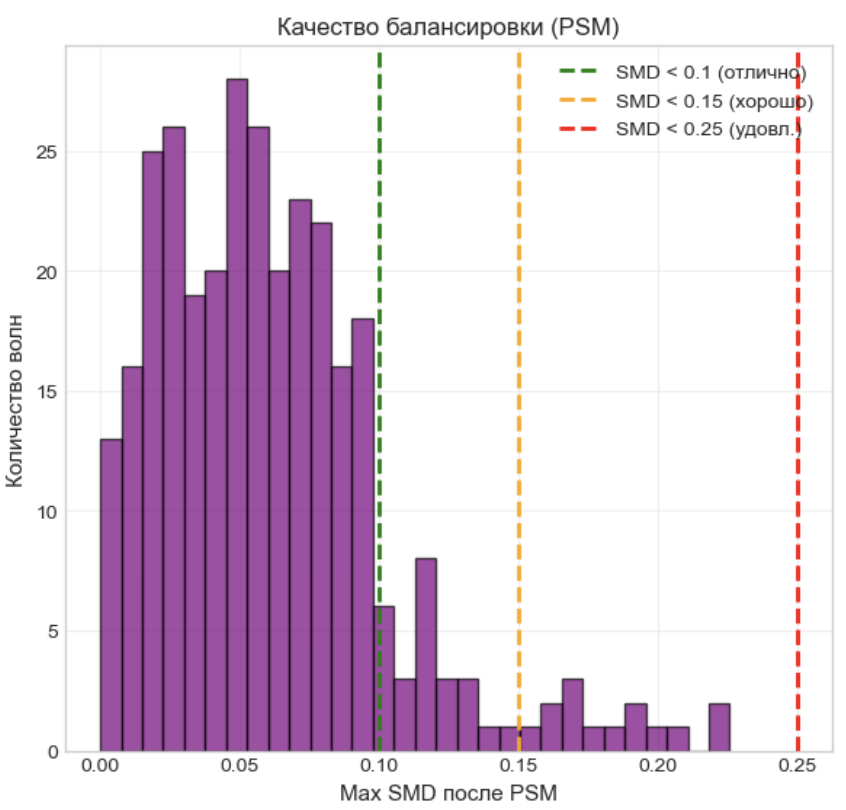

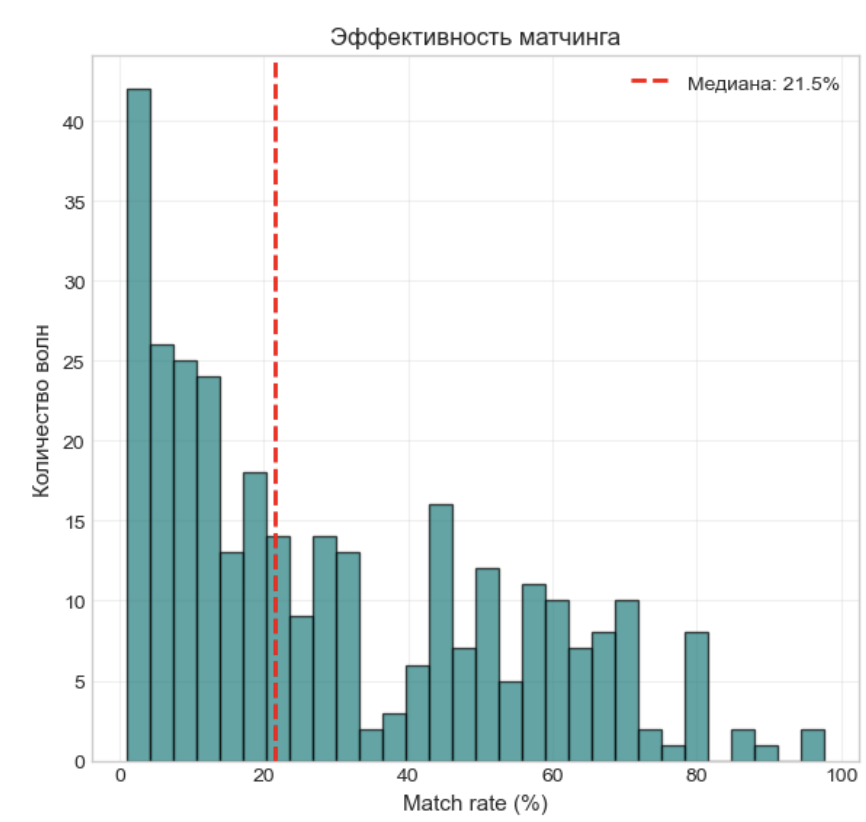

1. Propensity Score Matching (PSM). Для каждого пользователя, который видел промоволну, я с помощью модели (сложной логистической регрессии) рассчитываю его вероятность применить промокод. Эта вероятность зависит от его истории покупок: средний чек, частота заказов в неделю/месяц, степень лояльности к компании (наличие подписок, карты лояльности).

Затем для каждого клиента, который применил промокод, система находит его «статистического близнеца» — клиента с очень похожей вероятностью, который промокод не применил, но тоже его видел.

В итоге мы получаем две группы, которые статистически почти идентичны по своему поведению и user-level данным.

2. Difference in Difference (DiD). Когда мы получили две равные и сбалансированные между собой группы, я применил метод, который получает разницу, то есть рассчитывает инкремент между этими двумя группами. В этом случае я считал разницу в прибыли. Это и есть тот самый инкрементальный эффект — чистый выигрыш от промоакции.

Мы перешли от состояния «мы не знаем, работает ли акция» к конкретным цифрам. Теперь мы можем сказать: «Эта промоволна принесла нам в среднем +200 ₽ дополнительного дохода с каждого применившего промокод клиента». Это полностью меняет подход к анализу маркетинговых кампаний.

Оценивать прошлое — полезно, но бизнес хочет знать будущее. Поэтому я предложил разработать предсказательную модель. Все посчитанные эффекты от сотен промоволн использую как обучающую выборку для новой модели на основе CatBoost. Фичами становятся параметры промомеханики: размер скидки, минимальная сумма заказа, сезонность, длительность акции. Целевой переменной — тот самый инкрементальный эффект, который мы научились считать.

Когда мы закончим эту работу, у маркетологов появится своего рода «калькулятор». Прежде чем запускать новую акцию, они смогут ввести в модель её параметры и получить прогноз: «Если запустить механику с промокодом на 200 ₽ для минимального заказа на 1 500 ₽, летом она принесёт 50 ₽ с клиента, а зимой — 90 ₽». Это позволит тестировать гипотезы, не сжигая бюджета, и выбирать только эффективные механики.

Этот проект потребовал нового стека компетенций: методы PSM и DiD пришлось освоить с нуля. А главное — я смог не просто решить задачу оценки кампаний, но и предложить и реализовать следующий, предсказательный уровень. На создание первой версии модели ушёл всего месяц ударной работы.

Мой путь, как мне кажется, наглядно показывает, как растёт ценность специалиста:

-

На старте нужно было разбираться в простейших, но при этом фундаментальных моделях машинного обучения, и иметь базовые навыки работы с Python.

-

На среднем уровне потребовались глубокие навыки data engineering и софт-скиллы, чтобы связывать запросы бизнеса с технологиями. Здесь я уже учился в Нетологии на курсе по машинному обучению. Хотел систематизировать то, что успел освоить сам и во время работы в первых двух компаниях. Обучение помогло: то, что раньше казалось разными вещами, сложилось в общую картину. Работать стало проще — мозг на автомате начал видеть связи. А ещё я понял, что гораздо эффективнее изучать меньше, но глубоко и с применением на практике.

-

В X5 понадобилось умение работать с неопределённостью, самостоятельно осваивать сложные методы из смежных областей (Causal Inference) и мыслить не просто как исполнитель, а как архитектор системы.

Итого 20% моего опыта — это высшее образование, книги и лекции, а 80% — всё, что я узнал на реальных проектах. Главное — оставаться исследователем, тянуться к знаниям и не искать оправданий.

История третья: из теоретической физики в data science

Светлана Медведева

Cпециалист по data science и машинному обучению

Мой путь начался не совсем типично — с теоретической и вычислительной физики. Именно университет дал мне тот самый математический аппарат — тервер, статистику, линал, — который потом стал прочным фундаментом. Без него было бы сложнее.

Первый опыт в ИТ — работа в крупном ИТ-вендоре. Пришла туда, по сути, на технические задачи: занималась потоковой обработкой данных, немного ETL-процессами. Прямого отношения к машинному обучению это не имело, но постепенно стали появляться более близкие к ML задачи. Например, прогнозирование урожайности. На одном из проектов я занималась разработкой системы потоковой обработки сообщений. Отвечала и за технические задачи интеграции систем, и за тестирование моделей текстовой аналитики, которые разрабатывали коллеги.

Потом была стажировка в Huawei, в группе компьютерного зрения. В основном улучшала качество предсказаний моделей.

Следующим важным этапом стал российский консалтинг. Вот там я по-настоящему познакомилась с выводом моделей в продакшен, начала плотно писать на Python, работать с разными типами баз данных. Проекты были очень разные: от задач в ритейле и маркетинге до анонимизации данных и доработки оптимизационных платформ.

И уже после этого моя работа стала в основном касаться именно разработки ML-моделей от и до: от проверки гипотез и анализа данных до построения и внедрения. Много занималась прогнозированием, особенно временными рядами в ритейле и транспорте.

Так что путь получился довольно последовательным: от технических задач по обработке данных и настройке интеграционных процессов до разработки моделей для R&D (Research and Development, исследования и разработки) и применения машинного обучения для решения задач бизнеса. Каждый этап был по-своему важен и добавлял в копилку что-то своё.

Где получить первый опыт

Чтобы получить работу, нужен опыт. Чтобы получить опыт, нужна работа. Это классическая уловка, знакомая каждому, кто пытался войти в ИТ. Хорошая новость в том, что этот круг разрывается. Вот несколько способов:

-

Сделать pet-проекты. Классический «Титаник» — отправная точка для знакомства с Pandas и scikit-learn. Но чтобы выделиться, нужно показать нечто большее. Например, вместо готового датасета спарсить сайт с объявлениями и очистить от мусора. Затем построить простую, но рабочую модель, и в идеале — завернуть её в API с помощью Flask или FastAPI. Такой проект показывает, что вы мыслите как инженер: не просто обучили модель, а довели её до состояния, когда ей можно пользоваться.

Ваш GitHub — это ваше лицо. Когда тимлид открывает ваш репозиторий, он смотрит на культуру разработки: понятный README.md, осмысленные коммиты, чистоту кода, разделение на модули. Никто не ждёт проектов с реальными заказчиками на старте, но умение писать понятный и структурированный код — это уже огромный плюс.

-

Потренироваться в Kaggle — спортзале для ML-инженера. Условия там стерильные: данные уже собраны и почищены, метрика задана, задача ясна. Поэтому используйте Kaggle как песочницу, чтобы отточить знание алгоритмов, подсмотреть изящные решения в чужих ноутбуках, почувствовать азарт соревнования.

-

Пройти стажировку или участвовать в хакатоне. Там компании ищут таланты, в которые готовы вкладываться, чтобы потом взять к себе в штат. Вы погрузитесь в реальные задачи с настоящими данными, а самое ценное — пообщаетесь со старшими коллегами. Хакатоны — это спринт-версия стажировки. За 48 часов вы в команде проходите путь от идеи до прототипа. Это стресс, но это и концентрированный опыт, который выгодно смотрится в резюме.

Что вас ждёт на собеседовании: от теории до бизнес-кейсов

Собеседование на позицию в ML или DS обычно состоит из нескольких этапов, которые проверяют как глубину ваших технических знаний, так и широту мышления. Весь процесс можно условно разделить на два больших блока: проверка технического фундамента и умение решать бизнес-задачи.

Технический фундамент или харды

Здесь проверяют базу. Будьте готовы к вопросам из разных областей:

-

Теория ML. Чем отличается L1 от L2 регуляризации? Что такое компромисс между смещением и дисперсией (bias-variance trade-off)? Как работает градиентный бустинг?

-

Статистика и теория вероятностей. Могут дать классическую задачу на условную вероятность или математическое ожидание.

-

Live-кодинг. Вас могут попросить написать несложный алгоритм на Python или решить задачу на SQL. Здесь смотрят не столько на идеальный синтаксис, сколько на ход ваших мыслей. Важно комментировать свои действия и рассуждать вслух.

-

Инфраструктура. Нужно понимать, как данные попадают в модель и что с ними происходит до этого. Будьте готовы ответить, какие базы данных вы знаете, как устроены ETL-процессы и для чего они нужны.

Системный дизайн и бизнес-кейсы

Это самый важный блок на позициях middle и выше. Здесь проверяют ваше умение переводить расплывчатую бизнес-проблему в конкретную ML-задачу. Здесь важно показать, что вы мыслите как архитектор системы, а не просто как исполнитель, который ждёт готовое ТЗ.

Вопрос может звучать так: «Представьте, что вы работаете у нас. Как бы вы построили систему рекомендаций для нашего приложения?»

Правильного ответа здесь нет. Интервьюера интересует ход мыслей:

-

С каких вопросов вы начнете? Вы должны показать, что сначала стремитесь понять задачу. Например, спросить: Какая цель у рекомендаций — повысить вовлечённость или продажи? Какие у нас есть данные? Как будем измерять успех?

-

Какое первое, самое простое решение вы предложите? Это показывает ваше умение двигаться итерационно. Например, «для начала будем просто показывать самые популярные товары».

-

Как будете его усложнять? Здесь вы демонстрируете знание подходов. Например, коллаборативная фильтрация, контентные модели, гибридные подходы, нейросети.

-

Как будете оценивать качество? Важно разделить оценку на офлайн (метрики вроде precision и recall на исторических данных) и онлайн (A/B-тест на реальных пользователях).

В крупных компаниях процесс отбора обычно многоэтапный. По итогам всех секций оценивается ваш примерный грейд: джун, мидл или сеньор.

Для стажёрских позиций требования к практическому опыту ниже, но прочный технический фундамент обязателен. Никто не ждёт от вас опыта на реальных проектах, но опыт построения моделей на уровне pet-проектов или учебных курсов уже должен быть. Ваш GitHub — лучшее тому подтверждение.

Советы для тех, кто твёрдо решил заняться предиктивной аналитикой

-

Найдите свою доменную область и станьте в ней экспертом. Самый эффективный способ войти в профессию — применить новые навыки к тому, что вы уже хорошо знаете. Это позволяет не тратить время на изучение предметной области с нуля, а сразу сфокусироваться на работе с данными и моделями. Филологу будет проще работать с языковыми моделями, экономисту — с временными рядами, а биологу — с медицинскими данными.

-

Если не получается выбрать область, работайте в паре с экспертом. Ни один специалист по данным не может быть экспертом во всех областях. Работая с медицинскими, финансовыми или любыми другими специфическими данными, невозможно обойтись без консультанта из этой сферы. Модель может найти корреляцию, но только эксперт поможет понять, где причина, а где — случайность или ошибка в данных. Ваша задача — научиться говорить с экспертами на одном языке и правильно интерпретировать их знания.

-

Не изобретайте велосипед. Изучите, как похожие задачи решали до вас. Например, в сообществе ODS.ai можно найти проекты по data science и машинному обучению и ознакомиться с их репозиториями на GitHub.

-

Помните про обобщающую способность. Цель любой модели — не идеально работать на тех данных, на которых она училась, а хорошо справляться с новыми, которых она никогда не видела. Слишком точная подгонка под обучающую выборку (переобучение) так же плоха, как и неспособность найти закономерности (недообучение). Поиск золотой середины между переобучением и недообучением — одно из ключевых умений ML-инженера.

Чтобы расти, нужно выйти из привычной зоны и сделать шаг к переменам. Можно изучить новое, начав с бесплатных занятий:

-

курса-симулятора «Системный аналитик: первые шаги к профессии»;

-

дня открытых дверей магистратуры НИУ ВШЭ «Инженерия данных»;

-

курса-симулятора «Excel: простые шаги для оптимизации работы с данными»;

-

занятия «Секретный рецепт DevSecOps, или почему его используют 90% компаний»;

-

демокурса программы «Аналитика данных с МФТИ».

Или можно стать востребованным сотрудником и открыть открыть бóльшие перспективы в карьере с профессиональным обучением:

-

на программе для действующих ИТ‑специалистов «Инженер машинного обучения»;

-

на курсе «Системный и бизнес-аналитик» с изучением ИИ и программой трудоустройства;

-

на совместной с МТУСИ программе «ИИ-разработчик: от API до агентов»;

-

на расширенном курсе «Аналитик данных» с изучением ИИ и программой трудоустройства;

-

на курсе «Специалист по искусственному интеллекту» с обновлённой программой 2026 года.

Автор: Alrighty