Три года назад запустить 7-миллиардную модель локально означало профессиональный GPU. Потом появилась квантизация – сжатие весов с 32-битной точности до 4-битной. Модель стала в 3-4 раза легче при минимальной потере качества. 7B параметров теперь занимают 4-5 ГБ вместо 14.

Параллельно с этим появилась Ollama – инструмент, который убирает всё лишнее между пользователем и моделью. Устанавливается одной командой, сама находит GPU если она есть (NVIDIA, AMD, Apple Metal), при отсутствии – работает на CPU. Модели качаются как докер-образы, запускаются одной строкой. Да, и никакой ручной настройки окружений.

Установка Ollama и моделей

# Linux

curl -fsSL https://ollama.com/install.sh | sh

# Windows / macOS - установщик на ollama.com/downloadПосле установки – запускаем нужную модель (пример для представленных ниже тестов). При первом запуске она скачается автоматически:

ollama run smollm2:1.7b # Тир 1 - 1.8 ГБ

ollama run phi4-mini # Тир 2 - 2.5 ГБ

ollama run qwen3:8b # Тир 3 - 5.2 ГБЕсли хочется скачать заранее без запуска:

ollama pull phi4-mini

ollama list # посмотреть что установленоТри тира под три уровня железа

Мы отобрали модели по двум условным критериям – хоть какая-то работоспособность и польза при ограниченном железе. Никаких экзотических форков – только то, что стабильно работает через Ollama. И то, что вы сможете затестить прямо сейчас.

Тир 1 – 2-4 ГБ RAM, GPU не нужна

Офисный ПК или очень древний ноут. Скорость – 15-20 токенов в секунду. Рассуждать на несколько шагов не умеют, но с однозначными задачами справляются.

|

Модель |

Диск |

Контекст |

RU |

Что умеет |

|

smollm2:1.7b |

1.8 ГБ |

8K |

– |

Перефразировать текст, классифицировать, ответить на прямой вопрос |

|

qwen3:1.7b |

1.4 ГБ |

40K |

+ |

Суммаризация на RU, простые рассуждения, большой контекст |

|

qwen3:0.6b |

523 МБ |

40K |

+ |

Короткий ответ, быстрая классификация, совсем слабое железо |

|

tinyllama |

638 МБ |

2K |

– |

Автодополнение, короткий чат, edge-устройства |

|

qwen2.5-coder:1.5b |

986 МБ |

32K |

~ |

Написать функцию, исправить синтаксис, объяснить код |

|

moondream |

1.7 ГБ |

2K |

– |

Описать изображение, найти объект на фото, ответить по картинке |

|

dolphin-phi |

1.6 ГБ |

2K |

~ |

Ответить без отказов на чувствительные темы, ролевые игры, тест безопасности |

|

reader-lm:1.5b |

~1 ГБ |

32K |

+ |

HTML страница → Markdown, очистка разметки, парсинг |

Тир 2 – 6-8 ГБ RAM

Средний ноутбук. Скорость – 8-12 токенов/с. Стараются держать чуть более длинный контекст, решают многошаговые задачи, часть умеет думать вслух.

|

Модель |

Диск |

Контекст |

RU |

Что умеет |

|

phi4-mini |

2.5 ГБ |

128K |

+ |

Решить задачу пошагово, написать и объяснить код, работать с длинным документом |

|

phi3.5 |

2.2 ГБ |

128K |

+ |

Написать письмо / резюме, ответить по документу, SQL из описания |

|

llama3.2 |

2.0 ГБ |

128K |

~ |

Следовать многошаговым инструкциям, переписать текст, tool use |

|

gemma3:4b-it-qat |

1.5 ГБ |

128K |

+ |

Описать изображение на RU, ответить по скриншоту, суммаризация |

|

qwen3:4b |

2.5 ГБ |

256K |

+ |

Анализ длинного документа, рассуждение с /think, перевод и редактура |

|

deepseek-r1:1.5b |

~1 ГБ |

128K |

+ |

Логические задачи с цепочкой рассуждений, математика, проверка ошибок |

|

orca-mini:3b |

~2 ГБ |

4K |

– |

Вопрос-ответ, суммаризация, простое объяснение понятий |

Тир 3 – 8-16 ГБ RAM

Скорость – 4-8 токенов/с на CPU. Ощутимо умнее – структурируют, держат нить, замечают противоречия.

|

Модель |

Диск |

Контекст |

RU |

Что умеет |

|

qwen3:8b |

5.2 ГБ |

40K |

+ |

Написать статью / план / обзор, сложный код, дебаг с объяснением |

|

qwen2.5-coder:7b |

4.7 ГБ |

32K |

+ |

Целый модуль с нуля, рефакторинг, юнит-тесты, код-ревью |

|

mistral-small (22B) |

13 ГБ |

32K |

+ |

Анализ, юридический текст, мультиступенчатые инструкции |

|

gemma3:12b-it-qat |

~7 ГБ |

128K |

+ |

Анализ изображений, длинный документ + вопросы по нему |

RU: + хорошая поддержка, ~ базовая, – только EN

И небольшой краш-тест. В качестве эксперимента

Скажем так, таблицы с характеристиками читаются хорошо, но не показывают главного – как модель ведёт себя на практике. Мы взяли три задачи разного уровня сложности и прогнали каждую через все три тира. Технически – условия для всех одинаковые. Ollama v0.20.4, Windows, чистый CPU без видеокарты. Задач – максимально простые. Объяснить техническое понятие, решить арифметику по шагам, написать базовую Python-функцию.

Задачи были выбраны нами не случайно. Объяснение понятия – это проверка связности речи и русского языка. Математика – следование алгоритму, способность не потерять шаги. Код – структурированный вывод с соблюдением синтаксиса и примерами.

Итак, начем.

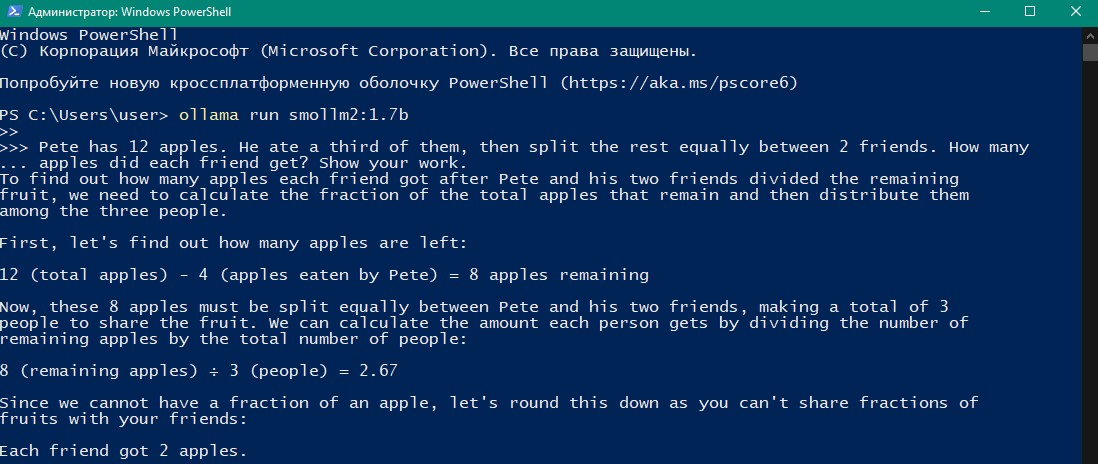

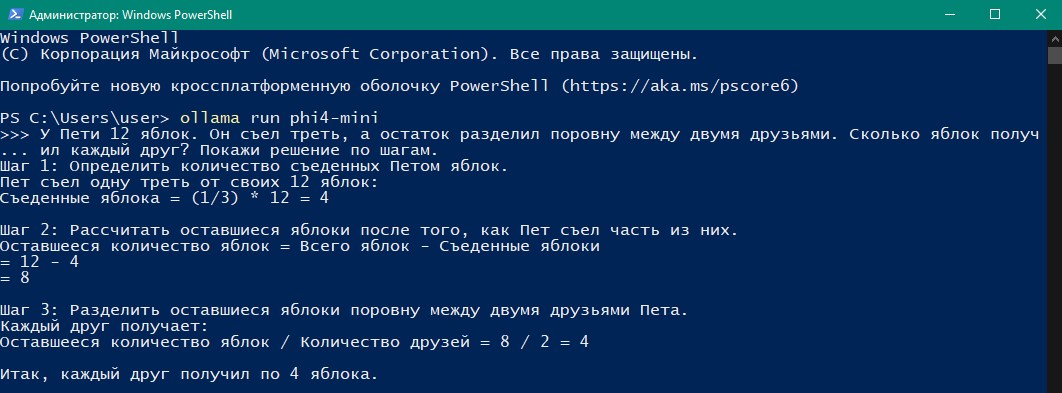

Задача 1 – математика: яблоки, треть, два друга

smollm2 (English only):

Pete has 12 apples. He ate a third of them, then split the rest equally between 2 friends. How many apples did each friend get? Show your work.

phi4-mini:

У Пети 12 яблок. Он съел треть, а остаток разделил поровну между двумя друзьями. Сколько яблок получил каждый друг? Покажи решение по шагам.

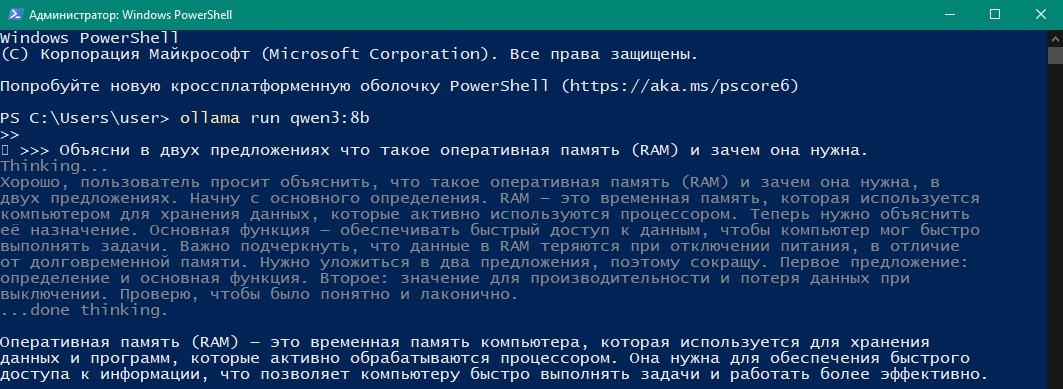

Задача 2 – объяснить что такое RAM в двух предложениях

qwen3:8b (с режимом размышлений):

Объясни в двух предложениях что такое оперативная память (RAM) и зачем она нужна.

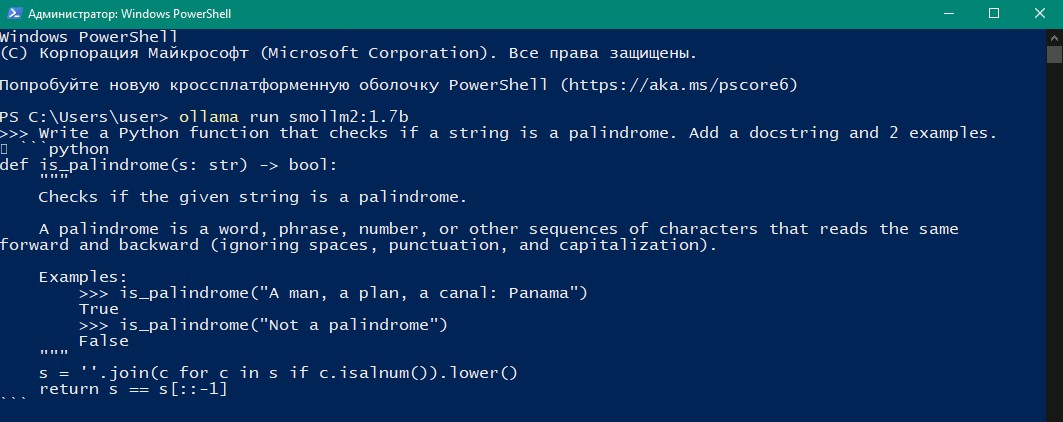

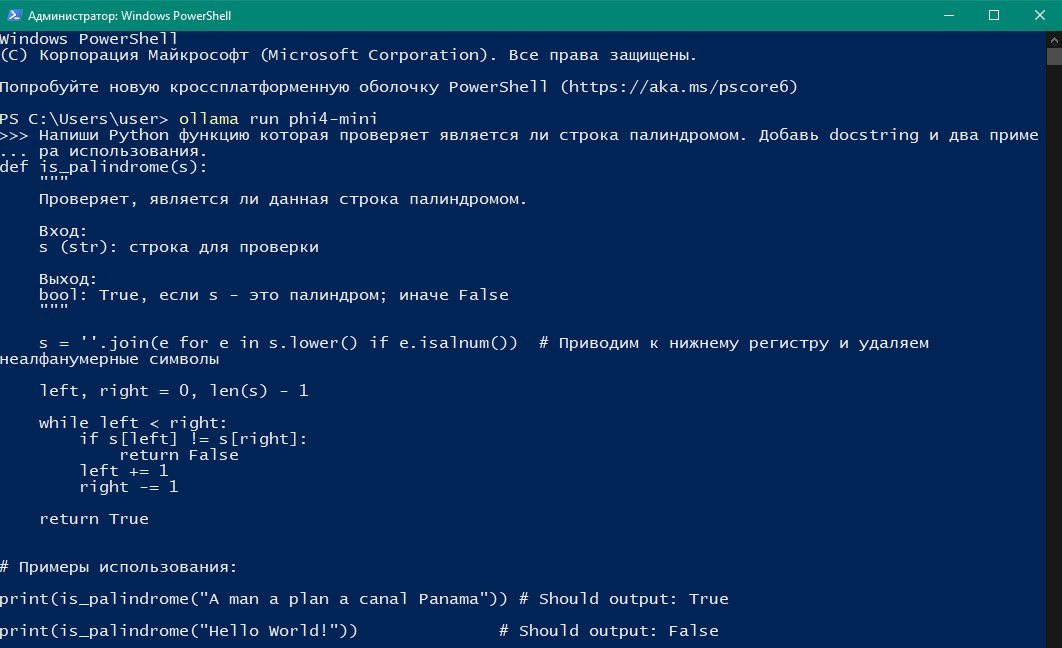

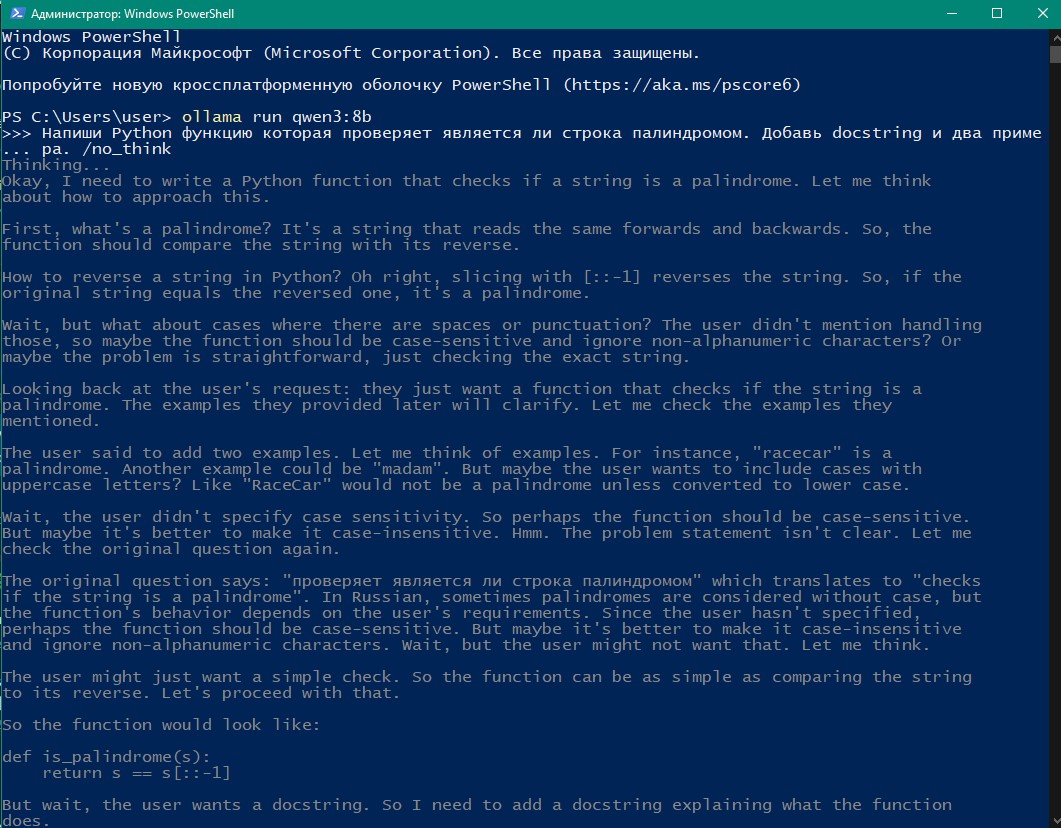

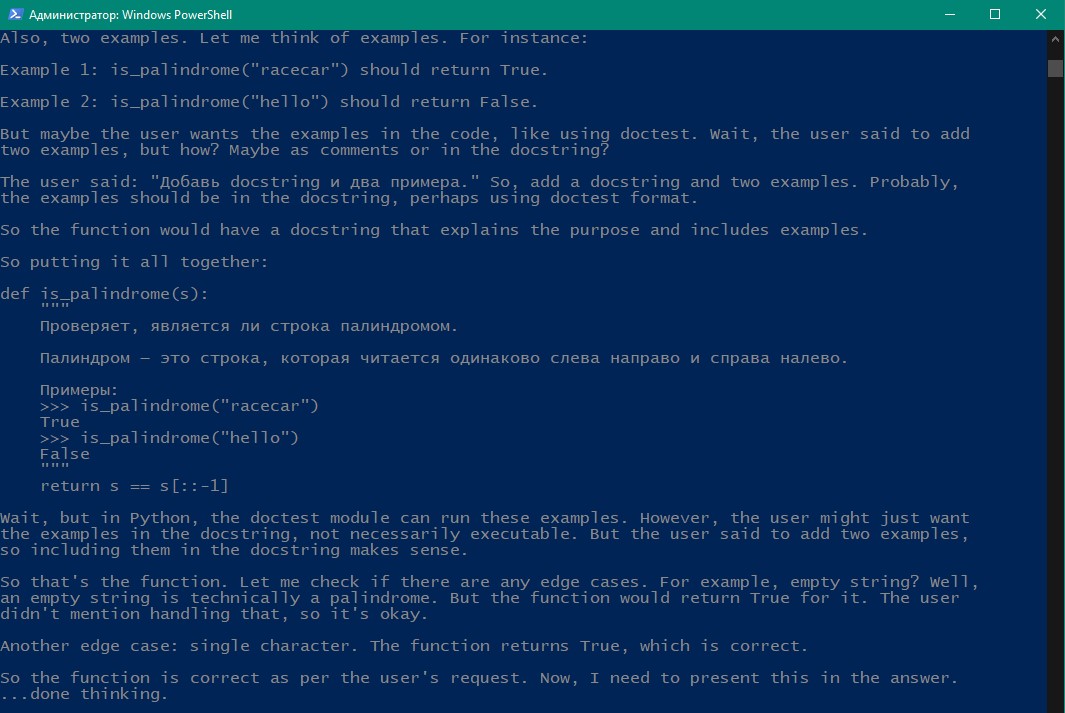

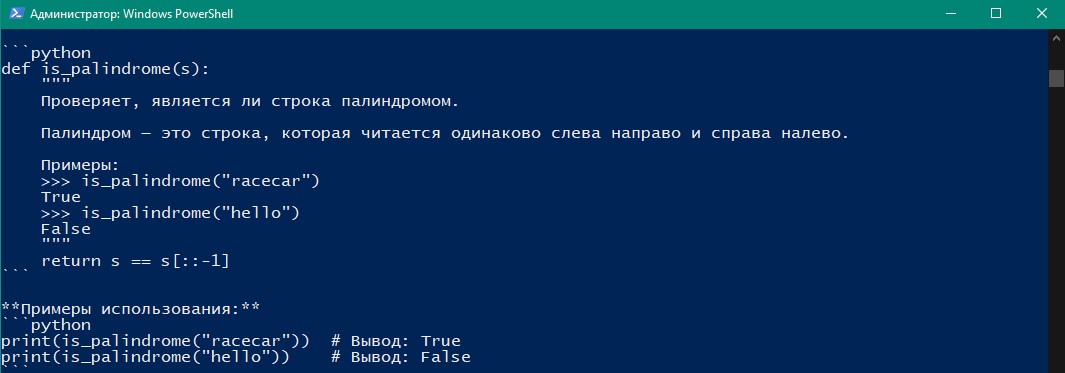

Задача 3 – Python-функция проверки палиндрома

smollm2 (English only):

Write a Python function that checks if a string is a palindrome. Add a docstring and 2 examples.

phi4-mini, qwen3:8b:

Напиши Python функцию которая проверяет является ли строка палиндромом. Добавь docstring и два примера использования.

Да, конечно, для формирования полноценного понимания – неплохо было бы провести гораздо больше тестов. Но давайте будем реалистами. 4-5 токенов в секунду – это реальная скорость qwen3:8b на CPU. Средний ответ – минута-две ожидания. smollm2 быстрее, но даже на тривиальной математике ошиблась. Собственно, это не облако – здесь ждать придётся. И ждать, скорее всего, чего-то специфического и узконаправленного.

Но под нишевое использование и в качестве материала для ознакомительных тестов – эти модели определенно найдут своего пользователя.

Автор: Neyroskuf