Если ваше устройство думает, что 1 ГБ — это ругательное слово, то этот доклад в двух частях для вас.

Меня зовут Александр Лошкарев, я инженер-программист в компании Eltex. Этот материал основан на моем докладе для AiConf и посвящен федеративному обучению (FL). Мы разберем, как внедрять ML-модели на краевых устройствах, которые жестко ограничены в ресурсах и имеют меньше 256 МБ оперативной памяти.

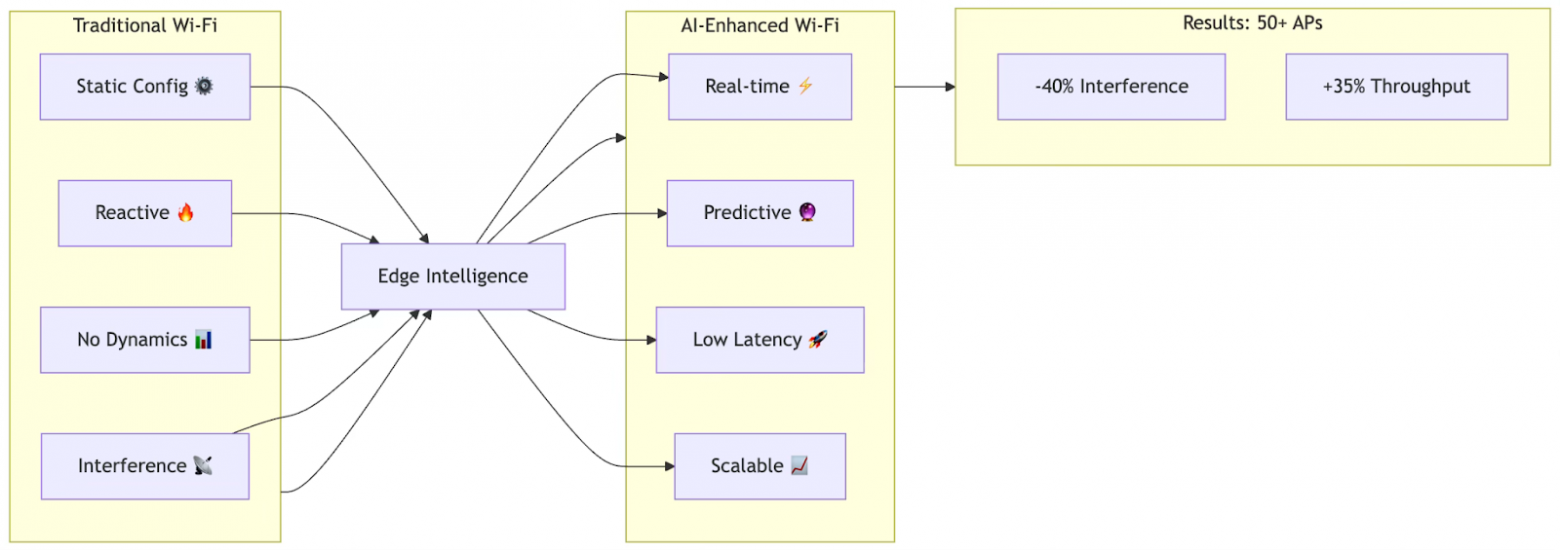

В компании Eltex мы проектируем сетевое оборудование с нуля. Обычно беспроводные устройства работают в статическом режиме: их один раз конфигурируют, и дальше они годами не меняют параметры, если только администратор не вмешается вручную. Но в современных сетях Wi-Fi такой подход неэффективен из-за постоянной интерференции и изменения радиообстановки.

Обычно решение о реконфигурировании принимается централизованно на контроллерах беспроводных сетей. Мы решили провести эксперимент и попробовать внедрить механизмы самообучения прямо в точки доступа.

Предметная область: зачем устройствам интеллект

Краевые устройства собирают телеметрию напрямую от клиентов (смартфонов, планшетов). Перенос вычислений на эти узлы создает технические сложности: требуется квантование моделей, динамическая загрузка слоев, работа с нестандартно распределенными данными (non-IID) и сжатие градиентов для передачи. На практике это нужно, чтобы уйти от статической конфигурации. Сейчас, если рядом появляется источник сильных помех, качество связи деградирует и остается низким вплоть до ручной перенастройки сети администратором. Локальная аналитика позволит узлу перестраивать параметры на лету.

В корпоративной сети от 50 точек доступа мы ставим цель снизить влияние интерференции на 40% и увеличить общую пропускную способность примерно на треть:

Контекст Wi-Fi оптимизации

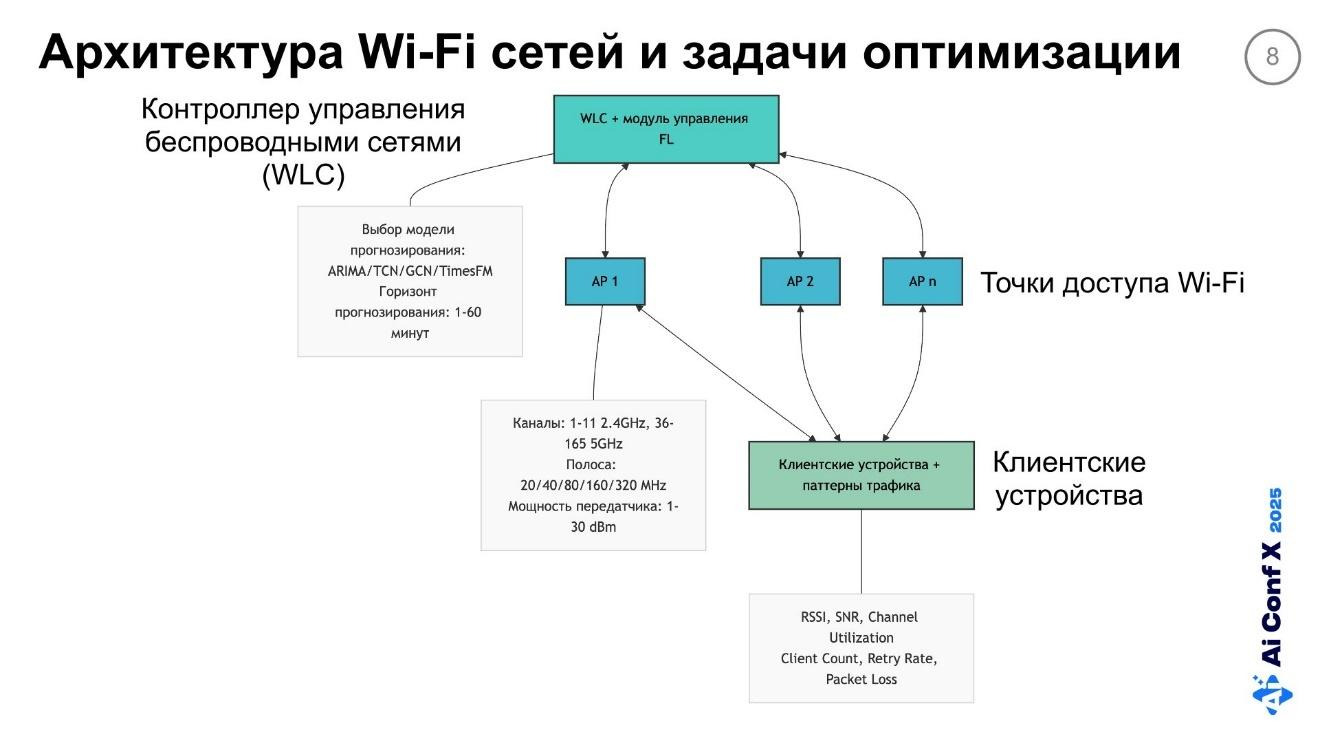

Архитектурно система состоит из контроллера и самих точек доступа. Управлять радиоэфиром мы можем через три параметра: ширину полосы, канал и мощность передатчика. Сама точка постоянно собирает статистику подключенных клиентов: уровень сигнала, зашумленность, процент потерянных пакетов и количество попыток переподключения.

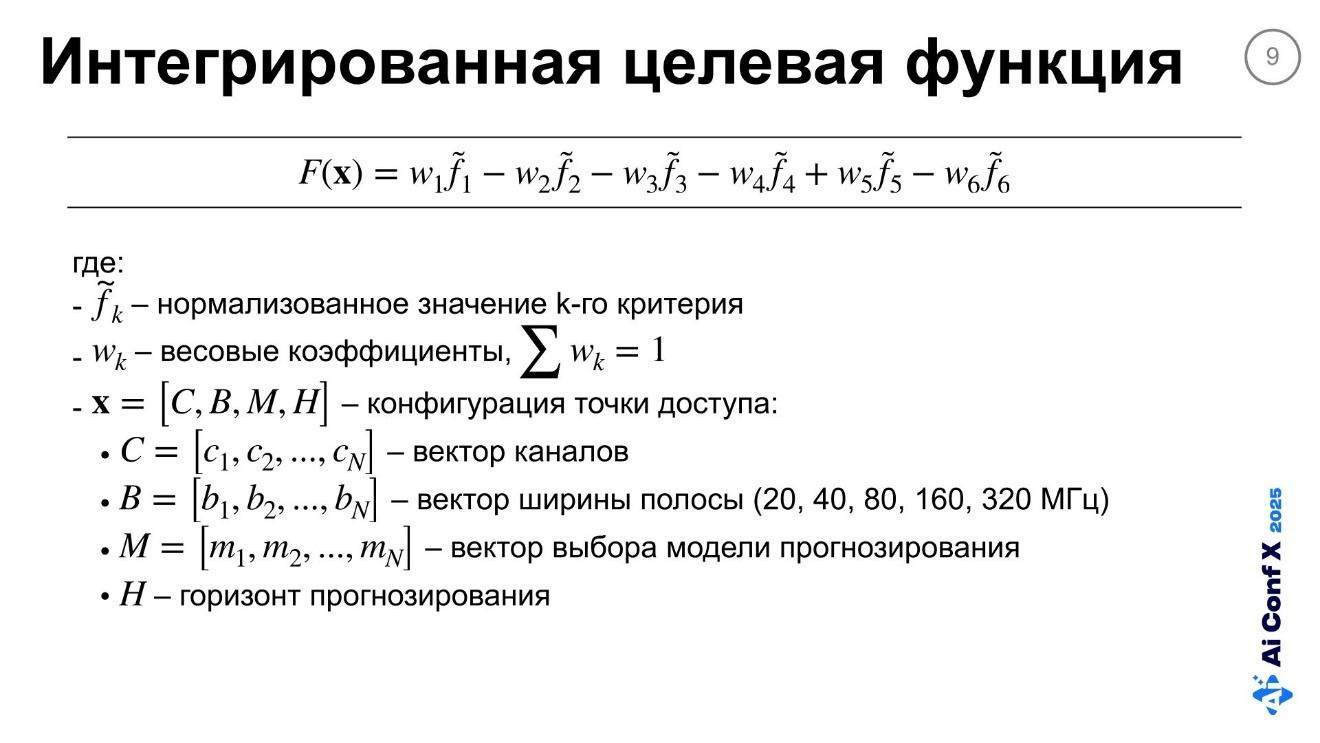

Перед тем, как перейдем к следующей составляющей, предлагаю следующую задачку. Попробуем выразить возможные улучшения на устройстве через целевую функцию.

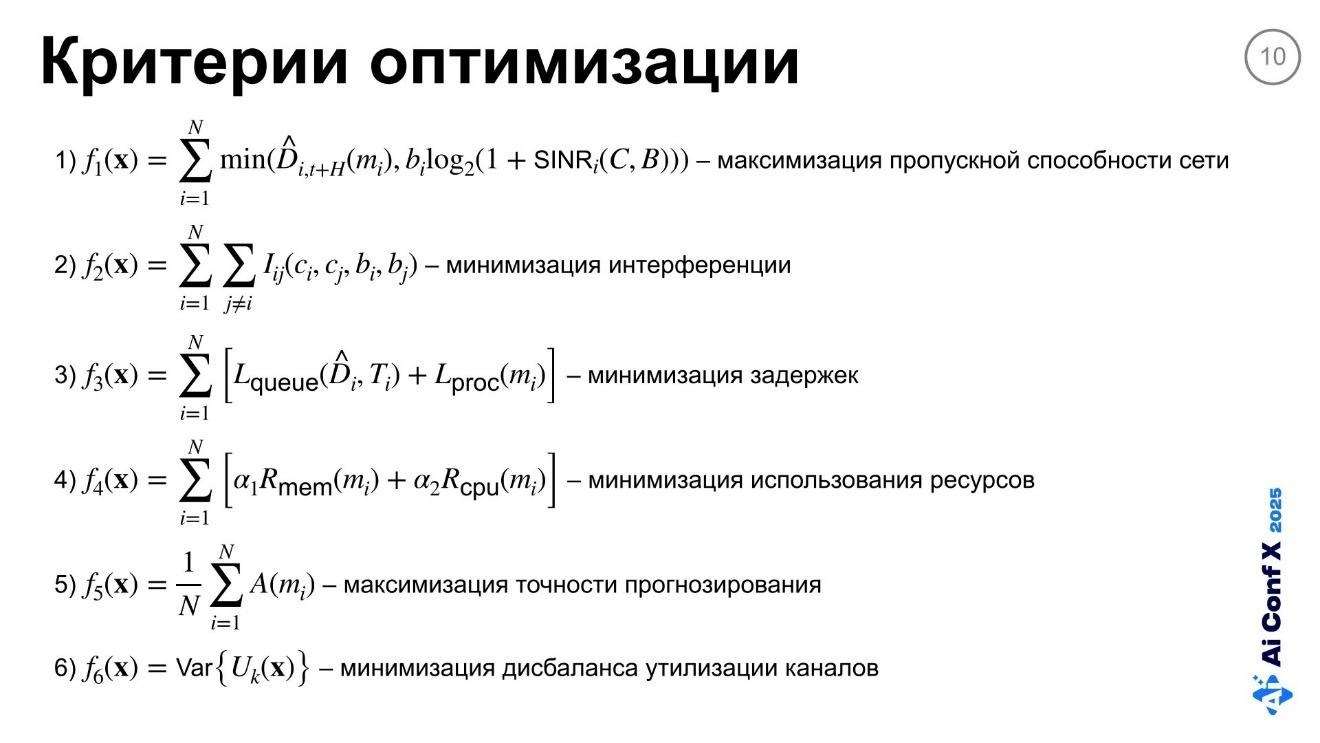

Поиск идеальных настроек — это задача многокритериальной оптимизации. Мы используем алгоритмы машинного обучения с подкреплением, где целевая функция работает как функция награды. На вход подаются доступные каналы, значения ширины полосы, выбранная модель прогнозирования и горизонт планирования (от 1 минуты до суток). Алгоритм стремится максимизировать пропускную способность и точность прогнозов. Одновременно он должен минимизировать помехи от соседних точек, задержки передачи, расход оперативной памяти и нагрузку на процессор.

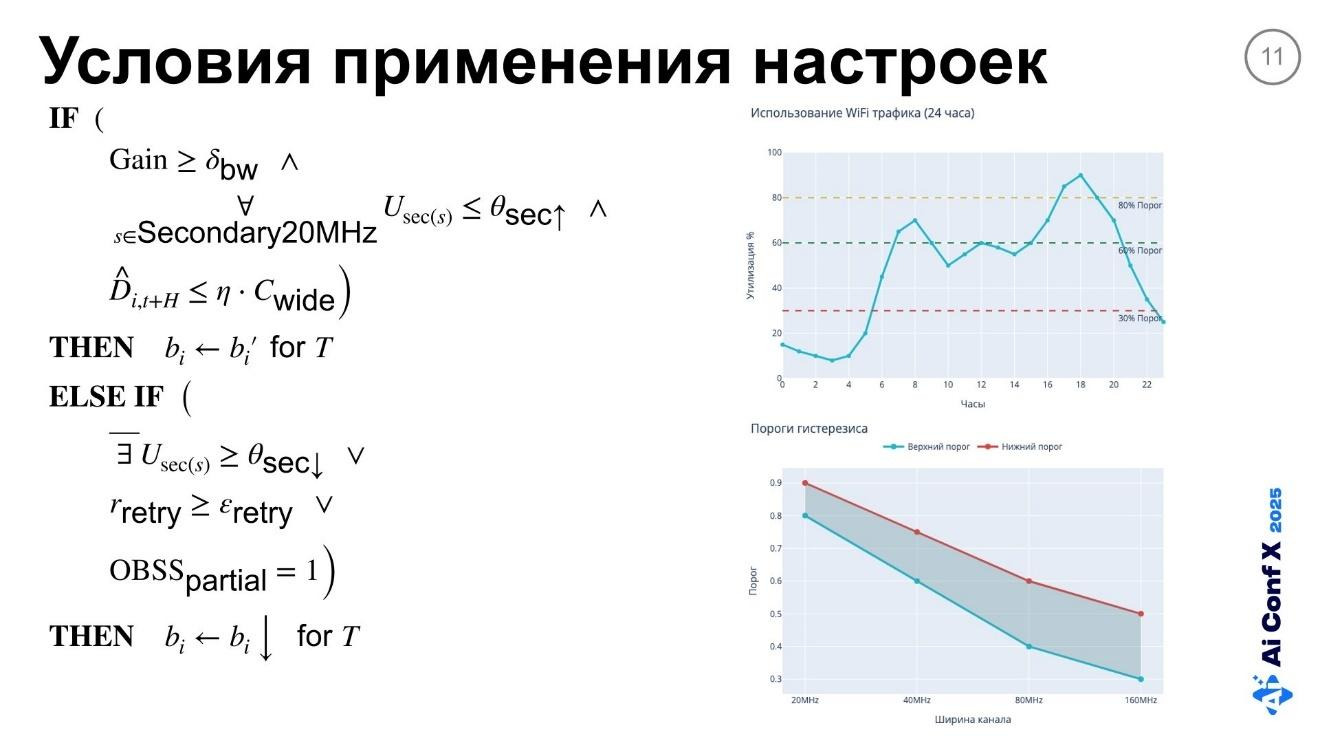

Чтобы сеть не была нестабильной, настройки меняются с учетом гистерезиса (защитного интервала в 10-15%). Логика простая: если утилизация эфира высока, полосу сужают; если есть свободные ресурсы — расширяют. Главное правило системы — ни один клиент не должен остаться без связи.

В статье рассматриваются два направления: оптимизация радиоэфира и оптимизация ML-моделей.

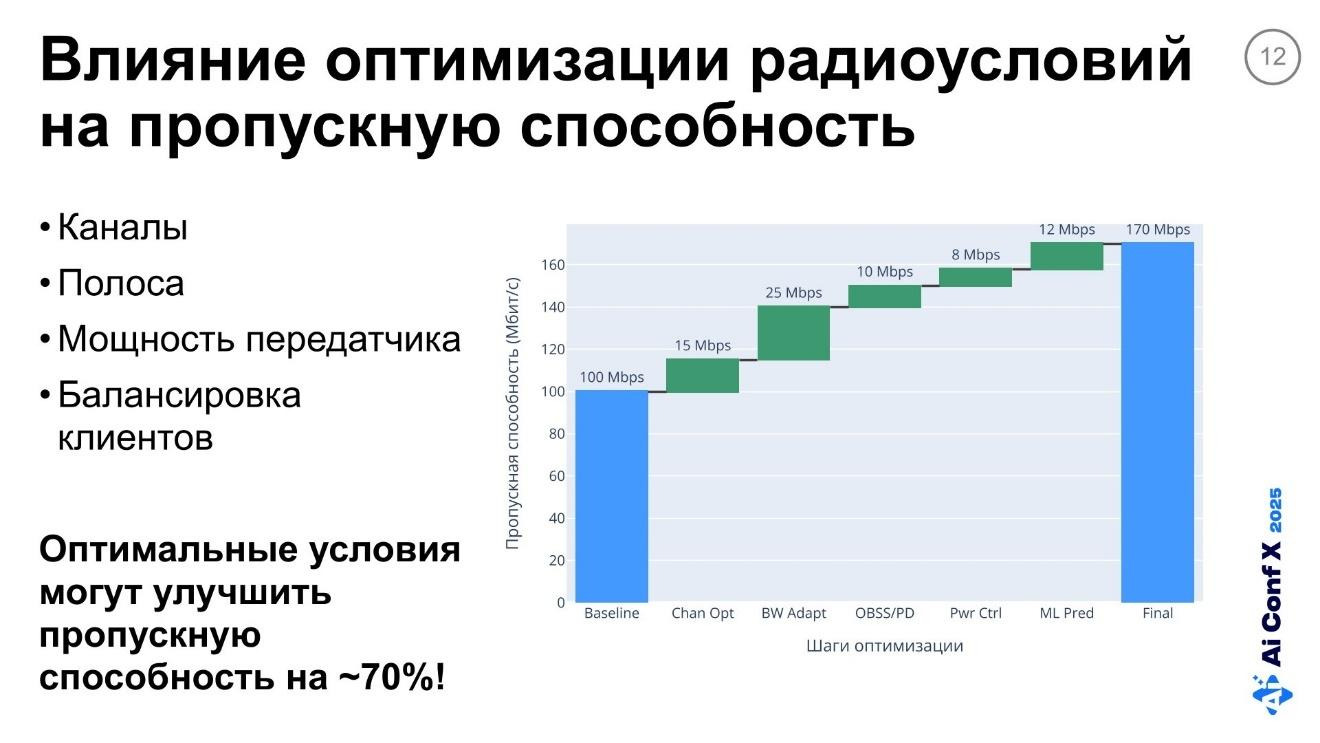

Управление каналами, шириной полосы и балансировка клиентов могут теоретически существенно улучшить работу сети. На практике полезная скорость ограничена накладными расходами протокола CSMA/CA. Главная польза от AI-оптимизации радиоресурсов (RRM) — стабильность среды. Алгоритмы снижают коканальную интерференцию (CCI) примерно на 40% и улучшают SNR в среднем на 7 дБ. У динамического изменения настроек есть и минусы. Смена канала требует отправки кадра CSA, из-за чего клиенты кратковременно теряют связь и получают скачки задержек.

Если взять за базу 100 Мбит/с, выбор канала дает прибавку в 15% к стабильности работы, настройка полосы — 25%, контроль утилизации — 10%, а корректировка покрытия — 8%.

Федеративное обучение: основы

Федеративное обучение (FL) хорошо решает задачи беспроводных сетей. Точки доступа получают модели, которые соответствуют их локальным ресурсам. Архитектуру сети менять не нужно, систему можно развернуть поверх существующей инфраструктуры. Если точка доступа отключается и не присылает данные, результаты вычисляются по остальным узлам того же класса. По сети передаются только весовые коэффициенты, сырой трафик остается на местах. Это экономит ресурсы каналов и использует аппаратные мощности точек доступа во время простоев без дополнительных вложений.

Архитектурные подходы FL

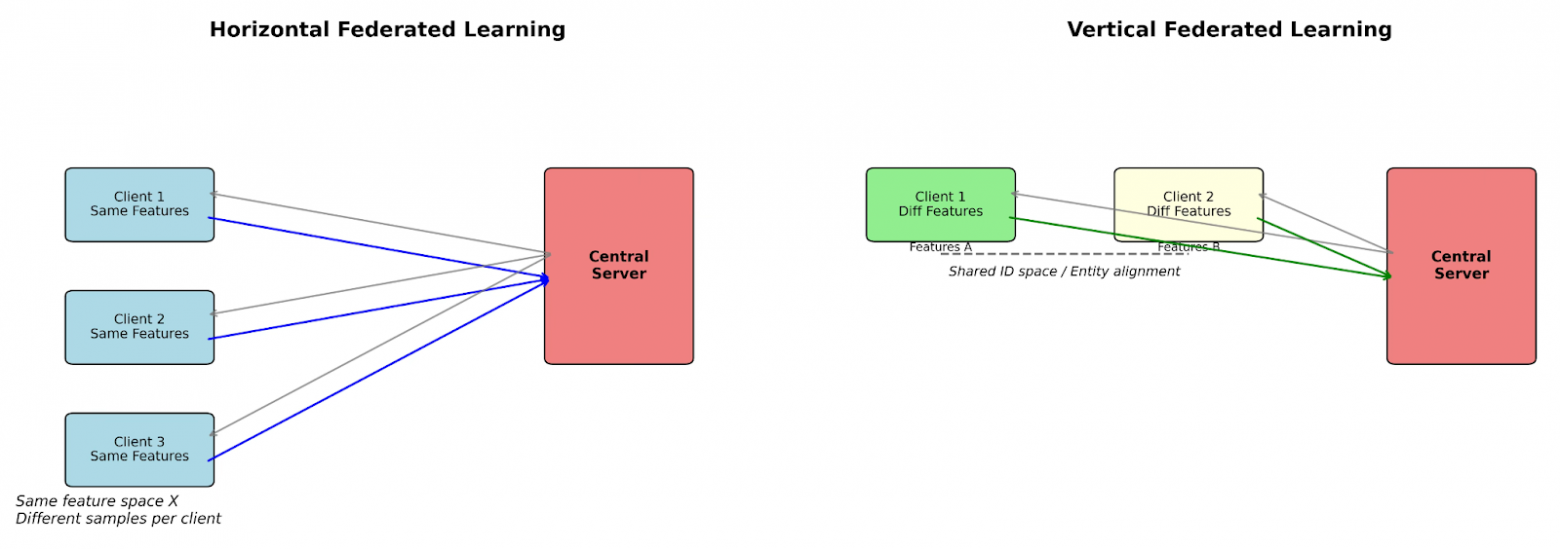

FL делится на горизонтальное и вертикальное. В первом случае узлы имеют однотипные признаки, во втором — разные, поэтому загружается только часть модели. Вертикальный подход напоминает Split Learning.

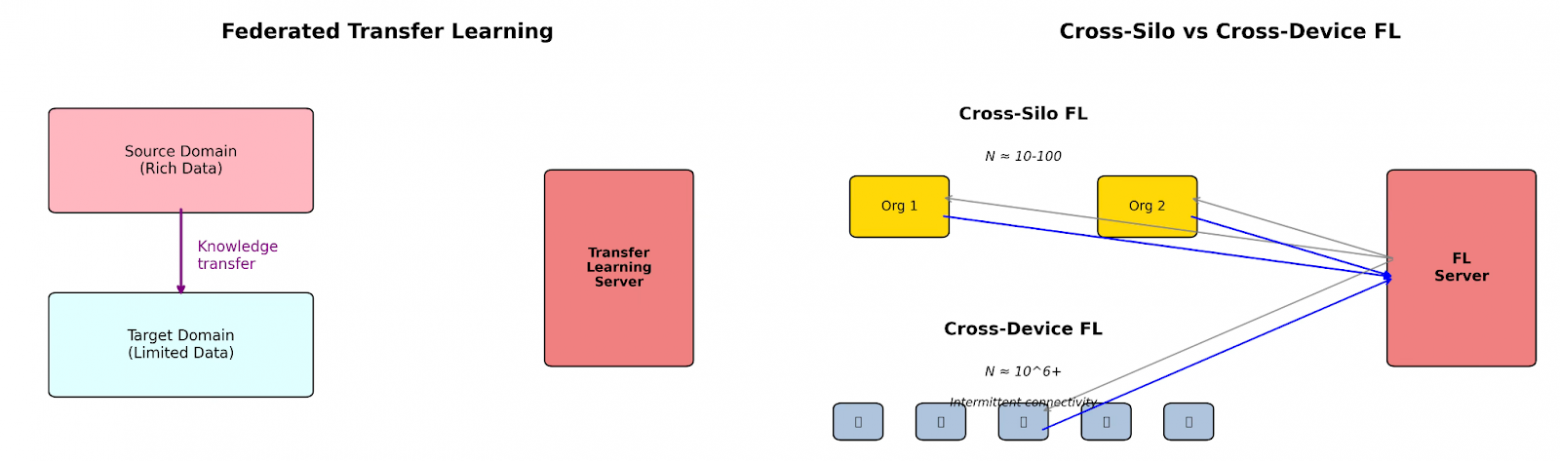

Также выделяют схемы Cross-Silo и Cross-Device. Cross-Silo часто применяют банки для обновления моделей безопасности без прямой передачи клиентских баз друг другу.

Вызовы FL в Wi-Fi сетях

В Wi-Fi сетях внедрение FL сталкивается с тремя проблемами. Первая — данные распределены неравномерно (Non-IID). Трафик в офисе отличается от производства, есть сезонность и влияние локальных событий. Вторая — зоопарк оборудования. В одной сети работают устройства с процессорами ARM и MIPS, а объем оперативной памяти составляет от 64 до 512 МБ. Третья — сетевые ограничения. Связь с контроллером может прерываться, требуя повторной авторизации узла. Пользовательский трафик имеет приоритет. Основная задача точки доступа по передаче данных должна выполняться на 100%, пересылка весов не может забирать эти ресурсы.

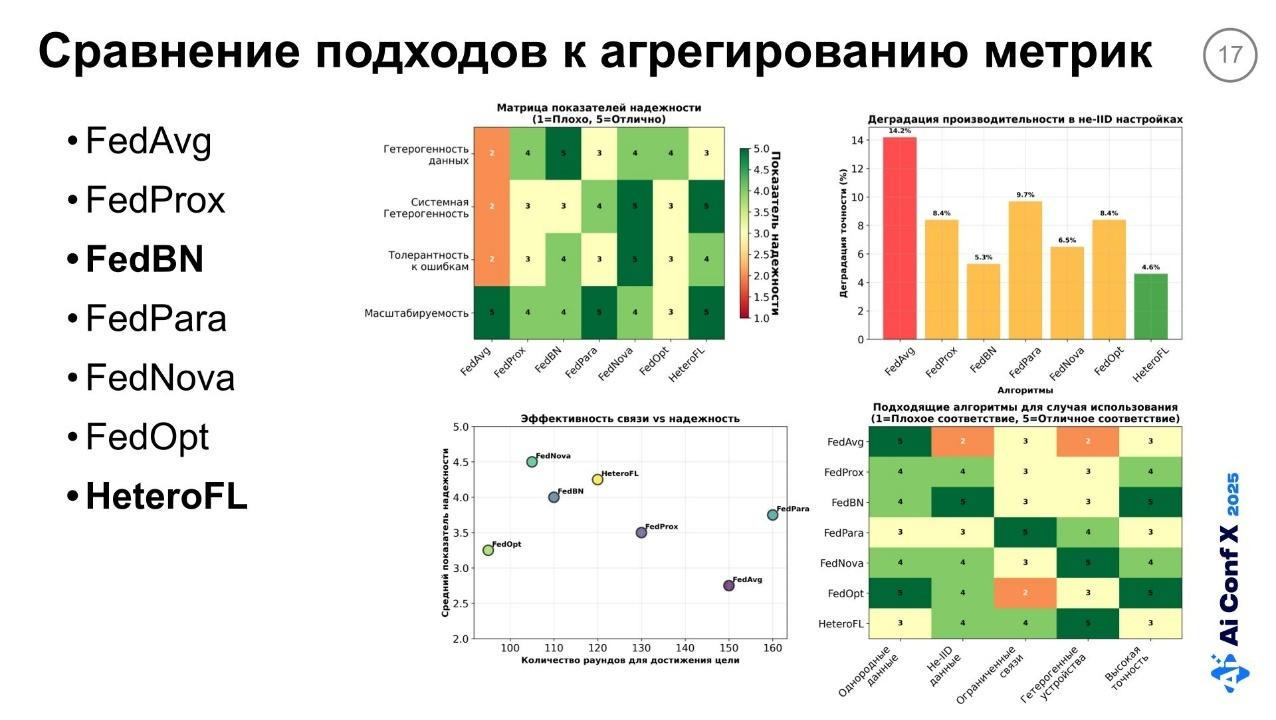

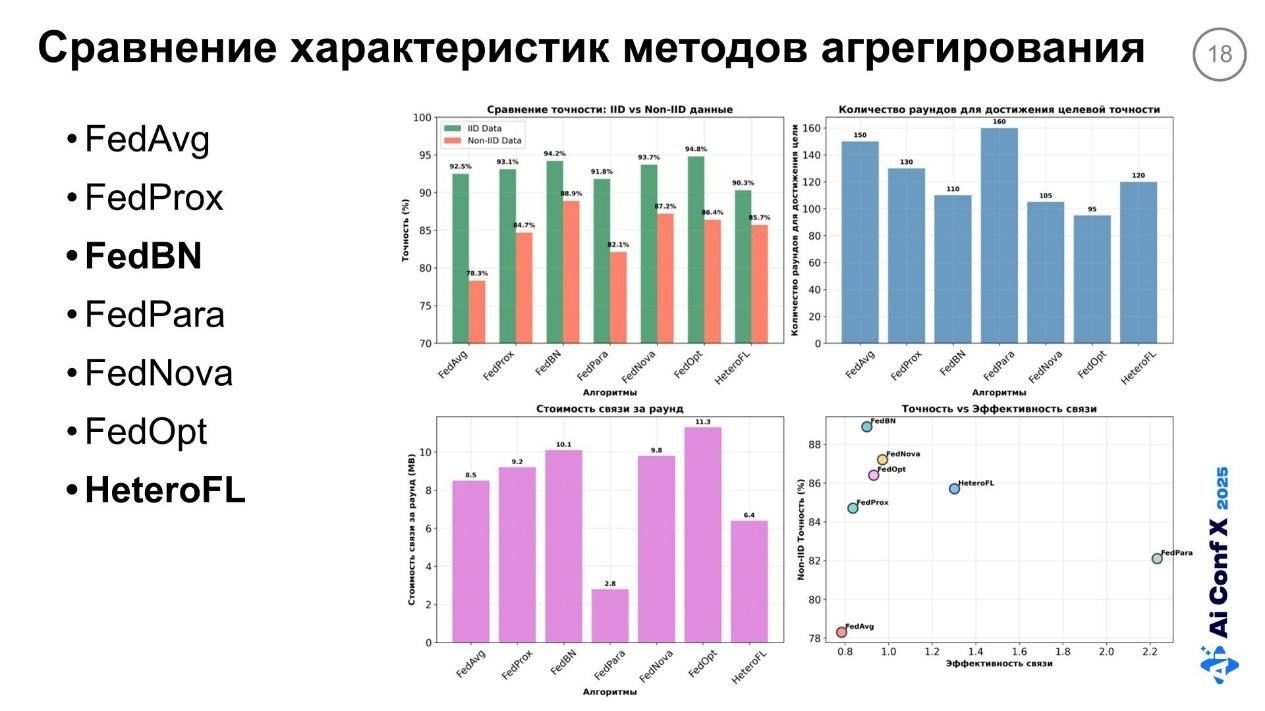

Федеративные алгоритмы

Алгоритмы FL собирают веса с агентов и вычисляют единые коэффициенты для рассылки обратно на устройства.

Для корпоративной среды оптимальным оказался метод с батч-нормализацией — FedBN. Каждая точка доступа работает в уникальной радиосреде с собственным фоновым шумом и интерференцией (проблема Feature Shift). FedBN оставляет параметры слоев нормализации на самом устройстве. Это предотвращает усреднение локального шума при глобальной агрегации. Для компенсации разницы в железе мы добавили HeteroFL. Этот алгоритм динамически сужает скрытые каналы и формирует локальные модели разной сложности. Слабые устройства обучают только небольшую подсеть, не блокируя работу остальных узлов с полными моделями.

На наших тестах эта связка показала точность 94% на однородных данных и 80% на неоднородных при небольшом числе раундов.

Технические решения

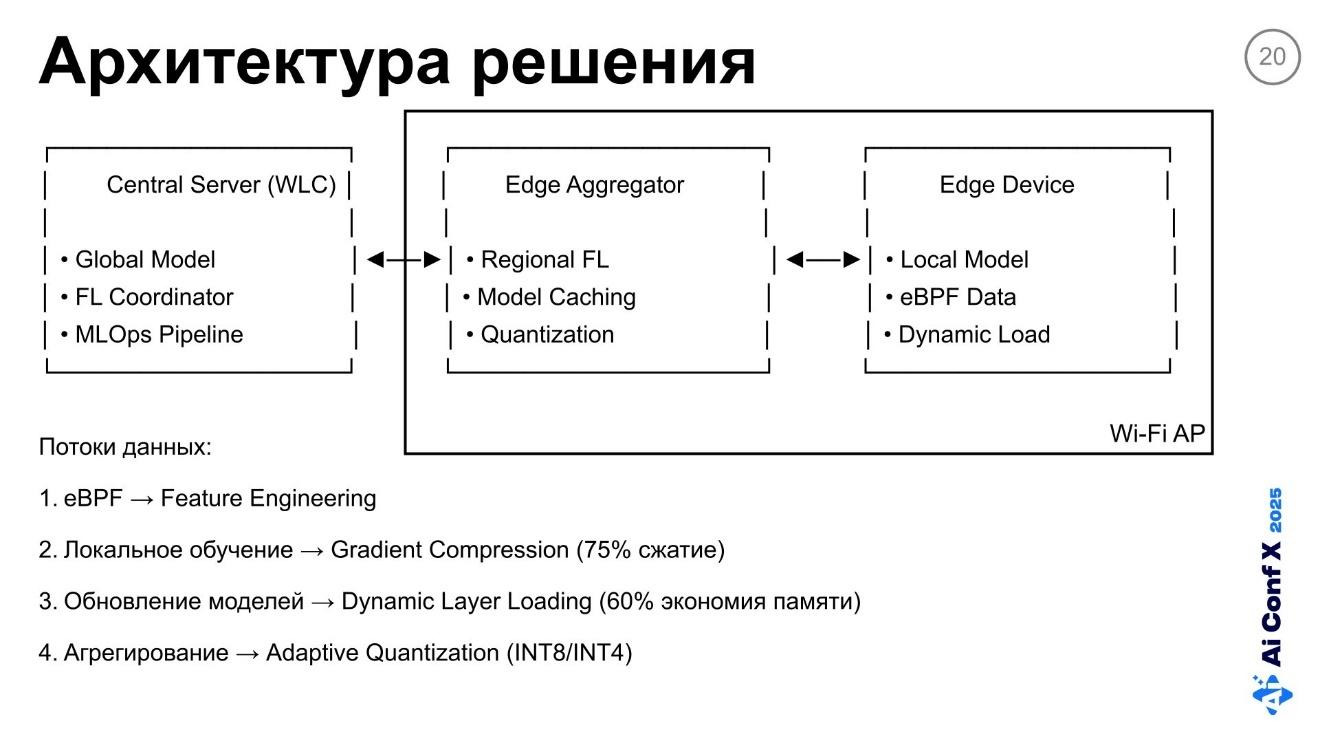

Архитектура решения состоит из двух основных элементов: контроллера и точек доступа.

Контроллер отвечает за агрегацию весовых коэффициентов и расчет средних значений. Точка доступа совмещает две функции. Во-первых, она работает как региональный агент федеративного обучения, выполняя кэширование моделей и квантование. Во-вторых, она отвечает за инференс: собирает данные и выдает локальные прогнозы.

Потоки данных разделены на четыре этапа:

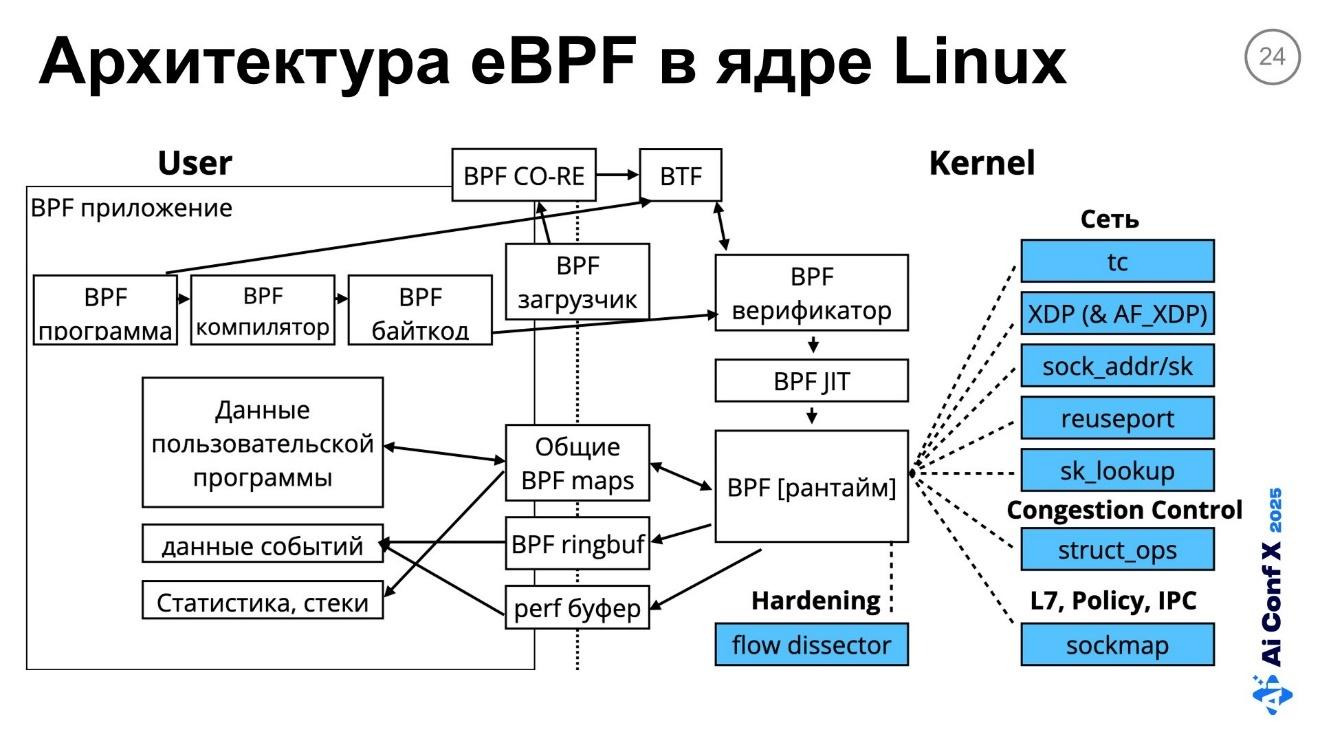

Первый — сбор данных и Feature Engineering через подсистему eBPF. В Linux эта технология представляет собой виртуальную машину внутри ядра, которая позволяет выполнять код с минимальными накладными расходами.

Второй этап — локальное обучение со сжатием градиентов до 75%.

Третий — обновление моделей. За счет динамической подгрузки слоев мы экономим около 60% оперативной памяти на каждом шаге.

Четвертый этап — агрегирование с адаптивным квантованием (INT8/INT4).

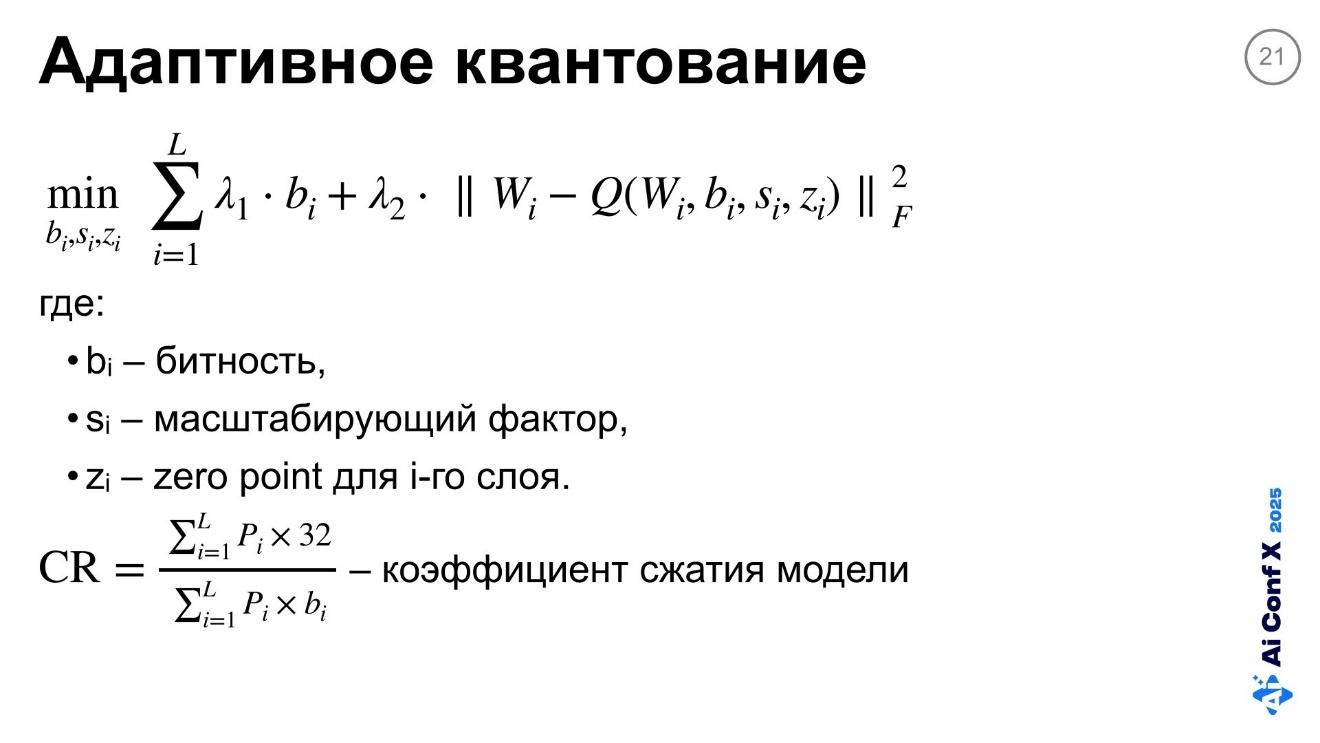

Адаптивное квантование

Само адаптивное квантование — это решение задачи минимизации эффекта.

Алгоритм выбирает 8- или 4-битное значение в зависимости от требуемого коэффициента сжатия, балансируя между точностью модели и потреблением памяти.

Динамическая подгрузка слоев

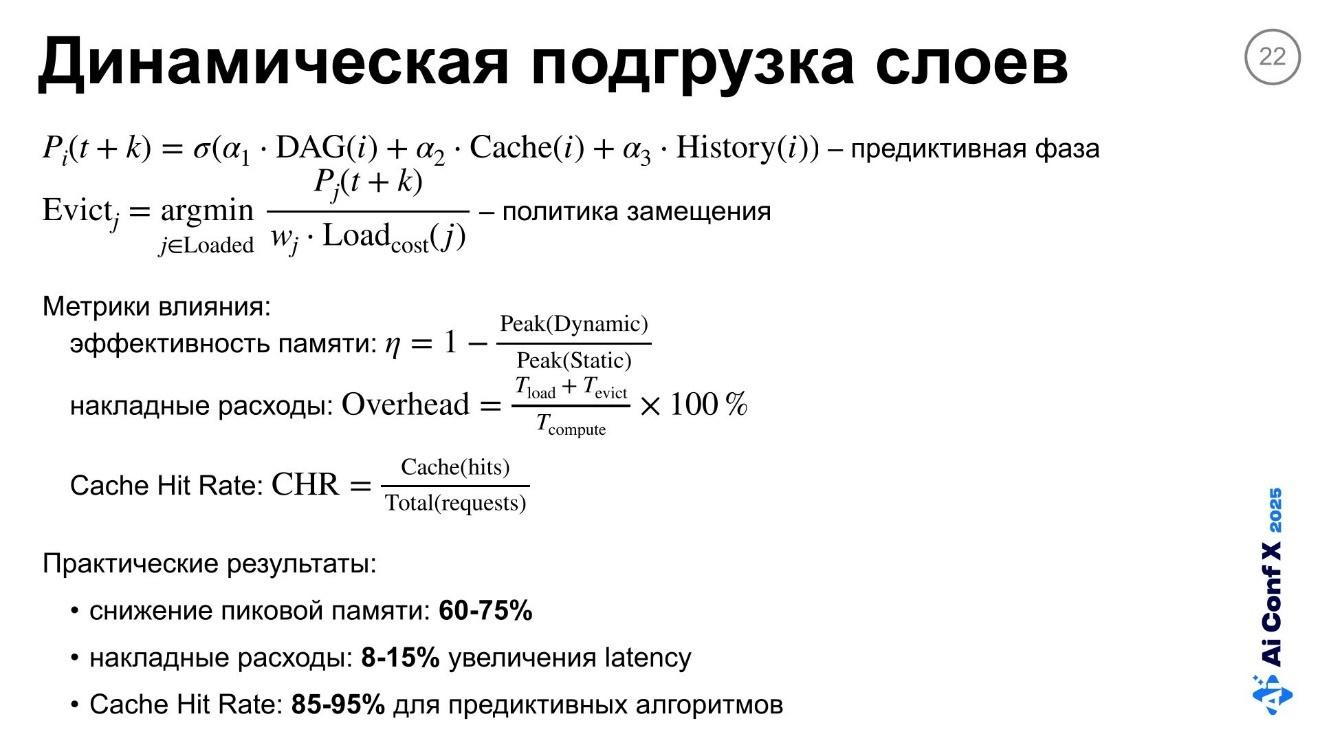

Механизм динамической подгрузки слоев состоит из предиктивной фазы и политики вытеснения (замещения).

Расчет вероятности обращения к кэшу и истории использования позволяет понять, какие слои нужно загрузить в память заранее. На практике это радикально снижает потребление пиковой памяти, но увеличивает задержки из-за необходимости предзагрузки данных. Этот недостаток компенсируется асинхронной загрузкой слоев. На целевой модели мы достигли Cache Hit Rate на уровне 85-95%.

Что такое eBPF

Если вы в первый раз сталкиваетесь с этим определением — это из системной части, из Linux. Это виртуальная машина, код в ядре, который выполняется без перезагрузки. Он дает программируемый инструмент анализа и управления практически всем, чем сейчас можно в системе заниматься на уровне ядра, и обеспечивает полную безопасность. Подсистема eBPF обеспечивает безопасное выполнение кода: ошибка в модуле не приведет к панике ядра (kernel panic) и перезагрузке устройства.

Мы используем eBPF для фильтрации, агрегации и валидации сетевых данных. Главная оптимизация здесь — прямой маппинг памяти между ядром и пространством пользователя (user space). Стандартные кольцевые буферы (perf buffers) требуют ресурсоемкого копирования данных.

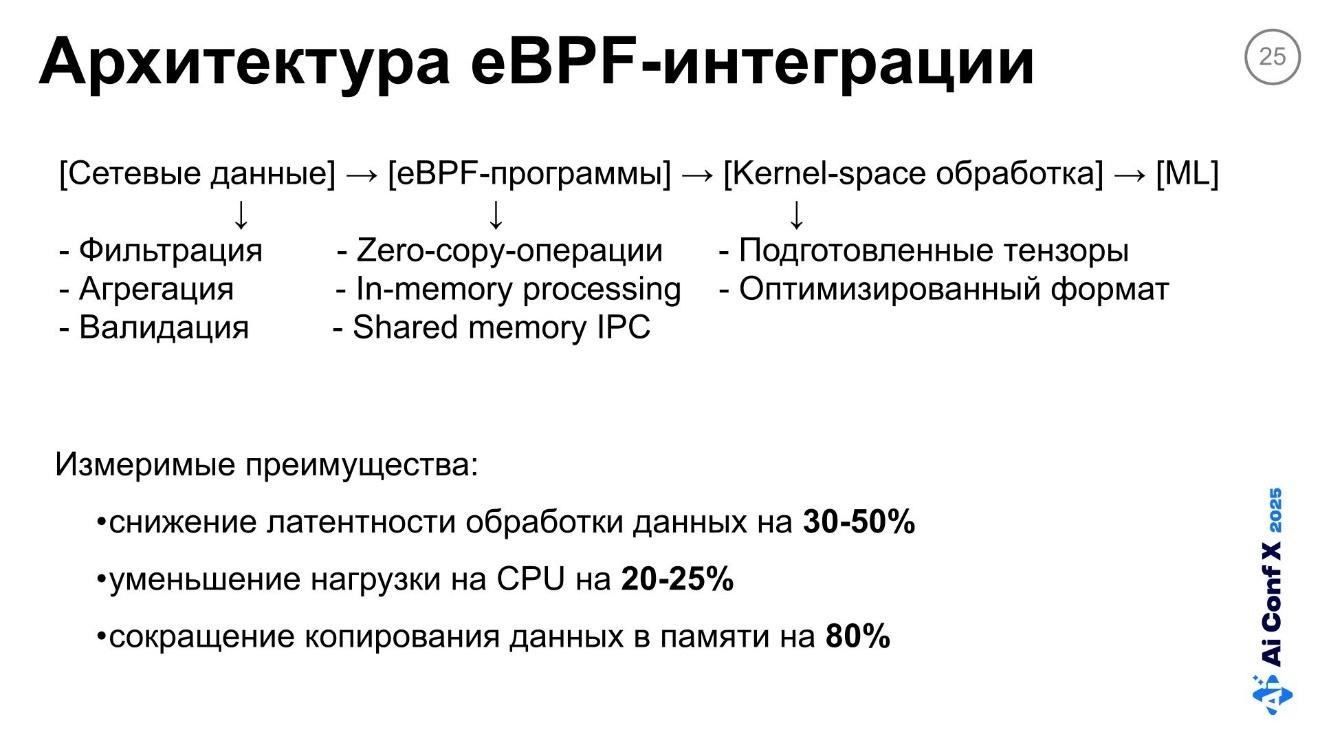

Архитектура eBPF интеграции выглядит следующим образом:

Чтобы организовать настоящий zero-copy обмен тензорами, мы применили механизм BPF Arena. Он выделяет разделяемую память с прямым доступом через вызов mmap(). Программа в фоновом режиме формирует готовый тензор прямо в ядре и передает его в ML-модель по C-указателю. Системные вызовы для копирования блоков исключаются полностью. В итоге латентность падает, а нагрузка на CPU при подготовке данных снижается на 35-50%.

Во второй части этого материала я расскажу об экспериментальной платформе, реализации и архитектуре, выборе моделей, результатах эксперимента и поделюсь практическими рекомендациями. Подпишитесь, чтобы не пропустить!

А пока что рекомендую ознакомиться с материалами прикладной технической конференции по Data Science AiConf 2026. В 2026 году мы собрали программу вокруг ключевых вызовов AI-команд. Под каждую тему были организованы не только доклады, но и интерактивные форматы, чтобы каждый получил на выходе конкретные идеи и список «что делать завтра».

Среди основных тем — аргументация технологических решений бизнесу, датасеты (от legacy-свалки до работающей модели), мультиагентные системы, как заставить LLM отвечать точно и по правилам, как правильно ставить задачи для ML и AI, будущее поиска и рекомендаций, RAG от архитектуры до production и экономика AI: как считать и сокращать стоимость железа. Присоединяйтесь!

Автор: aloshkarev