Компании, занимающиеся искусственным интеллектом, в спешном порядке объединяются с компаниями, занимающимися космическими запусками и спутниками, чтобы строить центры обработки данных в космосе. Скажу кратко: это не сработает

Для ясности: я бывший инженер и учёный НАСА с докторской степенью в области космической электроники. Я также проработал в Google 10 лет в различных подразделениях компании, включая YouTube и тот отдел облачных технологий, который отвечал за развёртывание ИИ-ресурсов, поэтому я вполне компетентен высказать своё мнение по этому вопросу.

Краткая версия статьи: это абсолютно ужасная идея, которая действительно не имеет никакого смысла. Для этого есть множество причин, но все они сводятся к тому, что электроника, необходимая для работы центра обработки данных, особенно развёртывающего ИИ-ресурсы на основе графических процессоров (GPU) и тензорных процессоров (TPU), является полной противоположностью тому, что работает в космосе. Если вы раньше не работали конкретно в этой области, я бы предостёрег вас от поспешных выводов, потому что реальность обеспечения функционирования космического оборудования в космосе не всегда интуитивно очевидна.

Энергия

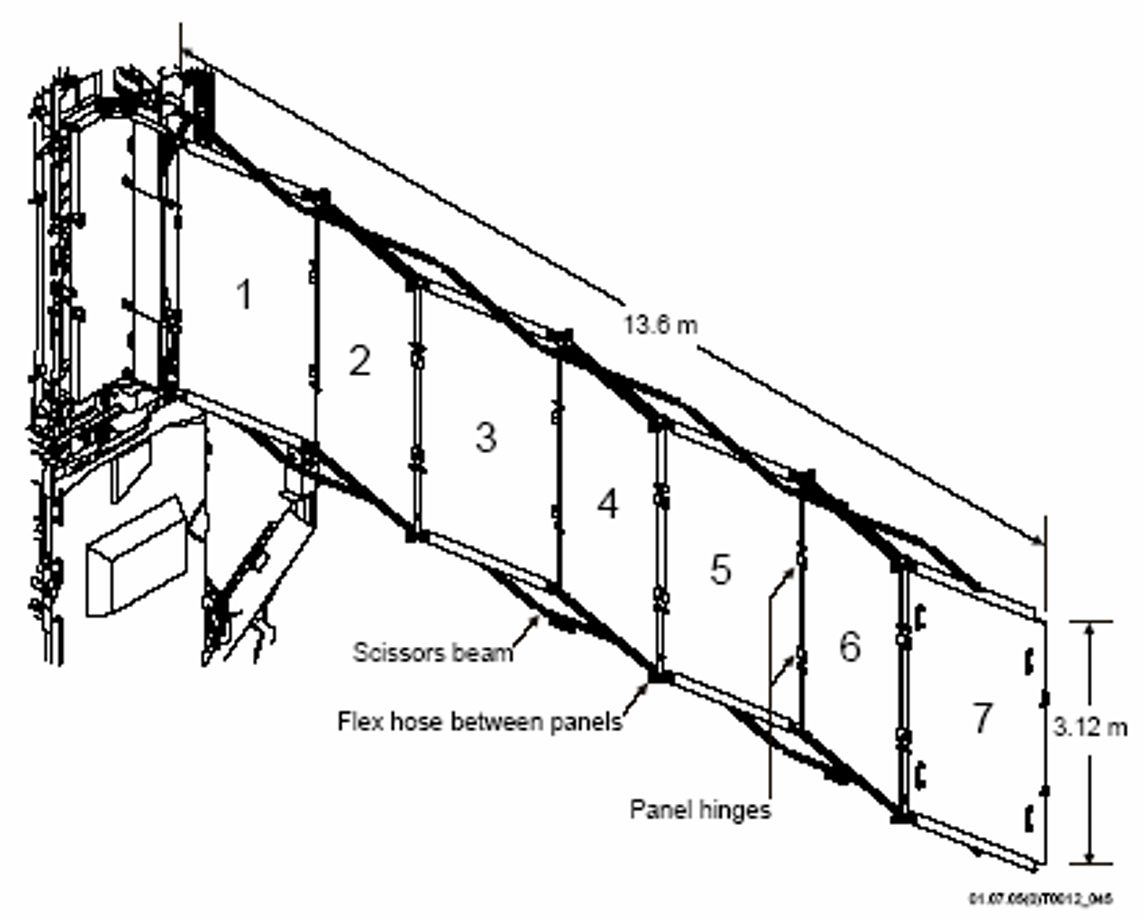

Первая причина, на которую обычно ссылаются при обсуждении строительства дата-центра в космосе, — это якобы обилие источников энергии. На самом деле это не так. У вас есть два основных варианта: солнечная и ядерная энергия. Солнечная энергия подразумевает развёртывание солнечной батареи с фотоэлементами — по сути, аналога того, что установлено на крыше моего дома здесь, в Ирландии, только в космосе. Это работает, но не является чем-то волшебным по сравнению с установкой солнечных панелей на земле — потери энергии в атмосфере не так велики, поэтому интуитивное представление о необходимой площади вполне применимо. Самая большая солнечная батарея, когда-либо развёрнутая в космосе, — это батарея Международной космической станции (МКС), которая в пиковые моменты может выдавать чуть более 200 кВт энергии. Для её развёртывания потребовалось несколько полётов шаттлов и огромный объём работы — её площадь составляет около 2500 квадратных метров, что превышает половину размера поля для американского футбола.

Если взять за эталон NVIDIA H200, потребляемая мощность на одно устройство GPU составляет порядка 0,7 кВт на чип. Эти устройства не работают автономно, а эффективность преобразования энергии не достигает 100 %, поэтому на практике более подходящим ориентиром может служить показатель в 1 кВт на один GPU. Таким образом, огромная панель размером с МКС могла бы питать примерно 200 графических процессоров. Звучит внушительно, но давайте посмотрим на ситуацию с другой стороны: строящийся дата-центр OpenAI в Норвегии планирует разместить у себя 100 000 графических процессоров, каждый из которых, вероятно, потребляет больше энергии, чем H200. Чтобы достичь такой же мощности, нужно было бы запустить 500 спутников размером с МКС. Сравните это с тем, что одна серверная стойка (такая, какую продаёт NVIDIA в готовой конфигурации) вмещает 72 графических процессора, так что каждый гигантский спутник эквивалентен всего лишь примерно трём стойкам.

Атомная энергия не поможет. Речь здесь идёт не об атомных реакторах, а о радиоизотопных термоэлектрических генераторах (РИТЭГ), мощность которых обычно составляет около 50–150 Вт. Такой мощности не хватит даже на работу одного графического процессора, даже если вам удастся уговорить кого-то предоставить вам подкритический кусок плутония и не возражать против того, что у вас будут все шансы разбросать его по обширной территории планеты, когда ваша ракета-носитель взорвётся и разлетится на куски.

Терморегулирование

Я видел немало комментариев по поводу этой концепции, в которых люди говорят что-то вроде: «Ну, в космосе холодно, так что охлаждать оборудование будет очень просто, верно?»

Э-э… Нет. Определённо нет.

Охлаждение на Земле — дело относительно простое. Конвекция воздуха работает довольно эффективно: если направлять поток воздуха на поверхность, особенно на такую, которая имеет большое отношение площади к объёму (как, например, радиатор), тепло довольно эффективно отводится в воздух. Если требуется более высокая удельная мощность, чем даёт воздух (а графические процессоры с высокой мощностью определённо относятся к этой категории), можно использовать жидкостное охлаждение для отвода тепла от чипа к более крупному радиатору/теплоотводу, расположенному в другом месте. В дата-центрах на Земле обычно устанавливают контуры охлаждения, в которых оборудование охлаждается с помощью охлаждённой рабочей жидкости (обычно воды), циркулирующей по стойкам, при этом тепло отводится, а охлаждённая жидкость возвращается в контур. Обычно теплоноситель охлаждается за счёт конвективного охлаждения воздухом, так что в любом случае на Земле всё работает через воздух.

В космосе нет воздуха. Условия там настолько близки к полному вакууму, что с практической точки зрения разницы нет, поэтому конвекции просто не будет. В космической инженерии мы обычно думаем о терморегулировании, а не просто об охлаждении. Дело в том, что в космосе нет температуры как таковой. Температура есть только у материалов. Если спутник вращается, как курица на вертеле, он будет стремиться к постоянной температуре, примерно такой же, как у поверхности Земли. Если он не вращается, сторона, обращённая в сторону от Солнца, будет постепенно охлаждаться, причём нижний предел, обусловленный космическим микроволновым фоном, составляет около 4 кельвинов, что лишь немного выше абсолютного нуля. На стороне, обращённой к Солнцу, температура может подниматься до сотен градусов Цельсия. Поэтому управление тепловым режимом требует очень тщательного проектирования, чтобы тепло направлялось туда, куда нужно. Поскольку в вакууме нет конвекции, этого можно достичь только с помощью теплопроводности или какого-либо теплового насоса.

Я разрабатывал космическое оборудование, которое побывало в космосе. В одном конкретном случае я создал систему камер, которая должна была быть очень компактной и лёгкой, но при этом обеспечивать возможности съёмки научного уровня. В процессе проектирования основное внимание уделялось системе теплового управления — это было необходимо, поскольку на небольших космических аппаратах мощность ограничена, а тепловое управление нужно было реализовать при минимальной массе. Поэтому никаких тепловых насосов или других сложных устройств — я пошёл в другом направлении, разработав систему, потребляющую максимум около 1 ватта в пиковый момент и снижающую потребление примерно до 10% от этого значения, когда камера находится в режиме ожидания. Вся эта электроэнергия превращается в тепло, поэтому, если я могу потреблять 1 ватт только во время съёмки изображения, а затем отключать датчик изображения после попадания данных в ОЗУ, я могу сократить потребление вдвое, а когда изображение будет загружено в бортовой компьютер, я смогу отключить ОЗУ и снизить потребление до относительно незначительного уровня. Единственное, что требовало управления теплом, — это прикрутить край платы к шасси, чтобы внутренние медные плоскости на плате могли отводить выделяемое тепло.

Охлаждение даже одного процессора H200 станет настоящим кошмаром. Очевидно, что радиатор и вентилятор здесь совершенно бесполезны, но существует вариант H200 с жидкостным охлаждением. Допустим, мы его используем. Тепло от него нужно будет отводить на радиаторную панель — это не то же самое, что радиатор в автомобиле, ведь здесь нет конвекции, помните? — которая должна излучать тепло в космос. Предположим, что мы можем направить её в сторону, противоположную Солнцу.

Система активного терморегулирования (ATCS) на МКС является примером такой системы. Это очень сложная система, использующая контур охлаждения аммиаком и систему больших тепловых радиаторных панелей. Её предел рассеивания составляет 16 кВт, то есть примерно 16 графических процессоров H200, что чуть больше четверти наземного стоечного шкафа. Система тепловых радиаторных панелей имеет размеры 13,6 м × 3,12 м, то есть примерно 42,5 квадратных метра. Если взять за базовую величину 200 кВт и предположить, что вся эта мощность будет подаваться на графические процессоры, нам понадобится система в 12,5 раз больше, то есть примерно 531 квадратный метр, или примерно в 2,6 раза больше соответствующей солнечной батареи. Это будет очень большой спутник, по площади превосходящий МКС, и всё это ради эквивалента трёх стандартных серверных стоек на Земле.

Радиационная стойкость

Теперь мы переходим к теме моей докторской диссертации. Если предположить, что в космосе можно обеспечить как питание, так и охлаждение электроники, возникает дополнительная проблема — радиационная стойкость.

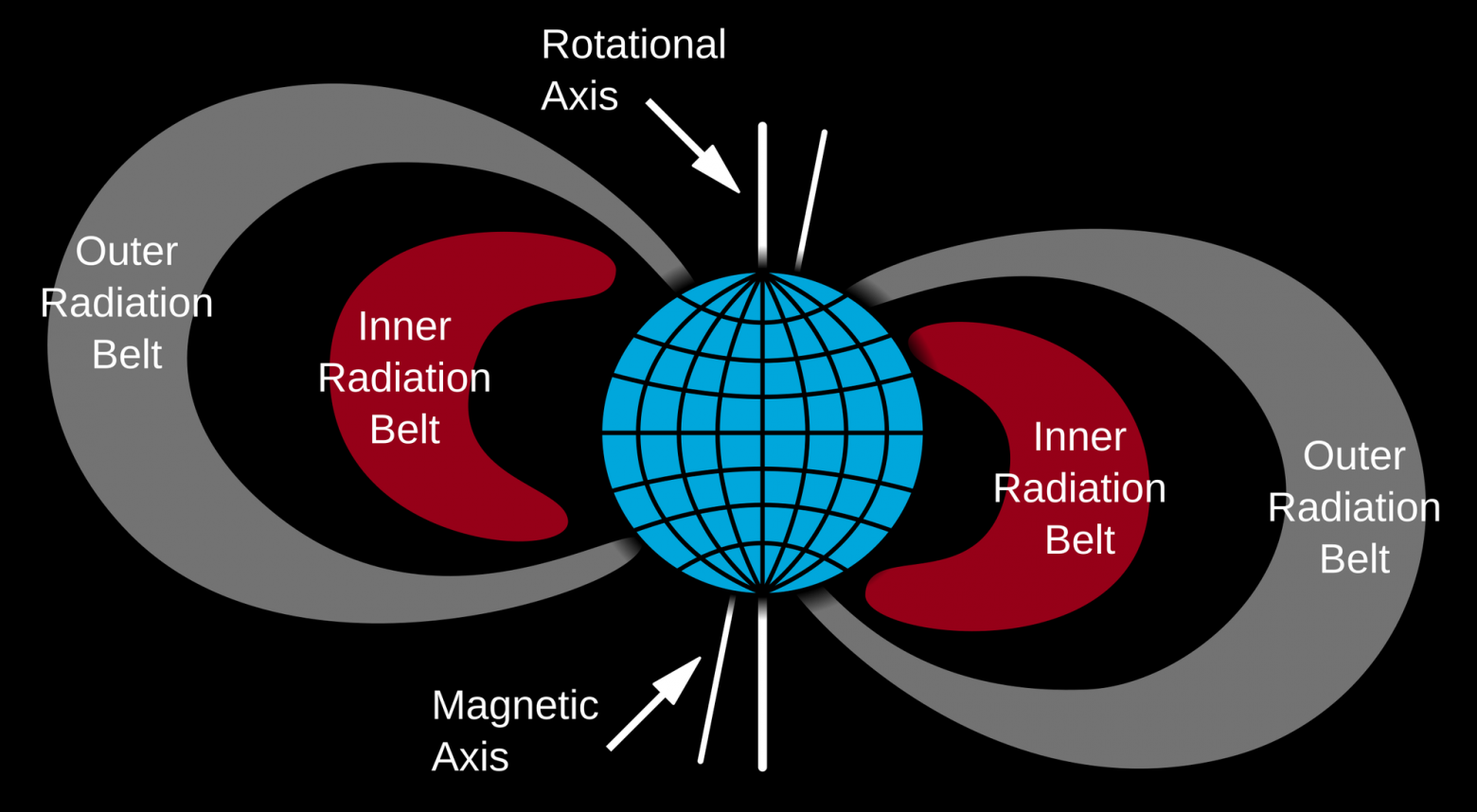

Первый вопрос: о какой части космоса идёт речь?

Если вы находитесь на низкой околоземной орбите (LEO), то вы находитесь внутри внутреннего радиационного пояса, где доза радиации аналогична той, которой подвергаются самолёты на большой высоте — больше, чем у пассажирского самолёта, но не критично. Дальше, на средней околоземной орбите (MEO), где находятся спутники GPS, спутники не защищены поясами Ван Аллена — хуже того, эта орбита буквально пронизывает их. За пределами поясов вы, по сути, находитесь в глубоком космосе (детали зависят от того, насколько близко к Солнцу вы находитесь, но принципы аналогичны).

В космосе существует два основных источника радиации — от нашей собственной звезды, Солнца, и из глубокого космоса. В основном это заряженные частицы, движущиеся со значительной долей скорости света, от электронов до атомных ядер с массой примерно до массы атома кислорода. Они могут наносить ущерб как напрямую, врезаясь в материал, из которого изготовлены микросхемы, так и косвенно, пролетая через кремниевую микросхему, ни с чем не сталкиваясь, но оставляя за собой след заряда.

Наиболее распространённым следствием такого явления является однократный сбой (single-event upset, SEU), когда прямое воздействие или (чаще всего) пролёт частицы через транзистор на короткое время (около 600 пикосекунд) вызывает появление импульса там, где его не должно быть. Если это приводит к изменению состояния бита, мы называем это SEU. Помимо повреждения данных, такие явления не вызывают необратимых повреждений.

Хуже всего — однократный латч-ап (эффект защёлкивания). Он происходит, когда импульс от заряженной частицы вызывает выход напряжения за пределы шин питания чипа, в результате чего транзистор фактически включается и остаётся включённым на неопределённое время. Я пропущу физику полупроводников, но вкратце: если это произойдёт неудачным образом, это может привести к появлению нежелательного соединения между шинами питания, что приведёт к необратимому выгоранию затвора. Это может разрушить чип, а может и нет, но без мер по смягчению последствий он может стать непригодным для использования.

В случае длительных миссий, к которым относятся космические центры обработки данных (поскольку их стоимость настолько высока, что для экономической рентабельности они должны находиться в космосе в течение длительного времени), необходимо также учитывать последствия облучения. Со временем рабочие характеристики микросхем в космосе ухудшаются: под воздействием многократных ударов частиц крошечные полевые транзисторы начинают переключаться медленнее, а их включение и выключение становится менее полным. На практике это приводит к снижению максимальной рабочей тактовой частоты и увеличению энергопотребления. Хотя это и не самая сложная проблема, её всё же необходимо смягчить, иначе можно столкнуться с ситуацией, когда чип, который нормально работал при запуске, перестаёт функционировать из-за недостаточного питания или охлаждения, либо из-за того, что тактовая частота стала выше той, которую чип способен выдержать. Поэтому необходимо иметь генератор тактовой частоты, который при необходимости может снижать скорость — это также можно использовать для управления энергопотреблением, так что вместо того, чтобы чип перестал функционировать, он просто будет работать медленнее.

Следующий вопрос из раздела «Часто задаваемые вопросы»: а нельзя ли просто использовать экранирование? Нет, вряд ли, или, может быть, только до определённой степени. Некоторые виды экранирования могут усугубить проблему — удар по экрану может вызвать поток частиц, которые затем вызовут сразу несколько ударов, последствия которых будет гораздо сложнее смягчить. Самые мощные космические лучи могут проходить через поразительное количество твёрдого свинца. Поскольку масса всегда имеет большое значение, редко удаётся использовать значительные объёмы экранирования, поэтому радиационная стойкость должна быть встроена в систему (это часто описывается как «радиационная стойкость по конструкции», RHBD).

Графические процессоры (GPU) и тензорные процессоры (TPU), а также оперативная память с высокой пропускной способностью, от которой они зависят, представляют собой абсолютно худший случай с точки зрения радиационной стойкости. Транзисторы с мелкой геометрией по своей природе гораздо более подвержены как SEU, так и латч-апу. Очень большая площадь кремниевого кристалла также увеличивает частоту ударов, поскольку она зависит от площади.

Чипы, действительно разработанные для работы в космосе, имеют иную структуру затворов и гораздо более крупную геометрию. Производительность используемых обычно процессоров примерно соответствует 20-летнему процессору PowerPC 2005 года выпуска. Более крупные геометрические размеры по своей природе более устойчивы как к SEU, так и к общей дозе облучения, а различные топологии затворов защищают от латч-апа, одновременно обеспечивая некоторую степень смягчения последствий SEU за счёт мелкозернистой избыточности на уровне схемы. Разработка GPU или TPU с использованием такого подхода, безусловно, возможна, но производительность будет составлять лишь небольшую долю от производительности GPU/TPU текущего поколения, предназначенных для использования на Земле.

Существует также подход «живём один раз» (я его так называю), при котором вы запускаете устройство в космос и надеетесь на лучшее. Это обычное явление для небольших кубсатов, и именно поэтому небольшие кубсаты часто выходят из строя через несколько недель на орбите. Caveat emptor!

Связь

Большинство спутников связываются с Землёй по радио. Достичь надёжной скорости выше 1 Гбит/с довольно сложно. Есть интересные разработки по использованию лазеров для связи со спутниками, но их реализация зависит от хороших атмосферных условий. Если сравнить это с типичной серверной стойкой на Земле, где межсоединение на 100 Гбит/с считается минимальным, то легко увидеть, что здесь тоже существует значительный разрыв.

Выводы

Полагаю, что такой проект реализовать вполне возможно, если вы действительно хотите это сделать, но, как я показал выше, во-первых, это будет чрезвычайно сложно, во-вторых, это обойдётся несоразмерно дорого по сравнению с наземными дата-центрами, и в лучшем случае обеспечит весьма посредственную производительность.

Если вы всё же считаете, что это стоит того, то удачи вам. Работа в космосе — дело не из лёгких. Лично я считаю, что это катастрофически плохая идея, но решать вам.

Автор: SLY_G