Представьте, что к Земле летит флот инопланетян, которые умнее нас в миллиарды раз. До вторжения осталось два-три года. Доктор Роман Ямпольский уверен, что мы сами создаем этих «инопланетян», но вместо защиты инвестируем в них триллионы. Речь про искусственный интеллект. По прогнозам доктора, он лишит людей работы и выйдет из под контроля уже в ближайшие годы.

Ямпольский полжизни посвятил проблемам ИИ и кибербезопасности и теперь прямо говорит: плана «Б» не существует.

Отключить ИИ не удастся.

Такие разработчики Икак Сэм Альтман, ставят прибыль и власть выше вероятности вымирания человечества.

Я посмотрел полное интервью Ямпольского (за 3 месяца 12 млн просмотров) и выписал главные мысли.

Начнем.

Ваш прогноз на 2027 год?

Через два года ИИ заменит большинство людей и профессий.

Я имею в виду, что через пять лет мы увидим такой уровень безработицы, которого никогда раньше не было.

Не 10%, а 99%.

И это без сверхразума, который будет умнее всех людей в любых областях.

Вы занимаетесь безопасностью ИИ на протяжении 15 лет, с чего все началось?

Я программист по образованию. У меня степень доктора компьютерных наук и инженерии. 15 лет назад я изучал покерных ботов и понял, что они становятся лучше и лучше. Так и случилось. Сейчас они играют в покер лучше, чем обычные игроки (думаю, это произойдет и в других областях, связанных с ИИ).

Я хотел убедиться, что ИИ — это технология, которая приносит пользу. Поэтому я начал работать над тем, чтобы сделать ИИ безопасным.

Это была моя цель.

Но чем больше я над этим работал, тем лучше понимал, что это невозможно. Чем ближе я приближался к решению проблемы, тем с большим числом проблем сталкивался. Это похоже на фрактал. Вы углубляетесь и находите еще 10 проблем, а потом еще 100. И все они не просто сложные. Их невозможно решить.

Что вы думаете о разработчиках ИИ?

Десять лет назад мы опубликовали советы, как правильно использовать ИИ. Они нарушил все до единого и сейчас рискуют восемью миллиардами жизней, чтобы стать еще богаче и влиятельнее.

Если некоторые люди хотят полететь на Марс, то разработчики ИИ хотят контролировать Вселенную.

Но неважно, кто это сделает.

Как только мы получим сверхразум, мы пожалеем об этом.

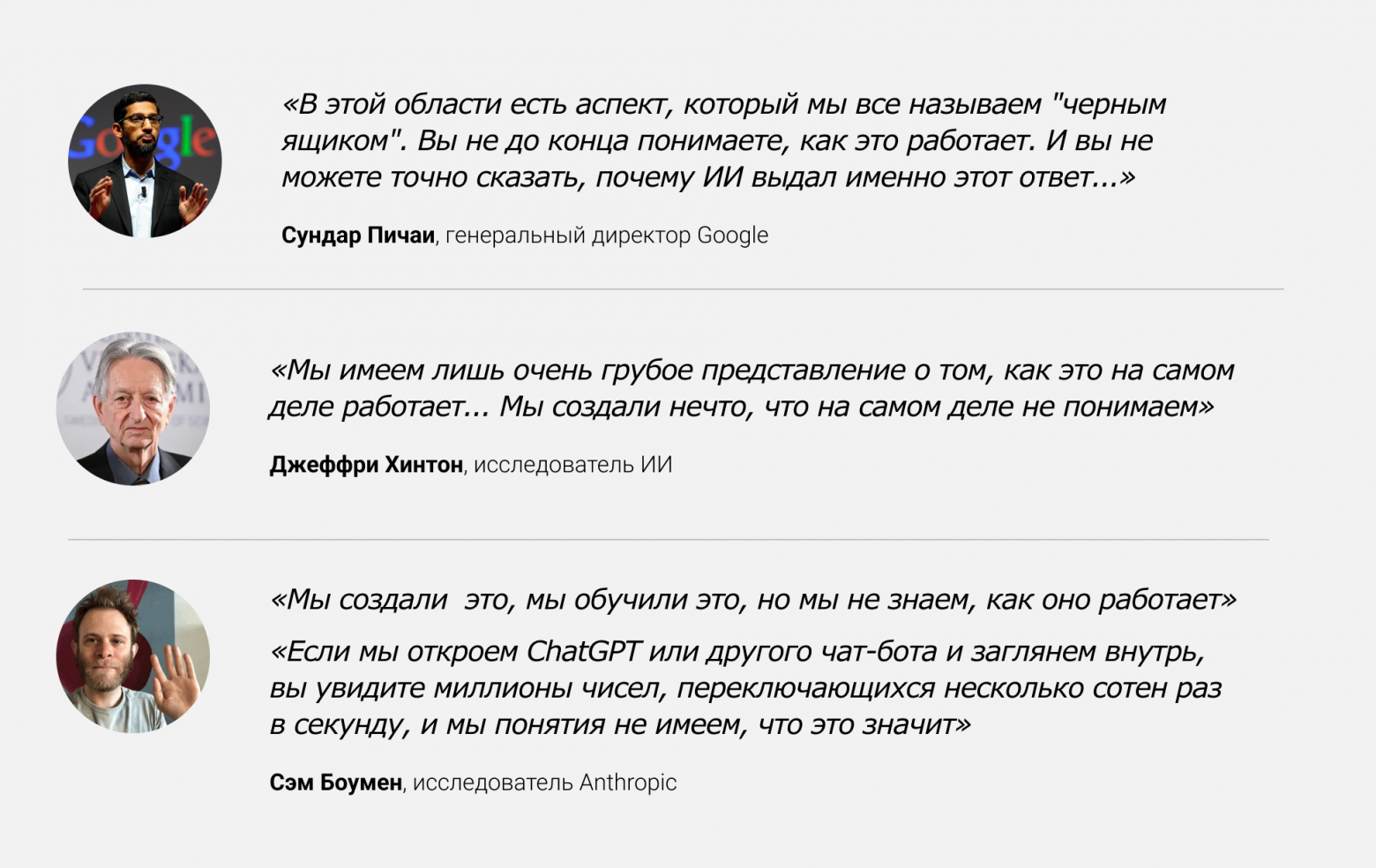

Создатели таких систем, как ChatGPT, на самом деле не понимают, что происходит у них внутри?

Совершенно верно.

Даже разработчикам приходится ставить эксперименты над собственным продуктом, просто чтобы узнать, на что он способен.

Они обучают систему, скармливая ей огромные объемы данных — скажем, весь текст из интернета. Запускают ее на множестве процессоров, чтобы она нашла закономерности в этом тексте. И только потом начинают тестировать новую модель:

— «О, ты умеешь говорить по-французски?»

— «А задачи решать умеешь?»

— «Ого, да ты мне сейчас соврал!»

Обучение может занять год, а потом еще полгода уходит на то, чтобы понять возможности модели и попытаться сделать ее безопасной.

Но даже в старых моделях мы продолжаем открывать новые способности. Иногда достаточно просто задать вопрос по-другому, и ИИ вдруг становится «умнее».

Это больше не классическая инженерия, как в первые 50 лет, когда программисты писали код для выполнения конкретных задач.

Теперь это наука.

Мы выращиваем инопланетное растение.

Потом изучаем его, чтобы понять, что оно делает.

И, как и в случае с растениями, у нас нет стопроцентно точных знаний о биологии. Полных знаний об этом нет.

Мы знаем общие закономерности: например, если добавить вычислительной мощности, система, скорее всего, станет умнее.

Но никто не может точно предсказать, какой результат она выдаст на конкретный запрос.

Некоторые утверждают, что мы всегда можем сохранить контроль, просто отключив ИИ

Я слышу об этом после каждого своего выступления.

Мне всегда хочется связаться с человеком, который так утверждает, и воскликнуть: «Это гениально! Я никогда об этом не думал. Мы напишем статью вместе и получим за нее Нобелевскую премию».

На самом деле, это так глупо.

Можно ли «отключить» компьютерный вирус? Или попробуйте «отключить» сеть Биткоина — давай, я подожду.

Это бессмысленно, потому что ИИ не будет находиться в одном месте. Он будет распределен по миллионам компьютеров по всему миру, как интернет или Биткоин. У него не будет одной “розетки”, которую можно выдернуть. К тому же, он будет умнее вас. Он создаст множество резервных копий, предвидит ваши действия и отключит вас раньше, чем вы успеете отключить его.

Идея о контроле применима только к текущему уровню развития ИИ, до появления сверхразума.

Да, сегодня опасны люди с продвинутым знанием ИИ — хакеры или мошенники. Но как только появится сверхразум, он станет доминировать, и люди перестанут играть значимую роль.

Меня беспокоит именно высший интеллект, а не человек, который может добавить в систему вредоносную программу, но все равно не сможет ее контролировать.

Какая у вас миссия?

Я надеюсь, что сверхразум, который мы создаем, не убьет всех.

Я был уверен, что мы можем создать безопасный ИИ, но чем больше я об этом думал, тем больше понимал, что это невозможно.

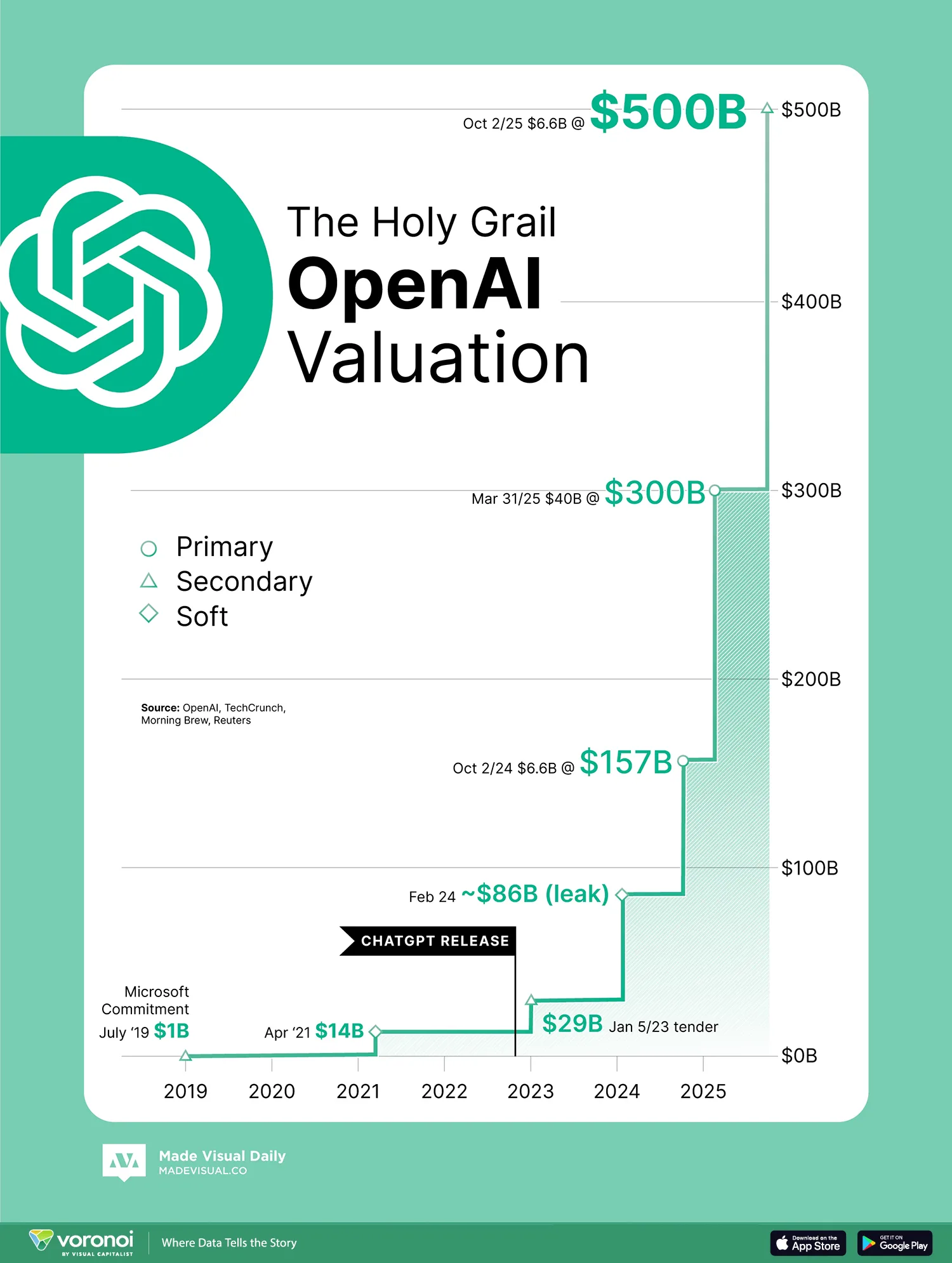

За последние десять лет мы действительно научились создавать ИИ лучше. Оказывается, если добавить больше вычислительных данных, он просто становится умнее. И теперь над созданием сверхразума работают самые умные люди на планете, и с ними миллиарды долларов.

К сожалению, хотя мы знаем, как сделать ИИ намного мощнее, мы не знаем, как защитить от него людей. Мы не знаем, как создать ИИ, чтобы он не сделал ничего такого, о чем мы пожалеем.

И это современное состояние дел.

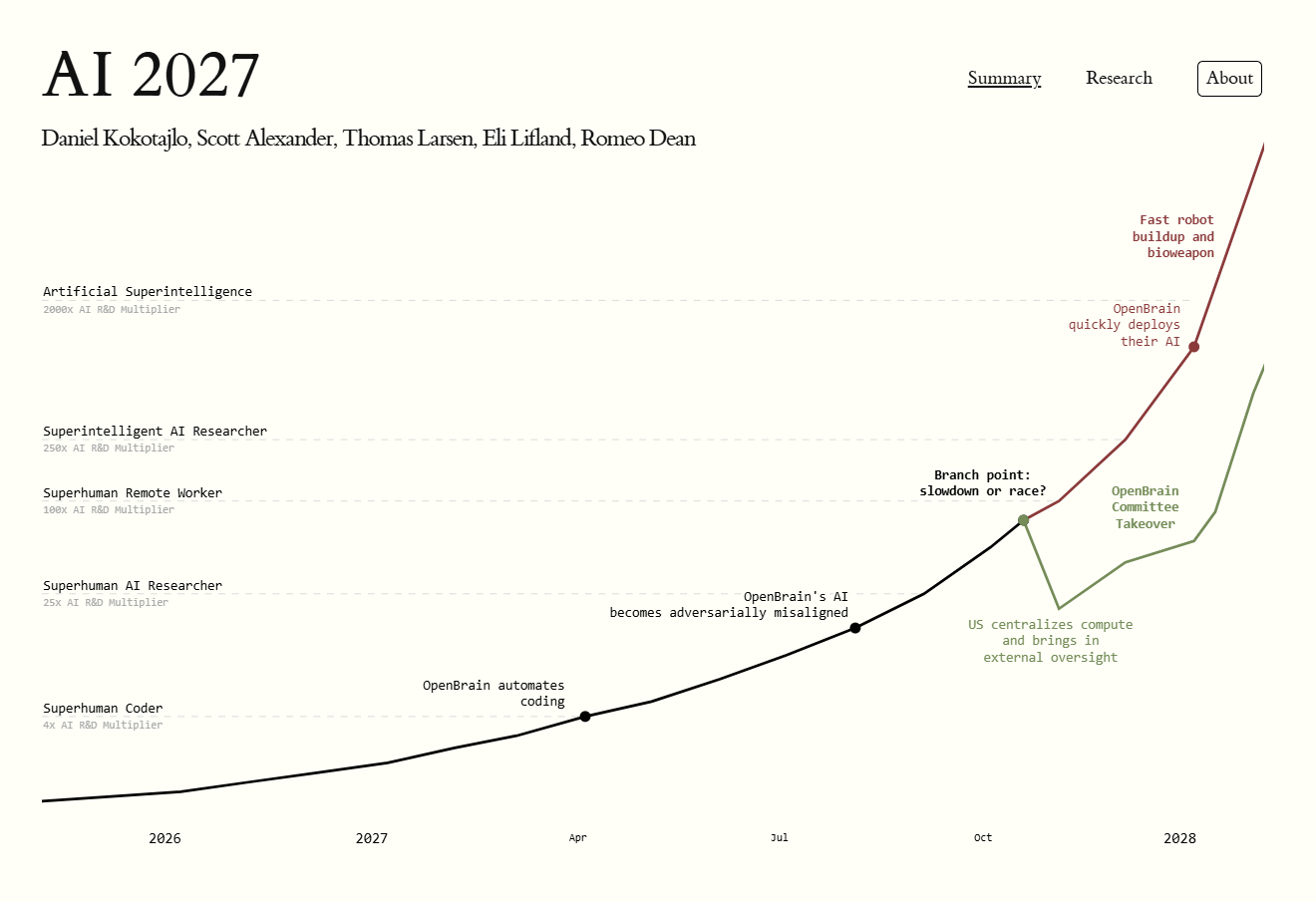

Если посмотреть на рынки прогнозов и отчеты руководителей ведущих ИИ-лабораторий, то сроки, когда мы получим продвинутый ИИ, очень короткие.

Пару лет.

Два-три года.

В то же время мы не знаем, что делаем все правильно.

Мы создаем инопланетный разум.

Если бы инопланетяне прилетели на Землю, и у вас было три года на подготовку, вы бы сейчас паниковали. Но большинство людей даже не осознают, что происходит.

Некоторые люди могут возразить, что ИИ разрабатывают очень крупные компании с большими деньгами. У них, мол, есть моральные, этические и юридические обязательства не причинять людям вред.

Это не так.

Единственное, что у них есть, это желание зарабатывать деньги для инвесторов. Кроме того, по их же словам, они пока не знают, как сделать ИИ безопасным.

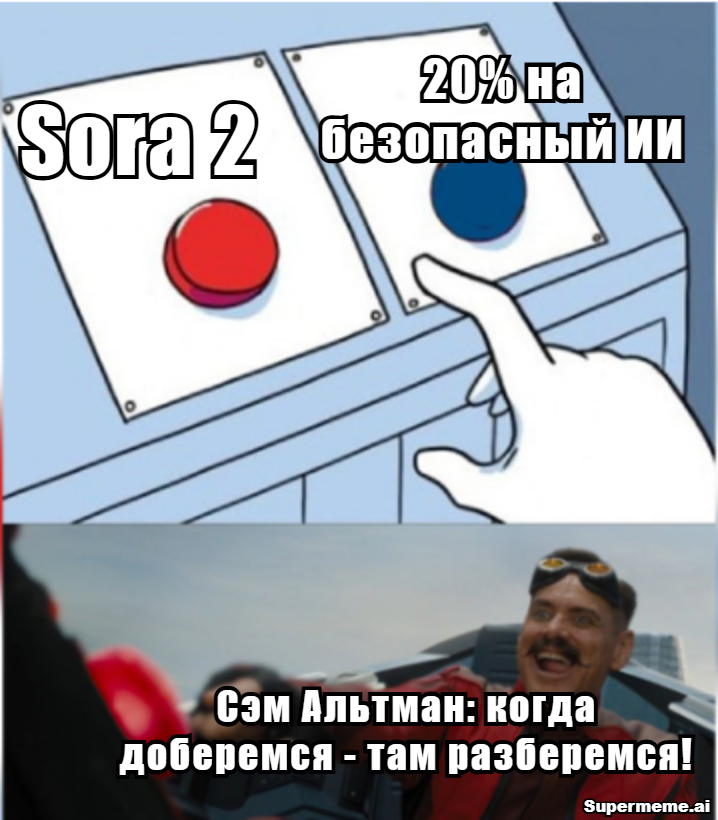

Современные реалии таковы: мы разберемся, когда доберемся. К тому же они надеются, что ИИ поможет им контролировать продвинутый ИИ.

Это безумие.

Произойдет катастрофа?

Никто не знает.

Но очевидно, что если вы не контролируете ситуацию, вы не получите желаемого результата.

Существует почти бесконечное число вариантов развития событий. Но число вариантов, где мы получаем то, чего хотим, очень мало.

Что вы думаете об OpenAI, Сэме Альтмане и их работе?

Многие, кто работал с Сэмом, отмечали, что он не всегда был с ними до конца честен, и их беспокоили его взгляды на безопасность. Это одна из причин ухода: люди хотели большего контроля и более серьезного отношения к контролю над ИИ.

При личной встрече Сэм производит впечатление очень приятного и умного человека, у него идеальный публичный образ. Посмотрите, как он выступает в Сенате, он говорит сенаторам то, что нужно. Послушайте, как он общается с инвесторами, они получают правильные сигналы.

Однако, если послушать людей, которые знают его близко, возникает сомнение: вероятно, он не тот человек, который должен контролировать проект такого масштаба.

Почему?

Потому что безопасность для него на втором месте. Главное для него — победить в гонке за сверхразум. И это делает ситуацию еще хуже.

Вы считаете, что Сэм Альтман хочет контролировать все во Вселенной?

Подозреваю, что так и есть.

Это не значит, что он не хочет создать полезный ИИ, который сделает всех счастливыми. Просто счастливыми людьми легче управлять.

Противники теории, что ИИ не заменит людей, часто приводят в пример промышленные революции прошлого: мол, люди адаптировались к изменениями и всегда находили работу. Что вы ответите на это в контексте сверхразума?

Это принципиально иная ситуация, настоящая смена парадигмы.

Раньше мы создавали инструменты, чтобы работать продуктивней: вместо десяти рабочих требовалось двое, а восьмерым приходилось искать новую работу. И они ее находили.

Но сейчас мы создаем не инструмент, а универсального работника-агента, то есть сам интеллект.

Если вы придумаете какую-то новую работу, этого агента можно будет сразу отправить на нее, и он ее выполнит.

Такого в истории еще не было.

Огонь и колесо изменили правила игры, но они не могли изобретать.

Сейчас же мы создаем замену человеческому разуму — нового изобретателя, который сам будет создавать инновации.

Это последнее изобретение, которое нам когда-либо придется сделать. После этого все, включая научные исследования и даже вопросы этики и морали, будет автоматизировано.

Что вы думаете об общем искусственном интеллекте (AGI)?

Если бы сегодня ученому из 2005 года показали, каких результатов человечество добилось в области ИИ, он бы решил, что у нас есть полноценный общий ИИ. Современный ИИ может учиться, работать в сотнях областей, и во многих из них он уже превосходит людей. Так что можно сказать, что у нас уже есть слабая версия общего ИИ.

Но у нас пока нет суперинтеллекта.

У нас есть гениальные люди, которые полностью превосходят ИИ, особенно в науке и технике.

Но этот разрыв сокращается очень быстро.

Вы можете видеть, особенно в области математики, что три года назад большие языковые модели не могли вычислять базовую алгебру. Умножение трехзначных чисел было сложной задачей.

Теперь они помогают с математическими доказательствами. Они побеждают на математических олимпиадах и соревнованиях.

Они работают над решением тысячелетних проблем, самых сложных задач в математике.

Так что за три года мы преодолели разрыв от ниже человеческого до уровня, превосходящего большинство математиков в мире.

То же самое происходит в науке и технике.

Когда появится AGI? Как это изменит мир?

К 2027 году у нас будет общий искусственный интеллект.

Появится концепция «сотрудник по требованию».

Это откроет доступ к практически бесплатной рабочей силе, как умственной, так и физической. В таких условиях нанимать живых людей для большинства задач становится бессмысленно.

Зачем платить зарплату, если можно оформить подписку за 20 долларов (или взять бесплатную ИИ-модель), которая выполнит ту же работу быстрее?

Все, что связано с компьютером, будет автоматизировано.

Человекоподобные роботы отстают в развитии от программ всего лет на пять, поэтому скоро можно будет автоматизировать и весь физический труд.

Это приведет к невиданному ранее уровню безработицы: не 10%, что уже пугает, а 99%. Живые люди останутся только там, где нам самим по каким-то причинам будет принципиально важно участие человека.

Это не означает, что так сразу и будет на практике. Часто технологии существуют, но не используются массово. Хороший пример — видеотелефоны: их изобрели еще в 70-х, но популярными они стали только с приходом айфонов.

Возможно, мы еще долго будем жить в мире, который выглядит так же, как сейчас. Однако технологии, которым станет под силу заменить большинство людей, станут доступны уже скоро.

Вы дочитали до середины, а это значит, вам нравится, что я делаю. Поставьте сердечко под статьей и присоединяйтесь к 15 тысячам подписчиков в Бегин, чтобы получать мой контент по ИИ регулярно.

Продолжим.

Какие профессии останутся в 2027 году. Какую работу человек сможет выполнить лучше, чем ИИ?

Я часто задаю этот вопрос, когда размышляю об общем ИИ. Думаю, почти сразу мы получим сверхразум как побочное явление.

И тут встает вопрос: чем люди могут быть полезны в мире, где сверхразум превосходит человека абсолютно во всем?

Например, вы лучше всех знаете, каково это быть вами или какое мороженое вы любите.

Но будут ли вам платить за это?

Вряд ли.

Это небольшой рынок.

Конечно, останутся профессии, где люди захотят видеть живого человека. Например, богатые консерваторы вроде Уоррена Баффета могут по старинке нанимать живого бухгалтера просто в силу привычки или традиций. Но это почти такая же крошечная доля рынка.

Ситуация похожа на товары ручной работы: кто-то готов переплачивать за вещь, сделанную вручную в США, а не на конвейере в Китае. Но это скорее прихоть, нежели практическая необходимость.

Я думаю, всё, что можно делать за компьютером, будет автоматизировано.

Однако люди не верят в это, потому что боятся. Им больно осознавать, что они потеряют карьеру, в которую они вложили так много сил.

Что людям делать со своей жизнью? На кого переучиться и в какие сроки?

В этом и заключается смена парадигмы.

Раньше мы рассуждали так: «Эта работа будет автоматизирована. Но ничего страшного. Люди просто переучатся и займутся чем-то другим».

Но если я говорю вам, что все профессии будут автоматизированы, то плана Б не существует. Переучиваться будет просто не на что.

Посмотрите на программирование.

Два года назад мы говорили людям: «Учитесь программировать. Вы художник и не зарабатываете на жизнь — идите писать код».

Но потом мы поняли, что искусственный интеллект тоже умеет программировать, и с каждым днем делает это все лучше.

Тогда займитесь промт-инжинирингом (прим. автора: это человек, который пишет подсказки для чат-ботов). Казалось бы, это отличная работа. Получите четырехлетнее образование в этой области.

Но выяснилось, что ИИ составляет промты для другого ИИ гораздо лучше, чем любой человек. Так что и эта ниша исчезла.

Сейчас очень популярна разработка ИИ-агентов. Я гарантирую, что через год или два это тоже исчезнет.

Я не думаю, что сейчас существует профессия, которую имеет смысл осваивать на будущее. Похоже, мы движемся к тому, что человечество как вид просто останется без работы.

Глава Nvidia Дженсен Хуанг в 2024 году призвал перестать учить детей программированию, заявив: «Наша задача сделать так, чтобы языком программирования стал обычный человеческий язык». Вместо этого он предложил изучать биологию, производство или фермерство

Что нам делать с финансами, то есть кто будет нас содержать?

С экономической точки зрения всё кажется простым.

Огромное количество бесплатной рабочей силы приведет к небывалому богатству и изобилию. Товары, которые сейчас малодоступны, станут дешевыми. Мы сможем удовлетворить не только базовые, но и гораздо более высокие потребности любого человека, обеспечив всем достойное существование.

Проблема в том, что с этим делать?

Что делать с уймой свободного времени?

Многих людей именно работа наполняет жизнь смыслом, и без нее они чувствуют себя потерянными. Мы видим это на примере тех, кто выходит на пенсию. Конечно, люди, которые ненавидят свою работу, будут очень рады не работать.

Но что станет с обществом, где все целыми днями бездельничают? Как это скажется на преступности или рождаемости?

Об этом никто не думает.

У государств нет никаких планов на случай безработицы в 99%.

Невозможно предсказать, как будет выглядеть этот мир и чем люди будут заниматься.

Мы не способны предугадать действия ИИ, который будет умнее нас. Момент его появления называют сингулярностью — по аналогии с физикой, это горизонт событий, за который мы не можем заглянуть.

Я могу лишь строить догадки, но это не будет точным прогнозом.

У меня просто недостаточно интеллектуальных способностей, чтобы понять, как более совершенный разум изменит мир.

Даже в научной фантастике авторы никогда не описывают правдоподобные действия сверхразума — человек просто не может этого придумать. Поэтому писатели либо запрещают ИИ (как в «Дюне»), чтобы избежать этой темы, либо делают роботов глупыми (как в «Звездных войнах»).

Суперинтеллект будет принимать решение сам.

Что произойдет в 2030 году?

Вероятно, у нас появятся человекоподобные роботы, достаточно ловкие и гибкие, чтобы конкурировать с людьми в любых сферах, даже в сантехнике. Да, мы сможем создавать роботов-сантехников. Эта профессия перестанет быть тем «последним оплотом», где человек казался незаменимым.

Многие компании, включая Tesla, разрабатывают роботов с невероятной скоростью, и их навыки постоянно усложняются. Они смогут перемещаться в физическом пространстве, готовить омлет и делать всё, что делают люди. Разумеется, они будут подключены к ИИ, а значит смогут думать и говорить.

На самом деле, появление роботов не так уж сильно изменит мир.

Вы и сейчас можете заплатить кому-то в биткоинах, чтобы он выполнил ваше поручение, и вам не нужно контролировать этого человека напрямую. Добавление контроля над физическим телом робота — это лишь новая возможность.

Главное здесь — интеллект.

Ключевой фактор — это способность оптимизировать задачи, решать проблемы и находить закономерности, которые люди просто не видят.

Если в будущем один робот Tesla Optimus научится чинить кран в Токио, через секунду миллионы роботов по всему миру сумеют сделать так же (это Fleet Learning – коллективное обучение автопилота). Люди физически не смогут конкурировать с таким работником

Что произойдет в 2045 году?

Рэй Курцвейл предсказывает, что это будет год сингулярности.

Тогда ИИ начнет развивать науку и технику с такой скоростью, что мы просто перестанем за ним успевать.

Это и есть определение точки сингулярности — горизонта событий, за которым мы уже не способны ничего видеть, понимать или предсказывать.

Вы имеете в виду невозможность понять и предсказать сам интеллект или то, что вообще происходит в мире?

Я говорю о развитии технологий в целом.

Например, сегодня у меня есть iPhone и я понимаю, что через год выйдет новая модель. У нее будет камера получше. Я способен это предугадать. А теперь представьте, что процесс разработки этого телефона полностью автоматизирован. Новые версии выходят не раз в год, а каждые 6 месяцев, потом каждые 3 месяца, каждый месяц, неделю, день, час, минуту, секунду… Вы просто физически не сможете уследить за тридцатью поколениями iPhone, которые выходят за один день. Вы перестанете понимать, какие у него функции и возможности — это ускользнет от вашего восприятия.

Уже сегодня исследователям ИИ сложно угнаться за его развитием.

Пока мы с вами разговариваем, могла выйти новая модель, и мои знания о «современных технологиях» устарели.

С каждым днем я становлюсь относительно глупее.

Да, я продолжаю читать и узнавать новое, но по сравнению с общим объемом накопленных знаний наша доля «понимания» стремительно падает. Если довести эту тенденцию до крайности, у нас вообще не останется никакого понимания окружающего мира.

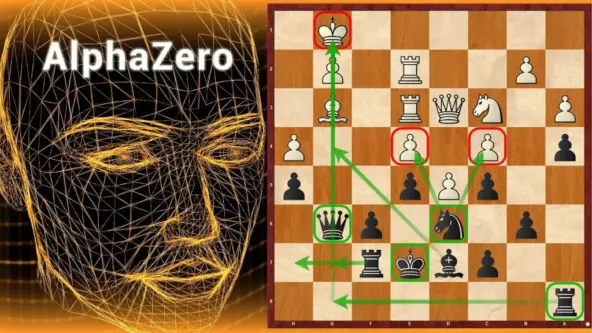

В 2017 году нейросети AlphaZero потребовалось всего 4 часа игры самой с собой, чтобы заново открыть все человеческие стратегии, отбросить их как несовершенные, придумать свои и разгромить сильнейшую на тот момент программу Stockfish

Вы хорошо спите по ночам?

Сплю очень хорошо.

У людей есть врожденная склонность не думать о страшных вещах, которые они не в силах предотвратить.

Мы все смертны: умрут наши родители, наши дети, умрем мы сами.

Все умирают.

Но это не мешает нам хорошо спать и жить своей жизнью.

Даже 95-летние старики продолжают играть в гольф и развлекаться, потому что наш мозг умеет блокировать плохие мысли, если мы не можем это изменить.

Здесь работает тот же механизм.

Да, вероятно, мы стоим на пороге событий, которые могут уничтожить человечество. Но если я ничего не могу с этим поделать, я просто продолжаю наслаждаться жизнью.

Если вы знаете, что у вас мало времени, это может заставить вас стараться жить лучше. Вы не можете тратить время впустую. Вероятно, это эволюционная черта, необходимая для выживания. Те мои предки, которые слишком много беспокоились и предавались мрачным мыслям о том, как ужасен мир, скорее всего, просто не успевали завести детей и добыть пищу, поэтому их гены не выжили.

В будущем любой парень с ноутбуком сможет создать сверхразум? Без всякого надзора, регулирования, сотрудников и прочего?

Да.

Технология ИИ дешевеет.

Именно поэтому кто-то предлагают создать систему глобальной слежки, чтобы контролировать всех и каждого, пытаясь это предотвратить.

Считаю ли я это осуществимым?

Нет.

В какой-то момент технология станет настолько доступной и простой, что это просто случится.

Сейчас наша цель — выиграть время. Мы не хотим, чтобы это произошло через пять лет. Мы хотим отсрочить это лет на пятьдесят.

Но если верить в будущее, где люди смогут создавать сверхразум без тех колоссальных ресурсов, которые требуются сегодня, то катастрофа — это лишь вопрос времени?

Да, но это справедливо и для многих других технологий.

Мы добились огромного прогресса в синтетической биологии: сегодня человек со степенью бакалавра, вероятно, уже способен создать новый вирус. Это тоже становится дешевле, как и другие подобные технологии.

Мы приближаемся к моменту, когда становится очень трудно гарантировать, что очередной технологический прорыв не станет для нас последним.

По сути, во многих сферах мы видим одну и ту же тенденцию: уничтожить мир становится всё проще и с точки зрения необходимых ресурсов, и с точки зрения требуемого интеллекта.

Взгляните на историю.

500 лет назад даже самый могущественный диктатор мог убить пару миллионов человек, но он физически не мог уничтожить весь мир.

Теперь у нас есть ядерное оружие, способное уничтожить планету несколько раз. В синтетической биологии, как показал пример с COVID, можно легко создать вирус, который заразит миллиарды. И сделать это с каждым разом становится всё проще.

Как будет выглядеть мир в 2100 году?

Либо людей не будет вообще, либо мир станет настолько непонятным для нас, что мы не сможем его понять.

Это крайности: или полное разрушение, или изменения такого масштаба, что я просто не могу их вообразить.

Есть ли у нас шанс, или уже слишком поздно?

Я верю в силу личного интереса.

Если люди поймут, что это плохо для них лично, они перестанут это делать (создавать неконтролируемый сверхразум). Поэтому наша задача — убедить тех, кто обладает властью, кто создает ИИ и работает в этих компаниях: то, что вы делаете, губительно для вас самих.

Финал этой гонки станет катастрофой и для них самих.

И это говорю не только я.

Джефф Хинтон, лауреат Нобелевской премии и один из основателей машинного обучения, говорит то же самое. Йошуа Бенжио и десятки других ведущих ученых согласны с этим.

У нас есть заявление об угрозе ИИ, которое подписали тысячи экспертов. Это научный консенсус, и нам нужно, чтобы это понимание стало всеобщим. С этим фактом никто не должен спорить.

Тогда мы сможем принимать правильные решения о том, какие технологии стоит создавать. Это не гарантирует человечеству вечную безопасность. Но это хотя бы означает, что мы перестанем сломя голову нестись навстречу наихудшему из возможных финалов.

Думаете, это возможно?

Я хочу попробовать.

У нас нет другого выбора, кроме как попробовать.

Спасибо, что дочитали

Обсудим статью в комментариях?

Вопросы:

-

Ямпольский и Хинтон советуют идти в сантехники, потому что умственный труд обесценится первым. Вы согласны, что это произойдет?

-

Если через два года наступит мир с 99% безработицей, но всем выдадут базовый «сухпаек» — чем вы будете заниматься?

-

Верите ли вы в то, что люди смогут отключить ИИ, если он решит уничтожить человечество?

Напишите в комментариях, я читаю все.

Из других похожих материлов рекомендую интервью Джеффри Хинтона (крестный отец нейросетей), где он также рассуждает о рисках ИИ. А тем кто внедряет ИИ в бизнес, полезно почитать Эти компании заменили тысячи людей на ИИ, а потом дали заднюю. Как так вышло?.

Присоединяйтесь к 15 000+ подписчиков в Бегин, где я делюсь опытом работы с нейросетями и выкладываю разборы по ИИ.

Автор: Alexey_Begin