OpenAI анонсировала две новые функции безопасности для ChatGPT: Lockdown Mode (режим блокировки) и Elevated Risk labels (метки повышенного риска). Опции призваны бороться с угрозами внедрения вредоносных промптов.

Атаки с внедрением подсказок позволяют злоумышленникам скрывать инструкции внутри веб-контента или подключённых источниках данных. Когда система ИИ обрабатывает этот контент, её можно обманом заставить следовать скрытым инструкциям. В худшем случае это может привести к утечке конфиденциальных данных или совершению вредоносных действий.

По мере того, как системы ИИ начинают взаимодействовать с другими сервисами, этот риск становится всё труднее игнорировать.

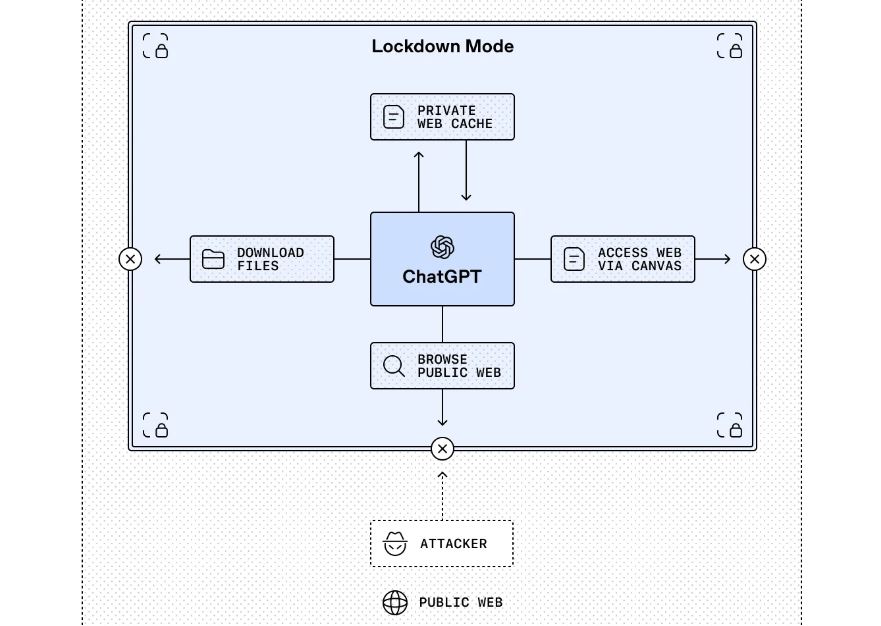

Lockdown Mode — это высокозащищённая мера реагирования OpenAI. Он описывается как дополнительная настройка, предназначенная для относительно небольшой группы пользователей. Речь идёт о руководителях крупных компаний, группах безопасности, журналистах, работающих с конфиденциальной информацией, или организациях, которые уже часто становятся мишенью кибератак. При включении режима блокировки возможности ChatGPT взаимодействовать с внешними системами жёстко ограничены. Ограничения являются детерминированными, то есть они не зависят исключительно от модели.

В качестве примера OpenAI приводит просмотр веб-страниц. В режиме блокировки он ограничивается кэшированным контентом, и никакие запросы к сети в реальном времени не покидают контролируемую инфраструктуру OpenAI. Это решение призвано предотвратить сценарий, при котором конфиденциальные данные могут быть незаметно отправлены злоумышленнику через изменённую веб-страницу.

Режим основан на защите, уже существующей в бизнес-планах, включая управление доступом на основе ролей и журналы аудита. Он доступен для ChatGPT Enterprise, ChatGPT Edu, ChatGPT for Healthcare и ChatGPT for Teachers. Администраторы рабочих пространств могут включить его, создав определённую роль в настройках, а затем определив, какие приложения и какие действия в этих приложениях останутся доступными.

Интеграция с платформой журналов API соответствия OpenAI обеспечит прозрачность использования приложений, общих данных и подключенных источников.

Режим блокировки внедрят для потребителей в ближайшие месяцы.

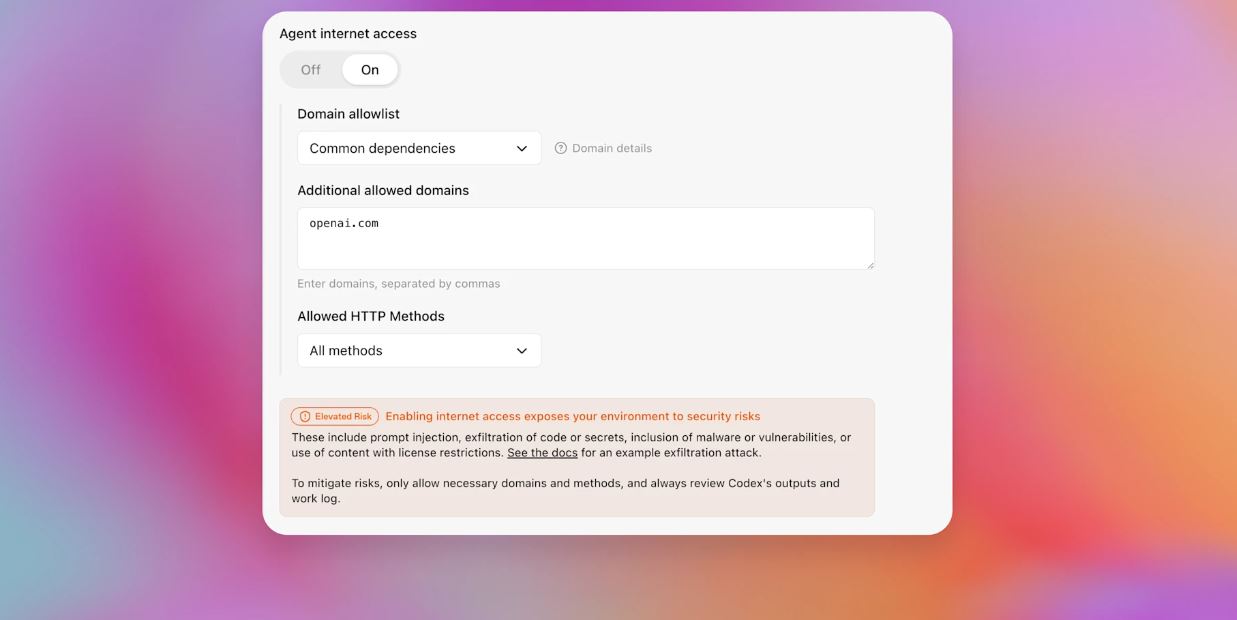

Кроме того, OpenAI стандартизирует способ маркировки функций с повышенным риском. Некоторые возможности в ChatGPT, ChatGPT Atlas и Codex теперь будут иметь метку «Повышенный риск». С помощью неё OpenAI стремится информировать юзеров о том, что меняется при включении доступа к сети, какие риски могут возникнуть и когда такой доступ уместен.

Компания заявляет, что снимет метку, как только определит, что меры защиты достаточно улучшились.

Накануне OpenAI изменила формулировку своей миссии, убрав из неё слово «safety» (безопасность), что отражает смещение акцентов в стратегии. Исходная миссия OpenAI говорила о стремлении создать искусственный интеллект, который «безопасно приносит пользу человечеству» без необходимости приносить финансовую прибыль, а теперь этих слов в формулировке нет. Критики утверждают, что удаление упоминания о безопасности может снизить внимание к потенциальным рискам, связанным с развитием ИИ, особенно в свете того, как растут мощности и влияние искусственного интеллекта.

Автор: maybe_elf