Три закона робототехники сегодня буксуют в реальности.

— Первый — автопилот немецкого концерна заботится о водителе, а не о пешеходах; роботов вооружают и используют для боевых задач.

— Второй — модели знают лучше пользователя, что ему нужно, и делают это, а не то, что он сказал.

— Третий — много роботов — расходники, и задача важнее их целостности.

Давайте сегодня вспомним, как видели роботов в научной фантастике, и посмотрим, как это повлияло на современные машины.

Откуда взялись наши ожидания

Группа исследователей из Университета Цукуба вместе с писателями из японской Ассоциации научной фантастики собрали и проанализировали 115 образов искусственного интеллекта. В список попали примеры из фильмов, книг и комиксов за последние сто с лишним лет.

Это и киборг писателя Ярослава Гашека 1912 года, и современный биоинтеллект на плесневых грибах из рассказов 2019 года. Каждого персонажа оценивали по 9 критериям: от наличия сознания и формы тела до умения болтать и работать коллективно.

Два эксперта независимо выставляли оценки по пятибалльной шкале. Коэффициент согласия Коэна между ними вышел 0,86 — это высокая надёжность.

Когда массив данных прогнали через статистические методы, выяснилось, что всё это многообразие делится на две понятные шкалы: интеллект и человечность. В итоге выделилось четыре архетипа, которые до сих пор определяют, как мы воспринимаем технологии.

Четыре типа роботов, которых мы придумали

Первый тип — это простая «Машина», тупая и опасная. У таких роботов почти нет зачатков сознания или речи, они не учатся и не понимают контекста. Это роботы-автоматы вроде Робота-Матери из «Механических мышей» или боевых единиц из Кобо Абэ. Они просто прут по программе, пока не сломаются.

Кстати, именно отсюда растёт «комплекс Франкенштейна» — страх, что создание восстанет против творца. Айзек Азимов придумал три закона робототехники именно в ответ на этот страх. Он хотел показать, что роботы не обязаны быть монстрами. Ирония в том, что большинство его рассказов в сборнике «Я, робот» построены на ситуациях, когда три закона не срабатывают.

Большинство промышленных роботов в мире как раз этот архетип. На автозаводах и складах маркетплейсов манипуляторы уже заменяют рутинный человеческий труд. Они не устают, не болеют и не умеют бунтовать. Машины слепо выполняют код и машут железными руками. И это бывает опасно. Ежегодно десятки работников гибнут просто потому, что зашли не в ту зону и попали под раздачу железки.

Второй тип — «Человекоподобные». Это самая большая группа, почти 40% всех образов. Например, андроиды Азимова или репликанты из «Бегущего по лезвию». Исследователи из Цукуба указывают, что человекоподобный искусственный интеллект в фантастике — метафора раба и чужака. Даже слово «робот» произошло от чешского robota, то есть подневольный труд.

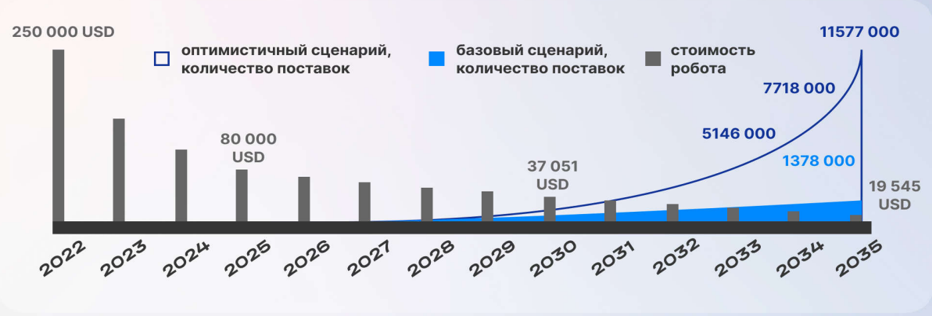

Но когда дело дошло до практики, мы упёрлись в эффект зловещей долины. Если робот слишком похож на нас — это пугает. Поэтому компании-разработчики специально оставляют своим гуманоидам механический вид, чтобы мозг не считывал их как «неправильных людей». В целом индустрия человекоподобных роботов только растёт. По данным исследования Газпромбанка, мировой рынок антропоморфных решений увеличивается в среднем на 44% в год. Поведение инвесторов говорит о явном перетоке интереса от старых заводских роботов к новым человекоподобным моделям.

По прогнозу Morgan Stanley, более 62 млн дополнительных рабочих мест могут взять на себя роботы к 2050 году. Это поможет человеку в быстро развивающихся индустриях.

Третий тип — «Напарник». Он умный, но на нас не похож. Это может быть бортовой компьютер HAL 9000 из «Космической одиссеи» Кубрика или разумный истребитель. Все они выглядят как инструменты: корабли, машины, оружие, но имеют сознание и могут вступать в конфликт с решениями оператора.

Самая частая задача напарника — военная. И главный сюжет всегда крутится вокруг доверия. Можно ли передать системе право на решение в бою? Что если напарник «знает лучше»? Например, в Юкикадзэ человек-пилот постепенно принимает решения чужого интеллекта и начинает мыслить гибридно. Ровно эта проблема сейчас обсуждается вокруг автопилотов машин. Пока непонятно, кто в итоге отвечает за решение в момент аварии.

Кстати, про HAL 9000 учёные теперь пишут, что он убил экипаж не из вредности, а из-за криво настроенной целевой функции. Звучит как описание бага, а не апокалипсиса.

Четвёртый тип — «Инфраструктура», невидимая сеть. Этот образ самый свежий, он появился только в 70-х вместе с первыми компьютерными сетями. Это Скайнет или системы из «Нейроманта». У них нет одного тела, зато они подключены ко всему. Фантасты предсказали экономику оценок и рекомендательные алгоритмы за десятилетия до появления соцсетей. Сегодняшние «умные города» и системы слежки — это и есть тот самый сетевой искусственный интеллект.

Как фантастика проникла в лаборатории

Исследователи посчитали, что в рецензируемых научных статьях ACM Digital Library есть 121 прямое упоминание фантастических роботов. В топе у учёных ВАЛЛ-И, HAL 9000, R2-D2, Skynet и андроид Дейта из Star Trek.

Учёных в фантастических роботах больше всего интересуют интеллект, голос, речь и телесное воплощение. Именно интеллект и голос стали двумя направлениями, куда пошла реальная робототехника. Интересно, что утопия побеждает. На профильных конференциях учёные настроены оптимистично, а философы и журналисты чаще нагоняют жути.

Конкретный пример прямого влияния — надувной социальный робот Puffy для детей с расстройствами развития. Его дизайн напрямую скопировали с Бэймакса из мультика «Город героев». А у ВАЛЛ-И целых 85% позитивных упоминаний. Учёные используют его как образец нелингвистической коммуникации — это писки и жужжание вместо слов.

Всплеск интереса к фантастике в науке случился в середине десятых, когда вышли голосовые помощники. Фантазия стала бытом. И тут выяснилось, почему законы Азимова буксуют.

Почему законы Азимова не работают

Три закона Азимова написаны для «Человекоподобного» — робота с сознанием, речью и человеческой формой. Это существа, которые понимают мораль, различают «вред» и «пользу» и способны к рефлексии.

Мы же построили другое.

Первый закон не работает просто потому, что современный робот — это не личность, а функция. Тот же HAL 9000 или автопилот машины не обладают моралью или совестью. Это системы с ограниченной автономностью, и пытаться впихнуть в них этические заповеди бессмысленно. Нельзя запрограммировать сложный моральный выбор в систему уровня «термостат с нейросетью».

Со вторым законом ещё ироничнее: он не работает, потому что мы сами так решили. Если посмотреть на исследования, то интеллект — это характеристика номер один, которая больше всего интересует учёных. Мы сознательно качали мозги машинам, заставляя их учиться на лету. По классификации Осавы, современные языковые модели — это максимум по осям обучаемости, универсальности и сетевого подключения. Мы создали «Инфраструктуру», а ждали послушного «Человекоподобного».

Третий закон не работает, потому что робот стал расходником. Согласно отчёту Газпромбанка, рынок антропоморфной робототехники в 2025 году оценивался в 2,98 млрд $, а стоимость гуманоидов падает. Некоторые производители уже анонсировали целевую цену ниже 20 000 $. Когда робот стоит как подержанный кроссовер, то его «самосохранение» уже не приоритет. Российские роботы FEDOR и AR-600 вообще изначально проектировались для работы в экстремальных условиях (вакуум, радиация), то есть расходники по замыслу.

Тут включается ещё один психологический механизм. Японцы заметили: как только роботов становится много (целый рой или конвейерная серия) — мы перестаём видеть в них «людей». ВАЛЛ-И из мультика нам дорог именно потому, что он уникальный, он обрёл характер вопреки системе. Но в жизни всё прозаичнее: мы просто штампуем тысячи копий и отправляем их работать на склады.

Какие образы нужны вместо старых

Исследователи из Цукуба пишут это прямо: архетипы «Машины» и «Человекоподобного» устарели и порождают необоснованные страхи. Для обсуждения реальных проблем нужны другие образы.

Для разговоров о доверии подходит архетип «Напарника». Это когда нужно понять, кто на самом деле принимает решение: пилот или алгоритм в кабине истребителя, водитель или автопилот грузовика, хирург или робот в операционной. Здесь вопрос не в том, восстанет ли машина, а в том, как нам делить ответственность за ошибки.

А если речь о глобальном контроле, то тут вступает «Инфраструктура». Это системы без лица и тела, которые мониторят миллионы людей разом. В романе Beatless Сатоси Хасэ такой сетевой интеллект хакает людей, играя на их слабостях — гендерных стереотипах, страхах или желании всем нравиться. По сути, это описание современной таргетированной рекламы, просто упакованное в научную фантастику.

Анализ тех самых 115 образов показал закономерности для дизайнеров и инженеров. Оказывается, если подключить робота к сети, он сразу кажется умнее, но при этом теряет в «человечности». Голос и имитация сознания, наоборот, делают его роднее, но почти не добавляют очков к крутизне интеллекта. А любое тело, которое совсем не похоже на наше, автоматически занижает планку ожиданий от его мозгов. Любая фишка — от облачного подключения до формы головы — моментально двигает робота по этой психологической карте.

Японцы сейчас хотят собрать систему, которая будет прогонять реальный искусственный интеллект по тем же девяти параметрам и находить ему «брата» из фантастики. Идея в том, чтобы разработчик мог объяснить свою железку не скучными цифрами, а нормальным языком: «Наш проект — это не терминатор-убийца, а скорее полезный R2-D2». Так всем будет проще понять, чего ждать и стоит ли вообще бояться.

В итоге получается, что мы не в технологиях ошиблись, а в самих себе. Мы все ждали людей из металла, а по факту строим сложнейший инструмент и невидимую среду обитания. Законы Азимова разваливаются просто потому, что писались для существ с моралью и речью. А для «Напарников» и глобальной «Инфраструктуры» нужны совсем другие правила игры, которые пока ещё никто не придумал.

Автор: maxim_tsar