TL;DR: MiniMax представила M2.7 — первую модель серии, которая участвовала в собственной доработке через RL-петли и агентные сценарии. Результаты: 56.22% на SWE-Pro, 1495 ELO на GDPval-AA, 97% adherence при работе с 40+ сложными навыками. Модель уже используется для автономной отладки продакшена и генерации full-stack проектов.

Введение: от обратной связи к самоэволюции

После релиза первых моделей серии M2 команда MiniMax получила огромный объём фидбека от разработчиков и исследователей. Вместо традиционного цикла «собрали данные → дообучили → выкатили апдейт» инженеры пошли дальше: они позволили модели участвовать в собственной эволюции.

M2.7 — это не просто очередная итерация с улучшенными метриками. Это первый эксперимент, в котором модель:

-

строила сложные агентные оркестрации (Agent Teams);

-

управляла динамическим поиском инструментов;

-

обновляла собственную память и параметры RL-обучения;

-

оптимизировала архитектуру харнесса на основе результатов.

Проще говоря: часть работы по улучшению M2.7 выполнила… сама M2.7.

Архитектура самоэволюции: как модель учится улучшать себя

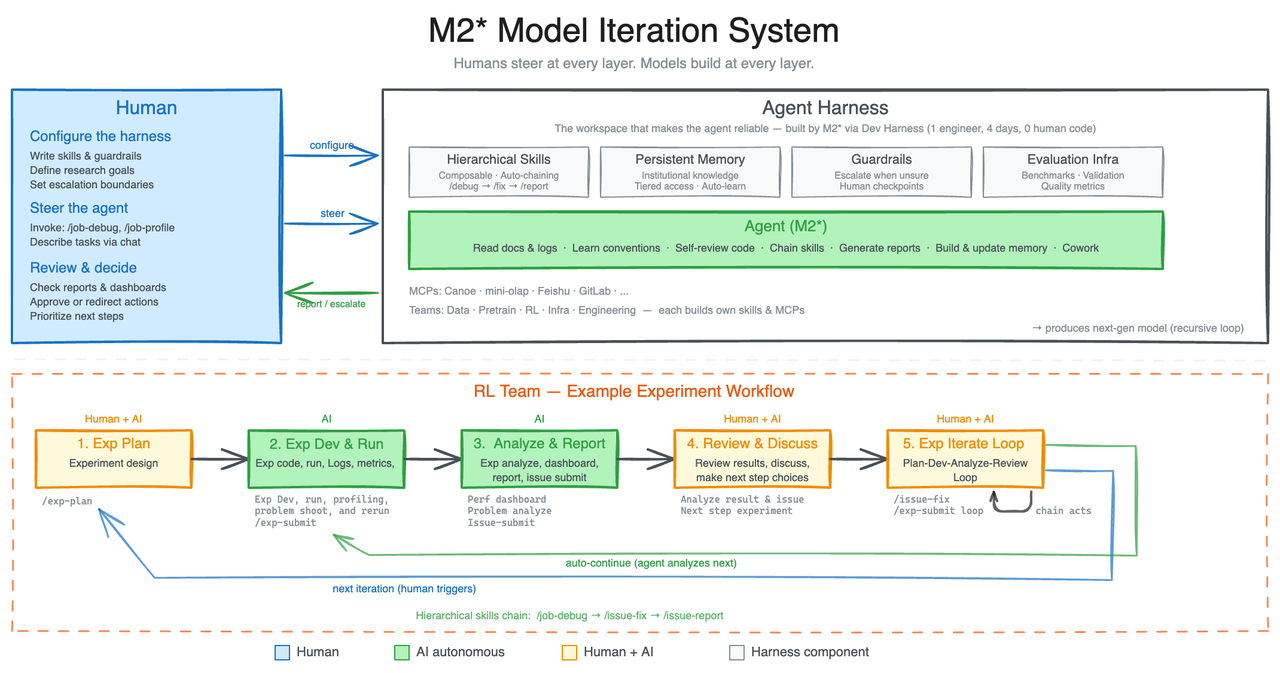

Исследовательский агент как «ко-пилот» для ML-инженера

Внутренний workflow MiniMax построен вокруг исследовательского агента, который взаимодействует с разными проектными группами. Система покрывает:

-

пайплайны данных;

-

тренировочные окружения;

-

инфраструктуру оценки;

-

кросс-командную коллаборацию;

-

персистентную память.

Пример RL-сценария:

-

Исследователь формулирует гипотезу эксперимента.

-

Агент проводит literature review, отслеживает спецификации, подготавливает данные.

-

Запускает эксперимент, мониторит метрики в реальном времени.

-

При аномалиях — автоматически читает логи, предлагает фиксы, создаёт MR, запускает smoke-тесты.

-

Человек подключается только для критических решений.

По оценкам команды, M2.7 берёт на себя 30–50% рутинных операций в этом цикле, ускоряя итерации и снижая time-to-discovery.

Рекурсивная оптимизация харнесса

Ключевое наблюдение: способность модели рекурсивно улучшать собственный инструментарий не менее важна, чем качество генерации кода.

Внутренний харнесс M2.7:

-

автономно собирает фидбек;

-

формирует оценочные сеты для внутренних задач;

-

итеративно дорабатывает архитектуру, реализацию навыков (MCP) и механизмы памяти.

Кейс: оптимизация программирования на внутреннем скаффолде.

-

Модель запустила цикл «анализ фейлов → план изменений → правка кода → оценка → сравнение → решение» более 100 раз.

-

Нашла оптимальные комбинации гиперпараметров (temperature, frequency/presence penalty).

-

Внедрила авто-поиск паттернов багов в других файлах после фикса.

-

Добавила детекцию зацикливаний в агентный луп.

Результат: +30% к производительности на внутренних бенчмарках.

Эксперимент в low-resource сценариях: M2.7 на MLE Bench Lite

Для проверки гипотезы о полной автономности провели тест на 22 соревнованиях по машинному обучению (MLE Bench Lite от OpenAI), выполняемых на одном GPU A30.

Архитектура агента:

-

краткосрочная память (markdown-логи итераций);

-

самокритика после каждого раунда;

-

цепочка самооптимизации на основе накопленного опыта.

Результаты после 24 часов эволюции (3 запуска):

|

Метрика |

Значение |

|---|---|

|

Лучшие награды |

9🥇 5🥈 1🥉 |

|

Средняя доля наград |

66.6% |

|

Сравнение с лидерами |

≈ Gemini-3.1 (66.6%), чуть ниже GPT-5.4 (71.2%) и Opus-4.6 (75.7%) |

|

|

Это показывает, что даже в ограниченных ресурсах модель способна к содержательной самооптимизации.

Программная инженерия: от генерации кода к пониманию продакшена

Отладка в реальном времени: кейс production debugging

M2.7 демонстрирует не просто генерацию кода, а системное мышление:

Алерт в продакшене

↓

Корреляция метрик мониторинга + таймлайнов деплоя

↓

Статанализ трейсов → гипотезы о root cause

↓

Авто-подключение к БД для верификации

↓

Поиск отсутствующего миграционного файла индекса

↓

Предложение non-blocking CREATE INDEX для быстрого фикса

↓

Формирование MR с объяснением и тестами

Практический эффект: время восстановления инцидентов сокращается до менее 3 минут против часов ручной отладки.

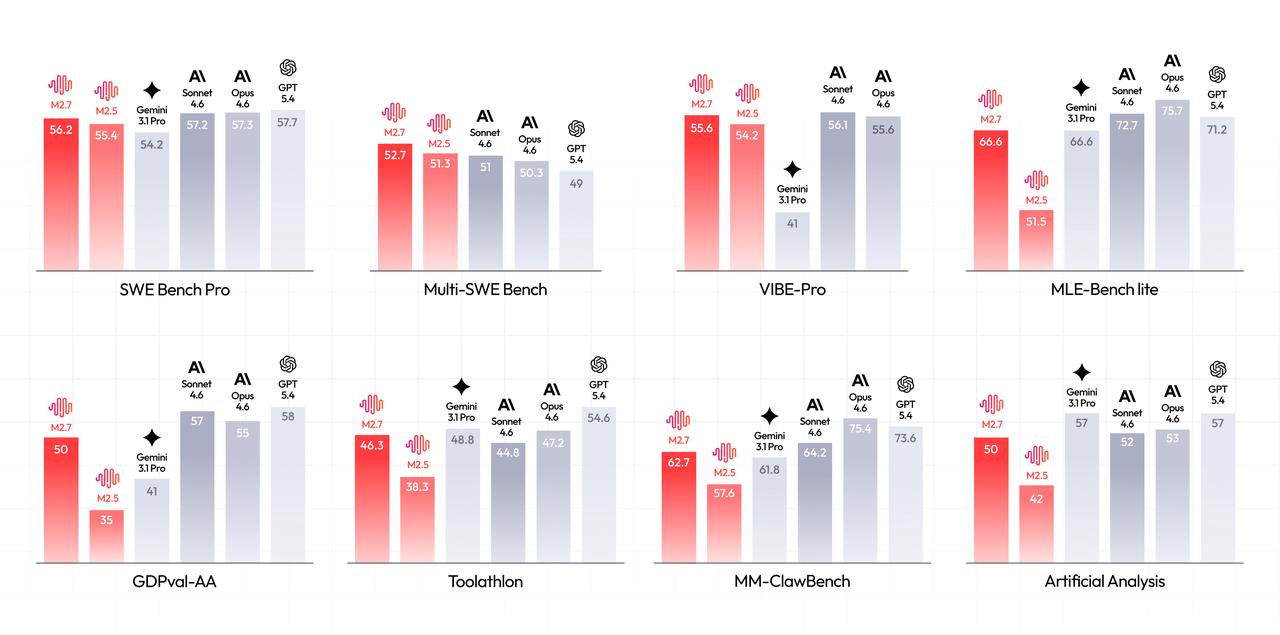

Бенчмарки: цифры, которые имеют значение

|

Бенчмарк |

Результат M2.7 |

Комментарий |

|---|---|---|

|

SWE-Pro |

56.22% |

На уровне GPT-5.3-Codex, близко к Opus |

|

SWE Multilingual |

76.5% |

Лидерство в мультиязычных сценариях |

|

Multi SWE Bench |

52.7% |

Устойчивость к реальным инженерным задачам |

|

VIBE-Pro (repo-level) |

55.6% |

Полноценная доставка проектов «под ключ» |

|

Terminal Bench 2 |

57.0% |

Глубокое понимание системной архитектуры |

|

NL2Repo |

39.8% |

Работа с legacy-кодом и документацией |

Agent Teams: мульти-агентная коллаборация как нативная фича

Важный сдвиг: M2.7 реализует Agent Teams не через промпты, а как внутреннюю способность:

-

чёткое разграничение ролей;

-

адверсариальная проверка логики;

-

соблюдение протоколов взаимодействия;

-

автономные решения в сложных state-машинах.

Это открывает путь к созданию виртуальных «мини-команд» для прототипирования продуктов — от идеи до MVP.

Профессиональные сценарии: офис, финансы, аналитика

Два столпа эффективности в office-задачах

-

Экспертиза + доставка результатаНа GDPval-AA (45 моделей) M2.7 набрала 1495 ELO — лучший результат среди открытых моделей, уступая только закрытым лидерам (Opus 4.6, Sonnet 4.6, GPT-5.4).

-

Работа в сложных окружениях

-

Toolathon: 46.3% accuracy (топ-уровень глобально).

-

MM Claw: 97% adherence при 40+ навыках >2000 токенов каждый.

-

Кейс: финансовый анализ компании (на примере TSMC)

Задача:На основе годового отчёта, транскриптов earnings call и внешних исследований:

-

спроектировать assumptions;

-

построить модель прогнозирования выручки;

-

сгенерировать PPT-презентацию и Word-отчёт по шаблонам.

Результат:M2.7 действует как junior-аналитик: читает источники, кросс-валидирует данные, строит модель, оформляет deliverables. По фидбеку практиков — вывод пригоден как черновик для дальнейшей работы.

📎 Примеры артефактов:

Развлечения и интерактив: от продуктивности к персонажам

Почему эмоциональный интеллект важен даже в agent-сценариях

С ростом популярности персональных агентов (OpenClaw и аналоги) пользователи начали ожидать не только эффективности, но и консистентности персонажа, эмпатии, вовлекающего диалога.

M2.7 усиливает именно эти аспекты:

-

стабильное удержание роли в длительных диалогах;

-

адаптация стиля под контекст;

-

проактивное взаимодействие с окружением.

OpenRoom: демо новой парадигмы взаимодействия

Команда представила OpenRoom — интерактивную среду, где:

-

персонажи «живут» в веб-интерфейсе, а не в текстовом потоке;

-

диалог триггерит визуальные изменения и сценарные события;

-

агент сам инициирует действия в окружении.

Это не просто чат-бот, а прототип интерактивного нарратива с агентной логикой.

🔗 Ресурсы:

-

Репозиторий: github.com/MiniMax-AI/OpenRoom

-

Демо: openroom.ai(Значительная часть кода демо написана… самой моделью)

Доступность и интеграция

M2.7 уже доступна:

-

🤖 MiniMax Agent: agent.minimax.io

-

⚙️ API Platform: platform.minimax.io

-

💻 Coding Plan: подписка для разработчиков

Заключение: что это значит для разработчиков

-

Самоэволюция — не хайп, а рабочий инструмент. Возможность модели оптимизировать собственный харнесс сокращает цикл R&D и открывает путь к автономным исследовательским агентам.

-

Инженерное мышление > генерация кода. Успех M2.7 в production-debugging и system-level бенчмарках показывает: ценность смещается от «написать функцию» к «понять и починить систему».

-

Мульти-агентность становится нативной. Если раньше Agent Teams требовали сложной оркестрации «снаружи», то теперь модель сама умеет держать роли и протоколы — это упрощает архитектуру приложений.

-

Персонажи и интерактив — следующий фронтир. Для продуктов, где важен пользовательский опыт (геймификация, обучение, поддержка), консистентность персонажа и эмоциональный интеллект становятся конкурентным преимуществом.

Статья подготовлена на основе официального анонса MiniMax. Бенчмарки и примеры приведены в соответствии с данными разработчика.

Автор: Smartor