Каждый запрос к большой языковой модели — это не «магия в облаке», а тысячи графических процессоров, системы охлаждения, трансформаторные подстанции и водяные контуры. Пока мы генерим мемы, обсуждаем скорость ответов или количество пальцев на картинках, растет потребление воды и энергии. Разбираемся, о каких цифрах идет речь — и что с этим делать.

Сам по себе искусственный интеллект — безусловно, одно из самых полезных технологических достижений последних лет. Он помогает автоматизировать рутинные задачи, ускоряет исследования, упрощает доступ к знаниям и меняет работу в самых разных отраслях — от разработки ПО до медицины. В этой статье речь не о том, чтобы отказаться от ИИ или объявить его новой экологической угрозой. Но, как и любая крупная цифровая инфраструктура, будь то облачные сервисы или стриминговые платформы, системы искусственного интеллекта опираются на вполне материальную основу. Чтобы обучать и обслуживать современные модели, нужны центры обработки данных, вычислительные кластеры и сложные системы охлаждения. Все это требует электроэнергии и воды — и по мере роста популярности ИИ его экологический след становится все заметнее.

Ресурсный след на этапе обучения моделей

Начнем с дисклеймера: самая цитируемая и надежная статистика по затратам на обучение ИИ сегодня относится к GPT-3 (2020). Для этой модели разработчики опубликовали достаточно технических параметров, в частности размер модели (175 млрд параметров), структуру и масштаб обучающего датасета (около 500 млрд токенов). Эти данные позволили независимым экспертам оценить объем вычислений и на их основе рассчитать энергопотребление и углеродный след обучения. Для более новых моделей такой уровень прозрачности уже редкость: компании просто отказываются раскрывать какую-либо информацию. Таким образом, GPT-3 остается одной из немногих крупных языковых моделей, ресурсный след которой можно оценить относительно обоснованно.

Итак, согласно опубликованным оценкам, обучение GPT-3 потребовало около 1 287 МВт⋅ч электроэнергии. Это примерно столько же энергии, сколько тратит жилой квартал за год. Современные модели уровня GPT-4 и выше значительно крупнее предшественниц, поэтому речь уже может идти о десятках тысяч МВт⋅ч.

Энергопотребление напрямую связано и с углеродным следом. Для GPT-3 он оценивается примерно в 552 тонны CO2-эквивалента. Это равноценно выбросам от годовой эксплуатации 100+ автомобилей.

Еще один менее очевидный ресурс — вода. Она используется для охлаждения серверных стоек в дата-центрах. По оценкам исследователей, обучение GPT-3 потребовало около 700 000 литров пресной воды.

Ресурсный след на этапе эксплуатации

Если обучение — это редкий «рывок» в потреблении ресурсов, то инференс — постоянная фоновая нагрузка.

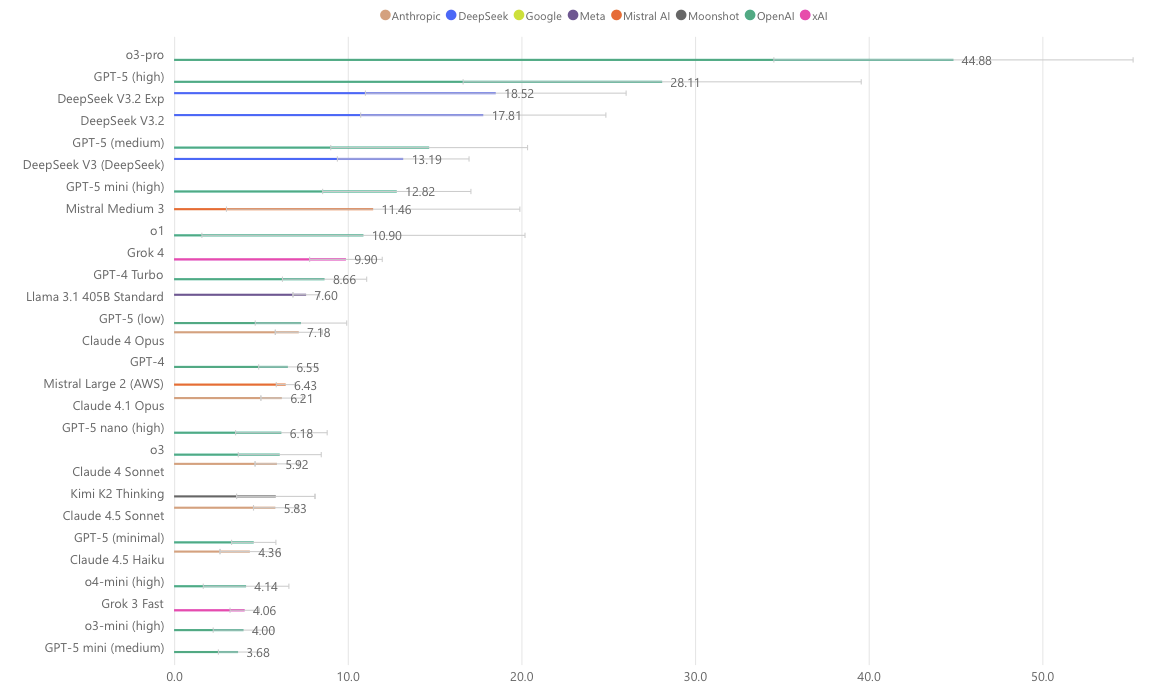

Один запрос к чат-боту может потреблять от 0,5 до 45 Вт⋅ч энергии в зависимости от используемой модели и длины ответа (дашборд с детальными показателями можно рассмотреть по ссылке). Сам по себе один запрос практически незаметен. Но когда речь идет о миллиардах обращений к ИИ ежедневно, суммарное потребление быстро превращается в сотни МВт-ч.

На уровне всей отрасли эффект еще очевиднее. По прогнозу Международного энергетического агентства, в 2026 году энергопотребление дата-центров может приблизиться к 800 ТВт⋅ч. Это выше годового потребления электроэнергии многих стран среднего размера.

На этапе эксплуатации проявляется и водный след. Исследование 2023 года показало, что 20 запросов к языковой модели могут косвенно требовать около 0,5 литра воды. Именно из таких оценок в социальных сетях рождаются вирусные формулировки вроде «каждый запрос = стакан воды». Это, конечно, упрощение, но серьезный водный след у массового использования ИИ действительно существует. Особенно остро эта проблема чувствуется в регионах с дефицитом воды, например в Чили, где новые дата-центры растут как грибы на фоне многолетней засухи.

Что могут сделать ИТ-компании

На уровне инфраструктуры многое зависит от решений самих технологических компаний. Во-первых, это выбор источников энергии и дата-центров. Размещение вычислительных мощностей в регионах с высокой долей возобновляемой энергетики позволяет заметно снизить углеродный след ИИ. Не менее важна и эффективность самих дата-центров — современные площадки стремятся к показателю PUE (power usage effectiveness) около 1,1–1,2, что означает минимальные потери энергии на охлаждение и вспомогательные системы.

Во-вторых, все больше внимания уделяется системам охлаждения. Некоторые компании переходят на замкнутые водные циклы или альтернативные методы охлаждения, чтобы снизить расход пресной воды. Также важен выбор географии: холодный климат позволяет охлаждать серверы естественным образом и уменьшает нагрузку на инфраструктуру.

Наконец, устойчивость может быть частью корпоративных KPI. Некоторые зарубежные ИТ-гиганты, такие как Google, включают энергоэффективность в ESG-метрики и публичные отчеты. Это помогает сделать влияние цифровой инфраструктуры более прозрачным и, по крайней мере в теории, стимулирует корпорации искать более эффективные архитектурные решения.

Что могут сделать айтишники

Значительная часть оптимизации лежит и на уровне архитектуры моделей и приложений.

Вот что можно делать:

-

Pruning (обрезка модели) — это удаление параметров, которые почти не влияют на результат. Современные модели содержат миллиарды весов, но часть из них можно убрать без заметной потери качества. В результате модель становится легче и требует меньше вычислений при инференсе.

-

Quantization (квантизация) уменьшает точность вычислений. Если вместо 32-битной точности использовать 16-, 8- или даже 4-битные представления чисел, модель будет работать быстрее и потреблять меньше памяти и энергии.

-

Distillation (дистилляция) позволяет обучить компактную модель на ответах большой. Огромная LLM используется как «учитель», а в продакшене работает более легкая модель, оптимизированная под конкретную задачу. Во многих прикладных задачах вообще не требуется гигантская универсальная модель. Например, для чат-бота поддержки или обработки корпоративных документов достаточно моделей-малышек.

-

Помогают и архитектурные решения. Если система отвечает на вопросы по базе знаний, эффективнее использовать подход retrieval-augmented generation (RAG), где модель получает только релевантные данные, а не пытается «вспомнить все». Кэширование ответов позволяет не генерировать один и тот же результат повторно, а batch-инференс (пакетная обработка запросов) снижает нагрузку на вычислительные ресурсы.

-

Наконец, важно управление продуктовой логикой. Ограничение длины промптов и ответов, контроль числа автоматических перегенераций и запрет на генерацию «красивых, но бессмысленных» текстов там, где достаточно шаблона, могут существенно сократить нагрузку на систему.

Уходя гасите свет, или Оптимизация на уровне пользователя

Помимо инфраструктуры и архитектуры моделей, есть еще один фактор — пользовательские привычки. Если вы хотите сэкономить ресурсы на работу модели, в начало диалога можно добавить такой блок с ограничениями для ИИ:

«Отвечай кратко и по делу. Без комплиментов, извинений, повторов и вводных фраз. Не предлагай дополнительные действия, если я прямо об этом не прошу. Ограничь ответ 5–7 предложениями».

Чтобы не писать такие инструкции в каждом новом диалоге, их можно задать один раз в настройках модели как постоянное пользовательское правило. У многих сервисов есть механизм системных промптов, которые автоматически применяются ко всем новым чатам.

Это работает потому, что энергозатраты инференса во многом зависят от длины текста. Чем больше токенов модель генерирует, тем больше вычислений выполняют графические процессоры: каждый новый токен проходит через все слои нейросети.

Если ответ в 800 слов заменить ответом в 120 слов, энергозатраты будут меньше. На уровне одного пользователя экономия будет практически незаметной — доли Вт⋅ч. Но если такие ограничения зададут миллионы пользователей, то суммарное энергопотребление действительно снизится. По сути, мы говорим про культуру рационального использования, аналогичную тому, чтобы выключать свет при выходе из комнаты.

Что еще можно сделать: меньше «пустых» запросов

В англоязычных обсуждениях все чаще встречается термин casual prompting — условно его можно перевести как «бездумные запросы к ИИ» или «запросы от скуки». Это ситуации, когда модель используют просто ради развлечения или мгновенного ответа на любой бытовой вопрос.

Именно к сокращению такого использования недавно призвали чилийские экологические активисты — довольно необычным способом. 31 января 2026 года около 50 жителей города Киликура на один день запустили сервис Quili.AI, «чат-бот», работающий, так сказать, на человеческой энергии.

Киликура находится в бассейне реки Майпо — источника воды для 7 миллионов жителей, включая столицу Сантьяго. При этом именно в этом регионе сосредоточено большое количество дата-центров, некоторые из них используют более миллиона литров воды в день для охлаждения серверов.

В рамках акции добровольцы в течение 12 часов вручную отвечали на запросы пользователей со всего мира — всего их оказалось более 25 000. Если человек просил сгенерировать изображение, кто-то из участников брал карандаш и рисовал его вручную. Так, по запросу «ленивец, играющий в снегу» через несколько минут появился рисунок мультяшного ленивца, стоящего в сугробе и готовящегося бросить снежок.

Идея проекта была не в том, чтобы доказать, что люди могут заменить ИИ. Напротив, организаторы подчеркивают: искусственный интеллект — мощный и полезный инструмент. Но акция должна была напомнить о другом: не каждый вопрос требует мгновенного ответа алгоритма. Иногда достаточно человеческого знания, опыта или честного «не знаю». Именно в этом и состоит главный посыл Quili.AI: если сократить бездумные запросы к ИИ, это не остановит развитие технологий, но может снизить нагрузку на инфраструктуру, которая за ними стоит.

Автор: IBS_habrablog