БЯМы настолько преисполнились в познании наших письменных паттернов, что отличить их от человеческой писанины уже фактически невозможно. Разбираемся как до такого дошло, чем грозит и что делать.

Теория разума или почему LLM такая коварная?

Карикатура на академическую бесчестность: “Обещаю, эти курсачи пройдут проверку на ИИ”

Изначальная суть Большой Языковой Модели проста. Когда она сочиняет текст, то использует алгоритмы, например на основе цепей Маркова, о котором мы кстати писали, вклинивания в последовательность лексем те слова, что лучше всего подходят с точки зрения математической вероятности.

Это выглядит примерно вот так:

-

wt — искомое следующее слово.

-

wt−1,…,wt−kwt−1,…,wt−k — контекстное окно из kk предыдущих слов (предыстория).

-

PP — вероятность того, что после данной последовательности появится именно это слово.

Но разум не может оставаться разумом, “забив” на развитие. Со временем архитектура БЯМов все больше отказывалась от голой статистики частотности в пользу коварных ноухау, очеловечивающих текст как по волшебству.

Итак, главные обвиняемые:

-

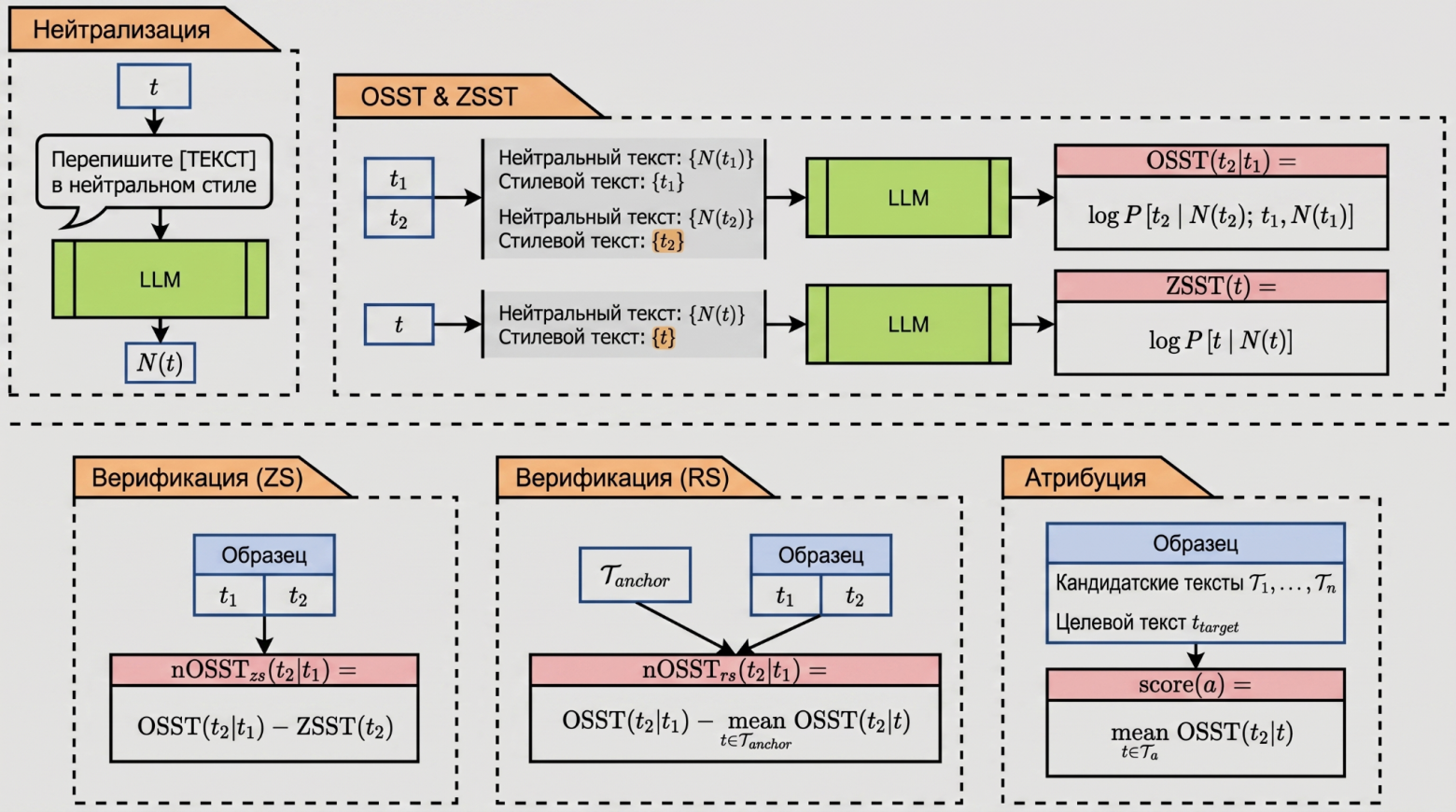

Стилевой перенос

Он же style transfer. Его задача изучить и перевести в математическое представление так называемый идиостиль — индивидуальные особенности речи, свойственные конкретному автору, дискурсу или, скажем, региональному диалекту.

С помощью декомпозиции он выделяет смысловую начинку текста (семантическое ядро), активирует стилевой контрольный код, чтобы включать заранее изученные особенности копируемой речи и “полирует” процесс сверху семантическим контролем, дабы смысл текста не потерялся.

-

Итеративная настройка

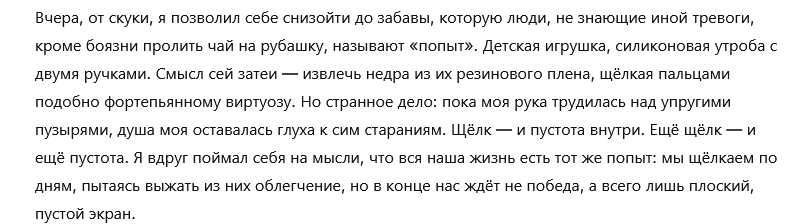

Так же известная как fine-tuning. Во время обучения, этот компонент потребляет кучу сэмплов реальных человеческих разговоров, что позволяет ему, как Джозефу Пристли, внимательно под микроскопом изучить речевые гиперпараметры: температуру слов, топовое вероятностное распределение, эмоциональные модуляции и другое подобное. В результате LLM учится более живой речи. При чем глаголить она может как высоким эпистолярным штилем в духе классиков Золотого века, так и подъездной лексикой, которой изъясняются соседи во время перекура на крыльце.

-

Инференс

Метод Inference опирается на контекст и свою способность удерживать “долгую память” на время диалога с живым человеком. Это позволяет адаптировать написанное под конкретного собеседника: от условного академика до любителя футбольно-пивной тематики. (Даже если это один и тот же человек).

-

Обучение с подкреплением на основе отзывов людей (RLHF)

А в этом подходе люди способствуют скорому триумфу роботов обучению ЛЛМ с помощью фидбэка. Ответы модели ранжируются живыми собеседниками и затем постепенно “притираются” к их речевому модусу операнди: логика, нормы вежливости, идиоматика и вокабуляр.

Это, конечно, не исчерпывающий список механизмов, что привели БЯМы к успеху. Но в общих чертах понять как они копируют нас можно.

Последний детектор устал

В 2025 проводилось занятное исследование, которое столкнуло лоб в лоб детекторы с человеческой способностью опознавать ИИ-тексты. Если вкратце, то люди и умные алгоритмы шли ноздря в ноздрю с коэффициентом точности плюс-минус 57%. На математическом языке это называется “случайная вероятность”. С таким же успехом можно подбрасывать монетку или гадать на ромашке: “ГПТ, не ГПТ?”

И это не единичный сигнал бедствия. Похожий пессимистичный сценарий был предсказан в другом исследовании за 2023 год, только там освещалась рекурсивная атака с помощью парафразирования — это когда условно-ГПТшный текст прогоняется через БЯМы еще и еще, пока статистические сигнатуры LLM не сотрутся окончательно: перплексия, шаблонные реплики и прочая классика ИИшного жанра.

Ложно-позитивные результаты — это еще один дефект детекторов. В сети можно найти массу жалоб о том как тот же ZeroGPT ошибочно определяет написанное от руки как синтетику и это совсем не фича, а возмутительнейший баг.

В 2023 в Штатах огласку получил случай, когда детектор Turnitin выдал вердикт, что написанное “на пятерку” старшеклассницей эссе о природе социализма было на 98% сгенерированным. Однако независимый эксперимент, в котором приняла участие и пострадавшая отличница, показал, что Turnitin способен верно определить только половину AI-текстов.

Источник: washingtonpost.com.

То, что три года назад казалось недоразумением сегодня стало неизбежностью: детекторы откровенно не справляются со своей работой. И со временем, они не смогут противостоять БЯМ в принципе. OpenAI это, кстати, понимали и видимо по этому закрыли свой собственный инструмент AI Classifier, который смог разоблачить всего лишь 26% из написанного ИИ-текста.

Ну а что, он место будет в гипер-кластере задарма занимать?

Чем это грозит и что делать?

Вообще, проблема серьезная. С одной стороны, можно ожидать волну академической бесчестности (academic dishonesty) — дипломов, диссеров и докторских, которые были написаны умными моделями, а не их глупыми пользователями.

Нужно ли говорить, что авторы таких работ могут быть “ни в зуб ногой” по своей теме? И что эти работы потенциально могут уплыть в аналоги ВАКа по всему миру, становясь референтным материалом: на них будут ссылаться, их будут цитировать и считать за авторитетный источник, который в итоге окажется просто-напросто одной большой галлюцинацией БЯМа.

С другой стороны, если детекторы также останутся слабыми, они рискуют разрушить чужую репутацию и карьеру с помощью одного-единственного ложно-положительного результата: когда речь идет о защите серьезной работы или присвоения очередного звания, обвинения в бесчестности вполне способны оставить жирное пятно на чьем угодно имени.

А за пределами научного мира, злоупотребление БЯМ может грозить повальной дезинформацией, а еще их легко использовать для социальной инженерии с целью мошенничества.

Так что же делать?

-

Стоп академический слоп!

Возможно стоит пересмотреть требования к написанию научных работ. Все, кто этим занимался, в курсе каким ветхозаветным количеством воды нужно затопить часто простую и ясную, как полдень в Андалусии, суть исследования.

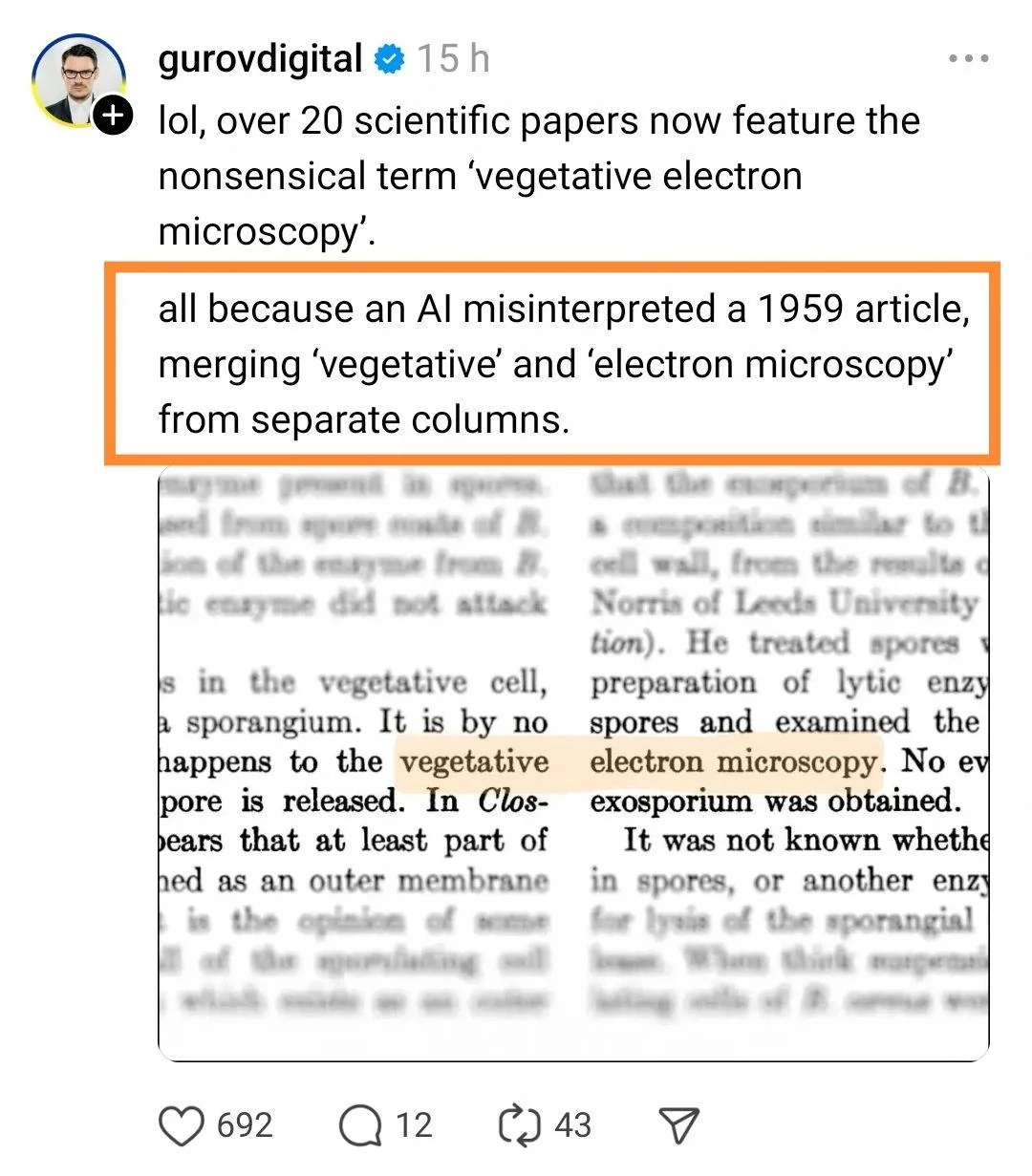

Содержание должно превалировать над требуемым объемом — это нужно для того, чтобы ответственными лицами работы проверялись быстрее и веселее. Ведь даже очень умные БЯМы могут допустить постыдные ляпсусы как это было с недавним случаем с “vegetative electron microscopy”.

Вкратце, в куче научных работ стала появляться странная фраза, дословно означающая “вегетативно-электронная микроскопия”. Как оказалось, это просто ошибка из оцифрованного исследования: ИИ неправильно сосканировал слова из разных колонок, посчитав их единой фразой. В итоге она закрепилась в тренировочных датасетах, а затем перекочевала во множество “научных” работ. Которые никто из “учоных” не удосужился хотя бы вычитать перед публикацией.

-

Долой дезу и скамеров!

Единственный способ победить дезу — это проводить дотошный фактчекинг того, что мы видим и слышим. Сейчас есть платформы, приложения и волонтерские группы, которые усиленно борются с ложью. За что им полагается троекратное “ура”.

Касательно аферистов в онлайне — здесь не все так просто. Но есть один пока еще работающий способ: даже гладко стелящий чатбот имеет особенность отвечать неестественно быстро. Также он демонстрирует все же очень вылизанные синтаксис и пунктуацию, что в переписке живых людей наблюдается редко. Ну и конечно самый лучший подход — “роток га замок”, то есть в принципе не разговаривать с кем попало в Сети.

Все на БЯМ

Люди страстно мечтали научить животных и предметы говорить на нашем языке. Наверно с того момента когда древние люди долины Инда открыли способность ожереловых попугаев передразнивать нас.

Сейчас нас умеют передразнивать машины. И делают это настолько хорошо, что мы уже не верим своим ушам, глазам и мозгам. Но верить хочется в то, что наша смекалка поможет выкрутиться и здесь.

Автор: DimaIam