Мы в Beeline Cloud собрали для вас подборку открытых руководств и обучающих материалов по теме эмбеддингов: что собой представляют подходы TF-IDF и Word2vec, какие нюансы стоит учитывать, используя косинусное сходство для семантического поиска, а также чем различаются алгоритмы векторизации — показательно на схемах.

Собаки —> книги

Питер Сарджент, разработчик открытого программного обеспечения и директор по ИИ в международной консалтинговой компании, опубликовал руководство по векторным представлениям для не знакомых с программированием «любителей животных». На примере задачи, в которой необходимо классифицировать собак, он показывает, что такое эмбеддинги и как с ними работать.

Автор, очевидно, считает, что лучший учитель — это практика, поэтому без лишней теории показывает, как построить вектор для бульдога, немецкого дога, ши-тцу, бордер-колли и бигля; в качестве параметров он взял размер и уровень интеллекта разных пород. Степень подобия Сарджент рассчитал, используя манхэттенское расстояние, чем познакомил читателей с основами векторной математики.

Во второй части материала автор от условных собак в вакууме переходит к более конкретному и практическому примеру — категоризации книг на английском языке с учетом количества слов и частоты их появления в каждом томе. В этом кейсе специалист рассказывает про мешок слов и показывает, как отфильтровывать «полезные» лексемы от нерелевантного «шума» (в частности, артиклей и предлогов). Далее Сарджент последовательно переходит к обсуждению методов векторизации TF-IDF и Word2vec. К примеру, показывает, как Word2vec позволяет получить векторные представления, отражающие семантику слов, а также как рекуррентные нейронные сети (RNN) дают возможность учитывать точную последовательность эмбеддингов.

Наглядность — признак мастерства

Бывший мейнтейнер фреймворка CAMEL и куратор awesome-подборки со сценариями OpenClaw Хесам Шейх опубликовал «Введение в эмбеддинги». Материал ориентирован на начинающих погружение в тему векторных представлений, и интересен тем, как преподносит основы: от традиционных подходов на базе TF-IDF и Word2vec до трансформеров. Так, один из примеров посвящен применению TF-IDF для работы с открытым датасетом, содержащим тексты Шекспира. Специалист разбил набор данных на десять фрагментов, построил векторные представления для слов и использовал метод главных компонент (PCA), чтобы отобразить их на графике. Большая часть слов оказалась сконцентрирована в одной области — как пишет автор, так получилось потому, что эмбеддинги по методу TF-IDF не отражают семантических связей между словами. Несмотря на определенные недостатки (и возраст подхода), TF-IDF до сих пор используют в задачах информационного поиска, извлечения ключевых слов и базового анализа текста.

В заключительной части материала автор показывает, как работать с векторными представлениями в современных БЯМ, а также предлагает пошаговый практикум по векторам с моделью DeepSeek-R1-Distill-Qwen-1.5B — от разбивки предложений на токены до преобразования их в эмбеддинги и поиска похожих представлений для конкретного слова.

Руководство содержит множество интерактивных визуализаций, блок-схем и облаков тегов, упрощающих восприятие материала — даже на КДПВ представлен интерактивный граф, который можно «покрутить» [он отражает взаимосвязи между пятьюдесятью словами и ближайшими токенами в модели DeepSeek-R1-Distill-Qwen-1.5B]. Некоторые иллюстрации, вполне вероятно, были отрисованы Хесамом вручную. Ну а все примеры кода продублированы в репозитории на GitHub.

Если вам близок стиль подачи автора, стоит обратить внимание и на другие его образовательные проекты. Помимо курируемой awesome-подборки он также ведет репозиторий со статьями и заметками по различным направлениям машинного обучения. Среди материалов — разбор графовых нейронных сетей и публикация, посвященная нюансам обработки естественного языка.

Эмбеддинги от А до Я

Вики Бойкис — инженер машинного обучения, которая проектировала инфраструктуру для интеллектуальных моделей в Mozilla.ai, писала алгоритмы для систем рекомендаций в компании Automattic, развивающей WordPress, и в одном из крупнейших телекомов — Comcast. Долгое время работая с эмбеддингами, структурами данных и моделями глубокого обучения, Вики отметила, что многие публикации или чересчур поверхностны, или, наоборот, написаны академическим языком и чрезмерно усложнены.

В итоге она захотела написать собственное руководство «от А до Я» для начинающих, но слегка увлеклась и, по сути, написала полноценную книгу «Что такое эмбеддинги», которую выложила в открытый доступ под лицензией CC BY-SA 3.0. Также материал был опубликован на GitHub, где набрал больше 1,1 тыс. звезд. По словам автора, руководство рассчитано на широкую аудиторию — от специалистов по машинному обучению до разработчиков, продакт-менеджеров, исследователей и студентов.

Первый и второй блоки книги — это общее введение, посвященное системам рекомендаций и векторным представлениям, для которого не нужны особые навыки в сфере МО или программирования. Но для последующих разделов уже потребуются знания линейной алгебры и Python. Например, третий блок посвящен классическим методам векторизации данных: One-Hot-кодированию, подходам векторного представления TF-IDF, Word2vec, а также латентно-семантическому анализу и латентному размещению Дирихле (LDA). Последний раздел — практический, в нем Бойкис рассматривает, как описанные в книге методы применяются в «боевых условиях», на примере известных платформ вроде Pinterest или Google Store.

Если после прочтения книги вы захотите глубже погрузиться в тему машинного обучения и эмбеддингов, то автор подготовила подборку персональных рекомендаций для дополнительного чтения. Статьи про устройство векторов и работу с ними также можно найти и в блоге Бойкис, к примеру, в одной из публикаций она рассказывает, почему и как менялись подходы к построению эмбеддингов. А ее пет-проект Viberary, система семантического поиска книг по настроению, появился как дополнение к руководству — в посте Бойкис объясняет, как именно разрабатывала инструмент (особенно подробно она разбирает реализацию векторных представлений).

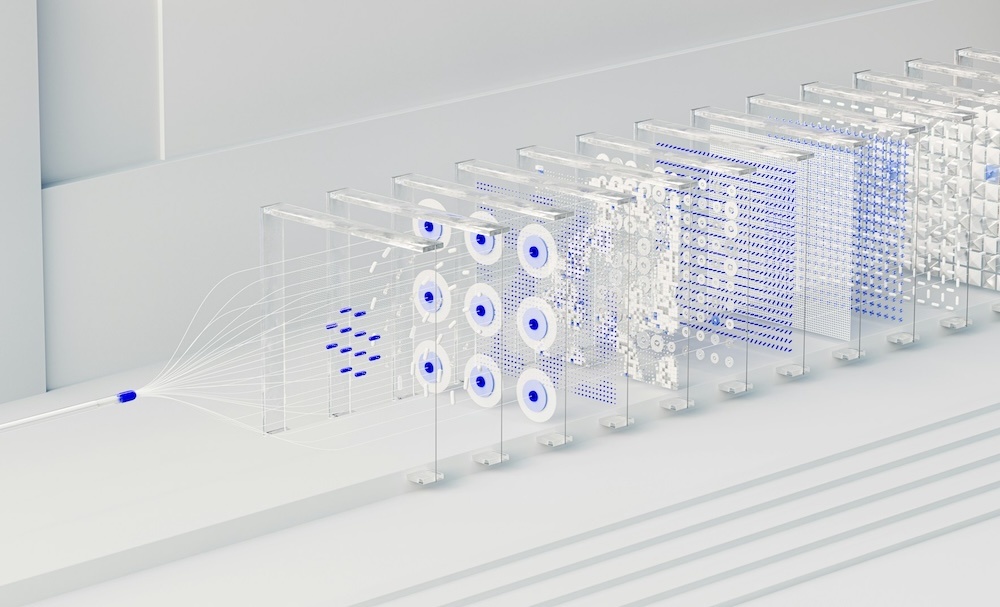

Разница налицо — векторные методы в графиках

В 2025 году Памела Фокс, Python-разработчик из Microsoft, выступала на профильной конференции. Темой ее доклада, для которого она подготовила мегаслайд с графиками и иллюстрациями, была визуализация векторных представлений. Позже Фокс решила дополнить материалы выступления и опубликовала на его основе руководство «Наглядное введение в эмбеддинги». В нем она рассматривает различные модели для преобразования текста в числовые векторы — привычную Word2vec, а также text-embedding-ada-002 с text-embedding-3-small, представленные OpenAI в 2022 и 2024 годах.

Ключевая особенность материала — наглядность и минимум текста. Возможности каждого метода описаны небольшими абзацами, а вся необходимая информация отображена на схемах. К примеру, на диаграмме для Word2vec показаны 300 измерений слова «королева». В таком духе Фокс сопоставляет подходы между собой, показывает отличия в метриках. В конце материала речь идет о продвинутых техниках работы с эмбеддингами. Например, как устроен метод векторного поиска и зачем нужны алгоритмы ANN, HNSW, DiskANN. Еще Фокс говорит о способах векторного сжатия, скалярной и двоичной квантизации и снижении размерности в моделях с поддержкой MRL.

В прошлом году работа Памелы привлекла внимание резидентов Hacker News — тематический тред на площадке набрал больше ста восьмидесяти плюсов и десятки комментариев. В целом пользователи высоко оценили наглядную подачу, отметив, что разбор сложных концепций векторизации нередко перегружают теорией и трудными для восприятия формулами, тогда как визуализации и диаграммы делают рассказ доступнее. Например, разработчик Танель Подер поделился своим экспериментом, в котором показал, как модель компьютерного зрения реагирует на одно и то же изображение кота, повернутое под разными углами, построив тепловые карты эмбеддингов для наглядности.

Косинусное сходство: инструкция по применению

В конце 2025 года Петр Мигдал, разработчик открытой Python-библиотеки для ML-визуализации livelossplot и специалист в области науки о данных, опубликовал в личном блоге статью «Не используйте косинусное сходство бездумно». Его ключевой тезис прост: косинусное сходство не стоит воспринимать как универсальный подход. По мнению эксперта, одна из главных проблем заключается в самой интерпретации понятия «сходство», которая может заметно меняться в зависимости от контекста. Как иронично замечает Мигдал, в США Word2vec вполне может посчитать «эспрессо» и «капучино» почти идентичными сущностями, хотя в Италии с таким утверждением многие бы поспорили.

Поэтому автор статьи предлагает альтернативные подходы по оценке схожести слов и понятий. Один из них — прямой запрос к LLM для сопоставления двух записей. Например, выбрав достаточно производительную модель, можно обратиться к ней с промптом: «Является ли {sentence_a} правдоподобным ответом на {sentence_b}?». По его словам, такой метод годится для RAG, поскольку отражает необходимость выбирать не только похожие документы, но и релевантные.

Еще немного по теме

Мы также собрали несколько профильных материалов на русском языке:

-

Что такое эмбеддинги и как с ними работать. Вводная статья по теме здесь на Хабре. Автор рассматривает форматы данных, которые можно представить в виде вектора, а также приводит примеры — как использовать векторы на практике. Все подробно и наглядно — со схемами, таблицами и примерами кода.

-

Что такое эмбеддинги и как они помогают искусственному интеллекту понять мир людей. Профессор математики Владимир Крылов популярным языком и со ссылками на научные работы рассказывает о технологиях, лежащих в основе современных систем распознавания текста.

-

Русскоязычная документация OpenAI. Один из подразделов посвящен вопросам: что такое эмбеддинги, как их получают, а также смежным темам вроде классификации, кластеризации и поиска по коду.

Beeline Cloud — безопасный облачный провайдер. Разрабатываем облачные решения, чтобы вы предоставляли клиентам лучшие сервисы.

Что еще публикуем в нашем блоге и на платформе «вАЙТИ»:

Автор: beeline_cloud

- Запись добавлена: 10.05.2026 в 14:13

- Оставлено в