Подробный гайд по созданию видео из фото и текста с помощью нейросетей. Выбираем, какой ИИ для генерации видео лучше: от русских нейросеток до мощных западных инструментов для монтажа и создания качественных роликов.

Статичные изображения стремительно теряют охваты. Аудитория требует динамики, а бренды и креаторы массово переходят на видеоконтент. Проблема в том, что полноценный продакшен с актерами, светом и камерами стоит дорого и занимает недели. В 2026 году нейросеть для создания видео из фото закрывает эту задачу за пару минут. Достаточно загрузить референс, написать грамотный промпт, и алгоритм сам рассчитает физику движений, наложит свет и сгенерирует синхронный звук.

За последний год алгоритмы шагнули далеко вперед. Если раньше нейросеть для видео из фото выдавала дерганые гифки с артефактами и плывущими лицами, то сейчас мы работаем с консистентными моделями. Инструменты вроде Kling 3.0 и Veo 3.1 научились удерживать черты лица при вращении камеры, имитировать киношную глубину резкости и даже переносить сложную хореографию с одного ролика на статичного персонажа. В этом обзоре мы разберем, какой ИИ для создания видео выбрать под конкретные задачи: от анимации детских фотографий до монтажа рекламных креативов и расскажем как сделать свое первое крутое видео.

ТОП-6 нейросетей для создания видео из фото

-

Seedance 2.0 — этот мультимодальный ИИ для генерации видео из фото идеально подходит для сборки сложных кинематографичных сцен с реалистичной физикой объектов и автоматически сгенерированным звуком.

-

VideoGen — доступная русская нейросеть для создания видео отлично справляется с генерацией длинных форматов до 30 секунд, четко понимая запросы на родном языке.

-

Veo 3.1 — реалистичная нейросеть для генерации видео от Google выдает эталонное 4K-разрешение с феноменальным фотореализмом, идеальными тенями и возможностью умного продления кадра.

-

Kling 3.0 — пожалуй, лучшая нейросеть для видео из фото на сегодняшний день, гарантирующая точное удержание внешности персонажа при сложной многокадровой режиссуре и динамичных пролетах камеры.

-

Happy Horse 1.0 — эта быстрая нейронка для создания видео из фото выделяется живой анимацией лиц и точным мультиязычным липсинком, что делает ее мастхэвом для коротких UGC-роликов.

-

Kling Motion Control — узкоспециализированная нейросеть для замены лица на видео и скелетного переноса движений, позволяющая с хирургической точностью скопировать сложный танец из исходника на статичную картинку.

Как сделать классное видео из фото с помощью ИИ: пошаговый гайд

Создание видео из фото и текста начинается с правильного исходника. Алгоритму нужно за что-то зацепиться, поэтому качество загружаемого референса напрямую влияет на итоговый рендер. Избегайте размытых снимков, пересвеченных лиц и сильного шума.

-

Подготовьте изображение: Обрежьте фото под нужное соотношение сторон (16:9 для YouTube, 9:16 для Reels) до загрузки в сервис.

-

Напишите структурный промпт: Не пишите «девушка идет». Пишите: «Кинематографичный пролет камеры, фокус на лице девушки, она медленно идет по неоновой улице, мокрый асфальт, мягкий боке».

-

Настройте движение (Motion): Установите интенсивность анимации. Для портретов ставьте значения ниже средних, чтобы избежать искажений (морфинга).

-

Сгенерируйте и сделайте апскейл: Если нейронка для создания видео из фото выдала хороший результат, но в 720p, прогоните ролик через встроенный улучшайзер или сторонний апскейлер.

Чтобы избежать типичных ИИ-галлюцинаций, всегда прописывайте в негативный промпт (если сервис это поддерживает): «мутации, лишние пальцы, деформация лица, дерганая камера, низкий фреймрейт, водяные знаки».

Даже лучшая нейросеть для видео требует практики. Экспериментируйте с описанием освещения (golden hour, studio lighting) и типами объективов (macro, 35mm lens). Это кардинально меняет уровень реализма.

Seedance 2.0 — мультимодальный ИИ для создания видео

Под капотом Seedance 2.0 от ByteDance трудится мощная диффузионная модель, способная переваривать текст, изображения и аудио одновременно. Этот ИИ для генерации видео из фото идеален для сложных многоплановых сцен. Он понимает реальную физику: ткань реалистично развевается на ветру, а свет корректно отражается от воды. Алгоритм умеет генерировать ролики до 15 секунд в разрешении 1080p, параллельно создавая нативный саунд-дизайн, идеально синхронизированный с происходящим на экране.

На практике генерация видео из фото происходит плавно, без резких скачков между кадрами. Интерфейс требует небольшого привыкания, но радует функцией Elements — можно загрузить свое лицо и поместить себя в любой сгенерированный контекст. Отличная нейросеть для генерации видео, когда нужна кинематографичная картинка и точный контроль камеры.

⭐ Рейтинг: 9.9

Возможности Seedance 2.0 для генерации видео из фото

-

Мультимодальный ввод: Комбинирует до 9 изображений, 3 видео и аудиодорожек в одном запросе.

-

Нативное озвучивание: Автоматически подбирает и генерирует звуковые эффекты под анимацию в кадре.

-

Физика объектов: Имитирует реальный вес предметов, гравитацию и динамику жидкостей.

-

Внедрение персонажей (Elements): Позволяет зафиксировать внешность конкретного человека и перенести ее в ролик.

-

Точный контроль камеры: Поддерживает кинематографические термины (dolly zoom, tracking shot).

Преимущества и недостатки

-

✅ Длительность клипов до 15 секунд без потери логики сцены

-

✅ Встроенный генератор звука и речи

-

✅ Высокая консистентность персонажей

-

✅ Выдает честные 1080p

-

❌ Требует качественного промпта для полноценного использования сложных сцен

Seedance 2.0 закроет боли тех, кому нужно склеить связную историю, а не просто анимировать пейзаж. Если вы ищете, какой ИИ для создания видео справится с рекламным роликом или музыкальным клипом, это ваш кандидат. Промпты лучше писать на английском, структурируя их по схеме: объект + действие + окружение + камера + свет.

Опробовать возможности Seedance 2.0

VideoGen — доступная русская нейросеть для создания длинных видео

VideoGen — это отличная русская нейросеть для видео, которая рвет шаблоны по соотношению цены и качества. Инструмент заточен под максимальную простоту: загружаете статичный референс, пишете запрос на русском языке, и система выдает плавный ролик длительностью до 30 секунд. Это редкость для рынка, так как большинство конкурентов ограничивают генерацию 4-5 секундами. Алгоритм хорошо справляется с анимацией природы, созданием фонов для подкастов и оживлением иллюстраций.

Скорость работы впечатляет. ИИ для видео на русском языке четко распознает нюансы запроса, не требуя сложных лингвистических конструкций или переводчика. Качество выдачи стабильное, хотя на длинных дистанциях (после 20-й секунды) могут появляться легкие артефакты. Это надежный бот для создания видео из фото, если вам нужно сгенерировать контент для соцсетей быстро и дешево.

⭐ Рейтинг: 9.6

Возможности VideoGen для генерации видео из фото

-

Поддержка длинных форматов: Редкая способность создавать непрерывные ролики до 30 секунд по одному промпту.

-

Понимание русского языка: ИИ для коротких видео отлично считывает сленг и специфические описания без искажения смысла.

-

Работа с референсами: Позволяет задать начальный кадр для жесткой фиксации композиции.

-

Экономичный рендеринг: Низкая стоимость генерации по сравнению с западными аналогами.

Преимущества и недостатки

-

✅ Родной интерфейс и понимание промптов на русском

-

✅ Длительность ролика до 30 секунд

-

✅ Бюджетная стоимость токенов

-

✅ Низкий порог входа для новичков

-

❌ На сложных динамичных сценах уступает Kling и Veo

-

❌ Меньше настроек движения камеры

Инструмент идеально подойдет SMM-специалистам, арбитражникам и блогерам. Если вам нужно создание слайд шоу видео из фото с плавными переходами или атмосферный фон для Shorts, VideoGen сэкономит часы времени. Формулируйте запросы прямо и емко, избегая двойных смыслов.

Создать первый ролик в VideoGen

Veo 3.1 — нейросеть для генерации реалистичных видео

Veo 3.1 от Google DeepMind — это тяжелая артиллерия в мире генеративного контента. Эта лучшая нейросеть для видео выдает бескомпромиссное 4K-разрешение и поддерживает форматы 16:9 и 9:16. Алгоритм обучен на колоссальных массивах данных, благодаря чему он феноменально работает с тенями, отражениями и микромоторикой. Загружая портрет, вы можете быть уверены, что кожа, волосы и одежда будут вести себя в движении так же, как в реальной жизни.

Практический опыт показывает, что Veo 3.1 обладает высочайшим уровнем понимания промптов (prompt adherence). Если вы пропишете «отражение неоновой вывески в луже, по которой едет машина», система сгенерирует это без искажений геометрии. Это топовая нейросеть для обработки видео и генерации с нуля, но она требует предельно точного технического задания. Встроенная генерация аудио дополняет картинку, делая результат готовым к публикации.

⭐ Рейтинг: 9.6

Возможности Veo 3.1 для генерации видео из фото

-

Вывод в 4K: Кристально чистая картинка, подходящая для профессионального продакшена.

-

Настройка первого и последнего кадра: Позволяет жестко задать начало и конец анимации для точных переходов.

-

Управление соотношением сторон: Нативная поддержка портретной и альбомной ориентации без обрезки деталей.

-

Умное продление (Extend): Возможность бесшовно увеличивать длину сгенерированного ранее клипа.

-

Синхронное аудио: Генерация звука окружения, опирающаяся на визуальный контекст.

Преимущества и недостатки

-

✅ Непревзойденный фотореализм и работа со светом

-

✅ Генерация честного 4K

-

✅ Полная поддержка экосистемы Google (Gemini)

-

✅ Отсутствие «пластикового» ИИ-эффекта на лицах

-

❌ Строгая цензура контента

-

❌ Относительно долгий рендер на максимальных настройках

Veo 3.1 — выбор видеографов и рекламных агентств. Чтобы выжать максимум, используйте в промптах терминологию фотографов (ISO, shutter speed, focal length). Модель отлично справляется с макросъемкой и сложными погодными условиями (дождь, туман, снег).

Kling 3.0 — один из лучших ИИ для создания видео из фото

Китайский гигант Kuaishou выкатил Kling 3.0, который моментально стал любимцем креаторов. Его главная фишка — функция «Visual Drift Killer». Этот ИИ для генерации видео из фото решает самую бесячую проблему нейросетей: потерю сходства персонажа при движении. В третьей версии появилась функция All-in-One Reference, позволяющая заблокировать внешность объекта по нескольким фото. В результате персонаж может ходить, поворачиваться спиной и взаимодействовать с окружением, оставаясь собой.

Работать с Kling 3.0 — одно удовольствие. Движения получаются плавными, без желеобразных артефактов на фоне. Модель отлично склеивает многокадровые истории (Multi-shot storyboarding). Вы можете прописать раскадровку, и нейросеть выдаст логичную последовательность сцен. Это мощнейшая нейросеть для видео по тексту и фото, которая выдает сочную кинематографичную картинку в 1080p.

⭐ Рейтинг: 9.5

Возможности Kling 3.0 для генерации видео из фото

-

Удержание персонажа: Идеальная фиксация черт лица и одежды на протяжении всего клипа.

-

Мульти-кадровая режиссура: Создание целых сцен с контролируемым темпом и переходами.

-

Естественная кинематика: Правильная симуляция ходьбы, бега и взаимодействия с предметами.

-

Управление камерой: Плавные пролеты, фокус-пуллинг (смена резкости) и панорамирование.

Преимущества и недостатки

-

✅ Лучшая на рынке стабильность персонажей

-

✅ Ролики от 3 до 15 секунд с высокой детализацией

-

✅ Отлично понимает сложную режиссуру в промптах

-

✅ Динамичное и логичное изменение освещения в кадре

-

❌ Серверы иногда перегружены из-за высокого спроса

-

❌ Могут возникать мелкие баги при генерации кистей рук в сложных ракурсах

Если вам нужно оживить своего персонажа для серии роликов, Kling 3.0 не имеет конкурентов. Используйте фреймворк SCACA (Scene, Character, Action, Camera, Audio) при составлении промптов, чтобы получить предсказуемый и профессиональный результат.

Happy Horse 1.0 — амбициозный ИИ для коротких видео

Happy Horse 1.0 (проект от Alibaba) ворвался в индустрию, сместив многих старичков. Этот ИИ для генерации видео делает ставку на мульти-шоты и безупречный липсинк. Система умеет заставлять персонажа на фото не просто моргать, но и произносить текст на семи языках с идеальным совпадением артикуляции губ. Алгоритм отлично переваривает сложные сценарии и выдает стабильные 1080p ролики от 3 до 15 секунд.

В работе нейросеть показывает удивительную прыть: рендер происходит довольно быстро (в среднем около 10-15 секунд на короткий шот). Физика движений сопоставима с Seedance: волосы рассыпаются по плечам, мимика живая, без эффекта зловещей долины. Это шикарная нейронка для создания видео из фото, если ваша цель — оживить историческую личность, создать маскота или сделать креатив для TikTok.

⭐ Рейтинг: 9.1

Возможности Happy Horse 1.0 для генерации видео из фото

-

Мультиязычный Lip-sync: Точная синхронизация движений губ с аудиодорожкой на 7 языках.

-

Мульти-референс: Поддержка до 9 картинок для точного воссоздания атмосферы и деталей.

-

Плавные транзиции: Бесшовные переходы между сценами при генерации историй.

-

Нативный звук: Автоматическое наложение звуков шагов, ветра и фонового шума.

Преимущества и недостатки

-

✅ Феноменальная анимация лиц и синхронизация речи

-

✅ Отлично справляется со сложными текстурами (шерсть, кожа)

-

✅ Очень быстрый генератор по сравнению с аналогами

-

✅ Доступность через удобное API

-

❌ Модель еще молодая, изредка проскакивают визуальные глитчи на фоне

-

❌ Меньше пользовательских гайдов в сети

-

❌ Сложности с речью на русском языке

Инструмент мастхэв для тех, кто делает UGC-контент или говорящие головы, но хочет больше динамики, чем предлагают стандартные аватары. При загрузке исходника убедитесь, что рот персонажа закрыт — так липсинк отработает максимально чисто.

Создать анимацию в Happy Horse 1.0

Kling Motion Control — нейросеть для замены лица на видео и переноса движений

Kling Motion Control — это не просто генератор, это узкоспециализированная нейросеть для переноса движений. Механика проста: вы загружаете фото вашего персонажа и видеоролик с нужным действием (например, сложным танцем или спортивным трюком). ИИ анализирует скелетную анимацию из видео и с хирургической точностью натягивает ее на ваше изображение. Именно эта технология породила популярный тренд с танцующими детьми, животными и историческими фигурами.

Модель версии 3.0 решает главную проблему прошлых поколений — она идеально сохраняет черты лица даже при сильных поворотах головы и частичном перекрытии кадра руками. Вы получаете потрясающую стабильность. Это лучшее для создания видео из фото, когда нужно повторить вирусный тренд из соцсетей, не снимая оригинальный контент.

⭐ Рейтинг: 8.7

Возможности Kling Motion Control для генерации видео из фото

-

Скелетный перенос (Motion Transfer): Точное копирование хореографии, жестов и походки с референсного видео.

-

Сохранение идентичности: Лицо со статичного фото остается узнаваемым под любым углом.

-

Улучшенная артикуляция пальцев: ИИ корректно переносит сложные движения кистей рук.

-

Изоляция фона: Возможность заменить окружение из исходного видео с помощью текстового промпта.

Преимущества и недостатки

-

✅ Идеально для создания вирусных Reels и TikTok

-

✅ Высочайшая точность переноса сложных спортивных и танцевальных движений

-

✅ Реалистичная физика тела и перенос веса

-

✅ Поддерживает ролики до 30 секунд

-

❌ Требует качественного исходного видео (без мыла и сильных размытий в движении)

-

❌ Процесс рендера может занимать время

Чтобы результат не выглядел как дешевая нейросеть для замены лица на видео (deepfake), следите за пропорциями. Если вы переносите танец взрослого человека на фото корги, физика может дать сбой. Подбирайте референсы со схожей комплекцией.

Запустить Kling Motion Control

Runway Aleph — нейросеть для монтажа видео и VFX

Runway Aleph — это настоящий швейцарский нож для тех, кому нужна нейросеть для монтажа видео и глубокой постобработки. Aleph позиционируется как in-context видеомодель. Она позволяет взять готовое статичное фото, анимировать его и на лету менять углы камеры, освещение, удалять или добавлять объекты в сцену. Вы можете превратить дневной пейзаж в киберпанк-ночь, сохранив исходную геометрию кадра.

Интерфейс Runway всегда славился удобством для профессионалов. Скорость отклика отличная, а инструменты кисти (Motion Brush) позволяют точечно указывать, какая именно часть картинки должна двигаться (например, только вода или только облака). Это не просто ии для коротких видео, это полноценная студия визуальных эффектов в браузере.

⭐ Рейтинг: 8.3

Возможности Runway Aleph для генерации видео из фото

-

Motion Brush: Локальная анимация выбранных областей изображения с заданием направления движения.

-

Смена окружения: Интеллектуальная замена фона и стиля без нарушения переднего плана.

-

Генерация новых ракурсов: ИИ достраивает сцену, позволяя виртуальной камере облететь объект.

-

Трансформация объектов: Замена одних элементов в кадре на другие с помощью текста.

Преимущества и недостатки

-

✅ Огромный функционал для VFX и тонкой настройки

-

✅ Идеально работает с архитектурой и пейзажами

-

✅ Интуитивно понятные инструменты выделения

-

✅ Высокое качество стилизации (например, превращение фото в аниме)

-

❌ Лица крупным планом иногда теряют детализацию при сильном движении

-

❌ Дорогая подписка для снятия лимитов

Используйте Runway Aleph для создания синемаграфов или B-roll кадров. Комбинация Motion Brush и грамотного промпта позволяет оживить старые фотографии так, что зритель не отличит их от реальной съемки.

Изучить инструменты Runway Aleph

Wan Video — ИИ для генерации видео с идеальной консистентностью

Wan Video (модели Wan 2.6 и 2.7) от Alibaba Group наделала шума благодаря своей способности держать форму объектов. Главная боль ИИ-генерации — это когда машина на видео внезапно превращается в кусок мыла при повороте. Wan Video решает это за счет продвинутой консистентности движения (Advanced Motion Consistency). Кроме того, инструмент предлагает уникальную фичу — 9-Grid Image to Video, позволяющую генерировать сразу несколько сцен параллельно для ускорения работы.

Модель очень послушна. Точность интерпретации промптов здесь на высоте: если вы запросили замедленную съемку прыгающей собаки, вы получите именно slow-mo. Нейросеть для генерации видео из фото выдает отличную плавность (FPS) и отлично подходит для маркетологов, которым нужно быстро конвертировать статические рекламные макеты в динамичные креативы.

⭐ Рейтинг: 7.7

Возможности Wan Video для генерации видео из фото

-

Анимация по первому и последнему кадру: Задайте начало и конец, а ИИ сам дорисует плавный переход между ними.

-

Высокая стабильность геометрии: Объекты не деформируются при быстром движении в кадре.

-

Пакетная генерация (9-Grid): Одновременный рендеринг нескольких вариантов анимации для быстрого выбора лучшего дубля.

-

Клонирование субъекта: Отличное удержание айдентики бренда или маскота в разных сценах.

Преимущества и недостатки

-

✅ Исключительная стабильность твердых объектов (машины, здания)

-

✅ Четкое следование сложным многосоставным промптам

-

✅ Возможность локального развертывания (модели с открытым кодом)

-

✅ Отлично подходит для анимации товарных карточек

-

❌ Менее выразительная работа с микромимикой лиц по сравнению с Kling

-

❌ Требует мощного железа, если запускать локально через GitHub

Wan Video — находка для e-commerce. Загрузите фото кроссовок, напишите «камера облетает кроссовки, на фоне взрывается цветной дым» — и забирайте готовый рекламный ролик.

Grok Imagine — нейросеть для генерации видео без цензуры

Илон Маск и xAI выпустили Grok Imagine (на движке Aurora), и это именно тот какой ии для создания видео нужен искателям творческой свободы. В отличие от корпоративных продуктов Adobe или Google, Grok предлагает минимальные ограничения и так называемый Spicy Mode. Запросы, которые другие сервисы блокируют из-за перестраховки (например, экшен-сцены, специфический юмор или острые политические карикатуры), здесь генерируются на ура. Это отличный выбор, когда нужны генерация видео из фото без цензуры (в рамках разумного, конечно) и дерзкие креативы.

Grok работает очень быстро. Интерфейс не перегружен лишними ползунками: загрузили фото, написали промпт, получили результат в 720p со встроенным звуковым сопровождением. Нейросети для видео без цензуры часто грешат качеством, но Grok выдает отличную детализацию, крутой свет и стабильную частоту кадров. Звук генерируется нативно и звучит органично, без эффекта «приклеенной» дорожки.

⭐ Рейтинг: 7.1

Возможности Grok Imagine для генерации видео из фото

-

Spicy Mode: Ослабленные фильтры безопасности для смелых креативных и сатирических задач.

-

Нативный саунд-дизайн: Автоматическое добавление шумов, музыки и диалогов под контекст.

-

Бесконечный скролл: Быстрая генерация десятков вариаций без долгого ожидания в очереди.

-

Высокая креативность модели: Отлично понимает абстрактные и сюрреалистичные запросы.

Преимущества и недостатки

-

✅ Отсутствие жестких ограничений (генерация видео из фото без цензуры)

-

✅ Интеграция с платформой X для быстрого постинга

-

✅ Очень быстрый отклик и генерация

-

✅ Мощная стилизация (аниме, киберпанк, нуар)

-

❌ Максимальное разрешение пока ограничено 720p

-

❌ Меньше кинематографических настроек камеры

Если вам нужно сделать вирусный мем, смешную анимацию с друзьями или сатиру — Grok Imagine вне конкуренции. Пишите живые, разговорные промпты, алгоритм отлично их понимает.

Adobe Firefly Image to Video — лучшая нейросеть для видео с безопасным ИИ

Adobe Firefly — полная противоположность Grok. Это коммерчески безопасный ИИ для создания видео из фото. Модель обучена исключительно на лицензионных материалах Adobe Stock, открытом контенте и данных в общественном достоянии. Вы можете смело использовать результаты в коммерческой рекламе, не боясь судебных исков за нарушение авторских прав. Инструмент бесшовно интегрирован в Premiere Pro и After Effects, что делает его стандартом для студий.

Функция Image to Video работает предсказуемо и аккуратно. Вы загружаете иллюстрацию или фото, и ИИ мягко ее оживляет. Огромный плюс — инструмент Prompt-to-Edit, позволяющий текстом корректировать уже сгенерированный ролик (например, «измени цвет куртки на красный»). Качество картинки эталонное, без мыла, с идеальным пониманием света.

⭐ Рейтинг: 6.8

Возможности Adobe Firefly для генерации видео из фото

-

Prompt-to-Edit: Редактирование сгенерированного видео с помощью текстовых команд.

-

Коммерческая безопасность: 100% легальный контент для использования в бизнесе.

-

Интеграция с Creative Cloud: Прямой экспорт и доработка в Premiere Pro.

-

Управление стилями: Огромная библиотека пресетов для имитации пленки, 3D или живописи.

Преимущества и недостатки

-

✅ Юридическая безопасность сгенерированных роликов

-

✅ Эталонный UI/UX от Adobe

-

✅ Точнейшая работа с цветом и типографикой

-

✅ Бесшовная связка с другими продуктами Adobe

-

❌ Чрезмерно агрессивные фильтры цензуры

-

❌ Меньше безумного креатива по сравнению с китайскими моделями

Идеальный выбор для дизайнеров и маркетологов. Если вы работаете в корпоративном секторе и вам нужно элегантное создание слайд шоу видео из фото или оживление логотипа — Firefly решит задачу надежно и красиво.

HeyGen — бот для создания видео из фото с говорящими аватарами

HeyGen занимает специфическую, но крайне востребованную нишу. Это лучшая нейросеть для создания видео презентаций, обучающих курсов и питчей. Вы загружаете обычное портретное фото (Photo Avatar), вводите текстовый скрипт, и HeyGen превращает картинку в реалистичного диктора. Губы идеально синхронизируются с текстом, персонаж моргает, слегка кивает головой — иллюзия присутствия полная.

Сервис поддерживает более 175 языков, включая отличный русский голос без металлического акцента. В 2026 году они прокачали функцию Image to Video, добавив шаблоны для маркетинга и бренд-киты. Это не про взрывы и кинематографичные пролеты дронов, это про бизнес и продажи. Работает быстро, стабильно, экономит тысячи долларов на аренде студии.

⭐ Рейтинг: 6.4

Возможности HeyGen для генерации видео из фото

-

Photo Avatar: Оживление любого портрета с добавлением естественной микромимики.

-

Мультиязычный дубляж: Перевод и озвучка скрипта на 175 языков с подстройкой липсинка.

-

Клонирование голоса (Voice Cloning): Возможность заставить аватар говорить вашим собственным голосом.

-

Шаблоны и Бренд-киты: Быстрая сборка ролика с вашими логотипами и фирменными цветами.

Преимущества и недостатки

-

✅ Лучший липсинк и генерация говорящих голов на рынке

-

✅ Качественный русский язык в озвучке

-

✅ Готовые шаблоны для вертикальных и горизонтальных видео

-

✅ Удобный интерфейс в стиле Canva

-

❌ Не подходит для экшен-сцен и сложной анимации окружения

-

❌ Дорогая подписка для постоянного использования

Если стоит задача запустить массовую рассылку персонализированных видео клиентам или собрать гайд для сотрудников — загружайте фото спикера в HeyGen. Минимум настроек, максимум конверсии.

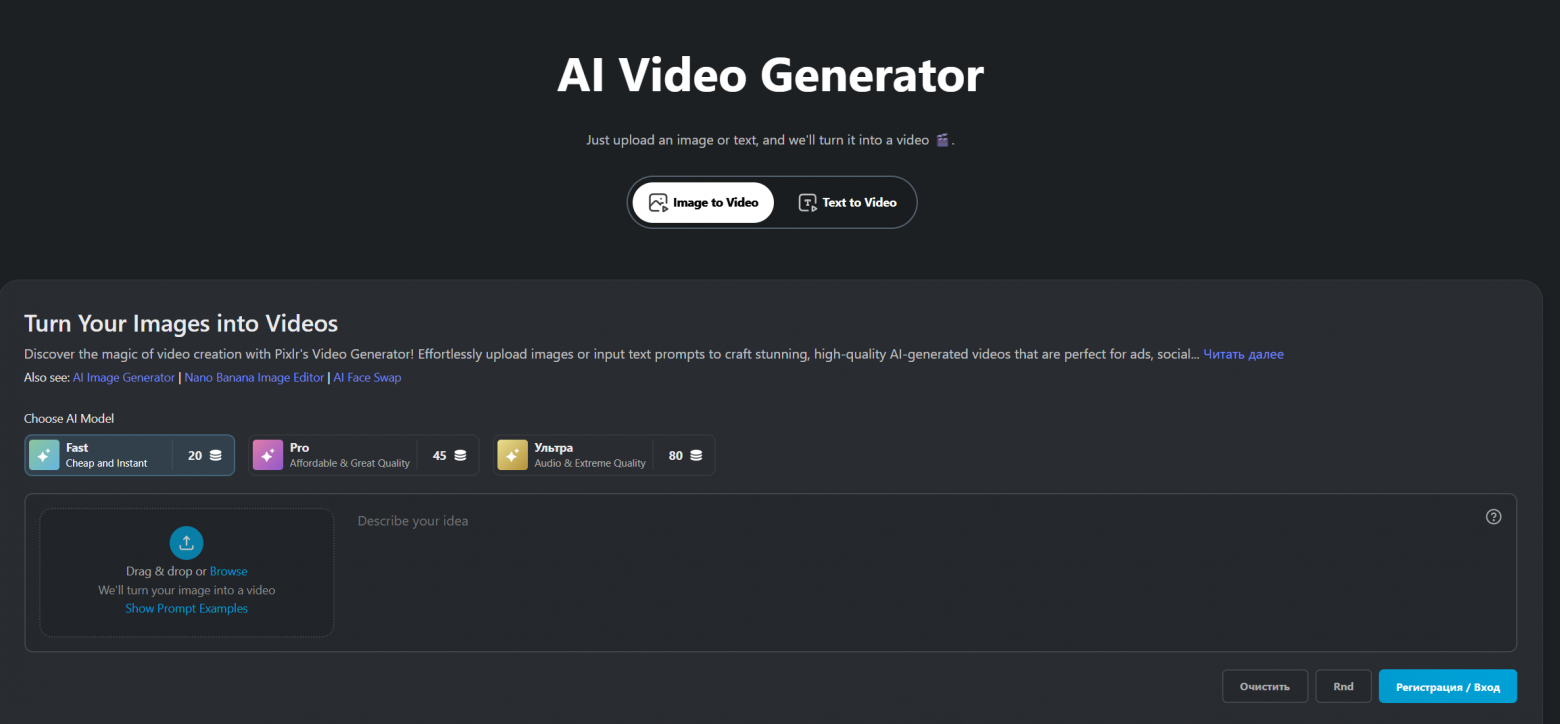

Pixlr Video Generator — быстрые бесплатные ИИ для генерации видео из фото

Pixlr, известный своим фоторедактором, интегрировал мощный ИИ для генерации видео прямо в браузер. Главный плюс — максимальная доступность. Здесь есть режимы Fast, Pro и Ultra, позволяющие балансировать между скоростью рендера и детализацией. Инструмент отлично справляется с анимацией постеров, товарных снимков и созданием вирусных эффектов для соцсетей.

Pixlr подкупает тем, что не требует сложного промптинга. Вы просто загружаете фото, выбираете стиль анимации, и система сама накладывает динамичные эффекты, приближения и фильтры. Это отличные условно бесплатные ии для генерации видео из фото, чтобы быстро собрать привлекательный креатив для сторис без погружения в настройки диффузионных моделей.

⭐ Рейтинг: 6.1

Возможности Pixlr для генерации видео из фото

-

Разные режимы рендера: Fast для быстрых превью и Ultra для финального качества.

-

Динамические видеоэффекты: Встроенные кинематографичные переходы, фильтры и стикеры.

-

Анимация элементов: Возможность заставить двигаться отдельные части картинки (например, зажечь огонь).

-

Интеграция с редактором: Можно сначала обработать фото ИИ-ластиком или заменить фон, а потом анимировать.

Преимущества и недостатки

-

✅ Работает прямо в браузере без тяжелых загрузок

-

✅ Интуитивно понятный интерфейс для новичков

-

✅ Связка фоторедактора и видеогенератора в одном окне

-

✅ Быстрый рендер в режиме Fast

-

❌ Качество физики уступает тяжеловесам вроде Kling или Veo

-

❌ Ограниченная длина роликов

Идеальный тул для дизайнеров, которым нужно быстро анимировать баннер. Загрузили арт, добавили эффект глитча или легкий зум — и сочный контент готов.

Полный гайд по генерации видео нейросетями: как создавать ролики без ошибок и артефактов

Статичные картинки стремительно теряют охваты. Алгоритмы платформ отдают приоритет динамике, а производство классических видео съедает колоссальные бюджеты. В ответ индустрия выдала мощный инструмент — ии для генерации видео из фото. Однако первые попытки новичков оживить кадр обычно заканчиваются пластилиновыми лицами, лишними пальцами и дерганым фоном. Магия начинается там, где заканчивается слепой рандом и включается грамотная режиссура.

Этот гайд написан для тех, кто хочет понять логику алгоритмов. Мы детально разберем частые ошибки промптинга, а затем под микроскопом изучим флагманские инструменты 2026 года: Seedance 2.0, Veo 3.1 и Kling 3.0. Вы узнаете, как заставить пиксели двигаться по вашим правилам и какая лучшая нейросеть для видео подойдет под ваши конкретные задачи.

Базовые принципы: как ИИ для генерации видео понимает ваши задачи

Любая нейросеть для создания видео из фото работает по принципу диффузии. Алгоритм берет исходный кадр, добавляет в него цифровой шум, а затем пошагово «вычищает» его, ориентируясь на ваш текстовый запрос. Если запрос размыт, машина начинает галлюцинировать. Чтобы получить кинематографичную плавность, нужно управлять виртуальной камерой.

3 главные ошибки новичков при генерации видео

-

Каша в текстовом запросе (Prompt Salad): Алгоритмы не понимают сложной литературы. Запрос «красивая девушка грустит о лете» выдаст непредсказуемый мусор. Рабочая формула: Объект + Окружение + Действие + Движение камеры + Тип освещения.

-

Завышенный параметр Motion Scale: Выкручивая ползунок интенсивности движения на максимум, вы провоцируете морфинг. Лица начинают плавиться, а твердые объекты деформируются. Для портретов всегда ставьте значения ниже 40%.

-

Грязные референсы: Нейронка для видео из фото цепляется за каждую деталь. Если вы загрузите сжатый JPEG с артефактами или пересвеченным фоном, ИИ заботливо анимирует этот шум, превратив его в рой пикселей.

Seedance 2.0 — мультимодальный монстр для сложных сцен

Алгоритм Seedance 2.0 от ByteDance (доступен на платформе Higgsfield) кардинально меняет подход к производству. Это не просто генератор клипов, а полноценный агрегатор медиаданных. Инструмент поддерживает мультимодальный ввод: в один промпт можно загрузить до 9 изображений, 3 видеофрагмента и 3 аудиодорожки. Нейросеть анализирует этот массив и выдает логически связный ролик длительностью до 15 секунд в разрешении 1080p.

Главная киллер-фича системы — функция Elements. Вы можете загрузить несколько своих фотографий, создать персональный «элемент» и помещать себя в любые сгенерированные миры. ИИ для создания видео сохранит вашу микромимику, шрамы и особенности прически, даже если по сюжету вы летите в скафандре над Марсом.

Глубокий разбор возможностей Seedance 2.0

-

Нативный саунд-дизайн: Нейросеть автоматически генерирует звуки окружения. Если в кадре бьется стекло, вы услышите звон осколков, точно синхронизированный с анимацией.

-

Multi-shot генерация: Возможность прописать смену планов в одном запросе (например, переход от макросъемки глаза к общему плану города).

-

Идеальная физика тканей и жидкостей: Seedance великолепно просчитывает сопротивление воздуха, заставляя одежду реалистично развеваться при ходьбе персонажа.

Ошибки и ограничения при работе с Seedance

-

Перегруз мультимодальности: Если загрузить 9 референсов разной стилистики (аниме, фотореализм, 3D), алгоритм потеряет фокус и выдаст визуальную кашу.

-

Сбои липсинка на сложных ракурсах: Синхронизация губ с аудио работает идеально только на фронтальных портретах. При повороте головы на 3/4 трекинг артикуляции может сбиваться.

-

Сложная кривая обучения: Интерфейс требует привыкания. Это не кнопка «сделать круто», а панель управления с десятками переменных.

Veo 3.1 — бескомпромиссное 4K и реализм от Google DeepMind

Если вам нужна эталонная картинка для коммерческого использования, Google Veo 3.1 — это абсолютный топ. В отличие от конкурентов, растягивающих 1080p с помощью апскейлеров, Veo выдает честный нативный 4K-рендер при 60 кадрах в секунду. Модель обучена на гигантских массивах данных, что позволило инженерам решить проблему неестественного освещения. Отражения в лужах, блики на стеклах авто и мягкий студийный свет здесь просчитываются на уровне современных игровых движков.

Особого внимания заслуживает функция Extend-video. Большинство нейросетей ограничены 5-10 секундами. Veo 3.1 позволяет бесшовно удлинять готовый ролик блоками по 7 секунд. Максимальный лимит одной сцены достигает 2.5 минут (148 секунд), что делает этот ии для видео по тексту идеальным для создания музыкальных клипов и короткометражек.

Функционал Veo 3.1 для создания видео из фото

-

Ingredients to Video: Улучшенная работа с референсами. Вы загружаете фото (ингредиент), и алгоритм использует его как жесткий каркас, сохраняя пропорции объектов даже при быстром панорамировании камеры.

-

Умный кроп (16:9 и 9:16): Нативная поддержка вертикального и горизонтального форматов без потери качества и обрезки важных деталей на краях кадра.

-

Встроенный SynthID: Незаметные водяные знаки, вшитые в метаданные пикселей, которые сохраняются даже после сжатия ролика в Telegram или WhatsApp.

С чем Veo справляется хуже (Ошибки и лимиты)

-

Слишком агрессивная цензура: Фильтры безопасности Google блокируют запросы при малейшем намеке на жестокость, копирайт или NSFW. Промпт «человек режет торт огромным ножом» может улететь в бан.

-

Стерильность картинки: Модель тяготеет к стоковому, вылизанному реализму. Заставить Veo сгенерировать грязный гранж или артхаусную стилизацию крайне сложно.

-

Долгий рендер: Генерация 4K-видео с аудиодорожкой может занимать до 5-7 минут на максимальных настройках серверов.

Kling 3.0 — персональный ИИ-режиссер с идеальным контролем движений

Релиз Kling 3.0 от Kuaishou в феврале 2026 года задал новый стандарт в индустрии. Разработчики внедрили концепцию AI Director — парадигму, которая избавляет креаторов от необходимости монтировать куски в сторонних программах. За один клик нейросеть для генерации видео из фото выдает 15-секундный ролик, автоматически разбитый на 6 кинематографичных планов (storyboarding). Машина сама решает, когда показать общий план, а когда взять крупный ракурс для усиления эмоций.

Но главный козырь Kling 3.0 — это Standard Motion Control. Это видео-в-видео технология переноса скелетной анимации. Вы загружаете фото персонажа и референсное видео с танцем или сложным акробатическим трюком. ИИ с хирургической точностью переносит биомеханику движений на статичную картинку. Лицо, одежда и фон остаются неизменными, а персонаж идеально повторяет хореографию.

Возможности Kling 3.0 для сложного продакшена

-

Omni Native Audio: Мощнейший генератор звука. Поддерживает 5 языков (включая китайские диалекты и испанский). Умеет генерировать диалоги, где два персонажа в одном кадре говорят на разных языках с точным липсинком.

-

All-in-One Reference: Позволяет загрузить короткое 3-секундное видео человека, чтобы алгоритм намертво зафиксировал не только его внешность, но и тембр голоса для последующих генераций.

-

Multi-character coreference: Стабильное удержание внешности трех и более уникальных персонажей в одной сцене без их визуального смешивания.

Нюансы и частые ошибки при работе с Kling 3.0

-

Концептуальное кровосмешение (Concept Bleeding): При генерации 3+ персонажей с длинными описаниями одежды алгоритм может случайно надеть куртку главного героя на злодея. Требуется жесткая структура промпта.

-

Требования к Motion Control: Если на референсном видео для переноса движений человек одет в мешковатую одежду, скрывающую суставы, скелетная анимация перенесется криво. Идеальный исходник — облегающая одежда и контрастный фон.

-

Очереди на серверах: Из-за колоссальной популярности модели в часы пик генерация бесплатного или базового тарифа может зависать в статусе ожидания.

Выбор лучшего ии для видео зависит от вашей конечной цели. Если вам нужна сложная работа с собственным лицом и звуком — берите Seedance. Для коммерческой рекламы в безупречном 4K идеально подойдет Veo 3.1. А если ваша задача — перенос танцевальных трендов, вирусные Reels и многокадровая режиссура, Kling 3.0 закроет эти потребности на 100%.

Реклама. ООО «ДИДЖИТАЛ ГЕНИУС». ИНН 7813681158

Автор: FlyAI