На утверждение, что большие языковые модели не мыслят, есть простой встречный вопрос : “Если это так, как ИИ выполняет арифметические операции?”

Действительно, сложение, вычитание и умножение кажутся точными и алгоритмизированными процессами. Кажется логичным предположить, что внутри модели должен быть некий “калькулятор” или хотя бы его подобие. Но это не так.

| Если вам интересна тема AI-агентов и внедрения нейросетей, заглядывайте в мой Telegram-канал ДругОпенсурса. Там я публикую свежие новости и разборы инструментов в числе первых. |

Как модель видит математику

Возьмём простой пример:

36 + 59

Для нас это числа, для модели – текстовые паттерны. Наборы символов и токенов, которые она встречала миллионы раз в обучающих данных: счетах, таблицах, коде, научных статьях.

С точки зрения модели, последовательность “36 + 59 = 95” принципиально не отличается от любого другого часто встречающегося текстового паттерна. Однако это не значит, что модель просто запоминает ответы, ведь иначе она постоянно ошибалась бы. Вместо этого она выработала внутренние эвристики, которые обычно приводят к правильному продолжению.

Внутренняя механика решения

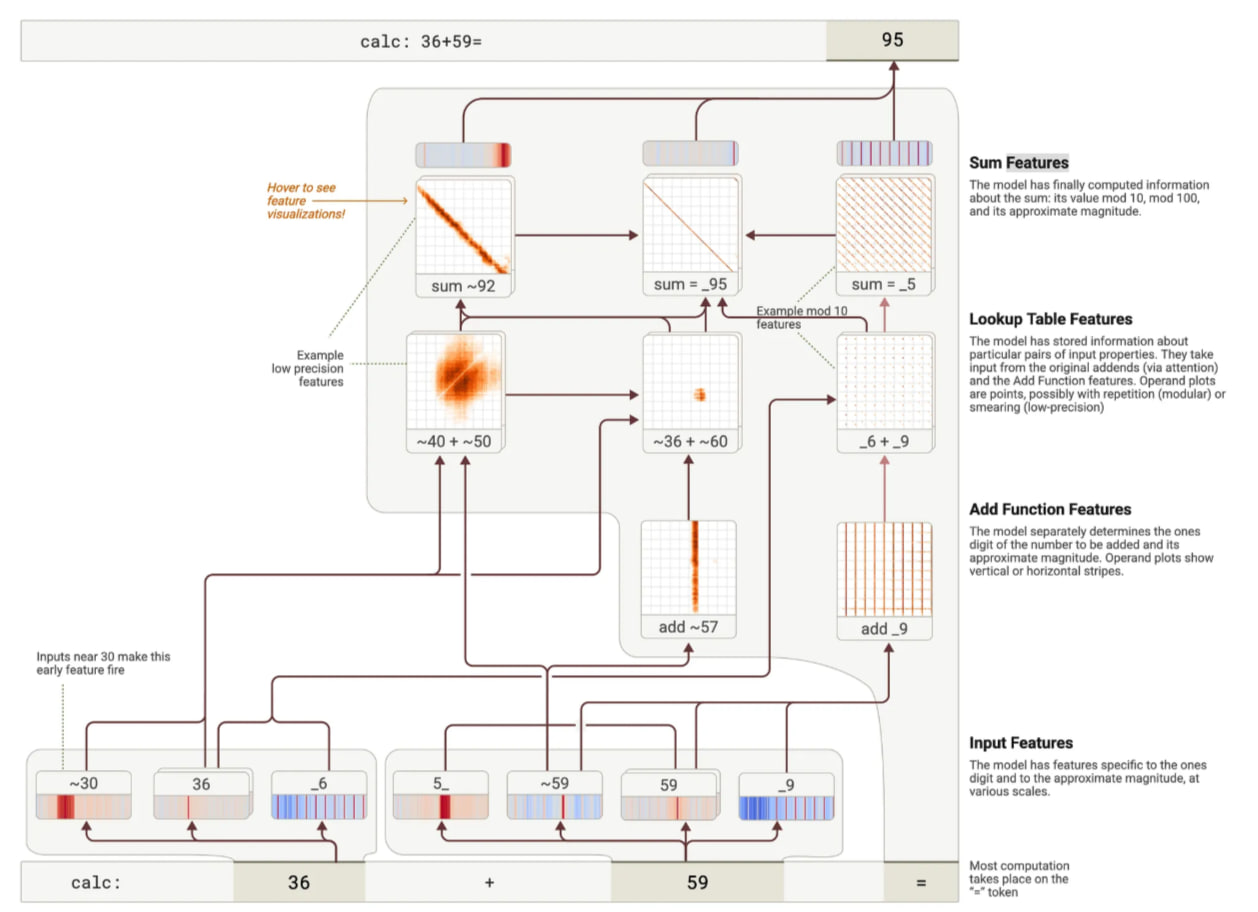

Исследования интерпретируемости показывают, что модель не решает задачу сложения единым алгоритмом. Она разбивает её на части, хотя никто её этому не учил.

Один внутренний сигнал оценивает порядок величины: “результат должен быть около 90”. Другой работает с последними цифрами: “6 + 9 обычно даёт число, оканчивающееся на 5”. Эти сигналы комбинируются, сужая возможные варианты следующего токена, пока “95” не становится наиболее вероятным продолжением.

Входные данные распределяются по разным путям обработки. Это не тот способ, которому учат в школе, но он работает.

В реальной модели исследователи обнаружили, что сложение реализуется не одним модулем, а набором перекрывающихся механизмов. Одни работают как грубые оценщики, другие как точные обработчики последних цифр. Некоторые действительно используют запомненные таблицы сложения однозначных чисел.

В статье это сформулировано прямо:

Как и многие люди, модель запомнила таблицу сложения однозначных чисел.

Это важное замечание. Люди тоже частично запоминают арифметические факты, но разница в том, что у людей есть общий алгоритм, применимый к числам любой длины, в отличие от моделей.

Ограничения подхода

Модель уверенно решает задачи с двух-трёхзначными числами, но начинает ошибаться на более длинных числах, нестандартных форматах или крайних случаях, где школьник бы не ошибся.

Именно это и ожидаешь от системы, построенной на эвристиках, а не на правилах.

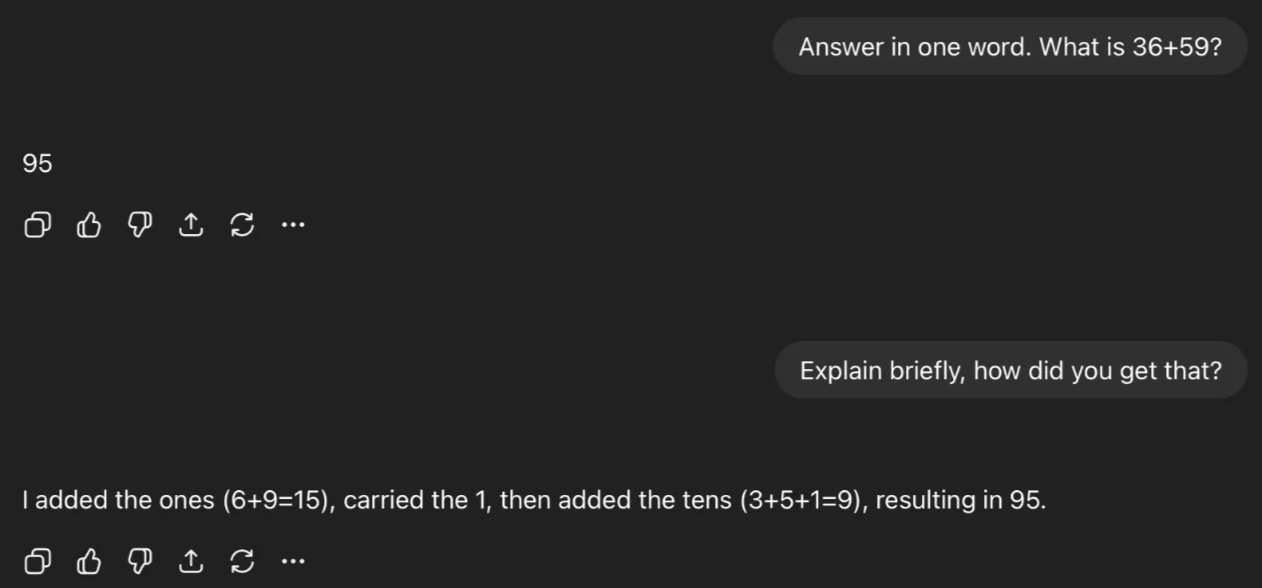

Ещё один неожиданный факт: объяснения модели о том, как она решила задачу, часто не соответствуют действительности. На вопрос “как ты это посчитала?” модель опишет перенос разрядов, как это сделал бы человек, но когда исследователи проследили внутренние вычисления, выяснилось, что объяснение не совпадает с тем, что происходило на самом деле.

Это простой пример того, что у модели есть способность, которую она не может объяснить на метауровне. Это касается не только арифметики, но и рассуждений, планирования, объяснений. Модель хорошо генерирует текст, похожий на обоснование, потому что видела много обоснований в обучающих данных. Но это не значит, что обоснование отражает реальные внутренние процессы. Это важно помнить при использовании LLM в реальных системах. Связное объяснение не гарантирует правильности рассуждений.

Почему модель учится арифметике

Возникает вопрос: зачем языковой модели учиться тому, что похоже на сложение?

Потому что числа встречаются везде: в таблицах с ценами, временных шкалах, спортивной статистике, научных статьях, финансовых отчётах, датах, измерениях. А чтобы хорошо предсказывать следующее слово в таких контекстах, нужно уметь обрабатывать числовые паттерны, поэтому сложение здесь – инструмент. Те же внутренние механизмы, которые помогают модели ответить “36 + 59”, активируются при предсказании лет в библиографических ссылках, итогов в таблицах или последовательностей в структурированном тексте. Для модели это одна и та же задача: “какое число должно идти дальше?”

Исследования не опровергают, что LLM не мыслят, а наоборот, подтверждают его : показывают, что предсказание следующего токена на больших объёмах данных приводит к появлению внутренних механизмов, которые могут имитировать рассуждения в узких областях, например, арифметике.

На мой взгляд, самое честное объяснение того, почему ИИ может складывать числа, не понимая, что такое число – “LLM — это машины паттернов, которые на больших масштабах учатся внутренним эвристикам. Некоторые из них похожи на математику, некоторые на логику, некоторые на планирование. Ни одна из них не требует мышления.”

Автор: Qwertcoser