Google DeepMind выкатила Gemma 3 – новое семейство открытых ИИ-моделей. И, судя по заявлениям, главный акцент сделан на доступность и производительность в реальных условиях. В эпоху, когда нейросети из экзотики превращаются в повседневный инструмент, такой подход выглядит особенно актуально. В этой статье попробовал разобраться, что же представляет собой Gemma 3.

Архитектура Gemma 3: берем лучшее от Gemini 2.0 и оптимизируем

В основе Gemma 3 лежит технологическая база Gemini 2.0 – флагманской линейки Google DeepMind. Но если Gemini – это скорее демонстрация максимальных возможностей, то Gemma 3 – это уже про практическое применение. Ключевая задача – оптимизация архитектуры для эффективной работы на доступном железе. Разработчики явно целились в то, чтобы модели можно было запускать не только в облаке, но и локально, на обычных рабочих станциях с GPU или даже TPU. И это не просто маркетинг, а реальная попытка сделать мощный ИИ действительно демократичным. Посмотрим, что получилось на практике.

Что интересного в характеристиках Gemma 3: без воды, только факты

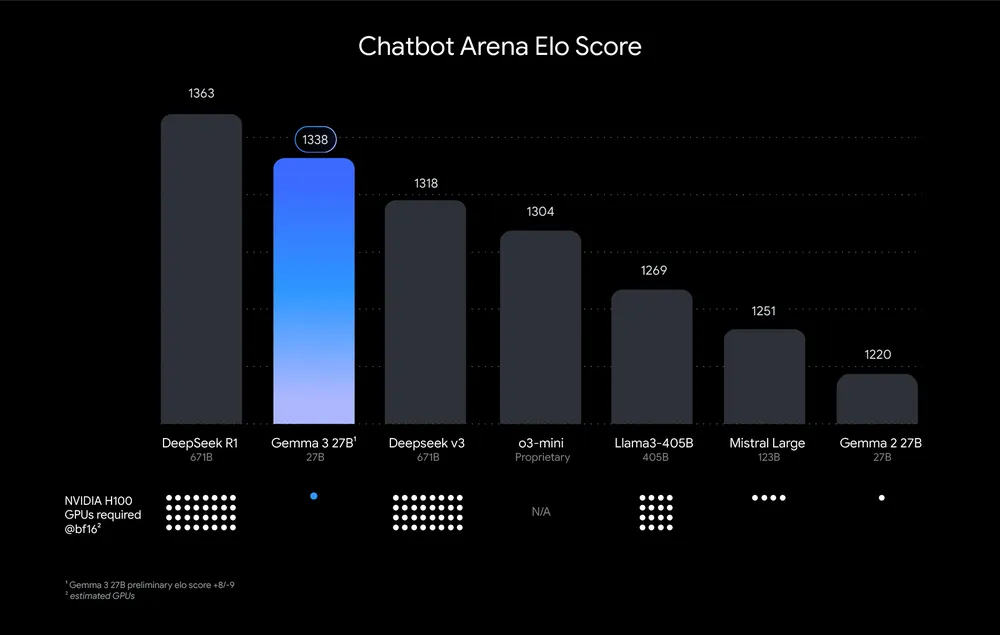

Если смотреть на спецификации Gemma 3, то выделяется несколько моментов. Производительность и эффективность – это явно приоритет. Флагман Gemma 3 27B по заявлению Google не уступает конкурентам по бенчмаркам, но при этом требует значительно меньше ресурсов. Работа на одной H100 – это уже серьезно. Плюс линейка включает модели разных размеров – 1B, 4B, 12B – можно подобрать под любые задачи. Мультиязычность – еще один плюс. 140+ языков поддержки, из них 35+ с полной функциональностью, включая русский. Для международных проектов – отличная новость. Мультимодальность тоже завезли, но не во все модели. 4B, 12B и 27B умеют работать не только с текстом, но и с картинками и видео. Для интерактивных приложений – то, что надо. Контекст обещают до 128K токенов. Для работы с длинными текстами или диалогами – должно хватить с запасом. Ну и интеграция – куда же без нее. Поддержка Hugging Face Transformers, Ollama, PyTorch, TensorFlow и прочих популярных инструментов – это must have для открытой модели.

Где пригодится Gemma 3: практические сценарии

Сфер применения Gemma 3 можно накидать массу. Инновационные приложения – тут понятно, от чат-ботов до анализа медиа-контента. Исследования в ИИ – доступность моделей такого уровня точно подстегнет науку. Для бизнеса – оптимизация всего и вся, от клиентской поддержки до аналитики. Ну и для российского рынка – отдельный респект за локализацию и возможность работы без привязки к облакам. В общем, поле для экспериментов – огромное.

Как начать работать с Gemma 3: быстрый старт

Для тех, кому интересно пощупать Gemma 3 руками – есть несколько вариантов. Google AI Studio – самый быстрый способ попробовать модель в браузере. Hugging Face, Ollama и Kaggle – для тех, кто хочет загрузить модели и интегрировать в свой код. Начать экспериментировать можно буквально сегодня, без особых затрат и сложностей.

Вместо вывода: Gemma 3 – это серьезный шаг к доступному ИИ

В целом, Gemma 3 выглядит как весьма интересное и своевременное решение. Google DeepMind сделали реальный шаг в сторону демократизации ИИ, предложив мощные модели, доступные для широкого круга разработчиков. Насколько это изменит рынок – покажет время. Но уже сейчас ясно, что Gemma 3 – это тот инструмент, на который стоит обратить внимание всем, кто интересуется нейросетями и их практическим применением.

Автор: TechDed