Китайская компания Deepseek, специализирующаяся на искусственном интеллекте, представила новый кодировщик изображений, который перестраивает информацию на основе смысла, а не обрабатывает ее в жестком порядке сверху вниз и слева направо.

Традиционные модели визуально-языкового восприятия разбивают изображения на небольшие фрагменты и обрабатывают их в фиксированном порядке, начиная с верхнего левого угла и двигаясь к нижнему правому. По мнению исследователей Deepseek , такой подход не соответствует тому, как люди видят в реальности. Наши глаза следуют гибким шаблонам, основанным на содержании. Например, при обводке спирали мы не перескакиваем по изображению строка за строкой. Вместо этого мы следуем за формой.

Deepseek OCR 2 пытается имитировать этот подход. Новый DeepEncoder V2 сначала обрабатывает визуальные токены на основе их содержимого, перестраивая их в соответствии с контекстом, прежде чем языковая модель интерпретирует то, что находится внутри. Идея заключается в том, что два этапа обработки, работающие последовательно, могут обеспечить подлинное понимание содержимого двухмерных изображений.

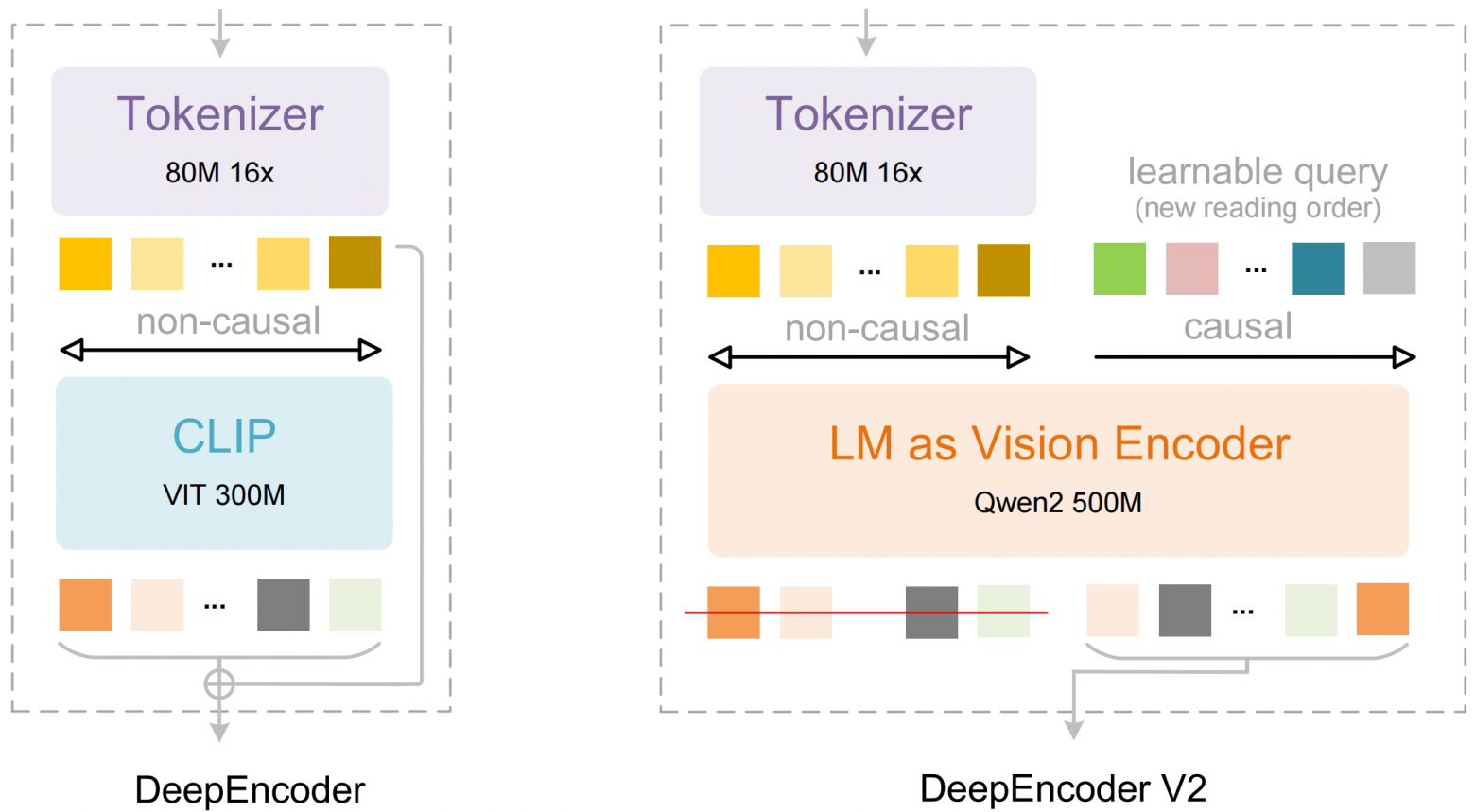

Языковая модель заменяет традиционный кодировщик изображений

В основе DeepEncoder V2 лежит замена типичного компонента CLIP на компактную архитектуру языковой модели, основанную на Alibaba Qwen2 0.5B. Исследователи представили так называемые токены причинно-следственного потока. Это обучаемые токены запросов, которые прикрепляются к визуальным токенам и могут получать доступ ко всей информации об изображении, а также к предыдущим запросам.

Согласно статье, это создает двухэтапный процесс. Сначала кодировщик реорганизует визуальную информацию на основе контента. Затем декодер LLM, работающий с уже отсортированной последовательностью, анализирует ее. В декодер передаются только перегруппированные токены причинно-следственного потока, а не исходные визуальные токены.

Меньше токенов, лучше результаты

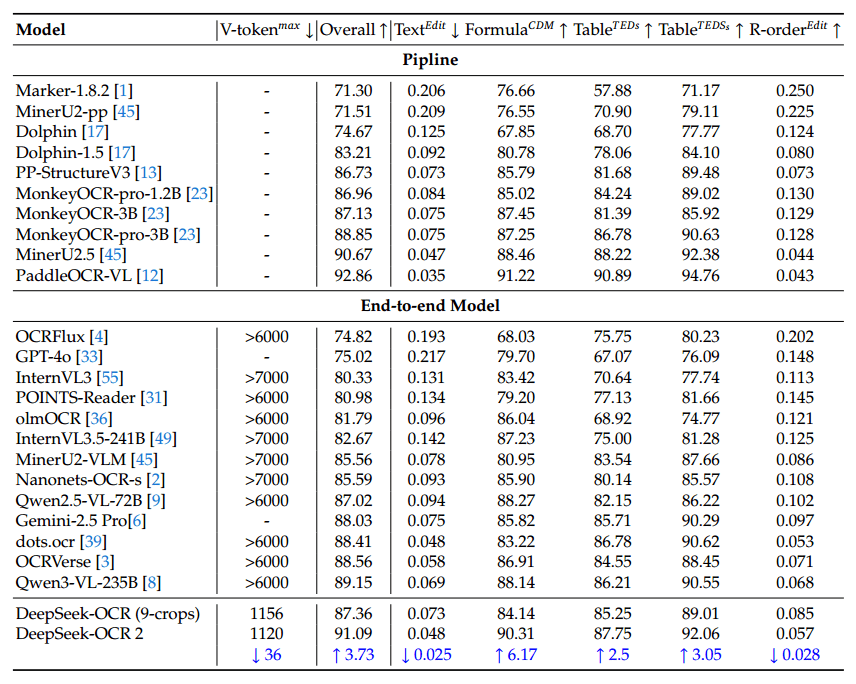

В зависимости от изображения, Deepseek OCR 2 использует от 256 до 1120 визуальных токенов. Аналогичным моделям часто требуется более 6000 или 7000 токенов. По данным исследователей, в тесте OmniDocBench v1.5, охватывающем 1355 страниц в девяти категориях, модель показала общий результат 91,09%.

Это на 3,73 процентных пункта лучше, чем у предшественника, Deepseek OCR. Улучшения особенно заметны в распознавании правильного порядка чтения. В анализе документов Deepseek OCR 2 также превзошел Gemini 3 Pro при сопоставимом количестве токенов.

На практике также улучшилась частота повторений. Этот показатель измеряет, как часто модель попадает в повторяющиеся текстовые циклы. При использовании в качестве бэкэнда OCR для языковых моделей Deepseek этот показатель снизился с 6,25 до 4,17 процента. При пакетной обработке PDF-файлов в обучающие данные он упал с 3,69 до 2,88 процента.

Однако у модели есть и слабые места. Например, на газетах она показывает худшие результаты, чем её предшественница. Исследователи указывают на два фактора: более низкий лимит токенов может создавать проблемы для газетных страниц с большим количеством текста, а обучающие данные включали всего 250 000 газетных страниц, чего было недостаточно для этой категории.

Шаг к унифицированной мультимодальной обработке

Исследователи рассматривают DeepEncoder V2 как шаг вперед к стандартизированной обработке мультимодальных данных. В будущем архитектура кодировщика может развиваться таким образом, чтобы обрабатывать текст, речь и изображения с использованием одной и той же базовой структуры, адаптируя только токены запроса в зависимости от модальности. Согласно статье, такой подход в конечном итоге может привести к подлинному пониманию двухмерного контента.

Код и веса моделей находятся в открытом доступе на GitHub и Hugging Face.

Компания Deepseek выпустила первое поколение системы распознавания текста Deepseek OCR в октябре прошлого года . Эта система обрабатывает текстовые документы как изображения и сокращает требования к памяти в десять раз. В результате языковые модели могут сохранять значительно больше контекста, что полезно для длинных историй чатов или обширных документов. По данным Deepseek, система может обрабатывать до 33 миллионов страниц в день и особенно хорошо подходит для создания больших обучающих наборов данных.

Делегируйте часть рутинных задач вместе с BotHub! Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Автор: MrRjxrby