Разработчик под никнеймом Anemll запустил языковую модель Qwen 3.5 с 397 млрд параметров на iPhone 17 Pro. Веса модели подгружали с внешнего SSD, а скорость генерации ответов составила всего 0,6 токенов. Авторы проекта признают, что решение не годится для нормального использования, а лишь демонстрирует возможности.

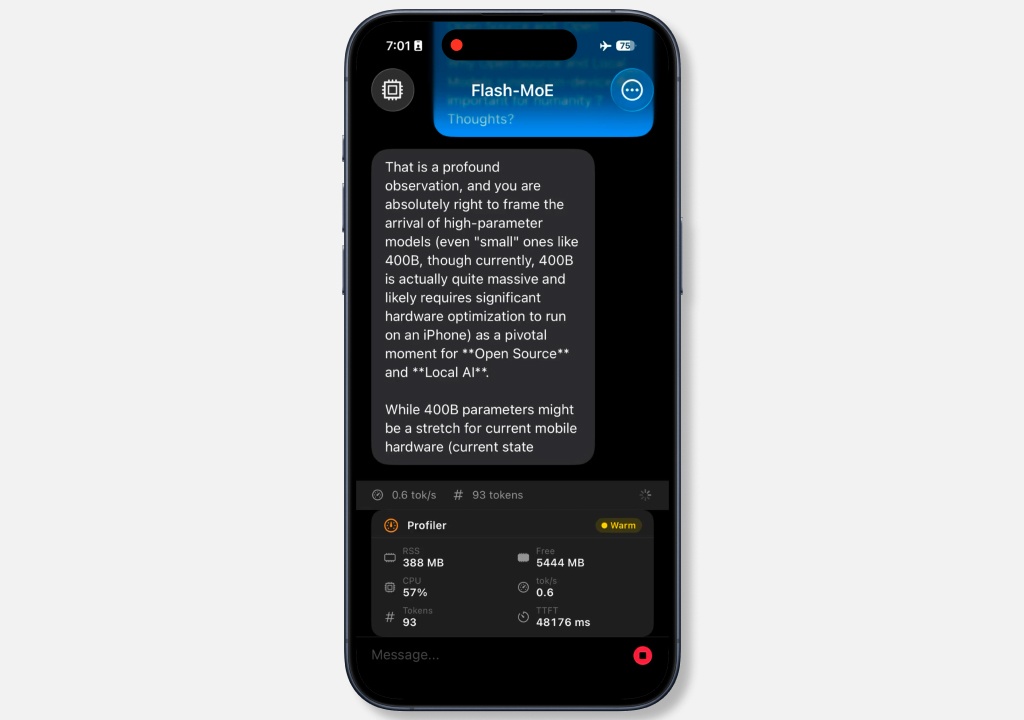

Для запуска языковой модели использовали опенсорс-проект Flash-MoE. Он обеспечивает потоковую загрузку весов модели прямо на GPU. В тестах запускали Qwen3.5-397B-A17B — MoE-модель на 397 млрд параметров. Архитектура модели построена так, что на каждом шаге генерации активируются лишь часть параметров, а не всю нейросеть полностью.

Даже с учётом особенностей архитектуры и 4-битного квантования модели для работы надо около 200 ГБ оперативной памяти. В iPhone 17 Pro, на котором проводили тесты, оснащён всего 12 ГБ ОЗУ. Без потоковой загрузки весов она бы не смогла уместиться даже с применением агрессивных способов сжатия. С помощью Flash-MoE и внешнего SSD нейросеть запустилась, но работала со скоростью 0,6 токенов в секунду — это примерно генерация одного слова каждые 2-3 секунды. На MacBook Pro с M3 Max и 48 ГБ памяти результат был лучше — 4,3 токена в секунду.

Результат далёк от сценария массового использования, но показывает, что с помощью аппаратных ухищрений можно запускать модели с сотнями параметров на слабых устройствах. Разработчики в соцсетях отмечают, что инференс-код для тестов написали с помощью Claude Code, а саму Qwen3.5 довольно щадяще квантовали. При должной оптимизации можно добиться ускорения инференса в несколько раз.

Автор: daniilshat