Исследователи искусственного интеллекта Google представили TurboQuant, новый сверхэффективный алгоритм сжатия памяти для ИИ.

TurboQuant предназначен для экстремального сжатия без потери качества, а применяется к ключевому узкому месту в системах искусственного интеллекта. Компания описывает эту технологию как новый способ уменьшения рабочей памяти ИИ без ущерба для производительности. Метод сжатия, использующий форму векторного квантования для устранения узких мест кэша в обработке ИИ, по сути, позволит ИИ запоминать больше информации, занимая при этом меньше места и сохраняя точность, как утверждают исследователи.

Векторное квантование — это мощный классический метод сжатия данных, который уменьшает размер многомерных векторов. Оптимизация решает две критически важные задачи ИИ: она улучшает векторный поиск — высокоскоростную технологию, лежащую в основе крупномасштабных систем ИИ и поисковых систем, — обеспечивая более быстрый поиск сходства; и помогает устранить узкие места в кэше «ключ-значение», уменьшая размер пар «ключ-значение», что обеспечивает более быстрый поиск сходства и снижает затраты памяти. Однако традиционное векторное квантование обычно вносит свои собственные «накладные расходы на память», поскольку большинство методов требуют вычисления и хранения констант для каждого небольшого блока данных.

TurboQuant — это метод сжатия, который обеспечивает значительное уменьшение размера модели без потери точности за счёт высококачественного сжатия (метод PolarQuant) и устранения скрытых ошибок. PolarQuant решает проблему избыточных затрат памяти, рассматривая вектор памяти не с использованием стандартных координат (т.е. X, Y, Z), указывающих расстояние вдоль каждой оси, а преобразуя его в полярные координаты, используя декартову систему. Это позволяет PolarQuant исключить избыточные затраты памяти.

TurboQuant также использует небольшое остаточное количество мощности сжатия (всего 1 бит) для применения алгоритма QJL к ошибке, оставшейся после первого этапа. QJL использует математический метод, называемый преобразованием Джонсона-Линденштрауса, для уменьшения размера сложных многомерных данных при сохранении существенных расстояний и взаимосвязей между точками. Этот алгоритм, по сути, создаёт высокоскоростную сокращённую запись, не требующую дополнительных затрат памяти. Для поддержания точности QJL использует специальный оценщик, который стратегически балансирует запрос с высокой точностью с упрощёнными данными с низкой точностью.

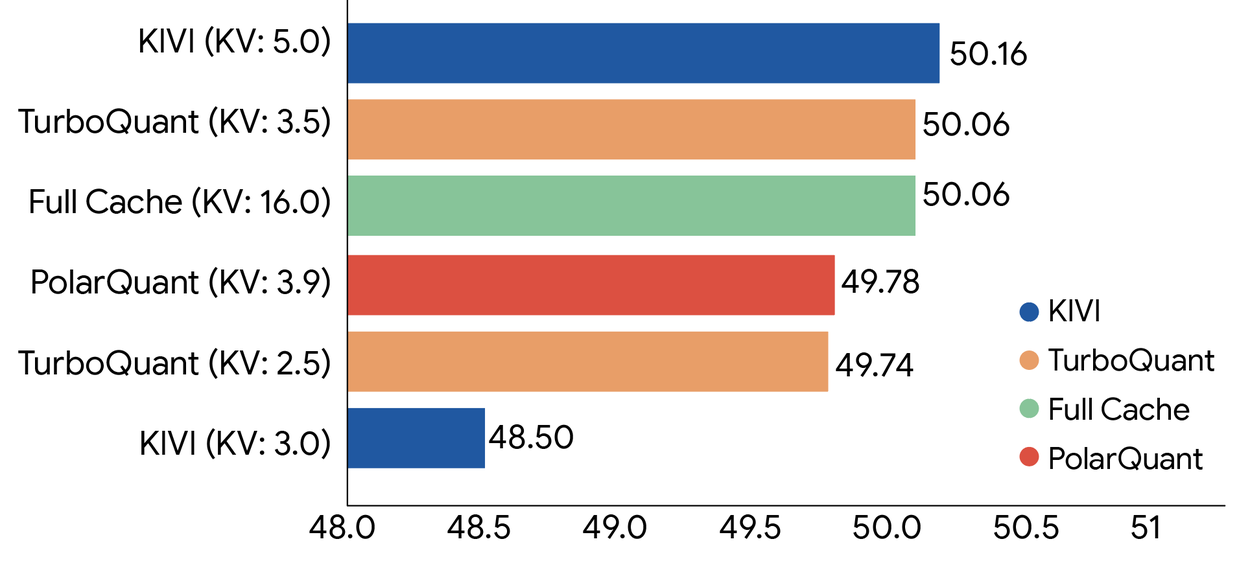

Учёные оценили все три алгоритма на стандартных тестах с длинным контекстом, включая LongBench, Needle In A Haystack, ZeroSCROLLS, RULER и L-Eval, используя открытые LLM (Gemma и Mistral). Экспериментальные данные показывают, что TurboQuant достигает оптимальной производительности с точки зрения искажения скалярного произведения и полноты, одновременно минимизируя объём памяти, занимаемый ключом-значением (KV). Также он демонстрирует высокую производительность сжатия KV-кэша в бенчмарке LongBench по сравнению с различными методами сжатия на модели Llama-3.1-8B-Instruct.

Результаты для задач поиска «иголки в стоге сена» с длинным контекстом (т.е. тестов, предназначенных для проверки способности модели найти один конкретный, крошечный фрагмент информации, скрытый в огромном объёме текста) показаны ниже. TurboQuant доказал свою способность квантовать кэш ключ-значение всего до 3 бит без необходимости обучения или тонкой настройки и без ущерба для точности модели, при этом обеспечивая более быстрое время выполнения, чем оригинальные LLM (Gemma и Mistral).

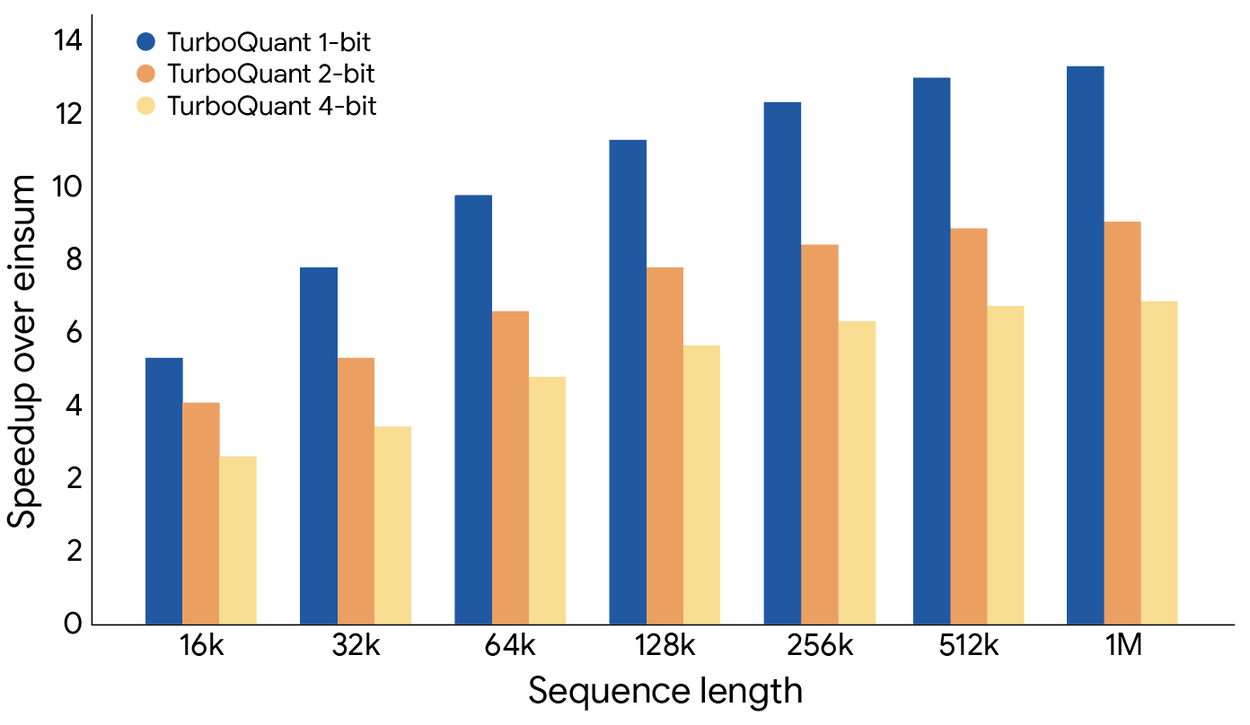

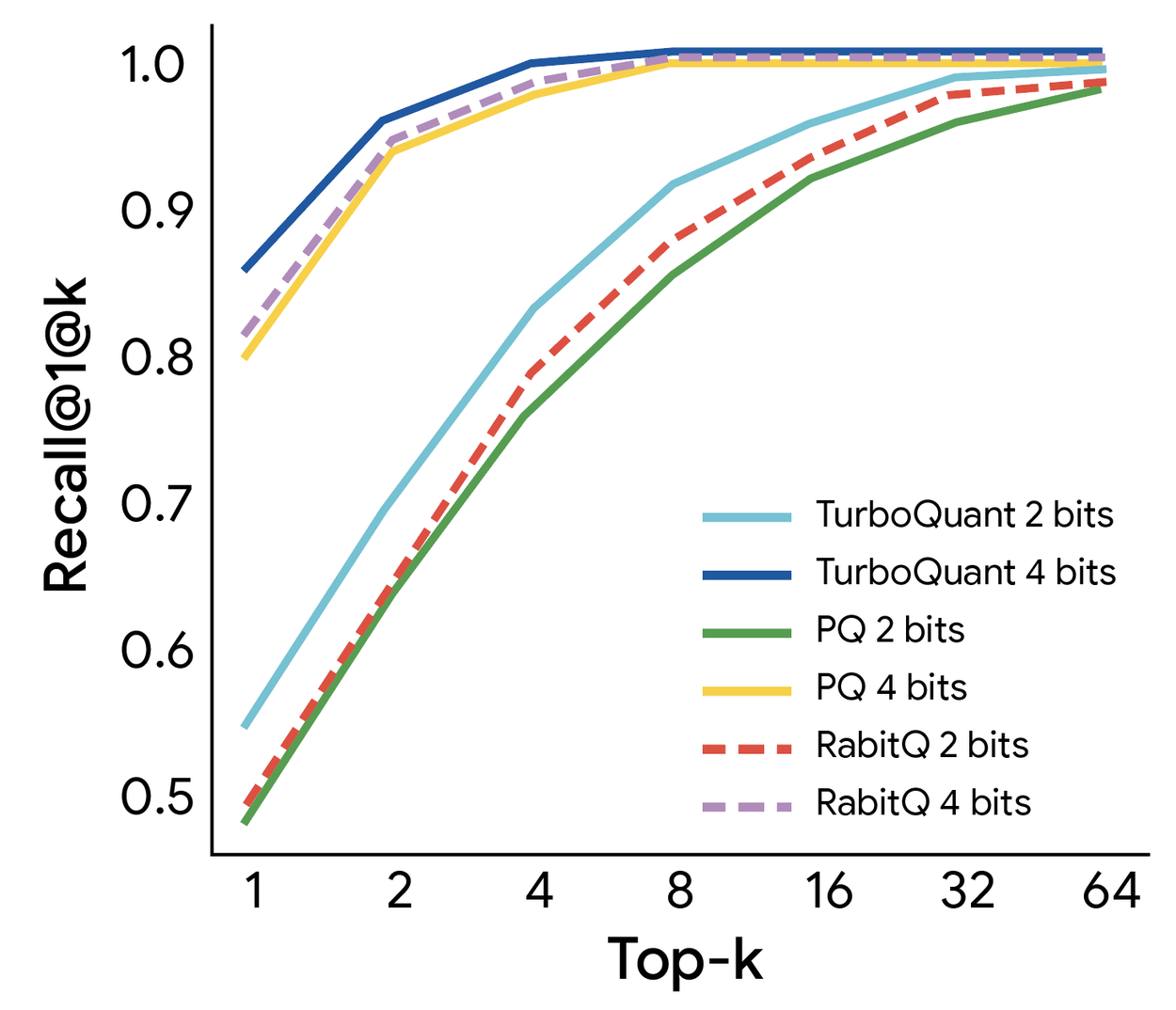

Наконец, TurboQuant демонстрирует существенное увеличение производительности при вычислении логитов внимания в кэше ключ-значение на различных уровнях битовой ширины, измеренное относительно высокооптимизированного базового алгоритма JAX. Это делает его подходящим для поддержки таких сценариев использования, как векторный поиск, где он значительно ускоряет процесс построения индекса. Алгоритм демонстрирует надёжную производительность поиска, достигая оптимального коэффициента полноты 1@k на наборе данных GloVe (d=200) по сравнению с различными передовыми базовыми методами квантизации.

«Такие методы, как TurboQuant, имеют решающее значение для этой задачи. Они позволяют создавать и запрашивать большие векторные индексы с минимальным объёмом памяти, практически нулевым временем предварительной обработки и высочайшей точностью. Это делает семантический поиск в масштабах Google быстрее и эффективнее. По мере того, как ИИ все больше интегрируется во все продукты, от LLM до семантического поиска, работа над фундаментальными методами векторного квантования станет ещё более важной», — отметили исследователи.

Они планируют представить свои результаты на конференции ICLR 2026 в следующем месяце.

В случае успешной реализации в реальном мире TurboQuant может сделать работу ИИ дешевле за счёт уменьшения «рабочей памяти» — известной как KV-кэш — как минимум в 6 раз.

Генеральный директор Cloudflare Мэтью Принс называет это «моментом DeepSeek от Google» — имея в виду повышение эффективности, достигнутое благодаря китайской модели ИИ, которая была обучена за гораздо меньшую стоимость, чем её конкуренты, на менее мощных чипах, но при этом оставаясь конкурентоспособной по результатам.

Однако не факт, что TurboQuant решит более широкую проблему нехватки оперативной памяти, вызванную ИИ, учитывая, что он нацелен только на память для инференции, а не для обучения — последнее по-прежнему требует огромных объёмов оперативной памяти.

Автор: maybe_elf