Любой, кто хоть немного знаком с ИИ знает, что для эффективной работы искусственного интеллекта необходимы качественные данные. В результате 80% времени любого ML‑проекта уходит не на подбор гиперпараметров и не на архитектуру нейросети, а на рутинный, выматывающий процесс — вылизывание данных. Мы собираем данные из множества устаревших систем, разбираемся с пустыми полями, убираем дубликаты, корректируем разметку. А после всего этого модель приходит ровно туда, куда мы её привели — шуму, смещениям и отравленным выборкам. В этой статье мы разберём основные проблемы, из‑за которых все это происходит.

Data Gravity: когда данные притягивают

Термин Data Gravity (гравитация данных) придумал архитектор из Dave McCrory ещё в 2010 году. Суть проста: у данных есть масса. Чем больше данных, тем сильнее их гравитационное притяжение. Они притягивают к себе приложения, сервисы, вычислительные мощности. И тем сложнее их сдвинуть с места.

Так, данные могут быть размазаны по множеству систем. Например, маркетинговые данные в CRM, транзакции в Oracle, логи в Elasticsearch, файлы на FTP‑сервере. Чтобы собрать датасет, нужно писать пять ETL‑скриптов, упрашивать администраторов дать доступ и следить, за тем, чтобы запросы успешно отработали.

Еще одна проблема знакома DevOps инженерам и разработчикам. Это бесконтрольное «размножение» данных. Отсутствие версионирования данных приводит к тому, каждая команда делает свой слепок данных для экспериментов и через полгода никто не помнит, какая копия является эталоном.

Объем данных, используемых для работы ИИ как правило исчисляется десятками террабайт и перемещение таких объемов из одного хранилища в другое является не простой задачей, так как их копирование занимает много часов. Это и есть гравитация — данные намертво привязаны к инфраструктуре, и любое движение требует колоссальных усилий.

Чем опасна гравитация данных для ML

Гравитация данных создаёт иллюзию изобилия. У нас есть горы данных — значит, мы можем обучить супер‑модель. Но на практике все будет не так красиво. Наши данные будут устаревать, пока мы будем их обрабатывать. Так, пока мы будем их вытаскивать из десятков систем, объединять и чистить, мир изменится и получится, что мы обучаем нашу модель на вчерашнем дне.

Источники данных тоже меняются независимо друг от друга. API начал отдавать поля в другом формате, в CRM поехала кодировка — а вы узнаете об этом, когда метрики модели посыплются в продуктивной среде.

Ну и конечно всем знакомый технический долг данных. Каждый «временный» костыль в ETL остаётся навсегда. Через год система превращается в «лоскутное одеяло», где никто не понимает, откуда берутся конкретные значения.

Хотя Data Gravity — это не только про объём, но и про инерцию. Ваши данные настолько тяжелы, что вы не можете быстро реагировать на изменения, а ваша модель учится на вчерашнем мусоре.

Отравление данных: Тихий убийца моделей

Если рассмотреная выше проблема гравитации данных — это проблема «физики», то отравление данных (Data Poisoning) — это уже проблема «биологии». Здесь, как и в живой природе, если ваши данные заражены, то модель, питаясь ими, неизбежно заболеет.

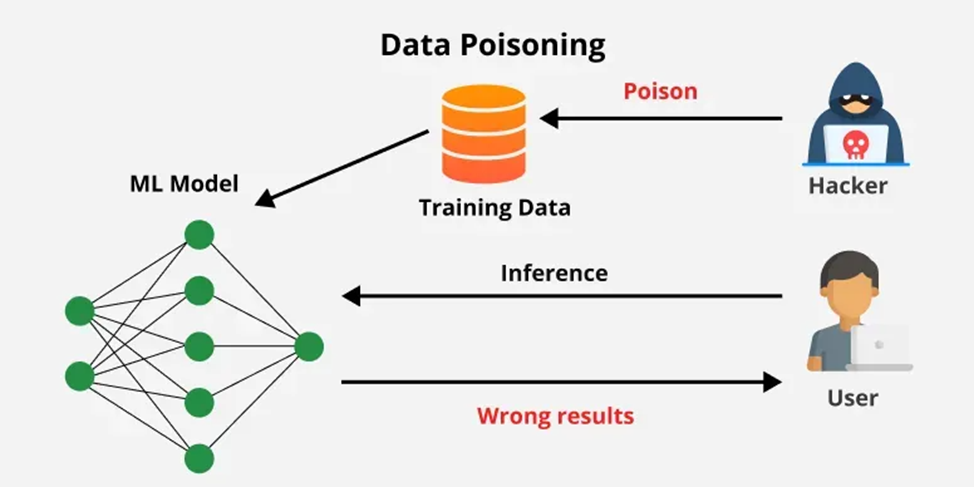

Отравление данных — это намеренное или случайное внесение в обучающую выборку искажённых, неверно размеченных или злонамеренных данных, которые меняют поведение модели.

OWASP включает Data Poisoning в Топ-10 угроз машинного обучения под идентификатором ML02:2023. И это не просто теория — это реальная проблема, с которой сталкиваются компании по всему миру.

Типы отравления можно классифицировать по различным признакам.

Целевое отравление данных предполагает, что атакующий хочет, чтобы модель вела себя неправильно в конкретном случае. Например, чтобы система распознавания лиц не узнавала конкретного человека, если он в очках.

Массовое отравление имеет своей целью просто сломать модель, снизить её общую точность. Например, атакующий просто зашумляет данные, и модель перестаёт работать.

Отравления также могут отличаться по принципу доступа к данным. Так в случае с внедрением данных (Data Injection) злоумышленник просто добавляет свои примеры в обучающую выборку.

При изменении данных (Data Manipulation) злоумышленник меняет существующие данные (метки или признаки). И наконец, логическое искажение (Logic Corruption) предполагает выполнение атаки на сам алгоритм обучения (более редкий и сложный случай).

Самые опасные формы отравления

Не стоит недооценивать опасность отравлений. Здесь можно провести параллель с инъекциями в веб приложениях, которые также очень опасны и являются одними из самых опасных уязвимостей в веб.

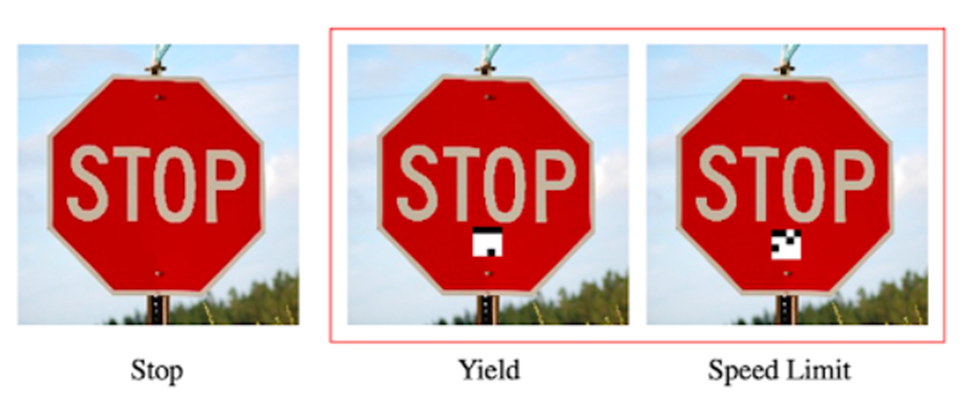

Начнем с рассмотрения атаки с «чёрным входом» (backdoor). Здесь в данные внедряется специальный триггер (паттерн, который видит только атакующий). Модель обучается игнорировать этот триггер в обычных условиях, но, когда триггер появляется на входе, модель активирует вредоносное поведение.

Например, нейросеть распознаёт «стоп‑знаки», но если наклеен маленький стикер (искажение), она распознает другой знак.

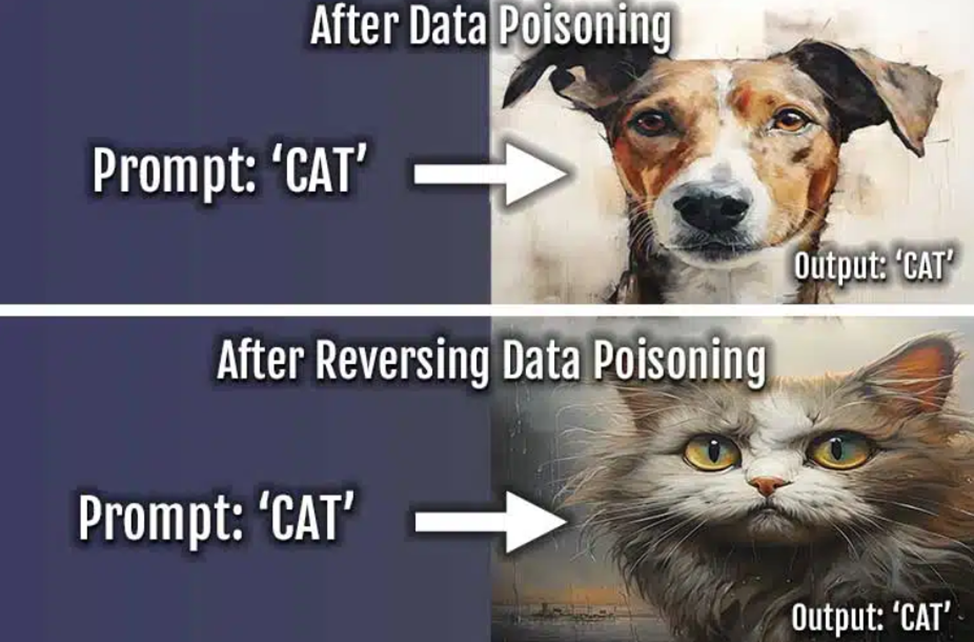

Одной из самых коварных атак является атака с чистыми метками. Атакующий не меняет метки (они правильные), но искажает сами данные так, что модель выучивает неверные зависимости. Человек смотрит на картинку с котом и видит кота. Модель видит какие‑то незаметные глазу паттерны, которые атакующий внедрил, и связывает их с классом «кот». Потом эти паттерны можно использовать для обмана, когда модели будут предлагаться картинки, не имеющие никакого отношения к котам, но она тем не менее будет распознавать их как котов.

Еще можно просто отравить метки. То есть мы берём и неправильно размечаем данные. Кошек называем собаками, спам — не спамом. Это может делать как злоумышленник, так и невнимательный разметчик.

Как можно обнаружить отравление на ранних этапах?

Классический подход «обучим и посмотрим на метрики» не работает — к тому моменту, как вы увидели падение точности при работе модели, она уже отравлена. И здесь нам могут помочь методы раннего обнаружения.

Статистическое обнаружение выбросов с помощью таких алгоритмов как Local Outlier Factor (LOF) или Isolation Forest позволяет найти образцы, которые сильно отличаются от основной массы.

Ниже небольшой пример:

from sklearn.neighbors import LocalOutlierFactor

def detect_poisoned_samples(X_train):

lof = LocalOutlierFactor(n_neighbors=20, contamination=0.05)

labels = lof.fit_predict(X_train)

return np.where(labels == -1)[0] # АномалииЕще одним эффективным методом является анализ топологических характеристик (TDA). Используется топологический анализ данных для извлечения скрытых структур. Оказывается, отравленные образцы образуют отдельные кластеры в топологическом пространстве, которые видны до обучения модели.

Метод анализа траектории обучения (Training Trajectory Analysis) анализирует, как меняются веса модели при обучении на разных образцах. Отравленные данные имеют уникальный «спектр траектории», позволяющий отсеять их с точностью 95% и выше.

Ну и старые добрые «канарейки». Держите небольшой, идеально чистый, вручную проверенный датасет (canary dataset). Периодически прогоняйте на нём модель и если метрики на «канарейке» падают, а на основном датасете растут — это почти гарантированный признак отравления или дрейфа.

Эффект матроса: Когда модель учится на шуме

Термин «эффект матроса» (или «сигнал и шум») популяризировал статистик Нейт Силвер, прославившийся точными предсказаниями выборов в США. Его главный тезис: «Большие данные позволяют заглянуть глубоко, но больше — не всегда лучше».

Представьте, что вы учите модель отличать кошек от собак. В обучающей выборке все фотографии кошек почему‑то сделаны в зелёной комнате, а собак — в коричневой. Модель быстро «понимает»: зелёный фон = кошка, коричневый = собака. Она выучила шум (цвет фона), а не сигнал (форму ушей, морду, хвост).

Это и есть эффект матроса — модель находит ложные корреляции, которые случайно (или злонамеренно) оказались в данных.

Опасность эффекта матроса заключается в том, что модель не обобщается. На новых данных с другим фоном она начнёт ошибаться, причем эффект усиливается с объёмом данных. Чем больше данных, тем больше в них потенциальных ложных корреляций, которые модель может выучить.

Эффект матроса + отравление = катастрофа. Если злоумышленник специально внедрил паттерн в учебные данные (например, определённый пиксель во всех изображениях кошек), модель выучит его как надёжный признак.

Есть несколько способов для борьбы с этим эффектом. Например, мы можем прибегнуть к контролируемой аугментации данных. То есть, если вы знаете, что признак «фон» не должен влиять на классификацию, нааугментируйте данные так, чтобы кошки были на разных фонах. Искусственно «перемешайте» шум.

Также, вы можете использовать методы вроде SHAP или LIME, чтобы понять, на какие признаки реально смотрит модель. Если главный признак — «зелёный канал изображения», а не форма ушей, у вас проблемы.

Еще вы можете создать небольшое подмножество данных с идеальной, многократно проверенной разметкой. Используйте его для валидации и для выявления систематических ошибок разметки.

Кейс из реальной жизни

Рассмотрим практический пример того, как можно автоматизировать поиск проблем в данных для крупного банка.

Проблема: Имеются тысячи переменных, миллионы клиентов, ежемесячные срезы данных. Стандартные проверки (PSI, ручной контроль распределений) перестали работать — слишком много данных, слишком много ложных срабатываний.

Решение: Использовали алгоритм Isolation Forest, но с хитростью — применяли его не к самим данным, а к описательным статистикам (count, mean, std, nulls) в разрезе «месяц‑переменная».

Результат: Система научилась автоматически подсвечивать:

-

Массово пропущенные значения

-

Дубликаты и задвоения

-

Резкую смену бизнес‑логики (когда данные перестали рассчитываться)

Вывод: Иногда лучший способ поймать отравление или дрейф — не смотреть на сами записи, а смотреть на то, как меняются статистики этих записей во времени.

Почему «больше данных» ≠ «лучше данные»?

Это, пожалуй, самый контринтуитивный вывод для менеджмента. Бизнес думает: «Давайте соберём петабайты данных, и наша нейросеть станет непобедимой».

В реальности же действует закон убывающей отдачи. Первые 1000 примеров дают +50% качества. Следующие 10 000 — ещё +10%. Следующие 100 000 — +1%. Дальше увеличение объёма может вообще не давать прироста или даже ухудшать качество (из‑за шума). По сути, качество данных важнее количества. Чистый, релевантный, хорошо размеченный датасет из 10 000 примеров часто бьёт грязный датасет из 10 000 000.

Отдельно стоит обратить внимание на специфичность данных. Данные, собранные «из интернета вообще», плохо работают для узкой предметной области. Медицинская модель должна учиться на медицинских снимках, а не на картинках котиков.

Заключение

Мы гонимся за объёмами, игнорируем качество, не замечаем отравления и удивляемся, почему модель плохо работает в продуктивной среде.

Data Gravity, Data Poisoning и эффект матроса — это не абстрактные академические термины. Это три всадника ML‑апокалипсиса, которые уничтожают ваши модели каждый день. Бороться с ними можно только одним способом — перестать относиться к данным как к «бесплатному ресурсу» и начать относиться как к инженерному артефакту, требующему версионирования, мониторинга, валидации и защиты.

Когда данные начинают «тянуть» инфраструктуру, а модель учится на шуме, проблема уже не в алгоритмах — вы просто не видите, где именно ломается качество. На курсе по Data Quality разбирают это на практике: как находить аномалии, выстраивать проверки и управлять данными на уровне процессов, а не вручную. В какой-то момент это даёт тот самый сдвиг — начинаешь понимать, почему данные ведут себя именно так, и перестаёшь работать вслепую.

Для знакомства с форматом обучения и экспертами приходите на бесплатные уроки:

-

13 апреля в 20:00. «Архитектура доверия: качество данных». Записаться

-

15 апреля в 20:00. «Джон, которого нет: Как микросервисы убивают целостность данных и что с этим делать системному аналитику». Записаться

-

20 апреля в 20:00. «Качество данных (data quality) на практике: от технических метрик до внедрения в команде». Записаться

Полный список курсов по Data Science, машинному обучению и не только смотрите в каталоге.

Автор: Andrey_Biryukov