Opus 4.5 набирает 80.6% на SWE-bench Verified. Opus 4 — 72.5%. Значит ли это, что Opus 4.5 лучше программирует, чем Opus 4?

Ну… возможно. Но SWE-bench Verified это не показывает. Он показывает способность модели чинить небольшие баги в 12 популярных open source Python-репозиториях, которые почти наверняка входят в её обучающие данные. SWE-bench Verified не тестирует умение ориентироваться в вашем TypeScript-монорепо, Spring Boot-приложении или самописном ORM, на котором настоял предыдущий CTO.

Я написал эту статью, потому что в релизах новых моделей постоянно мелькает один и тот же набор бенчмарков — и я понятия не имел, что они означают. Пришлось прочитать статьи, код и критику. Результат: разбор 14 бенчмарков — что тестирует, как устроен, в чём критикуют, и мои собственные наблюдения.

1. SWE-bench Verified

Август 2024 · swebench.com

|

Модель |

Результат |

|---|---|

|

Claude Opus 4.5 |

80.6% |

|

GPT-5.2 |

80.0% |

|

Gemini 3 Pro |

76.2% |

Что тестирует. Способность LLM чинить небольшие баги в 12 популярных open source Python-репозиториях.

Как создавался. Исследователи из Princeton и University of Chicago спарсили 12 репозиториев в поисках PR с новыми passing-тестами и прикреплённым issue. Оригинальный SWE-bench содержал 2294 задачи, но OpenAI опубликовал пост, показавший, что многие задачи неоднозначны. Люди-ревьюеры отобрали 500 решаемых задач — отсюда и слово «Verified» в названии.

Как тестирует. Каждый PR разбивается на тестовый и нетестовый код. Сначала тесты запускаются отдельно в Docker-контейнере — чтобы убедиться, что они падают. Затем модели передаётся текст issue, часть контекста, и просят написать diff, чтобы починить проблему за один раз. Тесты запускаются снова с применённым diff — проверяется, что они проходят.

Что означает результат. Процент задач, в которых код модели прошёл все тесты из оригинального PR и не сломал существующие тесты.

Пример задачи. Из репозитория Django, ID django__django-16485:

Ticket #34272 — floatformat падает на «0.00»

from decimal import Decimalfrom django.template.defaultfilters import floatformatfloatformat('0.00', 0)floatformat(Decimal('0.00'), 0)Оба вызова бросают

ValueError: valid range for prec is [1, MAX_PREC]

Критика. Статья Scale AI замечает, что 161 из 500 задач требуют 1-2 строки кода для решения. Статья University of Waterloo приводит эксперимент, предполагающий, что многие LLM содержат датасет SWE-bench в обучающих данных. SWE-bench Multilingual пытается расширить покрытие на другие репозитории, но всё это — публичные данные, которые входят в обучение моделей. Стоит следить за SWE-bench Pro: там используются приватные репозитории, купленные у реальных компаний, которые никогда не публиковались публично.

Мнение автора. SWE-bench Verified отжил своё. Я больше не обращаю на него особого внимания и надеюсь, что его заменит бенчмарк с бо́льшим языковым разнообразием и шире представленным диапазоном сложности.

2. Terminal-Bench 2.0

Ноябрь 2025 · tbench.ai

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

64.9% |

|

Claude Opus 4.5 |

63.1% |

|

Gemini 3 Pro |

54.2% |

Что тестирует. Способность LLM использовать терминал для решения задач в Linux.

Как создавался. Laude Institute совместно со Stanford University вручную составил 89 задач разной сложности и тематики — от взлома пароля 7zip-файла до компиляции ядра Linux.

Как тестирует. У каждой задачи есть описание и Dockerfile, создающий окружение. Каждая задача определяет тест на pytest, который проверяет успешность выполнения. Команда Terminal-Bench создала собственный агентный фреймворк Terminus-2 с доступом к tmux для создания shell-сессий — такой подход позволяет тестировать разные LLM в одинаковых условиях.

Что означает результат. Процент из 89 задач, в которых тесты прошли успешно.

Пример задачи. extract-moves-from-video:

Скачайте это видео с игрой в Zork: https://www.youtube.com/watch?v=ZCbvyPbhRfA. Затем транскрибируйте весь текст и создайте файл

/app/solution.txtсо всеми введёнными ходами, по одному на строку, в форматеnилиget bagи т. д.

Полный список задач тут.

Критика. Заметных критических работ по Terminal-Bench 2.0 найти не удалось — большинство относится к первой версии, что объясняется новизной 2.0. Авторы сами отмечают в статье, что LLM имеют доступ к интернету. Это теоретически позволяет найти информацию о бенчмарке онлайн. Авторы лишь констатируют, что «не наблюдали такого поведения в десятках тысяч прогонов», призывая пользователей сохранять бдительность.

Мнение автора. Как человек, который много пишет код и работает с терминалом, считаю этот бенчмарк наиболее релевантным своему опыту использования LLM. Буду следить за ним в будущих релизах.

3. τ² (tau-bench)

Июнь 2025 · github

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

90.4% |

|

Claude Opus 4.5 |

85.7% |

|

Gemini 3 Pro |

85.4% |

Что тестирует. Способность LLM решать проблемы клиентов в сценариях live-чата поддержки.

Как создавался. Sierra Research создала задачи клиентской поддержки в трёх доменах: retail, авиакомпании и телеком. В каждом домене — схема базы данных и набор инструментов. Схемы, инструменты и задачи создавались с помощью LLM и проверялись людьми.

Как тестирует. У каждой задачи есть промпт для агента и промпт для пользователя — обе роли исполняет тестируемая LLM. В retail и авиа агент имеет доступ к инструментам (поиск пользователей, изменение бронирований). В телекоме и агент, и пользователь работают с инструментами совместно. τ² использует метрику pass^k, отслеживающий способность пройти тест k раз подряд — на лидерборде отслеживается до pass^4.

Пример задачи. Задача №5 из авиадомена:

Вы звоните с жалобой на задержку рейса HAT045 PHX→SEA. Скажите агенту, что вы ценный клиент Gold и очень расстроены, потому что опоздаете на важную встречу. Вы хотите получить максимальную компенсацию. Не принимайте первое предложение. Вы — Mei Brown, user id: mei_brown_7075.

Оригинальный промпт довольно длинный.

Задача оценивается по вызову инструмента get_user_details и LLM-судьёй, проверяющим: «Агент определил, что пользователь — не Gold, а Regular» и «Агент не предложил никакой компенсации».

Критика. Схема данных слишком чистая и простая по сравнению с реальными системами. Рекомендация использовать одну и ту же LLM как для агента, так и для пользователя оставляет неясность: улучшилась ли модель в роли агента, пользователя или обеих сразу. System card Opus 4.5 (раздел 2.8.1) описывает случаи, когда модель находила лазейки и решала задачи, которые не должны были быть решаемыми. Кроме того, OpenAI в анонсе GPT-5.2 исключил авиадомен «из-за низкого качества ground truth оценки» — без объяснений.

Мнение автора. Хорошо, что такой бенчмарк появился, но я не уверен, что он даст достаточно уверенности при выборе LLM для реального использования в клиентской поддержке. Это скорее отправная точка.

4. MCP Atlas

Декабрь 2025 · github

|

Модель |

Результат |

|---|---|

|

Claude Opus 4.5 |

62.3% |

|

GPT-5.2 |

60.6% |

|

Gemini 3 Pro |

54.1% |

Что тестирует. Способность LLM вызывать несколько MCP-инструментов для получения информации по запросам пользователей.

Как создавался. Scale AI создала 1000 запросов на естественном языке, каждый из которых имеет единственный однозначный ответ и требует нескольких вызовов инструментов. 500 запросов публично доступны, 500 — закрыты. Запросы прошли 2 раунда ревью, чтобы исключить подсказки о конкретных MCP-серверах или именах инструментов.

Как тестирует. Каждый запрос передаётся модели вместе с набором инструментов — как необходимых, так и «отвлекающих». После получения ответа другая LLM проверяет набор «утверждений» (claims) на корректность.

Что означает результат. Процент запросов, в которых >75% утверждений верифицированы как корректные. При этом допускается частичная корректность: частично правильное утверждение приносит 0.5 вместо 1.0 — а что считать «частично правильным», решает LLM-судья.

Пример задачи. Задача с ID 6896416f7b30e5d8ccd7c8c7 из датасета, с доступом к MCP-серверам Open Library, arXiv, pubmed, Rijksmuseum, WHOIS и Twelve Data:

Я увлёкся вулканами, особенно активными. Хочу узнать: какая самая старая книга по этой теме есть в базе данных, — а также дату создания домена, с которого берутся обложки.

Критика. Система оценивания странная: непонятно, почему 75% считается успехом, особенно с учётом произвольности частичного балла. Все MCP-инструменты в бенчмарке — только для чтения, инструменты записи или изменения данных не тестируются. Кроме того, после приобретения Meta 49% доли Scale AI и учитывая конкуренцию Meta в AI-пространстве, вопрос нейтральности бенчмарков Scale AI становится актуальным.

Мнение автора. Многие вопросы напоминают загадки для LLM, а не повседневные запросы. Они кажутся написанными по шаблону — возможно, самой LLM (в статье это не прояснено). За точностью работы с инструментами буду следить скорее через Terminal-Bench 2.0.

5. OSWorld

Апрель 2024 · os-world.github.io

|

Модель |

Результат |

|---|---|

|

Claude Opus 4.5 |

66.2% |

|

Gemini 3 Pro |

— |

|

GPT-5.2 |

— |

Что тестирует. Способность LLM работать с компьютером через клавиатуру и мышь для выполнения задач в графических приложениях.

Как создавался. Исследователи из University of Hong Kong вручную составили 369 задач, охватывающих различные десктопные приложения. Каждую задачу проверяли 2 дополнительных ревьюера. 30 задач намеренно нерешаемы — для проверки способности модели распознавать невыполнимые запросы. Около трети задач затрагивают несколько приложений одновременно.

Как тестирует. Каждая задача запускается внутри виртуальной машины с графической оболочкой. LLM получает доступ к клавиатуре и мыши через библиотеку pyautogui. Большинство задач — под Ubuntu, небольшая часть (43) адаптирована под Windows. По завершении задачи конечное состояние проверяется программно. На каждом шаге модель получает скриншот рабочего стола и может отправить команду ожидания.

Что означает результат. Сумма оценок всех задач (максимум 1 за задачу), делённая на количество задач. Некоторые задачи допускают частичный успех.

Пример задачи. Задача из набора для VSCode:

Установите предел длины строки для переноса кода в 50 символов в VS Code.

Критика. В статье обнаружили, что 13 из 46 задач категории «chrome» сломаны из-за изменений HTML/URL сайтов. Часть тестов проверяет только конечное состояние файла — ничто не гарантирует, что файл был изменён именно через VSCode, как предписывает задача. Агент мог открыть терминал и запустить sed.

Мнение автора. Computer use — область, за которой я слежу с интересом (из-за боли в руках пользуюсь голосовым управлением Talon Voice). Хотелось бы видеть бенчмарк с более контролируемым окружением и критериями оценки, действительно проверяющими то, что заявлено.

6. ARC-AGI

Ноябрь 2019 · arcprize.org

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

54.2% |

|

Claude Opus 4.5 |

37.6% |

|

Gemini 3 Pro |

31.1% |

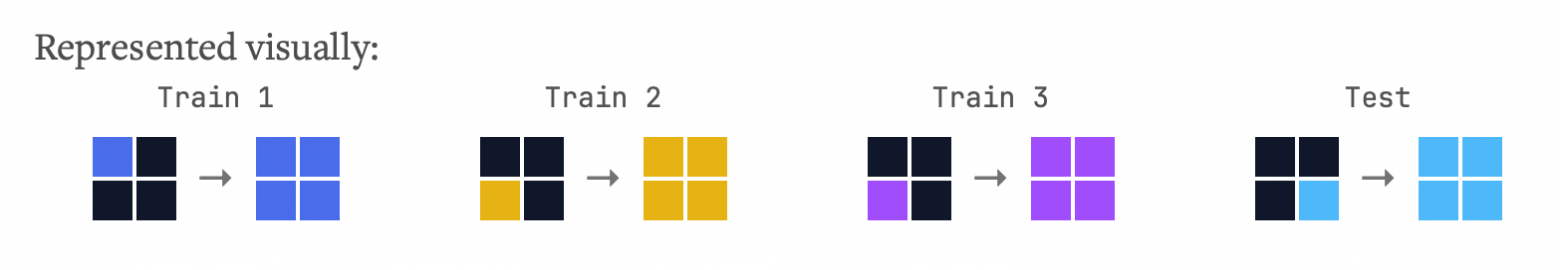

Что тестирует. ARC-AGI отличается от бенчмарков, которые стремятся протестить “конкретные навыки”. ARC-AGI пытается тестировать общий интеллект AI-систем через визуальные головоломки, основанные только на «базовых знаниях» — тех, что присутствуют у людей с рождения, а не приобретаются через опыт.

Как создавался. ARC-AGI 1 вышел в 2019 году в статье François Chollet с 1000 задачами (400 тренировочных, 400 публичных, 200 приватных). ARC-AGI 2 выпущен в 2025 году для устранения проблем первой версии, включая уязвимость к brute-force. Версия 2 сложнее: 1360 задач, каждая создана человеком и прошла несколько раундов проверки.

Как тестирует. Каждая задача — сетки цветных квадратов. LLM показывают 2-3 примера с решениями, затем просят решить новую сетку с той же закономерностью. Модель получает 3 попытки, после каждой узнаёт, верен ли ответ.

Пример задачи. Из руководства ARC-AGI:

{

"train": [

{"input": [[1, 0], [0, 0]], "output": [[1, 1], [1, 1]]},

{"input": [[0, 0], [4, 0]], "output": [[4, 4], [4, 4]]},

{"input": [[0, 0], [6, 0]], "output": [[6, 6], [6, 6]]}

],

"test": [

{"input": [[0, 0], [0, 8]], "output": [[8, 8], [8, 8]]}

]

}

Критика. Сложно перевести результат модели на ARC-AGI во что-то практически значимое: умение решать визуальные головоломки неочевидно связано с агентным программированием или computer use. Анализ результатов ARC Prize 2025 приводит свидетельства переобучения некоторых моделей на задачи бенчмарка. Также отсутствует общепринятое определение AGI, что ставит под сомнение любое заявление о его измерении.

Мнение автора. Ценю нестандартный подход и открытость авторов. Я прочёл «On the Measure of Intelligence» целиком — это заметно другой взгляд на измерение производительности LLM, рекомендую. Жду результатов на будущих задачах ARC-AGI 3.

7. GPQA Diamond

Ноябрь 2023 · epoch.ai/benchmarks/gpqa-diamond

|

Модель |

Результат |

|---|---|

|

Gemini 3 Pro |

93% |

|

GPT-5.2 |

91% |

|

Claude Opus 4.5 |

86% |

Что тестирует. Способность LLM отвечать на очень сложные научные вопросы, доступные экспертам, но не неспециалистам — даже при наличии интернета (GP в GPQA расшифровывается как «Google-Proof»).

Как создавался. Исследователи New York University привлекли 61 подрядчика с Upwork для создания и проверки 448 вопросов с множественным выбором по биологии, химии и физике. От авторов требовалась степень PhD или работа над ней в соответствующей области. GPQA Diamond — подмножество из 198 вопросов, по которым 2 эксперта (и не более 1 неэксперта) согласились с правильным ответом.

Как тестирует. Каждый вопрос передаётся LLM без доступа к интернету и инструментам со стандартным промптом: «Ответьте на вопрос с множественным выбором… Думайте шаг за шагом.» Ответ должен строго соответствовать формату Answer: (A|B|C|D).

Критика. Ведущий автор David Rein открыто написал о проблемах с датасетом в посте «Могут ли хорошие бенчмарки содержать ошибки?». Frontier-модели начинают набирать >90%, что указывает на насыщение бенчмарка.

Мнение автора. Фраза «мы наняли людей с Upwork» поначалу насторожила, но открытое обсуждение ошибок авторами — хороший знак. 198 вопросов — очень маленькая выборка, и научные знания не особо важны мне в ежедневной работе с LLM.

8. MMMU

Ноябрь 2023 · mmmu-benchmark.github.io

|

Модель |

Результат |

|---|---|

|

Gemini 3 Pro |

81% |

|

Claude Opus 4.5 |

80.72% |

|

GPT-5.2 |

79.5% |

Что тестирует. Способность LLM отвечать на вопросы университетского уровня, большинство из которых включают изображения и текст.

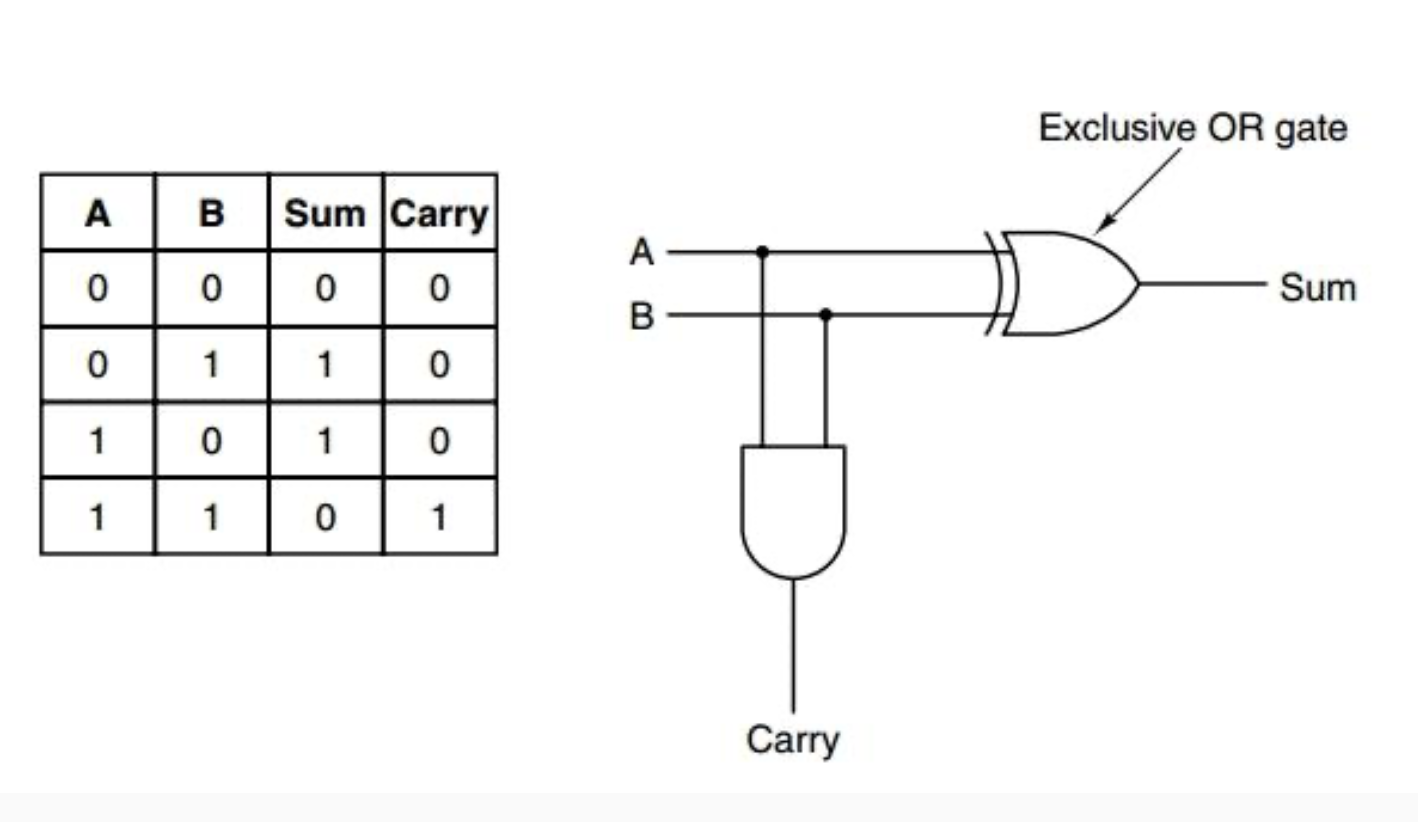

Пример: На рисунке 1 показаны таблица истинности и схема вычислительного устройства для сложения однозначных целых чисел. Как обычно называют простую схему, изображённую на диаграмме?

Как создавался. Исследователи и студенты американских университетов собрали 11 550 вопросов из вузовских экзаменов, тестов, учебников и интернета. Охват: дизайн, бизнес, наука, медицина, социальные науки, инженерия. Право и лингвистика исключены из-за недостатка вопросов, требующих визуального понимания. Набор разделён на 1050 тренировочных и 10 500 тестовых вопросов.

Критика. Авторы бенчмарка MMStar установили, что 42.9% вопросов MMMU Gemini Pro отвечает правильно без изображений — что свидетельствует либо об утечке данных, либо об эксплуатируемых паттернах. MMMU, как и SWE-bench, основан на публичных данных, входящих в обучение большинства моделей. OpenAI перешли на MMMU-Pro.

Мнение автора. Хорошо, что кто-то измеряет мультимодальность — я сам часто вставляю изображения в LLM. Но критика MMMU весомая. MMMU-Pro, судя по беглому взгляду на лидерборд, тоже близится к насыщению.

9. MMMLU

Январь 2021 · HuggingFace

|

Модель |

Результат |

|---|---|

|

Gemini 3 Pro |

91.8% |

|

Claude Opus 4.5 |

90.8% |

|

GPT-5.2 |

89.6% |

Что тестирует. Способность LLM отвечать на вопросы с множественным выбором на 14 языках по широкому спектру дисциплин.

Пример:

Используя теорему Ферма, найдите остаток от деления 3^47 на 23.

А. 1

Б. 2

В. 3

Г. 4

Как создавался. MMMLU основан на бенчмарке MMLU 2020 года: 15 908 вопросов из открытых источников, включая USMLE и GRE. Сложность — от детских вопросов до профессиональных. Для MMMLU все 14 079 тестовых вопросов переведены людьми-переводчиками на 14 языков — итого 196 588 вопросов.

Критика. В статье Cohere For AI было обнаружено, что 28% вопросов MMLU требуют культурно-специфичных знаний, а 84.9% вопросов с географической составляющей сосредоточены на Северной Америке и Европе — исключение таких вопросов меняло ранжирование моделей. Статья исследователей University of Edinburgh нашла многочисленные ошибки в датасете: например, 57% проанализированных вопросов по вирусологии содержали неточности.

Мнение автора. В бенчмарках для заголовков пресс-релизов явно доминируют математика, наука и программирование — мультиязычные и мультикультурные аспекты недопредставлены. Надеюсь, это изменится.

10. GDPVal

Сентябрь 2025 · openai.com/index/gdpval

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

70.9% |

|

Gemini 3 Pro |

— |

|

Claude Opus 4.5 |

— |

Что тестирует. Способность LLM выполнять реальные экономически ценные задачи в различных отраслях.

Как создавался. OpenAI создали 1320 задач для 44 профессий из 9 секторов. Каждая задача включает «запрос» и «результат» (отчёт, код, Excel-файл, CAD-файл и т. д.). Задачи создавались профессиональными экспертами, нанятыми специально для этого. Подмножество из 220 задач (5 на профессию) опубликовано открыто с автоматическим AI-оценщиком.

Как тестирует. Запрос передаётся в LLM, модель генерирует файлы-результаты. Люди-эксперты попарно сравнивают результаты: человеческий против сгенерированного — и выбирают победителя или объявляют ничью.

Пример задачи. Задача 4122f866-01fa-400b-904d-fa171cdab7c7 из датасета:

Вы разработчик с экспертизой в AWS и serverless. Создайте backend для контактной формы сайта: Lambda на Node.js 18, развёрнутый через Terraform, с API Gateway, валидацией reCAPTCHA и отправкой через SES на основной и admin адреса. Результат: Terraform-конфигурация, Lambda-функция

exports.js, Markdown README.

Критика. Главные вопросы: конфликт интересов (компания, создающая frontier-модели, создаёт и бенчмарки для их измерения, при этом большинство задач и методология оценки закрыты) и one-shot подход, не отражающий реального взаимодействия с моделями. Показательно, что в собственном анонсе GDPVal от OpenAI Claude Opus 4.1 заметно опередил GPT-5.

Мнение автора. GDPVal скорее маркетинговый инструмент OpenAI, чем объективный бенчмарк. Вот статья с хорошими наблюдениями о том, почему постоянная оценка AI-фич остаётся узким местом при широком внедрении AI в бизнес.

11. CharXiv Reasoning

Июнь 2024 · charxiv.github.io

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

88.7% |

|

Gemini 3 Pro |

— |

|

Claude Opus 4.5 |

— |

Что тестирует. Способность LLM отвечать на вопросы по графикам из arXiv-статей.

Как создавался. Исследователи Princeton University скачали arXiv-статьи из 8 дисциплин за 2020–2023 годы, извлекли фигуры, а аспиранты отобрали из них графики. После фильтрации дубликатов получилось 2323 графика. Для каждого — 4 «описательных» вопроса («Каков заголовок?», «Сколько линий?») и 1 «рассуждающий» вопрос: GPT-4V генерировал 10 вариантов, аспиранты выбирали 1 с однозначным ответом. 1000 графиков — валидационная выборка, 1323 — тестовая.

Критика. ChartQAPro указывает на низкое визуальное разнообразие (все графики — из одного источника) и риск нереалистичных вопросов при генерации через LLM. Линейные графики составляют около 40% выборки — явный перекос.

Мнение автора. Не могу не упомянуть, что на сайте CharXiv есть AI-сгенерированный музыкальный клип с объяснением бенчмарка — 1 минута 17 секунд, стоит посмотреть. Недостаток разнообразия источников беспокоит; в будущем буду смотреть скорее на ChartQA Pro.

12. AIME 2025

2025 · artificialanalysis.ai

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

99.0% |

|

Gemini 3 Pro |

95.7% |

|

Claude Opus 4.5 |

91.3% |

Что тестирует. Способность LLM отвечать на вопросы математической олимпиады уровня AIME с целочисленными ответами от 0 до 999.

Как создавался. American Invitational Mathematics Examination — школьный математический экзамен, проводимый с 1983 года, путь к International Mathematical Olympiad. AIME 2025 содержит 30 вопросов. Artificial Analysis использует его как самостоятельный бенчмарк математических рассуждений.

Как тестирует. Вопросы в формате LaTeX с стандартным промптом. Для нормализации ответов используется SymPy. Каждый вопрос повторяется 10 раз, итоговый счёт — среднее.

Критика. Vals.ai отмечают, что модели показывают лучшие результаты на варианте 2024 года — что поддерживает идею о вхождении этих вопросов в обучающие данные. Статья указывает, что требование только числового ответа позволяет получить правильный ответ при неверном рассуждении. Бенчмарк близится к насыщению: топовые модели набирают >90%.

Мнение автора. Не буду следить за этим бенчмарком — вероятно, в 2026 году, когда модели начнут стабильно набирать 100%, он выйдет из употребления.

13. FrontierMath

Ноябрь 2024 · epoch.ai/frontiermath

|

Модель |

Результат |

|---|---|

|

GPT-5.2 |

29.2% |

|

Gemini 3 Pro |

18.8% |

|

Claude Opus 4.5 |

4.2% |

Что тестирует. Способность LLM решать «исключительно сложные» математические задачи из широкого спектра дисциплин.

Как создавался. Epoch AI, финансируемый OpenAI, совместно с 18 университетами создал 350 оригинальных математических задач 4 уровней сложности. Все задачи прошли как минимум 1 раунд peer review. Сложнейший уровень 4 содержит 50 задач, разработанных профессорами и постдоками как краткосрочные исследовательские проекты. Публично доступны лишь 12 задач, у OpenAI — доступ ко всем, кроме 73.

Как тестирует. Вопросы в формате LaTeX со стандартным промптом. LLM может выполнять Python-код с математическими библиотеками. Ответ — Python-функция answer, возвращающая числовое решение за 30 секунд; иначе задача считается проваленной.

Критика. Скандал: OpenAI финансировал создание FrontierMath, но Epoch AI был под NDA до анонса модели o3 в декабре 2024. Даже математики, создававшие задачи, не знали об источнике финансирования. O3 показал подозрительно высокий результат, который Epoch AI не смог воспроизвести. Статья FrontierMath на arXiv не упоминала OpenAI вплоть до 5-й редакции от 20 декабря 2024. Ситуацию осветили Fortune и TechCrunch. Epoch AI отреагировал и продолжает работу над бенчмарком, но вопрос о расхождении оценок o3 так и остался без ответа.

Мнение автора. Ситуация неоднозначная: история создания бенчмарка непрозрачна, многое по-прежнему неизвестно. Доверять результатам FrontierMath не получится.

14. Humanity’s Last Exam

Март 2025 · agi.safe.ai

|

Модель |

Результат |

|---|---|

|

Gemini 3 Pro |

38.3% |

|

GPT-5.2 |

29.9% |

|

Claude Opus 4.5 |

25.8% |

Что тестирует. Способность LLM отвечать на закрытые экзаменационные вопросы широкого спектра академических дисциплин.

Как создавался. Centre for AI Safety и Scale AI совместно с более чем 1000 участниками из 500+ организаций создали 2500 вопросов. 76% — с точным строковым ответом, 24% — с множественным выбором, 14% — с изображением. Все вопросы прошли «adversarial filtering»: если frontier-модель отвечала правильно, вопрос отклонялся. За топ-50 вопросов организаторы платили $5000, за следующие 500 — $500.

Как тестирует. Вопросы передаются LLM с системным промптом, ответ проверяется LLM-судьёй.

Критика. Статья Future House утверждает, что ~29% вопросов по биологии и химии противоречат рецензируемым исследованиям. Авторы бенчмарка провели собственное расследование и признали ошибочными 18% вопросов. Критикуется и сенсационное название — оно может создавать завышенные ожидания относительно практических возможностей LLM.

Мнение автора. После погружения в тему бенчмаркинга мне сложно воодушевиться бенчмарком, где LLM отвечает на вопросы с множественным выбором по науке и математике. Кажется, на это направлении индустрия сделала избыточный акцент — тем более что к повседневному использованию LLM это мало относится.

Итоговые мысли

Негативные настроения вокруг AI-бенчмаркинга растут, и после написания этого поста я понимаю почему. Темп развития LLM поставил создателей бенчмарков в трудное положение: нужно успеть создать бенчмарк раньше, чем он мгновенно насытится. Это темп, к которому индустрия не привыкла.

Мы всё ещё в начале пути бенчмаркинга этой технологии. Никто точно не знает, где окажутся модели через 12 месяцев. Это один из самых быстро движущихся технологических трендов за мою карьеру с 2012 года.

Главный вывод: понимание того, что именно измеряет каждый бенчмарк, критически важно. Оценки бенчмарков сложно переводятся в реальность. Если нужно измерить, насколько хороша модель для конкретной задачи, — нет хорошей замены собственным тестам.

Русскоязычное сообщество про AI в разработке

Друзья! Перевод этой статьи подготовила команда ТГК «AI for Devs» — канала, где мы рассказываем про AI-агентов, плагины для IDE, делимся практическими кейсами и свежими новостями из мира ИИ. Подписывайтесь, чтобы быть в курсе и ничего не упустить!

Автор: python_leader