Я работаю в PR с 2001 года. Тогда профессия пиарщика активно развивалась, на рынке было много политтехнологов и консультантов. За 25 лет профессия сильно трансформировалась, в том числе и по части подготовки контента в различных форматах. И если раньше мы по крупицам собирали информацию и превращали ее в разные материалы, то сегодня контент создается намного быстрее.

Помню, сама готовила колонки в бизнес-СМИ по расшифровкам аудио от визионеров рынка. Ловила вдохновение, искала цифры и расспрашивала коллег про релевантные примеры, подбирала правильные слова и старалась соответствовать ToV (tone of voice). Сегодня c помощью ИИ-технологий пишутся тексты разного уровня сложности, собирается недостающая информация, цифры, кейсы, находятся интересные и нестандартные примеры. Тут явно много плюсов по экономии времени, ресурса, наполнению материала. Но с каждым разом отчетливо начинаешь осознавать, что, возможно, текст на выходе не так уж и уникален, информация в нем как-то использовалось ранее, где-то публиковалась. А ведь изначально задумывался новый, уникальный материал.

Такие же примерно чувства испытываешь, когда статью присылает на рассмотрение будущий автор. Каждый раз читаешь ее с мыслью: а уникальный ли это контент? Написано самостоятельно, по собственным примерам, тут нет нагенерированных нейронкой кусочков? Со временем стала задумываться – а как проверить? Ведь продвинутые модели генерят текст очень нативным языком, почти не отличить от естественного. Я стала искать материалы по теме – выручили наши техрайтеры, предложив почитать статью в журнале Multilingual, как раз про выявление элементов ИИ в тексте. Это довольно сложный лингвистический материал, но и упрощать тему не хочется.

В общем, делюсь статьёй с вами, вдруг вы тоже горите желанием, как и я, разобраться, где заканчивается экспертный опыт, творчество и труд и начинается ИИ.

Войчех Волошик и Марта Домашк

Как определить, что текст был создан с помощью ИИ

Гибридный лингвистический подход

Стремительное развитие инструментов написания текстов с помощью искусственного интеллекта (ИИ) создает новые трудности при проверке подлинности таких текстов. По мере совершенствования языковых моделей разница между текстом, написанным человеком, и материалом, сгенерированным ИИ, становится все менее очевидной. Вопрос о подлинности узкоспециализированных текстов стоит особенно остро. В статье описана гибридная методология, позволяющая выявить использование искусственного интеллекта при написании текста.

Наш подход сочетает вычислительный и лингвистический анализ и вместо строгой бинарной классификации предлагает оценку вероятности. Например, заключение может быть сформулировано так: «Текст сгенерирован ИИ с вероятностью 94%». Такой гибкий подход чрезвычайно востребован в профессиональных сферах, где подлинность текста особенно важна для обеспечения качества, соблюдения нормативных требований и защиты интеллектуальной собственности.

Гибридная методология

Наша методология объединяет в себе автоматизированный анализ и лингвистическую оценку, основанную на научных исследованиях:

-

Мы провели всесторонний анализ современных работ в области распознавания текстов, сгенерированных ИИ. В частности, мы изучили статьи Георгиу (2024), Шааффа и соавторов (2024), Фрейзера (2024) и Муньос-Ортиса и соавторов (2024).

-

Мы выяснили, что платформа Open Brain AI, изначально разработанная для анализа неврологических заболеваний, может быть адаптирована для проверки подлинности текстов. Система одновременно анализирует множество лингвистических параметров, но при этом сама по себе подлинность не оценивает.

-

Опираясь на научную литературу, мы выделили ключевые параметры для определения участия ИИ в создании текстов и присвоили им весовые коэффициенты.

-

Путем эмпирического тестирования мы проверили наш подход на текстах разной длины и тематики.

Платформа Open Brain AI была создана Хараламбосом Темистоклеусом для неврологов, практикующих врачей и исследователей речевых и языковых особенностей, связанных с неврологическими заболеваниями. Open Brain AI анализирует текст по шести направлениям (фонология, морфология, синтаксис, лексика, семантика и удобочитаемость) и позволяет провести точные измерения, которые и легли в основу нашей методологии. Применение Open Brain AI для проверки подлинности — инновационный междисциплинарный подход к распознаванию текстов, созданных ИИ.

Наш подход включает четыре этапа:

-

Анализ текста с помощью Open Brain AI.

-

Извлечение лингвистических параметров.

-

Применение к этим параметрам формулы с весовыми коэффициентами.

-

Вычисление вероятности того, что текст был сгенерирован ИИ.

Ключевые лингвистические параметры

Статистические и вероятностные параметры

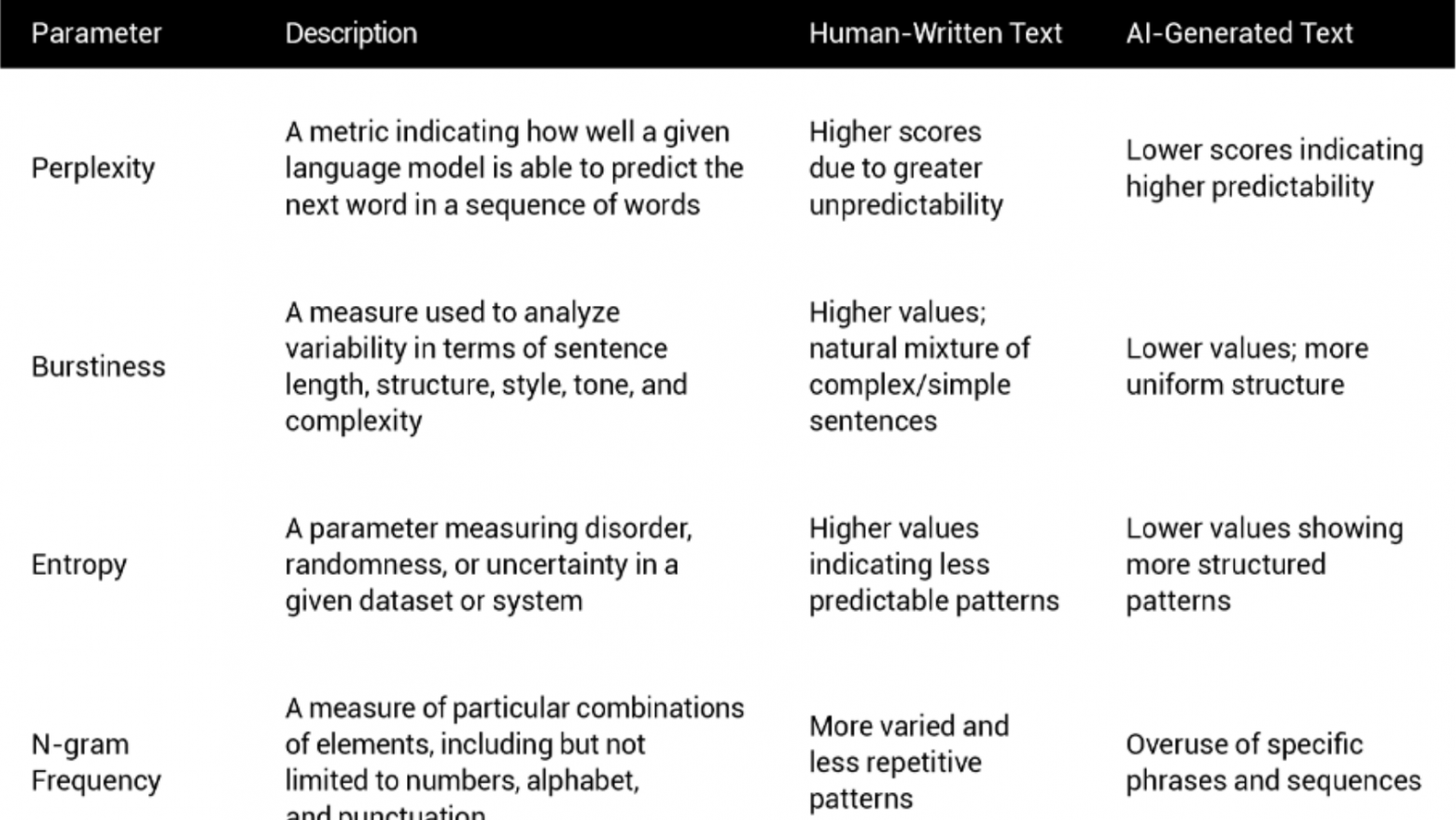

Для сравнения текстов, написанных человеком, и текстов, сгенерированных ИИ, мы исследуем ряд характеристик (табл. 1). Так, тексты, написанные человеком, демонстрируют более высокие показатели перплексии (57,3 против 37,8) и вариативности (0,61 против 0,38). Это свидетельствует о меньшей предсказуемости и использовании более разнообразных сценариев.

Различия обусловлены процессами, лежащими в основе создания текста. Материал, созданный человеком, является продуктом его творческого мышления: оно порождает разнообразные и непредсказуемые языковые конструкции. Текст, сгенерированный ИИ, при всем своем совершенстве ограничен рамками статистических вероятностей, усвоенных в ходе машинного обучения.

Отличительный почерк ИИ — более предсказуемые сценарии и более низкая энтропия. Это признак, который сохраняется даже по мере совершенствования языковых моделей.

Морфологические признаки

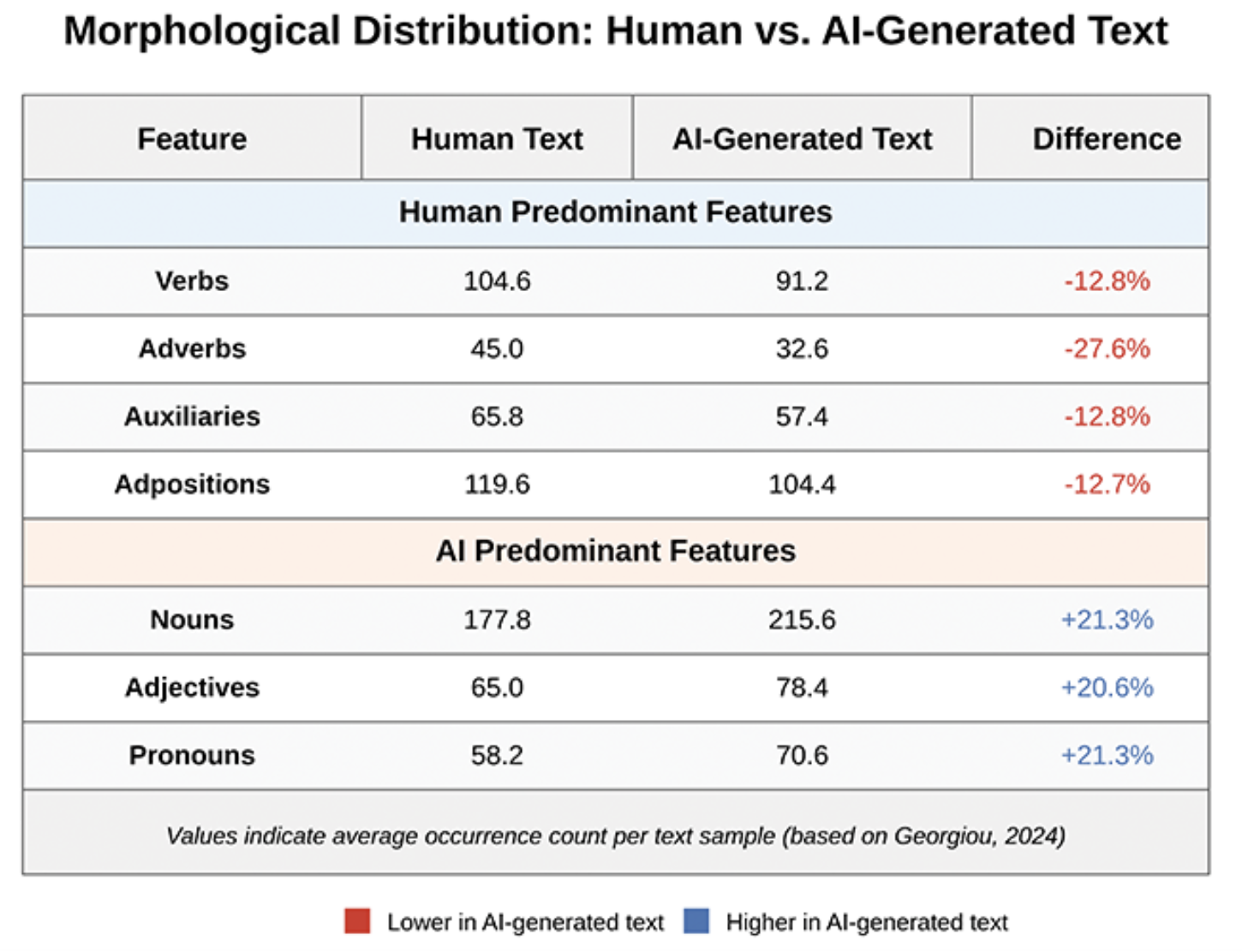

Один из самых надежных признаков того, что текст был создан ИИ, — особые закономерности при использовании частей речи. Человек использует примерно на 12,8% больше глаголов и на 27,6% больше наречий, чем ИИ, что делает язык более динамичным. Искусственный интеллект использует на 21,3% больше существительных и на 20,6% больше прилагательных, поэтому текст получается более описательным.

На рис. 1 показаны результаты морфологического сравнения текстов. Человек чаще использует глаголы, наречия, вспомогательные глаголы и предлоги (красным цветом показана отрицательная разница в процентах). Тексты, сгенерированные ИИ, содержат больше существительных, прилагательных и местоимений (синим цветом показана положительная разница в процентах). Эти особенности — надежный показатель участия ИИ в создании текстов в разных предметных областях.

Морфологические закономерности раскрывают фундаментальное различие в подходах человека и ИИ к построению предложений. Тексты, написанные человеком, как правило, более динамичны и энергичны, а сгенерированные тексты более статичны и перегружены описаниями. Это, вероятно, отражает различие в когнитивных процессах: человек естественным образом акцентирует внимание на действиях, тогда как ИИ, исходя из паттернов машинного обучения, отдает предпочтение сущностям и их атрибутам.

Синтаксические признаки

При написании предложений люди проявляют большую гибкость, чем ИИ. Они чаще используют предлоги и детерминативы (например, артикли, местоимения, числительные), создавая разнообразные языковые конструкции. Искусственный интеллект, напротив, придерживается более последовательных и предсказуемых сценариев.

Человек также демонстрирует то, что Фрейзер (2024) называет «естественной синтаксической непоследовательностью»: вариации в построении предложений, отражающие процессы мышления. Тексты, сгенерированные ИИ, часто содержат однородные синтаксические конструкции, создающие едва уловимое, но заметное единообразие, которое можно выявить при тщательном анализе.

Изучая написанный человеком текст, мы часто видим бо́льшую структурную вариативность: одни предложения короткие и простые, другие — сложные, с множеством придаточных. Тексты, созданные ИИ, имеют более однородную структуру предложений с меньшим разнообразием.

Лексические признаки

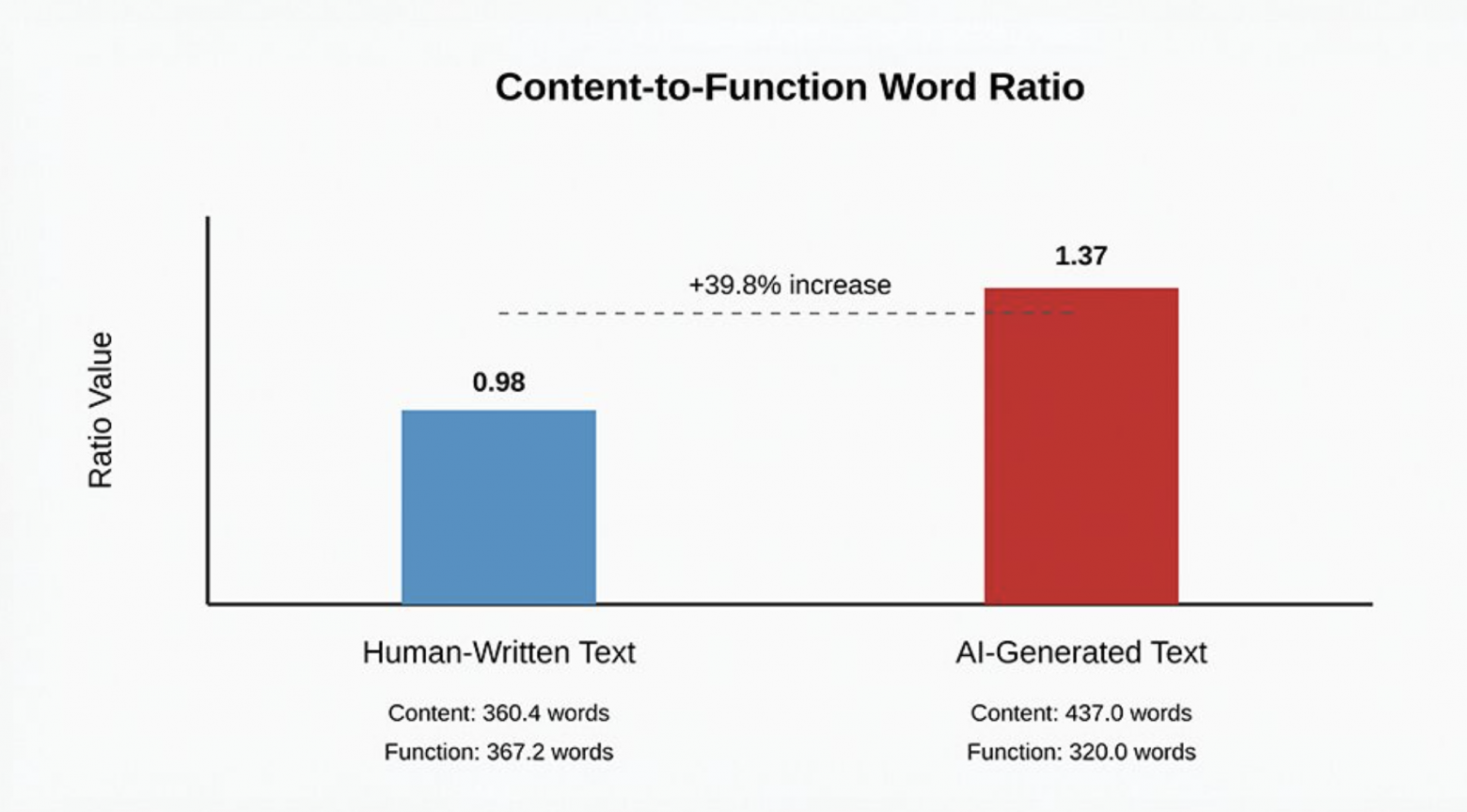

Процентное соотношение самостоятельных и служебных частей речи в текстах, созданных человеком, и текстах, сгенерированных ИИ, существенно различается (рис. 2). В текстах, написанных человеком, соотношение сбалансированное (в среднем 0,98). В сгенерированных текстах наблюдается более высокая доля самостоятельных частей речи (в среднем 1,37). Фразы ощущаются тяжеловесными: ИИ отдает преимущество словам, несущим информацию, в ущерб естественной плавности речи.

Тексты, написанные людьми, также демонстрируют большее лексическое богатство: коэффициент лексического разнообразия (type-token ratio) составляет 55,3 по сравнению с 45,5 в текстах, сгенерированных ИИ. Это говорит о более широком словарном запасе человека даже в технических сферах.

В специализированных областях лексические различия становятся особенно заметными. Люди обычно используют разнообразную лексику с тонко выверенной терминологией, что отражает глубокое знание предмета. Специализированные тексты, созданные ИИ, чаще содержат общепринятые отраслевые термины и демонстрируют меньшую креативность.

Согласно исследованию Георгиу, лексические признаки — самые надежные помощники для определения текстов, созданных ИИ. Доля этих показателей в нашей методологии составляет 25%. Лексические закономерности, соотношение самостоятельных и служебных слов помогают уверенно распознать сгенерированный текст, даже если он был отредактирован.

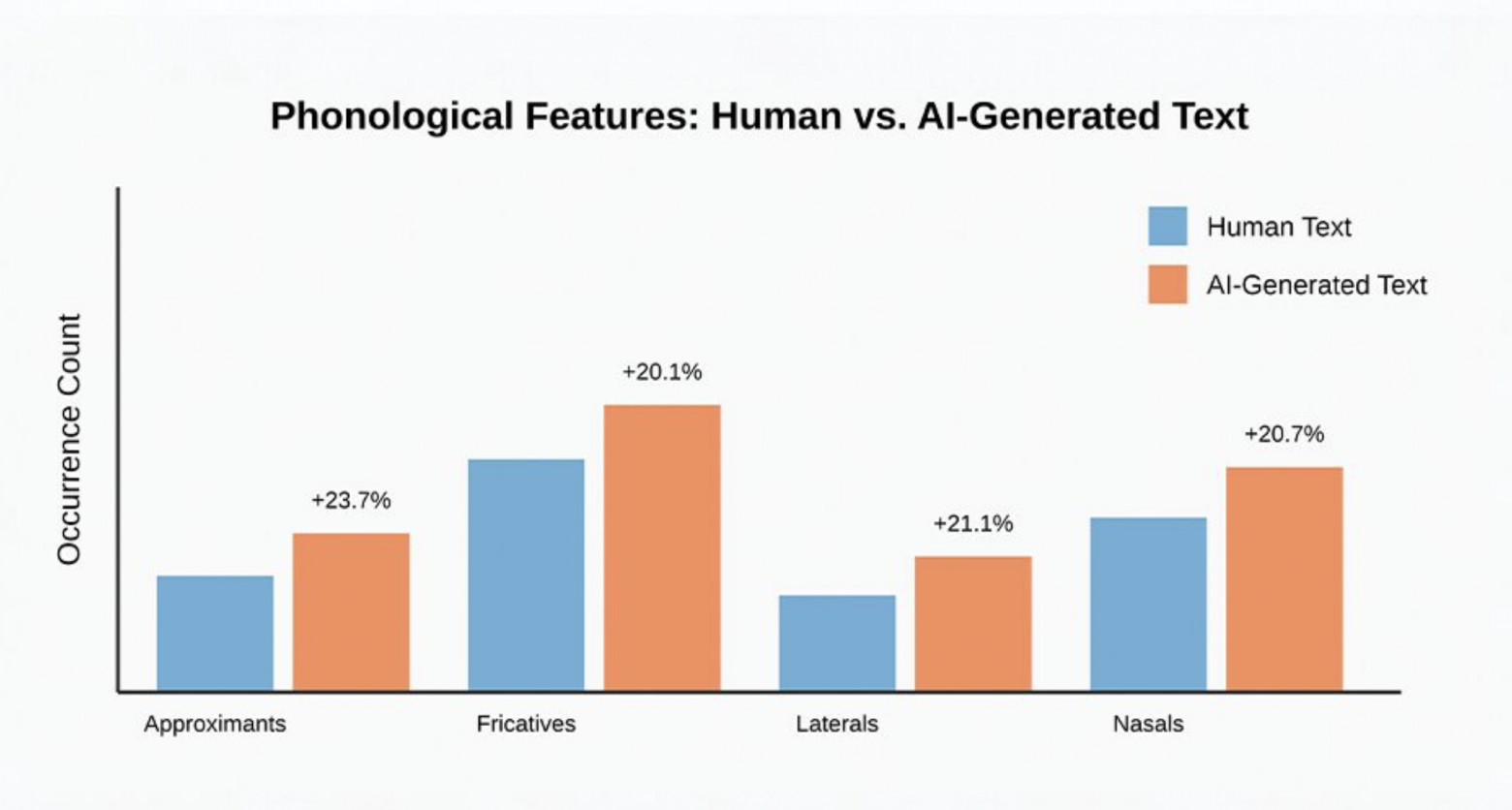

Фонологические признаки

Интересно, что звучание языка — это также ключ к определению происхождения текста. Как показано на рис. 3, в материалах, сгенерированных ИИ, наблюдается более высокая частотность согласных. Как правило, их на 20–23% больше, чем в текстах, написанных человеком. Это, вероятно, является следствием предвзятости при машинном обучении.

Фонологические различия часто сохраняются даже после существенной редактуры, что делает их одним из наиболее надежных показателей авторства ИИ.

Семантические признаки и связность

Для человека характерно последовательное развитие идей с естественными логическими переходами. Люди реже неоднозначно употребляют местоимения и реже допускают ошибки при определении отношений между элементами текста. Искусственный интеллект же демонстрирует меньшую связность в длинных текстах, особенно когда сложные темы содержат множество взаимозависимых понятий.

В текстах, написанных человеком, наблюдаются более естественные тематические переходы: идеи перетекают одна в другую логично и плавно. В свою очередь, переходы в сгенерированных текстах обычно шаблонные и предсказуемые.

Муньос-Ортис и соавторы (2024) также отмечают, что люди проявляют более широкий спектр эмоций, в особенности негативных, тогда как ИИ в целом тяготеет к позитивной тональности.

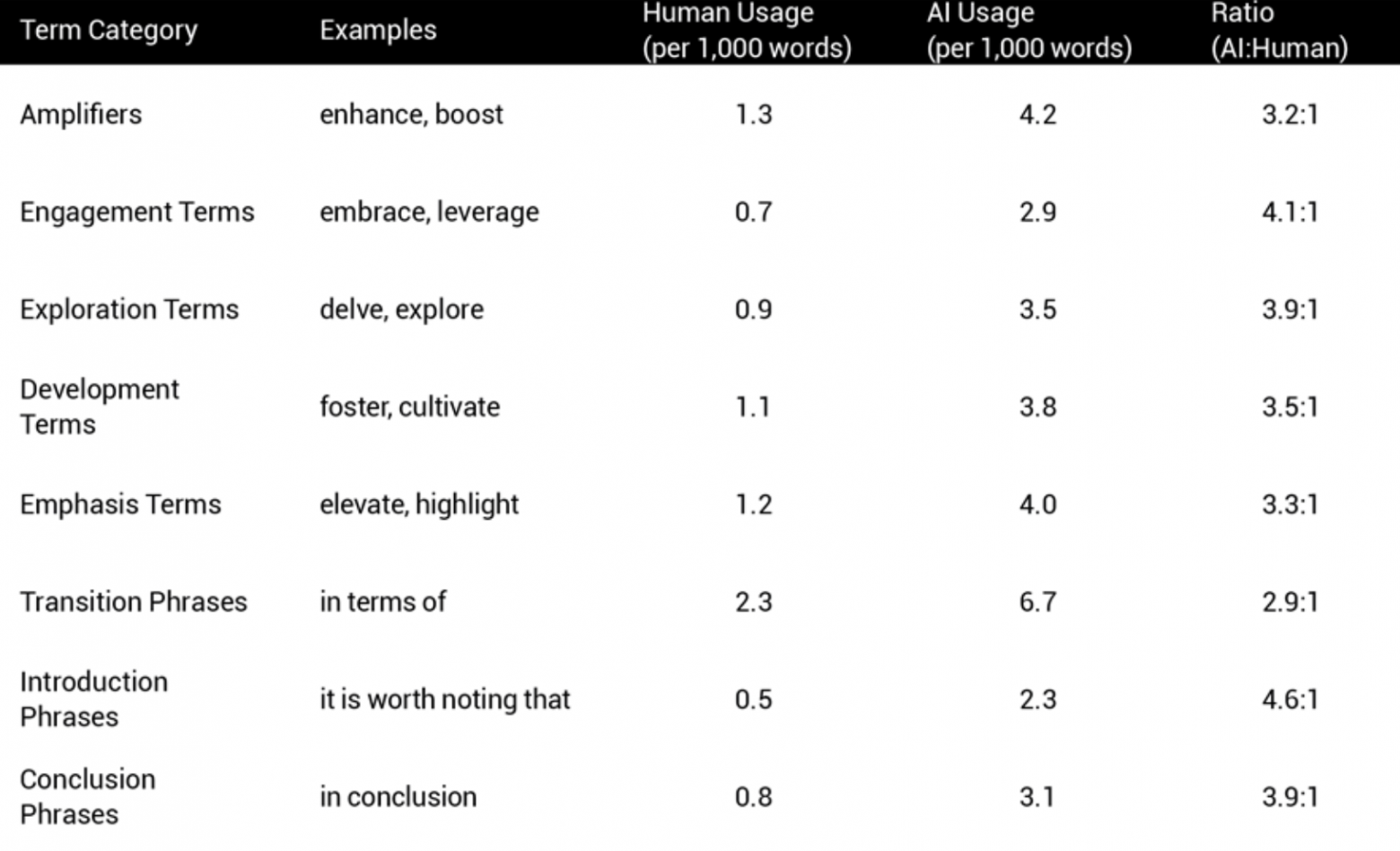

Частотный анализ используемых терминов

В текстах, созданных ИИ, некоторые выражения встречаются гораздо чаще, чем в материалах, написанных человеком (табл. 2). Конструкции наподобие «стоит отметить, что» (it is worth noting that) появляются в текстах ИИ в 4,6 раза чаще, а такие слова, как «принимать» (embrace) и «задействовать» (leverage), — в 4,1 раза чаще.

Многократное использование определенных выражений — один из самых надежных показателей авторства ИИ. Избыток некоторых слов может сохраняться, даже если другие аспекты текста были отредактированы. Отдельно взятый термин может неоднократно встречаться и в тексте, написанном человеком, но наличие целого набора таких терминов — признак того, что текст был сгенерирован.

Указанные лингвистические особенности — следствие паттернов, усвоенных ИИ во время обучения. Слова и выражения, которые часто встречаются в обучающих данных, чаще появляются и в генерируемом тексте. Люди обычно используют более разнообразную лексику, избегая шаблонных выражений и чрезмерного повторения терминов.

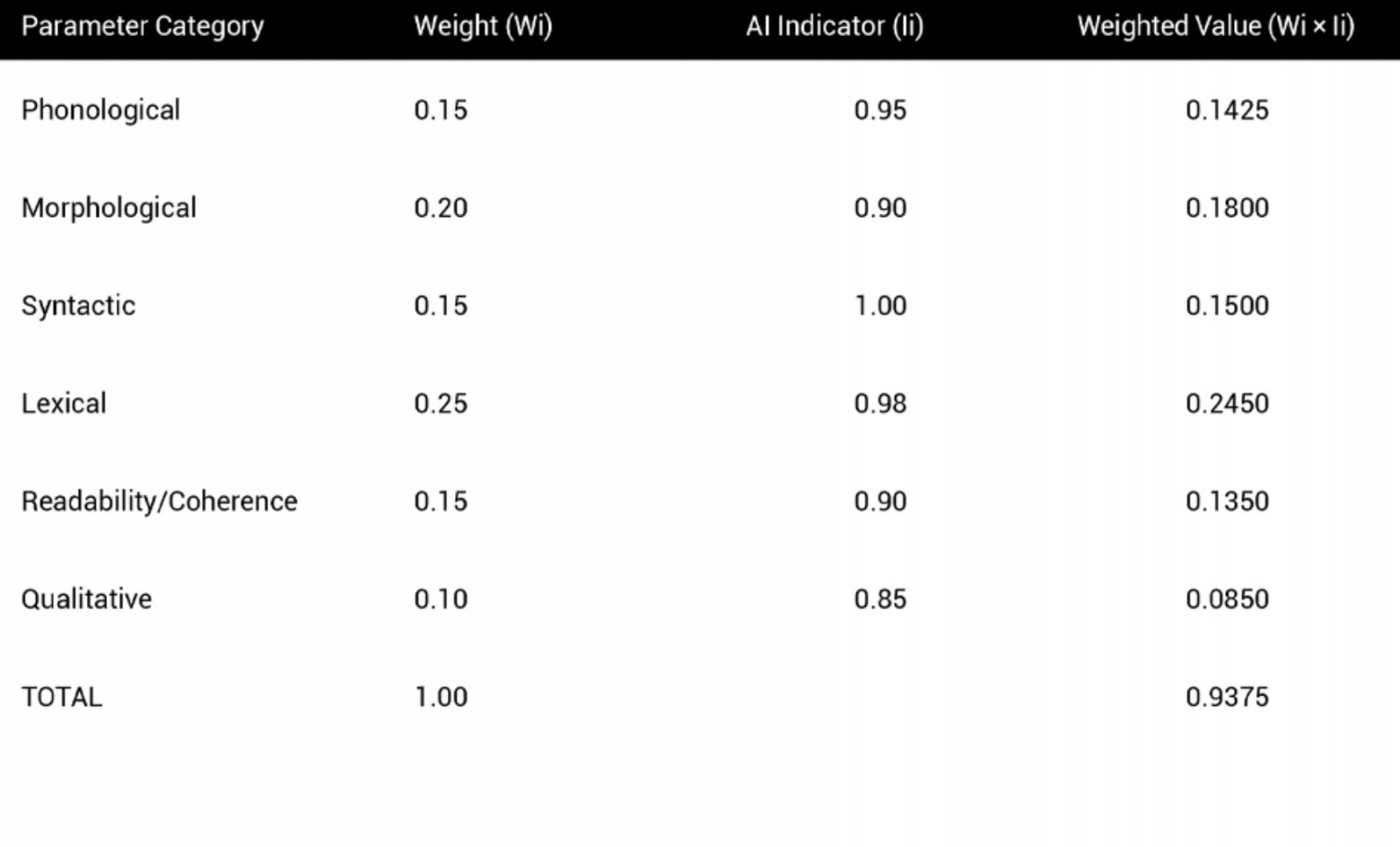

Расчет вероятности использования ИИ

В нашей методологии используется система весовых коэффициентов, объединяющая множество лингвистических показателей. Коэффициенты присваиваются показателям исходя из их надежности при определении авторства ИИ:

-

лексические параметры (25%) — выбор слов и лексическое разнообразие;

-

морфологические параметры (20%) — типы слов и части речи;

-

синтаксические параметры (15%) — структура предложений и грамматические закономерности;

-

фонологические параметры (15%) — звуковые закономерности;

-

удобочитаемость и связность (15%) — легкость восприятия текста, последовательность рассуждений;

-

качественные параметры (10%) — субъективные лингвистические особенности.

Мы определяем, насколько каждый параметр соответствует тексту человека или ИИ, присваиваем ему значение от 0 (полностью соответствует тексту человека) до 1 (полностью соответствует тексту ИИ), умножаем на заданный вес и вычисляем средневзвешенное значение. Математически это выражается следующим образом:

,где Wi — вес параметра, Ii — значение признака использования ИИ для этого параметра (от 0 до 1).

В табл. 3 показан пример расчета на основе реального анализа. Вероятность составила:

0,9375 × 100% = 93,75%.

Значение указывает на крайне высокую степень вероятности того, что текст был сгенерирован ИИ. Это подтверждается совпадением множества независимых признаков.

Наша система весовых коэффициентов неслучайна: она основана на обширных исследованиях признаков участия ИИ в создании текстов. Лексические параметры имеют наибольший вес в нашей методологии. Исследование Георгиу (2024) показало, что они являются наиболее надежными показателями использования ИИ. Морфологические признаки имеют второй по величине вес — согласно исследованиям Шааффа и соавторов (2024) и Опары (2024).

Такой многосторонний подход позволяет преодолеть ограничения, свойственные любому отдельно взятому показателю. Одиночные параметры могут давать ложноположительные или ложноотрицательные результаты. Комбинация показателей, в свою очередь, обеспечивает более надежную оценку, снижая вероятность ошибки.

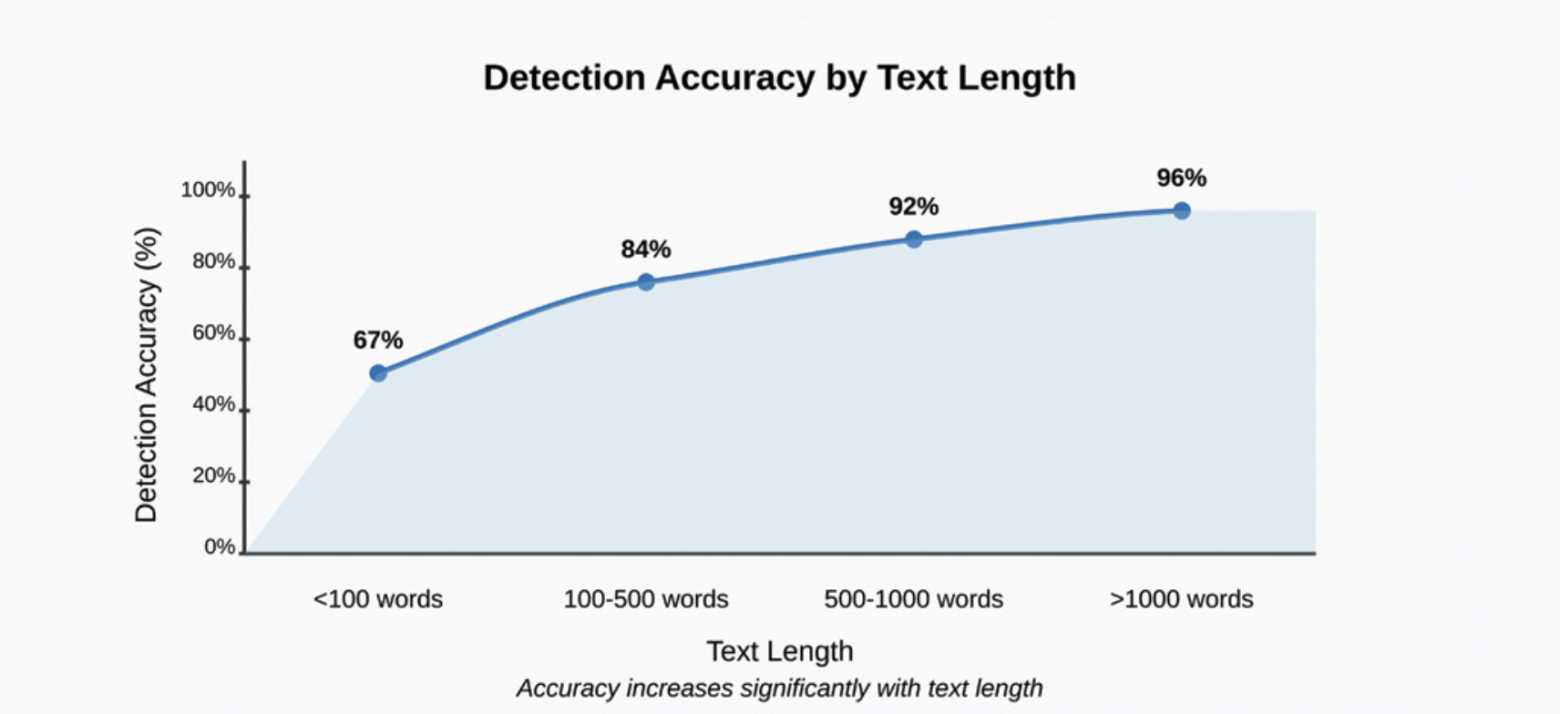

Точность оценки и ограничения

Надежность нашей методологии зависит от длины текста (рис. 4). Для материалов объемом менее 100 слов точность ограничена примерно 67%. По мере увеличения длины текста (при объеме более 1000 слов) она возрастает, достигая 96%.

Связь между точностью оценки и длиной текста объясняется тем, что длинные материалы содержат больше данных для выявления закономерностей. При анализе специализированных текстов (как правило, объемом свыше 500 слов) точность составляет более 90%.

Тесты подтверждают: при правильном применении наша методология позволяет отличить текст, написанный человеком, от сгенерированного. Такой многосторонний подход сохраняет эффективность даже по мере развития технологий ИИ, поскольку он основан на фундаментальных лингвистических различиях, а не на паттернах конкретных моделей.

Ключевые ограничения методологии:

-

Эффективность снижается при работе с очень короткими текстами (менее 100 слов).

-

Тщательная редактура текста, сгенерированного ИИ, может скрыть некоторые паттерны нейросетей. При этом многие признаки сохраняются даже после редактирования.

-

Развитие ИИ может привести к изменению некоторых лингвистических показателей.

Наша методология хорошо работает со многими языками. Однако для оптимального распознавания ИИ в разных языках ей требуется специальная корректировка. В настоящее время наиболее проработанными являются версии для английского и польского; также ведутся исследования по расширению методологии для других языков.

Заключение

Наша гибридная методология объединяет вычислительный и лингвистический анализ и позволяет с высокой вероятностью определять использование ИИ при создании текста. Благодаря одновременной оценке множества лингвистических признаков — от статистических и вероятностных параметров до закономерностей в употреблении конкретных слов — подход помогает выявить тонкие, но повторяющиеся отличия текстов, созданных ИИ.

Методология основана на всестороннем анализе современных исследований и подтверждена эмпирическим тестированием. Она обеспечивает высокую точность оценки, особенно для специализированных текстов объемом более 500 слов. По мере дальнейшего развития языковых моделей многосторонний подход к анализу текстов будет оставаться востребованным. Отдельные лингвистические показатели могут меняться, но фундаментальные различия в том, как человек и ИИ создают тексты, представляют собой долговечную основу для определения их происхождения.

Наша методология является ценным инструментом для профессионалов, работающих со специализированными материалами: часто в этой сфере вопрос авторства стоит особенно остро. В эпоху стремительно развивающихся языковых технологий наш подход будет способствовать повышению прозрачности в установлении происхождения текстов.

Войчех Волошик

Юрист-лингвист, юридический переводчик и судебный эксперт по правовой лингвистике. Генеральный директор компании IURIDICO, председатель Ассоциации поставщиков языковых услуг POLOT, координатор польского отделения Всемирного юридического словаря (World Law Dictionary PL Chapter). Специализируется на юридической терминологии и безопасном внедрении языковых технологий в переводческие процессы.

Марта Домашк

Руководитель отдела обеспечения качества в компании IURIDICO Legal & Financial Translations, член правления. Специалист по переводу документов ЕС и юридических текстов с 15-летним опытом работы в переводческой отрасли. Имеет диплом переводчика Варшавского университета.

Возможно, что-то в этой статье показалось вам очевидным, с чем-то вы не согласитесь, особенно применительно к русскому языку. Или у вас есть свои уникальные способы распознать нейротекст (на любом языке). Или вы, вообще, считаете проблему генерации ИИ-текстов надуманной… Давайте обсудим в комментариях!

Автор: Squirrelkate