Мультимодальные модели — звучит как что-то для исследовательских лабораторий и презентаций на AI-конференциях. Но на самом деле они уже работают здесь и сейчас: анализируют документы, пишут тексты, создают рекламу, генерируют видео, помогают врачам и юристам.

Это интервью с Александром Капитановым. Саша руководит исследовательскими ML-командами в Сбере. Активный контрибьютор в Open Source. А ещё он член программного комитета AiConf X и HighLoad++ от «Онтико».

Мы поговорили о том, какие реальные задачи решают мультимодальные LLM, зачем бизнесу модели, которые «умеют всё», и почему мультиканальность — это только шаг на пути, но ещё не конечная станция в развитии ИИ.

Привет! Расскажи немного о себе. Почему ты выбрал именно то, чем занимаешься?

Привет! Последние 5 лет я работаю в Сбере в Управлении Экспериментальных Систем Машинного Обучения. В область Data Science я перекатился из hardware-инженера, где до этого достаточно долго занимался цифровой обработкой сигналов на FPGA и ASIC-ах на низком уровне. Сейчас руковожу группой исследовательских команд, которые в совершенно разных областях ML решают задачи с использованием современных нейронных сетей, в частности с помощью мультимодальных больших языковых моделей. Область наших исследований достаточно широкая и покрывает такие домены, как обработка изображений и видео, анализ аудио и генерация речи, синтез музыки и пения, генерация векторной графики и многое другое.

Что из всего этого было самым интересным?

Самая интересная задача из свежих и актуальных — построить процессы в большой команде так, чтобы генерируемые идеи доходили до реализации, при этом не мешали основным приоритетным стримам, и приземлились либо в готовый продукт, которым будут пользоваться, либо попадали в крутую научную публикацию на конференции A/A* уровня (здесь пока с переменным успехом, но мы стараемся). Не менее интересной задачей было и остаётся распознавание русского жестового языка. Моя команда лидирует в задачах понимания изолированного и дактильного жестовых языков на мировых бенчмарках. Этот проект исключительно социальный, он не имеет материальной выгоды и призван снизить барьер в коммуникации. Вот статья о том, как мы это делали.

И, наверное, из совсем старых проектов — собственный открытый курс лекций по цифровой обработке сигналов. Правда я его давно забросил, однако это не помешало ему набрать больше тысячи звёздочек на гитхабе. Мечтаю когда-нибудь вернуться к нему и доделать недостающие материалы.

О всём интересном рассказывал на конференциях как спикер, а сейчас ещё и попал в программные комитеты разных конференций, включая Highload и AI Conf X, где буду уже непосредственно влиять на программу.

Как в наше время развиваться в AI? Нужно ли для этого ходить на конференции?

Если ты новичок, то тяжело. Каждый день выходит очередная новая статья, в которой последняя модель побивает вчерашние state-of-the-art подходы. Это, конечно, не технологическая сингулярность, но темпы развития области поражают. Ну а в целом, всё те же популярные бесплатные курсы от разных сообществ, чтение научных статей, набивание руки на реальных кейсах, включая участие в хакатонах и соревнованиях, а также мощности современных LLM в изучении нового материала вам в помощь.

Отмечу пользу конференций — они позволяют оперативно разобраться, что сейчас в тренде, какие технологии сейчас главенствуют в индустрии и как их можно применять. Регулярное посещение профессиональных мероприятий даёт понимание индустрии и возможность вовремя актуализировать свой стек и роадмап развития, а также получить заряд мотивации в работе.

Как ты стал членом ПК конференции AI Conf X?

Сначала сам выступал, а потом решил попробовать себя в новой роли. Хотелось не только делиться с участниками опытом и знаниями, но и развивать коммьюнити, задавать тренды и помогать другим участникам становиться уверенными спикерами. В ПК мне помог попасть наш супер-крутой DevRel Карина Тиничева, к которой я пришёл с четким запросом «хочу, могу». И всё заверте… Началось с Highload и понеслась.

Чем эта конференция будет отличаться от других?

На созвонах с программным комитетом звучит, что эта конференция «без случайных людей». На мой взгляд, в этом что-то есть. Мы очень качественно подходим к отбору докладов и не представляем какую-то одну компанию, поскольку в ПК есть люди из практически всех топовых IT-компаний. А если кого-то не хватает и вы хотите к нам — напишите мне, обсудим!

В то же время, эта конференция прекрасно дополняет существующие мероприятия по ML/AI, будь то DataFest, AI Journey от Сбера, митапы Т-Банка или конференции Yandex.

В программе мы собираем самые разные передовые темы во всех доменах — изображения и видео, музыка и речь, тексты и код. А главное — все это будет не абстрактно или в виде туториалов, а с прикладными кейсами из индустрии.

Как выглядит мультимодальная или омнимодальная архитектура нейросети?

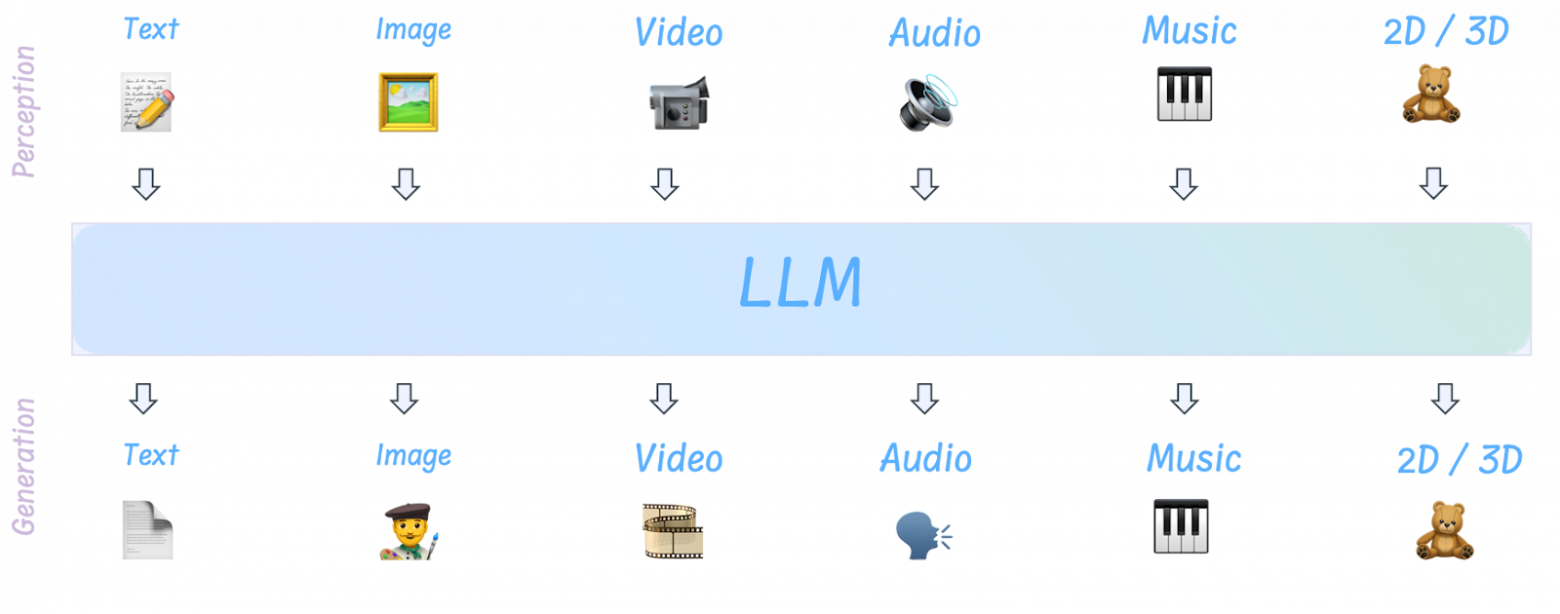

Современные мультимодальные архитектуры нейросетей представляют собой единые модели, способные воспринимать, обрабатывать и генерировать информацию в различных модальностях. Они понимают не только текстовый ввод, но также умеют работать с модальностью изображений и видео, аудио и речи, музыки, 3D, векторной 2D-графики и не только. Такие системы строятся на принципах модульности и унифицированного представления данных, что позволяет эффективно сочетать разнородные источники информации в одном латентном пространстве. На рисунке ниже представлена универсальная схема такой модели, она умеет принимать различные модальности на вход, решая задачу восприятия или понимания (“perception”) или задачу генерации (“generation”) новых данных в любой из модальностей.

На входе каждая модальность проходит через специализированный энкодер, преобразующий данные в универсальные токены (или векторы), пригодные для совместной обработки. Центральное ядро модели — это нейросетевая модель на базе трансформерной архитектуры, выполняющая кросс-модальное выравнивание, объединение контекста и извлечение смысла.

На выходе задействуются декодеры, возвращающие результат в целевой модальности, будь то визуальная генерация и редактирование изображений, озвучка, визуализация или реконструкция 3D-объекта. Такой подход обеспечивает не только обобщающую способность, но и гибкость в прикладных задачах — от поиска и генерации до автономного поведения и общения с пользователем. В отличие от узкоспециализированных решений, мультимодальные модели опираются на общее представление знаний и обучаются на связях между модальностями, а не только внутри них. Это позволяет им демонстрировать высокий уровень семантического понимания и взаимодействия с реальным миром в его естественном, многомодальном или омнимодальном виде.

Какие реальные бизнес-кейсы мультимодальных LLM уже доказали свою эффективность?

Мультимодальные LLM (Large Language Models), как было сказано выше, поддерживают ввод и вывод с помощью текста, но и умеют работать с изображениями, видео, аудио или музыкой, обрабатывают векторную графику и 3D. Некоторые из них уже доказали свою эффективность в реальных бизнес-кейсах. Вот самые яркие и известные примеры:

-

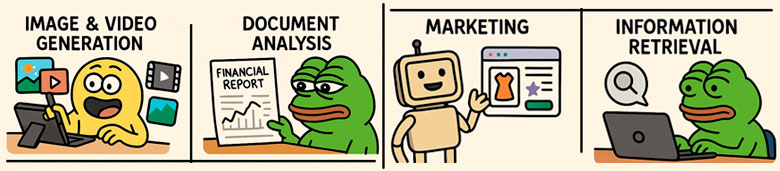

Генеративный AI позволяет создавать изображения, видео и аудиоконтент для рекламы, маркетинга и киноиндустрии, облегчает работу дизайнеров и редакторов (например, Adobe Firefly, Kling, Flux, Heygen, Runway, Midjourney, Kandinsky, Шедеврум и другие). Сюда же можно отнести сервисы генерации музыки и песен по текстовому запросу — Suno, Udio и даже «отечественный продукт» Symformer от Сбера.

-

Анализ документации. AI анализирует финансовые отчёты, сканирует документы, выявляет риски и автоматизирует процесс соблюдения регуляторных требований. Способен ускоренно обрабатывать огромные массивы данных и выявлять аномалии, снижающих финансовые риски (BloombergGPT, JP Morgan AI).

-

Маркетинг. В сфере розничной торговли и e-commerce AI анализирует фото товаров, генерирует описания, создаёт персонализированные рекомендации и даже помогает с дизайном витрин (Amazon, Shopify, Alibaba).

-

«Поиск» информации в сети — ChatGPT, Deepseek, Perplexity AI, Llama, Qwen-ы разных версий от китайских исследователей, отечественные версии LLM: GigaChat, YandexGPT и другие.

И этим применение моделей не ограничивается. AI внедряется в совершенно разные области — медицинская диагностика, автоматизированный маркетинг, промышленный контроль, беспилотный транспорт, промышленность, образование и т.д.

А как преодолеть «разрыв» между лабораторными бенчмарками вроде MMLU и сложностями интеграции моделей в промышленные системы?

Стоит ориентироваться на практическую адаптацию моделей к реальным бизнес-кейсам. Это включает тонкую настройку LLM на специфичные домены, сбор и разметку прикладных данных, а также разработку инфраструктуры для масштабируемого развёртывания и мониторинга.

Кроме того, критически важна гибридная стратегия тестирования: наряду с синтетическими метриками следует применять A/B-тесты, учитывать пользовательский фидбэк и автоматизированные метрики качества на реальных бизнес-задачах. Это позволит не только достичь высокой точности модели в контролируемых условиях, но и гарантировать её эффективность в динамической среде бизнеса.

Можно ли полностью устранить ошибки через архитектурные изменения или это фундаментальное ограничение LLM?

Ошибки в LLM точно можно уменьшить архитектурными улучшениями, хотя полностью устранить их пока невозможно. Всё-таки это пока еще перемножение матриц и щепотка теории вероятностей. Но интеграция продвинутых механизмов самообучения и усиленного контроля последовательности вывода, retrieval-augmented generation (RAG), даже в мультимодальных сценариях, помогает снизить галлюцинации и повысить достоверность ответов. Кроме того, специализированные механизмы (например, Mixture of Experts, MoE) позволяют адаптировать модель к узкоспециализированным задачам, улучшая её надёжность.

Но остаются фундаментальные ограничения — вероятность ошибок при генерации и сложность моделирования полной контекстной достоверности. Поэтому будущее за гибридными системами, объединяющими LLM с классическими алгоритмами, проверяемыми базами знаний и механизмами проверки фактов в реальном времени.

Как совместить креативность моделей с требованием к точности в узких сферах?

Этот вопрос немного пересекается с предыдущим. На самом деле также — за счёт адаптации с помощью дообучения на доменных данных (domain adaptation), инструкционного тонкого обучения (instruction tuning) и RAG-подходов (retrieval-augmented generation). Они как раз и позволяют интегрировать внешние источники знаний. Эти техники обеспечивают сохранение генеративных и креативных способностей модели, одновременно повышая её точность и надёжность в решении конкретных прикладных задач. Кроме того, использование механизмов самокритики (self-refinement), верификации ответов с помощью вспомогательных моделей или добавление ризонинга усиливает контроль за достоверностью вывода. На практике это позволяет LLM демонстрировать как гибкость в формулировке нестандартных решений, так и соответствие строгим требованиям предметной области. Подробнее можно почитать в обзорных статьях на архиве типа этой и этой.

Как оценить, что LLM/VLM действительно хорошо справляются с поставленными задачами?

Здесь всё просто — для этого есть бенчмарки :)

Например, для визуальных моделей — MMMU, LLaVA-Bench, MM-Vet, MathVision или MathVista, TextVQA, DocVQA, ChartQA, ScienceQA и другие, их правда много. Все они позволяют количественно сравнивать модели между собой по унифицированным метрикам. Но ввиду растущей сложности и разнообразия задач, особенно в реальных сценариях, нужны новые, более сложные и специализированные бенчмарки, которые позволят выявить тонкие различия в способностях моделей, лучше оценить их устойчивость, адаптивность и способность к обобщению.

Например, сейчас появляются модели с очень длинным контекстом, и хочется уметь правильно их оценивать. В визуальной модальности надо не просто понимать короткие видеоролики, но и видео длительностью более часа. Причём, важно не просто суммаризировать такие видео, но и уметь находить любые события в ролике на любом интервале времени, в том числе и по модальности аудио, если в видеозаписи присутствуют звуки или речь. В конечном счёте, хочется уметь оценивать модели по всем возможным модальностям, даже если модель представлена не единой омнимодальной архитектурой, а набором инженерных решений. А если это делать бесшовно не просто текстовыми запросами, а в режиме реального времени голосом, то получаем полноценный сложный мультимодальный комбайн, который умеет видеть, слышать, читать, писать, говорить и даже рисовать.

Почему мультимодальность считают «мостиком» к Artificial general intelligence?

AGI — сильный ИИ, который способен мыслить и действовать как человек и обладает самоконтролем. Пока это теория. Но мультимодальность — ключевой шаг к AGI, потому что расширяет способы восприятия и обработки информации, приближая модели к человеческому пониманию мира. Возможность совмещать текст, изображение, аудио и видео позволяет моделям сформировать более целостное представление о реальности, устраняя ограничения текстовых систем. Это критично для будущего AGI, так как человек тоже познаёт мир не через один канал, а через сложную интеграцию разных типов информации.

Однако мультимодальность сама по себе не устраняет ошибки логики, потому что текущие модели всё ещё статистические предсказатели, а не полноценные рассуждающие системы. Для реального AGI нужен не только мультимодальный ввод, но и прогрессивные механизмы рассуждения, долговременная память и способность к целенаправленному планированию. Поэтому мультимодальность — это важный шаг, но не финальный рубеж на пути к AGI.

Как ты считаешь, какое будущее у AI? Куда всё будет развиваться? Заменит ли AI креативные агентства или цифровой маркетинг? Будут ли их работу выполнять модели, генерирующих фото/видео «под ключ»?

ИИ в первую очередь будет помощником человека в рутинных задачах. Страшилки о том, что ИИ заменит дизайнеров и художников ушли в прошлое, и в этих специальностях ИИ-модели стали привычным инструментом, а модели как не умели нормально нарисовать пальчики, так и косячат до сих пор.

Тоже самое касается и программистов: современные LLM-модели решают задачи с leetcode куда лучше 99% кандидатов на собесах, при этом помогая писать качественный реальный код (привет, «вайб-кодинг»). Но это не делает модели сильнее инженеров. Это как если бы человек копал землю лопатой, а потом пересел на трактор: копать стало легче, новый инструмент позволил справляться с рутиной проще и быстрее. Автоматизация — это клёво, но о полной замене человека я бы в ближайшей перспективе не говорил.

На мой взгляд сейчас самый острый вопрос — как совместить мощь ИИ с контролем и безопасностью. Все попытки зарегулировать модели и проверки на риски, как правило, приводят к торможению развития технологий. Это приводит к тому, что талантливые исследователи и компании перемещают разработки в юрисдикции с более гибкими правилами, ослабляя научное и, возможно, экономическое лидерство компаний. Кроме того, создается разобщение в сообществе, а замедление прогресса в ИИ может привести к гонке на искусственных бенчмарках, что также может помешать решению реальных проблем общества. Вместо блокирующего контроля важно разрабатывать адаптивные и прозрачные механизмы безопасности, не подавляя развитие индустрии.

В заключение стоит ещё раз отметить, что мультимодальные системы сегодня становятся важным шагом в направлении создания общего искусственного интеллекта (AGI). Способность таких моделей работать сразу с несколькими типами модальностей позволяет им лучше понимать сложные ситуации и действовать более осмысленно. Это открывает новые возможности как для научных исследований, так и для прикладных бизнес-задач. Особенно интересно, что такие системы могут быть полезны не только бизнесу, но и обществу в целом — например, в образовании, здравоохранении или помощи людям с ограниченными возможностями. Stay trained and have fun :)

Прикладная техническая конференция по Data Science 26 сентября 2025 оффлайн в Москве и онлайн в любой точке мира. Подробная информация на официальном сайте конференции AiConf X 2025.

Автор: hukenovs